Das Web wächst in einem Tempo, mit dem man ehrlich gesagt kaum Schritt halten kann – bis 2026 sind fast , und ein riesiger Teil davon sind Unternehmen, die Daten scrapen, um Vertrieb, Betrieb und Wettbewerbsanalysen anzutreiben. Aus eigener Erfahrung habe ich gesehen, wie sich Web-Scraping von einem „Nice-to-have“ für Techies zu einem absoluten Muss für alle entwickelt hat – von Vertriebsteams bis hin zu Immobilienmaklern. Aber hier liegt der Haken: Nicht alle Web-Scraping-Unternehmen sind gleich, und die richtige Wahl kann den Unterschied machen zwischen einem reibungslosen, automatisierten Workflow und einer Woche voller Copy-Paste-Frust.

Also habe ich die Ärmel hochgekrempelt und die führenden Web-Scraping-Unternehmen für 2026 gründlich unter die Lupe genommen. Egal, ob Sie ein nicht-technischer Nutzer sind, der Daten einfach mit zwei Klicks möchte, oder ein Entwickler, der volle Kontrolle braucht – diese Liste deckt die Besten der Besten ab. Dazu gibt es ehrliche Einschätzungen dazu, wo jedes Tool glänzt und wo nicht. Los geht’s.

Warum Unternehmen die besten Web-Scraping-Unternehmen brauchen

Wenn Sie schon einmal versucht haben, eine Lead-Liste aufzubauen, Wettbewerberpreise zu überwachen oder Produktdaten von Dutzenden (oder Tausenden) Seiten zu ziehen, kennen Sie den Schmerz der manuellen Datenerfassung. Sie ist langsam, fehleranfällig und – seien wir ehrlich – niemandes Vorstellung von guter Zeit. Deshalb ist , in der Unternehmen es für alles Mögliche einsetzen: von und Preisbeobachtung bis hin zu Marktforschung und Stimmungsanalysen.

Die eigentliche Magie? Automatisierung. Moderne Web-Scraping-Unternehmen ermöglichen Ihnen:

- Wiederkehrende Recherche automatisieren (kein endloses Copy-Paste mehr)

- Auf Tausende Seiten skalieren – ohne zusätzlichen Aufwand

- Daten direkt integrieren in Ihre Lieblingstools (Excel, Google Sheets, Notion, CRMs)

- Wettbewerbern voraus sein durch aktuellere, bessere Daten – schneller

Aber bei so vielen Optionen: Wie wählt man die richtige aus? Genau dafür ist dieser Leitfaden da.

Wie wir die besten Web-Scraping-Unternehmen bewertet haben

Nicht jeder Scraper ist für denselben Nutzer – oder dieselbe Aufgabe – gebaut. So habe ich das Feld bewertet:

- Benutzerfreundlichkeit: Können auch Nicht-Programmierer schnell Ergebnisse erzielen? Ist die Oberfläche intuitiv?

- Automatisierung & Funktionen: Unterstützt das Tool Paginierung, Unterseiten, Zeitplanung und dynamische Inhalte?

- Skalierbarkeit: Taugt es für große Projekte, oder ist es eher für kleinere Jobs geeignet?

- Integration: Wie einfach lassen sich Daten exportieren oder mit anderen Tools verbinden?

- Preisgestaltung: Gibt es einen kostenlosen Tarif? Ist es für KMU erschwinglich und für Unternehmen skalierbar?

- Support & Community: Gibt es Tutorials, Vorlagen und echte Hilfe, wenn man sie braucht?

Ich habe auch darauf geachtet, was jedes Unternehmen einzigartig macht – denn manchmal ist das „beste“ Tool nicht das mit den meisten Funktionen, sondern das, das wirklich zu Ihrem Workflow passt.

Gut, kommen wir zur Liste.

1. Thunderbit

ist der KI-gestützte Web-Scraper, auf den ich mich für 2026 am meisten freue – und nicht nur, weil ich selbst daran mitgebaut habe! Thunderbit ist für Business-Anwender entwickelt, die Daten wollen und keinen Frust. Die Chrome-Erweiterung ermöglicht es, jede Website mit natürlichen Sprachbefehlen und KI-gestützten Feldvorschlägen zu scrapen. Kein Code, keine Vorlagen, kein Stress.

ist der KI-gestützte Web-Scraper, auf den ich mich für 2026 am meisten freue – und nicht nur, weil ich selbst daran mitgebaut habe! Thunderbit ist für Business-Anwender entwickelt, die Daten wollen und keinen Frust. Die Chrome-Erweiterung ermöglicht es, jede Website mit natürlichen Sprachbefehlen und KI-gestützten Feldvorschlägen zu scrapen. Kein Code, keine Vorlagen, kein Stress.

Warum Thunderbit heraussticht:

- Scraping mit 2 Klicks: Einfach auf „KI-Felder vorschlagen“ und „Scrapen“ klicken – Thunderbits KI erledigt den Rest.

- Unterseiten- und Paginierungs-Unterstützung: Listen lassen sich ganz einfach scrapen, danach besucht die KI jede Unterseite für weitere Details.

- Sofortvorlagen: Für beliebte Websites (Amazon, Zillow, Shopify usw.) gibt es vorgefertigte Vorlagen für Scraping mit einem Klick.

- Kostenloser Datenexport: Exportieren Sie nach Excel, Google Sheets, Notion oder Airtable – ohne Paywall für Ihre eigenen Daten.

- KI-Datenanreicherung: Daten beim Scrapen labeln, kategorisieren und übersetzen.

- Geplantes & Cloud-Scraping: Wiederkehrende Jobs einrichten oder Scrapes in der Cloud ausführen, um Zeit zu sparen.

- Völlig kostenloser Tarif: Bis zu 6 Seiten kostenlos scrapen, oder 10 mit einem Test-Boost. Bezahlte Pläne beginnen bei 15 $/Monat.

Thunderbit wird von über geschätzt – von Vertriebsteams bis zu E-Commerce-Betreibern. Wenn Sie 2026 das einfachste und nutzerfreundlichste Web-Scraping-Erlebnis suchen, ist Thunderbit kaum zu schlagen.

Sie möchten sehen, wie es funktioniert? und testen Sie es selbst.

2. Scrapy

ist das Open-Source-Python-Framework der Wahl für Entwickler, die volle Kontrolle wollen. Es ist leistungsstark, flexibel und in der Praxis bewährt – von kleinen Websites bis hin zum Scrapen von Millionen Seiten.

ist das Open-Source-Python-Framework der Wahl für Entwickler, die volle Kontrolle wollen. Es ist leistungsstark, flexibel und in der Praxis bewährt – von kleinen Websites bis hin zum Scrapen von Millionen Seiten.

Am besten geeignet für: Tech-Teams, Data Engineers und alle, die sich mit Python wohlfühlen.

Wichtige Funktionen:

- Benutzerdefinierte Regeln: Spiders für jede beliebige Website-Struktur bauen.

- Skalierbar & schnell: Meistert groß angelegtes Scraping mit robuster Fehlerbehandlung.

- Integration ins Python-Ökosystem: Lässt sich mit Pandas, Jupyter und mehr verbinden.

- Kostenlos & Open Source: Keine Lizenzgebühren, große Community-Unterstützung.

Hinweis: Scrapy hat eine gewisse Lernkurve. Wenn Sie kein Programmierer sind, sollten Sie sich eher nach einer anderen Lösung umsehen. Für Entwickler ist es jedoch ein echtes Kraftpaket ().

3. ParseHub

ist eine Desktop-App, die Web-Scraping visuell und zugänglich macht. Mit der Point-and-Click-Oberfläche lassen sich Scraper ohne Code erstellen.

ist eine Desktop-App, die Web-Scraping visuell und zugänglich macht. Mit der Point-and-Click-Oberfläche lassen sich Scraper ohne Code erstellen.

Am besten geeignet für: KMU, Forschende und Nicht-Programmierer, die Flexibilität wollen.

Wichtige Funktionen:

- Visueller Workflow: Daten per Klick auswählen und Logik für Paginierung und Unterseiten aufbauen.

- Cloud-basiertes Scheduling: Scrapes nach Zeitplan ausführen, selbst wenn der Computer aus ist.

- Exportoptionen: Download als CSV, Excel oder JSON.

- Kostenloser Plan: 5 Projekte, bis zu 200 Seiten pro Lauf; bezahlte Pläne ab 39 $/Monat.

ParseHub ist besonders beliebt für das Scrapen von Verzeichnissen, Bewertungen und E-Commerce-Daten ().

4. Octoparse

ist eine No-Code-Web-Scraping-Plattform mit Drag-and-Drop-Fokus und Automatisierung im großen Maßstab. Sie eignet sich hervorragend für Teams, die komplexe Jobs ohne Skripte einrichten möchten.

ist eine No-Code-Web-Scraping-Plattform mit Drag-and-Drop-Fokus und Automatisierung im großen Maßstab. Sie eignet sich hervorragend für Teams, die komplexe Jobs ohne Skripte einrichten möchten.

Am besten geeignet für: Marketing-, Forschungs- und Operationsteams.

Wichtige Funktionen:

- Drag-and-Drop-Workflow: Scraper visuell bauen, dynamische Inhalte und endloses Scrollen verarbeiten.

- Cloud-Scraping & Scheduling: Jobs in der Cloud ausführen, wiederkehrende Aufgaben planen.

- IP-Rotation & Anti-Block: Integrierte Funktionen für schwierige Websites.

- Export nach Excel, Sheets, Datenbanken: Einfache Integration in Ihren Workflow.

- Kostenloser Tarif: Bis zu 10.000 Datensätze/Monat; bezahlte Pläne ab 75 $/Monat.

Octoparse wird besonders für seine Geschwindigkeit und die Fähigkeit geschätzt, große Projekte zu bewältigen ().

5. DataMiner

ist eine Chrome-Erweiterung, die Web-Scraping direkt in Ihren Browser bringt. Sie ist perfekt für schnelles, vorlagenbasiertes Scraping von Tabellen, Listen und einfachen Websites.

ist eine Chrome-Erweiterung, die Web-Scraping direkt in Ihren Browser bringt. Sie ist perfekt für schnelles, vorlagenbasiertes Scraping von Tabellen, Listen und einfachen Websites.

Am besten geeignet für: Alltagsnutzer, Sales Ops und alle, die in Chrome zu Hause sind.

Wichtige Funktionen:

- Vorlagen-Marktplatz: Über 60.000 vorgefertigte Rezepte für beliebte Websites.

- Point-and-Click-Extraktion: Daten visuell auswählen, kein Code nötig.

- Export nach Excel/Google Sheets: Export mit einem Klick.

- Kostenloser Plan: 500 Seiten/Monat; bezahlte Pläne ab 19 $/Monat.

DataMiner ist ein Favorit für schnelle Jobs und nicht-technische Nutzer ().

6. Import.io

ist eine Enterprise-Plattform, die darauf ausgelegt ist, Webinhalte in strukturierte Daten für Analysen und Business Intelligence umzuwandeln.

ist eine Enterprise-Plattform, die darauf ausgelegt ist, Webinhalte in strukturierte Daten für Analysen und Business Intelligence umzuwandeln.

Am besten geeignet für: Unternehmen mit hohem Datenbedarf und Integrationsanforderungen.

Wichtige Funktionen:

- Managed-Service-Modell: Das Team von Import.io kann Scraper für Sie entwickeln und warten.

- Visuelle Benutzeroberfläche: Extraktions-Workflows ohne Code aufbauen.

- API-Zugriff: Scraped Daten direkt in Ihre Apps und Dashboards integrieren.

- Compliance & Sicherheit: Kontrollen auf Enterprise-Niveau, PII-Maskierung und mehr.

Preisgestaltung: Individuelle Angebote, typischerweise ab etwa 299 $/Monat ().

7. Apify

ist eine entwicklerfreundliche Automatisierungsplattform mit einem riesigen Marktplatz vorgefertigter „Actors“ (Scraping-Bots) und der Möglichkeit, eigene Workflows zu bauen.

ist eine entwicklerfreundliche Automatisierungsplattform mit einem riesigen Marktplatz vorgefertigter „Actors“ (Scraping-Bots) und der Möglichkeit, eigene Workflows zu bauen.

Am besten geeignet für: Entwickler, Agenturen und Teams, die Flexibilität wollen.

Wichtige Funktionen:

- Actor-Marktplatz: Fertige Scraper für beliebte Websites oder eigene erstellen.

- Cloud-Infrastruktur: Scrapes im großen Maßstab ausführen, Jobs planen und mit APIs integrieren.

- GitHub-Integration: Workflows und CI/CD automatisieren.

- Pay-as-you-go: Kostenlose Credits, danach nutzungsbasiertes Bezahlen; bezahlte Pläne ab 39 $/Monat.

Apify ist ideal sowohl für einfache als auch für komplexe Projekte ().

8. Diffbot

nutzt KI und Knowledge Graphs, um unstrukturierte Webinhalte in strukturierte, maschinenlesbare Daten zu verwandeln. Man kann es als das „Gehirn“ des Web-Scrapings betrachten.

nutzt KI und Knowledge Graphs, um unstrukturierte Webinhalte in strukturierte, maschinenlesbare Daten zu verwandeln. Man kann es als das „Gehirn“ des Web-Scrapings betrachten.

Am besten geeignet für: Unternehmen, Forschende und alle, die groß angelegte, automatisierte Extraktion benötigen.

Wichtige Funktionen:

- KI-gesteuerte Extraktion: Erkennt Artikel, Produkte, Organisationen und mehr automatisch.

- Knowledge Graph: Zugriff auf den weltweit größten Web-Daten-Graphen per API.

- Datenanreicherung: Verwandte Entitäten, Nachrichten und Kontext einbeziehen.

- API-first: Integration mit BI-Tools und Datenpipelines.

Preisgestaltung: Ab 299 $/Monat ().

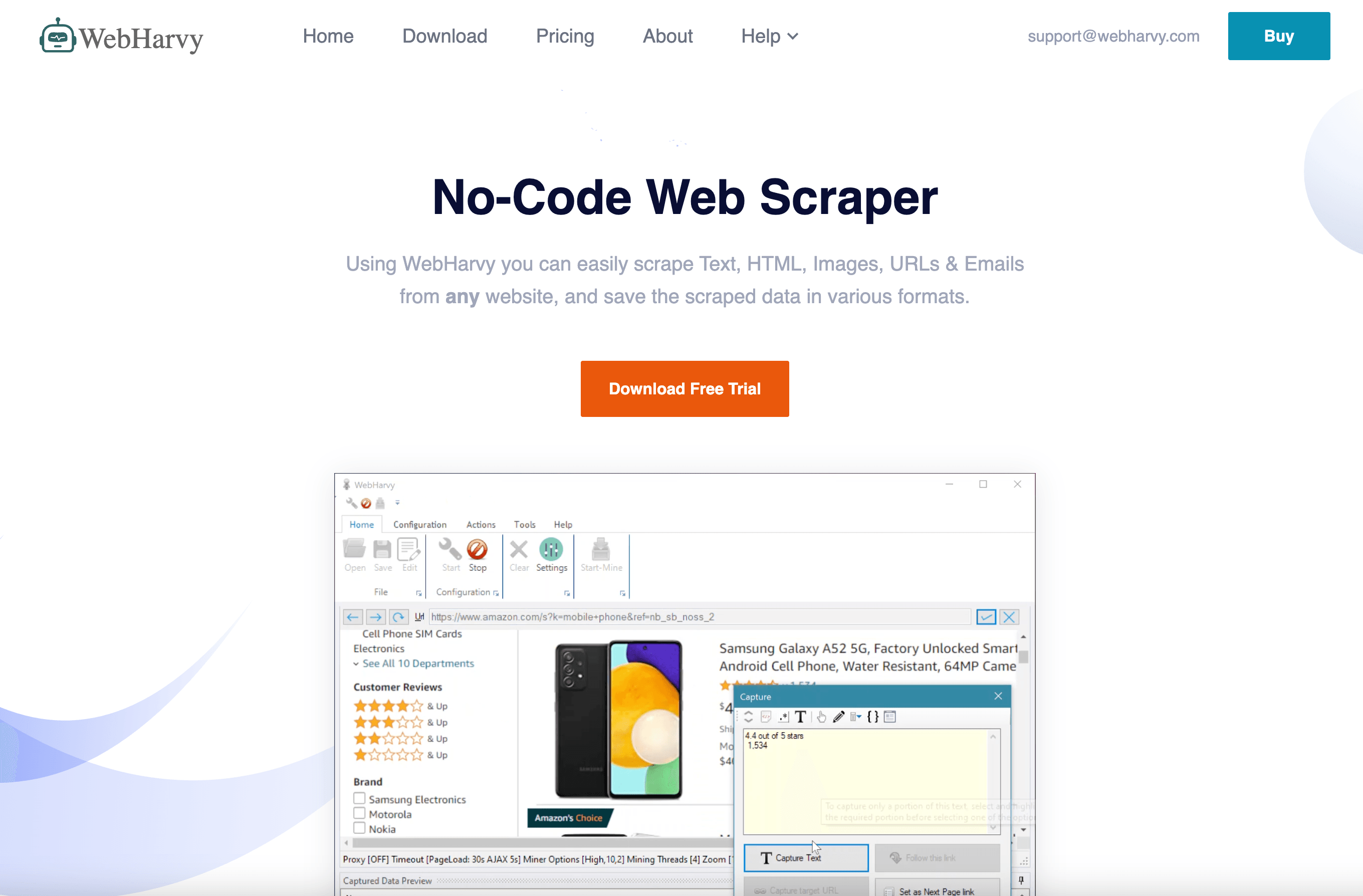

9. WebHarvy

ist ein Windows-basiertes Desktop-Scraping-Tool mit visueller Point-and-Click-Oberfläche. Es eignet sich hervorragend für Nutzer, die ohne Code arbeiten und eine Desktop-App bevorzugen.

ist ein Windows-basiertes Desktop-Scraping-Tool mit visueller Point-and-Click-Oberfläche. Es eignet sich hervorragend für Nutzer, die ohne Code arbeiten und eine Desktop-App bevorzugen.

Am besten geeignet für: Windows-Nutzer, Forschende und KMU.

Wichtige Funktionen:

- Visuelle Auswahl: Auf Daten klicken, um Felder zu definieren – kein Code nötig.

- Unterstützt Bilder & mehrseitige Navigation: Text und Bilder scrapen und Paginierung folgen.

- Export nach Excel, XML, Datenbanken: Flexible Ausgabeoptionen.

- Einmalige Lizenz: Einmal zahlen, für immer nutzen ().

WebHarvy ist besonders beliebt für das Scrapen von E-Commerce- und Kleinanzeigen-Seiten ().

10. Mozenda

ist eine cloudbasierte Plattform für Datenextraktion und Automatisierung im Enterprise-Maßstab.

ist eine cloudbasierte Plattform für Datenextraktion und Automatisierung im Enterprise-Maßstab.

Am besten geeignet für: Große Organisationen, compliance-sensible Branchen.

Wichtige Funktionen:

- Cloud-Automatisierung: Scraping-Jobs zentral planen, überwachen und verwalten.

- Datentransformation: Daten bereinigen, anreichern und in mehreren Formaten exportieren.

- Teamzusammenarbeit: Unterstützung für mehrere Nutzer und Workflow-Management.

- Enterprise-Support: Compliance, Zuverlässigkeit und dedizierte Hilfe ().

Preisgestaltung: Rund 99 $/Monat; Enterprise-Preise verfügbar.

11. Sequentum

ist ein fortgeschrittener Desktop-/Web-Scraper für Datenprofis und Agenturen.

ist ein fortgeschrittener Desktop-/Web-Scraper für Datenprofis und Agenturen.

Am besten geeignet für: Datenprofis, Agenturen und alle, die tiefe Automatisierung brauchen.

Wichtige Funktionen:

- Erweitertes Scripting: Komplexe Extraktionslogik automatisieren.

- Reporting & Monitoring: Jobs verfolgen, Warnungen erhalten und große Projekte verwalten.

- Integration: Export in Datenbanken, APIs oder Cloud-Speicher.

- Kein kostenloser Tarif: Nur kostenpflichtige Lizenzen ().

Sequentum ist für hochvolumige, individuell anpassbare Extraktion gebaut.

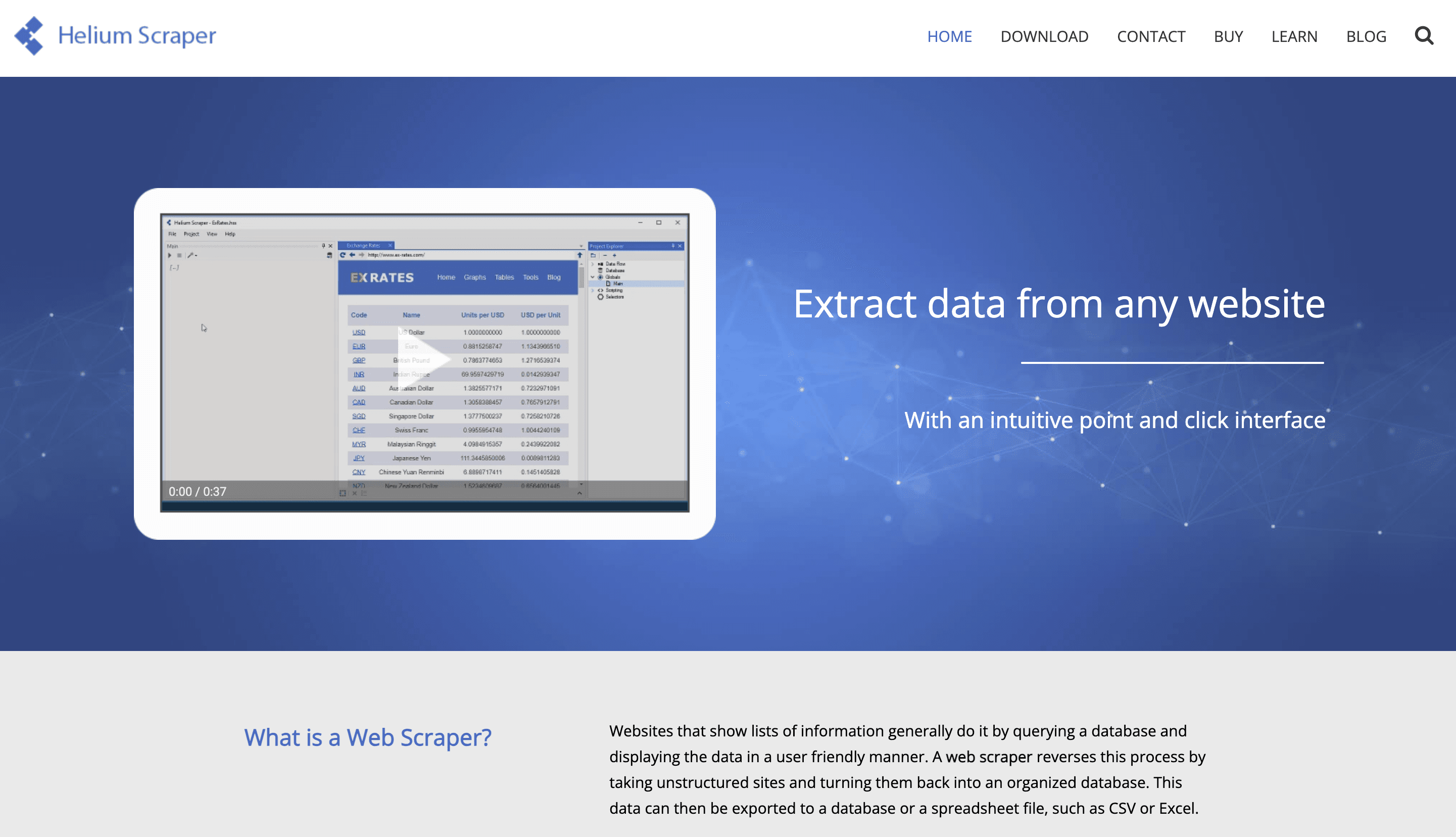

12. Helium Scraper

ist ein Desktop-Tool mit visuellem Workflow-Builder, ideal für die Extraktion von Daten aus komplexen und dynamischen Websites.

ist ein Desktop-Tool mit visuellem Workflow-Builder, ideal für die Extraktion von Daten aus komplexen und dynamischen Websites.

Am besten geeignet für: Power-User, Analysten und alle, die Flexibilität ohne Code wollen.

Wichtige Funktionen:

- Visueller Workflow: Drag-and-Drop-Oberfläche zum Erstellen der Extraktionslogik.

- Verarbeitet dynamische Inhalte: Funktioniert auch mit JavaScript-lastigen Websites.

- Datentransformation: Daten vor dem Export bereinigen und organisieren.

- Exportoptionen: Excel, CSV, Datenbanken und mehr.

- Einmalige Gebühr: Rund 199 $ für eine unbefristete Lizenz ().

Helium Scraper eignet sich besonders gut für untypische Websites und individuelle Workflows.

Die besten Web-Scraping-Unternehmen im Vergleich: Funktionen auf einen Blick

Hier ist ein schneller Vergleich, damit Sie die richtige Lösung finden:

| Unternehmen | Am besten geeignet für | Benutzerfreundlichkeit | Automatisierung & KI | Skalierbarkeit | Exportoptionen | Kostenloser Tarif / Preis |

|---|---|---|---|---|---|---|

| Thunderbit | Nicht-Programmierer, KMU | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | Excel, Sheets, Notion | Kostenlos (6 Seiten), ab 15 $/Monat |

| Scrapy | Entwickler | ⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | Python, CSV, DB | Kostenlos, Open Source |

| ParseHub | KMU, Forschende | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | CSV, Excel, JSON | Kostenlos (5 Projekte), ab 39 $ |

| Octoparse | Ops, Marketing | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | Excel, DB, API | Kostenlos (10.000 Zeilen), ab 75 $ |

| DataMiner | Chrome-Nutzer | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐ | Excel, Sheets | Kostenlos (500 Seiten), ab 19 $ |

| Import.io | Unternehmen | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | API, DB, Cloud | Individuell, ab 299 $/Monat |

| Apify | Entwickler, Agenturen | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | API, DB, Sheets | Kostenlose Credits, ab 39 $/Monat |

| Diffbot | Forschung, Analysen | ⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | API, Knowledge Graph | 299 $/Monat |

| WebHarvy | Windows-Nutzer | ⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐ | Excel, XML, DB | Einmalig, ab 139 $ |

| Mozenda | Unternehmen | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | Excel, API, Cloud | ab 99 $/Monat, Enterprise |

| Content Grabber | Datenprofis, Agenturen | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DB, API, Cloud | Nur kostenpflichtige Lizenz |

| Helium Scraper | Power-User, Analysten | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | Excel, CSV, DB | Einmalig, 199 $ |

Schnelle Empfehlungen:

- Für Nicht-Programmierer: Thunderbit, DataMiner, ParseHub, WebHarvy

- Für Entwickler: Scrapy, Apify, Content Grabber

- Für Unternehmen: Import.io, Diffbot, Mozenda

- Für flexible, visuelle Workflows: Thunderbit, Octoparse, Helium Scraper

Fazit: Den richtigen Web-Scraping-Partner für Ihr Unternehmen wählen

Web-Scraping im Jahr 2026 ist nicht nur etwas für Techies – es ist eine zentrale Geschäftsfähigkeit für alle, die Daten brauchen, um schneller bessere Entscheidungen zu treffen. Das richtige Web-Scraping-Unternehmen kann Ihnen Stunden sparen, Ihren ROI steigern und Erkenntnisse freilegen, die Ihrer Konkurrenz entgehen könnten.

Mein Rat:

- Tool und Team passend zusammenbringen: Nicht-technische Nutzer werden Thunderbit oder DataMiner lieben. Entwickler sollten Scrapy oder Apify anschauen. Unternehmen sollten Import.io oder Diffbot prüfen.

- Skalierung und Integration mitdenken: Müssen Sie Tausende Seiten scrapen? Wollen Sie Daten in Sheets, Notion oder in Ihrem CRM?

- Mit einer kostenlosen Testversion starten: Die meisten Tools bieten einen Gratis-Tarif an – testen Sie sie an einem echten Projekt, bevor Sie sich festlegen.

- Keine Angst vor Tool-Kombinationen: Manchmal ist der beste Workflow eine Kombination aus mehreren Tools.

Und wenn Sie sehen wollen, wie einfach Web-Scraping sein kann, . Ihre Tabellenkalkulationen (und Ihre Nerven) werden es Ihnen danken.

Für weitere Deep Dives, Tipps und Tutorials schauen Sie im vorbei.

FAQs

1. Was ist Web-Scraping und warum ist es 2026 für Unternehmen wichtig?

Web-Scraping ist der automatisierte Prozess, bei dem Daten von Websites extrahiert werden. Für Unternehmen ist das entscheidend, weil es schnelle Datenerfassung im großen Maßstab für Lead-Generierung, Preisüberwachung, Marktforschung und mehr ermöglicht – das spart Zeit und verbessert die Entscheidungsfindung.

2. Welches Web-Scraping-Unternehmen ist am besten für nicht-technische Nutzer geeignet?

Thunderbit und DataMiner sind dank ihrer KI-gesteuerten und visuellen Oberflächen die besten Optionen für Nicht-Programmierer. Beide ermöglichen es, Daten mit nur wenigen Klicks zu extrahieren – ganz ohne Code.

3. Auf welche Funktionen sollte ich bei einem Web-Scraping-Unternehmen achten?

Achten Sie auf Benutzerfreundlichkeit, Automatisierung (Paginierung, Unterseiten, Zeitplanung), Skalierbarkeit, Exportoptionen (Excel, Sheets, APIs) und starken Kundensupport. Wählen Sie ein Tool, das zu Ihren technischen Fähigkeiten und geschäftlichen Anforderungen passt.

4. Gibt es kostenlose Web-Scraping-Lösungen?

Ja! Thunderbit, DataMiner, ParseHub und Octoparse bieten kostenlose Tarife an. Scrapy ist Open Source und für Entwickler kostenlos. Kostenlose Pläne sind ideal für kleine Projekte oder zum Testen, bevor Sie skalieren.

5. Wie bleibe ich beim Scrapen von Daten regelkonform und ethisch?

Beachten Sie immer die Nutzungsbedingungen und Datenschutzrichtlinien der Website. Scrapen Sie nur öffentlich verfügbare Daten, überlasten Sie Websites nicht und achten Sie auf Datenschutzvorschriften wie die DSGVO. Viele führende Web-Scraping-Unternehmen bieten Compliance-Funktionen und Best-Practice-Leitfäden an.

Bereit, intelligenter zu scrapen? oder weitere Anleitungen im entdecken.

Mehr erfahren