Bilder sind überall — in Produktgalerien, Immobilienanzeigen und Konkurrenzkatalogen. Wenn du im Vertrieb, Marketing oder in der Recherche arbeitest, hast du vermutlich schon einmal Dutzende oder sogar Hunderte Bilder von Websites zusammengesucht.

Niemand speichert gern 500 Bilder per Rechtsklick. Genau dafür gibt es Image-Scraper-Tools.

Ich habe bei 10 Optionen getestet — von Browser-Erweiterungen bis zu Python-Bibliotheken. Hier erfährst du, was sich für welche Anforderungen am besten eignet.

Warum du 2026 einen Image Scrapper brauchst

Visuelle Inhalte sind nicht nur hübsches Beiwerk — sie sind Business Intelligence. Beiträge mit Bildern erhalten bis zu , und das Engagement in sozialen Medien kann um steigen, wenn du visuelle Elemente ergänzt. Unternehmen scrapen Bilder für alles — von Marktforschung, um Trends in Konkurrenzkatalogen zu erkennen, über Content-Erstellung, um sich mit Produktfotos einzudecken, bis hin zum KI-Training, um Modelle mit beschrifteten Fotos zu füttern.

Aber hier liegt das Problem: Websites werden immer komplizierter. Bilder laden dynamisch, verstecken sich hinter endlosem Scrollen oder liegen auf Unterseiten. Manuelles Herunterladen ist langsam, fehleranfällig und — ehrlich gesagt — zermürbend. Und für nicht-technische Teams ist das Schreiben eines eigenen Crawlers praktisch Raketenwissenschaft.

Genau hier kommen moderne Image-Scrapper-Tools ins Spiel. Sie übernehmen die mühsame Arbeit, kommen mit komplexen Websites zurecht und ermöglichen es jedem — ja, sogar deinem Kollegen, der „nur Excel benutzt“ —, Bilder im großen Stil zu sammeln. Der Markt für Web-Scraping-Software boomt und soll 2026 , während inzwischen über Web Scraping für geschäftliche Erkenntnisse nutzen. Kurz gesagt: Wenn du keinen Image Scrapper verwendest, bist du schon im Rückstand.

Wie wir die besten Image-Scrapper-Tools ausgewählt haben

Nicht alle Image Scrapper sind gleich. Darauf habe ich bei den Top 10 geachtet:

- Einfachheit: Kommt auch ein Nicht-Programmierer in wenigen Minuten zu Ergebnissen? Natürliche Sprache, Point-and-Click-Oberflächen und sofortiges Feedback sind klare Vorteile.

- Exportoptionen: Lässt sich das Tool direkt nach Excel, Google Sheets, Notion oder per API exportieren? Integrationen sind für Business-Workflows entscheidend.

- Anpassbarkeit & Flexibilität: Kommt es mit Logins, dynamischen Inhalten oder eigener Extraktionslogik zurecht? Fortgeschrittene Nutzer brauchen mehr als nur „Speichern unter“.

- Automatisierung & Planung: Lässt sich das Ganze einmal einrichten und dann vergessen? Geplante Scrapes und Cloud-Verarbeitung sind bei wiederkehrenden Aufgaben Gold wert.

- Skalierbarkeit: Schafft das Tool auch 10.000 Bilder? Es muss sowohl kleine als auch große Jobs bewältigen können.

- Preis & Gegenwert: Gibt es eine kostenlose Stufe? Ist der Preis für kleine Teams sinnvoll oder eher auf Enterprise-Budgets ausgelegt?

Vor diesem Hintergrund findest du hier die 10 besten Image-Scrapper-Tools für 2026 — jedes mit eigenen Stärken, Eigenheiten und idealen Einsatzszenarien.

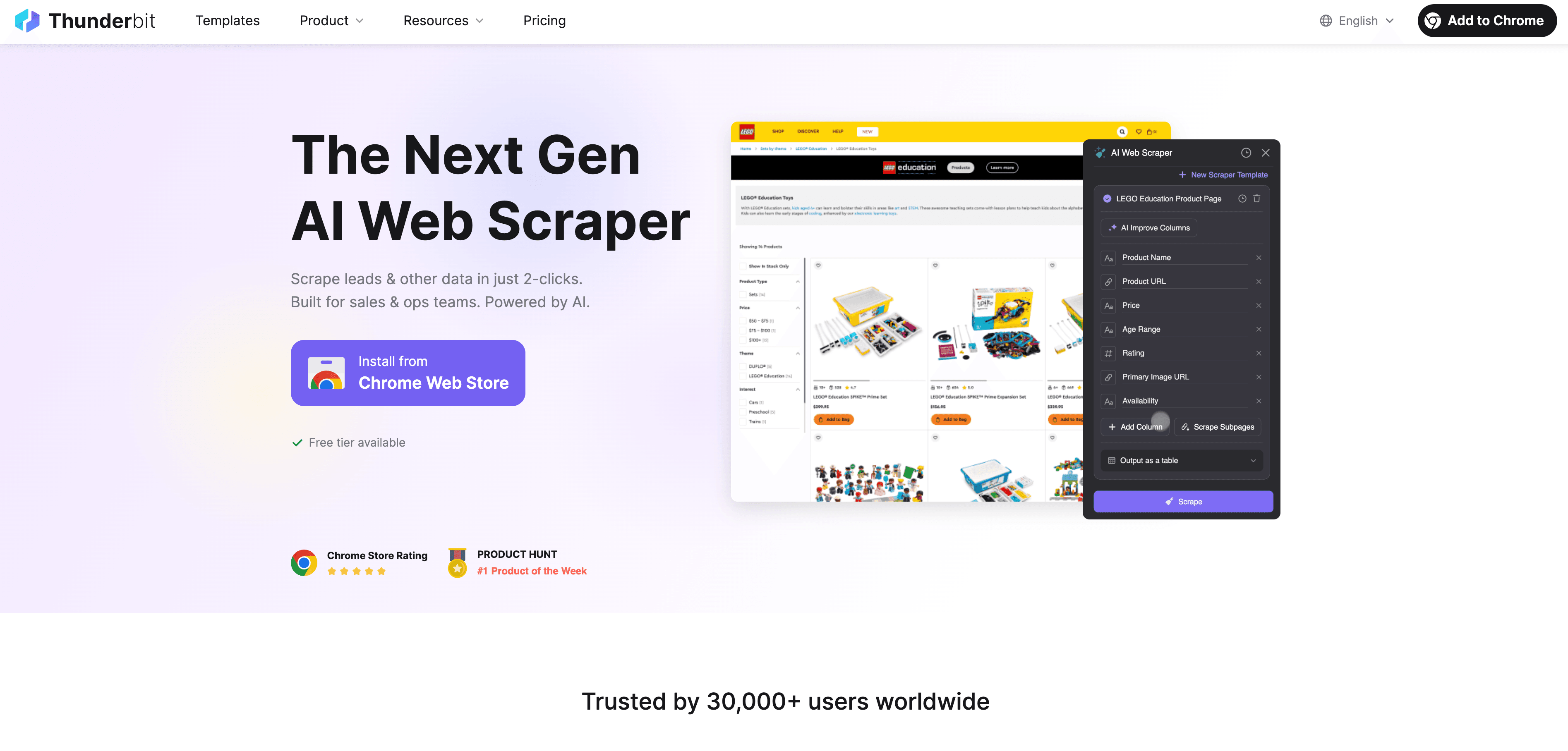

1. Thunderbit

ist meine erste Wahl für nicht-technische Teams und alle, die Bilder mit möglichst wenig Aufwand extrahieren wollen. Als Mitgründer bin ich natürlich etwas voreingenommen — aber unsere Mission war schon immer, Web Scraping so einfach zu machen, dass sogar deine Oma damit klarkommt (vorausgesetzt, sie interessiert sich für Wettbewerbsanalysen).

Was Thunderbit so besonders macht: Es geht vor allem um Einfachheit. Einfach auf „AI Suggest Fields“ klicken, die KI alle Bilder (und alle anderen gewünschten Daten) erkennen lassen und dann auf „Scrape“ drücken. Thunderbit navigiert automatisch durch Unterseiten, kommt mit endlosem Scrollen zurecht und exportiert Bilder direkt nach Excel, Google Sheets, Airtable oder Notion. Du kannst sogar die kostenlose nutzen, um jedes Bild auf einer Seite mit einem Klick zu extrahieren — kein Setup, kein Code.

Wichtige Funktionen:

- Bilderextraktion in 2 Klicks (die KI erledigt die Schwerstarbeit)

- Unterseiten-Scraping (Bilder von Detailseiten automatisch erfassen)

- Kostenlose Extraktoren für Bilder/E-Mails/Telefonnummern

- Sofortiger Export nach Sheets, Notion, Airtable, Excel, CSV oder JSON

- Kostenloser Tarif (6 Seiten, unbegrenzte Zeilen), kostenpflichtige Pläne ab 15 $/Monat

- Mehrsprachige Unterstützung (34 Sprachen)

- Keine Wartung — die KI passt sich an Website-Änderungen an

Am besten geeignet für: Vertriebs-, Marketing- und Ops-Teams, die schnelle, genaue Bilddaten ohne Code oder Setup wollen. Perfekt, um Konkurrenzprodukte zu katalogisieren, Immobilienfotos zu sammeln oder Content-Bibliotheken aufzubauen.

Mehr dazu, wie Thunderbit im Vergleich abschneidet, findest du in unserem .

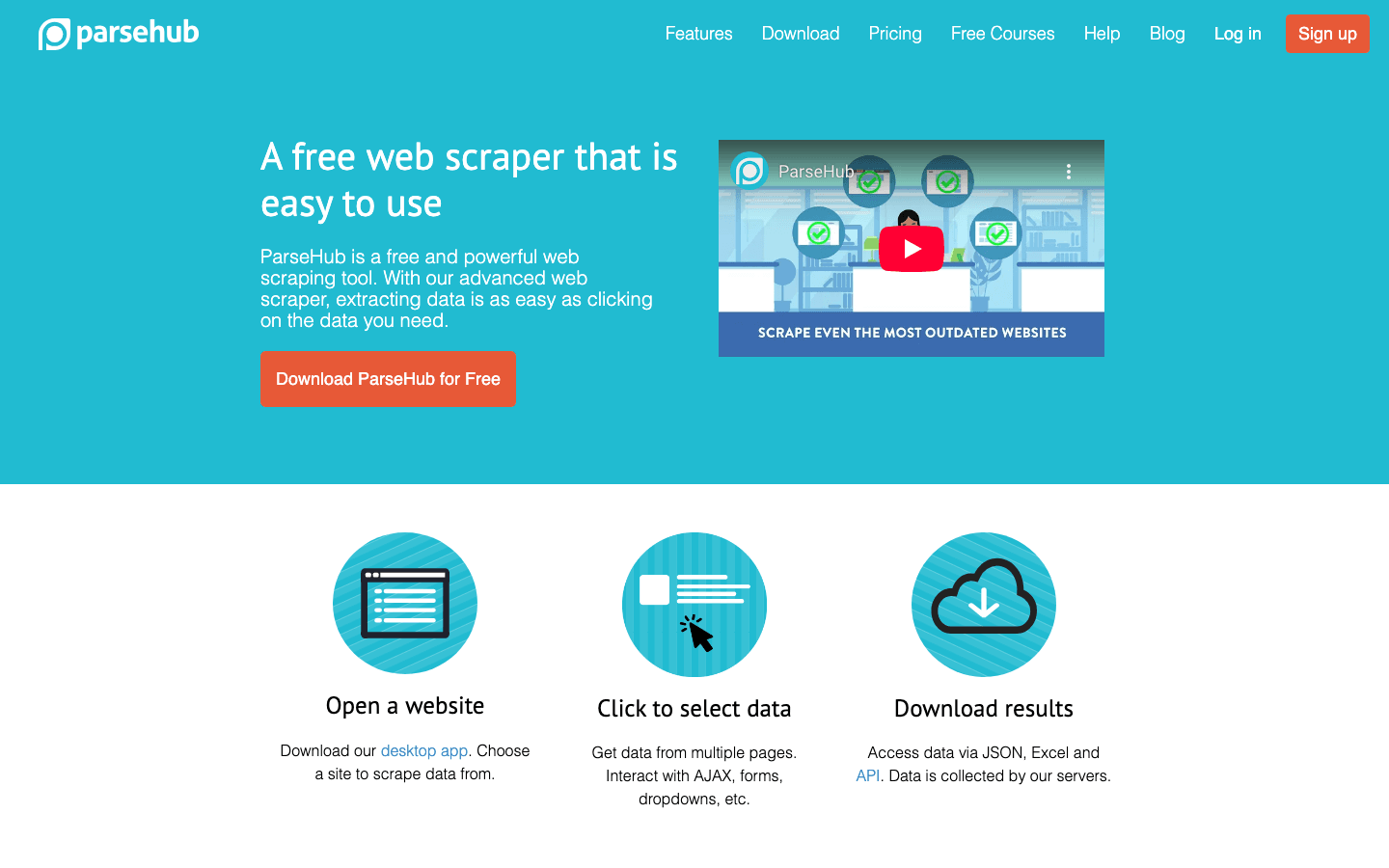

2. ParseHub

ist ein Kraftpaket für Nutzer, die Bilder von komplexen, dynamischen Websites scrapen müssen — etwa Seiten mit endlosem Scrollen, per AJAX geladenen Galerien oder Websites, auf denen man durch Filter und Pop-ups klicken muss.

Warum ParseHub überzeugt: Mit dem visuellen Workflow-Editor kannst du mehrstufige Scraping-Logik abbilden, ohne Code zu schreiben. Bedingungen, Schleifen und sogar Variablen lassen sich hinzufügen, um knifflige Websites zu bewältigen. ParseHub kann mit Formularen interagieren, Buttons anklicken und Bilder extrahieren, die erst nach bestimmten Aktionen sichtbar werden.

Wichtige Funktionen:

- Visueller Editor mit erweiterter Logik (Bedingungen, Schleifen)

- Kommt mit JavaScript-lastigen und dynamischen Inhalten zurecht

- Cloud-Planung und API-Zugriff

- Automatischer IP-Wechsel, um Sperren zu vermeiden

- Export nach CSV, JSON und Integration mit Tableau

Am besten geeignet für: Datenanalysten, Journalisten oder Forschende, die komplexe Websites scrapen und dabei präzise Kontrolle ohne Programmierung wollen. Es gibt eine kostenlose Stufe (bis zu 200 Seiten pro Lauf), aber Power-User werden den 189 $/Monat-Plan für Cloud-Funktionen und höhere Volumen brauchen.

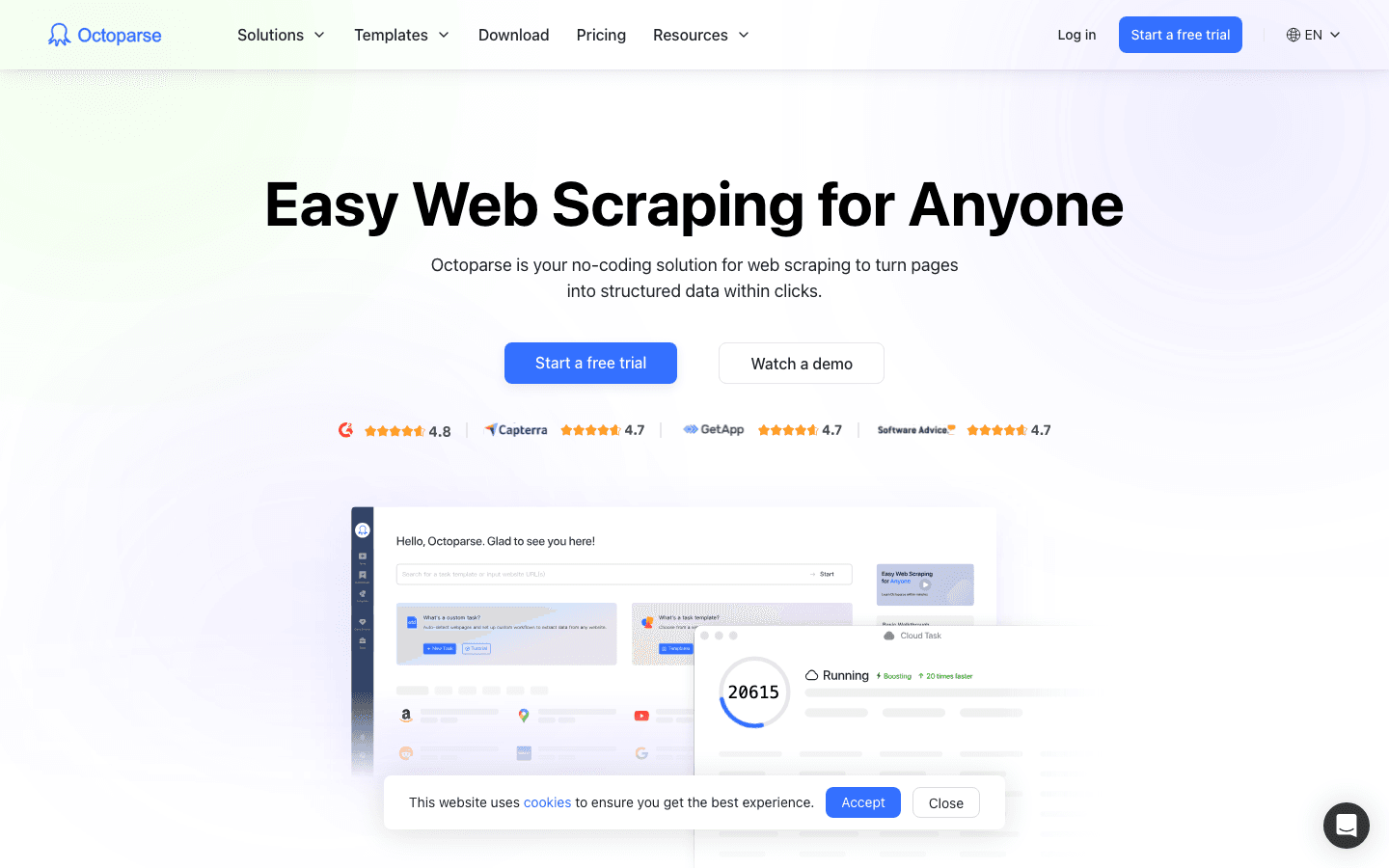

3. Octoparse

ist der No-Code-Champion für die Massenextraktion von Bildern. Die tabellenähnliche Oberfläche und die automatische Erkennung machen das Tool für nicht-technische Nutzer sehr zugänglich.

Warum Octoparse beliebt ist: Einfach auf ein Bild oder eine Liste klicken, und die KI von Octoparse schlägt vor, was gescrapt werden soll. Besonders stark ist es bei Paginierung, endlosem Scrollen und Seiten mit Login-Pflicht. Cloud-basiertes Scraping und Zeitplanung gibt es in kostenpflichtigen Tarifen, sodass du große Jobs ausführen kannst, ohne deinen Rechner zu blockieren.

Wichtige Funktionen:

- No-Code-Setup per Point-and-Click

- Erkennt Listen und Bilder automatisch

- Kommt mit Paginierung, endlosem Scrollen und Logins zurecht

- Cloud-Scraping und Zeitplanung

- Export nach CSV, Excel, JSON und Datenbanken

Am besten geeignet für: Marketingteams, kleine Unternehmen oder alle, die schnell viele Bilder extrahieren möchten, ohne zu programmieren. Kostenloser Plan für kleine Jobs; kostenpflichtige Pläne ab 119 $/Monat.

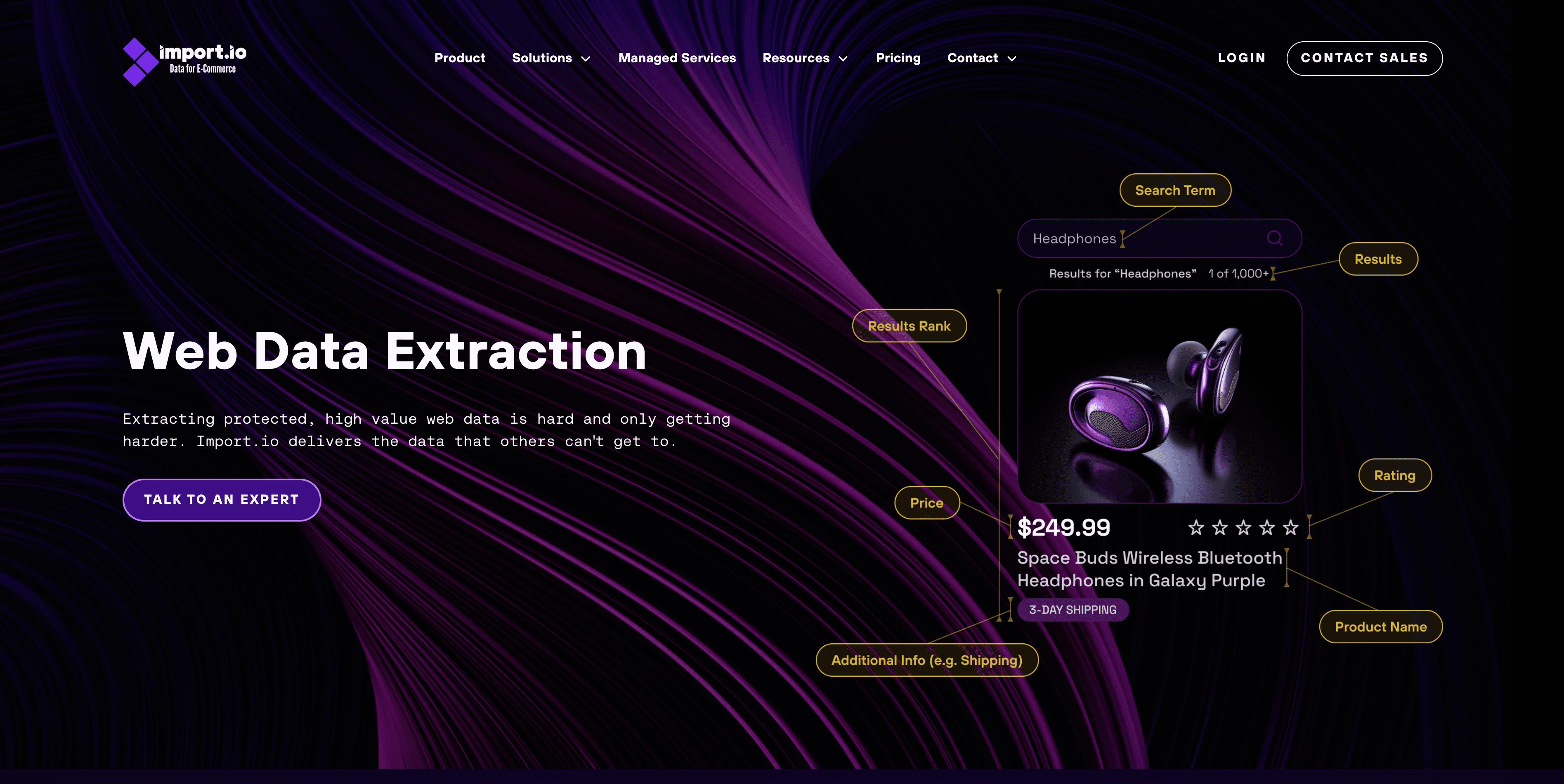

4.

ist eine Datenextraktionsplattform auf Enterprise-Niveau, die sich auch als robuster Image Scrapper eignet. Mit der interaktiven Oberfläche kannst du Workflows aufzeichnen — etwa Login, Filter oder das Durchklicken von Galerien — und sie anschließend in der Cloud im großen Stil ausführen.

Was auszeichnet: Es ist auf Integration ausgelegt — extrahierte Bilder und Daten können per APIs und Webhooks direkt in Analyse-Dashboards, BI-Tools oder Datenbanken fließen. eignet sich außerdem hervorragend für geschützte oder dynamische Inhalte.

Wichtige Funktionen:

- Interaktiver Workflow-Recorder

- Kommt mit Logins, dynamischen Inhalten und geschützten Seiten zurecht

- API-/Webhook-Integration für Analyse-Workflows

- Managed Services für Unternehmenskunden

Am besten geeignet für: Mittelständische bis große Unternehmen, die zuverlässige, skalierbare Bilderextraktion als Teil einer größeren Datenpipeline benötigen. Die Preise beginnen bei etwa 299 $/Monat, eine kostenlose Testversion ist verfügbar.

5. Apify

ist eine entwicklerfreundliche Automatisierungsplattform mit einem Marktplatz vorgefertigter „Actors“ (fertiger Scraper) und der Möglichkeit, eigene Lösungen in Node.js oder Python zu programmieren.

Warum Apify flexibel ist: Du kannst einen Actor für gängige Websites finden (etwa Instagram oder Amazon) oder einen eigenen Scraper für alles andere bauen. Die Cloud-Infrastruktur von Apify übernimmt Zeitplanung, Proxy-Management und Skalierung — so kannst du Tausende Seiten parallel scrapen.

Wichtige Funktionen:

- Actor-Marktplatz (vorgefertigte Scraper für beliebte Websites)

- Eigenes Skripting in Node.js/Python

- Cloud-Zeitplanung und Speicher

- Robuste API-Integration

Am besten geeignet für: Entwickler, Start-ups oder Data Engineers, die programmierbares, skalierbares Scraping wollen. Kostenloser Tarif für leichte Nutzung; kostenpflichtige Pläne ab 49 $/Monat.

6. Mozenda

ist eine Enterprise-Lösung mit Fokus auf strukturierte Datenextraktion, einschließlich Bildern, Dateien und PDFs. Die Point-and-Click-Oberfläche ist leicht zugänglich, aber die eigentliche Stärke liegt in Automatisierung, Zeitplanung und Teamverwaltung.

Warum Mozenda enterprise-tauglich ist: Es ist auf Zuverlässigkeit ausgelegt — mit robuster Planung, Benachrichtigungen und Workflow-Automatisierung. Mozenda kann Daten aus mehreren Quellen zusammenführen, in verschiedene Formate exportieren und sogar lokal vor Ort für sensible Projekte betrieben werden.

Wichtige Funktionen:

- Visueller Agent-Builder (kein Code)

- Kommt mit komplexen Websites, mehrstufigen Daten und Bildern zurecht

- Zeitplanung, Benachrichtigungen und Workflow-Automatisierung

- Teamzusammenarbeit und Managed Services

Am besten geeignet für: Große Organisationen oder Teams mit laufendem, geschäftskritischem Scraping-Bedarf. Die Preise beginnen bei etwa 99 $/Monat, mit individuellen Enterprise-Optionen.

7. VisualScraper

ist ein leichtgewichtiges, benutzerfreundliches Tool für schnelle Image-Scraping-Aufgaben. Die Oberfläche ist minimalistisch — einfach zeigen, klicken und extrahieren.

Warum VisualScraper praktisch ist: Es ist perfekt für kleine Aufgaben oder einmalige Projekte. Du kannst Aufgaben planen, nach CSV/JSON/XML exportieren und Ergebnisse sogar per E-Mail oder FTP erhalten. Es ist nicht so leistungsstark wie die großen Player, aber für grundlegende Anforderungen ist die Einfachheit kaum zu schlagen — und der Preis auch nicht: für die meisten Nutzer kostenlos.

Wichtige Funktionen:

- Einfache Point-and-Click-Oberfläche

- Echtzeit-Vorschau der Daten

- Zeitplanung und Export in mehrere Formate

- Kostenlose Windows-App für kleine Jobs

Am besten geeignet für: Einzelpersonen, Hobbyanwender oder kleine Unternehmen, die nur gelegentlich Bilder scrapen müssen, ohne eine steile Lernkurve.

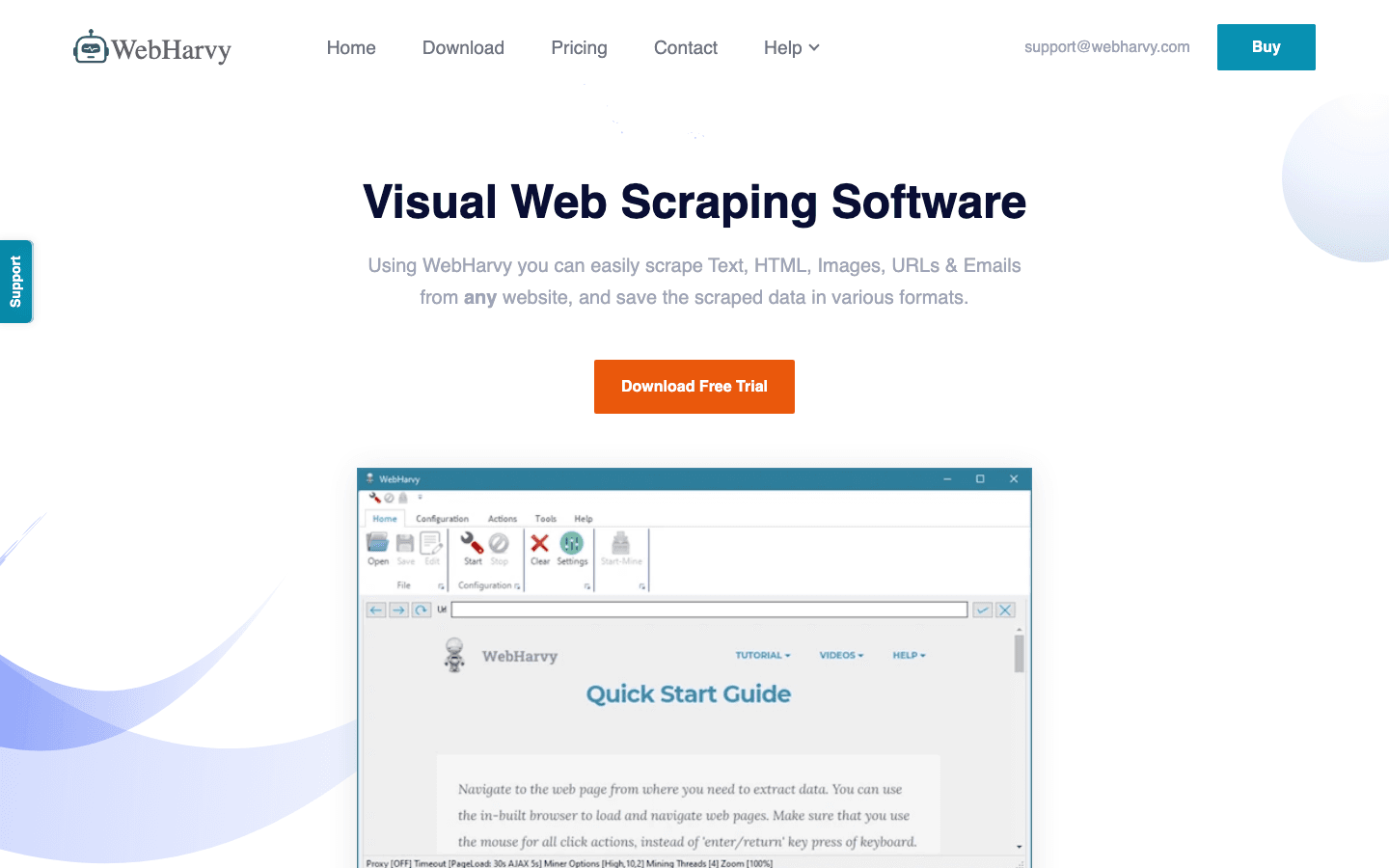

8. WebHarvy

ist ein Windows-basierter visueller Scraper, der für seine intelligente Mustererkennung bekannt ist. Klicke auf ein Bild, und WebHarvy findet und scrapt automatisch alle ähnlichen Bilder auf der Seite.

Warum WebHarvy clever ist: Es kann mehrstufiges Scraping bewältigen (etwa Galeriebilder von Produktdetailseiten holen), Formulare ausfüllen, Buttons anklicken und sogar eigenes JavaScript für knifflige Websites ausführen. Es ist ein Einmalkauf, also keine monatlichen Gebühren.

Wichtige Funktionen:

- Intelligente Mustererkennung

- Mehrstufiges Scraping und Galeriebilder

- Export nach Excel, CSV, JSON, SQL

- Einmalige Lizenz (kein Abo)

Am besten geeignet für: Nicht-Programmierer, die eine Mischung aus Bedienkomfort und erweiterten Funktionen wollen, besonders unter Windows. Ideal für Forschende und kleine Unternehmen.

9. Diffbot

ist das KI-Gehirn der Web-Datenextraktion. Gib eine URL ein — oder eine Million —, und Computer Vision sowie NLP identifizieren und extrahieren automatisch alle Hauptbilder, ganz ohne Regeln oder Selektoren.

Warum Diffbot einzigartig ist: Es ist API-first, extrem skalierbar und widerstandsfähig gegenüber Website-Änderungen (die KI passt sich automatisch an). Mit dem Knowledge Graph von Diffbot kannst du sogar eine webweite Datenbank aus Bildern und strukturierten Daten abfragen.

Wichtige Funktionen:

- KI-gestützte Extraktion (kein Setup erforderlich)

- Verarbeitet Millionen von Seiten per API

- Liefert Bild-URLs, Metadaten und Tags

- Knowledge Graph für webweite Abfragen

Am besten geeignet für: Unternehmen, KI-Firmen oder Datenanbieter, die riesige, wartungsfreie Bilddatensätze brauchen. Kostenlos für 10.000 API-Aufrufe pro Monat; kostenpflichtige Pläne ab 299 $/Monat. Für die Nutzung sind einige Programmierkenntnisse erforderlich.

10. Scrapy

ist das Open-Source-Python-Framework für individuelles Web Scraping. Wenn du Entwickler bist, gibt dir Scrapy volle Kontrolle — schreibe Spiders, um jede Website zu crawlen, Bilder zu extrahieren und sie genau so zu verarbeiten, wie du es willst.

Warum Scrapy stark ist: Die integrierte Images Pipeline automatisiert das Herunterladen von Bildern, erstellt Thumbnails und filtert nach Größe oder Format. Scrapy ist schnell, skalierbar und verfügt über ein riesiges Ökosystem an Erweiterungen für Proxys, Cloud-Crawling und mehr.

Wichtige Funktionen:

- Code-first, maximale Flexibilität

- Asynchrones, schnelles Crawling

- Integriertes Herunterladen und Verarbeiten von Bildern

- Kostenlos und Open Source

Am besten geeignet für: Entwickler und technische Teams mit individuellen oder groß angelegten Scraping-Anforderungen. Die einzigen Kosten sind deine Zeit und Serverressourcen.

Vergleichstabelle der Image-Scrapper-Tools

| Tool | Einfachheit | Exportformate | Automatisierung/Planung | Am besten für | Preis (ca.) |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Excel, Sheets, Notion | Ja | Nicht-technische Teams, KMU | Kostenlos, ab 15 $/Monat |

| ParseHub | ★★★★☆ | CSV, JSON, Tableau | Ja (Cloud) | Analysten, komplexe Websites | Kostenlos, ab 189 $/Monat |

| Octoparse | ★★★★☆ | CSV, Excel, JSON | Ja (Cloud) | No-Coder, Massenextraktion | Kostenlos, ab 119 $/Monat |

| Import.io | ★★★★☆ | API, CSV, DB | Ja (Cloud) | Enterprise, BI-Integration | Ab 299 $/Monat |

| Apify | ★★★☆☆ | JSON, CSV, API | Ja (Cloud) | Entwickler, skalierbare Projekte | Kostenlos, ab 49 $/Monat |

| Mozenda | ★★★★☆ | CSV, Excel, API, DB | Ja | Enterprise, Team-Workflows | Ab 99 $/Monat |

| VisualScraper | ★★★★☆ | CSV, JSON, XML, E-Mail | Ja | Einzelpersonen, kleine Projekte | Kostenlos, ab 49 $/Monat (Cloud) |

| WebHarvy | ★★★★☆ | Excel, CSV, JSON, SQL | Ja | Nicht-Programmierer, Windows-Nutzer | 99 $ einmalig |

| Diffbot | ★★★☆☆ | API (JSON, Metadaten) | Ja (API) | Enterprise, KI, Entwickler | Kostenlos, ab 299 $/Monat |

| Scrapy | ★★★☆☆ | Beliebig (eigener Code) | Ja (eigene Lösung) | Entwickler, benutzerdefinierte Pipelines | Kostenlos |

So wählst du das richtige Image-Scrapper-Tool für dein Unternehmen aus

Hier ist mein kurzer Entscheidungsleitfaden:

- Nicht-technisch, aber schnell und einfach? Starte mit oder .

- Komplexe, dynamische Websites scrapen? Probiere oder aus.

- Enterprise, Integration und Support wichtig? Schau dir , oder an.

- Entwickler und volle Kontrolle gewünscht? oder sind die beste Wahl.

- Nur ein schnelles, kostenloses Tool für kleine Jobs? ist eine solide Option.

Nutze immer kostenlose Testversionen oder Gratis-Tarife — führe auf deiner Zielwebsite einen kleinen Test-Scrape durch, um zu sehen, welches Tool zu deinem Workflow und deinen Datenanforderungen passt.

Fazit: Finde dein ideales Image-Scrapper-Tool für 2026

Der visuelle Goldschatz des Webs wartet nur darauf, gehoben zu werden — wenn du das richtige Image-Scrapper-Tool hast. Ob du einen Produktkatalog aufbaust, Wettbewerber beobachtest oder deine nächste virale Kampagne befeuerst: Diese Tools können dir Stunden und einige Kopfschmerzen ersparen. Mein Rat? Beginne mit deinem echten Anwendungsfall, ordne ihn dem Tool zu, das zu deinen Fähigkeiten und deinem Budget passt, und hab keine Angst zu experimentieren.

Und wenn du sehen willst, wie einfach Bilderextraktion sein kann, und probier sie aus. Dein Ctrl+S-Finger wird es dir danken.

Für weitere Deep Dives zum Scraping schau dir den an.

FAQs

1. Was ist ein Image-Scrapper-Tool und wie funktioniert es?

Ein Image-Scrapper-Tool automatisiert das Extrahieren von Bildern (oder deren URLs) von Websites. Die meisten Tools lassen dich festlegen, was gescrapt werden soll — per KI, Point-and-Click oder Code — und sammeln und exportieren die Bilder dann in großen Mengen. So sparst du Stunden an manueller Arbeit.

2. Kann ich Image-Scrapper-Tools ohne Programmierkenntnisse nutzen?

Auf jeden Fall. Tools wie , und sind für nicht-technische Nutzer gemacht und bieten natürliche Spracheingaben oder visuelle Oberflächen.

3. Was ist der Unterschied zwischen kostenlosen und kostenpflichtigen Image-Scrapper-Tools?

Kostenlose Tools sind ideal für kleine, gelegentliche Aufgaben, können aber bei Menge, Funktionen oder Support begrenzt sein. Kostenpflichtige Tools bieten mehr Automatisierung, Cloud-Verarbeitung und erweiterte Funktionen — ideal für Business- oder Enterprise-Anforderungen.

4. Wie exportiere ich Bilder nach Excel, Google Sheets oder Notion?

Die meisten modernen Scraper (wie ) ermöglichen den Direkt-Export nach Excel, Sheets, Notion oder Airtable mit einem Klick. Andere bieten CSV-/JSON-Downloads oder API-Integrationen für individuelle Workflows.

5. Ist es legal, Bilder von jeder Website zu scrapen?

Du solltest immer die Nutzungsbedingungen und das Urheberrecht der jeweiligen Website beachten. Scrape nur öffentlich verfügbare Bilder und verwende gescrapten Content nicht ohne Erlaubnis für kommerzielle Zwecke. Im Zweifelsfall solltest du rechtlichen Rat einholen oder die Bilder nur für interne Analysen nutzen.

Bereit, Bilderextraktion zum einfachsten Teil deines Workflows zu machen? Probiere ein paar Tools aus dieser Liste aus und finde heraus, welches für dich passt — vielleicht trennt dich von deinem nächsten großen Projekt nur noch ein Scrape.

Mehr erfahren: