Das Web quillt über vor Daten — so sehr, dass wir bis 2025 von unglaublichen ausgehen. Wenn du im Vertrieb, E-Commerce, in der operativen Arbeit oder in der Forschung tätig bist, kennst du das Problem: Aus diesem Chaos etwas Nützliches zu machen, ist eine echte Herausforderung. Manuelles Copy-Paste? Vergiss es. Das ist langsam, fehleranfällig und ungefähr so spannend wie beim Trocknen von Farbe zuzusehen. Genau deshalb setzen immer mehr Teams — — inzwischen KI ein, um das Extrahieren von Webdaten zu automatisieren. Was früher Wochen dauerte, geht heute in Minuten.

Ich arbeite seit Jahren mit SaaS und Automatisierung und habe aus erster Hand erlebt, wie sehr das richtige KI-gestützte Web-Scraping-Tool die Produktivität steigern kann. Aber wie wählst du bei so vielen Optionen die beste Lösung für deinen Bedarf? Schauen wir uns die 10 besten Tools an, die KI zum effizienten Scrapen von Websites nutzen — von Point-and-Click-Chrome-Erweiterungen bis hin zu Cloud-Plattformen für den Unternehmenseinsatz.

Warum KI zum Scrapen von Websites nutzen? Neue Möglichkeiten erschließen

Klassische Web-Scraping-Tools sind wie diese alten GPS-Geräte — du kennst schon die, die sich sofort verirren, sobald sich die Straße ändert. Sie verlassen sich auf feste Regeln und Selektoren, die jedes Mal kaputtgehen, wenn eine Website ihr Layout aktualisiert. KI-gestützte Scraper dagegen nutzen Machine Learning und Natural Language Processing, um Muster zu erkennen, sich an Änderungen anzupassen und sogar zu verstehen, was du möchtest — einfach anhand einer Beschreibung in natürlicher Sprache ().

Das bringt KI ins Spiel:

- Geschwindigkeit: KI-Scraper können Wochen manueller Recherche in Minuten automatisierter Extraktion verwandeln ().

- Genauigkeit: Sie nutzen Computer Vision und NLP, um zum Beispiel zwischen einem Produkttitel und einer Beschreibung zu unterscheiden, sodass deine Daten sauberer und zuverlässiger werden.

- Robustheit: Wenn sich eine Website verändert, passt sich die KI an — ständige Wartung entfällt.

- Barrierefreiheit: Auch nicht-technische Nutzer können Daten nun einfach per Beschreibung extrahieren. Dadurch werden Anwendungsfälle wie Lead-Generierung, Preisüberwachung und Marktforschung für alle zugänglich.

- Kosteneinsparungen: Teams berichten von und massiver Reduzierung manueller Arbeit.

Kurz gesagt: KI zum Scrapen von Websites zu nutzen heißt, schneller und zuverlässiger an Daten zu kommen — ohne einen Doktortitel in Regex oder einen Entwickler auf Kurzwahl zu brauchen.

Wie wir die besten Tools ausgewählt haben, um mit KI Websites zu scrapen

Bei so vielen Tools auf dem Markt habe ich einige zentrale Kriterien herangezogen, um die Top 10 auszuwählen:

- Einfache Bedienung: Können auch Nicht-Programmierer schnell einen Mehrwert erzielen? Gibt es eine visuelle Oberfläche oder Unterstützung in natürlicher Sprache?

- KI-Funktionen: Nutzt das Tool KI zur Felderkennung, zur Anpassung an Layout-Änderungen oder zum Verstehen natürlicher Anweisungen?

- Funktionsumfang: Unterstützung für Pagination, Zeitplanung, Proxy-Management, CAPTCHA-Lösung und Ausgabeformate.

- Skalierbarkeit: Kann es alles von ein paar Seiten bis zu Millionen bewältigen? Gibt es eine Cloud-Option?

- Preis & Zugänglichkeit: Gibt es eine Gratisstufe? Ist es für Einzelpersonen, KMU und Unternehmen erschwinglich?

- Support & Community: Gute Dokumentation, schneller Support und eine aktive Nutzerbasis.

- Reputation: Echte Nutzerbewertungen, Erfahrungsberichte und ein verlässlicher Track Record.

Ich habe eine Mischung aus Browser-Erweiterungen, Desktop-Apps, Cloud-Plattformen und Entwickler-Frameworks aufgenommen — egal, ob du Solo-Gründer, Data Analyst oder Teil eines Enterprise-Teams bist, du wirst etwas Passendes finden.

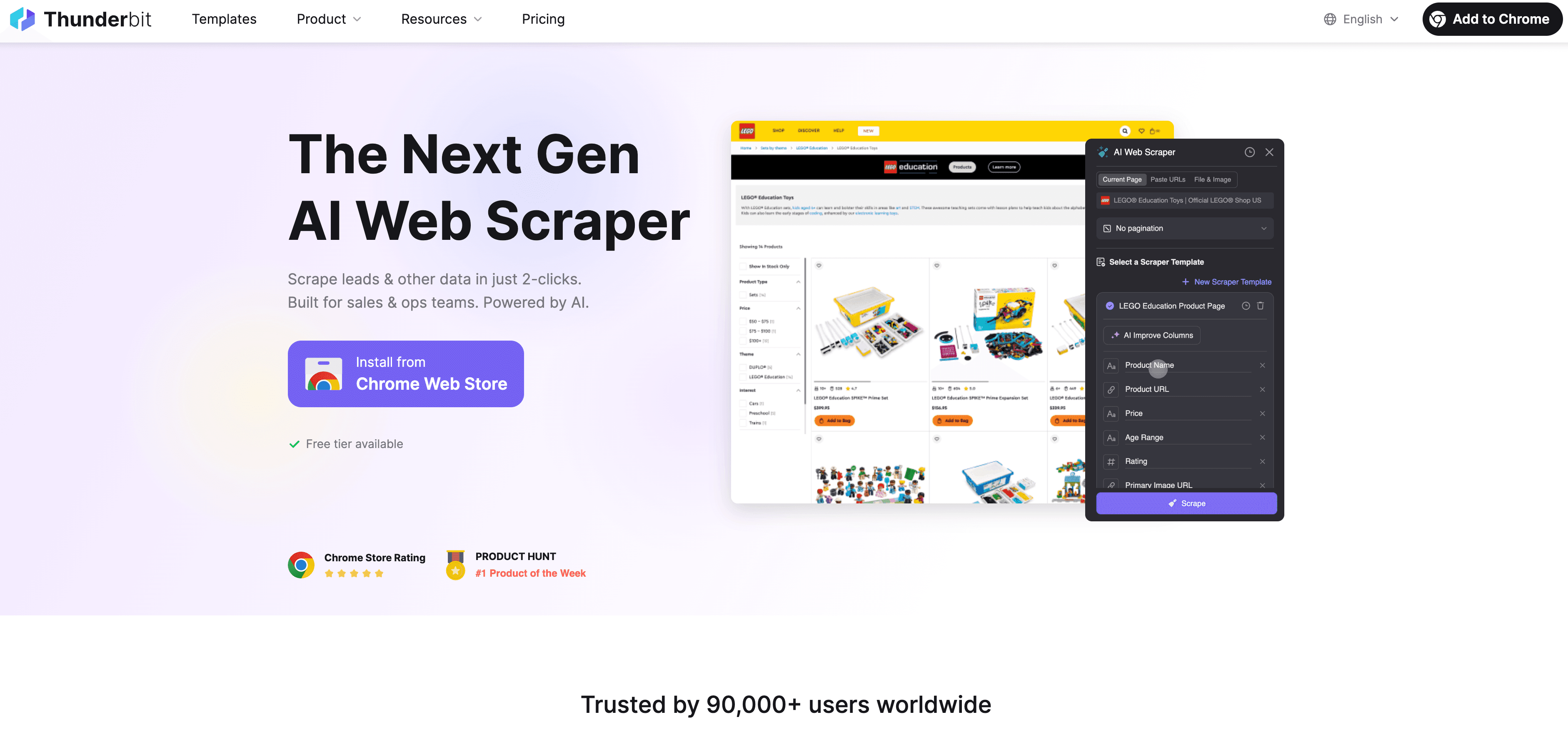

1. Thunderbit

ist meine klare Empfehlung für Business-Anwender, die Websites schnell mit KI scrapen wollen. Als Chrome-Erweiterung funktioniert Thunderbit wie ein KI-Assistent, der jede Webseite liest — sogar PDFs oder Bilder — und in nur zwei Klicks strukturierte Daten ausgibt.

ist meine klare Empfehlung für Business-Anwender, die Websites schnell mit KI scrapen wollen. Als Chrome-Erweiterung funktioniert Thunderbit wie ein KI-Assistent, der jede Webseite liest — sogar PDFs oder Bilder — und in nur zwei Klicks strukturierte Daten ausgibt.

Was Thunderbit besonders macht:

- Oberfläche in natürlicher Sprache: Beschreibe einfach, was du brauchst („Extrahiere alle Produktnamen, Preise und Bilder von dieser Seite“), und die KI von Thunderbit erledigt den Rest.

- KI-Feldvorschläge: Mit einem Klick scannt die KI die Seite und schlägt die besten Spalten vor. Du kannst sie anpassen oder übernehmen und dann auf „Scrape“ klicken.

- Scraping von Unterseiten & Pagination: Thunderbit kann automatisch Links zu Unterseiten (etwa Produktdetails) folgen und Pagination verarbeiten — sogar bei Infinite Scroll.

- Sofortiger Datenexport: Direkt nach Excel, Google Sheets, Airtable oder Notion exportieren — ohne Zusatzkosten.

- Kostenlose Kontakt-Extraktoren: E-Mail-, Telefon- und Bildextraktion mit einem Klick — komplett kostenlos.

- Geplantes Scraping: Wiederkehrende Jobs mit natürlicher Sprache einrichten („jeden Montag um 9 Uhr“) und den Rest der KI überlassen.

Thunderbit ist besonders stark bei unübersichtlichen, komplexen oder unstandardisierten Webseiten — denk an Nischenverzeichnisse, Immobilienanzeigen oder E-Commerce-Produktseiten, die andere Scraper zum Weinen bringen würden. Nutzerbewertungen loben durchgehend die Einfachheit und Leistung; der .

Preis: Kostenlos für bis zu 6–10 Seiten; kostenpflichtige Pläne starten bei etwa 15 $/Monat für 500 Credits (Seiten), mit höheren Stufen für größere Anforderungen. Der Datenexport ist immer kostenlos.

Am besten geeignet für: Vertrieb, Marketing, E-Commerce-Operations und alle, die Daten ohne Programmierung oder Stress scrapen möchten.

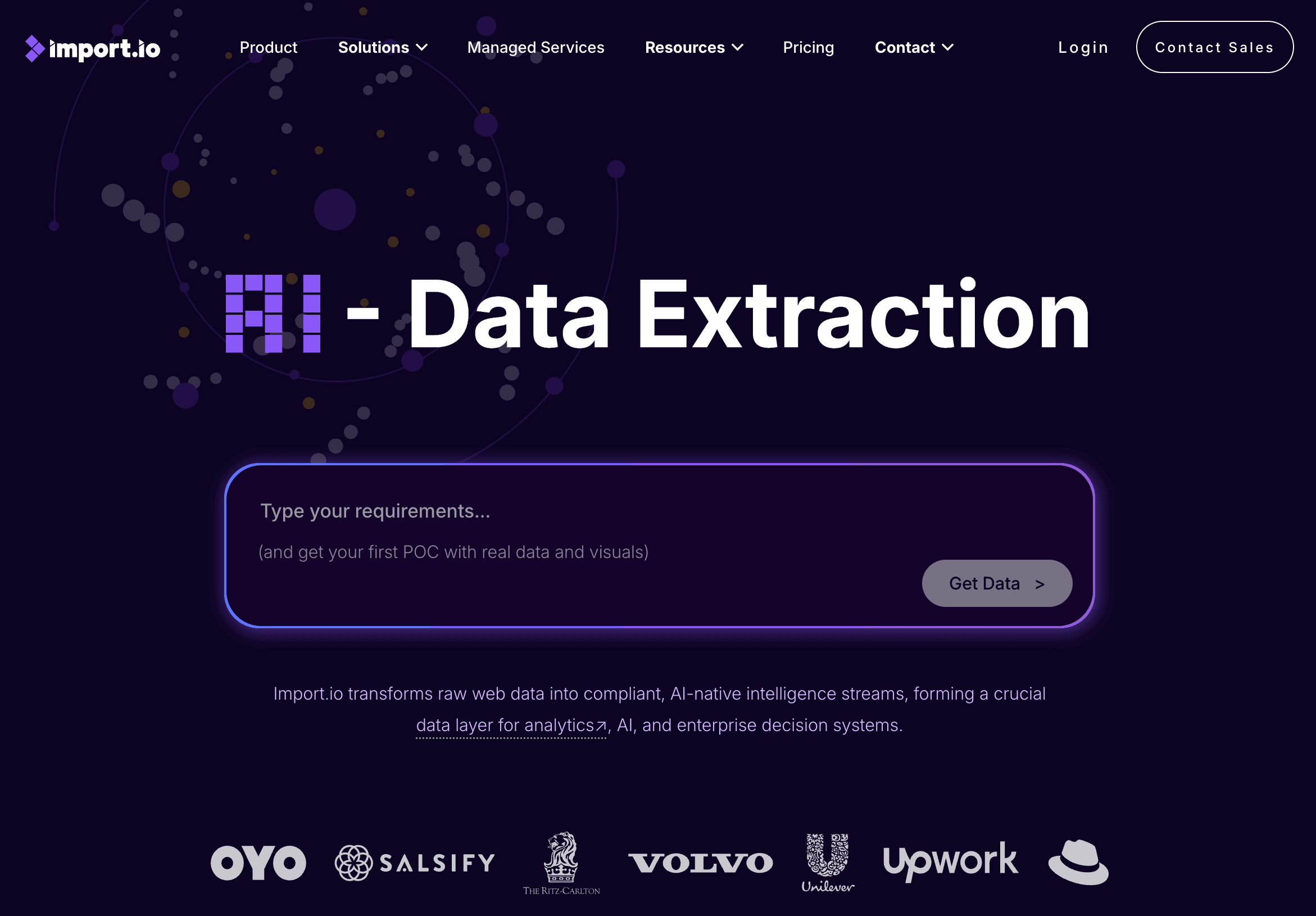

2. import.io

ist eine KI-gestützte Web-Scraping-Plattform für den Enterprise-Einsatz, der große Namen wie Unilever und Volvo vertrauen. Sie ist für groß angelegte, geschäftskritische Datenextraktion gebaut.

ist eine KI-gestützte Web-Scraping-Plattform für den Enterprise-Einsatz, der große Namen wie Unilever und Volvo vertrauen. Sie ist für groß angelegte, geschäftskritische Datenextraktion gebaut.

Warum import.io wählen?

- KI-„Self-Healing“-Pipelines: Wenn sich eine Website ändert, kann sich die KI von import.io automatisch anpassen — keine kaputten Scraper mehr.

- Prompt-basierte Extraktion: Extraktionen mit übergeordneten Anweisungen einrichten; die KI kümmert sich um die Details.

- Automatisierte Compliance: Integrierte Filter für Datenschutzgesetze (DSGVO, CCPA) und anpassbares Maskieren personenbezogener Daten.

- Voll gemanagte Cloud: Übernimmt Proxy-Rotation, Zeitplanung und Infrastruktur für dich.

- API-Integration: Verwandle jede Website in eine Live-API für deine Analyse- oder Business-Systeme.

Preis: Ab etwa 299 $/Monat, mit individuellen Enterprise-Plänen. Kostenlose Testphase verfügbar.

Am besten geeignet für: Unternehmen und Data-Teams, die zuverlässige, skalierbare und rechtskonforme Web-Datenpipelines brauchen.

3. Bright Data

dreht sich ganz um Skalierung. Wenn du Millionen von Seiten scrapen, Preise weltweit überwachen oder Daten in KI-Modelle einspeisen musst, ist das hier dein Tool.

dreht sich ganz um Skalierung. Wenn du Millionen von Seiten scrapen, Preise weltweit überwachen oder Daten in KI-Modelle einspeisen musst, ist das hier dein Tool.

Wichtige Funktionen:

- Proxy-Netzwerk mit über 100 Mio. IPs: Residential-, Mobile- und Rechenzentrums-IPs für unschlagbares Anti-Blocking.

- KI-gestützter Unblocker: Löst CAPTCHAs, rotiert Header und passt sich in Echtzeit an Anti-Bot-Maßnahmen an.

- Vorgefertigte Scraper: APIs für über 120 beliebte Websites (Amazon, LinkedIn, Google usw.).

- Dataset-Marktplatz: Große vorgefertigte Datensätze kaufen oder darauf zugreifen.

- LLM-fähige Datenstreams: Webdaten in Echtzeit direkt in KI-Systeme einspeisen.

Preis: Nutzungsbasiert; auf Skalierung kann es teuer werden. Kostenlose Testphase und einige kostenlose Datensätze verfügbar.

Am besten geeignet für: Große Unternehmen, KI-Projekte und alle, die riesige, zuverlässige und rechtskonforme Webdaten brauchen.

4. ParseHub

ist eine Desktop-App für Windows, Mac und Linux, die visuelles Web-Scraping einfach macht — sogar bei dynamischen, JavaScript-lastigen Websites.

ist eine Desktop-App für Windows, Mac und Linux, die visuelles Web-Scraping einfach macht — sogar bei dynamischen, JavaScript-lastigen Websites.

Warum ParseHub?

- Mustererkennung per Machine Learning: Auf ein Element klicken, und ParseHub findet automatisch alle ähnlichen Elemente.

- Beherrscht dynamische Inhalte: Funktioniert mit AJAX, Infinite Scroll und interaktiven Elementen.

- Visueller Workflow-Builder: Mehrstufige Scraping-Abläufe ohne Code einrichten.

- Cloud-Zeitplanung: Jobs in der Cloud ausführen und wiederkehrende Aufgaben planen.

- Flexible Ausgabe: CSV, Excel, JSON oder API.

Preis: Kostenlos für bis zu 5 Projekte (200 Seiten pro Lauf); kostenpflichtige Pläne ab 189 $/Monat.

Am besten geeignet für: Analysten, Forschende und kleine Unternehmen, die einen leistungsstarken Point-and-Click-Scraper für komplexe Websites wollen.

5. Scrapy

ist das Entwickler-Toolkit für Web-Scraping. Es ist ein Python-Framework, Open Source und hochgradig erweiterbar.

ist das Entwickler-Toolkit für Web-Scraping. Es ist ein Python-Framework, Open Source und hochgradig erweiterbar.

Was Scrapy besonders macht:

- Ultimative Flexibilität: Eigene Spiders schreiben, um alles in jeder Größenordnung zu scrapen.

- KI-Integrationen: Erweiterungen wie Scrapy-LLM nutzen, um Daten mit Large Language Models (LLMs) zu parsen, oder NLP für intelligenteres Extrahieren integrieren.

- Asynchrones Crawling: Extrem schnell und effizient für große Jobs.

- Offenes Ökosystem: Zahlreiche Plugins für Proxies, Browser-Automatisierung und mehr.

Preis: Kostenlos und Open Source; du zahlst nur für deine eigene Infrastruktur.

Am besten geeignet für: Entwickler und technische Teams, die volle Kontrolle und die Möglichkeit wollen, KI in individuelle Scraping-Workflows einzubinden.

6. Octoparse

ist ein No-Code- und Cloud-basiertes Web-Scraper-Tool für Business-Anwender und Teams.

ist ein No-Code- und Cloud-basiertes Web-Scraper-Tool für Business-Anwender und Teams.

Hervorstechende Funktionen:

- KI-Auto-Erkennung: Die KI scannt eine Seite und schlägt vor, welche Daten extrahiert werden sollen — keine manuelle Einrichtung nötig.

- Drag-and-Drop-Workflow: Scraper visuell erstellen, inklusive Login, Pagination und dynamischen Inhalten.

- Vorgefertigte Vorlagen: Hunderte einsatzbereite Vorlagen für beliebte Websites.

- Cloud-Zeitplanung: Scrapes in der Cloud ausführen und planen; Export nach Sheets, Excel oder per API.

- KI-Regex-Helfer: Regex-Muster mithilfe von KI generieren.

Preis: Gratisstufe (10 Aufgaben); kostenpflichtige Pläne ab etwa 75 $/Monat.

Am besten geeignet für: Nicht-Programmierer, Marketing-Teams und KMU, die eine benutzerfreundliche No-Code-Scraping-Lösung wollen.

7. WebHarvy

ist eine Windows-Desktop-App, die für intelligente Mustererkennung und ein Einmal-Lizenzmodell bekannt ist.

ist eine Windows-Desktop-App, die für intelligente Mustererkennung und ein Einmal-Lizenzmodell bekannt ist.

Warum WebHarvy wählen?

- Automatische Mustererkennung: Auf ein Element klicken, und WebHarvy findet alle ähnlichen Daten auf der Seite.

- Visuelles Scraping: Der integrierte Browser ermöglicht die Auswahl per Klick, ganz ohne Code.

- Bild- & E-Mail-Scraping: Bilder herunterladen oder E-Mails problemlos extrahieren.

- Einmaliger Kauf: Lebenslange Lizenz (ab 129 $) mit optionalen kostenpflichtigen Updates.

Preis: Ab 129 $ einmalig für einen Nutzer.

Am besten geeignet für: Kleine Unternehmen, Forschende oder alle unter Windows, die ein kosteneffizientes Offline-Scraping-Tool suchen.

8. Apify

ist eine Cloud-Automatisierungsplattform für Web-Scraping und Workflow-Integration, die sowohl von Entwicklern als auch von Nicht-Programmierern genutzt wird.

ist eine Cloud-Automatisierungsplattform für Web-Scraping und Workflow-Integration, die sowohl von Entwicklern als auch von Nicht-Programmierern genutzt wird.

Wichtige Funktionen:

- Actors-Marktplatz: Über 200 vorgefertigte Bots für gängige Scraping-Aufgaben.

- Eigene Actors: Eigene Bots in JavaScript/Python schreiben oder visuelle Tools verwenden.

- KI-Integrationen: Extrahierte Daten an LLMs weitergeben oder Scraper von KI-Agenten aus starten.

- Cloud-Zeitplanung & Speicherung: Jobs in großem Maßstab ausführen, Ergebnisse speichern und mit APIs oder Workflow-Tools integrieren.

- Proxy- & Headless-Browser-Unterstützung: Dynamische Websites und Anti-Bot-Maßnahmen meistern.

Preis: Gratisstufe (5 $ monatliches Guthaben); kostenpflichtige Pläne ab 49 $/Monat.

Am besten geeignet für: Entwickler, Startups und Teams, die skalierbares, automatisiertes Scraping mit Workflow-Integration wollen.

9. Diffbot

ist der König der KI-gestützten Webdatenextraktion und Knowledge Graphs.

ist der König der KI-gestützten Webdatenextraktion und Knowledge Graphs.

Was Diffbot einzigartig macht:

- Vollständig KI-gestützte Extraktion: Beliebige URL an die API von Diffbot übergeben und strukturiertes JSON erhalten — keine Einrichtung nötig.

- Knowledge Graph: Zugriff auf einen riesigen, ständig aktualisierten Graphen mit über 10 Milliarden Entitäten (Unternehmen, Personen, Produkte, Artikel).

- Computer Vision + NLP: Extrahiert Daten aus Text und Bildern und leitet sogar Beziehungen ab.

- Faktenbasiertes LLM: Fragen stellen und Antworten mit Quellenangaben aus dem Web erhalten.

Preis: Kostenloser Entwickler-Test (10.000 Aufrufe/Monat); Startup-Plan 299 $/Monat für 250.000 Credits.

Am besten geeignet für: Unternehmen, KI-Firmen und Forschende, die sofort strukturierte Daten aus jeder Seite — oder eine direkt abfragbare Web-Wissensdatenbank — wollen.

10. Data Miner

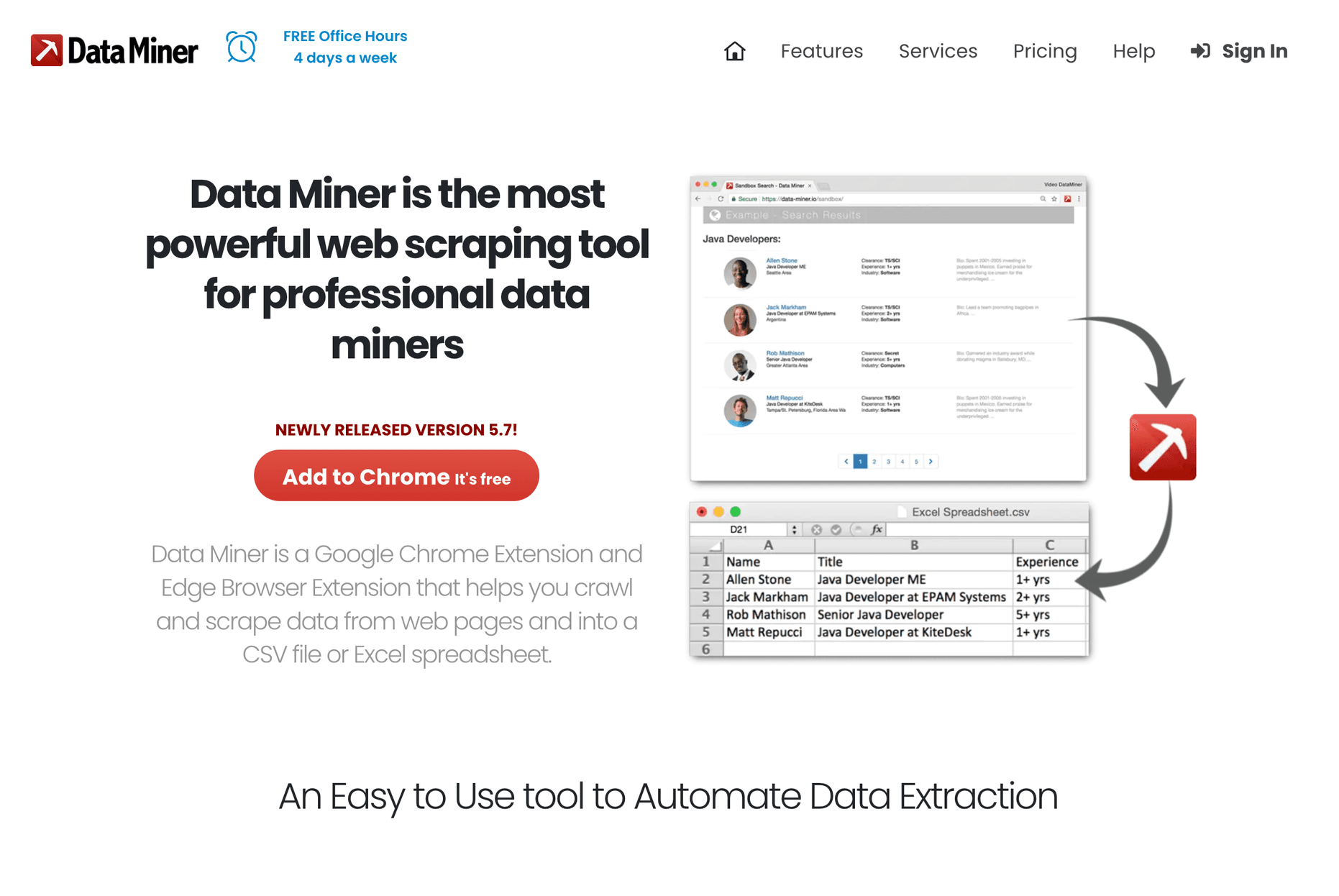

ist eine Chrome-/Edge-Erweiterung, die schnelles, vorlagenbasiertes Scraping für alle zugänglich macht.

ist eine Chrome-/Edge-Erweiterung, die schnelles, vorlagenbasiertes Scraping für alle zugänglich macht.

Warum Data Miner?

- Über 50.000 öffentliche Rezepte: Scraping mit einem Klick für mehr als 15.000 Websites (LinkedIn, Gelbe Seiten, Amazon usw.).

- Point-and-Click-Anpassung: Eigene Scraping-Rezepte visuell erstellen.

- Pagination & Automatisierung: Mehrere Seiten oder eine URL-Liste direkt im Browser scrapen.

- Direkter Export: Als CSV/Excel herunterladen oder in Google Sheets hochladen.

Preis: Kostenlos für bis zu 500 Seiten/Monat; kostenpflichtige Pläne ab etwa 19 $/Monat.

Am besten geeignet für: Nicht-technische Nutzer, die schnelles browserbasiertes Scraping für kleine bis mittlere Aufgaben wollen.

Die Top-Tools im Vergleich, die KI zum Scrapen von Websites nutzen

Hier ist ein schneller Vergleich aller 10 Tools:

| Tool | Am besten geeignet für | KI-Funktionen | Einfache Bedienung | Skalierbarkeit | Preis | Support/Community |

|---|---|---|---|---|---|---|

| Thunderbit | Nicht-Programmierer, Business-Nutzer | LLM-Felderkennung, NL-UI | Sehr einfach | Mittel (Cloud) | Kostenlos, ab 15 $/Monat | Schneller E-Mail-Support, aktive Entwickler |

| import.io | Unternehmen, Data-Teams | Self-Healing, Prompt-KI | Mittel | Sehr hoch | Ab 299 $/Monat | Dedizierter Enterprise-Support |

| Bright Data | Große Unternehmen, KI-Projekte | Unblocker, über 100 Mio. Proxies | Mittel | Extrem hoch | Nutzungsbasiert | Enterprise, Doku |

| ParseHub | Analysten, KMU, dynamische Websites | ML-Mustererkennung | Einfach/mittel | Mittel bis hoch | Kostenlos, ab 189 $/Monat | Doku, Forum |

| Scrapy | Entwickler, individuelle Workflows | LLM-/NLP-Plugins | Schwer (Code) | Sehr hoch | Kostenlos (OSS) | Community, Doku |

| Octoparse | KMU, Nicht-Programmierer, Teams | KI-Auto-Erkennung, Vorlagen | Sehr einfach | Hoch (Cloud) | Kostenlos, ab 75 $/Monat | Live-Chat, Tutorials |

| WebHarvy | Windows-Nutzer, KMU, Forschende | Mustererkennung | Sehr einfach | Mittel | 129 $ einmalig | E-Mail, Bewertungen |

| Apify | Entwickler, Startups, Automatisierung | KI-Integrationen, Actors | Mittel | Sehr hoch | Kostenlos, ab 49 $/Monat | Doku, Slack, Support |

| Diffbot | KI-/Data-Science-Teams, Unternehmen | Vollständige KI-Extraktion, KG | Einfach (API) | Extrem hoch | Kostenlos, ab 299 $/Monat | Dediziert, akademisch |

| Data Miner | Nicht-Techniker, schnelle Browser-Jobs | Über 50k Rezepte, Muster-KI | Sehr einfach | Niedrig bis mittel | Kostenlos, ab 19 $/Monat | Sprechstunden, Rezepte |

So wählst du das richtige KI-Web-Scraping-Tool für deinen Bedarf aus

Hier ist mein Spickzettel, um das passende Tool auszuwählen:

- Nicht-Programmierer, schnelle Aufgaben: Thunderbit, Octoparse, Data Miner oder WebHarvy.

- Groß angelegte Enterprise-Anforderungen: import.io, Bright Data, Diffbot.

- Individuelle Entwickler-Workflows: Scrapy, Apify.

- Dynamische oder komplexe Websites: ParseHub, Octoparse, Apify (mit Browser-Automatisierung).

- Sofort strukturierte Daten von jeder Seite: Diffbot.

- Einmaliger Kauf gewünscht (kein Abo): WebHarvy.

Profi-Tipp: Manchmal ist die Kombination mehrerer Tools am besten. Nutze zum Beispiel Thunderbit, um unübersichtliche Daten schnell zu strukturieren, und verarbeite sie danach mit der Mustererkennung von WebHarvy weiter — für einen reibungslosen Workflow.

Wichtige Entscheidungskriterien:

- Budget: Gratisstufen sind ideal zum Testen; Enterprise-Tools kosten mehr, bieten aber Skalierung und Support.

- Technische Kenntnisse: No-Code-Tools für Business-Anwender; Frameworks für Entwickler.

- Datenvolumen: Browser-Tools für kleine Jobs; Cloud-Plattformen für große Vorhaben.

- Support-Bedarf: Enterprise-Tools bieten SLAs; andere setzen auf Community oder E-Mail.

Fazit: Die Zukunft des KI-gestützten Scrapens von Websites

KI verändert Web-Scraping von einer Nischenaufgabe für Entwickler hin zu einer alltäglichen Geschäftsfähigkeit. Ob du Lead-Listen aufbaust, Preise überwachst oder Daten in KI-Modelle einspeist — inzwischen gibt es ein Tool, das zu deinem Bedarf und deinem Kenntnisstand passt. Die zehn Tools oben zeigen, wie vielfältig — und wie leistungsfähig — dieses Ökosystem geworden ist.

Mit der Weiterentwicklung von KI wird auch Web-Scraping immer intelligenter: natürlichere Sprachschnittstellen, bessere Anpassung an Website-Änderungen und tiefere Integration in Geschäftsprozesse. Mein Rat? Probiere ein paar dieser Tools aus, finde heraus, was zu deinem Workflow passt, und scheue dich nicht, verschiedene Lösungen zu kombinieren, um die besten Ergebnisse zu erzielen.

Wenn du sehen willst, wie modernes, KI-gestütztes Scraping aussieht, oder lies weitere Anleitungen im . Die Zukunft der Webdaten ist da — und sie macht viel mehr Spaß (und ist produktiver) als endlose Copy-Paste-Marathons.

FAQs

1. Warum sollte ich KI zum Scrapen von Websites statt klassischer Tools nutzen?

KI-gestützte Scraper passen sich veränderten Website-Layouts an, erkennen Muster automatisch und ermöglichen es auch nicht-technischen Nutzern, Daten einfach per Beschreibung zu extrahieren. Das bedeutet schnellere, zuverlässigere Extraktion mit weniger Wartung und weniger Kopfzerbrechen.

2. Welches KI-Web-Scraping-Tool ist am besten für Nicht-Programmierer?

Thunderbit, Octoparse, Data Miner und WebHarvy sind alle hervorragend für nicht-technische Nutzer geeignet. Sie bieten visuelle Oberflächen, Unterstützung in natürlicher Sprache und erfordern keine Programmierkenntnisse.

3. Welches Tool ist am besten für groß angelegtes oder Enterprise-Web-Scraping?

import.io, Bright Data und Diffbot sind auf Skalierung, Zuverlässigkeit und Compliance ausgelegt. Sie bewältigen Millionen von Seiten, bieten robuste APIs und liefern dedizierten Support für Unternehmenskunden.

4. Kann ich verschiedene Tools kombinieren, um meinen Web-Scraping-Workflow zu optimieren?

Absolut! Viele Teams nutzen eine Kombination — etwa Thunderbit für die schnelle Strukturierung, dann WebHarvy für die Mustererkennung oder Apify für die Workflow-Automatisierung. Mehrere Tools zusammen einzusetzen, lässt dich die Stärken jedes einzelnen ausspielen.

5. Gibt es eine kostenlose Möglichkeit, diese KI-Web-Scraping-Tools auszuprobieren?

Ja! Die meisten Tools bieten eine Gratisstufe oder Testphase. Thunderbit, Octoparse, Data Miner und Apify haben alle kostenlose Pläne, sodass du experimentieren kannst, bevor du dich für ein kostenpflichtiges Abo entscheidest.

Bereit, dein Webdaten-Spiel auf das nächste Level zu bringen? Probiere ein paar dieser Tools aus und schau, wie viel Zeit — und Nerven — du sparen kannst. Und wenn du mehr Tipps zu Web-Scraping, Automatisierung und KI möchtest, schau im vorbei oder abonniere unseren . Viel Erfolg beim Scrapen!

Mehr lesen