Facebook-Scraping lohnt sich auch 2026 noch – aber nur, wenn man das richtige Erfassungsmodell wählt. Das Pew Research Center berichtete am 20. November 2025, dass , und Meta erklärte am 29. April 2026, dass seine . Diese Reichweite macht Facebook weiterhin nützlich für Marketplace-Monitoring, Recherchen auf öffentlichen Seiten, Lead-Generierung und Wettbewerbsbeobachtung. Das Schwierige ist nicht, Anwendungsfälle zu finden. Schwierig ist es, saubere Daten zu bekommen, ohne an Login-Sperren, dynamischen Ladeprozessen, temporären Blocks oder fragilen Scraping-Setups hängen zu bleiben.

Diese jährliche Shortlist ist auf schnelle Entscheidungen ausgelegt. Ich habe am 8. Mai 2026 die offiziellen Produktseiten, Dokus und Preissignale noch einmal geprüft und die Liste dann auf Tools fokussiert, die für echte Business-User weiterhin sinnvoll sind. Wenn dein Workflow im Wesentlichen lautet: „Daten von dieser Seite holen und in ein Sheet schicken“, dann starte mit Thunderbit. Wenn du Infrastruktur auf API-Niveau brauchst, gehören Bright Data, Apify und Nimble by Nimbleway an die Spitze der Liste. Wenn dein Job Cloud-Automatisierungen oder Folgeschritte nach der Erfassung umfasst, solltest du PhantomBuster genauer ansehen.

Schnelle Empfehlungen nach Aufgabe

- Du brauchst den schnellsten No-Code-Export von Facebook oder Marketplace? Starte mit .

- Du brauchst API-Skalierung für Unternehmen und verwaltetes Unblocking? Nimm in die engere Wahl.

- Du brauchst flexible Cloud-Scraping-Workflows? Sieh dir genau an.

- Du brauchst öffentliche Web-Erfassung mit API-First-Ansatz und weniger Wartungsaufwand? Dann ist eine Option.

- Du brauchst eine kostengünstige API für kleinere Aufgaben? ist weiterhin relevant.

- Du brauchst Scraping plus Workflow-Automatisierung? passt besser.

- Du brauchst einen visuellen Workflow-Builder mit Zeitplanung? bleibt eine solide No-Code-Option.

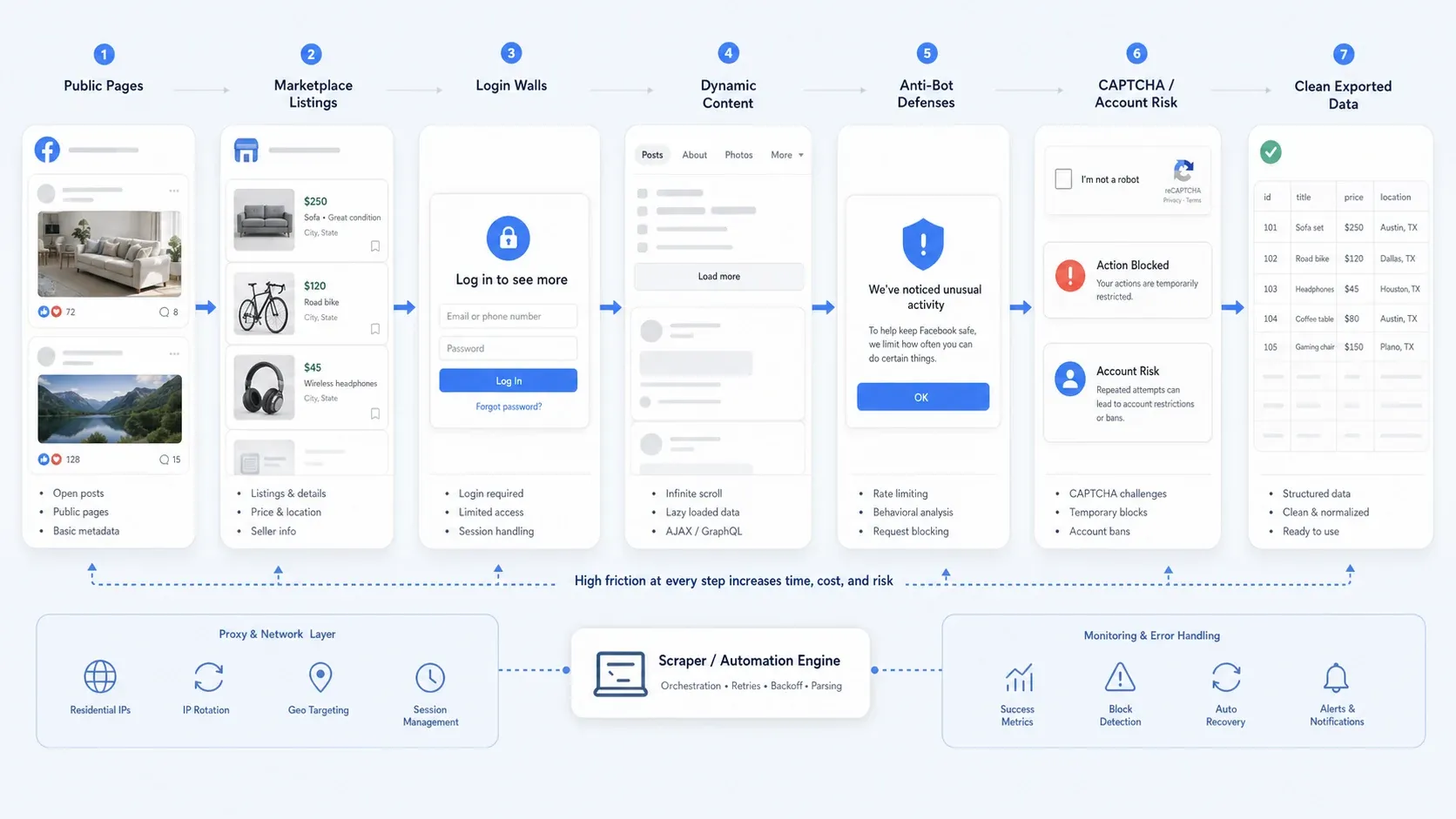

Warum Facebook-Scraping 2026 immer noch schwierig ist

Facebook-Datenerfassung ist in der Praxis selten nur ein Selektorproblem. Die meisten Teams stoßen auf eines oder mehrere dieser Probleme:

- Teilweise öffentlicher Zugriff: Manche Seiten bleiben öffentlich, während andere Abläufe dich zu einem Login drängen, um mehr Details zu sehen.

- Dynamische Inhalte: Marketplace-Ansichten, lange Kommentar-Threads und Seiteninhalte laden oft schrittweise nach.

- Anti-Bot-Schutz: Rate-Limits, Verhaltensprüfungen, CAPTCHAs und temporäre Aktionssperren bringen naive Automatisierungen schnell aus dem Takt.

- Operatives Risiko: Erfassung nur mit Login ist deutlich riskanter als Scraping öffentlicher Seiten, vor allem wenn Kontosicherheit und Wiederholbarkeit wichtig sind.

Wie ich diese Tools bewertet habe

Ich habe diese Seite auf die Bildung einer Shortlist optimiert, nicht auf künstlich aufgeblähte Feature-Listen. Bewertet wurden die Tools nach:

- Workflow-Fit: Passt das Produkt wirklich zu Facebook- und Marketplace-Erfassungsaufgaben, wie sie echte Teams ausführen?

- Einfache Bedienung: Können Nicht-Entwickler oder kleine Teams schnell zu brauchbaren Ergebnissen kommen?

- Skalierung und Zuverlässigkeit: Macht das Tool auch noch Sinn, wenn es nicht bei einem einmaligen Scrape bleibt?

- Umgang mit Anti-Bot-Maßnahmen und Sessions: Wie viel Infrastruktur-Stress nimmt das Produkt ab?

- Ausgabequalität: Lassen sich strukturierte Daten ohne großen Nachbearbeitungsaufwand in CSV, Sheets oder nachgelagerte Systeme bringen?

- Preissignal: Lässt sich das Produkt praktikabel testen, oder braucht es einen schweren Enterprise-Vertriebsprozess?

- Compliance-Haltung: Ist das Tool klar auf öffentliche Datenerfassung und verantwortungsvollen Einsatz ausgerichtet?

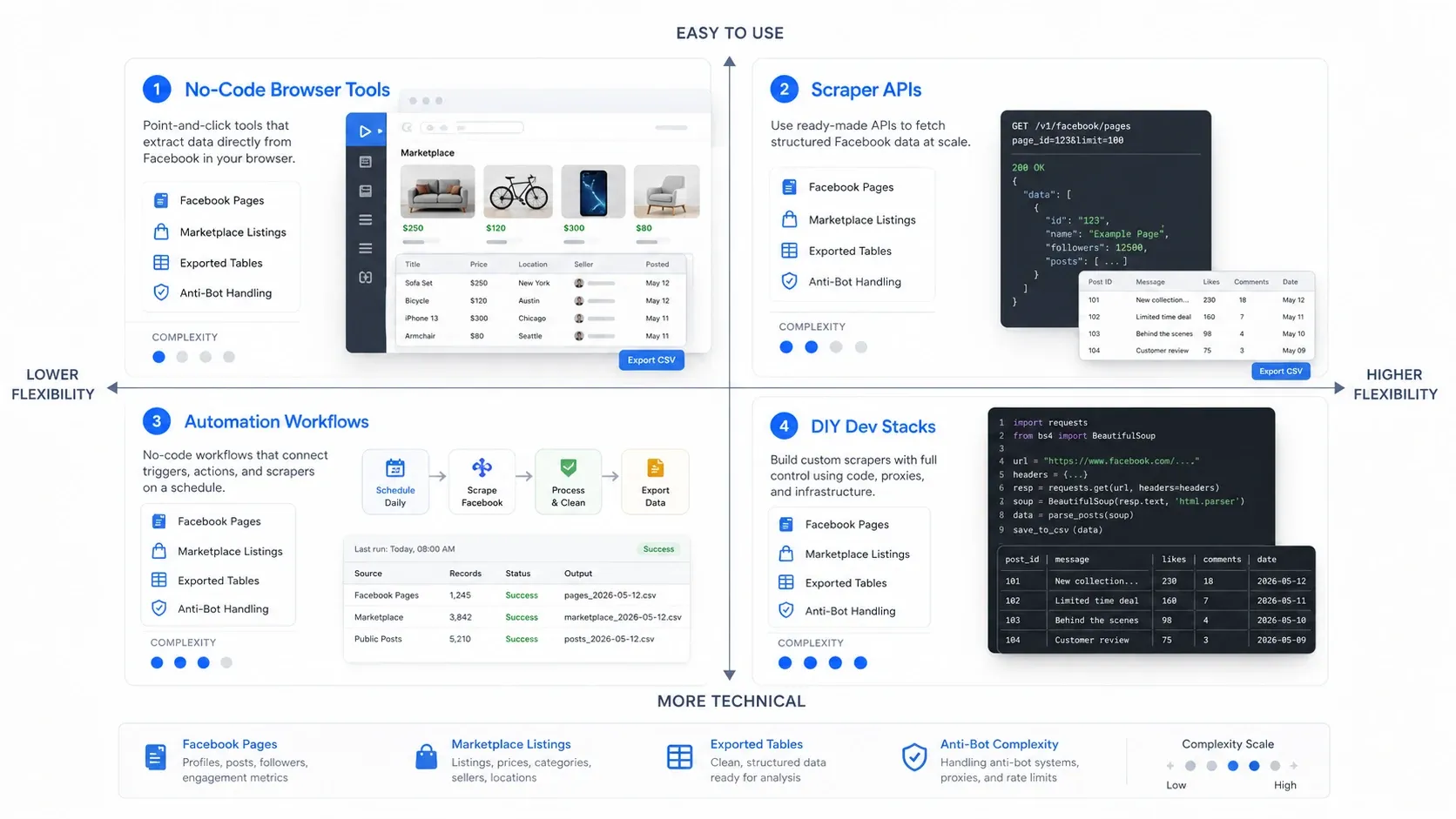

Welchen Typ Facebook-Scraper brauchst du?

Am schnellsten triffst du eine gute Wahl, wenn du zuerst die richtige Kategorie wählst. Facebook-Scraping-Tools fallen meist in vier Betriebsmodelle:

- No-Code-Browser-Tools: Am besten, wenn du schnell Daten aus der Seite ziehen willst, die bereits offen vor dir liegt.

- Scraper-APIs: Am besten, wenn du zuverlässige, wiederholbare Erfassung in höherem Volumen brauchst.

- Automatisierungs-Workflows: Am besten, wenn Scraping nur ein Schritt in einem größeren Go-to-Market-Prozess ist.

- DIY-Dev-Stacks: Am besten, wenn dein Team maximale Kontrolle will und bereit ist, den Wartungsaufwand selbst zu tragen.

Vergleichstabelle

| Tool | Am besten für | Warum es auf die Shortlist kam | Preissignal |

|---|---|---|---|

| Thunderbit | Nicht-technische Teams und schnelle Ad-hoc-Aufgaben | KI-Felderkennung, dynamische Seitenverarbeitung direkt im Browser, schnelle Exporte | Kostenlose Testversion; kostenpflichtige Pläne auf Guthabenbasis |

| Bright Data | Große öffentliche Social-Data-Pipelines | Dedizierte Scraper-APIs für Social Media, verwaltetes Unblocking, starke Skalierung | Nutzungsbasierte und Enterprise-Preise |

| Apify | Flexible Cloud-Scraping-Workflows | Vorgefertigte Facebook-Actors, Zeitplanung, API-Zugriff, Anpassungsspielraum | Bezahlte Plattformpläne plus nutzungsbasierte Abrechnung |

| Nimble by Nimbleway | API-First-Erfassung öffentlicher Webdaten | URL-First-API-Workflow und geringerer Wartungsaufwand für Scraper | Vertriebsgetriebene Preise |

| ScrapingBot | Kleine Public-Data-Aufgaben und Prototypen | Einfache API, Render-Unterstützung, niedrigerer Einstiegspreis | Kostenloser Tarif; kostenpflichtige Pläne ab etwa 22 $/Monat |

| PhantomBuster | GTM-Automatisierungs-Workflows | Cloud-Automatisierungen, Browser-Aktionen, Fit für Lead-Gen | Kostenlose Testversion; kostenpflichtige Pläne ab etwa 56 $/Monat |

| Octoparse | Visuelles No-Code-Scraping mit Zeitplanung | Point-and-Click-Builder, Cloud-Extraktion, wiederholbare Workflows | Kostenloser Plan; kostenpflichtige Pläne ab etwa 119 $/Monat |

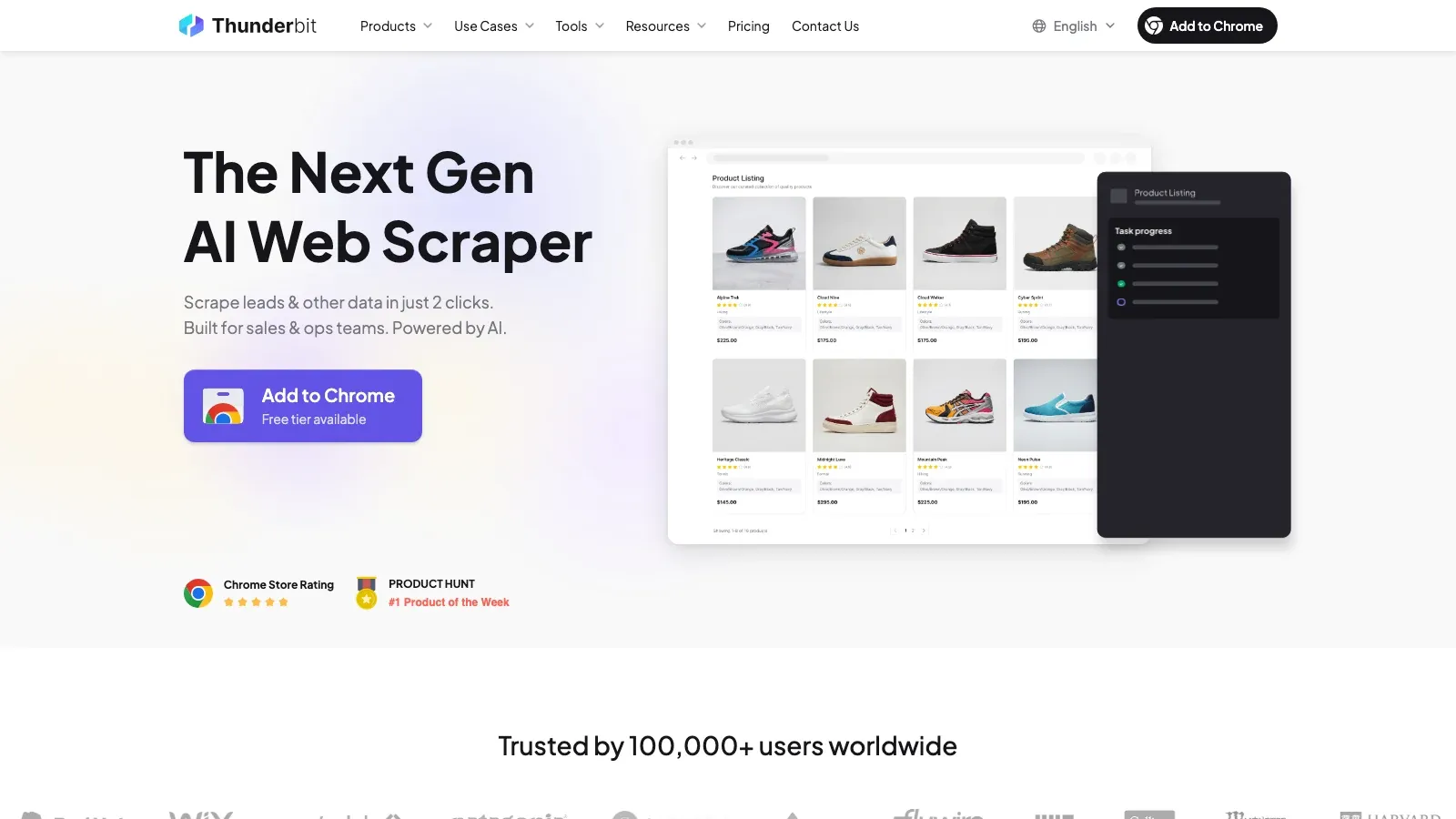

1. Thunderbit

ist hier die stärkste Wahl, wenn du eine Facebook-Seite oder eine Marketplace-Ergebnisliste schnell in strukturierte Daten verwandeln willst, ohne einen Scraper bauen oder warten zu müssen. Der zentrale Vorteil ist die semantische Extraktion: Thunderbit liest die Seite, schlägt sinnvolle Felder vor und lässt dich das Ergebnis exportieren, ohne dass du dich mit Selektoren, Proxys oder Code herumschlagen musst.

Warum es heraussticht:

- KI-Feldvorschläge: Thunderbit erkennt wahrscheinliche Felder wie Titel, Preis, Verkäufer, Ort, Kontaktdaten und URLs.

- Browser-native Verarbeitung: Weil es dort läuft, wo die Seite gerendert wird, funktioniert es gut auf dynamischen, scrollintensiven Seiten.

- Anreicherung von Unterseiten: Du kannst zuerst Listendaten erfassen und dann jeden Eintrag oder jede Seite für mehr Details öffnen.

- Nützliche Exporte: Excel, Google Sheets, Airtable und Notion sind natürliche Zielsysteme.

Wenn du vor dem eigenen Test eines browser-nativen Workflows lieber ein Video sehen willst, ist dieses praktische Thunderbit-Walkthrough der beste Einstieg, weil es den echten Extraktionsprozess zeigt statt nur Feature-Versprechen:

Am besten für: Nicht-Techniker, Sales-Teams, Operatoren und Researcher, die schnell Ergebnisse brauchen.

Preissignal: Kostenlose Testversion verfügbar; die kostenpflichtigen Pläne sind auf Guthabenbasis. Sieh dir die an.

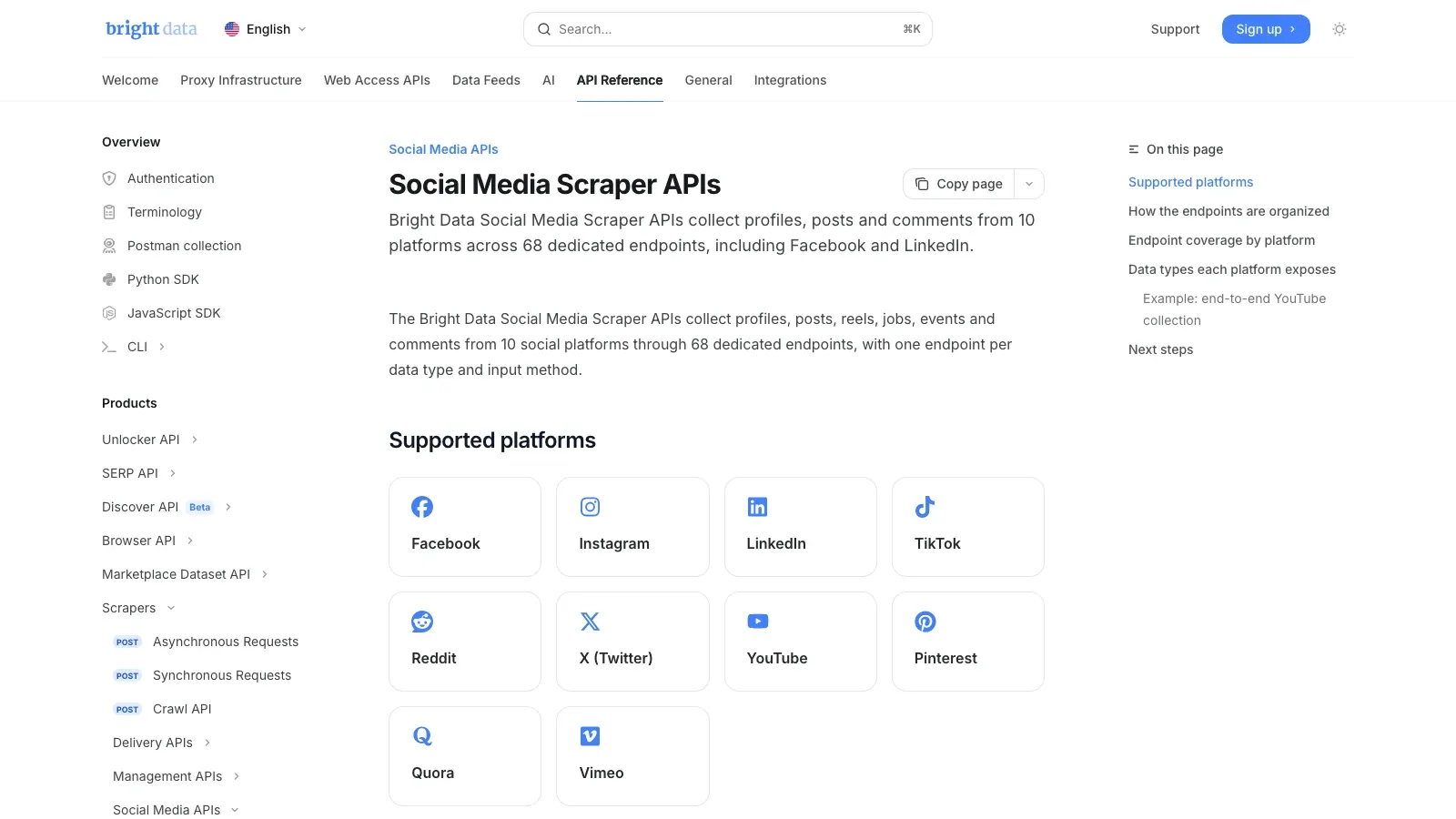

2. Bright Data

ist die Infrastruktur-First-Wahl. Die eigene Dokumentation von Bright Data sagt, dass die 10 Plattformen und 68 dedizierte Endpunkte abdecken, darunter Facebook. Wenn es um groß angelegte öffentliche Datenerfassung geht, ist ein verwalteter API-Stack meist realistischer als der Versuch, eine Browser-Erweiterung oder einen selbstgebauten Scraper zu skalieren.

Warum es auf die Shortlist gehört:

- Dedizierte Scraping-Endpunkte für Social Media

- Verwaltetes Unblocking und Extraktion

- Strukturierte Auslieferung der Daten für Datenpipelines

- Besser geeignet für zuverlässigkeitskritische Monitoring- und Analyseaufgaben

Am besten für: Analysten, Datenteams, große Monitoring-Projekte und öffentliche Social-Datensätze in großem Maßstab.

Preissignal: Die Preise variieren je nach Produkt und Volumen. Prüfe die aktuellen .

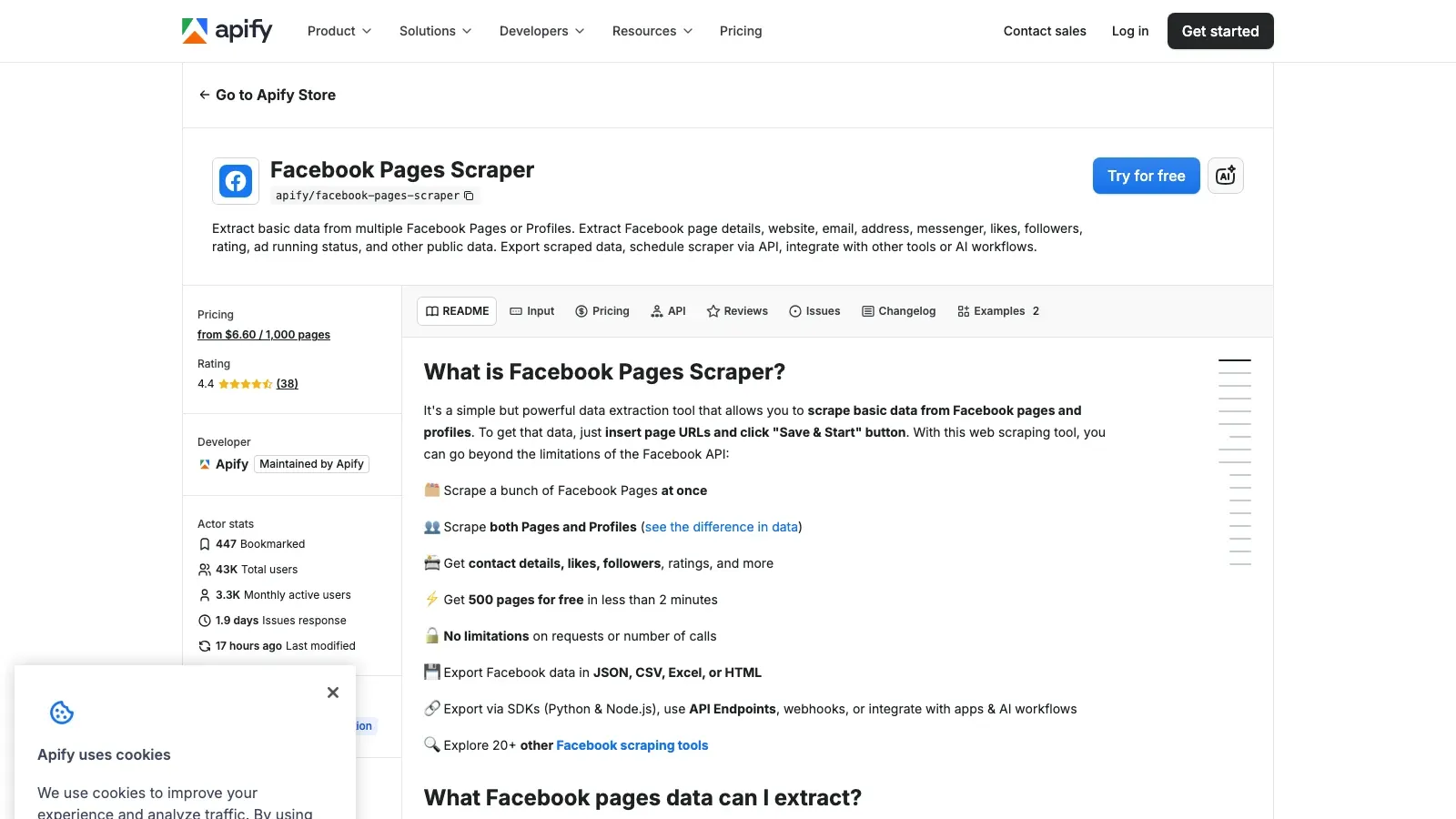

3. Apify

bleibt relevant, weil es einen starken Mittelweg zwischen Vorlagen und vollständiger Anpassung bietet. Der Facebook Pages Scraper Actor ist ein guter Startpunkt, während die breitere Apify-Plattform Cloud-Läufe, Zeitplanung, APIs und Spielraum zur Erweiterung des Workflows bietet, wenn deine Anforderungen komplexer werden.

Warum es in die Liste kam:

- Fertige Facebook-Actors

- Cloud-Ausführung und wiederkehrende Zeitpläne

- Flexible Exporte und API-Zugriff

- Leichter erweiterbar als ein reiner No-Code-Browser-Workflow

Am besten für: technikaffine Marketer, Agenturen, Ops-Teams und wiederkehrende Erfassungsjobs über mehrere Websites hinweg.

Preissignal: Plattformpläne sind kostenpflichtig, und die Nutzung der Actors wird separat abgerechnet. Prüfe die .

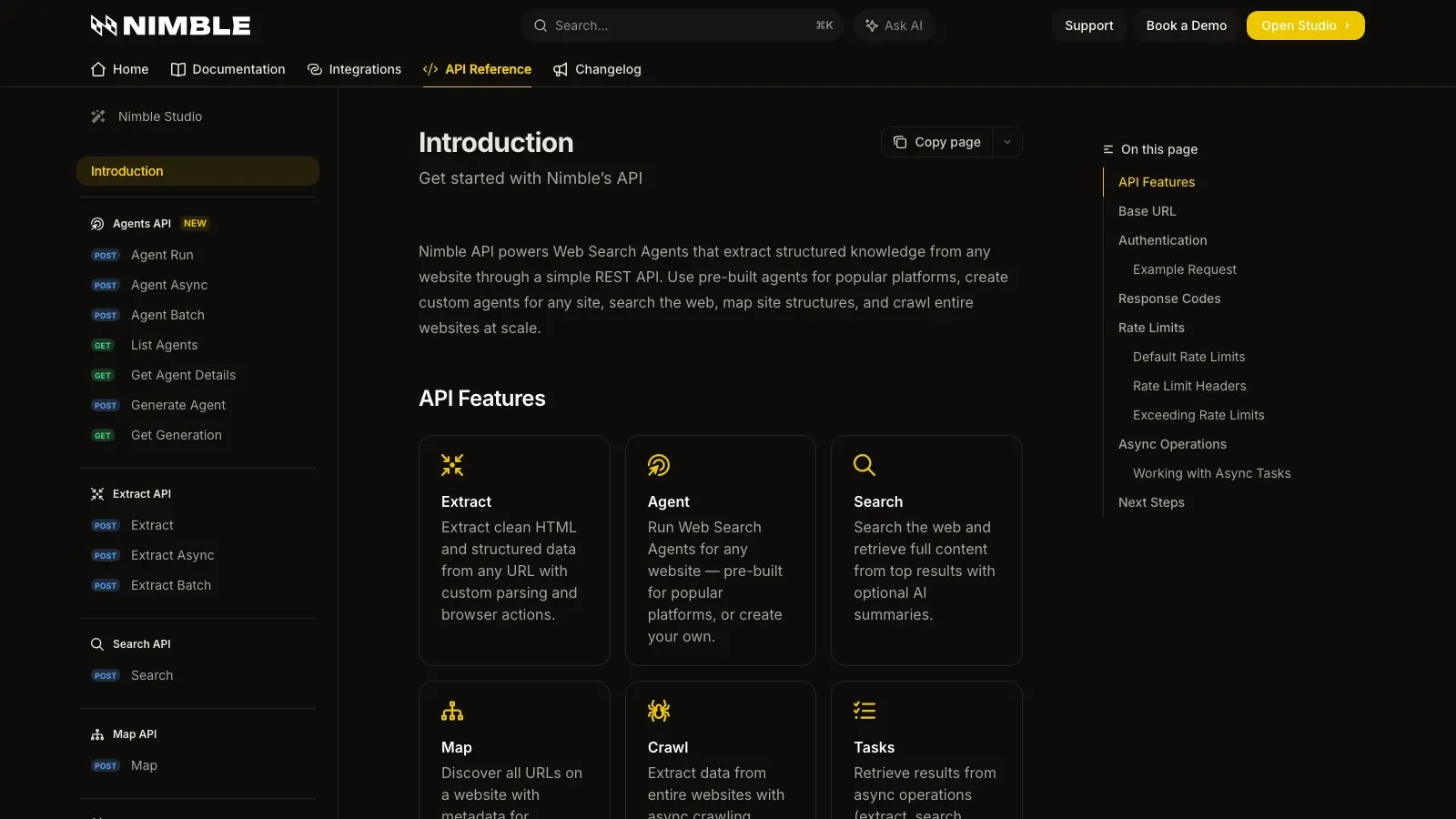

4. Nimble by Nimbleway

ist die API-First-Option für Teams, die einfach eine URL senden wollen und die Plattform den Zugriff, das Rendering und die Auslieferung übernehmen lassen möchten. Nimble positioniert seine als End-to-End-Lösung für die Erfassung öffentlicher Webdaten. Das ist nützlich, wenn Facebook-Scraping nur ein Teil eines größeren Daten-Stacks ist.

Warum es sich anzusehen lohnt:

- URL-First-API-Workflow

- Weniger Wartungsaufwand für Scraper bei Engineering-Teams

- Gute Passung für robuste Erfassung öffentlicher Webdaten

- Hilfreich, wenn gescrapte Daten interne Produkte oder Dashboards speisen

Am besten für: engineering-getriebene Teams, Produkt-Datenpipelines und Organisationen, die eine Infrastruktur-Abstraktion statt einzelner Punkt-Tools wollen.

Preissignal: Nimble stellt auf den zentralen API-Seiten keine öffentlich klar kommunizierten Self-Service-Preise in den Vordergrund; rechne daher mit vertriebsgetriebenen Preisen und kläre Details direkt mit .

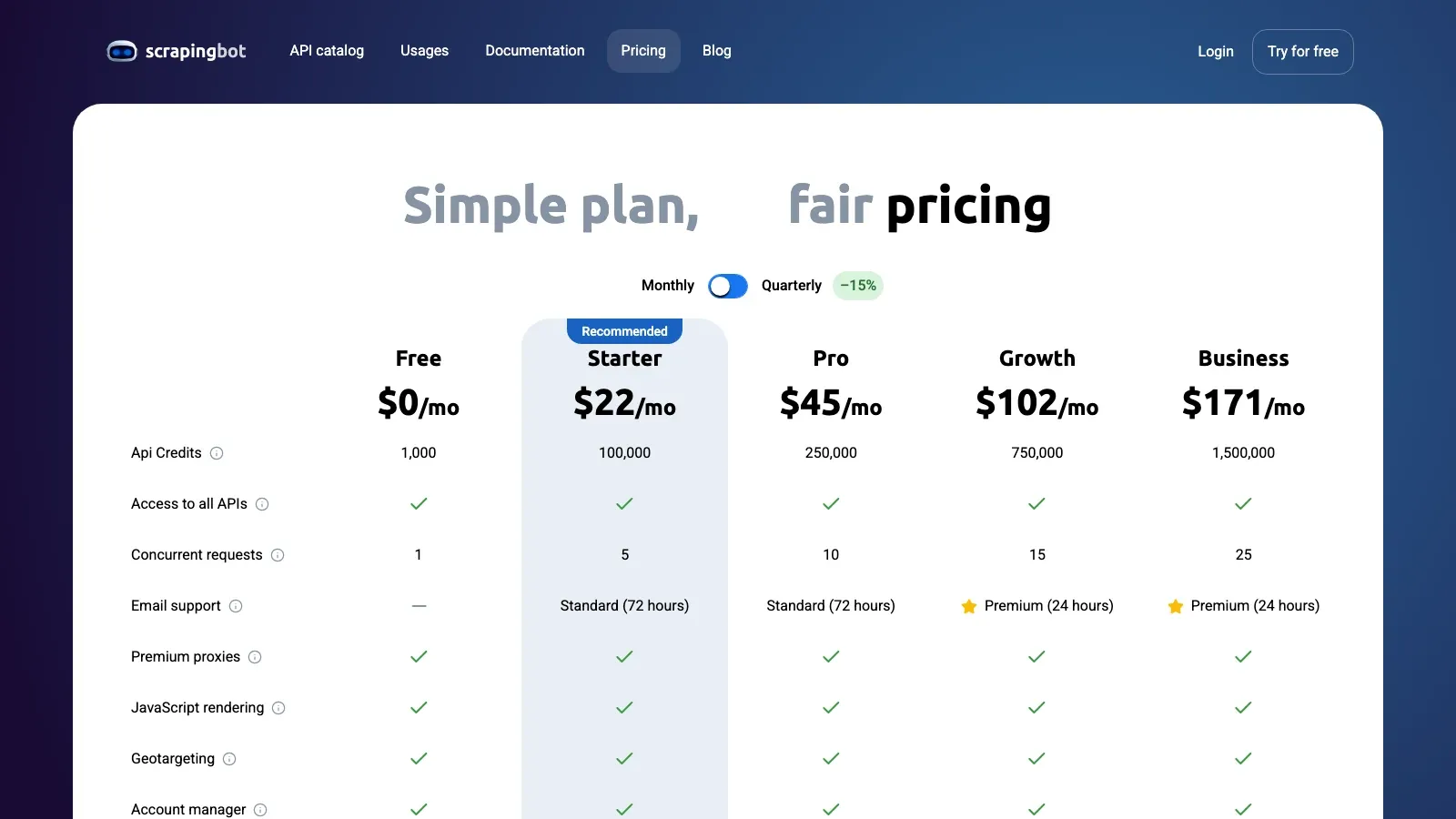

5. ScrapingBot

ist die preisbewusste API-Option in dieser Liste. Es ist nicht die tiefste Facebook-spezialisierte Plattform hier, aber für kleinere öffentliche Datenerfassungen ist es weiterhin sinnvoll, wenn du eine API, Render-Unterstützung und eine niedrigere Einstiegshürde als bei Enterprise-Scraping-Infrastruktur willst.

Wofür es passt:

- Einfaches, API-getriebenes Public-Scraping

- Niedriger Einstiegspreis

- Render- und Proxy-Handling inklusive

- Besser für Prototypen und leichte wiederkehrende Abrufe als für große Intelligence-Programme

Am besten für: Start-ups, kleine Unternehmen und Entwickler, die leichtere Anwendungsfälle zur öffentlichen Seitenerfassung testen.

Preissignal: Kostenloser Tarif verfügbar; die aktuelle öffentliche Preisseite startet kostenpflichtige Pläne bei etwa .

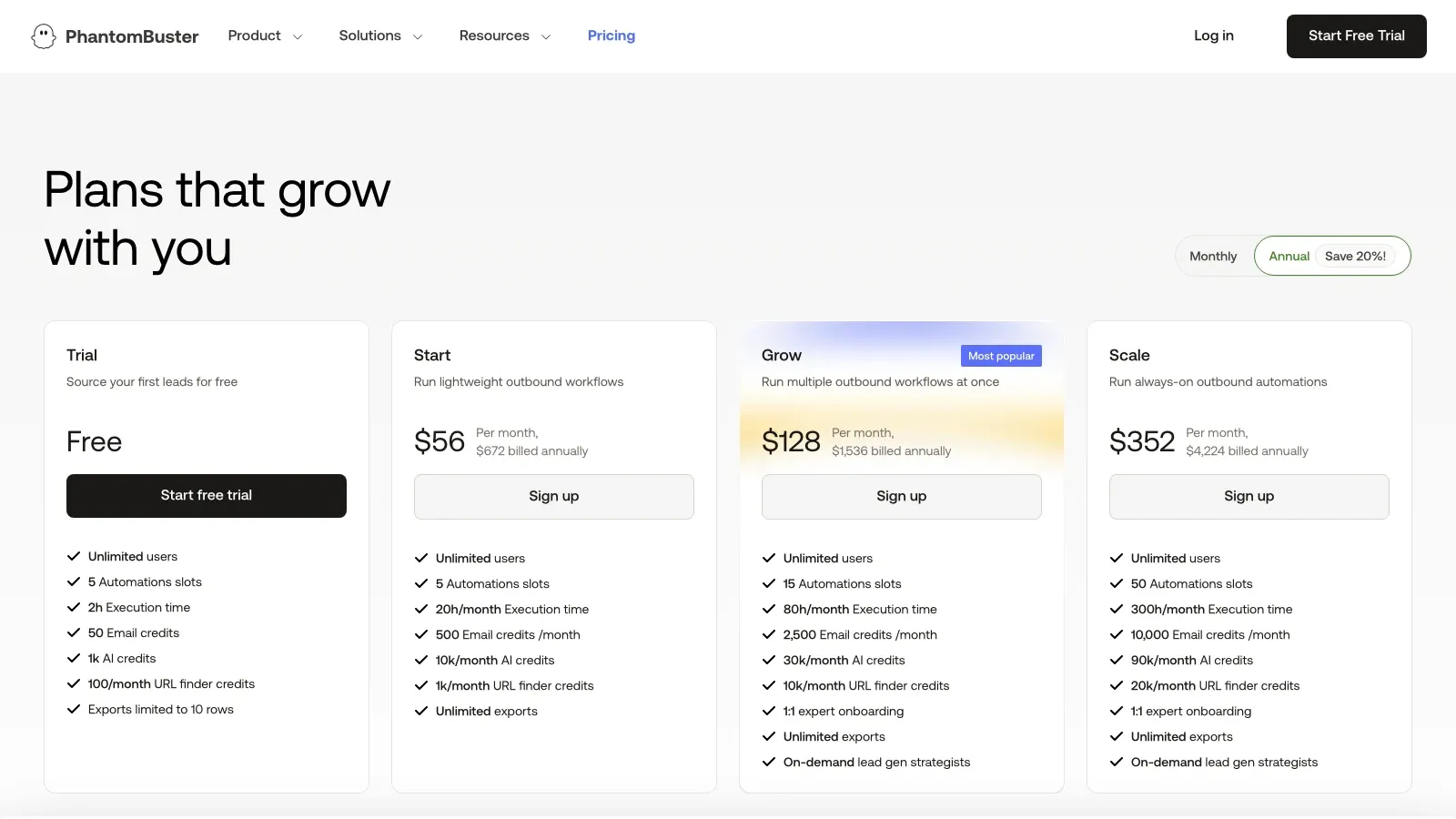

6. PhantomBuster

dreht sich weniger um rohe Scraping-Infrastruktur und mehr darum, was nach der Erfassung passiert. Wenn dein Use Case lautet: „Daten sammeln und dann Outreach, Anreicherung oder Follow-up-Aktionen auslösen“, ist PhantomBuster oft nützlicher als ein einfacher Extraktor, weil es auf Cloud-Automatisierungen und Browser-Aktions-Workflows ausgelegt ist.

Warum Teams es trotzdem auf die Shortlist setzen:

- Cloud-basierte Automatisierungs-Workflows

- Nützlich für Lead-Generierung und GTM-Operationen

- Stärkere Passung, wenn Scraping nur ein Schritt in einem größeren Prozess ist

- Praktisch für Operatoren, die auf Aktionen statt nur auf Exporte achten

Am besten für: GTM-Teams, Growth-Teams, Recruiter und Operatoren, die Datenerfassung mit nachgelagerten Aktionen verknüpfen.

Preissignal: Kostenlose Testversion verfügbar; die kostenpflichtigen Pläne auf der aktuellen Preisseite starten bei etwa .

7. Octoparse

bleibt eines der besseren visuellen No-Code-Scraping-Tools für Nutzer, die wiederholbare Workflows und geplante Cloud-Läufe möchten. Für schnelle Facebook-Einmalaufgaben ist es nicht so leichtgewichtig wie Thunderbit, aber Nicht-Entwicklern gibt es mehr explizite Kontrolle darüber, wie die Extraktionslogik aufgebaut und wiederholt wird.

Warum es relevant bleibt:

- Visueller Point-and-Click-Workflow-Builder

- Cloud-Extraktion und Zeitplanung

- Gut für strukturierte, wiederkehrende Aufgaben

- Besser geeignet für Analysten, die Wiederholbarkeit ohne Code wollen

Am besten für: nicht-technische Analysten, SMB-Ops-Teams und wiederholbare Erfassungsaufgaben mit klarer Workflow-Logik.

Preissignal: Die öffentliche Preisseite von Octoparse listet kostenpflichtige Pläne ab etwa .

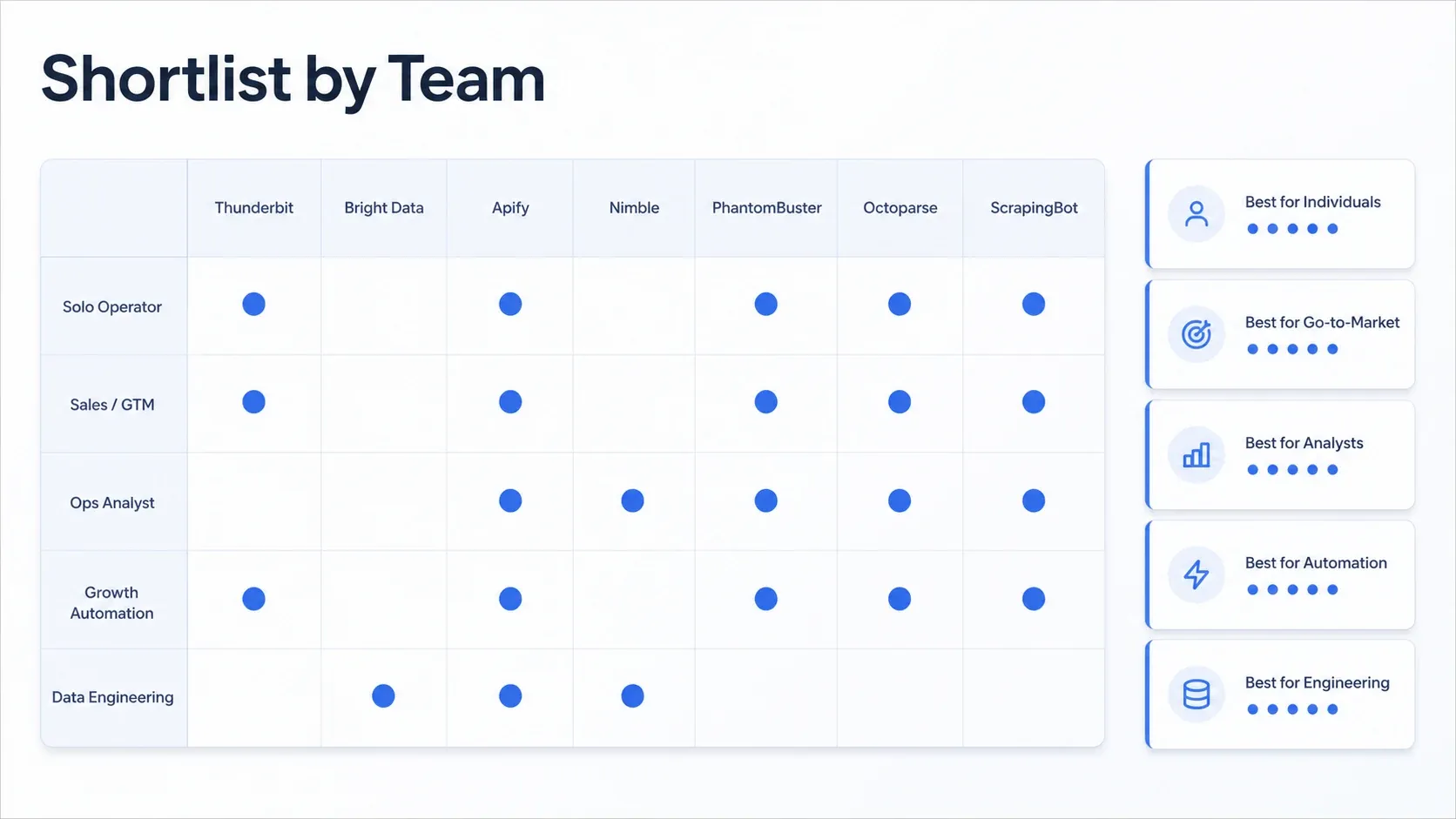

Shortlist nach Team

Wenn du schon weißt, welches Team den Workflow übernehmen wird, dann starte hier:

- Solo-Operator oder kleines Unternehmen: Thunderbit, ScrapingBot oder Octoparse

- Sales- / GTM-Team: Thunderbit oder PhantomBuster

- Ops-Analyst: Thunderbit, Apify oder Octoparse

- Growth-Automatisierungsteam: PhantomBuster oder Apify

- Data-Engineering-Team: Bright Data, Nimble oder Apify

So wählst du den richtigen Facebook-Scraper aus

- Wähle Thunderbit, wenn Geschwindigkeit und Einfachheit wichtiger sind als maximale Skalierung.

- Wähle Bright Data, wenn du öffentliche Daten in großem Umfang und verwaltete Zuverlässigkeit brauchst.

- Wähle Apify, wenn du Plattform-Flexibilität und Actor-basierte Workflows willst.

- Wähle Nimble, wenn du eine API-First-Abstraktionsschicht mit geringerem Wartungsaufwand für Scraper willst.

- Wähle PhantomBuster, wenn Scraping nur ein Schritt in einem größeren GTM-Automatisierungs-Workflow ist.

- Wähle Octoparse, wenn du visuelle Wiederholbarkeit ohne Code willst.

- Wähle ScrapingBot, wenn das Budget zählt und die Aufgabe relativ einfach ist.

Fazit

Die Marktaufteilung ist 2026 klarer als noch vor einem Jahr. Du suchst nicht wirklich den einen universell „besten Facebook Scraper“. Du wählst ein Erfassungsmodell: schnelle No-Code-Extraktion, verwaltete API-Skalierung, Cloud-Automatisierung oder handfeste visuelle Workflow-Kontrolle. Wenn du dort anfängst, wird die Shortlist deutlich einfacher.

Wenn dein Team den schnellsten Weg von einer Facebook-Seite oder einer Marketplace-Liste zu nutzbaren strukturierten Daten sucht, ist Thunderbit immer noch der einfachste Einstieg. Wenn dein Volumen oder deine Engineering-Anforderungen deutlich höher sind, machen Bright Data, Apify und Nimble mehr Sinn. Wenn dein Workflow mit Scraping beginnt, aber mit Folgemaßnahmen endet, ist PhantomBuster die klügere Shortlist.

FAQs

1. Was ist das einfachste Facebook-Scraping-Tool für Nicht-Techniker?

Thunderbit ist für die meisten Nicht-Techniker der einfachste Einstieg, weil es im Browser arbeitet, Felder automatisch vorschlägt und Daten schnell ohne Code exportiert.

2. Welches Facebook-Scraping-Tool ist am besten für die Erfassung großer öffentlicher Datenmengen?

Bright Data ist in dieser Liste die stärkste Infrastruktur-Wahl, wenn es um die Erfassung öffentlicher Social-Daten in großem Maßstab geht und Zuverlässigkeit wichtiger ist als Benutzerfreundlichkeit.

3. Was ist, wenn ich Scraping plus anschließende Automatisierung brauche?

PhantomBuster passt besser, wenn Datenerfassung nur ein Schritt in einem größeren Lead-Generierungs- oder GTM-Workflow ist.

4. Ist Facebook-Scraping 2026 immer noch schwierig?

Ja. Dynamische Inhalte, Login-Schranken, Rate-Limits, Anti-Bot-Systeme und Kontorisiken machen Facebook weiterhin schwieriger als das Scrapen einfacherer öffentlicher Websites.

5. Wie sollten Teams bei Compliance denken?

Konzentriere dich auf öffentliche Daten, nutze vernünftige Raten, vermeide Missbrauch von Zugangsdaten und prüfe die Plattformbedingungen sowie geltende Datenschutzregeln, bevor du einen Workflow skalierst.

Weiterlesen: