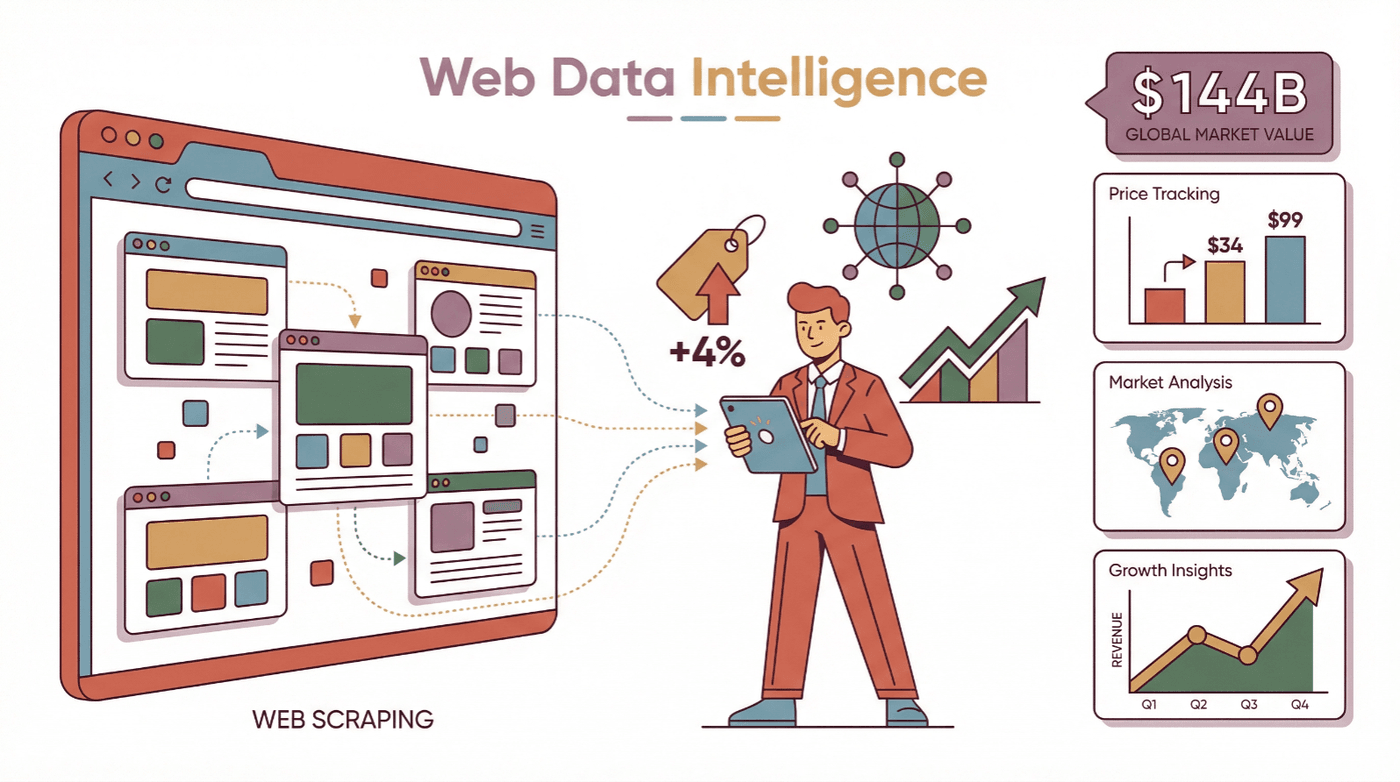

Das Web wächst in einem Tempo, das selbst den ehrgeizigsten Daten-Nerd schwindelig machen würde. Unternehmen setzen heute stärker denn je auf Webdaten – sei es, um Preise von Wettbewerbern im Blick zu behalten, Produkttrends zu verfolgen oder riesige Lead-Listen aufzubauen. Tatsächlich dürfte der globale Markt für Web-Scraping von rund 5 Milliarden US-Dollar im Jahr 2023 auf fast wachsen. Warum? Weil die richtigen Daten zur richtigen Zeit den Unterschied zwischen einer verpassten Chance und einem großen Erfolg ausmachen können. Es gibt dafür genug konkrete Beispiele: John Lewis steigerte seinen Umsatz durch das Scrapen von Wettbewerberpreisen um 4 %, und Einzelhändler wie ASOS schreiben regionsspezifischen Webdaten zu, ihr internationales Geschäft etwa verdoppelt zu haben.

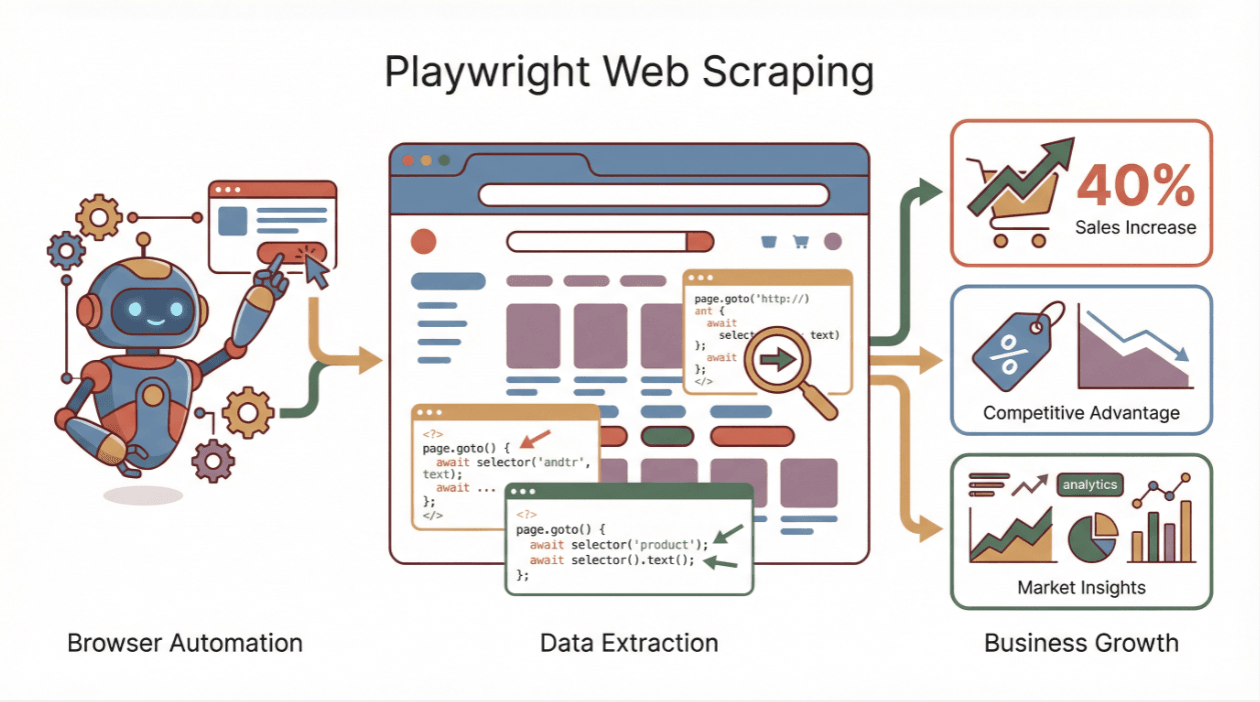

Der Haken ist allerdings: Websites sind heute eher Mini-Apps als statische Seiten. Sie stecken voller JavaScript, dynamischer Inhalte und interaktiver Funktionen, die klassische Scraper alt aussehen lassen. Genau hier kommt Playwright Web-Scraping ins Spiel – ein Tool zur Browser-Automatisierung, mit dem Sie mit Websites genauso interagieren können wie ein echter Nutzer. So lassen sich selbst aus den kniffligsten, dynamischsten Seiten Daten extrahieren. In diesem Leitfaden zeige ich Ihnen die Grundlagen von Playwright Web-Scraping, wie Sie loslegen und wie Sie es mit KI-gestützten Tools wie kombinieren können, um Ihr Daten-Spiel auf das nächste Level zu heben.

Was ist Playwright Web-Scraping?

Kurz gesagt: Playwright ist ein Open-Source-Framework von Microsoft zur Browser-Automatisierung. Es ist, als hätten Sie eine Fernbedienung für Chrome, Firefox, Safari und mehr. Mit Playwright können Sie einen echten Browser starten, eine Website aufrufen, Buttons klicken, Formulare ausfüllen, scrollen und – am wichtigsten – Daten von einer Seite extrahieren, selbst wenn diese Daten erst nach dem Ausführen von JavaScript erscheinen ().

Browserbasiertes Scraping (wie mit Playwright) unterscheidet sich vom klassischen HTTP-basierten Scraping. Alte Scraper laden nur das HTML – wenn eine Website Daten per JavaScript nachlädt, bekommen Sie nur eine leere Seite. Playwright hingegen steuert einen echten Browser, der alle Skripte ausführt. Sie sehen also die vollständig gerenderte Seite, genau wie ein Mensch ().

Wer profitiert von Playwright Web-Scraping? Alle, die Daten von modernen, interaktiven Websites benötigen: Vertriebsteams, die Leads aus Verzeichnissen scrapen, Marketing-Teams, die Wettbewerberseiten überwachen, E-Commerce-Teams, die Preise und Lagerbestände verfolgen, sowie Forschende, die öffentliche Daten zusammenführen. Wenn Sie schon einmal versucht haben, eine Website zu scrapen und am Ende nur leere Felder erhalten haben, wird Playwright schnell zu Ihrem neuen besten Freund.

Warum Playwright Web-Scraping für Unternehmen wichtig ist

Unterm Strich gilt: Playwright macht Daten zugänglich, die bisher kaum erreichbar waren. Durch die Automatisierung echter Browseraktionen können Sie Informationen von Websites extrahieren, die stark auf JavaScript setzen, Logins erfordern oder interaktive Funktionen besitzen.

Schauen wir uns einige echte Business-Use-Cases an:

| Abteilung | Web-Scraping-Anwendungsfall | Vorteil / Ergebnis |

|---|---|---|

| Vertrieb | Geschäftsverzeichnisse oder LinkedIn nach Leads scrapen | Größere, aktuellere Lead-Listen; schnelleres Pipeline-Wachstum |

| Marketing | Wettbewerberseiten zu Preisen, Launches und Content überwachen | Einblicke in Echtzeit; schnelle Strategieanpassungen |

| E-Commerce-Operations | Wettbewerberpreise verfolgen, Marktplätze nach Produkten scrapen | Dynamische Preisoptimierung; bessere Produkt- und Bestandsentscheidungen |

| Research & BI | Öffentliche Daten aggregieren (Social, Finanzen, Behörden) | Rechtzeitige Analysen und Berichte für bessere Entscheidungen |

Die Wirkung ist real: , indem Wettbewerberpreise gescrapt wurden, und einige E-Commerce-Teams berichten von dank wettbewerbsbezogenem Preis-Monitoring auf Basis gescrapter Daten.

Playwright für Web-Scraping einrichten: Ihre ersten Schritte

Mit Playwright loszulegen ist erfreulich unkompliziert – selbst wenn Sie kein erfahrener Entwickler sind. So geht’s:

1. Eine Programmiersprache installieren

Playwright funktioniert mit Node.js (JavaScript/TypeScript) oder Python (außerdem Java und .NET, aber wir halten es einfach). Stellen Sie sicher, dass Node.js oder Python installiert ist. Für Python benötigen Sie Version 3.8+ ().

2. Playwright installieren

- Für Node.js:

1npm init -y 2npm install playwright 3npx playwright install - Für Python:

1pip install playwright 2python -m playwright install

3. Installation überprüfen

Probieren Sie ein kleines Skript aus, um sicherzustellen, dass alles funktioniert. Hier ist ein Python-Beispiel:

1from playwright.sync_api import sync_playwright

2with sync_playwright() as p:

3 browser = p.chromium.launch(headless=True)

4 page = browser.new_page()

5 page.goto("https://example.com")

6 print(page.title())

7 browser.close()Wenn Sie „Example Domain“ ausgegeben sehen, ist alles bereit.

4. Fehlerbehebung

Wenn Probleme auftauchen (fehlende Browser, Berechtigungen oder Netzwerkprobleme), führen Sie den Installationsbefehl einfach noch einmal aus oder werfen Sie einen Blick in die . Die meisten Einrichtungsprobleme lassen sich mit einer kurzen Google-Suche und etwas Geduld lösen.

Scraping auf Browser-Ebene: Mit Playwright dynamische Seiten bedienen

Hier spielt Playwright seine Stärken wirklich aus. Anders als klassische Scraper kann Playwright mit der Seite interagieren wie ein Mensch:

- Zu einer Seite navigieren:

page.goto("https://...") - Auf Inhalte warten:

page.wait_for_selector(".product-item") - Buttons/Links klicken:

page.click(".pagination-next") - In Formulare tippen:

page.fill("input[name='q']", "laptop") - Scrollen:

page.evaluate("window.scrollBy(0, document.body.scrollHeight)") - Aus Dropdowns auswählen:

page.select_option("select#element", "value") - Eigenes JavaScript ausführen:

page.evaluate("return window.someValue")

Warum ist das wichtig? Weil moderne Websites Daten oft hinter Klicks, Dropdowns oder endlosem Scrollen verstecken. Playwright ermöglicht es Ihnen, all diese Aktionen zu simulieren und so an Daten zu kommen, die erst nach einer Nutzerinteraktion sichtbar werden ().

Beispiel: Produktlisten scrapen

1# Pseudocode für Playwright-Scraping

2page.goto("https://example.com/products")

3page.wait_for_selector(".product-item")

4names = page.locator(".product-name").all_text_contents()

5prices = page.locator(".price").all_text_contents()Sie können sogar die Pagination durchlaufen, indem Sie auf die Schaltfläche „Weiter“ klicken und die Extraktion wiederholen.

Maximale Performance: Playwright Web-Scraping mit mehreren Tabs und Sessions

Ein Browser-Tab nach dem anderen reicht für kleine Jobs, aber was ist, wenn Sie Hunderte oder Tausende von Seiten scrapen müssen? Playwright unterstützt Scraping mit mehreren Tabs und Sessions – Sie können also mehrere Browser-Kontexte oder Seiten gleichzeitig öffnen und so Ihre Datenerfassung deutlich beschleunigen ().

Wie funktioniert das? In Node.js können Sie mit Promise.all mehrere page.goto()-Aufrufe parallel ausführen. In Python nutzen Sie die Async-API mit asyncio.gather.

Best Practices:

- Beginnen Sie mit 3–5 parallelen Browsern pro CPU-Kern.

- Verwenden Sie Semaphoren, um die Parallelität zu begrenzen und Ihren Rechner oder die Zielwebsite nicht zu überlasten.

- Überwachen Sie CPU- und Speichernutzung.

- Bauen Sie höfliche Verzögerungen ein und randomisieren Sie Aktionen, um Anti-Bot-Erkennung zu vermeiden.

Vergleichstabelle: Einzel- vs. Multi-Tab-Scraping

| Modus | Durchsatzgeschwindigkeit | Komplexität | Erkennungsrisiko |

|---|---|---|---|

| Einzel-Tab | Langsam (nacheinander) | Einfach | Niedrig |

| Multi-Tab | 3–5x schneller (oder mehr) | Höher (async) | Mittel (bei Missbrauch) |

Für die meisten geschäftlichen Scraping-Aufgaben bietet eine Handvoll paralleler Tabs die beste Balance aus Geschwindigkeit und Sicherheit.

API-Grenzen und Herausforderungen durch dynamische Inhalte meistern

Moderne Websites werfen gern neue Hürden in den Weg: API-Rate-Limits, Inhalte, die per AJAX geladen werden, endloses Scrollen, CAPTCHAs und mehr. Die Funktionen von Playwright helfen Ihnen, damit souverän umzugehen:

- Auf Elemente warten: Nutzen Sie

wait_for_selector, um zu pausieren, bis die benötigten Daten erscheinen. - Auf Netzwerk-Leerlauf warten:

wait_for_load_state("networkidle")stellt sicher, dass alle Anfragen abgeschlossen sind. - Endloses Scrollen behandeln: Scroll-Aktionen in einer Schleife ausführen und warten, bis neue Inhalte geladen sind.

- Retry-Logik: Wenn Sie auf ein Rate-Limit oder eine Blockade stoßen, warten Sie etwas und versuchen Sie es erneut.

- User-Agents und Proxys rotieren: Simulieren Sie echte Nutzer und vermeiden Sie IP-Sperren.

Checkliste zur Fehlerbehebung:

- Leere Daten? Wartezeiten hinzufügen oder anpassen.

- Das Skript funktioniert auf einer Seite, aber nicht auf einer anderen? Prüfen Sie CAPTCHAs oder Layoutänderungen.

- Blockiert? Verlangsamen, IPs rotieren oder Header anpassen.

Thunderbit mit Playwright Web-Scraping integrieren

Jetzt wird’s richtig interessant. ist eine KI-gestützte Chrome-Erweiterung für Web-Scraping, mit der sich Datenextraktion so einfach anfühlt wie ein Klick auf einen Button. Sie öffnen einfach eine Seite, klicken auf „KI-Felder vorschlagen“, und die KI von Thunderbit erkennt selbst, welche Daten extrahiert werden sollen – ganz ohne Programmierung.

Wie ergänzt Thunderbit Playwright?

- Für Nicht-Entwickler: Thunderbit ermöglicht es Vertriebs-, Marketing- und E-Commerce-Teams, die benötigten Daten zu erhalten, ohne auf Dev-Support warten zu müssen.

- Für Entwickler: Playwright eignet sich für komplexes, groß angelegtes oder tief integriertes Scraping. Thunderbit ist ideal für schnelle, ad-hoc oder schwierige Seiten, bei denen KI schneller reagieren kann als ein kodiertes Skript.

- Kombinierte Workflows: Verwenden Sie Playwright zum Beispiel, um Login und Navigation zu automatisieren, und lassen Sie dann die KI von Thunderbit die Daten extrahieren und nach Excel, Google Sheets oder Notion exportieren.

Thunderbit ist besonders nützlich für:

- unübersichtliche, dynamische oder häufig wechselnde Seiten scrapen

- strukturierte Daten mit KI-gestützten Feldvorschlägen extrahieren

- direkt in Business-Tools exportieren (Excel, Sheets, Airtable, Notion)

- Unterseiten und Pagination mit minimalem Aufwand verarbeiten

Wenn Sie sehen möchten, wie Thunderbit im Vergleich zu Playwright und anderen Tools abschneidet, werfen Sie einen Blick auf unseren .

Daten-Nachbearbeitung: Playwright-Scraping-Ergebnisse in Business-Insights verwandeln

Scraping ist nur die halbe Miete – der eigentliche Wert entsteht, wenn Rohdaten in verwertbare Erkenntnisse umgewandelt werden. So gehe ich bei der Nachbearbeitung vor:

- Daten bereinigen: Duplikate entfernen, Müll herausfiltern und Formate vereinheitlichen (Datum, Preise, Kategorien).

- Validieren: Sicherstellen, dass wichtige Felder nicht fehlen und die Werte plausibel sind (z. B. positive Preise).

- Anreichern: Zusätzlichen Kontext hinzufügen, etwa Geolokalisierung, Sentiment-Analyse oder Kategorien-Tags. Thunderbit kann das sogar während der Extraktion automatisch erledigen.

- Exportieren: Daten im gewünschten Format speichern – Excel, Google Sheets, CSV, JSON oder direkt in Ihr CRM.

- Visualisieren und analysieren: Daten in BI-Tools oder Dashboards laden, um Berichte und Entscheidungen zu unterstützen.

Mini-Checkliste:

- [ ] Deduplizieren und filtern

- [ ] Formate standardisieren

- [ ] Kritische Felder validieren

- [ ] Mit Zusatzinfos anreichern

- [ ] In Geschäftssysteme exportieren

Mehr zu Best Practices bei der Datenbereinigung finden Sie in diesem .

Playwright Web-Scraping im Vergleich zu anderen Lösungen

Im Werkzeugkasten für Web-Scraping gibt es viele Optionen. So schlägt sich Playwright:

| Tool | Benutzerfreundlichkeit | Browser-Unterstützung | Sprachunterstützung | Stärken | Schwächen |

|---|---|---|---|---|---|

| Playwright | Mittel (mit Code) | Chrome, Firefox, Safari | Python, JS, Java, .NET | Cross-Browser, intelligente Wartezeiten, Parallelität | Erfordert Code, jüngere Community |

| Puppeteer | Mittel (mit Code) | Nur Chrome | JavaScript | Schnell in Chrome, große JS-Community | Nur Chrome, keine offizielle Python-Unterstützung |

| Selenium | Anspruchsvoll (ältere API) | Alle großen Browser | Viele (Python, JS, Java usw.) | Ausgereift, breite Unterstützung | Langsamer, mehr Boilerplate |

| Thunderbit | Sehr einfach (ohne Code) | Chrome-Erweiterung | N/A (kein Code nötig) | KI passt sich Seitenänderungen an, sofortiger Export | Kostenpflichtig über die Gratisstufe hinaus, weniger benutzerdefinierte Logik |

Wann was verwenden?

- Playwright: Für Entwickler, die volle Kontrolle und Scraping dynamischer Seiten brauchen.

- Thunderbit: Für Business-Anwender oder schnelle Jobs, bei denen KI die Komplexität übernimmt.

- Puppeteer/Selenium: Wenn Sie bereits in diesen Ökosystemen arbeiten oder spezielle Browser-/Sprachunterstützung benötigen.

Schritt-für-Schritt-Beispiel: Eine dynamische Website mit Playwright scrapen

Werfen wir einen praktischen Blick darauf. Angenommen, Sie möchten die ersten beiden Seiten der eBay-Suchergebnisse für „Laptop“ scrapen – Titel und Preise.

Python-Beispiel:

1from playwright.sync_api import sync_playwright

2with sync_playwright() as p:

3 browser = p.chromium.launch(headless=True)

4 page = browser.new_page()

5 search_term = "laptop"

6 page.goto(f"https://www.ebay.com/sch/i.html?_nkw=\{search_term\}")

7 page.wait_for_selector("h3.s-item__title")

8 results = []

9 for _ in range(2): # 2 Seiten scrapen

10 titles = page.locator("h3.s-item__title").all_text_contents()

11 prices = page.locator("span.s-item__price").all_text_contents()

12 for title, price in zip(titles, prices):

13 results.append({"title": title, "price": price})

14 next_button = page.locator("a[aria-label='Go to next search page']")

15 if next_button.count() > 0:

16 next_button.click()

17 page.wait_for_selector("h3.s-item__title")

18 else:

19 break

20 browser.close()

21 print(f"Insgesamt {len(results)} Einträge gefunden.")Wichtige Playwright-Funktionen in diesem Beispiel:

- Navigation zu einer dynamischen Seite

- Warten, bis Inhalte geladen sind

- Mehrere Elemente auf einmal extrahieren

- Pagination durch Klicken auf „Weiter“ verarbeiten

- Ergebnisse speichern und ausgeben

Anschließend können Sie results für die weitere Analyse nach CSV oder Excel exportieren.

Fazit & wichtigste Erkenntnisse

Playwright Web-Scraping ist eine Superkraft für alle, die Daten aus dem modernen Web benötigen. Es ermöglicht Ihnen, echte Browseraktionen zu automatisieren, dynamische Inhalte zu verarbeiten und präzise, aktuelle Informationen selbst aus den komplexesten Websites zu extrahieren. Für Business-Anwender bedeutet das bessere Leads, smartere Preisgestaltung und schnellere Insights.

Und wenn Sie sich das Leben noch einfacher machen wollen, bringen Tools wie KI-gestütztes, codefreies Scraping direkt in Ihren Browser – perfekt für Vertriebs-, Marketing- und E-Commerce-Teams, die Daten jetzt brauchen und nicht erst nächste Woche.

Bereit, Ihr Web-Scraping auf das nächste Level zu bringen? Testen Sie Playwright in Ihrem nächsten Projekt und kombinieren Sie es ruhig mit Thunderbit für schnelle Erfolge oder knifflige Seiten. Die Zukunft der Webdaten ist hybrid, flexibel und – darf ich sagen – sogar ein bisschen unterhaltsam.

FAQs

1. Was ist Playwright Web-Scraping?

Playwright Web-Scraping nutzt das Playwright-Framework von Microsoft, um echte Browser für die Extraktion von Daten aus dynamischen, JavaScript-lastigen Websites zu automatisieren. Es simuliert menschliche Aktionen (Klicken, Tippen, Scrollen), um Inhalte zugänglich zu machen, die klassische Scraper nicht erreichen.

2. Warum sollte ich Playwright statt eines traditionellen Scrapers verwenden?

Traditionelle Scraper laden oft nur das anfängliche HTML und verpassen Daten, die per JavaScript nachgeladen werden. Playwright steuert einen echten Browser, sodass Sie die vollständig gerenderte Seite erhalten – ideal für das Scraping moderner, interaktiver Websites.

3. Wie geht Playwright mit dynamischen Inhalten und API-Einschränkungen um?

Playwright bietet intelligente Wartefunktionen (wie wait_for_selector und wait_for_load_state), unterstützt Multi-Tab-Parallelität und kann mit Elementen genauso interagieren wie ein Nutzer. So lassen sich API-Rate-Limits umgehen und alle dynamischen Inhalte erfassen.

4. Wie kann ich Thunderbit mit Playwright kombinieren?

Thunderbit ist eine KI-gestützte Chrome-Erweiterung, die Scraping per Point-and-Click einfach macht. Nutzen Sie Thunderbit für schnelles, codefreies Datenscraping oder kombinieren Sie es mit Playwright-Skripten für komplexere Workflows – besonders dann, wenn Sie Daten direkt in Business-Tools exportieren möchten.

5. Was sollte ich nach dem Scrapen mit Playwright tun?

Bereinigen und validieren Sie Ihre Daten (Duplikate entfernen, Formate standardisieren), reichern Sie sie bei Bedarf an und exportieren Sie sie nach Excel, Google Sheets oder in Ihr CRM. Eine saubere Nachbearbeitung verwandelt Rohdaten in verwertbare Business-Insights.

Sie möchten mehr Tipps und Tutorials? Schauen Sie im vorbei oder , um heute smarter zu scrapen.

Mehr erfahren