Web Scraping ist heute längst kein Geheimtipp mehr, sondern gehört für alle, die im Vertrieb, Operations oder in der Marktforschung unterwegs sind, zum absoluten Pflichtprogramm. Die Menge an Webdaten explodiert förmlich – das weltweite Datenvolumen ist von 2019 bis 2023 um satte . Kein Wunder also, dass Daten mittlerweile als Herzstück ihrer Entscheidungen sehen. Die Kehrseite: kämpfen mit der Verarbeitung von unstrukturierten Daten wie wildem HTML. Ich habe schon viele Teams erlebt, die stundenlang Copy-Paste betreiben, um Webinfos in Tabellen zu bringen – das ist alles andere als smart.

Hier kommt BeautifulSoup ins Spiel. In diesem praxisnahen Tutorial zeige ich dir, wie du mit BeautifulSoup Webseiten scrapen kannst – inklusive eines konkreten Python-Beispiels, das du direkt für dein Business anpassen kannst. Und weil ich auf Effizienz stehe, zeige ich dir auch, wie du BeautifulSoup mit , unserem KI-Web-Scraper, kombinierst, um deinen Workflow zu beschleunigen und sauber strukturierte Daten zu bekommen – ganz egal, wie fit du beim Programmieren bist.

Was ist BeautifulSoup und warum eignet es sich für Web Scraping?

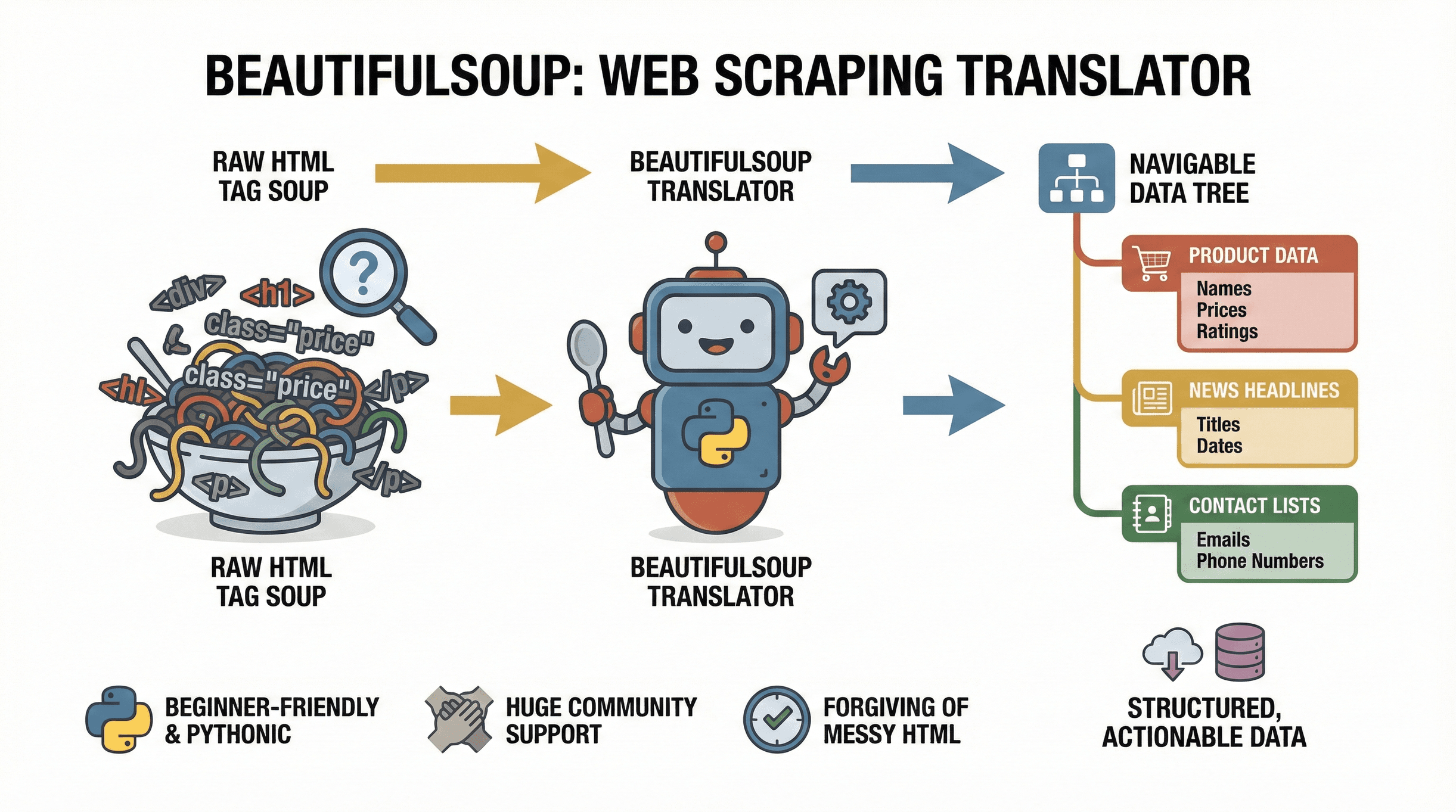

Fangen wir mit den Basics an. ist eine Python-Bibliothek, die das Parsen von HTML- und XML-Dokumenten super easy macht. Stell dir BeautifulSoup wie einen Dolmetscher vor: Es verwandelt das HTML-Chaos einer Webseite in eine übersichtliche Baumstruktur, sodass du gezielt Daten finden, extrahieren und weiterverarbeiten kannst. Egal ob du Produktpreise aus Online-Shops ziehst, News-Headlines sammelst oder Firmenverzeichnisse für Leads scrapen willst – BeautifulSoup ist das Tool, um Webseiten in strukturierte, nutzbare Daten zu verwandeln.

Fangen wir mit den Basics an. ist eine Python-Bibliothek, die das Parsen von HTML- und XML-Dokumenten super easy macht. Stell dir BeautifulSoup wie einen Dolmetscher vor: Es verwandelt das HTML-Chaos einer Webseite in eine übersichtliche Baumstruktur, sodass du gezielt Daten finden, extrahieren und weiterverarbeiten kannst. Egal ob du Produktpreise aus Online-Shops ziehst, News-Headlines sammelst oder Firmenverzeichnisse für Leads scrapen willst – BeautifulSoup ist das Tool, um Webseiten in strukturierte, nutzbare Daten zu verwandeln.

Warum ist BeautifulSoup so beliebt? Zum einen ist es extrem einsteigerfreundlich. BeautifulSoup verzeiht auch fehlerhaftes oder unvollständiges HTML (und davon gibt’s im Web mehr als genug) und dank der typischen Python-Syntax kannst du mit wenigen Zeilen Code loslegen. Die Bibliothek ist millionenfach im Einsatz und die Community ist riesig – bei Problemen findest du schnell Hilfe.

Typische Anwendungsfälle für BeautifulSoup:

- Produktnamen, Preise und Bewertungen aus Online-Shops extrahieren

- News-Headlines, Autoren und Veröffentlichungsdaten von News-Seiten sammeln

- Tabellen oder Verzeichnisse (z. B. Firmen- oder Kontaktlisten) auslesen

- E-Mails oder Telefonnummern von Portalen erfassen

- Preisänderungen, neue Jobangebote oder andere Updates überwachen

Wenn deine Daten in statischem HTML vorliegen, ist BeautifulSoup dein bester Buddy fürs Web Scraping.

Die besonderen Vorteile von BeautifulSoup beim Web Scraping

Es gibt viele Python-Bibliotheken fürs Web Scraping – warum also BeautifulSoup? Hier die wichtigsten Pluspunkte:

- Einfachheit: BeautifulSoup ist schlank und leicht zu lernen. Du brauchst kein großes Framework und keinen komplizierten Setup. Perfekt für schnelle, einmalige Scraping-Jobs oder für Einsteiger.

- Fehlertoleranz: Auch fehlerhaftes oder unvollständiges HTML wird problemlos verarbeitet – das ist im Web eher Standard als Ausnahme.

- Flexibilität: Du bist nicht an eine starre Crawling-Architektur gebunden. Einfach HTML reinwerfen und gezielt extrahieren, was du brauchst.

- Integration: BeautifulSoup spielt super mit anderen Python-Bibliotheken wie

requests(für das Laden von Webseiten),csv(zum Speichern von Daten) undpandas(für die Datenanalyse) zusammen.

Wie schlägt sich BeautifulSoup im Vergleich zu anderen Tools?

| Tool | Am besten geeignet für | Vorteile | Nachteile |

|---|---|---|---|

| BeautifulSoup | Statisches HTML, Einsteiger | Einfach, schneller Einstieg, fehlertolerant, flexibel | Nicht geeignet für JavaScript-lastige Seiten |

| Scrapy | Große, asynchrone Projekte | Leistungsstark, skalierbar, integriertes Crawling | Höhere Einstiegshürde, mehr Konfiguration |

| Selenium | JavaScript/dynamische Inhalte | Kann mit JS interagieren, Formulare ausfüllen, klicken | Langsamer, ressourcenintensiver |

Wenn du gerade erst loslegst oder schnell statische Seiten parsen willst, ist BeautifulSoup das „Schweizer Taschenmesser“ fürs Web Scraping (). Für komplexere oder dynamische Seiten kannst du BeautifulSoup mit Selenium oder Scrapy kombinieren – aber zum Einstieg ist BeautifulSoup einfach top.

Python-Umgebung für BeautifulSoup einrichten

Bereit für den Start? So richtest du deine Umgebung ein:

-

Python installieren: Hol dir die aktuelle Version von .

-

Virtuelle Umgebung einrichten (optional, aber empfehlenswert):

1python -m venv venv 2source venv/bin/activate # Unter Windows: venv\Scripts\activate -

BeautifulSoup und Abhängigkeiten installieren:

1pip install beautifulsoup4 requests lxml html5libbeautifulsoup4: Die Hauptbibliothekrequests: Zum Laden von Webseitenlxmloderhtml5lib: Schnelle und zuverlässige HTML-Parser

-

Fehlerbehebung:

- Bei „pip not found“-Fehlern probiere

pip3oderpy -m pip. - Auf Mac/Linux ggf.

sudoverwenden. - Unter Windows sicherstellen, dass Python im PATH ist.

- Bei „pip not found“-Fehlern probiere

Teste dein Setup mit folgendem Code:

1from bs4 import BeautifulSoup

2import requests

3html = requests.get("http://example.com").text

4soup = BeautifulSoup(html, "html.parser")

5print(soup.title)Wenn <title>Example Domain</title> ausgegeben wird, läuft alles ().

Schritt-für-Schritt: Python Beautiful Soup Beispiel

Schauen wir uns ein praktisches Beispiel an: Du willst die neuesten News-Headlines von einer öffentlichen News-Seite extrahieren. So gehst du vor:

1. Webseite abrufen

1import requests

2from bs4 import BeautifulSoup

3url = "https://www.bbc.com/news"

4response = requests.get(url)

5html = response.text2. HTML parsen

1soup = BeautifulSoup(html, "html.parser")3. HTML-Struktur untersuchen

Öffne die Entwicklertools deines Browsers (Rechtsklick → Untersuchen) und suche nach den Tags, die die Headlines enthalten. Auf vielen News-Seiten sind das <h3>-Tags mit bestimmten Klassen.

Beispiel:

1<h3 class="gs-c-promo-heading__title">Headline Title</h3>4. Daten extrahieren

1headlines = soup.find_all("h3", class_="gs-c-promo-heading__title")

2for h in headlines:

3 print(h.get_text(strip=True))Damit bekommst du alle Überschriften der Seite ausgegeben.

5. Daten als CSV speichern

Speichere die Headlines für spätere Analysen:

1import csv

2with open("headlines.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.writer(file)

4 writer.writerow(["headline"])

5 for h in headlines:

6 writer.writerow([h.get_text(strip=True)])Jetzt hast du eine CSV-Datei, die du easy in Excel oder Google Sheets weiterverarbeiten kannst.

HTML-Struktur verstehen: So extrahierst du gezielt Daten

Bevor du mit dem Coden loslegst, solltest du immer die HTML-Struktur der Seite checken. So geht’s:

- Entwicklertools öffnen: Rechtsklick auf die Seite und „Untersuchen“ wählen.

- Daten finden: Mit der Maus über die Elemente fahren, um die relevanten Tags zu identifizieren (z. B. Headlines, Preise, Autoren).

- Tags und Klassen notieren: Achte auf eindeutige Merkmale wie

class="product-title"oderid="main-content". - Selektoren testen: Nutze die Methoden

.find(),.find_all()oder.select()von BeautifulSoup, um die gewünschten Elemente gezielt anzusprechen.

Tipp: Mit soup.prettify() kannst du dir das HTML schön formatiert in der Konsole anzeigen lassen.

Daten mit BeautifulSoup extrahieren und strukturieren

Angenommen, du willst Titel und Autoren von Blog-Artikeln extrahieren:

1articles = soup.find_all("article")

2data = []

3for article in articles:

4 title = article.find("h2").get_text(strip=True)

5 author = article.find("span", class_="author").get_text(strip=True)

6 data.append({"title": title, "author": author})Jetzt hast du eine Liste von Dictionaries – perfekt für den Export als CSV oder zur weiteren Analyse.

Links, Bilder oder andere Attribute extrahierst du so:

1for link in soup.find_all("a"):

2 print(link.get("href"))Oder Bilder:

1for img in soup.find_all("img"):

2 print(img.get("src"))Extrahierte Daten speichern: Von Python zu Excel oder CSV

Sobald deine Daten strukturiert sind, ist der Export ein Kinderspiel. So geht’s mit dem csv-Modul:

1import csv

2with open("articles.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.DictWriter(file, fieldnames=["title", "author"])

4 writer.writeheader()

5 for row in data:

6 writer.writerow(row)Oder, wenn du lieber mit pandas arbeitest:

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv("articles.csv", index=False)

4df.to_excel("articles.xlsx", index=False)Verwende immer UTF-8-Kodierung, damit Sonderzeichen kein Problem machen – gerade bei internationalen Daten.

Praxisbeispiel: News-Webseite mit BeautifulSoup scrapen

Hier ein konkretes Beispiel: Du willst von Artikeltitel, Autoren und Veröffentlichungsdaten extrahieren:

1import requests

2from bs4 import BeautifulSoup

3import csv

4url = "https://edition.cnn.com/world"

5response = requests.get(url)

6soup = BeautifulSoup(response.content, "html.parser")

7articles = soup.find_all("article")

8data = []

9for article in articles:

10 title_tag = article.find("h3")

11 date_tag = article.find("span", class_="date")

12 author_tag = article.find("span", class_="author")

13 title = title_tag.get_text(strip=True) if title_tag else ""

14 date = date_tag.get_text(strip=True) if date_tag else ""

15 author = author_tag.get_text(strip=True) if author_tag else ""

16 data.append({"title": title, "date": date, "author": author})

17with open("cnn_articles.csv", "w", newline='', encoding="utf-8") as file:

18 writer = csv.DictWriter(file, fieldnames=["title", "date", "author"])

19 writer.writeheader()

20 for row in data:

21 writer.writerow(row)Dieses Skript holt die neuesten Artikel, extrahiert Titel, Datum und Autor und speichert alles als CSV. Die Daten kannst du für Wettbewerbsanalysen, Trendbeobachtung oder Content-Recherche nutzen – je nachdem, was du brauchst.

Workflow optimieren: BeautifulSoup und Thunderbit kombinieren

Wie kannst du deinen Scraping-Workflow noch effizienter machen? ist eine KI-basierte Web-Scraper Chrome-Erweiterung, die dir das Extrahieren von Daten extrem erleichtert. Mit Thunderbit kannst du:

- „KI-Felder vorschlagen“ nutzen: Thunderbit analysiert die Seite und schlägt dir automatisch relevante Datenfelder vor – kein mühsames Suchen im HTML oder Anpassen von Selektoren mehr.

- Unterseiten scrapen: Thunderbit folgt Links zu Unterseiten (z. B. Produkt- oder Artikelseiten) und reichert deinen Datensatz mit weiteren Details an.

- Sofort exportieren: Mit nur einem Klick exportierst du deine Daten direkt nach Excel, Google Sheets, Airtable oder Notion.

- Paginierung meistern: Thunderbit kann Daten über mehrere Seiten hinweg (inklusive Infinite Scroll) extrahieren.

- Scrapes planen: Richte wiederkehrende Jobs ein, damit deine Daten immer aktuell bleiben.

So sieht mein Lieblings-Workflow aus:

- Mit Thunderbit starten: Zielseite öffnen, Thunderbit-Icon anklicken und mit „KI-Felder vorschlagen“ die passenden Spalten (z. B. Titel, Autor, Datum) automatisch erkennen lassen.

- Daten exportieren: Ergebnisse als CSV herunterladen oder direkt nach Google Sheets schicken.

- BeautifulSoup für individuelle Verarbeitung: Wenn du tiefergehende Analysen (z. B. Textbereinigung, Dubletten entfernen oder Datenquellen kombinieren) brauchst, lade die exportierte CSV in Python und nutze BeautifulSoup oder pandas für die Nachbearbeitung.

So kombinierst du die Geschwindigkeit und KI-Felderkennung von Thunderbit mit der Flexibilität von BeautifulSoup für individuelle Logik.

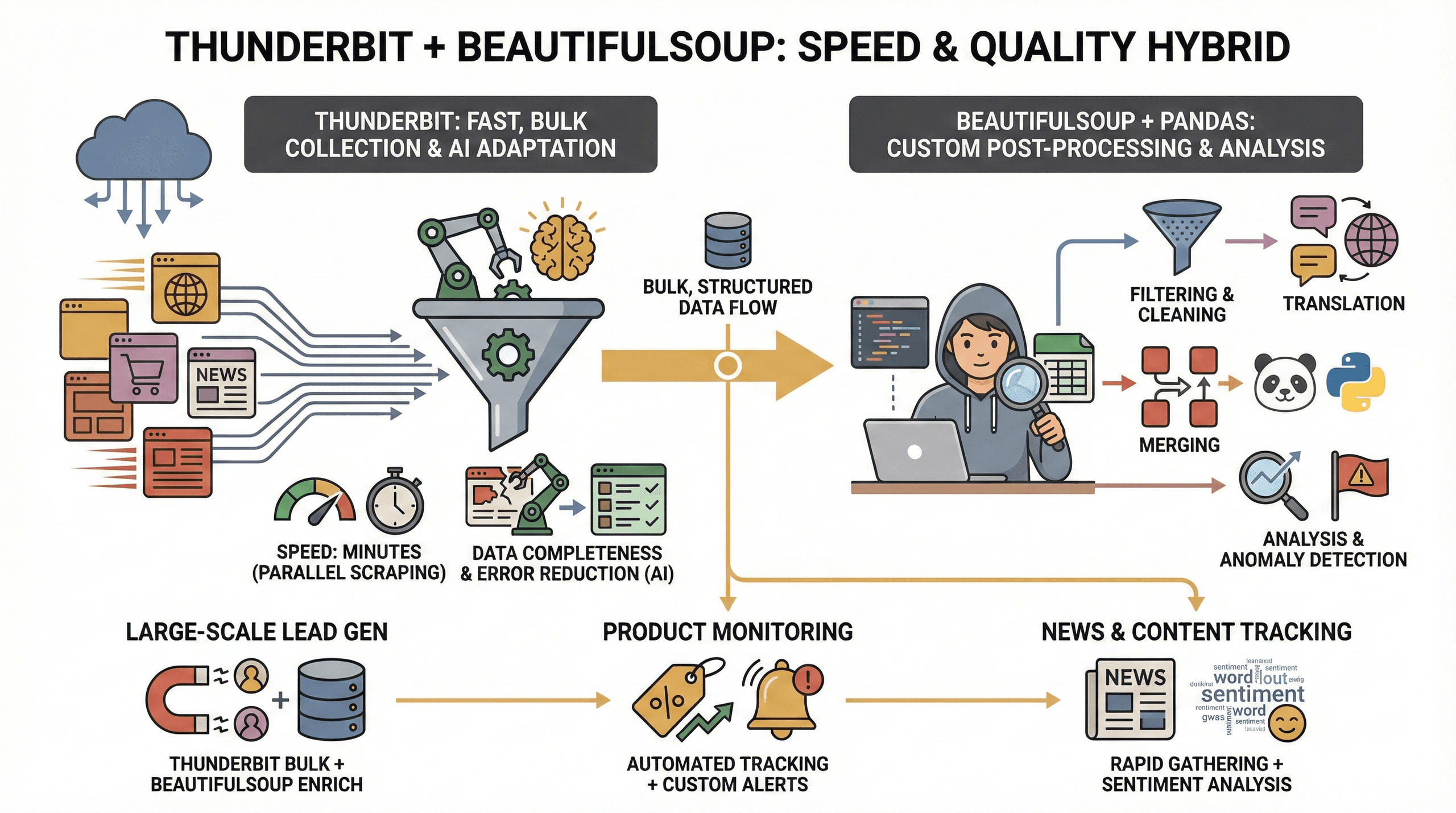

Geschwindigkeit & Datenqualität: Warum Thunderbit und BeautifulSoup gemeinsam nutzen?

Warum beide Tools kombinieren? Das sind meine Erfahrungen:

Warum beide Tools kombinieren? Das sind meine Erfahrungen:

- Geschwindigkeit: Thunderbit kann dutzende Seiten parallel scrapen (bis zu 50 gleichzeitig im Cloud-Modus) – so hast du deine Daten in Minuten statt Stunden.

- Datenvollständigkeit: Thunderbits KI passt sich Layout-Änderungen an und extrahiert auch aus komplexen Seiten strukturierte Daten – so gehen weniger Felder verloren.

- Fehlerreduktion: Keine kaputten Skripte mehr, wenn sich Klassennamen ändern – Thunderbits KI analysiert die Seite bei jedem Durchlauf neu.

- Individuelle Nachbearbeitung: Für spezielle Anforderungen (z. B. Filtern, Übersetzen, Datensätze zusammenführen) bieten dir BeautifulSoup und pandas volle Kontrolle.

Gerade für folgende Szenarien ist dieser Hybrid-Ansatz ideal:

- Lead-Generierung im großen Stil: Mit Thunderbit die Massendaten holen, mit BeautifulSoup gezielt bereinigen und anreichern.

- Produktmonitoring: Thunderbit übernimmt das repetitive Scraping, BeautifulSoup analysiert Trends oder erkennt Auffälligkeiten.

- News- und Content-Tracking: Artikel schnell mit Thunderbit sammeln, dann mit Python z. B. Sentiment-Analysen oder Keyword-Extraktion durchführen.

Häufige Probleme beim Web Scraping mit BeautifulSoup und wie du sie löst

Web Scraping läuft nicht immer reibungslos – hier die häufigsten Stolpersteine und wie du sie umgehst:

- Dynamische Inhalte: Wenn eine Seite Daten per JavaScript nachlädt (Infinite Scroll, AJAX), sieht BeautifulSoup diese nicht. Nutze in solchen Fällen Selenium oder den Browser-Modus von Thunderbit.

- Anti-Bot-Maßnahmen: Manche Seiten blockieren automatisierte Anfragen. Setze einen eigenen User-Agent, baue Pausen zwischen Requests ein oder nutze Thunderbits Cloud-Scraping, um einfache Sperren zu umgehen.

- HTML-Änderungen: Wenn dein Skript plötzlich nicht mehr funktioniert, hat sich vermutlich das HTML geändert. Untersuche die Seite erneut und passe deine Selektoren an. Thunderbits KI kann hier helfen, da sie sich automatisch anpasst.

- Fehlende Daten: Prüfe immer, ob Elemente existieren, bevor du

.get_text()aufrufst. Für Attribute nutze.get()statt[], um KeyErrors zu vermeiden. - Zeichenkodierung: Speichere Dateien immer mit UTF-8, um Probleme mit Sonderzeichen zu vermeiden.

Und ganz wichtig: Respektiere immer die robots.txt und die Nutzungsbedingungen der Seite. Scrape verantwortungsvoll – niemand mag rücksichtslose Bots.

Fazit & wichtigste Erkenntnisse

Web Scraping mit BeautifulSoup ist eine der nützlichsten Skills in der heutigen datengetriebenen Welt. Das hast du in diesem BeautifulSoup Web Scraping Tutorial gelernt:

- BeautifulSoup ist der perfekte Einstieg, um statisches HTML zu parsen und strukturierte Daten mit Python zu extrahieren.

- Das Setup ist schnell erledigt – Python, pip und ein paar Bibliotheken reichen völlig.

- HTML-Inspektion ist entscheidend, um gezielt die richtigen Daten zu erfassen.

- Export nach CSV/Excel macht deine Daten sofort für Analysen nutzbar.

- Die Kombination mit Thunderbit bringt dir KI-gestützte Felderkennung, schnelleres Scraping und einfache Exporte – ideal für Business-Anwender und Nicht-Programmierer.

- Hybride Workflows (Thunderbit für die Massendaten, BeautifulSoup für individuelle Nachbearbeitung) bieten maximale Geschwindigkeit, Datenqualität und Flexibilität.

Wenn du dein Web Scraping aufs nächste Level bringen willst, probiere beide Tools aus: Starte mit einem einfachen BeautifulSoup-Skript und erlebe, wie viel schneller du mit dem arbeiten kannst. Weitere praxisnahe Anleitungen findest du im .

Viel Erfolg beim Scrapen – und möge deine Daten immer sauber, strukturiert und einsatzbereit sein.

Häufig gestellte Fragen (FAQ)

1. Was ist BeautifulSoup und wofür wird es verwendet?

BeautifulSoup ist eine Python-Bibliothek zum Parsen von HTML- und XML-Dokumenten. Sie hilft dir, Daten aus Webseiten zu extrahieren und in strukturierte Formate wie Listen oder Tabellen umzuwandeln – ideal für Web Scraping-Projekte.

2. Wie unterscheidet sich BeautifulSoup von Selenium und Scrapy?

BeautifulSoup ist leichtgewichtig und ideal für statische HTML-Seiten. Selenium eignet sich besser für dynamische, JavaScript-lastige Seiten, während Scrapy ein umfassendes Framework für große, asynchrone Scraping-Projekte ist. Für Einsteiger und schnelle Aufgaben ist BeautifulSoup die beste Wahl.

3. Kann ich BeautifulSoup und Thunderbit gemeinsam nutzen?

Absolut. Thunderbit erkennt und extrahiert Felder auf Webseiten mithilfe von KI, und du kannst BeautifulSoup für individuelle Nachbearbeitung oder tiefere Analysen der exportierten Daten einsetzen.

4. Welche Herausforderungen gibt es beim Web Scraping mit BeautifulSoup?

Typische Probleme sind der Umgang mit dynamischen Inhalten, Anti-Bot-Maßnahmen und Änderungen in der HTML-Struktur. Mit den KI-Funktionen oder dem Browser-Modus von Thunderbit lassen sich viele dieser Hürden meistern.

5. Wie exportiere ich mit BeautifulSoup gescrapte Daten nach Excel oder CSV?

Du kannst das eingebaute csv-Modul von Python oder die Bibliothek pandas nutzen, um extrahierte Daten als CSV- oder Excel-Dateien zu speichern. Verwende immer UTF-8-Kodierung, um Sonderzeichen korrekt zu verarbeiten und Kompatibilität mit Tabellenprogrammen sicherzustellen.

Bereit, es selbst auszuprobieren? Lade dir die herunter und starte noch heute mit smarterem Scraping. Weitere Tipps und Tutorials findest du im .

Mehr erfahren