Webdaten zu extrahieren ist heute kein nettes Extra mehr, sondern ein echter Gamechanger im Wettbewerb. Egal ob du im Vertrieb, Operations, in der Forschung oder im E-Commerce unterwegs bist – es war noch nie so wichtig, unstrukturierte und sich ständig ändernde Webinhalte in brauchbare, strukturierte Daten zu verwandeln. Aber das Web entwickelt sich rasant weiter: Überall JavaScript-geladene „Mini-Apps“, endloses Scrollen und immer ausgefeiltere Anti-Bot-Technologien. Klassische Scraping-Tools kommen da schnell an ihre Grenzen. Ich habe schon Teams gesehen, die stundenlang mit fehlerhaften Skripten oder leeren Tabellen kämpfen, weil die alten Copy-Paste- oder HTTP-Request-Methoden bei modernen, dynamischen Seiten einfach nicht mehr ausreichen.

Genau hier setzt Playwright Scraping an. Dieses moderne Browser-Automatisierungs-Toolkit verändert grundlegend, wie selbst die komplexesten Webseiten zuverlässig und effizient ausgelesen werden können. Kombinierst du das mit den KI-gestützten Datenstrukturierungs- und Exportfunktionen von , bekommst du einen Workflow, der nicht nur leistungsstark, sondern auch richtig angenehm zu bedienen ist (ja, das meine ich wirklich so). In diesem Guide zeige ich dir, wie du Playwright Scraping meisterst, typische Stolperfallen umgehst und deinem Team einen echten Produktivitätsschub verschaffst.

Was ist Playwright Scraping? Die Basics auf den Punkt gebracht

Im Kern bedeutet Playwright Scraping, dass du mit Playwright – einem von Microsoft entwickelten Browser-Automatisierungs-Framework – echte Webbrowser wie Chrome, Firefox oder Safari per Code steuerst. Im Gegensatz zum reinen Abrufen von HTML (wo oft Inhalte fehlen, die erst durch JavaScript geladen werden), startet Playwright einen echten Browser, interagiert wie ein Mensch mit der Seite (klickt, scrollt, füllt Formulare aus) und extrahiert Daten aus der komplett gerenderten Website ().

Warum ist das so wichtig? Die meisten modernen Webseiten sind dynamisch. Sie laden Inhalte erst nach dem ersten Seitenaufruf, verlangen Interaktionen oder verstecken Daten hinter Logins. Klassische HTTP-basierte Scraper (wie BeautifulSoup oder Requests in Python) sehen nur das, was im ersten HTML steckt – alles, was später per JavaScript nachgeladen wird, bleibt unsichtbar. Playwright dagegen sieht genau das, was auch ein echter Nutzer sieht. Was du im Browser siehst, kann Playwright ebenfalls auslesen.

Wann solltest du Playwright Scraping einsetzen? Immer dann, wenn du mit diesen Herausforderungen zu tun hast:

- Dynamische Inhalte, die per JavaScript oder AJAX geladen werden

- Seiten mit Login oder mehrstufiger Navigation

- Interaktive Elemente (endloses Scrollen, „Mehr laden“-Buttons, Pop-ups)

- Seiten, bei denen klassische Scraper versagen oder leere Daten liefern

Wenn du schon mal nach dem Scraping eine leere Tabelle hattest, ist Playwright wahrscheinlich genau das Tool, das du brauchst.

Warum Playwright Scraping für moderne Datenerfassung unverzichtbar ist

Playwright ist nicht einfach nur ein weiteres Automatisierungstool – es bringt einige technische Vorteile mit, die es einzigartig machen:

Playwright ist nicht einfach nur ein weiteres Automatisierungstool – es bringt einige technische Vorteile mit, die es einzigartig machen:

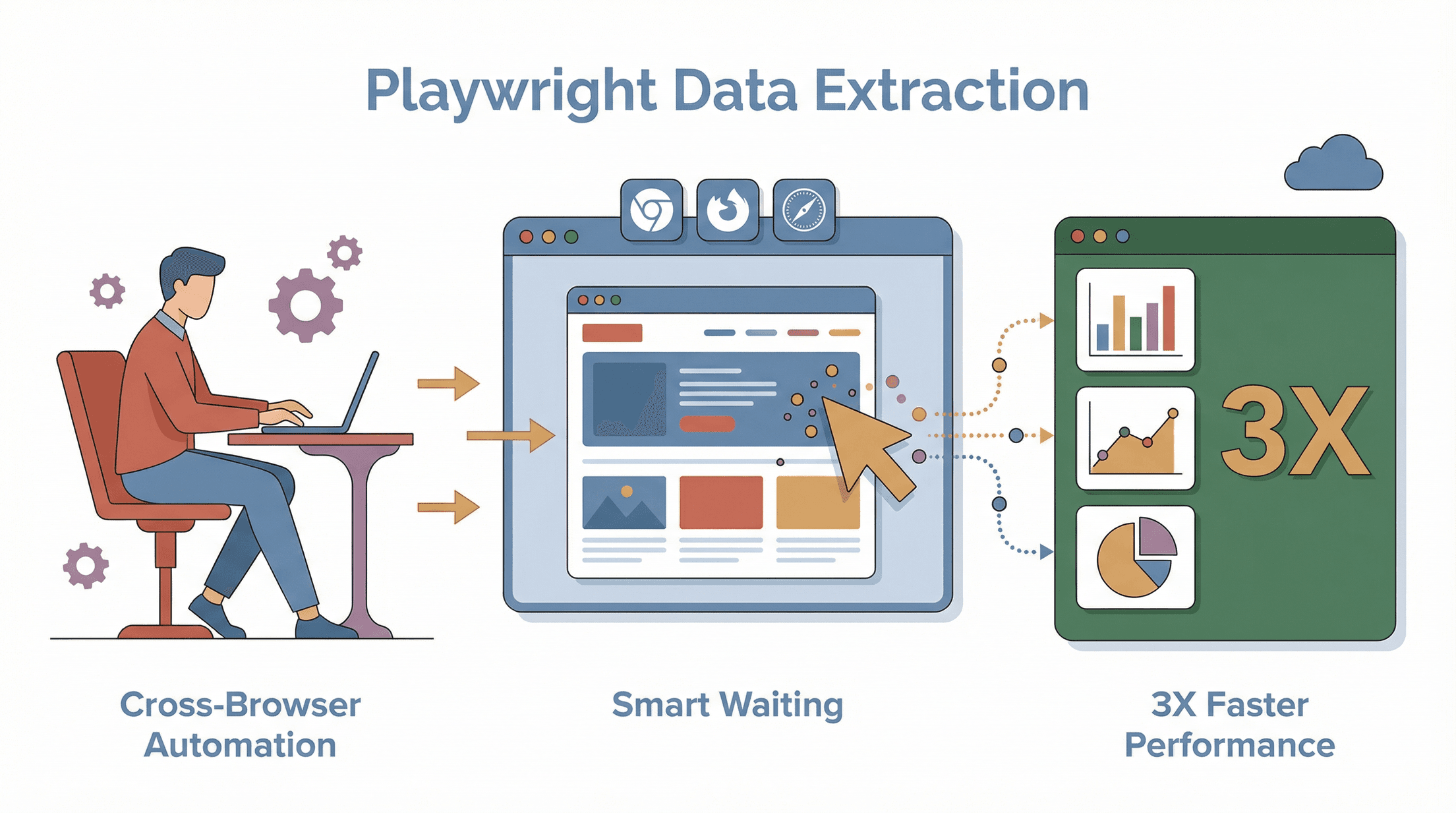

1. Browserübergreifende Automatisierung

Playwright unterstützt Chromium (Chrome/Edge), Firefox und WebKit (Safari) direkt „out of the box“ (). Du kannst also ein Skript schreiben und es in allen wichtigen Browsern laufen lassen – ein echter Vorteil, wenn sich Seiten je nach Browser unterschiedlich verhalten.

2. Simulation menschlichen Verhaltens

Playwright kann echte Nutzeraktionen nachahmen – klicken, scrollen, mit der Maus über Elemente fahren, Formulare ausfüllen, sogar Dateien hochladen. Das ist entscheidend, um Inhalte hinter Interaktionen zu erreichen oder einfache Bot-Schutzmechanismen zu umgehen. Für Debugging oder um noch menschlicher zu wirken, kannst du sogar im „headful“-Modus (sichtbares Browserfenster) arbeiten.

3. Headless- und Headful-Modus

Du kannst mit einem einzigen Parameter zwischen headless (ohne UI, schneller, unauffälliger) und headful (mit UI, ideal zum Debuggen oder Umgehen von Bot-Erkennung) wechseln. Manche Seiten blockieren headless-Browser – der Moduswechsel ist daher ein echter Pluspunkt.

4. Intelligentes Warten und Timing

Dynamische Seiten laden Inhalte oft asynchron. Dank automatischem Warten von Playwright pausiert dein Skript, bis die Daten wirklich da sind – kein Rätselraten mehr, wie viele Sekunden du „schlafen“ musst. Das sorgt für zuverlässigere und genauere Ergebnisse ().

5. Parallelität und Performance

Playwright kann mehrere Browser-Tabs oder Sessions parallel steuern. So kannst du große Datenmengen effizient und ohne Engpässe extrahieren – ein klarer Fortschritt gegenüber Tools, die nur eine Seite nach der anderen abarbeiten.

6. Anti-Bot- und Stealth-Funktionen

Da Playwright echte Browser steuert, kannst du User Agents fälschen, Proxys rotieren und sogar mobile Geräte emulieren. Mit der richtigen Konfiguration umgehst du viele Blockaden, an denen klassische Scraper scheitern ().

Kurz gesagt: Playwright Scraping gibt dir die Flexibilität, Power und Zuverlässigkeit, die du für die Datenerfassung auf modernen Webseiten brauchst – egal wie komplex sie sind.

So richtest du deine Playwright Scraping-Umgebung ein

Der Einstieg in Playwright ist leichter als du denkst – auch wenn du noch nie mit Browserautomatisierung gearbeitet hast. So gehst du Schritt für Schritt vor:

Node.js und Playwright installieren

Zuerst brauchst du Node.js (alternativ geht auch Python, aber Node.js ist für Playwright am gängigsten). Lade Node.js von herunter, installiere es und öffne dein Terminal.

Dann legst du dein Projektverzeichnis an:

1mkdir my-playwright-scraper

2cd my-playwright-scraper

3npm init -y

4npm install playwright

5npx playwright installnpm install playwrightinstalliert die Playwright-Bibliothek.npx playwright installlädt die Browser-Engines (Chromium, Firefox, WebKit) herunter.

Teste deine Installation mit einem einfachen Skript:

1const { chromium } = require('playwright');

2(async () => {

3 const browser = await chromium.launch();

4 const page = await browser.newPage();

5 await page.goto('https://example.com');

6 console.log(await page.title()); // Sollte "Example Domain" ausgeben

7 await browser.close();

8})();Wenn der Titel wie erwartet erscheint, bist du startklar ().

Abhängigkeiten und Projektstruktur verwalten

Best Practice: Halte deinen Code übersichtlich. Für kleine Projekte reicht eine Datei, bei größeren empfiehlt sich ein src/-Ordner mit separaten Modulen für Scraping-Logik, Datenverarbeitung und Konfiguration. Zugangsdaten oder Einstellungen gehören in eine .env-Datei (niemals Passwörter direkt im Code speichern).

Dein erstes Playwright Scraping-Skript schreiben und ausführen

Beispiel: Produktnamen und Preise von einer E-Commerce-Seite extrahieren:

1const { chromium } = require('playwright');

2(async () => {

3 const browser = await chromium.launch();

4 const page = await browser.newPage();

5 await page.goto('https://example-ecommerce.com/laptops');

6 await page.waitForSelector('.product-card');

7 const names = await page.$$eval('.product-card .name', els => els.map(el => el.textContent.trim()));

8 const prices = await page.$$eval('.product-card .price', els => els.map(el => el.textContent.trim()));

9 names.forEach((name, i) => {

10 console.log(`$\{name\} - ${prices[i]}`);

11 });

12 await browser.close();

13})();Das Skript wartet, bis die Produktkarten geladen sind, und liest dann alle Namen und Preise aus. Passe die Selektoren an deine Zielseite an.

Tipp bei Problemen: Wenn Fehler zu fehlenden Selektoren oder leeren Daten auftreten, prüfe die Seitenstruktur mit den Chrome DevTools und passe deine Selektoren an.

Playwright Scraping in der Praxis: Techniken und Best Practices

Jetzt wird’s praktisch – so holst du das Maximum aus Playwright heraus.

Daten gezielt finden und extrahieren

- CSS-Selektoren: Mit

page.locator('selector')oderpage.$('selector')Elemente ansprechen. - Text extrahieren:

await page.locator('.product-name').allTextContents()liefert ein Array aller Produktnamen. - Attribute auslesen: Für Bilder oder Links

.getAttribute('src')oder.getAttribute('href')nutzen. - Verschachtelte Selektoren: Mit

item.locator('.price')gezielt Unterelemente ansprechen.

Dynamische Inhalte und Paginierung meistern

- Auf Inhalte warten: Mit

await page.waitForSelector('.item')pausieren, bis die Elemente geladen sind. - Endloses Scrollen: Per

await page.evaluate(() => window.scrollBy(0, window.innerHeight));scrollen und auf neue Inhalte warten. - Paginierung: Über „Weiter“-Buttons durch Seiten blättern und jeweils auf das Laden warten. Beispiel:

1let pageNumber = 1;

2while (true) {

3 await page.waitForSelector('.result-item');

4 // Daten extrahieren ...

5 const nextButton = await page.$('button.next');

6 if (!nextButton) break;

7 await nextButton.click();

8 await page.waitForNavigation();

9 pageNumber++;

10}Proxys nutzen und Blockaden vermeiden

- Proxy setzen: Beim Starten des Browsers:

1const browser = await chromium.launch({

2 proxy: { server: 'http://YOUR_PROXY:PORT', username: 'USER', password: 'PASS' }

3});()

- User Agents rotieren: Für jede Session den User Agent wechseln.

- Zufällige Pausen: Wartezeiten zwischen Aktionen einbauen, um menschliches Verhalten zu simulieren.

- Headful-Modus: Manche Seiten blockieren headless-Browser – dann mit sichtbarem Fenster (

headless: false) arbeiten. - Stealth-Plugins: Mit Tools wie playwright-stealth Automatisierungsspuren verschleiern.

Playwright Scraping und Thunderbit kombinieren: Neue Möglichkeiten für die Datenerfassung

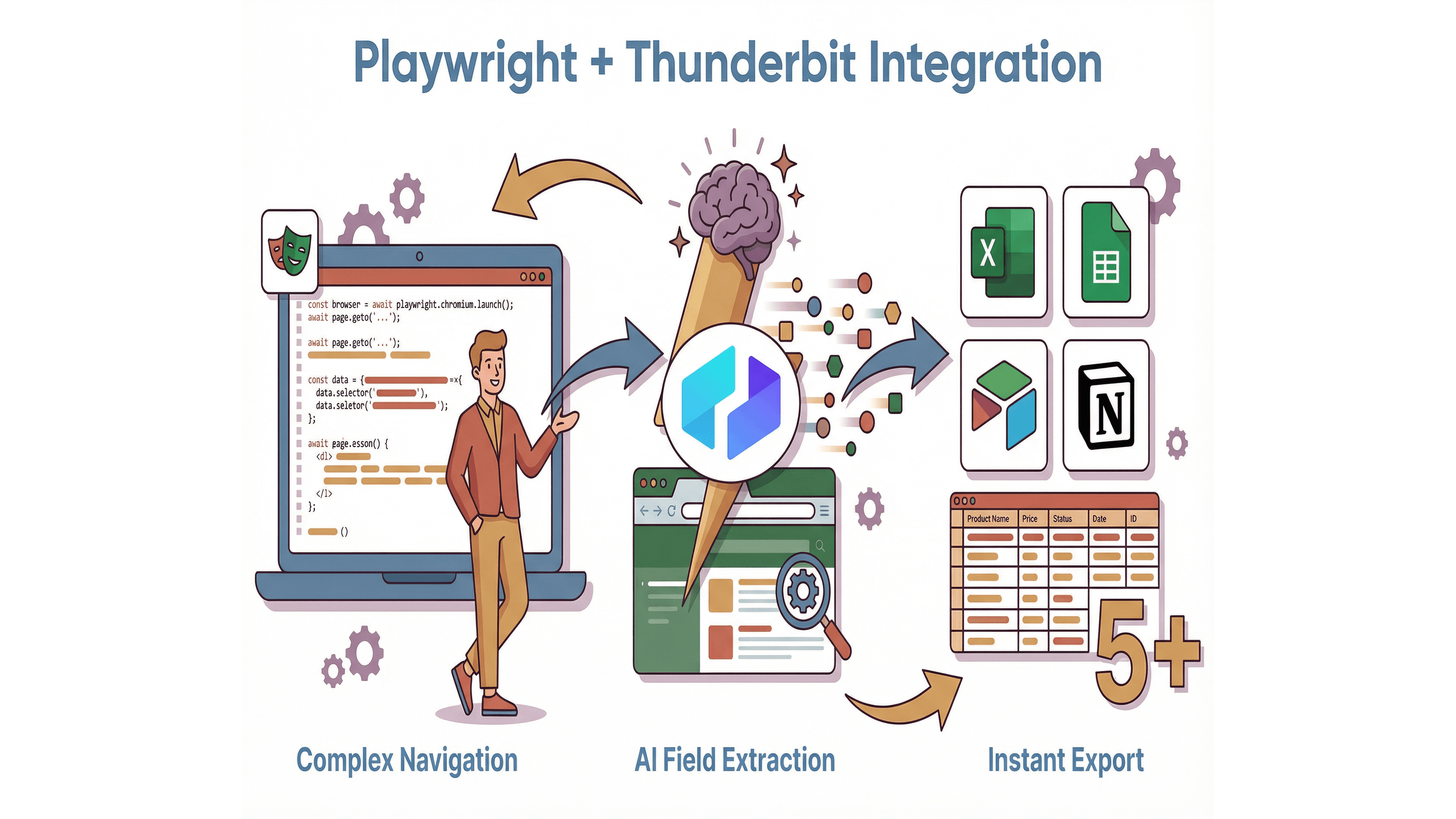

Jetzt wird’s spannend: Playwright ist ideal, um komplexe Seiten zu navigieren und zu bedienen – aber wie strukturierst und exportierst du die Daten, vor allem wenn sie an Kolleg:innen ohne Programmierkenntnisse weitergegeben werden sollen? Hier kommt ins Spiel.

Jetzt wird’s spannend: Playwright ist ideal, um komplexe Seiten zu navigieren und zu bedienen – aber wie strukturierst und exportierst du die Daten, vor allem wenn sie an Kolleg:innen ohne Programmierkenntnisse weitergegeben werden sollen? Hier kommt ins Spiel.

Thunderbits KI-Feldvorschläge mit Playwright nutzen

Mit Thunderbits KI Suggest Fields kannst du auf Knopfdruck erkennen, welche Datenfelder auf einer Seite extrahiert werden sollten. Statt mühsam HTML zu inspizieren und Feldnamen zu raten, öffnest du einfach die , klickst auf „KI-Felder vorschlagen“ und erhältst automatisch passende Spalten und Datentypen ().

Was bringt das Playwright-Nutzern?

- Schneller Start: Mit Thunderbits KI kannst du das Feldmapping vorab testen, bevor du Playwright-Code schreibst.

- Zuverlässige Extraktion: Übernimm die vorgeschlagenen Selektoren oder Feldnamen direkt in dein Playwright-Skript.

- Empowerment für Nicht-Entwickler: Geschäftsanwender:innen können mit Thunderbit schnell und ohne Code Daten extrahieren, während Entwickler:innen komplexere Aufgaben mit Playwright lösen.

Daten in Echtzeit formatieren und exportieren

Thunderbit extrahiert nicht nur Daten, sondern wandelt sie direkt in strukturierte Tabellen um und ermöglicht den Export nach Excel, Google Sheets, Airtable oder Notion (). Kein Ärger mehr mit CSV-Dateien oder eigenen Exportskripten.

Workflow-Tipp: Nutze Playwright für komplexe Navigation (z. B. Logins, mehrstufige Formulare) und übergib die gerenderte Seite dann an Thunderbit für KI-gestützte Felderkennung und Sofort-Export. Oder erweitere mit Thunderbits Subpage-Scraping deine Daten um Details von verlinkten Unterseiten – ganz ohne zusätzlichen Code.

Typische Herausforderungen beim Playwright Scraping meistern

Auch mit Playwright gibt es Stolpersteine. So löst du die häufigsten Probleme:

Auch mit Playwright gibt es Stolpersteine. So löst du die häufigsten Probleme:

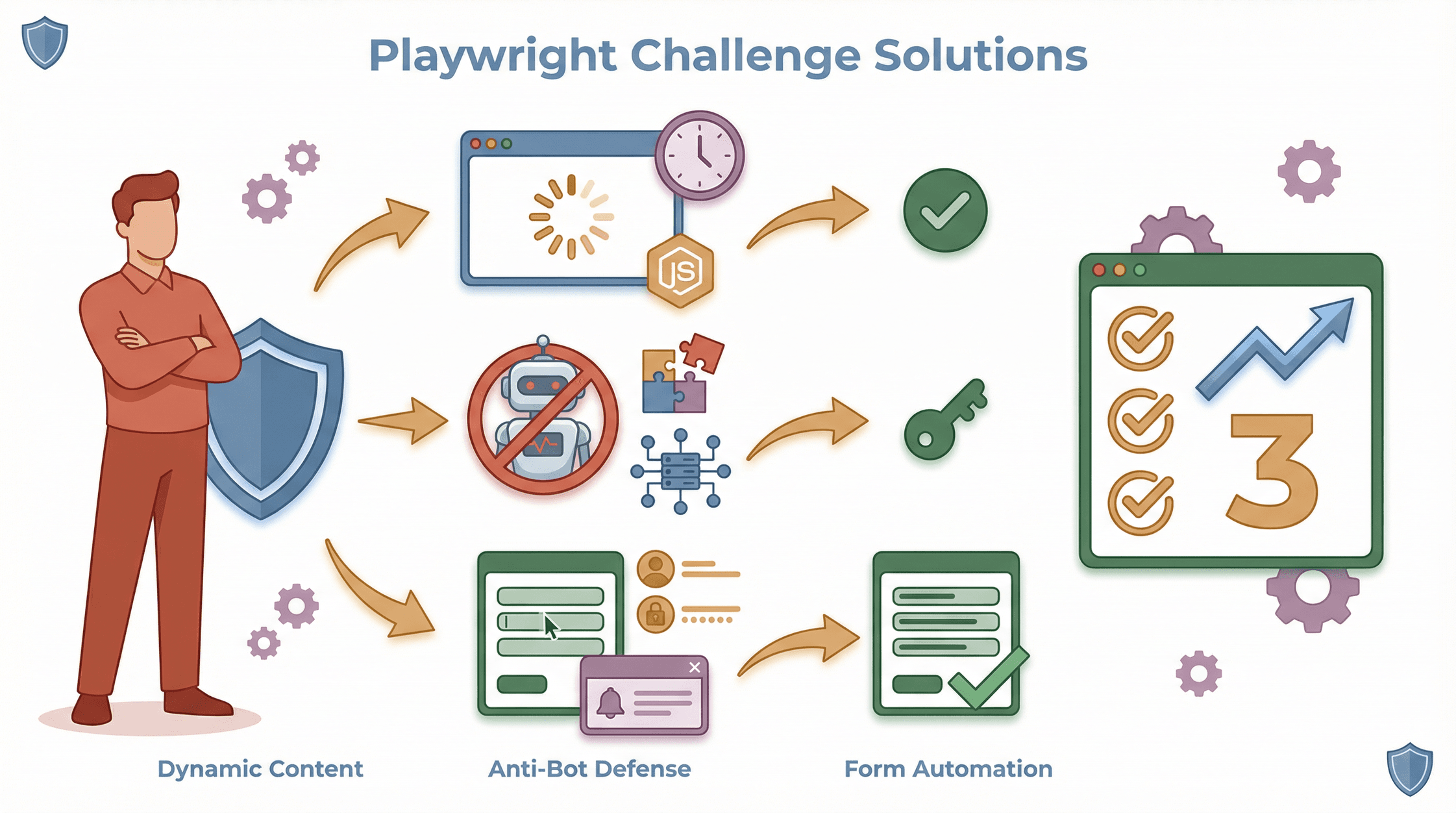

Dynamische Inhalte und JavaScript-Rendering

- Auf das richtige Element warten: Immer mit

waitForSelectorauf den Datencontainer warten, nicht nur auf das Laden der Seite. - Endloses Scrollen: Scroll-Aktionen in einer Schleife ausführen und prüfen, ob neue Elemente erscheinen.

- Debugging im Headful-Modus: Beobachte im sichtbaren Browser, was fehlt oder zu spät geladen wird.

Anti-Bot-Maßnahmen umgehen

- Proxys und User Agents rotieren: Sorge dafür, dass dein Scraper nicht wie ein Bot wirkt.

- Aktionen variieren: Scraping-Muster und Timing zufällig gestalten.

- CAPTCHAs handhaben: Bei CAPTCHAs pausieren, Proxy wechseln oder (ethisch vertretbar) einen Captcha-Service einbinden.

Komplexe Formulare und Interaktionen

- Formulare automatisiert ausfüllen: Mit

page.fill()undpage.click()auch mehrstufige Formulare bedienen. - Logins skripten: Login-Prozesse automatisieren und Cookies für spätere Sessions speichern.

- Pop-ups und neue Tabs: Mit Playwrights Kontext- und Page-Events mehrere Fenster steuern.

Praxisbeispiele: 5 Playwright Scraping Use Cases mit Mehrwert

Hier wird’s konkret: Fünf Anwendungsfälle, bei denen Playwright Scraping echten Business-Nutzen bringt – inklusive Code-Snippets für den Einstieg.

1. E-Commerce-Preisüberwachung

Szenario: Preise und Verfügbarkeiten von Wettbewerbern verfolgen.

1await page.goto('https://example-ecommerce.com/laptops');

2await page.waitForSelector('.product-card');

3const products = await page.$$eval('.product-card', cards =>

4 cards.map(card => ({

5 name: card.querySelector('.name').textContent.trim(),

6 price: card.querySelector('.price').textContent.trim()

7 }))

8);

9console.log(products);()

2. Marktforschung & Trendanalyse

Szenario: Nachrichtenüberschriften oder Forenbeiträge aggregieren.

1await page.goto('https://tech-news.com/latest');

2await page.waitForSelector('.headline');

3const headlines = await page.$$eval('.headline', els => els.map(el => el.textContent.trim()));

4console.log(headlines);3. Immobilienanzeigen extrahieren

Szenario: Immobiliendetails von Portalen auslesen.

1from playwright.sync_api import sync_playwright

2with sync_playwright() as p:

3 browser = p.chromium.launch()

4 page = browser.new_page()

5 page.goto("https://realestate.com/city")

6 page.wait_for_selector(".listing")

7 listings = page.query_selector_all(".listing")

8 for listing in listings:

9 price = listing.query_selector(".price").inner_text()

10 beds = listing.query_selector(".beds").inner_text()

11 print(price, beds)

12 browser.close()()

4. Lead-Generierung im Vertrieb

Szenario: Kontaktdaten aus Branchenverzeichnissen extrahieren.

1await page.goto('https://yellowpages.com/search?query=plumbers');

2await page.waitForSelector('.result');

3const leads = await page.$$eval('.result', results =>

4 results.map(res => ({

5 name: res.querySelector('.business-name').textContent.trim(),

6 phone: res.querySelector('.phones').textContent.trim()

7 }))

8);

9console.log(leads);()

5. Wettbewerbsanalyse von Produkten

Szenario: Produktspezifikationen und Bewertungen vergleichen.

1products = ["ProductA", "ProductB"]

2with sync_playwright() as p:

3 browser = p.chromium.launch()

4 page = browser.new_page()

5 for product in products:

6 page.goto(f"https://competitor.com/products/\{product\}")

7 page.wait_for_selector(".specs")

8 specs = page.query_selector(".specs").inner_text()

9 print(product, specs)

10 browser.close()Playwright Scraping im Vergleich: Wie schlägt es sich gegen andere Tools?

Wie schneidet Playwright im Vergleich zu Puppeteer und Selenium ab? Hier ein direkter Vergleich (, , ):

| Feature | Playwright | Puppeteer | Selenium |

|---|---|---|---|

| Browser Support | Chrome, Firefox, Safari | Chrome (offiziell) | Alle gängigen Browser |

| Language Support | JS, Python, Java, .NET | JS (Node.js) | Viele (Java, Python, C#, etc.) |

| Speed | Sehr schnell, parallele Sessions | Schnell (nur Chrome) | Langsamer, mehr Overhead |

| Ease of Use | Moderne API, Auto-Wait | Einfach für Node.js-Entwickler | Umständlicher, viel Konfiguration |

| Stealth/Anti-bot | Gut, wachsende Plugins | Gut mit Plugins | Schwächer, leichter zu erkennen |

| Community/Ecosystem | Wächst rasant | Stark im Node.js-Umfeld | Riesig, aber testfokussiert |

Fazit: Für neue Scraping-Projekte ist Playwright meist die beste Wahl – vor allem, wenn du browserübergreifend arbeiten, moderne APIs nutzen oder fortschrittliche Anti-Bot-Features brauchst.

Fazit & wichtigste Erkenntnisse

Wer Playwright Scraping beherrscht, kann das moderne Web effizient in strukturierte Daten verwandeln. Dank browserübergreifender Automatisierung, menschlicher Interaktionen und robuster Handhabung dynamischer Inhalte werden selbst anspruchsvolle Scraping-Aufgaben machbar. In Kombination mit Thunderbits KI-gestützter Felderkennung und Sofort-Export-Tools entsteht ein Workflow, der nicht nur effizient, sondern auch richtig angenehm ist.

Das Wichtigste auf einen Blick:

- Playwright Scraping ist ideal für dynamische, JavaScript-lastige Seiten, bei denen klassische Scraper versagen.

- Die Stärken – browserübergreifende Unterstützung, intelligentes Warten und Stealth-Features – machen es zum Top-Tool für moderne Datenerfassung.

- Die Einrichtung ist unkompliziert, und Best Practices wie intelligentes Warten und Proxy-Rotation sorgen für zuverlässige Ergebnisse.

- In Kombination mit profitierst du von KI-gestütztem Feldmapping, Subpage-Scraping und Sofort-Export – ideal für Business-Anwender:innen und Entwickler:innen.

- Praxisbeispiele reichen von E-Commerce über Marktforschung bis hin zu Immobilien und Vertrieb.

Bereit, deine Datenerfassung aufs nächste Level zu bringen? Starte mit deinem ersten Playwright-Skript und probiere anschließend Thunderbits für sofortige, codefreie Datenstrukturierung und Export aus. Noch mehr Tipps und Anleitungen findest du im .

Viel Erfolg beim Scrapen – möge dein Selektor immer passen, dein Proxy nie blockiert werden und deine Tabellen sich wie von selbst füllen.

Häufige Fragen (FAQ)

1. Was macht Playwright Scraping besser als klassische HTTP-basierte Scraper?

Playwright steuert einen echten Browser und kann so alle dynamischen Inhalte erfassen, die per JavaScript nachgeladen werden – klassische Scraper sehen diese Daten oft nicht. Das Ergebnis: vollständigere und genauere Daten von modernen Webseiten.

2. Kann Playwright auch Seiten mit Login oder mehrstufigen Formularen verarbeiten?

Definitiv. Playwright kann Logins automatisieren, Formulare ausfüllen, durch mehrstufige Prozesse klicken und sogar Cookies oder Sessions für authentifiziertes Scraping verwalten.

3. Wie verbessert Thunderbit das Playwright Scraping?

Mit Thunderbits KI-Feldvorschlägen erkennst du blitzschnell, welche Daten extrahiert werden sollten und wie sie zu strukturieren sind. Außerdem kannst du die extrahierten Daten direkt nach Excel, Google Sheets, Airtable oder Notion exportieren – ganz ohne manuelle Nachbearbeitung.

4. Was sind Best Practices, um Blockaden beim Playwright Scraping zu vermeiden?

Proxys rotieren, User Agents wechseln, menschliche Pausen einbauen und ggf. im Headful-Modus arbeiten. Immer die Nutzungsbedingungen der Zielseite respektieren und Server nicht überlasten.

5. Ist Playwright Scraping auch für Nicht-Programmierer geeignet?

Playwright selbst ist codebasiert, aber in Kombination mit Thunderbits No-Code Chrome Extension können auch Nicht-Entwickler:innen strukturierte Daten aus den meisten Webseiten extrahieren und exportieren – ganz ohne Programmierkenntnisse.

Du willst Playwright und Thunderbit in Aktion erleben? Lade die herunter und stöbere im für weitere Anleitungen und Inspiration.

Mehr erfahren