Stellen Sie sich Folgendes vor: Es ist Montagmorgen, Sie trinken gerade Ihren Kaffee, und Ihr Posteingang blinkt schon wegen der ersten Warnmeldungen auf. Schon wieder macht ein KI-gestütztes Tool Schlagzeilen, weil sensible Daten geleakt wurden. Ihr CEO will Antworten. Ihr Legal-Team ist in Alarmbereitschaft. Und Ihre Kunden? Die stellen schwierige Fragen dazu, wie ihre Daten in all diesen „intelligenten“ Systemen verwendet werden, die Sie im letzten Quartal ausgerollt haben. Willkommen im Jahr 2026 – in dem Datenschutz bei KI nicht nur ein Technikproblem ist, sondern eine Aufgabe für die Chefetage, ein Thema für die Marke und etwas, das Karrieren entweder beflügelt oder beendet.

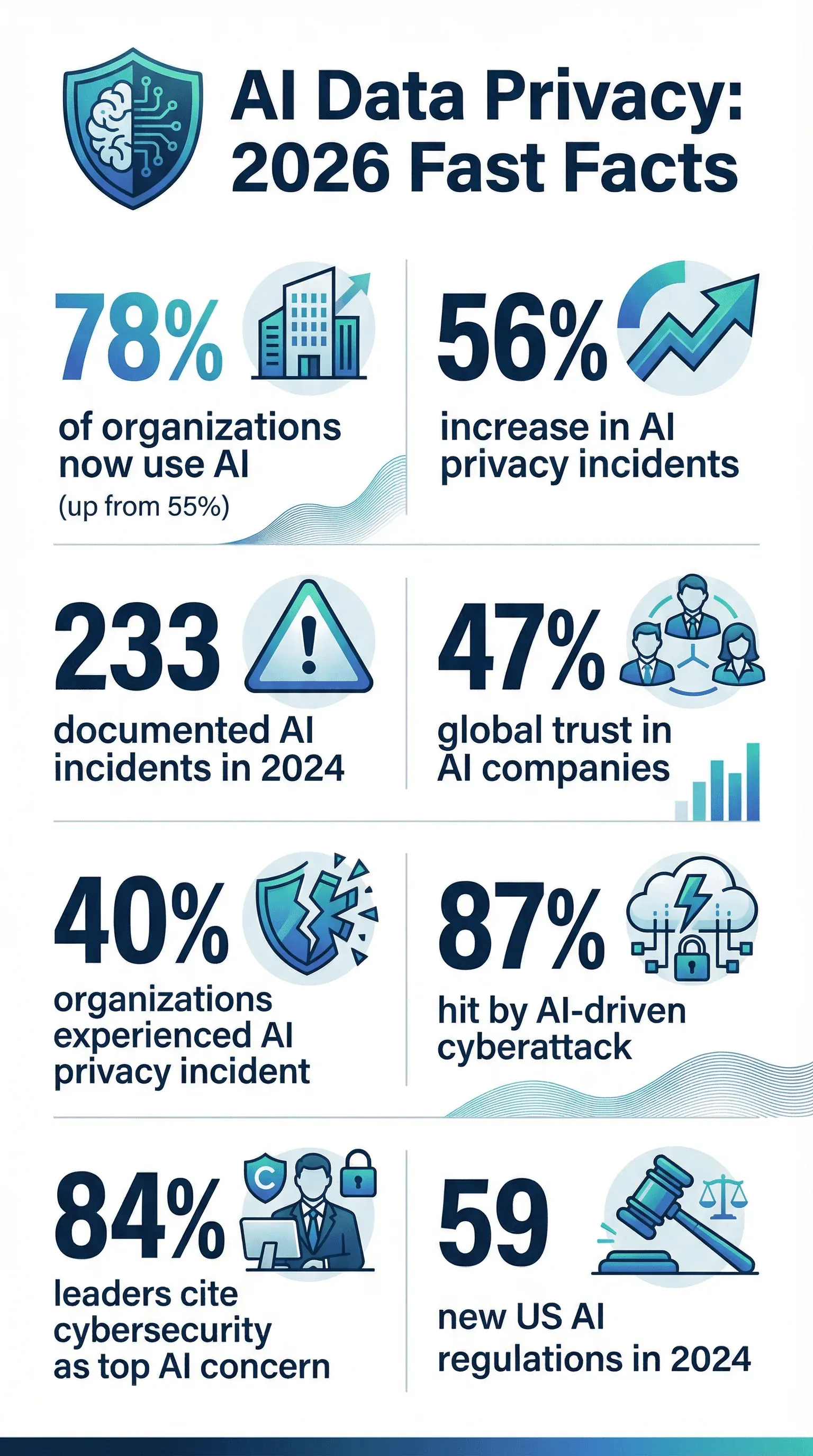

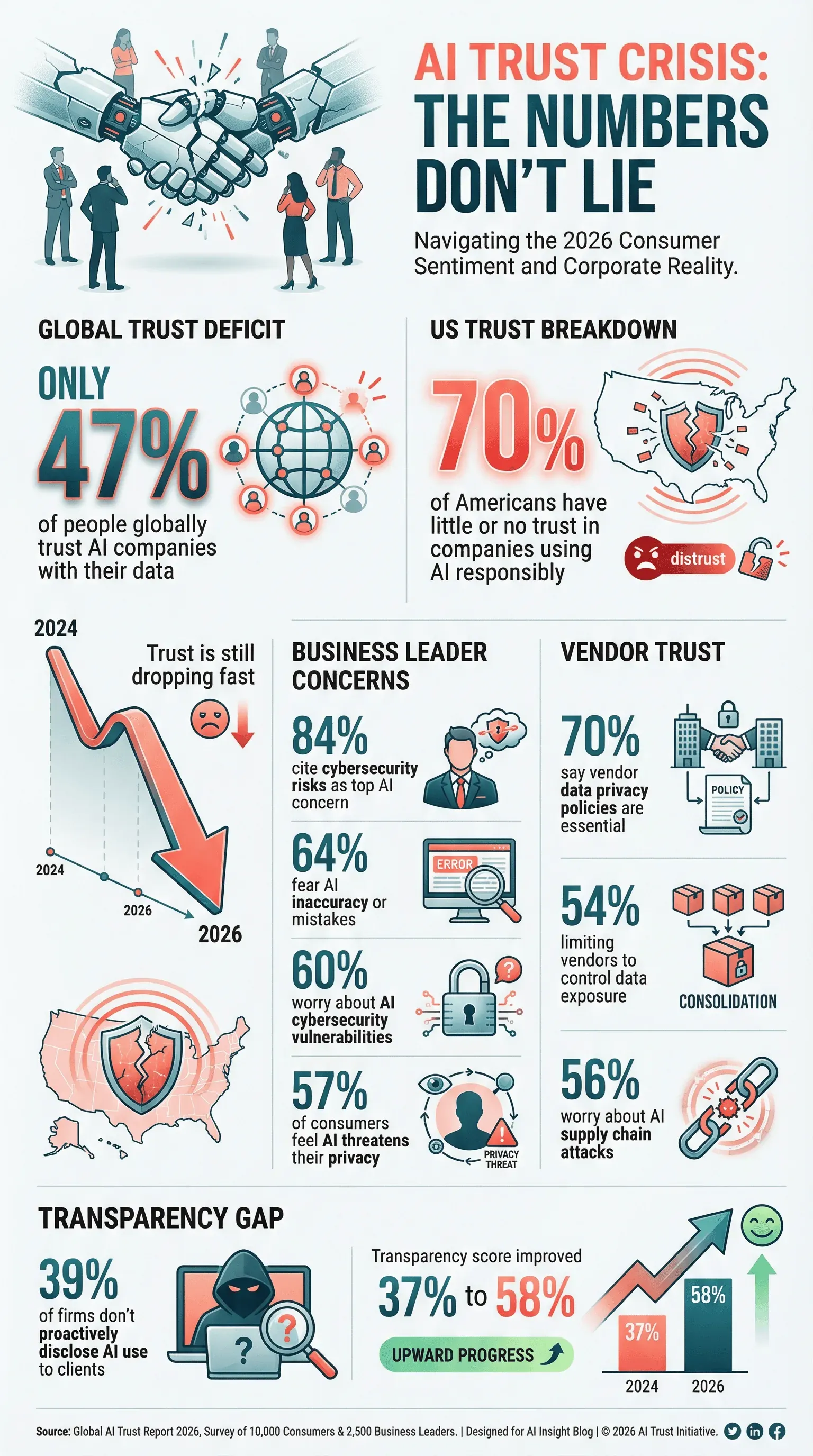

Die Wahrheit ist: KI ist inzwischen in fast jeden Geschäftsbereich eingebettet – von Vertrieb und Marketing bis hin zu Immobilien und E-Commerce. Mit der rasant steigenden Nutzung wachsen aber auch die Risiken. Allein im vergangenen Jahr stiegen KI-bezogene Datenschutzvorfälle um unglaubliche 56 %, und nur 47 % der Menschen weltweit vertrauen KI-Unternehmen beim Schutz ihrer personenbezogenen Daten – eine Zahl, die weiter schnell sinkt (, ). Als jemand, der jahrelang SaaS- und Automatisierungsplattformen aufgebaut hat – und heute Mitgründer von ist – kann ich Ihnen sagen: Die neuesten Statistiken zum Datenschutz bei KI zu verstehen, ist nicht nur ein Häkchen für die Compliance. Es entscheidet darüber, ob man in dieser neuen digitalen Ära erfolgreich ist oder gerade so überlebt.

Der Stand des Datenschutzes bei KI im Jahr 2026: Die wichtigsten Fakten

Kommen wir direkt zum Punkt. Wenn Sie für Ihr nächstes Board-Meeting oder Ihren nächsten Kundenpitch die wichtigsten Zahlen brauchen, sind hier die relevantesten Statistiken zum Datenschutz bei KI für 2026:

- KI ist überall: 78 % der Organisationen gaben 2024 an, KI zu nutzen – nach nur 55 % im Jahr davor ().

- Vorfälle nehmen stark zu: Dokumentierte KI-Vorfälle stiegen 2025 auf 362, nach 233 im Jahr 2024 – ein Anstieg von 55 % gegenüber dem Vorjahr ().

- Datenpannen sind häufig: 40 % der Organisationen haben bereits einen KI-bezogenen Datenschutzvorfall erlebt (), und 21 % erlitten im vergangenen Jahr einen Cyberangriff ().

- Vertrauen ist gering: Nur 47 % der Menschen weltweit vertrauen KI-Unternehmen ihre Daten an, und in den USA haben 70 % wenig oder gar kein Vertrauen darin, dass Unternehmen KI verantwortungsvoll einsetzen ().

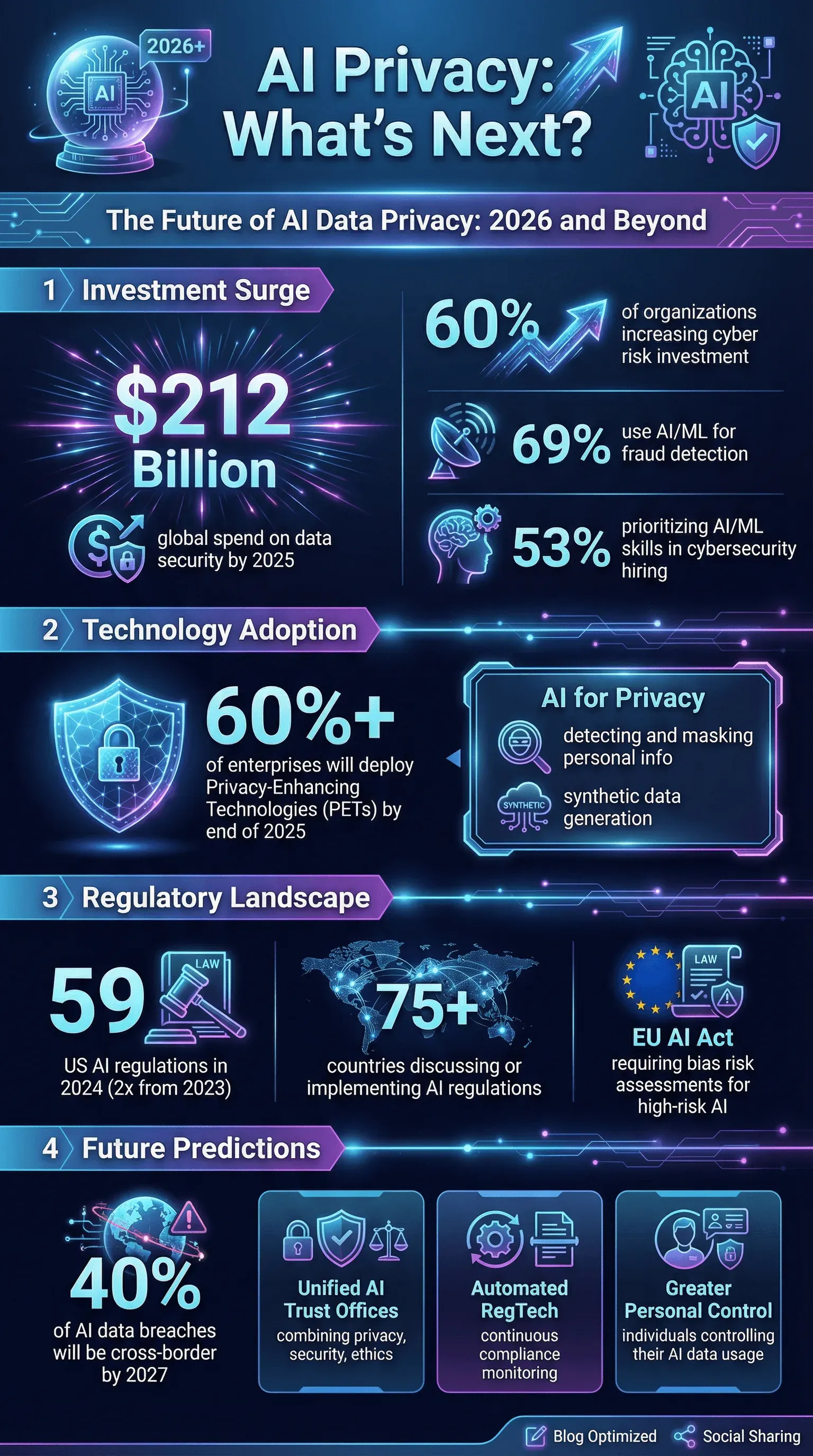

- KI ist die wichtigste Cyber-Investition: Die PwC-Umfrage zu Global Digital Trust Insights 2026 unter 3.887 Führungskräften zeigt, dass KI-Investitionen (36 %) die größte Cyber-Priorität für die nächsten 12 Monate sind – vor Cloud-Sicherheit (34 %), Netzwerksicherheit (28 %) und Datenschutz (26 %); 60 % der Organisationen erhöhen zudem ihre gesamten Cyber-Investitionen als Reaktion auf geopolitische Volatilität ().

- Anbieter werden genau geprüft: 70 % der Organisationen sagen, dass die Datenschutzrichtlinien eines Anbieters entscheidend sind, wenn sie KI- und Technologiepartner bewerten ().

- KI-Bedrohungen beunruhigen Führungskräfte: 84 % der Business Leader nennen Cybersicherheitsrisiken als ihre größte Sorge bei der KI-Einführung ().

- Die Regulierung nimmt Fahrt auf: US-Bundesbehörden haben 2024 59 KI-bezogene Vorschriften erlassen – mehr als doppelt so viele wie 2023 ().

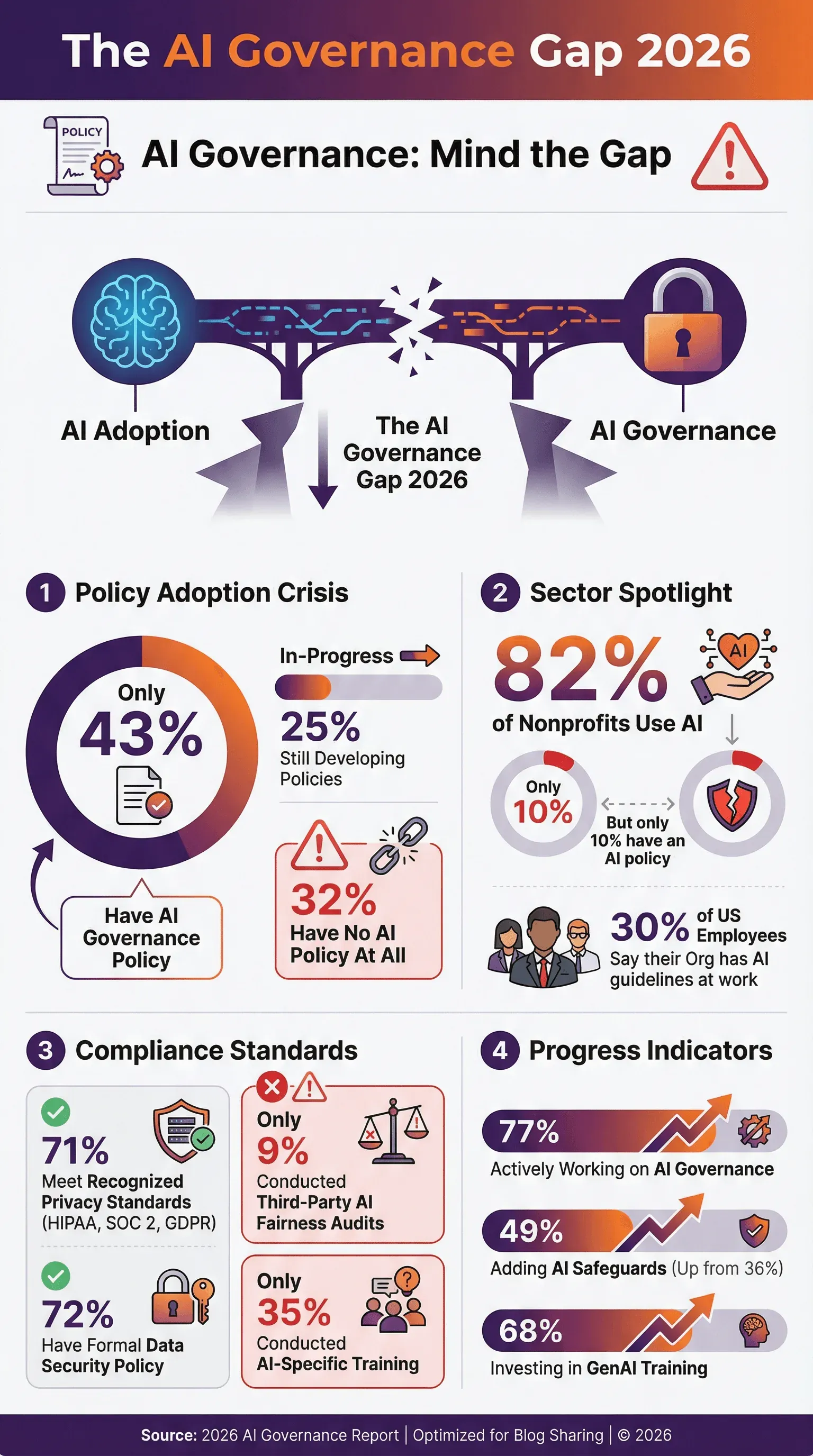

- Formale Richtlinien hinken hinterher: Nur 43 % der Unternehmen haben eine KI-Governance-Richtlinie, obwohl 77 % aktiv daran arbeiten (, ).

- KI-gestützte Cyberangriffe sind der neue Normalfall: 87 % der Organisationen erlebten im vergangenen Jahr einen KI-gestützten Cyberangriff ().

Diese Zahlen sind nicht nur interessant – sie sind ein Weckruf für alle, die für Daten, Compliance oder digitale Transformation verantwortlich sind.

Warum Datenschutz bei KI wichtiger ist als je zuvor

KI ist nicht einfach nur ein weiteres IT-Upgrade – sie verändert grundlegend, wie Organisationen Daten erfassen, verarbeiten und nutzen. Anders als klassische Software lernen KI-Systeme oft aus riesigen, unstrukturierten Datensätzen, die alles enthalten können – von Kundene-Mails bis zu Krankenakten. Und jetzt kommt der Knackpunkt: KI-Modelle können Informationen „auswendig lernen“ und wieder ausgeben, auf eine Weise, die niemand erwartet hat. Dabei werden manchmal private Daten offengelegt, die niemals ans Licht kommen sollten ().

Das Ausmaß ist kaum zu fassen. Ein einzelnes KI-Modell kann Millionen von Datensätzen verarbeiten oder Daten aus dem gesamten Web scrapen – manchmal ohne ausdrückliche Zustimmung. Das bedeutet: Der Schutz dieser Daten steht heute mehr denn je auf dem Spiel. Und wenn KI in Sekunden Entscheidungen trifft – etwa bei Kreditvergaben oder beim Screening von Bewerbern –, können sich Verzerrungen oder Fehler mit Lichtgeschwindigkeit verstärken und zu Datenschutzverletzungen oder sogar zu Problemen im Bereich der Bürgerrechte führen.

Wenn Sie jetzt denken: „Wir haben doch eine Datenschutzerklärung, also passt das schon“, sollten Sie noch einmal überlegen. In Wirklichkeit bringt KI neue Risiken mit sich – etwa Data Poisoning, Model Inversion und adversariale Angriffe –, für die klassische Schutzmaßnahmen schlicht nicht gebaut wurden. Und die Reputationsschäden nach einem KI-Datenschutzvorfall? Die sind massiv. Kunden springen ab, Aufsichtsbehörden verhängen Bußgelder, und es kann Jahre dauern, bis sich Ihre Marke erholt. Im Jahr 2026 geht es beim Datenschutz bei KI nicht nur um Compliance, sondern ums Überleben.

Statistiken zum Datenschutz bei KI: Einführung, Sorgen und Compliance

KI ist nahezu allgegenwärtig

Sagen wir es ehrlich: KI ist längst keine „aufstrebende Technologie“ mehr. Sie ist Mainstream. Bis 2024 nutzten 78 % der Organisationen KI – gegenüber nur 55 % im Jahr davor (). In manchen Branchen, etwa Recht und Finanzen, sind die Nutzungsraten sogar noch höher – 42 % der Kanzleien nutzten 2025 KI-Tools, fast doppelt so viele wie im Vorjahr (). Diese Explosion bei der Nutzung bedeutet: Es werden mehr Daten gesammelt, analysiert und manchmal offengelegt.

Datenschutzbedenken nehmen zu

Mit großer Macht kommt große Verantwortung – und jede Menge Unsicherheit. 57 % der Verbraucher weltweit sind inzwischen der Meinung, dass KI eine erhebliche Bedrohung für ihre Privatsphäre darstellt (). In den USA ergab eine Pew-Research-Umfrage vom März 2026, dass 47 % der Erwachsenen nicht besonders viel oder gar kein Vertrauen darin haben, dass das Land KI gut reguliert, und dass die Hälfte der US-Erwachsenen sagt, die zunehmende Nutzung von KI im Alltag mache ihnen eher Sorgen als Freude (gegenüber nur 10 %, die mehr Vorfreude empfinden) ().

Mit großer Macht kommt große Verantwortung – und jede Menge Unsicherheit. 57 % der Verbraucher weltweit sind inzwischen der Meinung, dass KI eine erhebliche Bedrohung für ihre Privatsphäre darstellt (). In den USA ergab eine Pew-Research-Umfrage vom März 2026, dass 47 % der Erwachsenen nicht besonders viel oder gar kein Vertrauen darin haben, dass das Land KI gut reguliert, und dass die Hälfte der US-Erwachsenen sagt, die zunehmende Nutzung von KI im Alltag mache ihnen eher Sorgen als Freude (gegenüber nur 10 %, die mehr Vorfreude empfinden) ().

Selbst Führungskräfte sind besorgt: 64 % fürchten die Ungenauigkeit oder Fehleranfälligkeit von KI, und 60 % nennen gezielt KI-bezogene Cybersicherheitslücken als großes Problem ().

Compliance: Ein bewegliches Ziel

Organisationen bemühen sich, mit Vorschriften wie GDPR, CCPA, HIPAA und SOC 2 Schritt zu halten – doch KI bringt oft neue Fallstricke mit sich. 71 % der Organisationen sagen, dass sie anerkannte Datenschutzstandards erfüllen (), und 72 % verfügen über eine formale Richtlinie zur Datensicherheit. Der Haken: Weniger als die Hälfte hat eine eigene KI-Governance- oder Ethikrichtlinie. Nur 43 % der Organisationen haben eine KI-Governance-Richtlinie, weitere 25 % entwickeln noch eine (, ). Der Rest? Der navigiert blind.

Einführung von Richtlinien zum Datenschutz bei KI

Formale Richtlinien zum Datenschutz bei KI entwickeln sich schnell von einem „Nice-to-have“ zu einem „Must-have“. Doch die Zahlen zeigen, dass es noch eine Lücke gibt:

- Nur 43 % der Unternehmen haben eine KI-Governance-Richtlinie, weitere 25 % arbeiten daran ().

- In den USA sagen nur 30 % der Beschäftigten, dass ihre Organisation Richtlinien oder Leitlinien für den KI-Einsatz bei der Arbeit hat ().

- Unter Nonprofits nutzen 82 % KI, aber nur 10 % haben eine KI-Richtlinie ().

- Die gute Nachricht? 77 % der Organisationen arbeiten aktiv an KI-Governance-Maßnahmen, und bei intensiven KI-Nutzern liegt der Anteil bei fast 90 % ().

Frühe Anwender passen ihre Richtlinien bereits an – mit Regelungen zu verbotenen KI-Anwendungen, Anforderungen an menschliche Prüfung und Zusagen zu Fairness und Transparenz. Wenn Ihre Organisation damit noch nicht begonnen hat, ist jetzt der richtige Zeitpunkt – bevor ein Vorfall oder ein neues Gesetz Sie dazu zwingt.

Audits und Zertifizierungen im Datenschutz bei KI

Richtlinien sind wichtig, aber Audits und Zertifizierungen sind der Beweis, dass Sie nicht nur reden, sondern handeln.

- 71 % der Unternehmen berichten über die Einhaltung anerkannter Standards wie HIPAA, SOC 2 oder GDPR ().

- 51 % verlangen von Anbietern die HIPAA-Konformität für Gesundheitsdaten, und 45 % fordern Ende-zu-Ende-Verschlüsselung ().

- Nur 9 % der Organisationen haben Drittanbieter-Audits durchgeführt, die sich auf Fairness oder Bias ihrer KI konzentrierten – dieser Wert dürfte jedoch steigen, sobald die Regulierung aufholt ().

Zertifizierungen wie SOC 2, ISO 27001 und HITRUST werden zunehmend zu echten Wettbewerbsvorteilen. Wenn Sie Anbieter sind, sollten Sie mit Nachfragen nach Nachweisen rechnen. Wenn Sie einkaufen, stellen Sie sicher, dass Ihre Partner wirklich mithalten können.

KI-Cybersicherheit: Bedrohungen, Vorfälle und Reaktion

Sprechen wir über den Elefanten im Serverraum: KI ist nicht nur Ziel von Cyberangriffen – sie ist auch ein Werkzeug für Angreifer. Und die Zahlen sind, offen gesagt, ziemlich beunruhigend.

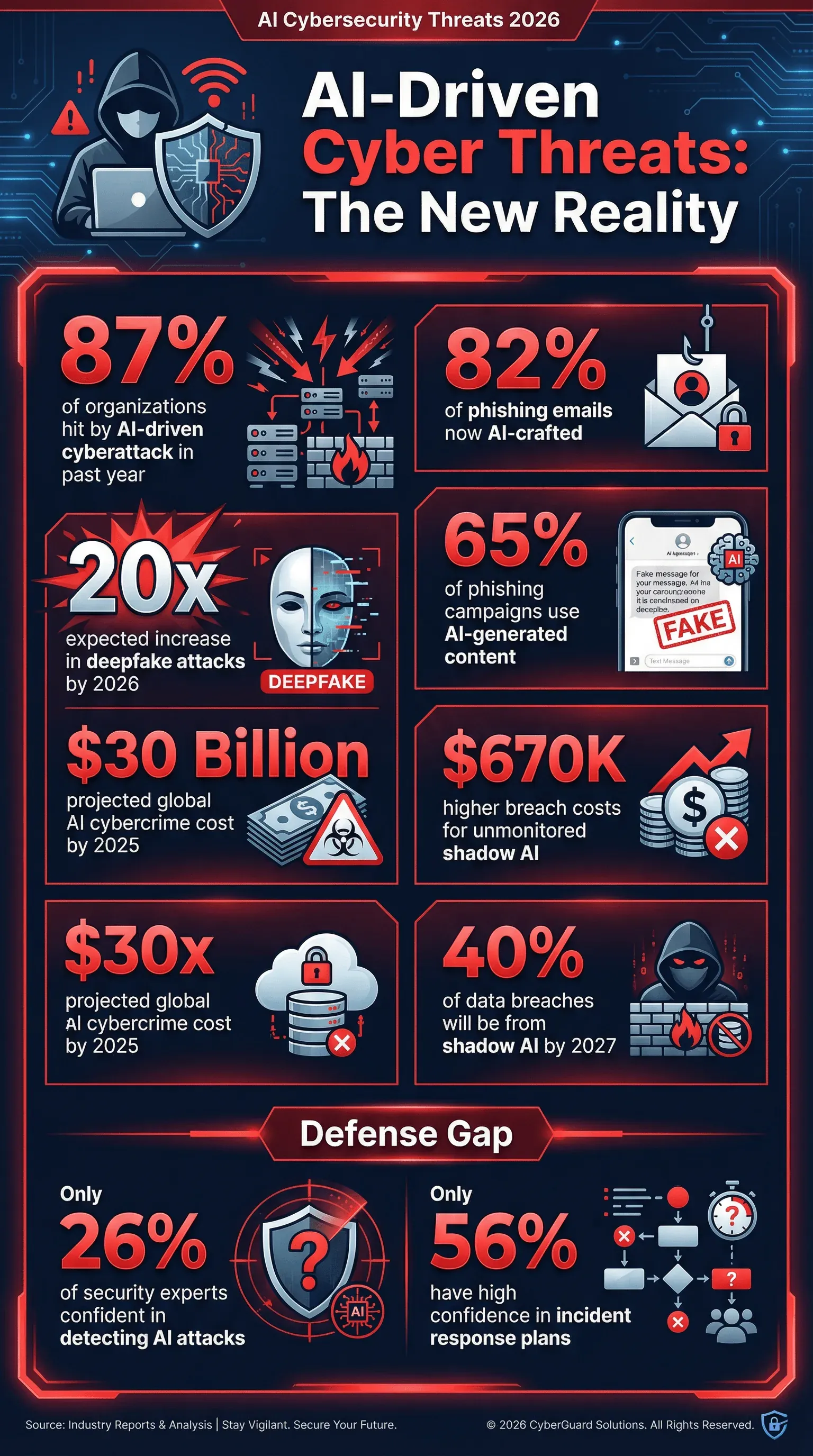

- 87 % der Organisationen erlebten im vergangenen Jahr einen KI-gestützten Cyberangriff ().

- 65 % der Phishing-Kampagnen nutzen inzwischen KI-generierte Inhalte, um vertrauenswürdige Kommunikation zu imitieren ().

- Es wird geschätzt, dass 82 % der Phishing-E-Mails mit Hilfe von KI erstellt werden ().

- Deepfake-Angriffe sollen sich bis 2026 um das 20-Fache erhöhen ().

- Shadow AI – also die nicht autorisierte Nutzung von KI durch Mitarbeitende – ist ein wachsendes Risiko. Gartner prognostiziert, dass 40 % aller Datenpannen bis 2027 auf den Missbrauch von KI- oder „Shadow-AI“-Systemen zurückzuführen sein werden ().

Und hier ist eine Zahl, die CISOs nachts wach hält: Nur 26 % der Sicherheitsexperten haben großes Vertrauen in ihre Fähigkeit, KI-gestützte Angriffe zu erkennen (). Das ist ein bisschen so, als würde man mit einem Weltklasse-Magier Verstecken spielen.

KI-gestützte Cyberangriffe: Was die Zahlen zeigen

- 87 % der Organisationen sind in den letzten 12 Monaten einem KI-unterstützten Angriff begegnet ().

- Phishing ist intelligenter geworden: Ende 2025 waren über 82 % der Phishing-E-Mails KI-gestaltet ().

- Deepfakes explodieren: Deepfake-Audio- und Videoangriffe sollen sich bis 2026 um das 20-Fache erhöhen.

- Shadow AI ist riskant: Bis 2027 werden 40 % der Datenpannen auf den Missbrauch von KI oder „Shadow AI“ zurückzuführen sein ().

- Shadow AI erhöht die Kosten von Datenpannen: Vorfälle mit Shadow AI kosteten im Schnitt 4,63 Millionen US-Dollar – rund 670.000 US-Dollar mehr als der globale Durchschnitt. Dabei wurden bei solchen Vorfällen überdurchschnittlich häufig Kundendaten mit personenbezogenen Informationen offengelegt (65 % gegenüber 53 % globaler Durchschnitt) ().

- Globale Kosten: KI-gestützte Cyberkriminalität könnte bis 2025 30 Milliarden US-Dollar erreichen ().

- Zugangskontrollen fehlen: Unter Organisationen mit einer KI-bezogenen Datenpanne gaben 97 % an, keine angemessenen KI-Zugangskontrollen gehabt zu haben, und 63 % verfügten entweder über keine KI-Governance-Richtlinie oder waren noch dabei, eine zu entwerfen ().

Wenn Sie keine Phishing-Übungen mit KI-generierten E-Mails durchführen oder Ihre Abwehr gegen Deepfakes testen, spielen Sie mit dem Feuer.

Investitionen von Organisationen in KI-Cybersicherheit

Die gute Nachricht? Organisationen investieren mehr denn je in KI-Cybersicherheit:

- 60 % der Organisationen erhöhen ihre Investitionen in die Minderung von Cyberrisiken, wobei KI ein Treiber ist ().

- 69 % nutzen KI oder Machine Learning für die Erkennung und Verhinderung von Betrug ().

- 53 % priorisieren KI- und ML-Kompetenzen bei Einstellungen im Bereich Cybersicherheit ().

- Die weltweiten Ausgaben für Datensicherheit und Risikomanagement sollen bis 2025 212 Milliarden US-Dollar erreichen ().

Doch es gibt weiterhin eine Lücke: Der Anteil der Organisationen, die ihre Reaktion auf KI-Vorfälle als „hervorragend“ bewerten, sank von 28 % im Jahr 2024 auf 18 % im Jahr 2025, obwohl die Einführung von KI weiter an Fahrt gewann (). Die von manchen 2024er-Umfragen genannte Vertrauenszahl von 56 % überschätzt die tatsächliche Bereitschaft.

KI-Daten-Governance: Schulung, Aufsicht und Bias-Minderung

Sie können die beste Technologie der Welt haben – wenn Ihre Mitarbeitenden und Prozesse nicht auf dem neuesten Stand sind, bleiben Risiken bestehen.

- Nur 35 % der Organisationen haben ihre Teams bereits speziell zu Datenschutz, Sicherheit oder Ethik rund um KI geschult ().

- 68 % der Unternehmen investieren in Schulungen zu generativer KI für Mitarbeitende ().

- 30 % setzen auf menschliche Aufsicht als Kontrollmaßnahme für KI-Schutzmechanismen ().

- Nur 9 % nutzen unabhängige Audits zur Fairness von KI ().

- 49 % sind dabei, zusätzliche KI-Governance-Schutzmaßnahmen einzuführen, nach 36 % im Vorjahr.

Bias ist ebenfalls ein großes Datenschutzproblem. KI-Systeme, die personenbezogene Daten je nach Rasse, Geschlecht oder anderen Merkmalen unterschiedlich behandeln, können zu ungleichen Datenschutzschäden und sogar zu rechtlichen Problemen führen. 46 % der Führungskräfte sagen, dass verantwortungsvolle KI – einschließlich Fairness – ein zentrales Ziel ihrer KI-Investitionen ist (). Doch Bias zu messen und zu verringern, ist für die meisten Organisationen noch immer ein laufender Prozess.

KI-Bias und Fairness: Auswirkungen auf den Datenschutz

- KI-bezogene Vorfälle mit Bias oder Sicherheitsproblemen nehmen jedes Jahr deutlich zu ().

- Einige Unternehmen berichten nach Maßnahmen zur Bias-Minderung von einer 25 % geringeren Geschlechterungleichheit bei Empfehlungen für Jobkandidaten.

- Der regulatorische Druck wächst: Die GDPR der EU und der kommende AI Act werden Risikoanalysen für Bias bei „hochrisikobehafteten“ KI-Systemen verlangen.

Wenn Sie Ihre KI nicht auf Bias testen, riskieren Sie nicht nur schlechte Presse, sondern auch Klagen und Geschäftseinbußen.

Risiken durch Anbieter und Ökosystem: Konsolidierung und Drittparteiexposition

Kein Unternehmen ist eine Insel. Die meisten verlassen sich auf ein Netzwerk aus Anbietern, Cloud-Providern und Partnern – und all diese können Datenschutzrisiken mit sich bringen.

- 54 % der Unternehmen begrenzen die Zahl ihrer Anbieter, um Kosten zu kontrollieren und die Datenexposition zu minimieren ().

- 70 % der Unternehmen halten Datenschutzrichtlinien für entscheidend, wenn sie Technologieanbieter prüfen.

- 56 % sorgen sich über KI-gestützte Angriffe auf die Lieferkette ().

Der Trend ist klar: Anbieter konsolidieren, strengere Datenschutzkontrollen verlangen und Partner als Erweiterung der eigenen Sicherheitsgrenze behandeln.

Regulatorischer und kundenseitiger Druck: Transparenz und Offenlegung beim Datenschutz bei KI

Aufsichtsbehörden und Kunden drehen an der Schraube. 2024 gab es in den USA 59 KI-bezogene regulatorische Maßnahmen, mehr als doppelt so viele wie im Vorjahr. Weltweit haben mindestens 75 Länder KI-Regulierungen diskutiert oder umgesetzt ().

- Transparenz ist der neue Standard: Kunden erwarten Offenlegung beim KI-Einsatz, doch 39 % der Unternehmen geben zu, Kunden nicht proaktiv über ihren KI-Einsatz zu informieren ().

- Audit-Bereitschaft ist Pflicht: Seien Sie darauf vorbereitet, Nachweise für Compliance zu liefern – HIPAA, SOC 2, Listen der KI-Tools und Kontrollen zur Datenverarbeitung.

- Die Transparenz unter Entwicklern von Foundation Models sinkt tatsächlich. Der Foundation Model Transparency Index von Stanford fiel auf einer 100-Punkte-Skala von durchschnittlich 58 Punkten im Jahr 2024 auf 40 Punkte im Jahr 2025, wobei die meisten Frontier Labs im vergangenen Jahr weniger über Trainingsdaten, Rechenleistung und Risiken offenlegten ().

Wenn Sie nicht bereit für ein Audit oder einen kritischen Kundenfragebogen sind, sind Sie auch für 2026 nicht bereit.

Die Zukunft des Datenschutzes bei KI: Prognosen und neue Trends

Mit Blick nach vorn sehe ich Folgendes am Horizont – und auch die Expertinnen und Experten sagen Ähnliches:

- Datenschutz als Wettbewerbsvorteil: Unternehmen, die nachweisen können, dass ihre KI sicher, datenschutzfreundlich und ethisch ist, werden Kunden gewinnen ().

- Einheitliche Governance: Erwarten Sie „AI Trust“-Teams, die Datenschutz, Sicherheit und Ethik unter einem Dach vereinen.

- Privacy-Enhancing Technologies (PETs): Über 60 % der Unternehmen planen, PETs bis Ende 2025 einzusetzen ().

- Automatisierte Compliance: RegTech für KI wird unverzichtbar werden, mit Tools, die KI-Systeme kontinuierlich auf Compliance-Probleme überwachen.

- Grenzüberschreitende Datenprobleme: Bis 2027 werden 40 % der KI-bezogenen Datenpannen auf grenzüberschreitenden Datenmissbrauch zurückzuführen sein ().

- Mehr persönliche Kontrolle: Es werden Tools erwartet, mit denen Einzelpersonen steuern können, wie ihre Daten in KI verwendet werden.

- KI für den Datenschutz: KI wird genutzt werden, um personenbezogene Informationen zu erkennen und zu maskieren, synthetische Daten zu erzeugen und mehr.

- Incident Response und Resilienz: Organisationen werden sich von reiner Prävention hin zu Resilienz bewegen – einschließlich Versicherungen für KI-Vorfälle und Übungen zur Wiederherstellung nach Data Poisoning oder Modellkorruption.

Als jemand, der Automatisierung und KI liebt – und ganz ehrlich auch eine gesunde Portion Paranoia beim Thema Datenschutz mitbringt – bin ich überzeugt: Die Gewinner des nächsten Jahrzehnts werden diejenigen sein, die Datenschutz und Sicherheit als Kernfunktionen behandeln, nicht als Nebensache.

Wichtige Erkenntnisse: Was die KI-Datenschutzstatistiken 2026 für Ihr Unternehmen bedeuten

Zum Abschluss einige konkrete Schritte – denn niemand möchte im nächsten Jahr die mahnende Schlagzeile liefern:

- Machen Sie Datenschutz bei KI zu einem Kernbestandteil Ihrer Strategie. Nicht nachträglich ergänzen – von Anfang an mitdenken.

- Führen Sie umfassende KI-Risikoanalysen durch. Kennen Sie Ihre KI-Systeme, Datenflüsse und Risikopunkte.

- Investieren Sie in KI-spezifische Schulung und Governance. Lassen Sie Ihr Team nicht zum schwächsten Glied werden.

- Stärken Sie die technischen Abwehrmaßnahmen mit Blick auf KI. Nutzen Sie KI gegen KI – mit fortschrittlichen Monitoring- und Erkennungstools.

- Verwalten Sie Anbieter konsequent. Konsolidieren, prüfen und Nachweise zur Compliance einfordern.

- Setzen Sie auf Transparenz. Sagen Sie Kunden und Nutzern, wann und wie Sie KI einsetzen – bevor es jemand anderes tut.

- Implementieren Sie privacy-enhancing Technologien. Anonymisieren, verschlüsseln und minimieren Sie Daten, wo immer es möglich ist.

- Planen Sie für den Ernstfall. Haben Sie einen Incident-Response-Plan für KI und testen Sie ihn regelmäßig.

- Bleiben Sie bei Gesetzen und Standards auf dem Laufenden. Die Regulierungslandschaft verändert sich schnell – lassen Sie sich nicht überraschen.

- Machen Sie Vertrauen zu Ihrem Nordstern. 2026 und darüber hinaus ist Vertrauen Ihr wertvollstes Gut.

Zitierfähige Quellen und weiterführende Lektüre

Möchten Sie tiefer einsteigen oder brauchen Sie Zahlen für Ihre nächste Präsentation? Hier sind einige der besten Quellen, die ich für diesen Überblick verwendet habe:

- )

Für mehr Einblicke in KI, Automatisierung und Datenschutz besuchen Sie den oder werfen Sie einen Blick in unsere Leitfäden zu und .