Im Geschäftsleben hört man oft: „Daten sind das neue Öl.“ Aber mal ehrlich – wer heute noch Daten per Copy & Paste von Webseiten sammelt, der versucht, mit einem Teelöffel Öl zu fördern. In unserer datengetriebenen Arbeitswelt verbringen Teams im Schnitt bis zu nur damit, Informationen zu suchen. Und ein durchschnittlicher Büroangestellter macht . Kein Wunder, dass viele von uns in endlosen, manuellen Aufgaben untergehen.

Deshalb ist es ein echter Gamechanger, wenn du lernst, wie du mit Python eine Website scrapen kannst – egal ob im Vertrieb, in der Forschung oder im Tagesgeschäft. Mit den Web-Scraping-Tools von Python kannst du stundenlange Fleißarbeit auf ein paar Zeilen Code reduzieren. Oder – wenn du wie ich lieber auf Programmieren verzichtest – mit wenigen Klicks per KI-Tool wie . Egal ob Anfänger oder Profi: Hier erfährst du, warum, was und wie du mit Python (und Thunderbit) Webseiten scrapen kannst – und wie du dir damit jede Menge Arbeit sparst.

Warum Python für das Scrapen von Webseiten?

Wenn es ums Web Scraping geht, ist Python einfach die erste Wahl – und das aus gutem Grund. Python ist nicht nur super beliebt, sondern bringt alles mit, was du für effizientes Scraping brauchst.

Das macht Python so stark:

- Einfach zu lernen und zu nutzen: Die Syntax von Python ist klar und verständlich. Du brauchst kein Informatikstudium, um ein Skript zu schreiben, das Webdaten abruft.

- Viele Bibliotheken: Mit Tools wie , , und findest du für jeden Anwendungsfall die passende Lösung – von statischem HTML bis zu komplexen Browser-Interaktionen.

- Aktive Community & gute Dokus: Bei Problemen findest du fast immer eine Lösung auf Stack Overflow. Die Bibliotheken sind top dokumentiert und werden von einer riesigen Community unterstützt.

- Flexibel und vielseitig: Python lässt sich easy mit anderen Tools kombinieren. Du kannst es mit KI-Plattformen wie verbinden, um Daten noch effizienter zu extrahieren, oder automatisierte Analysen und Machine Learning darauf aufbauen.

Im Vergleich zu anderen Sprachen wie JavaScript oder R ist Python leichter zu lernen und bietet besonders viel Support fürs Web Scraping. Wie ein Branchenprofi sagt: „Python ist das Schweizer Taschenmesser fürs Web Scraping – vielseitig, zuverlässig und immer einsatzbereit.“

Die Grundlagen: Wie funktioniert Web Scraping mit Python?

Schauen wir uns mal an, wie der typische Ablauf beim Scrapen mit Python aussieht. Egal ob du eine einzelne Seite oder eine ganze Website auslesen willst – der Workflow ist meistens ähnlich:

| Schritt | Was passiert | Python-Bibliothek |

|---|---|---|

| 1. Webanfrage senden | HTML der Zielseite abrufen | requests.get() |

| 2. HTML parsen | Seitenstruktur analysieren | BeautifulSoup() |

| 3. Daten extrahieren | Benötigte Infos auslesen (z.B. Titel, Preise) | soup.find_all() |

| 4. Daten speichern | Ergebnisse als CSV, Excel oder in Datenbank sichern | csv, pandas, oder openpyxl |

Klingt easy, oder? In der Praxis gibt’s aber oft Herausforderungen – zum Beispiel bei Seiten mit Paginierung, dynamischen Inhalten oder ständig wechselndem Layout. Hier kommen Tools wie Thunderbit ins Spiel, die mit „2-Klick-Scraping“ und KI-gestützter Felderkennung den Prozess deutlich vereinfachen.

Die wichtigsten Python-Bibliotheken fürs Web Scraping

Im Python-Ökosystem gibt’s für jeden Anwendungsfall die passende Bibliothek. Hier ein Überblick über die wichtigsten Tools:

BeautifulSoup: Schnelles und einfaches HTML-Parsing

ist perfekt für Einsteiger. Es eignet sich super, um statisches HTML zu analysieren und gezielt Daten rauszuziehen.

- Vorteile: Einfach, intuitiv, ideal für kleine Projekte.

- Einschränkungen: Nicht für das Crawlen vieler Seiten oder JavaScript-lastige Websites gedacht.

- Beispiel: Produktlisten von einer statischen Shop-Seite extrahieren.

Scrapy: Leistungsstarkes Crawling für große Projekte

ist das Profi-Tool für komplexe Scraping-Projekte. Es ist ein komplettes Framework, um viele Seiten zu durchsuchen, Links zu folgen und große Datenmengen zu exportieren.

- Vorteile: Schnell, skalierbar, unterstützt komplexe Workflows (z.B. Paginierung).

- Einschränkungen: Etwas höhere Einstiegshürde, mehr Konfiguration nötig.

- Beispiel: Alle Kategorien und Produkte eines großen Online-Shops scrapen.

Selenium: Für dynamische Inhalte und Interaktionen

ist die Lösung für Webseiten, die auf JavaScript basieren oder Nutzerinteraktionen erfordern (z.B. Login, Klicks).

- Vorteile: Steuert echte Browser, kann mit dynamischen Inhalten umgehen.

- Einschränkungen: Langsamer als andere Tools, braucht mehr Ressourcen.

- Beispiel: Daten hinter Login-Bereichen oder von interaktiven Dashboards extrahieren.

Requests: Die Basis für Webanfragen

ist das Standard-Tool, um HTTP-Anfragen zu senden. Oft wird es zusammen mit BeautifulSoup für einfache Scraping-Aufgaben genutzt.

- Vorteile: Einfach zu bedienen, unterstützt Cookies und Sessions.

- Einschränkungen: Kann kein JavaScript ausführen.

- Beispiel: HTML herunterladen und mit BeautifulSoup weiterverarbeiten.

Workflow-Booster: Webseiten mit Thunderbit und Python scrapen

Kleiner Geheimtipp: Auch als Python-Fan schreibe ich nicht für jede Aufgabe ein eigenes Skript. Hier kommt ins Spiel – eine Chrome-Erweiterung, die KI-basiertes, codefreies Scraping für alle ermöglicht.

Thunderbit richtet sich an Business-Anwender, die schnell Ergebnisse brauchen. Mit Features wie KI-Feldvorschlägen, Subpage-Scraping und direktem Export nach Excel oder Google Sheets ist es wie ein Python-Skript und ein Datenanalyst in einem.

Thunderbits 2-Klick-Scraping vs. manuelles Python-Coding

Vergleichen wir mal den klassischen Python-Workflow mit Thunderbit:

| Aufgabe | Python-Skript | Thunderbit KI-Web-Scraper |

|---|---|---|

| Umgebung einrichten | Python, pip, Bibliotheken installieren | Chrome-Erweiterung installieren |

| Seitenstruktur prüfen | Dev-Tools nutzen, Selektoren schreiben | „KI-Felder vorschlagen“ klicken |

| Extraktionscode schreiben | Python-Code schreiben und debuggen | „Scrapen“ klicken |

| Paginierung abbilden | Schleifen und URL-Handling programmieren | „Paginierung“ im UI aktivieren |

| Daten exportieren | Mit Code als CSV/Excel speichern | „Export zu Sheets/Excel/Notion/Airtable“ klicken |

| Wartung | Code bei Layout-Änderungen anpassen | KI passt sich automatisch an |

Mit Thunderbit kannst du Daten von fast jeder Website in zwei Klicks extrahieren – ganz ohne Code, Vorlagen oder Kopfschmerzen. Für komplexere Workflows kannst du Python weiterhin nutzen, um Thunderbit-Exporte zu automatisieren oder weiterzuverarbeiten.

Thunderbit mit Python-Skripten kombinieren

Das Beste: Du kannst Python nutzen, um Thunderbit-Scraping-Aufgaben zu steuern oder zu planen. Zum Beispiel:

- Thunderbit regelmäßig automatisch starten (z.B. tägliche Preisüberwachung)

- Exportierte Daten mit pandas oder scikit-learn weiterverarbeiten

- Thunderbit-Daten mit anderen Quellen für Analysen oder Machine Learning kombinieren

So profitierst du von der Schnelligkeit und Einfachheit von Thunderbit und der Flexibilität von Python für fortgeschrittene Automatisierung.

Schritt-für-Schritt: So scrapen Sie eine Website mit Python

Bereit für die Praxis? Hier eine einfache Anleitung für Einsteiger:

Schritt 1: Python-Umgebung einrichten

Stell sicher, dass Python installiert ist. Für das Management der Umgebung empfehlen sich oder .

1# pip installieren (falls noch nicht vorhanden)

2python -m ensurepip --upgrade

3# Virtuelle Umgebung anlegen (optional, empfohlen)

4python -m venv myenv

5source myenv/bin/activate # Unter Windows: myenv\Scripts\activate

6# Benötigte Bibliotheken installieren

7pip install requests beautifulsoup4 pandasSchritt 2: Webseiteninhalt abrufen

Mit Requests lädst du das HTML der Zielseite herunter.

1import requests

2url = 'https://example.com/products'

3response = requests.get(url)

4if response.status_code == 200:

5 html = response.text

6else:

7 print("Seite konnte nicht geladen werden:", response.status_code)Tipp: Bei Fehlern wie 403 oder 404 prüfe, ob die Seite Bots blockiert oder spezielle Header/Cookies braucht.

Schritt 3: HTML parsen und Daten extrahieren

Jetzt mit BeautifulSoup das HTML analysieren und die gewünschten Daten auslesen.

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html, 'html.parser')

3products = soup.find_all('div', class_='product-item')

4data = []

5for product in products:

6 name = product.find('h2').get_text(strip=True)

7 price = product.find('span', class_='price').get_text(strip=True)

8 data.append({'name': name, 'price': price})Hinweis: Mit „Element untersuchen“ im Browser findest du die passenden HTML-Tags und Klassen.

Schritt 4: Daten speichern und exportieren

Ergebnisse als CSV-Datei exportieren – ideal für Analyse oder Weitergabe.

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv('products.csv', index=False)Oder – mit Thunderbit einfach auf „Export zu Google Sheets“ oder „Als CSV herunterladen“ klicken, ganz ohne Code.

Mehr rausholen: Scraping automatisieren und skalieren mit Python & Thunderbit

Wenn du die Grundlagen drauf hast, kannst du deine Scraping-Prozesse automatisieren und ausbauen:

- Paginierung abbilden: In Python per Schleife durch Seiten blättern, in Thunderbit einfach Paginierung aktivieren und die KI übernimmt.

- Subpages scrapen: Mit Python Links folgen oder Thunderbits Subpage-Scraping nutzen, um Datensätze automatisch anzureichern.

- Scraping planen: Mit Pythons

schedule-Bibliothek oder Thunderbits integriertem Scheduler Scrapes regelmäßig ausführen (z.B. tägliche Preisüberwachung). - Datenquellen kombinieren: Daten aus mehreren Seiten zusammenführen – ideal für Wettbewerbsanalysen oder Marktforschung.

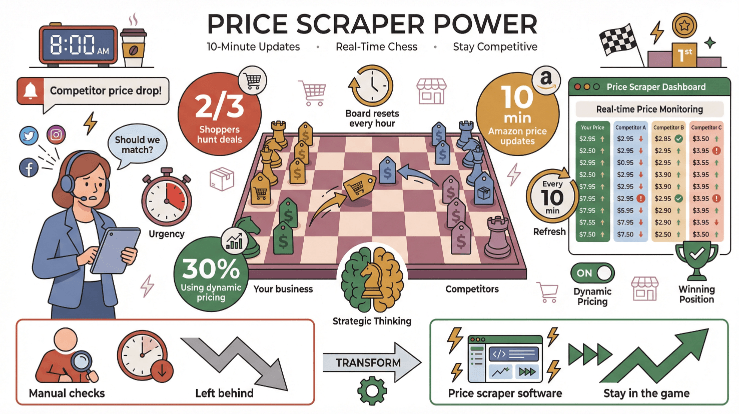

Praxisbeispiel: Ein E-Commerce-Team nutzte Thunderbit, um Preise von Wettbewerbern auf 10 Seiten zu überwachen, plante tägliche Scrapes und exportierte die Daten direkt nach Google Sheets. Das Ergebnis: und deutlich weniger Nachtschichten mit Excel.

Datenethik & Datenschutz: Verantwortungsvolles Scraping mit Python

Mit großer Scraping-Power kommt auch Verantwortung. So bleibst du auf der sicheren Seite:

- robots.txt und Nutzungsbedingungen beachten: Prüfe immer, ob Scraping erlaubt ist. Im Zweifel nachfragen.

- Anfragen begrenzen: Server nicht überlasten – mit Rate Limiting und höflichen Scraping-Praktiken.

- Keine sensiblen Daten: Keine persönlichen oder vertraulichen Infos ohne Einwilligung scrapen. Datenschutzgesetze wie die DSGVO beachten.

- Scraper identifizieren: User-Agent setzen und transparent agieren.

- Opt-Outs respektieren: Wer aus dem Datensatz entfernt werden möchte, sollte umgehend gelöscht werden.

Thunderbit unterstützt dich dabei, indem es Scraping-Geschwindigkeiten drosselt, Login-basiertes Scraping ermöglicht und Tools zur verantwortungsvollen Datenaufbereitung bietet. Mehr dazu in den .

Von Rohdaten zu Insights: So nutzt du gescrapte Daten für Analysen & Machine Learning

Gescrapte Daten sind nur der Anfang. Mit Python und Thunderbit kannst du:

- Daten bereinigen und formatieren: Mit pandas Dubletten entfernen, Tippfehler korrigieren, Formate vereinheitlichen.

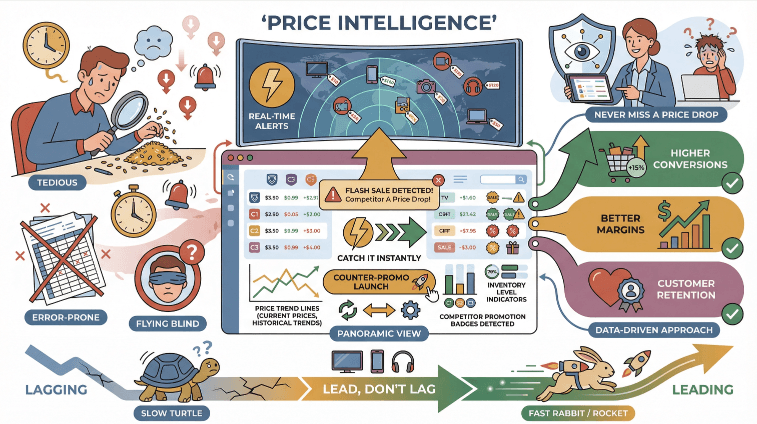

- Trends analysieren: Wettbewerberpreise verfolgen, Stimmungen in Bewertungen auswerten oder Marktveränderungen erkennen.

- Machine-Learning-Modelle bauen: Mit scikit-learn Modelle für Sentiment-Analyse, Preisprognosen oder Kundensegmentierung trainieren.

- Berichte automatisieren: Dashboards oder Benachrichtigungen auf Basis aktueller Webdaten erstellen.

Beispiel: Ein Produktteam sammelte tausende Kundenbewertungen, bereinigte die Daten mit Python und nutzte Thunderbits KI zur Sentiment-Analyse. Das Ergebnis: Wertvolle Erkenntnisse für Produktentwicklung und Marketing.

Fazit & wichtigste Erkenntnisse

Kurz und knapp:

- Python ist die perfekte Sprache fürs Web Scraping – dank einfacher Syntax, starker Bibliotheken und aktiver Community.

- Thunderbit macht Scraping für alle zugänglich – mit KI-gestützten, codefreien Tools, die von Felderkennung bis Subpage-Navigation alles abdecken.

- Die Kombi aus Python und Thunderbit ermöglicht fortgeschrittene Automatisierung – Aufgaben planen, Daten verarbeiten und in Geschäftsprozesse integrieren.

- Immer verantwortungsvoll scrapen: Webseitenregeln, Datenschutz und Ethik beachten.

- Rohdaten in Geschäftswert verwandeln: Nutze deine Daten für Analysen, Berichte oder Machine Learning.

Bereit, dein Datenprojekt aufs nächste Level zu bringen? Probier das Scrapen mit Python – oder, wenn du auf Code verzichten willst, teste die . Weitere Tipps und Anleitungen findest du im .

Häufige Fragen (FAQ)

1. Ist Web Scraping mit Python legal?

Web Scraping ist erlaubt, solange du die Nutzungsbedingungen, robots.txt und Datenschutzgesetze beachtest. Verzichte auf das Scrapen persönlicher oder sensibler Daten ohne Zustimmung.

2. Wie kann ich ohne Programmierkenntnisse eine Website scrapen?

bietet eine codefreie, KI-gestützte Chrome-Erweiterung, mit der du Daten in nur zwei Klicks von jeder Website extrahieren kannst – ganz ohne Programmierung.

3. Welche Python-Bibliothek eignet sich für dynamische Webseiten?

Für Seiten mit JavaScript oder Interaktionen empfiehlt sich . Für statische Seiten reichen meist und .

4. Wie kann ich Web Scraping automatisieren?

Python-Skripte lassen sich mit cronjobs oder Bibliotheken wie schedule zeitgesteuert ausführen. Thunderbit bietet ebenfalls eine integrierte Terminplanung für wiederkehrende Scraping-Aufgaben.

5. Was tun, wenn sich das Layout einer Website ändert?

Klassische Python-Skripte müssen dann angepasst werden. Thunderbits KI erkennt Änderungen automatisch und reduziert so den Wartungsaufwand. Bei Python musst du Selektoren oder Parsing-Logik aktualisieren.

Viel Erfolg beim Scrapen – und mögen deine Daten immer sauber, strukturiert und einsatzbereit sein!

Mehr erfahren