Das Internet quillt über vor Daten – so sehr, dass sie für moderne Unternehmen längst zum Lebenselixier geworden sind. Ob im Vertrieb, im E-Commerce, in der Immobilienbranche oder einfach nur, um die Konkurrenz im Blick zu behalten: Die richtigen Daten sofort griffbereit zu haben, kann den entscheidenden Unterschied machen. Aber ehrlich gesagt will niemand stundenlang Informationen von Websites in Tabellen kopieren und einfügen. Genau hier kommt Web-Scraping ins Spiel, und glauben Sie mir: Es ist viel weniger einschüchternd, als es klingt.

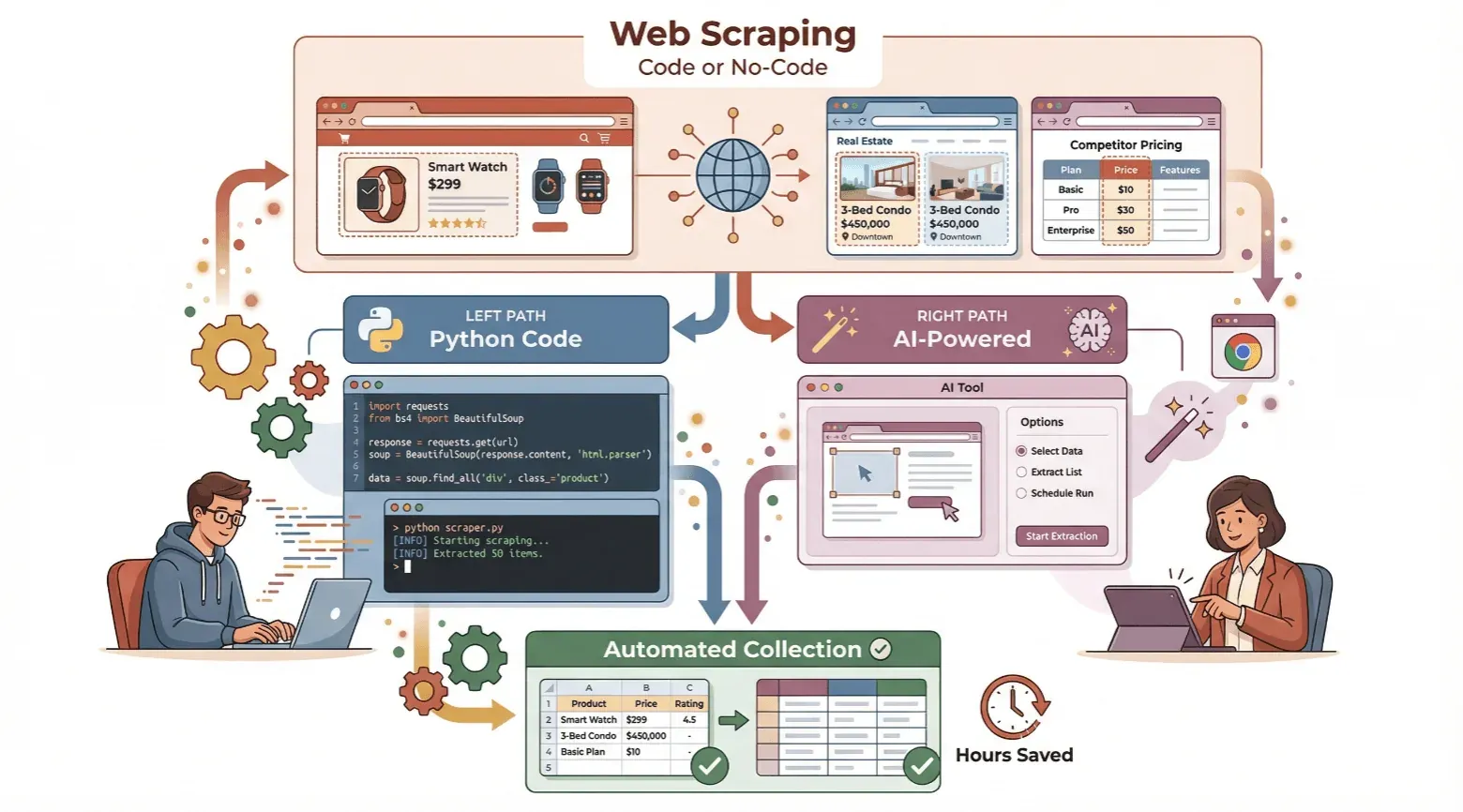

In diesem Leitfaden zeige ich Ihnen, wie Sie einen Web-Scraper erstellen – ganz gleich, ob Sie als Einsteiger Python ausprobieren möchten oder lieber ganz ohne Code mit einem KI-gestützten Tool wie arbeiten wollen. Ich erkläre die Grundlagen, führe Sie Schritt für Schritt durch beide Ansätze und helfe Ihnen dabei, den passenden Weg für Ihre Anforderungen zu finden. Bereit, Zeit zu sparen und die Möglichkeiten automatisierter Datenerfassung zu nutzen? Dann legen wir los.

Was ist ein Web-Scraper? Die Grundlagen verstehen

Ein Web-Scraper ist ganz einfach ein Tool – also Software oder ein Dienst –, das Informationen automatisch von Websites extrahiert. Stellen Sie sich vor, Sie brauchen eine Liste aller Cafés in Ihrer Stadt, inklusive Adressen und Telefonnummern. Sie könnten sich stundenlang durch Seiten klicken und jede Angabe von Hand kopieren (Hallo, Ctrl+C-Müdigkeit), oder Sie lassen einen Web-Scraper die ganze Arbeit für Sie übernehmen.

Ein Web-Scraper ist wie ein digitaler Assistent: Er liest Webseiten, findet die gewünschten Daten – etwa Preise, Produktnamen oder Kontaktdaten – und bringt sie sauber in eine Tabelle oder Datenbank. Statt zwischen Browser-Tabs und Excel hin- und herzuwechseln, automatisiert der Scraper den Prozess und ruft, analysiert und speichert die Daten in einem Bruchteil der Zeit.

So läuft das im Hintergrund ab:

- Anfrage: Der Scraper sendet eine Anfrage an eine Webseite und lädt das rohe HTML herunter.

- Analyse: Er untersucht das HTML, um die gewünschten Daten zu finden, etwa den Preis in einem

<span>-Tag. - Extraktion: Er zieht die Daten heraus und speichert sie in einem strukturierten Format (CSV, Excel, Google Sheets usw.).

Manuelles Kopieren und Einfügen ist, als würde man mit einem Löffel ein Loch graben. Web-Scraping ist, als würde man einen Bagger holen.

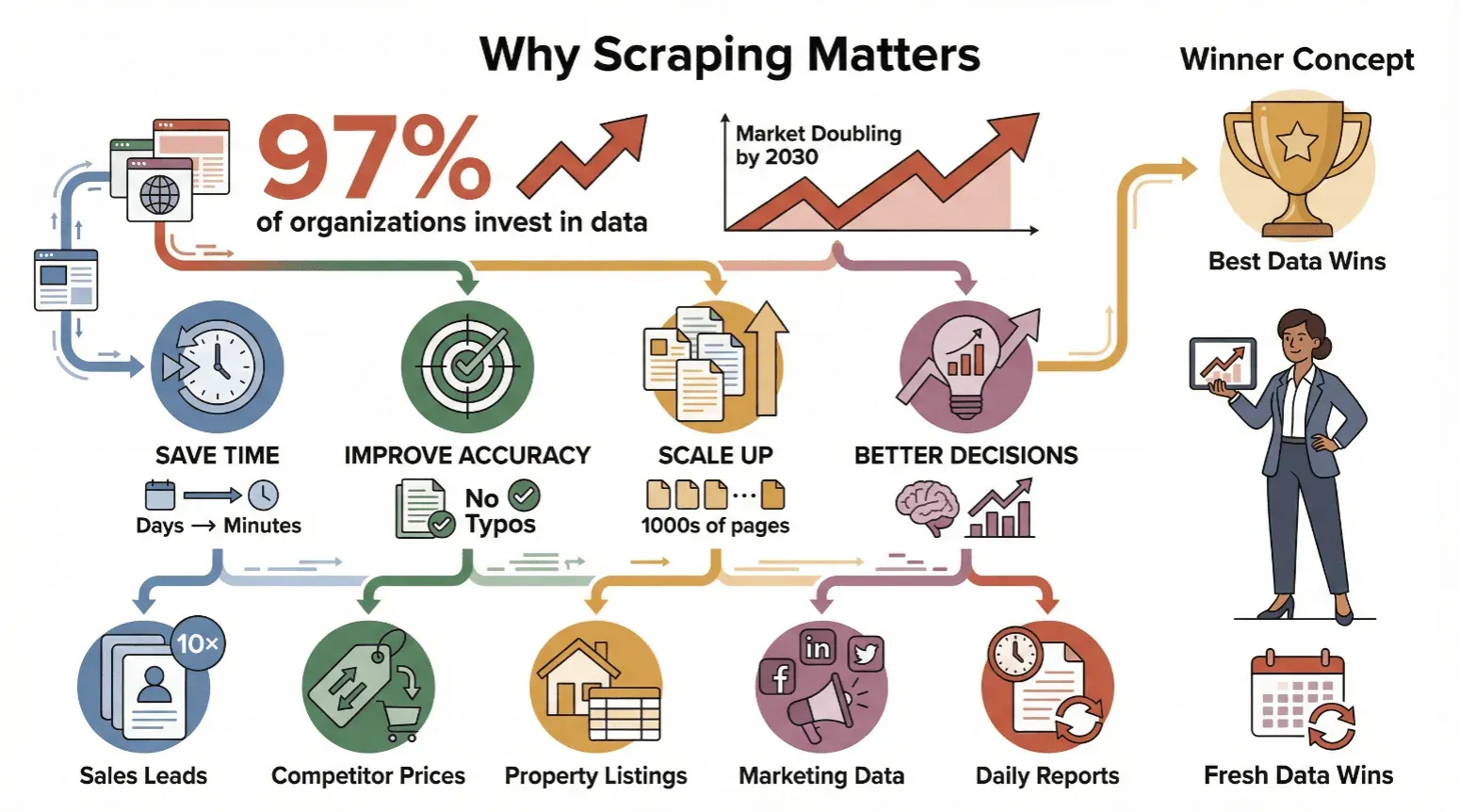

Warum die Erstellung eines Web-Scrapers für Unternehmen wichtig ist

Web-Scraping ist nicht nur etwas für Techies oder Datenwissenschaftler – es ist längst ein Muss für alle, die verlässliche und aktuelle Informationen brauchen. Nahezu setzen inzwischen auf datengetriebene Entscheidungen, und Marktanalysen zum Web-Scraping-Sektor prognostizieren durchgehend weiteres Wachstum bis zum Ende des Jahrzehnts.

Darum setzen Unternehmen jeder Größe auf Web-Scraping:

- Zeit sparen: Automatisches Scraping macht aus Tagen manueller Arbeit nur noch Minuten.

- Genauigkeit verbessern: Software wird nicht müde und macht keine Tippfehler.

- Skalieren: Scrapen Sie Tausende von Seiten statt nur einer Handvoll.

- Bessere Entscheidungen treffen: Aktuelle Daten führen zu klügeren Entscheidungen – ob bei Preisänderungen, Lead-Generierung oder Trendbeobachtung.

Schauen wir uns einige konkrete Anwendungsfälle an:

| Anwendungsfall | Wer profitiert | Typisches Ergebnis |

|---|---|---|

| Vertriebsleads aus Verzeichnissen extrahieren | Vertriebsteams | 10× mehr Leads, stundenlange Zeitersparnis bei der Akquise |

| Konkurrenzpreise auf E-Commerce-Seiten überwachen | E-Commerce-Manager | Preisanpassungen in Echtzeit, Schutz der Gewinnmarge |

| Immobilienangebote zusammenführen | Immobilienagenturen | Schnellere Objektfindung, aktuelle Marktdaten |

| Marketingdaten aus Web- und Social-Media-Kanälen sammeln | Marketingteams | Besser ausgerichtete Kampagnen, verbessertes Performance-Tracking |

| Tägliche Web-Datenberichte automatisieren | Operations, Analysten | Geringere Arbeitskosten, weniger Fehler, konsistente und pünktliche Berichte |

Kurz gesagt: Wer die besten und aktuellsten Daten hat, gewinnt.

Einsteigerleitfaden: So erstellen Sie einen einfachen Web-Scraper mit Python

Wenn Sie neugierig sind, wie Web-Scraping „unter der Haube“ funktioniert, ist Python ein hervorragender Einstieg. Selbst wenn Sie noch nie programmiert haben, können Sie in nur wenigen Schritten einen einfachen Scraper bauen. So geht’s:

Ihre Umgebung einrichten

Zuerst müssen Sie Python auf Ihrem Computer installiert haben. Laden Sie die neueste Version von herunter und folgen Sie den Anweisungen für Ihr Betriebssystem (Windows oder Mac). Achten Sie während der Installation darauf, „Add Python to PATH“ zu aktivieren.

Öffnen Sie dann Ihr Terminal oder die Eingabeaufforderung und installieren Sie die benötigten Bibliotheken:

1pip install requests

2pip install bs4

3pip install pandasrequestshilft Ihnen, Webseiten abzurufen.bs4(Beautiful Soup) hilft Ihnen beim Analysieren von HTML.pandaseignet sich hervorragend, um Daten als CSV oder Excel zu speichern.

Die Struktur der Website untersuchen

Bevor Sie Code schreiben, müssen Sie wissen, wo sich Ihre Daten im HTML befinden. Öffnen Sie Ihre Zielwebsite in Chrome, klicken Sie mit der rechten Maustaste auf die gewünschte Information – zum Beispiel einen Jobtitel – und wählen Sie „Untersuchen“. Das entsprechende HTML-Element wird hervorgehoben, vielleicht ein <a>-Tag mit einer Klasse wie jobtitle. Merken Sie sich diese Tags und Klassen; Sie brauchen sie später, um dem Scraper mitzuteilen, wonach er suchen soll.

Den Scraper schreiben und ausführen

Angenommen, Sie möchten Jobtitel und Firmennamen von einer Jobbörse scrapen. Hier ist ein einfaches Skript:

1import requests

2from bs4 import BeautifulSoup

3import pandas as pd

4URL = "https://example.com/jobs" # Ersetzen Sie dies durch Ihre Ziel-URL

5response = requests.get(URL)

6soup = BeautifulSoup(response.text, 'html.parser')

7# Alle Jobtitel und Firmennamen finden (Selektoren bei Bedarf anpassen)

8titles = [t.get_text().strip() for t in soup.find_all('a', class_='jobtitle')]

9companies = [c.get_text().strip() for c in soup.find_all('div', class_='company')]

10# Als CSV speichern

11df = pd.DataFrame({'Job Title': titles, 'Company': companies})

12df.to_csv('jobs.csv', index=False)

13print("Scraping abgeschlossen! Daten wurden in jobs.csv gespeichert")- Passen Sie URL und Klassennamen an die Zielseite an.

- Führen Sie das Skript im Terminal aus:

python yourscript.py - Öffnen Sie

jobs.csv, um die Ergebnisse zu sehen.

Profi-Tipp: Bei komplexeren Websites mit Paginierung oder dynamischen Inhalten müssen Sie Schleifen hinzufügen oder Tools wie Selenium verwenden. Für viele statische Seiten funktioniert dieser Ansatz jedoch einwandfrei.

Ohne Code: So erstellen Sie mit Thunderbit einen Web-Scraper

Was aber, wenn Sie überhaupt nicht mit Code arbeiten möchten? Genau dafür gibt es – einen No-Code-, KI-gestützten Web-Scraper für Business-Anwender. Bei klar strukturierten Seiten bringt Sie Thunderbit in nur wenigen Klicks von „Ich brauche diese Daten“ zu einer nutzbaren Tabelle – bei anspruchsvolleren Seiten mit Logins, Bot-Schutz oder ungewöhnlichen Layouts braucht es zwar manchmal etwas Feintuning, aber die Einstiegshürde ist deutlich niedriger als beim manuellen Schreiben eines Parsers.

So funktioniert es:

Schritt 1: Thunderbit Chrome-Erweiterung installieren

Rufen Sie die auf und fügen Sie sie Ihrem Browser hinzu. Registrieren Sie sich für ein kostenloses Konto (mit dem Gratis-Tarif können Sie einige Seiten testen).

Schritt 2: Zur Zielwebsite navigieren

Öffnen Sie die Seite, die Sie scrapen möchten, in Chrome. Loggen Sie sich bei Bedarf ein und scrollen Sie nach unten, damit dynamische Inhalte geladen werden.

Schritt 3: Ihre Datenanforderungen beschreiben

Klicken Sie auf das Thunderbit-Symbol, um die Seitenleiste zu öffnen. Sie können entweder:

- auf „KI-Felder vorschlagen“ klicken und Thunderbits KI die Seite scannen und Spalten vorschlagen lassen, etwa „Produktname“, „Preis“ oder „Bild“.

- oder eine Eingabe in einfachem Englisch schreiben, zum Beispiel: „Extrahiere alle Buchtitel und Autoren von dieser Seite“.

Thunderbits KI empfiehlt automatisch Felder und Datentypen. Sie können Felder bei Bedarf umbenennen, hinzufügen oder löschen.

Schritt 4: Ihren ersten Scrape ausführen

Sobald Ihre Felder festgelegt sind, klicken Sie einfach auf „Scrapen“. Thunderbit extrahiert die Daten, behandelt bei Bedarf die Paginierung und zeigt alles in einer übersichtlichen Tabelle an. Wenn Sie mehr Details von Unterseiten möchten – etwa von einzelnen Produktseiten – klicken Sie auf „Unterseiten scrapen“. Thunderbit besucht dann jeden Link und zieht zusätzliche Informationen heraus.

Schritt 5: Ergebnisse prüfen und exportieren

Prüfen Sie Ihre Daten in der Thunderbit-Tabelle. Wenn alles passt, klicken Sie auf „Exportieren“ und wählen Sie das gewünschte Format: Excel, CSV, Google Sheets, Airtable, Notion oder JSON. Exporte sind kostenlos und unbegrenzt.

Das war’s. Kein Code, keine Vorlagen, kein Kopfzerbrechen.

Traditionelle und No-Code-Web-Scraper-Lösungen im Vergleich

Schauen wir uns an, wie die beiden Ansätze abschneiden:

| Lösung | Einrichtungszeit | Benötigte Kenntnisse | Wartung | Flexibilität | Exportoptionen |

|---|---|---|---|---|---|

| Python + Beautiful Soup | Stunden/Tage | Programmierung, HTML-Grundlagen | Hoch (bricht leicht) | Sehr hoch | CSV, Excel, JSON (per Code) |

| Ältere No-Code-Tools | 30–60 Min. | Etwas technisches Wissen | Mittel (manuelle Korrektur) | Gut für statische Seiten | CSV, Excel |

| Thunderbit (KI-No-Code) | Minuten | Keine (einfaches Deutsch) | Gering (KI passt sich an) | Hoch (dynamische Seiten) | Excel, CSV, Sheets, Notion... |

Der KI-gestützte Ansatz von Thunderbit bedeutet: weniger Zeit für Einrichtung und Fehlerbehebung – und mehr Zeit für die tatsächliche Nutzung Ihrer Daten.

Typische Herausforderungen traditioneller Web-Scraper überwinden

Traditionelle Scraper haben ein paar bekannte Schwachstellen:

- Website-Änderungen: Wenn eine Seite ihr Layout aktualisiert, kann Ihr Code brechen. Thunderbits KI passt sich den meisten Änderungen automatisch an, sodass Sie nichts neu programmieren müssen.

- Anti-Bot-Maßnahmen: Viele Seiten blockieren automatisierte Skripte. Thunderbit kann direkt in Ihrem Browser laufen (mit Ihrer Anmeldung/Ihrer Session) oder in der Cloud für mehr Geschwindigkeit.

- Dynamische Inhalte: Seiten mit Infinite Scroll oder „Mehr laden“-Schaltflächen bringen einfache Scraper oft aus dem Konzept. Thunderbits KI verarbeitet automatisches Scrollen und interaktive Elemente standardmäßig.

- Daten hinter Logins: Mit Thunderbits Browser-Modus gilt: Wenn Sie es in Chrome sehen können, können Sie es auch scrapen.

Kurz gesagt: Thunderbit ist dafür gemacht, mit den unordentlichen Realitäten moderner Websites umzugehen – damit Sie es nicht müssen.

Mehr Effizienz: Thunderbits erweiterte Web-Scraping-Funktionen

Thunderbit geht nicht nur darum, Daten zu bekommen – sondern sie schnell, sauber und einsatzbereit zu erhalten. Hier sind einige Funktionen, die ich besonders schätze:

Automatische Paginierung und Unterseiten-Scraping

Müssen Sie Hunderte von Produkten über mehrere Seiten hinweg scrapen? Thunderbit erkennt die Paginierung (Weiter-Buttons, Infinite Scroll) und holt alles in einem Durchgang. Möchten Sie mehr Details von Unterseiten? Klicken Sie auf „Unterseiten scrapen“ und Thunderbit besucht jeden Link und zieht zusätzliche Felder hinein – etwa Verkäuferinformationen oder Produktspezifikationen.

KI-Feldvorschläge und Datenstrukturierung

Thunderbits KI rät nicht nur an Spalten herum – sie versteht den Kontext. Sie kann Spalten benennen, Datentypen zuweisen (Text, Zahl, Bild, E-Mail) und sogar benutzerdefinierte Anweisungen anwenden, etwa „nur Preise über 100 $“ oder „Beschreibungen ins Englische übersetzen“. Sie können Prompts hinzufügen, um Daten zu kategorisieren, zusammenzufassen oder beim Scraping gleich umzuformatieren.

Vorlagen und Sofort-Scraping

Für beliebte Seiten (Amazon, Zillow, Google Maps, Instagram) bietet Thunderbit sofort einsatzbereite Vorlagen – wählen Sie einfach Ihre Seite aus, und alle Felder sind bereits vorkonfiguriert. Keine Einrichtung nötig.

Planung und Automatisierung

Brauchen Sie jeden Tag frische Daten? Richten Sie einen Zeitplan ein („jeden Montag um 9 Uhr“) und Thunderbit scraped automatisch, sodass Ihre Google-Tabelle oder Datenbank aktualisiert wird, ohne dass Sie einen Finger rühren müssen.

Cloud- vs. lokales Scraping

Sie können wählen, ob Scrapes direkt im Browser laufen sollen – ideal für eingeloggte oder interaktive Seiten – oder in der Cloud, wo es für öffentliche Daten schneller ist, bis zu 50 Seiten gleichzeitig.

Thunderbits erweiterte Funktionen machen es zu einer Top-Wahl für Business-Anwender, die zuverlässiges, skalierbares und einfach zu bedienendes Web-Scraping brauchen.

Schritt-für-Schritt-Anleitung: So erstellen Sie mit Thunderbit einen Web-Scraper

Hier ist Ihre Schnellstart-Checkliste:

- Thunderbit installieren: und registrieren.

- Ihre Zielwebsite öffnen: Bei Bedarf einloggen, zum Laden des Inhalts scrollen.

- Thunderbit-Seitenleiste öffnen: Auf das Erweiterungssymbol klicken.

- Ihre Daten beschreiben: Auf „KI-Felder vorschlagen“ klicken oder Ihren Prompt eingeben.

- Felder prüfen: Spalten bei Bedarf umbenennen, hinzufügen oder löschen.

- Auf „Scrapen“ klicken: Thunderbit erledigt den Rest.

- (Optional) Unterseiten scrapen: Für tiefere Daten auf „Unterseiten scrapen“ klicken.

- Ergebnisse prüfen: Die Tabelle auf Korrektheit überprüfen.

- Daten exportieren: Excel, CSV, Google Sheets, Notion, Airtable oder JSON auswählen.

- Speichern/Vorlage/Planung: Ihre Konfiguration für später speichern oder wiederkehrende Scrapes planen.

Tipps zur Fehlerbehebung:

- Wenn Daten fehlen, formulieren Sie Ihren Prompt anders oder verwenden Sie benutzerdefinierte Anweisungen.

- Bei dynamischen Inhalten achten Sie darauf, im Browser-Modus zu sein.

- Wenn Sie das Limit des Gratis-Tarifs erreichen, sollten Sie ein Upgrade für mehr Seiten erwägen.

Fazit und wichtigste Erkenntnisse

Einen Web-Scraper zu erstellen ist längst nicht mehr nur etwas für Programmierer. Ganz gleich, ob Sie selbst Hand anlegen und Python schreiben möchten oder lieber die KI die schwere Arbeit erledigen lassen: Die Werkzeuge sind heute so zugänglich wie nie zuvor.

Das sollten Sie mitnehmen:

- Web-Scraping spart Zeit, erhöht die Genauigkeit und ermöglicht datengetriebene Entscheidungen.

- Python ist ideal zum Lernen und für individuelle Projekte, erfordert aber Programmierung und Wartung.

- Thunderbit bietet eine schnelle No-Code-Lösung – einfach beschreiben, was Sie möchten, und auf „Scrapen“ klicken.

- Erweiterte Funktionen wie automatische Paginierung, Unterseiten-Scraping und KI-Feldvorschläge machen Thunderbit zu einem Kraftpaket für Business-Anwender.

- Sie können Thunderbit kostenlos testen und innerhalb weniger Minuten Ergebnisse sehen.

Bereit, mit dem Kopieren und Einfügen aufzuhören und mit der Automatisierung zu beginnen? und sehen Sie selbst, wie einfach Web-Scraping sein kann. Und wenn Sie tiefer einsteigen möchten, besuchen Sie den für weitere Anleitungen und Tipps.

FAQs

1. Muss ich programmieren können, um einen Web-Scraper zu erstellen?

Nein! Auch wenn Programmierung (wie Python + Beautiful Soup) Ihnen volle Kontrolle gibt, ermöglichen No-Code-Tools wie Thunderbit jedem, leistungsstarke Web-Scraper mit einfachen Prompts auf Deutsch und nur wenigen Klicks zu erstellen.

2. Welche Art von Daten kann ich mit Thunderbit scrapen?

Thunderbit kann Text, Zahlen, Bilder, E-Mails, Telefonnummern und mehr von fast jeder Website extrahieren – einschließlich paginierter Listen und Unterseiten. Für beliebte Seiten können Sie außerdem Vorlagen nutzen.

3. Wie geht Thunderbit mit Websites um, die ihr Layout ändern?

Thunderbits KI passt sich den meisten Layoutänderungen automatisch an. Im Gegensatz zu traditionellen Scrapern, die nach einem Update der Seite ausfallen, nutzt Thunderbit semantisches Verständnis und arbeitet mit minimalen Anpassungen weiter.

4. Ist Web-Scraping legal und sicher?

Web-Scraping ist legal, wenn Sie öffentlich verfügbare Daten sammeln und die Nutzungsbedingungen einer Website respektieren. Thunderbit setzt auf verantwortungsvolle Nutzung und bietet Funktionen, die Ihnen helfen, konform zu bleiben.

5. Kann ich wiederkehrende Scrapes planen oder Exporte automatisieren?

Ja! Thunderbit ermöglicht es Ihnen, Scrapes in jedem beliebigen Intervall zu planen – täglich, wöchentlich usw. – und Ergebnisse direkt nach Google Sheets, Notion, Airtable, Excel oder CSV zu exportieren, ganz ohne manuelle Arbeit.

Bereit, Ihre Datenerfassung zu automatisieren? und erleben Sie, wie einfach Web-Scraping für alle sein kann.

Mehr erfahren