Daten sind heute das Herzstück jeder modernen Wirtschaft – und immer mehr Unternehmen wollen aus den riesigen Rohdatenmengen im Netz echte Mehrwerte ziehen. Ich habe selbst erlebt, wie ein erfahrener Data Scraping Spezialist die Entscheidungswege verkürzen, Marktforschung auf ein neues Level heben und der Konkurrenz einen echten Vorsprung verschaffen kann. Aber: Die Suche nach dem richtigen Profi ist alles andere als ein Spaziergang. Die Nachfrage nach Top-Fachkräften ist so hoch wie nie, und ob du am Ende saubere, rechtssichere und wirklich nutzbare Daten bekommst – oder nur Datenmüll –, hängt oft an der Qualität deiner Einstellung.

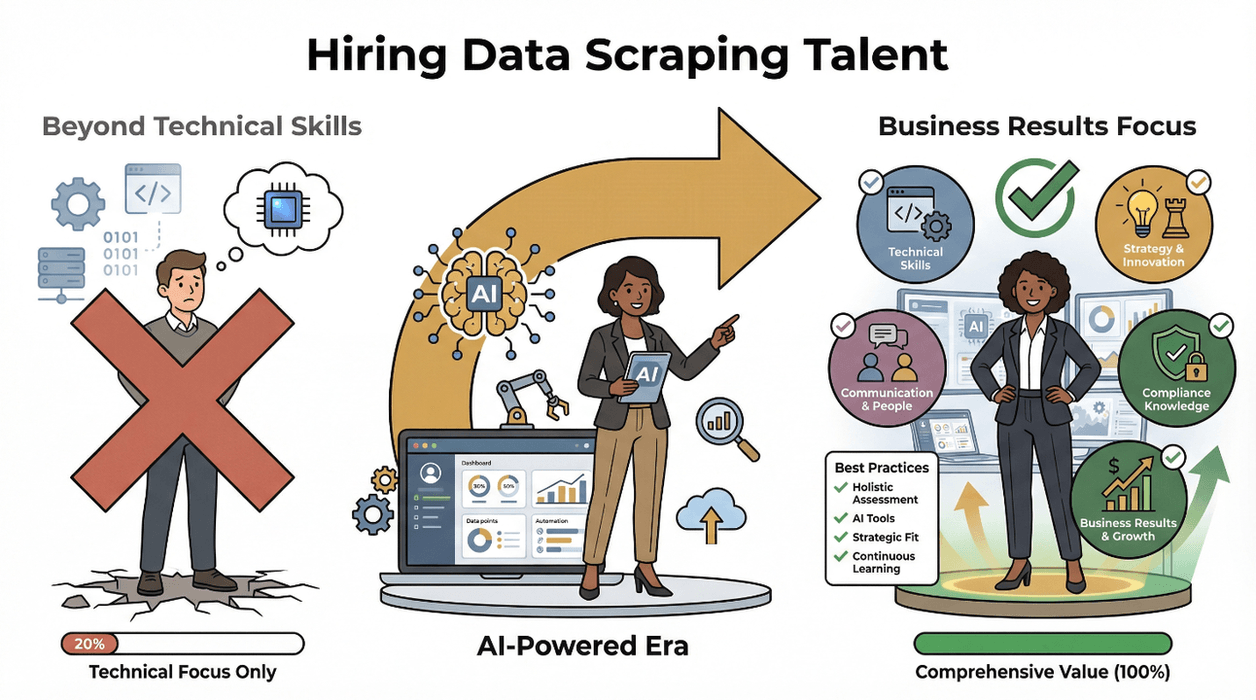

Wenn du gerade auf der Jagd nach Data Scraping Spezialisten bist, bist du definitiv nicht allein. Der globale Markt für Web-Scraper boomt – Unternehmen aus allen Branchen setzen auf kontinuierlich gewonnene Daten, um im Wettbewerb nicht abgehängt zu werden (). Doch mit dem technischen Fortschritt – vor allem durch KI-gestützte Plattformen wie – und immer strengeren Compliance-Regeln reicht reines Technik-Know-how längst nicht mehr. Hier kommen die wichtigsten Best Practices, die ich (manchmal auch auf die harte Tour) beim Recruiting von Data Scraping Talenten gelernt habe – damit dein Unternehmen wirklich nach vorne kommt.

Klare Anforderungen definieren, bevor du jemanden einstellst

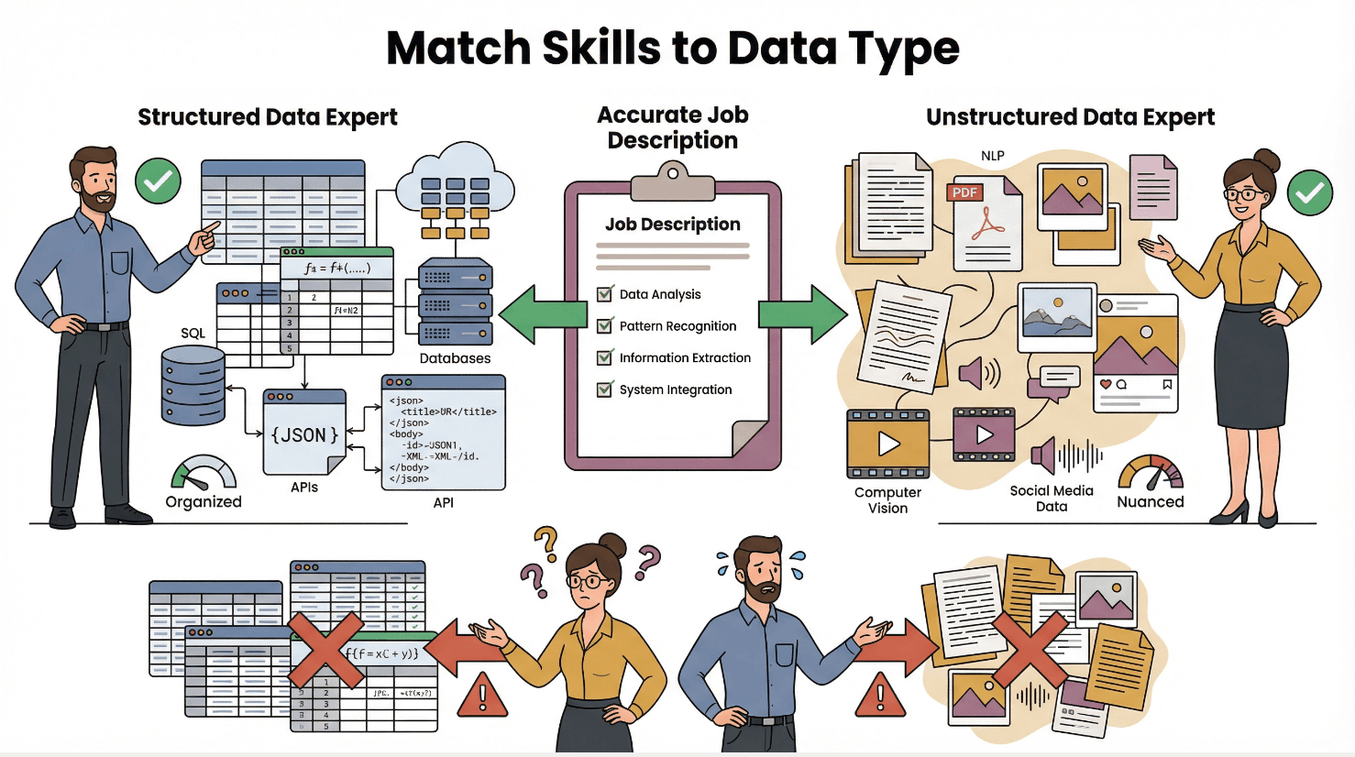

Bevor du überhaupt eine Stellenanzeige schaltest, solltest du dir ehrlich die Frage stellen: Was genau wollen wir eigentlich scrapen – und warum? Viele Projekte scheitern, weil das Team diese Frage nicht sauber beantworten kann. Geht es um strukturierte Daten (wie übersichtliche Preistabellen) oder um unstrukturierte Infos (zum Beispiel Bewertungen, Bilder oder Fließtext)? Brauchst du einen einmaligen Datenexport oder regelmäßige, automatisierte Abfragen?

Je genauer du deine Anforderungen kennst, desto besser kannst du Unternehmensziele und technische Anforderungen abgleichen – und der Einstellungsprozess läuft viel zielgerichteter. Das Scrapen von Produktdaten aus Onlineshops ist zum Beispiel eine ganz andere Baustelle als das Extrahieren von Stimmungen aus Social Media oder das Auslesen von juristischen PDFs.

Die Profis unter den Unternehmen starten mit einer detaillierten Bedarfsanalyse – sie listen Ziel-Websites, relevante Datenfelder, Aktualisierungsfrequenz und Compliance-Vorgaben auf, bevor sie überhaupt Bewerbungen sichten (). Diese Klarheit sorgt dafür, dass du wirklich die Kandidaten anziehst, die zu deinem Projekt passen – und nicht nur Leute, die irgendein Skript ausführen können.

Strukturierte vs. unstrukturierte Daten: Was steckt dahinter?

Hier die wichtigsten Unterschiede:

- Strukturierte Daten sind ordentlich und vorhersehbar – zum Beispiel Tabellen, Datenbanken oder Listen. Typische Beispiele: Produktkataloge, Aktienkurse oder Adressverzeichnisse. Das Scrapen solcher Daten ist meist unkomplizierter, und Tools wie Thunderbit verwandeln Web-Tabellen blitzschnell in nutzbare Excel-Tabellen ().

- Unstrukturierte Daten sind wild und schwer vorhersehbar – dazu zählen Blogartikel, Bilder, PDFs oder Nutzerbewertungen. Hier braucht es oft fortgeschrittene Methoden wie KI-gestützte Analyse, Natural Language Processing oder Bilderkennung ().

Die Komplexität deiner Daten bestimmt, welches Skillset dein Wunschkandidat mitbringen muss. Wer fit bei strukturierten Daten ist, ist nicht automatisch ein Ass bei unstrukturierten Quellen – und umgekehrt. Deine Stellenanzeige sollte die echten Herausforderungen deines Projekts widerspiegeln.

Die Komplexität deiner Daten bestimmt, welches Skillset dein Wunschkandidat mitbringen muss. Wer fit bei strukturierten Daten ist, ist nicht automatisch ein Ass bei unstrukturierten Quellen – und umgekehrt. Deine Stellenanzeige sollte die echten Herausforderungen deines Projekts widerspiegeln.

Die Skills der Kandidaten auf deine Anforderungen abstimmen

Sobald du weißt, was du brauchst, kannst du gezielt nach den passenden Fähigkeiten suchen. Worauf ich immer achte:

- Technisches Know-how: Erfahrung mit verschiedenen Scraping-Tools (von Code-basiert bis No-Code), Kenntnisse in HTML/CSS/JavaScript, Umgang mit Anti-Bot-Technologien und Datenbereinigung ().

- Problemlösung: Können sie auf plötzliche Website-Änderungen, CAPTCHAs oder wechselnde Anforderungen reagieren?

- Genauigkeit: Es geht nicht nur ums Datensammeln, sondern um die richtige Information im passenden Format – jedes Mal.

- Soft Skills: Kommunikation, Eigenständigkeit und Anpassungsfähigkeit. Data Scraping Projekte brauchen oft Abstimmung mit anderen Teams, schnelle Richtungswechsel und Geduld.

Die besten Kandidaten bringen Erfahrung mit, die genau zu deinen Herausforderungen passt. Wenn du zum Beispiel Seiten mit starken Anti-Bot-Maßnahmen scrapen willst, such nach Spezialisten, die sich mit Proxies, Browser-Automatisierung oder KI-gestützten Tools auskennen.

Erfahrung mit modernen Tools (Thunderbit & Co.) bewerten

Mit dem Siegeszug von KI-basierten No-Code-Tools wie hat sich das Spielfeld verändert. Es zählt nicht mehr nur, wer den elegantesten Python-Code schreibt – sondern wer schnell, zuverlässig und skalierbar Ergebnisse liefert.

Thunderbit macht es zum Beispiel möglich, Anforderungen einfach in natürlicher Sprache zu beschreiben, per Klick „AI Suggest Fields“ zu nutzen und die KI den Rest erledigen zu lassen. Gerade für nicht-technische Teams oder mehrsprachige Projekte ist das ein echter Gamechanger (). Im Gespräch frage ich immer nach Erfahrungen mit Tools wie Thunderbit und wie sie damit echte Probleme gelöst haben.

Erfahrung mit KI-gestützten Tools ist ein dickes Plus: Sie zeigt, dass der Spezialist sich schnell auf neue Websites einstellen, komplexe oder dynamische Inhalte verarbeiten und den Wartungsaufwand gering halten kann (). Außerdem ist das ein Zeichen, dass der Kandidat am Puls der Zeit bleibt.

Technische Skills und Problemlösung in der Praxis testen

Technisches Know-how ist Pflicht – aber wie prüfst du das am besten? Ich setze auf praktische Tests und Portfolio-Reviews. Lass dir ein aktuelles Projekt erklären: Was war das Ziel? Welche Hürden gab es? Wie wurden Anti-Bot-Maßnahmen oder Datenbereinigung gelöst?

Gib auch mal eine praxisnahe Aufgabe: „Extrahiere Produktnamen, Preise und Bilder von dieser E-Commerce-Seite, inklusive Paginierung und Unterseiten.“ Extrapunkte gibt’s, wenn der Kandidat das sowohl per Code als auch mit einem No-Code-Tool wie Thunderbit lösen kann.

Achte auf Kandidaten, die ihren Ansatz klar erklären, ihre Arbeit dokumentieren und flexibel reagieren, wenn mal was schiefgeht. Die besten Spezialisten sehen Scraping als laufenden Prozess, nicht als einmalige Aufgabe ().

Teste Anti-Bot- und Deep-Scraping-Skills

Websites werden immer besser darin, Scraper zu blockieren – dein Spezialist muss also immer einen Schritt voraus sein. Frag im Interview nach Erfahrungen mit:

- Anti-Bot-Technologien: Wie gehen sie mit CAPTCHAs, IP-Sperren oder User-Agent-Erkennung um? Haben sie Browser-Automatisierung oder Premium-Proxies eingesetzt ()?

- Deep-Link-Scraping: Können sie Daten nicht nur von Übersichtsseiten, sondern auch von Detailseiten, Unterseiten oder sogar aus PDFs und Bildern extrahieren?

- Anpassungsfähigkeit: Was machen sie, wenn sich das Layout einer Website über Nacht ändert?

Ein guter Praxistest könnte das Scrapen einer Seite mit einfachen Anti-Bot-Maßnahmen oder das Anreichern einer Tabelle durch Unterseitenbesuche sein – etwas, das Thunderbit mit seiner Subpage-Scraping-Funktion besonders elegant löst.

Erfahrung mit KI- und No-Code-Scraping-Tools bevorzugen

Die Zeiten, in denen nur individuelle Skripte zum Einsatz kamen, sind vorbei. KI-gestützte und No-Code-Tools machen Data Scraping für viel mehr Leute zugänglich – und Spezialisten, die diese Plattformen beherrschen, liefern schneller und mit weniger Wartung Ergebnisse.

Thunderbit bietet zum Beispiel:

- AI Suggest Fields: Die KI erkennt relevante Felder und schlägt automatisch Spalten vor – ganz ohne manuelle Konfiguration.

- Subpage-Scraping: Automatisches Besuchen und Auslesen von Unterseiten zur Datenanreicherung.

- Mehrsprachigkeit: Scraping in 34 Sprachen – perfekt für internationale Projekte.

- Sofortiger Datenexport: Ergebnisse direkt nach Excel, Google Sheets, Notion oder Airtable exportieren.

Achte bei der Auswahl darauf, dass Kandidaten diese Features sicher beherrschen. Bitte sie, ein Projekt zu beschreiben, bei dem sie Thunderbit (oder ein ähnliches Tool) für eine komplexe Scraping-Aufgabe eingesetzt haben – oder lass sie im Interview eine Live-Demo machen.

Thunderbit als Maßstab: Worauf solltest du achten?

Diese Thunderbit-Skills zeigen echtes Expertenwissen:

- Individuelle KI-Anweisungen: Können sie Field AI Prompts nutzen, um Daten präzise zu extrahieren und zu beschriften?

- Subpage- und Paginierungs-Scraping: Haben sie mit Thunderbit mehrstufige Datenextraktion umgesetzt?

- Datenexport und Integration: Sind sie fit im Export und in der Aufbereitung für verschiedene Plattformen?

- Lernbereitschaft: Bleiben sie bei neuen Thunderbit-Features und Updates am Ball?

Beispielfragen fürs Interview:

- „Beschreiben Sie, wie Sie mit Thunderbits Subpage-Scraping ein Dataset angereichert haben. Welche Herausforderungen gab es?“

- „Wie nutzen Sie AI Suggest Fields, um Ihren Workflow zu beschleunigen?“

- „Haben Sie schon einmal Field AI Prompts für eine besonders knifflige Extraktion angepasst?“

Rechtliche und ethische Aspekte beim Data Scraping nicht vergessen

Das ist ein absolutes Muss. Nur weil Daten im Web sichtbar sind, heißt das nicht, dass du sie einfach nutzen darfst (). Achte bei der Auswahl darauf, dass Kandidaten die rechtlichen und ethischen Rahmenbedingungen kennen.

Wichtige Regelungen:

- GDPR (Europa): Schutz personenbezogener Daten und Privatsphäre ().

- CCPA (Kalifornien): Regelt die Erhebung personenbezogener Daten von Kaliforniern ().

- Urheber- und Datenbankrechte: Das Scrapen urheberrechtlich geschützter oder proprietärer Daten kann illegal sein, auch wenn sie öffentlich zugänglich sind ().

- Nutzungsbedingungen: Viele Websites verbieten Scraping explizit in ihren AGBs ().

Aktuelle Gerichtsurteile sind zwar oft pro Scraping öffentlicher Daten, aber die Rechtslage entwickelt sich ständig weiter (). Ein guter Spezialist kennt die Fallstricke und entwickelt rechtssichere, ethische Lösungen.

Compliance-Bewusstsein im Interview abklopfen

Frag im Gespräch gezielt nach:

- „Wie stellen Sie sicher, dass Ihre Scraping-Projekte mit GDPR oder CCPA konform sind?“

- „Welche Maßnahmen ergreifen Sie, um urheberrechtlich geschützte oder sensible Daten zu vermeiden?“

- „Wie gehen Sie mit Websites um, die Scraping in ihren Nutzungsbedingungen untersagen?“

Warnsignale sind ausweichende Antworten, fehlendes Wissen zu Datenschutzgesetzen oder eine gleichgültige Haltung zu Ethik. Du brauchst jemanden, der Compliance als festen Bestandteil seiner Arbeit sieht.

Fördere eine Lernkultur und Anpassungsfähigkeit

Web Scraping ist ein Feld, das sich ständig verändert. Websites ändern sich, Anti-Bot-Maßnahmen werden immer raffinierter, neue Tools tauchen auf. Die besten Spezialisten sind die, die nie aufhören zu lernen.

Achte bei der Auswahl auf Hinweise auf kontinuierliche Weiterbildung:

- Folgen sie Branchenblogs oder sind sie in Scraping-Communities aktiv?

- Testen sie regelmäßig neue Tools oder Features, wie die neuesten Thunderbit-Updates?

- Können sie beschreiben, wie sie ihren Workflow an neue Vorschriften oder Technologien angepasst haben?

Ermutige dein Team, sich mit Thunderbits Feature-Releases auseinanderzusetzen, Webinare zu besuchen oder bei Open-Source-Projekten mitzumachen. Eine Lernkultur zahlt sich aus – in Effizienz, Datenqualität und Compliance.

Thunderbits neueste Features für kontinuierliche Verbesserung nutzen

Thunderbit bringt ständig neue Funktionen – wie geplantes Scraping, KI-gestützte Feldvorschläge und Mehrsprachigkeit. Spezialisten, die diese Neuerungen schnell adaptieren, liefern bessere Ergebnisse in kürzerer Zeit.

Mit Thunderbits geplantem Scraping kannst du regelmäßige Datenabfragen automatisieren – deine Datensätze bleiben immer aktuell. Wer Field AI Prompts beherrscht, extrahiert und beschriftet auch komplexe Daten mit minimalem Aufwand.

Wer proaktiv neue Features testet und sich weiterbildet, ist ein echter Gewinn – und sorgt dafür, dass deine Datenpipeline auch bei Veränderungen reibungslos läuft.

Soft Skills nicht unterschätzen: Kommunikation, Eigenständigkeit, Problemlösung

Technische Skills sind wichtig – aber Soft Skills machen einen Data Scraping Spezialisten erst richtig wertvoll. Worauf ich achte:

- Klare Kommunikation: Können sie technische Themen verständlich erklären?

- Eigenständigkeit: Arbeiten sie selbstständig und treffen Entscheidungen?

- Beharrlichkeit: Geben sie bei Problemen nicht auf, sondern suchen Lösungen?

- Flexibilität: Können sie sich schnell auf neue Anforderungen oder Website-Änderungen einstellen?

Ein Praxisbeispiel: Ich habe mit einem Spezialisten gearbeitet, der nicht nur saubere Daten geliefert hat, sondern auch auf Compliance-Risiken hingewiesen und Prozessverbesserungen vorgeschlagen hat. Solche Eigeninitiative ist Gold wert.

Mit einer klaren, gezielten Stellenanzeige Top-Talente gewinnen

Eine erfolgreiche Einstellung startet mit einer präzisen Jobbeschreibung. Sei konkret bei Anforderungen, benötigten Skills und Compliance-Erwartungen. Hier eine Checkliste:

- Rollenbeschreibung: Welche Daten werden extrahiert? Welche Tools kommen zum Einsatz?

- Erforderliche Fähigkeiten: Technische (z. B. Thunderbit, Python, Anti-Bot-Techniken) und Soft Skills (Kommunikation, Eigenständigkeit).

- Compliance-Hinweise: Betone die Bedeutung von rechtssicherem und ethischem Data Scraping.

- Lernbereitschaft: Hebe die Bedeutung von Weiterbildung und Tool-Kompetenz hervor.

Formuliere die Anzeige so, dass sie Kandidaten mit technischem und unternehmerischem Denken anspricht. Die Erwähnung von Thunderbit- oder KI-Tool-Erfahrung zieht innovative Spezialisten an.

Muster-Jobbeschreibung

Hier eine Vorlage, die du nach Bedarf anpassen kannst:

| Stellenbezeichnung | Data Scraping Spezialist |

|---|---|

| Über uns | Wir sind ein datengetriebenes Unternehmen und suchen einen talentierten Data Scraping Spezialisten, der uns dabei unterstützt, hochwertige Webdaten für Business Insights zu extrahieren, zu bereinigen und bereitzustellen. Sie arbeiten mit modernen Tools wie Thunderbit, um unsere Datenerfassung zu automatisieren und zu optimieren. |

| Aufgaben | - Planung und Umsetzung von Data Scraping Projekten (strukturierte und unstrukturierte Daten) - Effiziente Datenerfassung mit KI-basierten Tools (Thunderbit etc.) - Umgang mit Anti-Bot-Maßnahmen, Paginierung und Subpage-Scraping - Sicherstellung der rechtlichen und ethischen Compliance (GDPR, CCPA, Urheberrecht, AGBs) - Datenbereinigung, Strukturierung und Export nach Excel, Google Sheets, Notion oder Airtable - Kommunikation von Ergebnissen und Empfehlungen an Fachbereiche - Aktuell bleiben bei neuen Scraping-Tools und Best Practices |

| Anforderungen | - Nachweisbare Erfahrung im Data Scraping (Portfolio oder Projektbeispiele erforderlich) - Vertrautheit mit KI-/No-Code-Tools wie Thunderbit - Ausgeprägte Problemlösungs- und Kommunikationsfähigkeiten - Verständnis für Datenschutz und Compliance - Bereitschaft zur kontinuierlichen Weiterbildung |

| Wünschenswert | - Erfahrung mit mehrsprachigen Scraping-Projekten - Kenntnisse in Field AI Prompts und individueller Datenbeschriftung - Engagement in Web-Scraping-Communities oder Open-Source-Projekten |

Interview- und Assessment-Tipps

Das Interviewen von Data Scraping Spezialisten ist eine Mischung aus Fachwissen und Bauchgefühl. Was sich bewährt hat:

- Technischer Test: Gib eine praxisnahe Scraping-Aufgabe – am besten mit Code und einem No-Code-Tool wie Thunderbit.

- Portfolio-Review: Lass dir frühere Projekte, Codebeispiele oder Fallstudien zeigen.

- Verhaltensinterview: Prüfe Soft Skills wie Kommunikation, Eigenständigkeit und Anpassungsfähigkeit.

- Compliance-Check: Teste das Wissen zu rechtlichen und ethischen Fragen mit Szenarien.

- Remote-Assessment: Nutze Screensharing für Live-Demos oder gib klar definierte Aufgaben für zu Hause.

Ein ausgewogener Mix aus technischen, praktischen und sozialen Assessments hilft dir, einen echten Datenpartner zu finden – nicht nur einen Scraper.

Fazit: So findest du die besten Data Scraping Spezialisten

Die richtige Person fürs Data Scraping zu finden, heißt mehr als nur Technik abfragen. Es geht darum, deine Geschäftsziele mit den passenden Skills, Tools und ethischen Standards zu verbinden. Definiere deine Anforderungen klar, such nach Spezialisten, die sowohl strukturierte als auch unstrukturierte Daten beherrschen, und setze auf Erfahrung mit modernen, KI-basierten Plattformen wie Thunderbit. Vergiss nicht, auf Compliance-Bewusstsein und Lernbereitschaft zu achten – denn wer stehen bleibt, fällt in diesem Bereich schnell zurück.

Das Ergebnis? Saubere, verwertbare Daten, die zu besseren Entscheidungen, schnellerer Umsetzung und echtem Wettbewerbsvorteil führen. Bereit für den nächsten Schritt? Probier die aus oder stöbere im für noch mehr Tipps zum Aufbau deines Datenteams.

FAQs

1. Was ist der Unterschied zwischen strukturierten und unstrukturierten Daten beim Web-Scraper?

Strukturierte Daten sind geordnet und leicht auswertbar (z. B. Tabellen, Datenbanken). Unstrukturierte Daten sind unübersichtlich (z. B. Texte, Bilder, PDFs) und brauchen fortgeschrittene Methoden zur Verarbeitung ().

2. Warum ist Erfahrung mit Tools wie Thunderbit bei der Einstellung von Data Scraping Spezialisten wichtig?

KI-basierte Tools wie Thunderbit ermöglichen eine schnellere und zuverlässigere Datenerfassung – besonders für nicht-technische Nutzer oder mehrsprachige Projekte. Spezialisten, die diese Tools beherrschen, liefern mit weniger Aufwand und Wartung bessere Ergebnisse ().

3. Wie kann ich die technische Kompetenz eines Kandidaten im Data Scraping prüfen?

Setze auf praktische Tests, Portfolio-Reviews und szenariobasierte Fragen. Lass Kandidaten eine reale Scraping-Aufgabe lösen, Anti-Bot-Maßnahmen umgehen oder ein Dataset mit Subpage-Scraping anreichern.

4. Welche rechtlichen und ethischen Aspekte sind bei der Einstellung eines Data Scraping Spezialisten zu beachten?

Achte darauf, dass Kandidaten GDPR, CCPA, Urheberrecht und Website-AGBs kennen. Verantwortungsvolles Scraping heißt, Datenschutz, geistiges Eigentum und Compliance zu respektieren ().

5. Wie fördere ich kontinuierliches Lernen im Data Scraping Team?

Schaffe eine Lernkultur – ermutige dein Team, Branchenblogs zu verfolgen, neue Tools wie Thunderbit zu testen und sich in Communities auszutauschen. Kontinuierliche Weiterbildung sorgt für bessere Datenqualität und nachhaltigen Erfolg.

Bereit, dein Traum-Datenteam aufzubauen? Starte mit klaren Anforderungen, setze auf Skills und Mindset – und lass die Daten (und Thunderbit) für dich arbeiten.

Mehr erfahren