Ich will ehrlich sein: Als ich zum ersten Mal versucht habe, alle URLs von einer großen Website zu ziehen, dachte ich: „Wie schwer kann das schon sein?“ Ein paar Stunden später klickte ich mich immer noch durch endlose Seiten, kopierte Links in eine Tabellenkalkulation und stellte meine Lebensentscheidungen infrage. Wenn du schon einmal versucht hast, alle Seiten einer Website zu finden — ob für ein Content-Audit, eine Lead-Liste oder Wettbewerbsrecherche — kennst du den Schmerz. Es ist mühsam, fehleranfällig und ganz ehrlich: eine Verschwendung deiner Zeit und Talente.

Die gute Nachricht: Du musst es heute nicht mehr auf die harte Tour machen. KI-gestützte Tools wie verändern das Spiel für Business-Anwender und machen es möglich, alle URLs einer Domain zu finden — in Minuten statt in Tagen. Unternehmen, die KI-gestützte Web-Scraper nutzen, berichten laut einer Studie von bei Datenerfassungsaufgaben, und manche sparen sogar bis zu im Vergleich zu manuellen Methoden. Das ist nicht nur eine Statistik — das sind Stunden (oder Tage) deines Lebens, die du zurückbekommst.

Schauen wir uns also an, warum es so schwierig ist, alle Seiten einer Website zu finden, warum allgemeine KI-Modelle wie GPT oder Claude dabei kaum helfen, und wie spezialisierte KI-Agenten — wie Thunderbit — diesen Prozess zum Kinderspiel machen. Und ja: Ich zeige dir die genauen Schritte, um jede URL zu extrahieren, die du brauchst, auch wenn du kein Entwickler bist.

Warum es so schwierig ist, alle URLs einer Domain zu finden

Seien wir ehrlich: Websites sind nicht dafür gemacht, dir eine saubere Liste aller enthaltenen Seiten zu geben. Sie sind für Besucher gebaut, nicht für Menschen, die auf einmal alle Seiten einer Website finden wollen. Deshalb ist diese Aufgabe so nervig:

- Manuelles Kopieren und Einfügen bis zum Wahnsinn: Sich durch jedes Menü, jede Liste und jedes Verzeichnis zu klicken, URLs einzeln zu kopieren und in eine Tabelle einzufügen, ist ein Rezept für Sehnenscheidenentzündung — und dafür, die Hälfte der Seiten zu verpassen.

- Pagination und Infinite Scroll: Viele Seiten verteilen Inhalte auf mehrere Seiten oder laden beim Scrollen weitere Ergebnisse nach. Ein „Weiter“-Button übersehen oder nicht weit genug scrollen, und ganze Bereiche gehen verloren.

- Uneinheitliche Seitenstrukturen: Manche Seiten listen Links in einem Format auf, andere in einem völlig anderen Layout. Da den Überblick zu behalten, ist ein Albtraum.

- Versteckte oder verwaiste Seiten: Nicht jede Seite ist über die Hauptnavigation verlinkt. Manche sind tief vergraben und nur über Sitemaps oder die interne Suche erreichbar.

- Menschliche Fehler: Je mehr Seiten du kopieren musst, desto eher passieren Fehler — doppelte URLs, Tippfehler oder einfach ausgelassene Einträge.

Und wenn du an einer Website mit Hunderten oder Tausenden von Seiten arbeitest? Dann kannst du manuelles Extrahieren vergessen. Es skaliert einfach nicht. Wie ein Datenteam es formulierte: Alles, was über triviale Fälle hinausgeht, .

Was bedeutet es eigentlich, „alle Seiten einer Website zu finden“?

Bevor wir zu Lösungen springen, sollten wir kurz klären, worum es eigentlich geht.

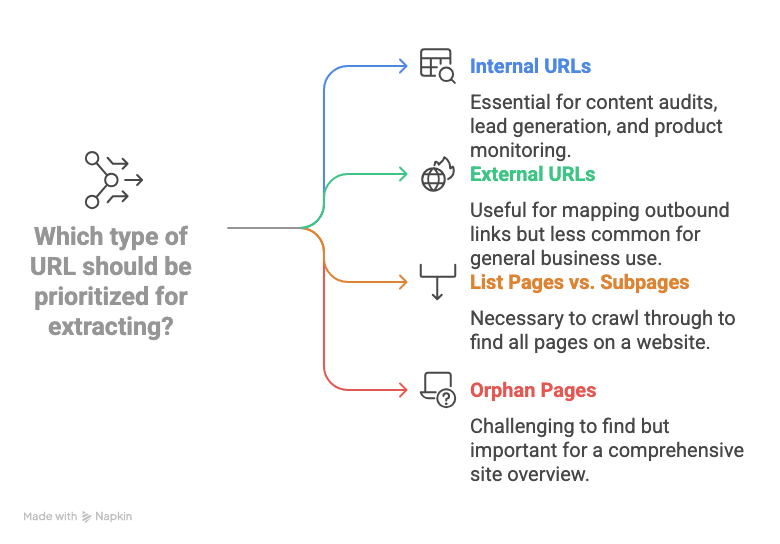

- Interne URLs: Das sind Links zu Seiten derselben Domain (z. B. /about-us oder /products/widget-123). Für die meisten Business-Anwendungsfälle — Content-Audits, Lead-Generierung, Produkt-Monitoring — sind interne URLs das eigentliche Ziel.

- Externe URLs: Links, die auf andere Websites führen. Die brauchst du normalerweise nur, wenn du ausgehende Links analysierst.

- Listen-Seiten vs. Unterseiten: Viele Websites haben „Hub“- oder „Listen“-Seiten (z. B. Kategorieseiten, Blog-Archive, Verzeichnisse), die auf Detailseiten verlinken — etwa Produkt- oder Profilseiten. Um wirklich alle Seiten einer Website zu finden, musst du diese Listen durchgehen und jede verlinkte Unterseite erfassen.

- Verwaiste Seiten: Seiten, die von nirgends Offensichtlichem verlinkt sind. Manchmal findest du sie über Sitemaps oder die interne Suche, aber leicht zu übersehen sind sie trotzdem.

Wenn wir also von allen URLs einer Domain finden sprechen, meinen wir: jede interne Seiten-URL erfassen — von der Startseite bis zur tiefsten Produkt- oder Artikelseite — idealerweise in einem Format, das du direkt nutzen kannst, etwa einer Tabellenkalkulation.

Klassische Methoden, um alle URLs einer Domain zu finden

Es gibt ein paar altmodische Wege, das anzugehen — aber jeder bringt seine eigenen Probleme mit sich:

Manuelles Kopieren und Einfügen sowie Browser-Tools

Das ist der „Holzhammer“-Ansatz: jeden Link anklicken, jede URL kopieren, in eine Tabelle einfügen und hoffen, dass nichts fehlt. Manche nutzen Browser-Erweiterungen, um alle Links von der aktuellen Seite zu ziehen, aber das musst du trotzdem für jede einzelne Seite wiederholen. Und bei Pagination oder versteckten Bereichen bist du auf dich allein gestellt. Für eine Website mit fünf Seiten geht das noch — für alles Größere eher nicht.

Site-Suche und Sitemaps nutzen

- Googles site:-Suche: Gib site:deinedomain.com bei Google ein, und du siehst eine Reihe indexierter Seiten. Aber Google zeigt nur, was tatsächlich indexiert wurde (oft auf etwa 1.000 Ergebnisse begrenzt), also fehlen neue, versteckte oder minderwertige Seiten. Googles eigene gibt zu, dass das keine vollständige Lösung ist.

- XML-Sitemaps: Viele Websites haben eine /sitemap.xml, die wichtige URLs auflistet. Super — wenn die Sitemap aktuell ist und wirklich jede Seite enthält. Aber nicht jede Website hat eine, und manche teilen ihre Sitemap in mehrere Dateien auf. Verwaiste Seiten tauchen dort oft gar nicht erst auf.

Technische Crawler und Skripte

- SEO-Tools (wie Screaming Frog): Diese crawlen eine Website wie eine Suchmaschine und spucken eine URL-Liste aus. Sie sind leistungsstark, aber sie erfordern Einrichtung, Konfiguration und bei großen Websites manchmal eine kostenpflichtige Lizenz.

- Python-Skripte (wie Scrapy): Entwickler können Skripte schreiben, um URLs zu crawlen und zu extrahieren. Aber seien wir realistisch: Wenn du mit Code nicht sicher bist, ist das keine Option. Außerdem brechen Skripte, wenn sich das Layout der Website ändert — du musst also ständig hinterherlaufen.

Kurz gesagt: Klassische Methoden sind für die meisten Business-Anwender entweder zu manuell, zu unvollständig oder zu technisch. Kein Wunder, dass so viele mittendrin aufgeben.

Warum allgemeine KI-Modelle die URL-Extraktion nicht vollständig automatisieren können

Vielleicht denkst du: „Kann ich ChatGPT oder Claude nicht einfach bitten, alle Seiten einer Website für mich zu finden?“ Ich wünschte, es wäre so einfach. In der Realität sieht es so aus:

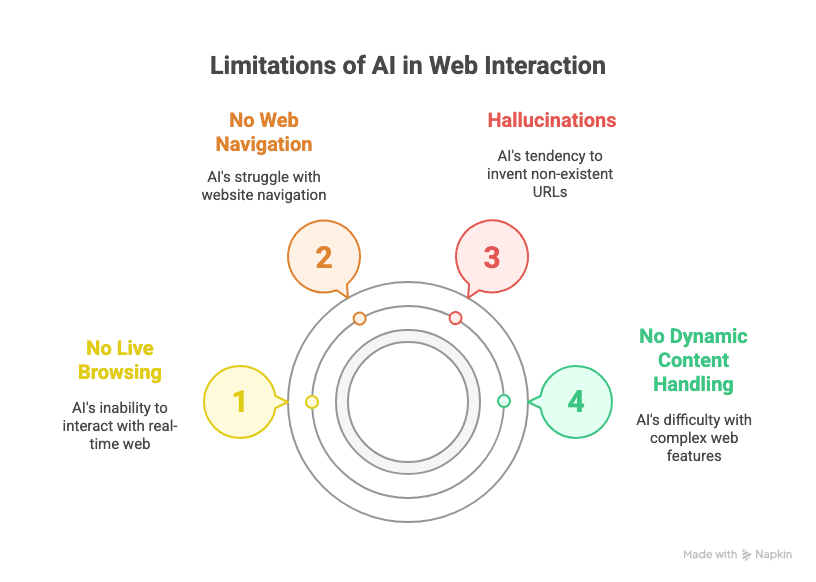

- Kein Live-Browsing: Allgemeine KI-Modelle wie GPT oder Claude können das Web nicht wirklich in Echtzeit durchsuchen. Sie „sehen“ den aktuellen Zustand einer Website nicht — sie arbeiten nur mit ihren Trainingsdaten oder dem, was du einfügst.

- Keine Webnavigation: Selbst mit Plugins oder aktivierter Browsing-Funktion wissen LLMs nicht, wie sie auf „Weiter“ klicken, Infinite Scroll handhaben oder systematisch jedem Link auf einer Seite folgen sollen.

- Halluzinationen: Frag eine allgemeine KI nach allen URLs einer Domain, und sie erfindet oft Links, die plausibel klingen, aber in Wirklichkeit nicht existieren. (Ich habe schon erlebt, dass sie /about-us-Seiten für Websites erfunden hat, die nie eine hatten.)

- Kein Umgang mit dynamischen Inhalten: Websites, die Inhalte mit JavaScript laden, Logins erfordern oder komplexe Navigation verwenden, liegen für allgemeine LLMs außerhalb der Reichweite.

Wie sagt: „Wenn du Hunderte oder Tausende Seiten scrapen willst … reicht ChatGPT allein nicht aus.“ Du brauchst ein Tool, das genau für diese Aufgabe gebaut wurde.

Vertikale KI-Agenten sind die Zukunft – und warum das wichtig ist

Hier kommt meine Erfahrung aus SaaS und Automatisierung ins Spiel: Vertikale KI-Agenten — also KI-Tools, die für einen bestimmten Bereich wie Web-Datenextraktion entwickelt wurden — sind der einzige Weg zu zuverlässigen, skalierbaren Ergebnissen bei Business-Aufgaben. Warum?

- Allzweck-LLMs sind großartig für Schreiben oder Suche, aber sie neigen zu Halluzinationen und können keine mehrstufigen, wiederholbaren Workflows mit der Stabilität abbilden, die Unternehmen brauchen.

- Enterprise-SaaS-Tools müssen viele repetitive, strukturierte Aufgaben automatisieren. Genau da glänzen vertikale KI-Agenten — sie sind dafür gebaut, eine Sache zu tun, und sie gut zu tun, mit minimalen Fehlern.

- Beispiele gibt es in vielen Branchen: Thunderbit für Web-Datenextraktion, Devin AI für Softwareentwicklung, Alta für Vertriebsautomatisierung, Infinity Learn’s IL VISTA für Bildung, Rippling für HR, Harvey für Recht … und die Liste geht weiter.

Kurz gesagt: Wenn du zuverlässig alle Seiten einer Website finden willst, brauchst du einen vertikalen KI-Agenten, der genau dafür gebaut ist — keinen Allzweck-Chatbot.

Thunderbit kennenlernen: KI-gestützte URL-Extraktion für alle

Hier kommt ins Spiel. Als KI-Web-Scraper-Chrome-Erweiterung ist Thunderbit für Business-Anwender gemacht — kein Programmieren, kein technisches Setup, einfach Ergebnisse. Das macht es besonders:

- Natürliche Sprache: Beschreibe einfach, was du willst („Liste alle Seiten-URLs auf dieser Website auf“), und die KI von Thunderbit findet heraus, wie sie extrahiert werden sollen.

- KI schlägt Felder vor: Thunderbit scannt die Seite und schlägt automatisch Spaltennamen vor (z. B. „Seiten-URL“) — ohne CSS-Selektoren oder XPath anfassen zu müssen.

- Pagination und Infinite Scroll: Thunderbit kann automatisch auf „Weiter“ klicken oder nach unten scrollen, damit dir keine Seiten entgehen.

- Navigation zu Unterseiten: Musst du tiefer gehen? Thunderbit kann Links zu Unterseiten folgen und dort ebenfalls Daten ziehen.

- Strukturierter Export: Exportiere deine Ergebnisse direkt nach Google Sheets, Excel, Notion, Airtable oder als CSV — kostenlos und mit einem Klick.

- Keine Programmierung nötig: Wenn du eine Website bedienen kannst, kannst du Thunderbit nutzen. So einfach ist das.

Und weil Thunderbit ein vertikaler KI-Agent ist, ist er auf Stabilität und Wiederholbarkeit ausgelegt — perfekt für Business-Anwender, die dieselben Aufgaben immer wieder automatisieren müssen.

Schritt für Schritt: Alle URLs einer Domain mit Thunderbit finden

Bereit zu sehen, wie es funktioniert? Hier ist eine verständliche Anleitung ohne technischen Ballast, um jede URL zu extrahieren, die du brauchst.

1. Thunderbit-Chrome-Erweiterung installieren

Als Erstes: . Es funktioniert mit Chrome, Edge, Brave und anderen Chromium-Browsern. Heft es an deine Symbolleiste, damit du schnell darauf zugreifen kannst.

2. Deine Ziel-Liste oder Verzeichnisseite öffnen

Navigiere zu der Website, von der du URLs extrahieren willst. Das kann die Startseite, eine Sitemap, ein Verzeichnis oder jede beliebige Listen-Seite sein, die auf die Seiten verweist, die dich interessieren.

3. Thunderbit öffnen und Felder einrichten

Klicke auf das Thunderbit-Symbol, um die Erweiterung zu öffnen. Starte eine neue Scraper-Vorlage. Hier passiert die Magie:

- Klicke auf „KI-Felder vorschlagen“. Die KI von Thunderbit scannt die Seite und schlägt Spalten vor — achte auf eine mit „Seiten-URL“, „Link“ oder Ähnlichem.

- Wenn du das exakte Feld nicht siehst, füge einfach eine Spalte mit dem Namen „Seiten-URL“ hinzu (oder einen anderen passenden Namen). Die KI von Thunderbit ist darauf trainiert, solche Begriffe zu erkennen und den richtigen Daten zuzuordnen.

4. Pagination oder Scrollen aktivieren, falls nötig

Wenn deine Zielseite mehrere Seiten hat (z. B. „Seite 1, 2, 3 …“ oder einen „Mehr laden“-Button), aktiviere in Thunderbit die Pagination:

- Wechsle in den Modus „Pagination per Klick“ für Seiten mit „Weiter“-Buttons oder in „Infinite Scroll“ für Seiten, die beim Scrollen weitere Inhalte laden.

- Thunderbit fordert dich dann auf, den „Weiter“-Button oder den Scrollbereich auszuwählen — einfach anklicken, den Rest erledigt die KI.

5. Scrapen starten und Ergebnisse prüfen

Klicke auf den „Scrape“-Button. Thunderbit crawlt dann alle Seiten und sammelt jede gefundene URL. Die Ergebnisse erscheinen direkt als Tabelle in der Erweiterung. Bei großen Websites kann das ein paar Minuten dauern, aber es ist immer noch viel schneller als manuelle Arbeit.

6. Deine URL-Liste exportieren

Sobald der Scrape abgeschlossen ist, klicke auf Exportieren. Du kannst deine Daten direkt senden an:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

Exporte sind kostenlos und behalten deine Formatierung bei. Kein lästiges Kopieren und Einfügen mehr.

Thunderbit im Vergleich zu anderen Lösungen zur URL-Extraktion

| Methode | Benutzerfreundlichkeit | Genauigkeit & Abdeckung | Skalierbarkeit | Exportoptionen |

|---|---|---|---|---|

| Manuelles Kopieren und Einfügen | Schrecklich | Niedrig (leicht zu verpassen) | Keine | Manuell (Excel usw.) |

| Browser-Link-Extraktoren | Für 1 Seite okay | Mittel | Schwach | Manuell |

Google site:-Suche | Einfach | Mittel (nicht vollständig) | Auf ca. 1.000 begrenzt | Manuell |

| XML-Sitemap | Einfach (falls vorhanden) | Gut (wenn aktuell) | Gut | Manuell/Skript |

| SEO-Tools (Screaming Frog) | Technisch | Hoch | Hoch (kostenpflichtig) | CSV, Excel |

| Python-Skripte (Scrapy usw.) | Sehr technisch | Hoch | Hoch | Individuell |

| Thunderbit | Sehr einfach | Sehr hoch | Hoch | Google Sheets, CSV usw. |

Thunderbit bietet dir die Genauigkeit und Skalierbarkeit eines professionellen Crawlers bei der Einfachheit einer Browser-Erweiterung. Kein Code, kein Setup, nur Ergebnisse.

Bonus: Mit Thunderbit mehr als nur URLs extrahieren

Hier wird es richtig spannend. Thunderbit ist nicht nur für URLs gedacht — du kannst auch Folgendes extrahieren:

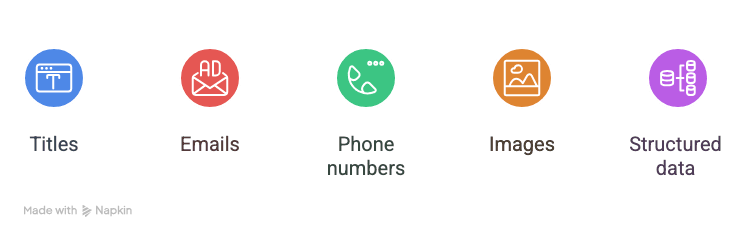

- Titel

- E-Mails

- Telefonnummern

- Bilder

- Jede strukturierte Daten auf der Seite

Wenn du zum Beispiel eine Lead-Liste aufbaust, kann Thunderbit aus jedem Verzeichniseintrag die Profil-URL, den Namen, die E-Mail-Adresse und die Telefonnummer ziehen — alles in einem Durchlauf. Wenn du Produkte prüfst, kannst du Produkt-URL, Name, Preis und Lagerstatus erfassen. Thunderbit unterstützt sogar , sodass es jeden Link anklicken und die Details dort extrahieren kann.

Und ja: Die E-Mail- und Telefon-Extraktoren von Thunderbit sind komplett kostenlos. Das ist für Vertriebs- und Marketing-Teams ein großer Vorteil.

Wichtige Erkenntnisse: Wie man mit KI alle Seiten einer Website findet

Fassen wir zusammen:

- Alle URLs einer Domain zu extrahieren ist mit manuellen oder allgemeinen Tools schwierig.

- Allgemeine KI-Modelle wie GPT können keine Webnavigation, Pagination oder dynamische Inhalte zuverlässig handhaben.

- Vertikale KI-Agenten wie Thunderbit sind speziell für Web-Datenextraktion gebaut — stabil, wiederholbar und einfach für Business-Anwender.

- Thunderbit macht es einfach: Erweiterung installieren, KI Felder vorschlagen lassen, Pagination aktivieren, scrapen und exportieren. Kein Code, kein Aufwand.

- Du kannst mehr als nur URLs extrahieren: Titel, E-Mails, Telefonnummern und mehr — perfekt für Lead-Generierung, Audits oder Recherche.

Wenn du genug davon hast, Links zu kopieren oder mit technischen Crawlern zu kämpfen, . Es gibt einen kostenlosen Tarif, damit du selbst sehen kannst, wie viel Zeit — und Nerven — du sparst.

Und wenn du neugierig bist, wie Thunderbit dir sonst noch helfen kann — etwa beim , beim oder beim — schau im nach weiteren Anleitungen und Tipps.

Bereit, deine Zeit von manueller Datensammlung zurückzuholen? Die Zukunft der Web-Datenextraktion sind vertikale KI-Agenten — und Thunderbit führt diesen Wandel an. Probier es aus, und mach dein nächstes Audit, deine nächste Lead-Liste oder dein nächstes Rechercheprojekt zum bisher einfachsten.

Mehr lesen

P.S.: Wenn du jemals in Versuchung gerätst, 1.000 URLs von Hand zu kopieren, denk einfach daran: Dafür gibt es jetzt eine KI. Deine Handgelenke — und dein Chef — werden es dir danken.