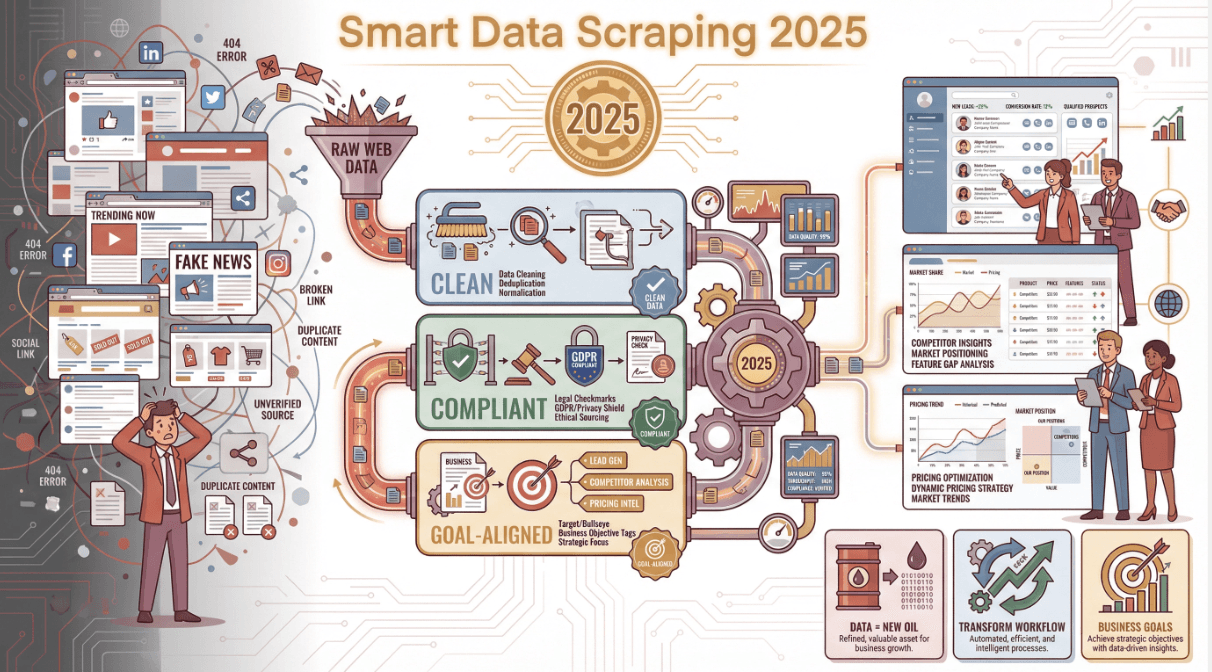

Daten sind das neue Gold -- aber seien wir ehrlich: Die wenigsten von uns haben Lust, tagelang durch digitalen Datenmüll zu wühlen. 2025 ist Data Scraping zum unverzichtbaren Werkzeug für Business-Teams geworden, die aus dem endlosen Wust des Internets verwertbare Erkenntnisse gewinnen wollen -- statt nur noch mehr Rauschen. Ich habe selbst erlebt, wie eine durchdachte Scraping-Strategie den Workflow eines Teams komplett verändern kann -- egal ob du Leads generierst, die Konkurrenz im Blick behältst oder einfach bei der Preisgestaltung einen Schritt voraus sein willst. Aber hier kommt der Haken: Beim Scraping geht es nicht nur ums Daten-Einsammeln. Es geht darum, es richtig zu machen -- sauber, rechtskonform und auf deine Geschäftsziele abgestimmt.

Wenn du genug hast von Copy-Paste-Marathons oder dich schon gefragt hast, warum dein "gescraptes" Spreadsheet voller Lücken und Duplikate ist, dann ist dieser Guide genau das Richtige für dich. Ich zeige dir die Best Practices, die ich gelernt habe (manchmal auf die harte Tour), erkläre, wie du die klassischen Fallstricke vermeidest, und stelle dir vor, wie Tools wie hochwertiges Data Scraping für alle zugänglich machen -- auch wenn du keine Zeile Code schreiben kannst.

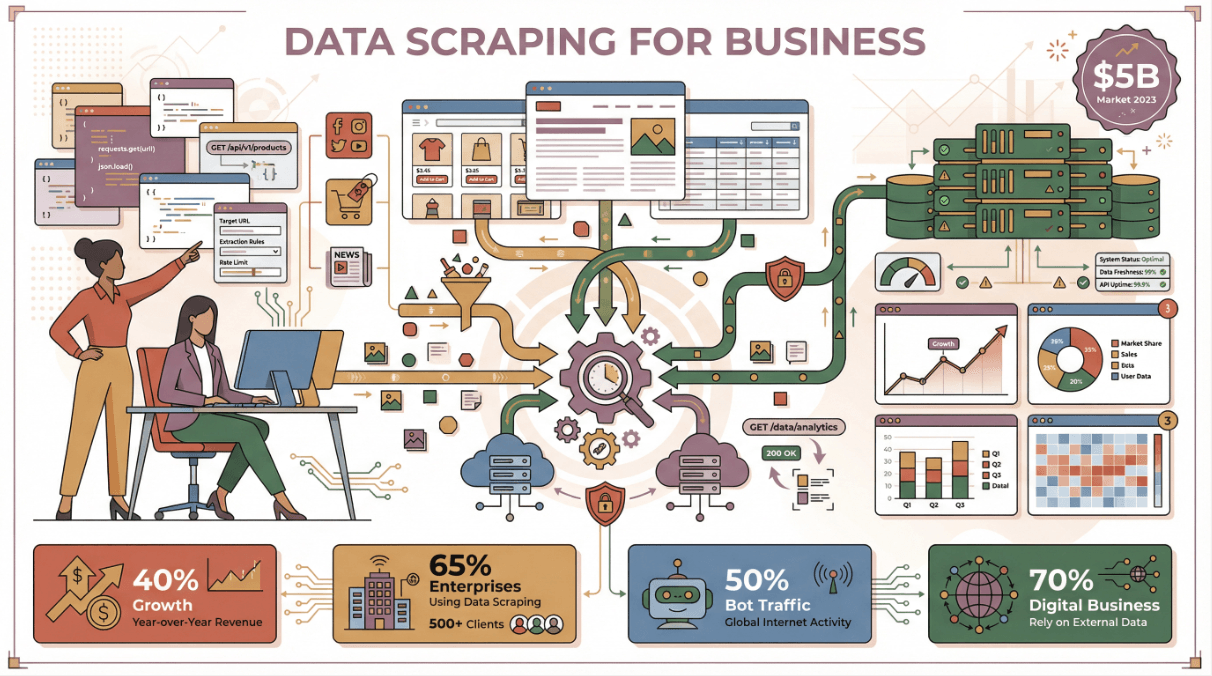

Warum Data Scraping für moderne Unternehmen so wichtig ist

Fangen wir mit dem großen Bild an: Warum ist Data Scraping für Business-Teams heute so relevant? Nun, die Zahlen sprechen für sich. Der weltweite Markt für Web-Scraping-Software hat 2023 die Marke von überschritten -- mit einem jährlichen Wachstum von über 40 %. Fast nutzen mittlerweile öffentliche Webdaten für die Marktanalyse, und rund setzen irgendeine Form von Web-Data-Extraction-Tool ein. Tatsächlich wurde fast die Hälfte des gesamten Internetverkehrs 2023 von Bots erzeugt -- Scraper und Crawler, nicht Menschen.

Aber es geht nicht nur um die Menge. Der eigentliche Wert entsteht durch das, was du mit den Daten machst:

| Abteilung | Scraping-Anwendung | Business Impact (ROI) |

|---|---|---|

| Vertrieb & Marketing | Verzeichnisse/Social Media nach neuen Leads durchsuchen | Füllt die Pipeline mit qualifizierten Leads, reduziert die Akquisezeit um 30--40 % (scrapingapi.ai) |

| E-Commerce Ops | Wettbewerberpreise und Produktlistings überwachen | Ermöglicht dynamische Preisgestaltung, steigert den Umsatz (John Lewis verzeichnete einen 4 % Umsatzanstieg browsercat.com) |

| Marktforschung | Bewertungen, Ratings und Trends aggregieren | Erkennt neue Trends und Kundenstimmungen schneller als klassische Methoden |

| Finanzen & Strategie | Nachrichten, Geschäftsberichte und öffentliche Datensätze sammeln | Versorgt Entscheider mit aktuellen Informationen |

Wenn du Scraping richtig angehst, sparst du nicht nur Zeit -- du triffst klügere, schnellere Entscheidungen. Unternehmen wie John Lewis und ASOS haben echte Umsatzsteigerungen erzielt, indem sie das Wettbewerber-Monitoring automatisiert und Kampagnen mit gescrapten Daten maßgeschneidert haben ().

Data-Scraping-Best-Practices für verschiedene Szenarien

Data Scraping ist kein Einheitsansatz. Die beste Vorgehensweise hängt von deinem Geschäftsziel ab -- ob Marktforschung, Leadgenerierung oder Wettbewerbsanalyse. Schauen wir uns an, was in jedem Szenario funktioniert.

Data Scraping für Marktforschung

Bei Marktforschung geht es darum, das große Ganze zu sehen -- und das heißt: ein breites Netz auswerfen. Die Best Practice hier ist, Daten aus mehreren Quellen zu aggregieren: Produktbewertungen, Social Media, Foren und Preisseiten. Modemarken zum Beispiel scrapen Social-Media-Konversationen und Retail-Seiten, um neue Trends zu erkennen, bevor sie im Mainstream ankommen ().

Tipps für Marktforschungs-Scraping:

- Quellen diversifizieren: Verlasse dich nicht auf eine einzige Seite -- kombiniere Bewertungen, Ratings und Forenbeiträge.

- Daten strukturieren: Erfasse Metadaten (wie Datum, Bewertung, Kategorie), damit du später gezielt filtern und auswerten kannst.

- Zeitverläufe tracken: Plane regelmäßige Scrapes (wöchentlich/monatlich), um Veränderungen und Trends zu erkennen.

Beispiel: Eine Kosmetikmarke scrapt Social Media und Beauty-Retailer, um einen Anstieg bei Erwähnungen von "Hyaluronsäure" frühzeitig zu erkennen -- und ihr Marketing anzupassen, bevor die Konkurrenz es überhaupt bemerkt.

Data Scraping für Sales-Leadgenerierung

Für Vertriebsteams ist Scraping eine Abkürzung zu einer vollen Pipeline -- wenn man es richtig macht. Der Schlüssel liegt darin, zuverlässige, öffentliche Quellen gezielt anzusteuern (Branchenverzeichnisse, LinkedIn, Verbandsseiten) und auf Qualität statt Quantität zu setzen.

Best Practices:

- Kontaktdaten validieren: E-Mail-/Telefonnummern verifizieren, Duplikate entfernen und Formate prüfen.

- Compliant bleiben: Nur öffentliche, berufliche Daten scrapen. Persönliche Identifikatoren vermeiden, es sei denn, es gibt eine rechtliche Grundlage ().

- Erst testen, dann skalieren: Starte mit einem kleinen Scrape, prüfe auf Besonderheiten, und skaliere dann.

Typischer Fehler: Ein Leadgenerierungs-Unternehmen hat personenbezogene Daten ohne Schutzmaßnahmen gescrapt -- das Ergebnis: Compliance-Albtraum und verschwendeter Aufwand (). Scrape smart, scrape verantwortungsvoll.

Data Scraping für Wettbewerbsanalyse

Du willst wissen, was deine Mitbewerber gerade treiben? Mit Scraping kannst du Preise, Verfügbarkeiten, neue Launches und sogar Einstellungstrends beobachten. Das Geheimrezept: Genau definieren, was du tracken willst (Artikelnummern, Preise, Bewertungen, Stellenanzeigen) und automatisierte Unterseiten-Navigation nutzen, um das vollständige Bild zu erhalten.

Best Practices:

- Unterseiten-Scraping automatisieren: Nutze Tools, die Links folgen können (wie "Subpages scrapen" in Thunderbit), um Details von Produkt- oder Stellenseiten zu erfassen.

- Regelmäßige Checks einplanen: Häufigkeit zählt -- täglich für Preise, wöchentlich für Blogbeiträge.

- Exportieren und vergleichen: Historische Daten speichern, um Trends zu erkennen und schnell zu reagieren.

Profi-Tipp: Verwende browserbasierte Scraper (wie Thunderbits Chrome Extension), die echtes Nutzerverhalten simulieren und so die Erkennung durch Anti-Bot-Systeme vermeiden ().

Häufige Data-Scraping-Fallstricke vermeiden und Datenqualität sichern

Auch der beste Scraping-Plan kann schiefgehen, wenn du in diese klassischen Fallen tappst. So umgehst du sie und hältst deine Daten sauber.

Umgang mit dynamischen Webseiten

Moderne Websites lieben JavaScript, Infinite Scroll und "Mehr laden"-Buttons. Ein einfacher Scraper sieht oft nur die Spitze des Eisbergs.

So gehst du damit um:

- Nutze browserbasierte oder KI-gestützte Scraper, die JavaScript ausführen und auf das Laden von Inhalten warten ().

- Prüfe auf versteckte APIs -- manchmal werden die Daten über einen Hintergrund-Endpunkt geladen, den du direkt ansprechen kannst.

- Ergebnisse immer plausibilitätsprüfen -- wenn du 100 Einträge erwartest und nur 10 bekommst, stimmt etwas nicht.

Thunderbit zum Beispiel lädt Seiten wie ein echter Browser und kommt mit dynamischen Inhalten direkt zurecht.

Anti-Scraping-Maßnahmen meistern

Websites werden immer besser darin, Bots zu blockieren -- CAPTCHAs, IP-Sperren und Rate Limiting. Wenn dein Scraper plötzlich nicht mehr funktioniert, liegt es wahrscheinlich daran.

Best Practices:

- Anfragen drosseln: Geschwindigkeit reduzieren, Intervalle zufällig gestalten und die Seite nicht überlasten.

- Browser-Modus für sensible Seiten nutzen: Thunderbits Browser-Modus simuliert echtes Surfverhalten und verringert die Wahrscheinlichkeit, blockiert zu werden.

- robots.txt und Nutzungsbedingungen prüfen: Wenn eine Seite Scraping untersagt, erst nachdenken -- oder um Erlaubnis bitten ().

Vollständigkeit und Genauigkeit der Daten sicherstellen

Schlechte Daten sind schlimmer als gar keine Daten. Vertraue nicht einfach deinem Scraper -- validiere, bereinige und prüfe alles.

Checkliste:

- Formate validieren: Sind E-Mails gültig? Sind Preise numerisch? Sind Datumsformate konsistent?

- Deduplizieren: Wiederholungen anhand eindeutiger IDs oder URLs entfernen.

- Fehlende Daten behandeln: Leere Felder markieren, wo möglich auffüllen oder bei Bedarf erneut scrapen.

- Regelmäßige Audits: Bei jedem Durchlauf eine Stichprobe manuell prüfen. Wenn etwas seltsam aussieht, vor dem Weiterlaufen korrigieren.

Schlechte Datenqualität kann Unternehmen kosten -- also überspringe diesen Schritt nicht.

Wie Thunderbit Data Scraping für Business-Teams vereinfacht

Jetzt reden wir darüber, wie das alles einfach wird. Bei Thunderbit haben wir unsere für Business-Nutzer entwickelt, die Ergebnisse wollen -- ohne technische Kopfschmerzen. So verändert Thunderbit die Arbeitsweise (klingt vielleicht nach Buzzword, ist aber wirklich so):

Thunderbits KI-gestützter Workflow

- AI Suggest Fields: Rufe eine beliebige Seite auf, klicke auf "AI Suggest Fields", und Thunderbit analysiert die Seite und schlägt die besten Spalten zur Extraktion vor -- ohne Setup, ohne Code.

- 2-Klick-Scraping: Felder bei Bedarf anpassen, dann auf "Scrape" klicken. Thunderbit erfasst alle Daten, handhabt Pagination und folgt sogar Unterseiten, wenn du mehr Tiefe brauchst.

- Sofortiger Export: Daten direkt an Excel, Google Sheets, Airtable oder Notion senden -- kein Copy-Paste, kein manuelles Aufräumen.

Ich habe schon erlebt, wie nicht-technische Teammitglieder innerhalb von fünf Minuten von "Ich weiß gar nicht, wo ich anfangen soll" zu "Ich habe gerade 500 Wettbewerberpreise gescrapt" gekommen sind.

Multi-Source- und mehrsprachiges Data Scraping

Thunderbit ist nicht nur für Websites. Du kannst Daten auch aus PDFs, Bildern und Dokumenten scrapen -- dank integrierter OCR und KI. Und mit Unterstützung für 34 Sprachen ist es perfekt für internationale Teams oder alle, die mit Daten aus verschiedenen Ländern arbeiten.

Beispiel: Du musst den Produktkatalog eines japanischen Lieferanten scrapen? Thunderbit kann die Daten extrahieren und direkt übersetzen, strukturiert für deine Analyse.

Datenbereinigung und -aufbereitung: Rohdaten in Geschäftswert verwandeln

Scraping ist nur die halbe Miete. Rohdaten sind unordentlich -- Duplikate, seltsame Formate, fehlende Informationen. Die eigentliche Magie passiert, wenn du die Daten bereinigst, beschriftest und für die geschäftliche Nutzung strukturierst.

Automatisierte Datenbeschriftung und Kategorisierung

Thunderbits Field AI Prompt ermöglicht es dir, einen Großteil dieser Arbeit zu automatisieren:

- Produkte kategorisieren: "Ordne jedes Produkt als Elektronik, Bekleidung oder Haushaltswaren ein, basierend auf dem Namen."

- Felder übersetzen: Gescrapten Text sofort ins Deutsche (oder eine von 34 Sprachen) übersetzen.

- Formatieren und validieren: Datumsangaben, Preise oder Telefonnummern schon beim Scrapen standardisieren.

Checkliste zur Datenbereinigung:

- Auf offensichtliche Probleme prüfen (verschobene Spalten, Encoding-Fehler).

- Zeilen deduplizieren.

- Formate standardisieren (Datum, Preise, Kategorien).

- Fehlende Werte behandeln (auffüllen, markieren oder entfernen).

- Mit Geschäftsregeln validieren (z. B. Preisspannen).

- Bei Bedarf anreichern (Branche, Region usw. ergänzen).

- Den Prozess dokumentieren -- für Transparenz.

Durch die Automatisierung dieser Schritte verwandelst du einen unübersichtlichen Export in einen entscheidungsfertigen Datensatz -- ohne stundenlange Tabellenarbeit.

Rechtliche und ethische Aspekte beim Data Scraping

Lass uns kurz ernst werden. Nur weil du Daten scrapen kannst, heißt das nicht, dass du es auch solltest -- zumindest nicht, ohne über Datenschutz, Urheberrecht und Compliance nachzudenken.

Wichtige Vorschriften, die du kennen solltest

- DSGVO/CCPA: Wenn du Daten scrapst, die eine Person identifizieren könnten, brauchst du eine rechtliche Grundlage. Beschränke dich auf öffentliche, berufliche Daten und vermeide sensible Informationen.

- Nutzungsbedingungen: Viele Seiten verbieten Scraping in ihren AGB. Immer vorher prüfen.

- Urheberrecht: Fakten sind nicht urheberrechtlich geschützt, aber die Art der Datenpräsentation kann es sein. Scrape und veröffentliche keine vollständigen Artikel oder kreativen Inhalte ohne entsprechende Rechte.

Best Practices:

- Nur das sammeln, was du brauchst (Datenminimierung).

- robots.txt und Seitenrichtlinien respektieren.

- Transparent sein über deine Datenquellen.

- Gescrapte Daten mit personenbezogenen Informationen anonymisieren oder absichern.

- Eine interne Richtlinie erstellen, damit alle im Team die Regeln kennen.

Im Zweifelsfall: um Erlaubnis fragen oder eine offizielle API nutzen. Es ist besser, auf ein paar Daten zu verzichten, als rechtliche Probleme zu riskieren.

Kontinuierliche Verbesserung: Scraping-Projekte überwachen und optimieren

Websites ändern sich, Geschäftsanforderungen entwickeln sich weiter, und was letzten Monat funktioniert hat, kann morgen schon nicht mehr klappen. Behandle Scraping als einen lebendigen Prozess:

- Datenqualität überwachen: Vollständigkeit, Genauigkeit und Aktualität im Blick behalten. Alerts einrichten, wenn dein Scraper plötzlich weniger Datensätze oder seltsame Ergebnisse liefert.

- An Business-Ergebnisse koppeln: Messe, wie gescrapte Daten deine KPIs beeinflussen -- generierte Leads, gewonnene Abschlüsse, Preisvorteile.

- Häufigkeit optimieren: Nicht öfter scrapen als nötig (das schont die Zielseite und deine Infrastruktur).

- Agil bleiben: Sei bereit, deinen Scraper anzupassen, wenn sich Seiten ändern. Dokumentiere, was funktioniert und was nicht, für schnellere Fehlerbehebung beim nächsten Mal.

Die besten Teams behandeln Scraping als Datenpipeline, nicht als einmaliges Projekt. Je mehr du iterierst, desto mehr Wert wirst du freisetzen.

Fazit: Die wichtigsten Erkenntnisse für erfolgreiches Data Scraping

Fassen wir die Kernpunkte zusammen:

- Mit dem Geschäftsziel starten: Nicht um des Scrapens willen scrapen -- wisse, was du erreichen willst.

- Das richtige Tool wählen: KI-gestützte Scraper wie machen es jedem leicht, hochwertige Daten schnell zu gewinnen.

- Ansatz anpassen: Verschiedene Szenarien (Marktforschung, Vertrieb, Wettbewerbsanalyse) erfordern unterschiedliche Strategien.

- Datenqualität priorisieren: Daten validieren, bereinigen und strukturieren, bevor du sie nutzt.

- Compliant und ethisch handeln: Datenschutz, Urheberrecht und Seitenregeln respektieren.

- Kontinuierlich verbessern: Überwachen, optimieren und anpassen.

Bereit, Data Scraping für dein Team produktiv zu machen? und erlebe, wie einfach es sein kann, das Web in deine eigene Business-Intelligence-Engine zu verwandeln. Und wenn du tiefer einsteigen möchtest, besuche den für weitere Tipps, Anleitungen und Praxisbeispiele.

FAQs

1. Was ist Data Scraping und warum ist es wichtig für Business-Teams?

Data Scraping ist die automatisierte Extraktion von Informationen aus Websites, PDFs oder Dokumenten. Es ist entscheidend für Business-Teams, weil es öffentliche Webdaten in verwertbare Erkenntnisse für Vertrieb, Marketing und Operations verwandelt -- und so bessere Entscheidungen und schnellere Workflows ermöglicht.

2. Was sind die häufigsten Fehler beim Data Scraping?

Typische Fallstricke sind das Übersehen dynamischer Inhalte (wie Infinite-Scroll-Seiten), das Ignorieren von Anti-Scraping-Maßnahmen (was zu Sperren führt) und das Versäumnis, die Daten zu validieren oder zu bereinigen (was Duplikate oder Fehler verursacht). Nutze immer Tools, die dynamische Seiten handhaben, und baue Validierungsschritte ein.

3. Wie vereinfacht Thunderbit Data Scraping für nicht-technische Nutzer?

Thunderbit nutzt KI, um Felder vorzuschlagen, dynamische Inhalte zu verarbeiten und Unterseiten-Scraping zu automatisieren. Mit nur zwei Klicks kannst du strukturierte Daten extrahieren und nach Excel, Google Sheets, Airtable oder Notion exportieren -- ganz ohne Programmierung oder Setup.

4. Wie stelle ich sicher, dass mein Data Scraping legal und ethisch ist?

Beschränke dich auf öffentliche, nicht-sensible Daten, beachte Datenschutzgesetze (wie DSGVO/CCPA) und prüfe immer die Nutzungsbedingungen einer Seite. Vermeide das Scrapen personenbezogener Daten, es sei denn, du hast eine rechtliche Grundlage, und nutze offizielle APIs, wenn verfügbar.

5. Was sollte ich nach dem Scraping mit den Daten tun, damit sie nützlich werden?

Bereinige, dedupliziere und strukturiere deine Daten. Nutze KI-Tools (wie Thunderbits Field AI Prompt) zum Beschriften, Übersetzen und Kategorisieren von Feldern. Validiere deine Ergebnisse immer, bevor du sie für geschäftliche Entscheidungen nutzt.

Weiterlesen