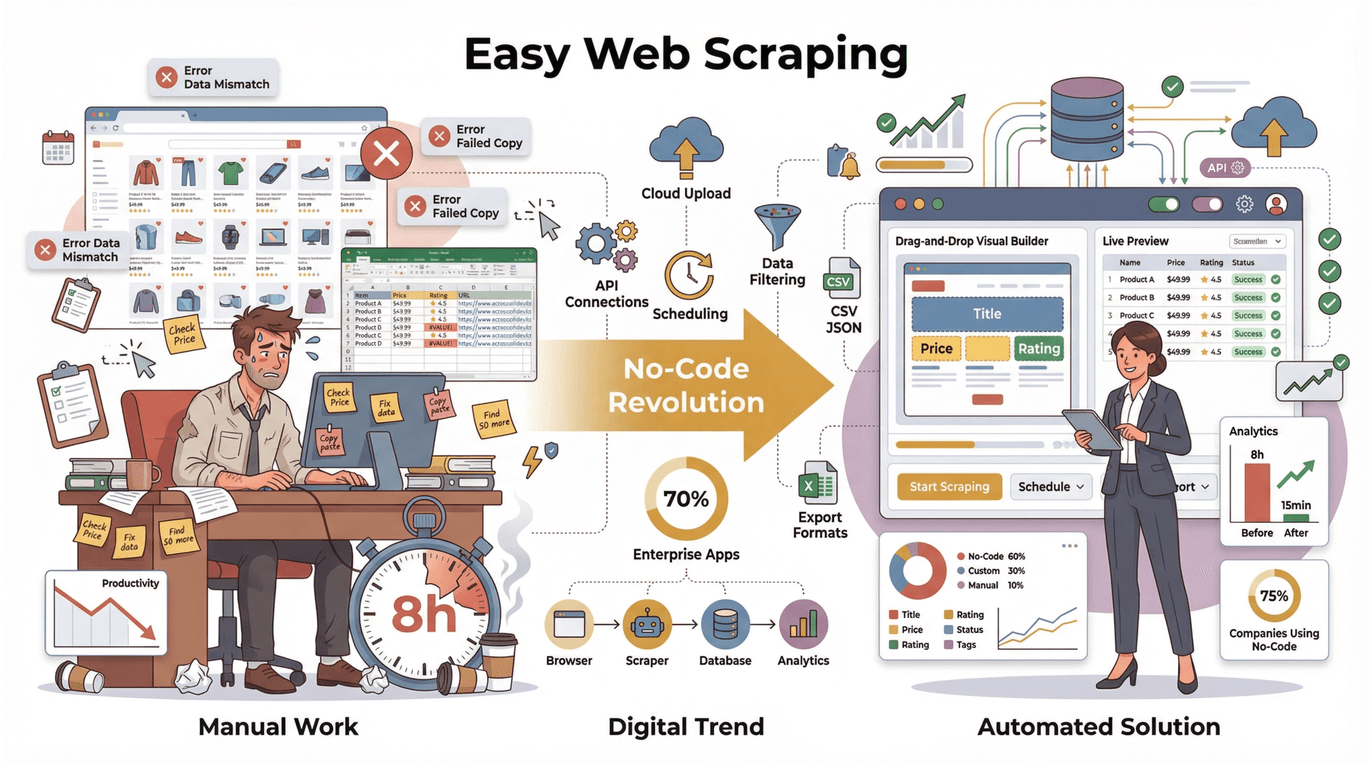

Wenn du schon einmal versucht hast, Hunderte Produktangebote oder Sales Leads von einer Website in eine Tabelle zu kopieren, kennst du das Gefühl: irgendwo zwischen „Ich spare Zeit“ und „warum ist das so mühsam?“. Die Wahrheit ist: Webdaten sind das neue Öl für Vertriebs-, E-Commerce- und Research-Teams – aber die meisten wollen nicht erst programmieren lernen, nur um an sie heranzukommen. Die gute Nachricht? Die No-Code-Revolution hat endlich auch das Web Scraping erreicht. Tatsächlich werden , und . Das heißt: Die Zeiten des mühsamen Kopierens und Einfügens sind gezählt.

Aber hier liegt der Haken: Bei so vielen Web-Scrapern da draußen – wie wählst du einen aus, der für Einsteiger wirklich einfach ist? Ich habe Jahre damit verbracht, diese Tools zu entwickeln und zu testen (und ja, ich bin ein bisschen voreingenommen zugunsten von Thunderbit, weil es mein Baby ist), aber ich bin auch besessen davon, Web Scraping so einfach zu machen wie Essen bestellen. Deshalb habe ich diesen praxisnahen, schnörkellosen Leitfaden zu den 10 einfachsten Web-Scrapern im Jahr 2025 zusammengestellt – mit ehrlichen Vor- und Nachteilen sowie Tipps für jedes Tool.

Was macht einen Web-Scraper am einfachsten zu nutzen?

Seien wir ehrlich: „einfach“ bedeutet für verschiedene Menschen Unterschiedliches. Für Business-User haben die einfachsten Web-Scraper ein paar Dinge gemeinsam:

- Kein Coding oder HTML erforderlich: Du solltest nicht wissen müssen, was ein Selector ist oder warum XPath wie ein Bösewicht aus Star Wars klingt.

- Intuitive, visuelle Oberfläche: Drag-and-drop, Point-and-click oder sogar Prompts in natürlicher Sprache – damit du einfach sagen kannst, was du willst.

- Wenige Einrichtungsschritte und geringe Lernkurve: Ergebnisse solltest du in Minuten bekommen, nicht in Stunden (oder Tagen).

- Automatisierung und Zuverlässigkeit: Das Tool sollte knifflige Dinge wie Pagination, Unterseiten und dynamische Inhalte für dich abfangen, ohne dass du dich mit den Details herumschlagen musst.

- Export mit einem Klick: Die Daten sollten direkt für Excel, Google Sheets, Airtable, Notion oder das Tool deines Teams bereitstehen.

- Support und Dokumentation: Gute Tutorials, schneller Support und eine hilfreiche Community machen einen riesigen Unterschied.

- Flexible Preisgestaltung: Kostenlose Pläne oder Testphasen für kleinere Aufgaben, mit bezahlten Upgrades, wenn du mehr brauchst.

Bei meinem Ranking habe ich vor allem darauf geachtet, wie schnell ein nicht-technischer Nutzer von „Ich brauche diese Daten“ zu „Ich habe sie in meiner Tabelle“ kommt – besonders bei typischen Business-Szenarien wie Produktdaten, Lead-Generierung und Preis-Monitoring.

Wie wir die einfachsten Web-Scraper bewertet haben

Ich habe nicht nur Marketingseiten überflogen – ich habe Nutzerbewertungen geprüft, praktische Tests durchgeführt und die Funktionspakete jedes Tools verglichen. Folgendes war am wichtigsten:

- Onboarding für Einsteiger: Wie schnell kann ein neuer Nutzer loslegen? Gibt es Vorlagen, Assistenten oder KI-Helfer?

- Aufgaben aus der Praxis: Kann das Tool Produktlisten scrapen, E-Mails aus einem Verzeichnis extrahieren oder Preise überwachen – ohne steile Lernkurve?

- Automatisierung: Kommt das Tool mit Pagination, Unterseiten und Zeitplanung zurecht? Oder musst du ständig eingreifen?

- Datenexport: Lässt sich die Datenmenge einfach herausbekommen, bereinigen und nutzen?

- Support und Preisgestaltung: Gibt es kostenlose Pläne, schnellen Support und klare Upgrade-Pfade?

Jetzt tauchen wir in die 10 einfachsten Web-Scraper ein – bewertet und geprüft für echte Einsteiger.

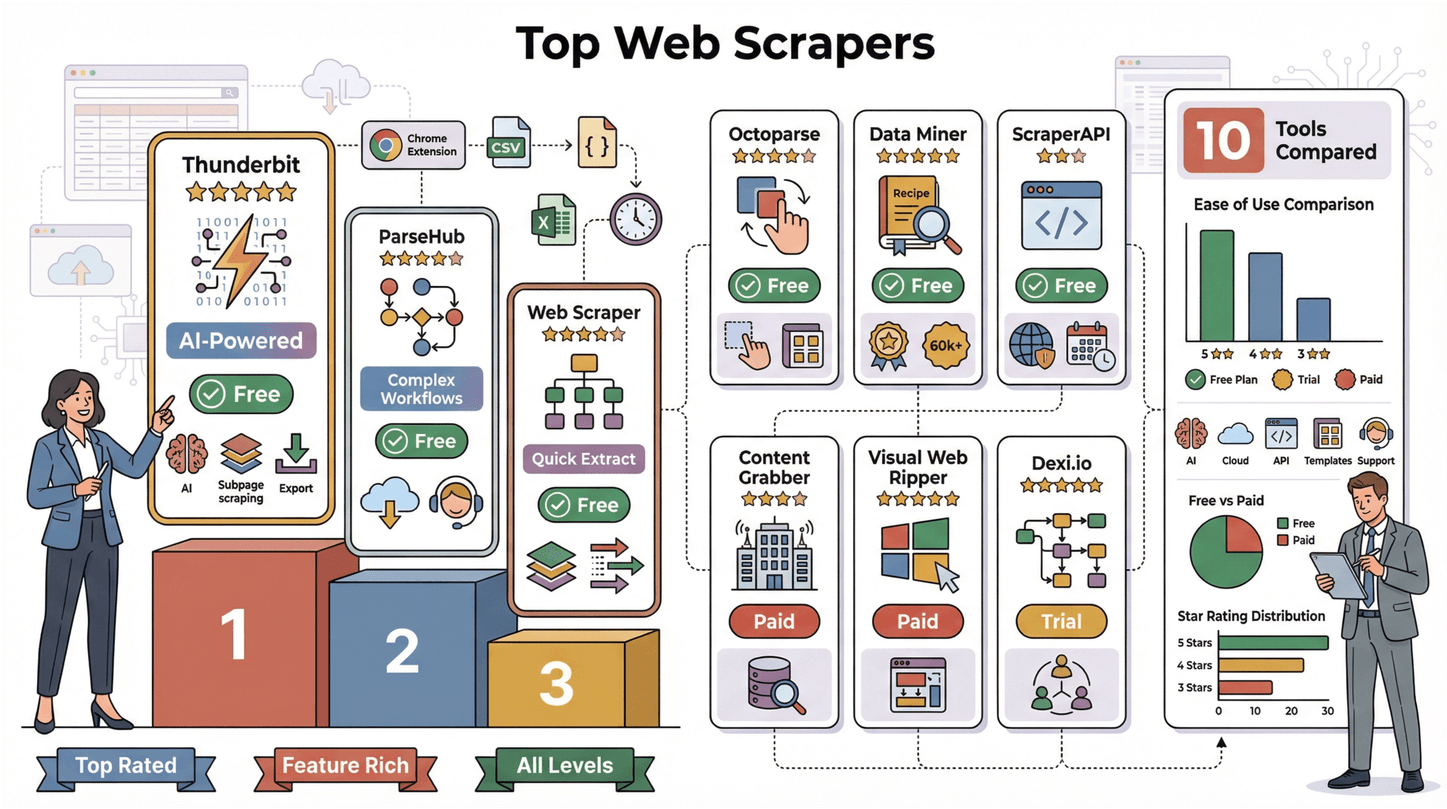

Die 10 einfachsten Web-Scraper zur Nutzung

- für das einfachste KI-gestützte Web Scraping mit 2 Klicks

- für visuelle Point-and-click-Workflows

- für kostenloses, flexibles Scraping auf Sitemap-Basis

- für Drag-and-drop-Automatisierung mit Vorlagen

- für rezeptbasiertes Scraping im Alltag

- für Plug-and-play-API-Scraping (für technische Teams)

- für cloudbasierte Extraktion, die businessfreundlich ist

- für Scraping im Enterprise-Maßstab mit hoher Anpassbarkeit

- für Windows-Nutzer, die Offline-Scraping mit Vorlagen wollen

- für browserbasierte Workflow-Automatisierung und Teamzusammenarbeit

1. Thunderbit

ist meine erste Wahl, wenn es um den einfachsten Web-Scraper für 2025 geht – und das nicht nur, weil ich bei der Entwicklung geholfen habe. Thunderbit soll Web Scraping so anfühlen lassen, als hättest du einen KI-Assistenten direkt im Browser. Darum sticht es heraus:

- KI-gestützter Workflow mit 2 Klicks: Öffne eine beliebige Webseite, klicke auf „KI-Felder vorschlagen“, und die KI von Thunderbit liest die Seite, schlägt vor, welche Daten extrahiert werden sollen (z. B. Produktnamen, Preise, E-Mails) und richtet deine Tabelle ein. Dann auf „Scrapen“ klicken – fertig. Kein Herumfummeln an Selectors, kein Coding, kein Stress.

- Prompts in natürlicher Sprache: Du kannst in normalem Deutsch beschreiben, was du willst. Thunderbits KI erledigt den Rest – selbst bei komplexen, unübersichtlichen oder unstrukturierten Seiten.

- Unterseiten-Scraping: Mehr Details nötig? Thunderbit kann automatisch jede Unterseite besuchen (z. B. Produktdetails oder LinkedIn-Profile) und deine Tabelle ohne zusätzliche Einrichtung anreichern.

- Alles scrapen: Funktioniert mit jeder Website, PDF oder jedem Bild – selbst wenn die Daten in einem Dokument oder Bild versteckt sind.

- Sofortiger Export: Exportiere deine Ergebnisse mit einem Klick nach Excel, Google Sheets, Airtable oder Notion. Kein Paywall-Block beim Export – nicht einmal im kostenlosen Plan.

- Kostenlose Chrome-Erweiterung: Installiere sie aus dem und leg sofort los.

- Kostenlose Extraktion von E-Mails, Telefonnummern und Bildern: Extrahiere Kontakte und Bilder aus jeder Seite, PDF oder Bilddatei – ohne zusätzliche Einrichtung.

Anwendungsfälle: Vertriebsteams nutzen Thunderbit für die Lead-Extraktion, E-Commerce-Teams überwachen Konkurrenzpreise, und Immobilienprofis sammeln Objektinformationen. Ich habe Nutzer erlebt, die von „Ich brauche 200 Produktlisten“ zu „Hier ist meine Tabelle“ in zehn Minuten kamen.

Nutzerfeedback: Thunderbit hat im und über 100.000 Nutzer. Viele sagen, es „fühlt sich an, als würde ein Praktikant das Kopieren und Einfügen für dich erledigen“. Selbst komplexe Aufgaben wie das Scrapen mehrerer Seiten und Unterlinks werden automatisch erledigt.

Preisgestaltung: Die kostenlose Stufe erlaubt das Scrapen von 6 Seiten (oder 10 mit Testphase). Bezahlte Pläne starten bei 15 $/Monat für 500 Zeilen, und alle Funktionen sind sogar im Basistarif enthalten.

Warum es die Nummer 1 ist: Thunderbit ist das einzige Tool, das echte KI-Feldvorschläge, Prompts in natürlicher Sprache und Unterseiten-Scraping in einem Workflow mit 2 Klicks kombiniert. Es ist das Nächste an „Sag dem Computer einfach, was du willst“ – und es funktioniert für alle, nicht nur für Techies.

2. ParseHub

ist eine bekannte Desktop-App (Windows, Mac, Linux) mit visuellem Workflow-Builder. Sie ist beliebt bei Einsteigern und kleinen Teams, die komplexere Websites ohne Coding scrapen wollen.

- Visuelles Point-and-click: Erstelle Scraping-Projekte, indem du Elemente auf einer Seite anklickst. ParseHub versucht, „ähnliche Datenelemente automatisch zu erkennen und auszuwählen“, was die Einrichtung erleichtert.

- Bewältigt komplexe Workflows: Unterstützt Klicks durch Dropdowns, das Verarbeiten von „Mehr laden“-Schaltflächen und das Scrapen von Inhalten hinter Logins.

- Live-Vorschau und Export: Sieh deine Daten während des Scrapings und exportiere sie dann als CSV, Excel oder JSON.

- Zeitplanung und Cloud-Ausführungen: Bezahlte Pläne ermöglichen geplante Scrapes und die Ausführung in der Cloud.

Einsteigererfahrung: Einfache Scrapes sind leicht, aber fortgeschrittene Abläufe (etwa verschachtelte Daten oder bedingte Logik) erfordern eine kurze Lernphase. ParseHubs Tutorials und Live-Trainings sind dabei eine große Hilfe.

Preisgestaltung: Der kostenlose Plan erlaubt bis zu 5 Projekte (200 Seiten pro Lauf). Bezahlte Pläne starten bei 99 $/Monat für mehr Seiten und Zeitplanung.

Am besten geeignet für: Einsteiger, die komplexe Websites scrapen wollen und bereit sind, etwas Zeit ins Einlernen zu investieren.

3. Web Scraper (webscraper.io)

ist eine kostenlose Chrome-Erweiterung, die mit einem visuellen „Sitemap“-Ansatz arbeitet. Sie ist flexibel und leistungsstark, erfordert aber etwas mehr Einrichtung als KI-gestützte Tools.

- Visueller Sitemap-Builder: Lege mit Selectors und Aktionen in den Chrome DevTools fest, wie navigiert werden soll und welche Daten extrahiert werden.

- Mehrstufige Navigation: Scrape Kategorien, Unterkategorien und Detailseiten, indem du Parent-Child-Beziehungen einrichtest.

- Unterstützt dynamische Inhalte: Kann scrollen, klicken und auf AJAX-Elemente warten.

- Kostenlos und Open Source: Zu 100 % kostenlos für browserbasiertes Scraping; optionale Cloud-Dienste für Zeitplanung und größere Umfänge.

Einsteigererfahrung: Es gibt eine Lernkurve – besonders für Nicht-Techniker. Das Einrichten von Sitemaps kann technisch wirken, aber es gibt viele Tutorials und Beispielprojekte.

Preisgestaltung: Kostenlos für die Browser-Nutzung; Cloud-Pläne starten bei 50 $/Monat.

Am besten geeignet für: Technikaffine Einsteiger oder Analysten, die ein kostenloses, flexibles Tool wollen und bereit sind, die Sitemap-Logik zu lernen.

4. Octoparse

ist ein Web-Scraper mit Drag-and-drop, der sowohl eine Desktop- als auch eine Cloud-Version bietet. Er ist bekannt für seine benutzerfreundliche Oberfläche und starke Automatisierung.

- Drag-and-drop-Designer: Klicke Elemente an, um Daten zu extrahieren, baue Workflows visuell auf und handle Pagination automatisch.

- Vorgefertigte Vorlagen: Vorlagen für Amazon, Twitter, Facebook und mehr – einfach URL eingeben und loslegen.

- Cloud-Automatisierung: Scrapes in der Cloud ausführen, Aufgaben planen und IP-Rotation nutzen, um Blockierungen zu vermeiden.

- Export nach CSV, Excel, JSON oder API: Flexible Ausgabeoptionen für Business-User.

Einsteigererfahrung: Für grundlegende Aufgaben sehr zugänglich – Nutzer berichten, dass sie in 2–3 Stunden eine „grundlegende Sicherheit“ erreichen. Fortgeschrittene Funktionen wie Login oder Infinite Scroll können mehr Einarbeitung erfordern.

Preisgestaltung: Der kostenlose Plan erlaubt bis zu 10.000 Datensätze pro Export und 2 gleichzeitige lokale Aufgaben. Bezahlte Pläne starten bei 89 $/Monat für unbegrenzte Seiten und Cloud-Ausführungen.

Am besten geeignet für: Einsteiger und Analysten, die ein Gleichgewicht aus Einfachheit und Leistung suchen, besonders für wiederkehrendes oder geplantes Scraping.

5. Data Miner

ist eine Chrome/Edge-Erweiterung, die für Scraping ein „Rezept“-System verwendet. Sie eignet sich hervorragend für alltägliche Aufgaben und verfügt über eine riesige Bibliothek vorgefertigter Extraktionsregeln.

- 60.000+ vorgefertigte Rezepte: Finde ein Rezept für deine Zielseite und führe es mit einem Klick aus.

- Point-and-click-Rezepteditor: Erstelle eigene Extraktionsregeln, indem du Elemente visuell auswählst.

- Pagination und Formularausfüllung: Rezepte können durch Seiten klicken oder Suchformulare ausfüllen.

- Export nach CSV, Excel oder Google Sheets: Direkte Integration für schnelle Datenpipelines.

Einsteigererfahrung: Super einfach, wenn es bereits ein Rezept für deine Website gibt. Eigene Rezepte zu erstellen ist einsteigerfreundlich, auch wenn die Oberfläche etwas voll wirken kann.

Preisgestaltung: Kostenlos für 500 Seiten/Monat. Bezahlte Pläne starten bei 19 $/Monat für mehr Seiten und Funktionen.

Am besten geeignet für: Marketing-, Vertriebs- und Forschungsteams, die schnelle Ergebnisse wollen – besonders dann, wenn bereits ein Rezept existiert.

6. ScraperAPI

ist kein Point-and-click-Tool, aber es ist erwähnenswert für Teams mit etwas technischem Know-how. Es ist ein API-Dienst, der die harten Teile des Scrapings übernimmt (Proxies, CAPTCHAs, JavaScript-Rendering).

- Plug-and-play-API: Rufe einfach die API mit deiner Ziel-URL auf, und ScraperAPI liefert HTML oder JSON zurück.

- Automatische Proxy-Rotation und CAPTCHA-Lösung: Keine IP-Blocks oder Anti-Bot-Probleme mehr.

- Geo-Targeting und Endpunkte für strukturierte Daten: Scrape aus verschiedenen Ländern oder hole strukturierte Daten für gängige Websites.

Einsteigererfahrung: Am einfachsten für Entwickler oder Teams mit etwas Skripting-Erfahrung. Kann mit Google Sheets, Zapier oder Low-Code-Plattformen auch von Nicht-Programmierern genutzt werden.

Preisgestaltung: Kostenloser Plan mit 5.000 API-Aufrufen pro Monat. Bezahlte Pläne starten bei 49 $/Monat für 100.000 Anfragen.

Am besten geeignet für: Teams mit leichten Coding-Kenntnissen, die zuverlässiges, skalierbares Backend-Scraping wollen.

7. Import.io

ist eine cloudbasierte Plattform mit einem visuellen Extraktor. Sie richtet sich an Business-User, die Webseiten in strukturierte Daten verwandeln wollen – ganz ohne Desktop-Installation.

- Point-and-click-Training: Markiere Datenpunkte auf einer Seite, und Import.io verallgemeinert das Muster für dich.

- Cloudbasierte Zeitplanung: Lasse Extraktoren nach Zeitplan laufen und baue APIs oder Webhooks für die Datenübertragung.

- Datenbereinigung und Transformation: Integrierte Tools bereinigen und formatieren deine Daten vor dem Export.

Einsteigererfahrung: Für einfache Extraktionen sehr zugänglich. Die Plattform bietet eine kostenlose Testphase, der dauerhafte Einsatz richtet sich jedoch an Enterprise-Kunden.

Preisgestaltung: Kostenlose Testphase verfügbar; bezahlte Pläne starten bei etwa 299 $/Monat (für Unternehmen mit individuellem Angebot).

Am besten geeignet für: Business-Teams, die eine robuste, verwaltete Lösung für wiederkehrende Webdatenprojekte brauchen.

8. Content Grabber

ist ein Desktop-Tool für Business-Automatisierung und groß angelegtes Scraping.

- Visueller Editor: Entwerfe Extraktionsabläufe, indem du dich durch Websites klickst – für die meisten Aufgaben ohne Coding.

- Automatisierung und Zeitplanung: Mehrere Agenten parallel ausführen, Scrapes planen und direkt mit Datenbanken oder APIs integrieren.

- Enterprise-Funktionen: Fehlerbehandlung, Benachrichtigungen und eine zentrale Verwaltungskonsole.

Einsteigererfahrung: Hohe Lernkurve, außer du hast bereits einen technischen Hintergrund. Am besten für IT- oder Operations-Teams, die bereit sind, in eine bezahlte Lösung zu investieren.

Preisgestaltung: Keine kostenlose Version; Lizenzen kosten mehrere tausend Dollar.

Am besten geeignet für: Unternehmen und Datenteams, die hochgradig anpassbares Scraping im großen Maßstab brauchen.

9. Visual Web Ripper

ist ein klassischer Windows-Desktop-Scraper mit Point-and-click-Oberfläche.

- Vorlagen- und Projekt-Designer: Erstelle Scraper, indem du Daten visuell auswählst – unterstützt Listings, Detailseiten und Pagination.

- Zeitplanung und Automatisierung: Projekte nach Zeitplan ausführen und als CSV, XML, SQL und mehr ausgeben.

- Einmalige Lizenz: Einmal zahlen, für immer nutzen.

Einsteigererfahrung: Für typische Projekte relativ einfach, besonders wenn du dich mit Windows-Software wohlfühlst. Die Oberfläche ist etwas altmodisch, aber logisch.

Preisgestaltung: Kein kostenloser Plan; einmalige Lizenz um 349 $ pro Nutzer.

Am besten geeignet für: KMU und Power-User unter Windows, die einen zuverlässigen Offline-Scraper wollen.

10. Dexi.io

(früher CloudScrape) ist eine cloudbasierte Plattform mit browserbasiertem visuellem Editor und Workflow-Automatisierung.

- Drag-and-drop-Robot-Designer: Baue Scraping-Bots direkt im Browser mit Blöcken und Point-and-click-Auswahlen.

- Workflow-Automatisierung: Verknüpfe Bots, plane Läufe und integriere Slack, Sheets oder APIs.

- Teamzusammenarbeit: Benutzerverwaltung, Versionskontrolle und Cloud-Speicher für Ergebnisse.

Einsteigererfahrung: Grundlegende Aufgaben sind einfach, aber fortgeschrittene Workflows (Schleifen, Bedingungen) erfordern etwas Einarbeitung. Dokumentation und Support sind verfügbar.

Preisgestaltung: Kostenlose Testphase; Business-Pläne starten typischerweise bei einigen hundert Dollar pro Monat.

Am besten geeignet für: Operations- und Datenteams, die skalierbares, wiederholbares Scraping mit Automatisierung brauchen.

Die einfachsten Web-Scraper auf einen Blick

| Tool-Name | Bewertung der Benutzerfreundlichkeit | Idealer Anwendungsfall | Kostenloser Plan verfügbar | Bemerkenswerte Funktionen |

|---|---|---|---|---|

| Thunderbit | ⭐⭐⭐⭐⭐ | Unstrukturiertes Web Scraping | Ja | KI-Feldvorschläge, Unterseiten-Scraping, Sofort-Export, kostenlose Chrome-Erweiterung |

| ParseHub | ⭐⭐⭐⭐ | Komplexe Automatisierungs-Workflows | Ja | Visueller Workflow, Cloud-Ausführungen, Live-Support |

| Web Scraper | ⭐⭐⭐⭐ | Schnelle, flexible Extraktion | Ja | Visuelle Sitemap, mehrstufiges Scraping |

| Octoparse | ⭐⭐⭐⭐ | Häufiges, komplexes Scraping | Ja | Drag-and-drop, Vorlagen, Cloud-Zeitplanung |

| Data Miner | ⭐⭐⭐⭐ | Alltagsaufgaben, Rezepte | Ja | 60.000+ Rezepte, Batch-Scraping, Sheets-Export |

| ScraperAPI | ⭐⭐⭐ | API-getrieben, technische Teams | Ja | Proxy-Rotation, CAPTCHA-Umgehung, JSON-Ausgabe |

| Import.io | ⭐⭐⭐⭐ | Cloudbasiert, Business-Teams | Kostenlose Testphase | Visuelles Training, Zeitplanung, Datenbereinigung |

| Content Grabber | ⭐⭐⭐ | Enterprise, Automatisierung | Nein | Visuelles Skripting, direkte DB-/API-Integration |

| Visual Web Ripper | ⭐⭐⭐⭐ | Windows, strukturierte Daten | Nein | Point-and-click-Vorlagen, Einmal-Lizenz |

| Dexi.io | ⭐⭐⭐⭐ | Workflow-Automatisierung, Teams | Kostenlose Testphase | Drag-and-drop, Cloud-Zeitplanung, Integrationen |

So wählst du den einfachsten Web-Scraper für deine Bedürfnisse

Hier ist meine Schnellhilfe für die Wahl des richtigen Tools:

- Kompletter Einsteiger, du willst sofort Ergebnisse? Starte mit Thunderbit oder Data Miner (besonders wenn es für deine Website schon ein Rezept gibt).

- Du musst komplexe oder dynamische Websites scrapen? Probiere Octoparse oder ParseHub – beide bewältigen fortgeschrittene Abläufe über eine visuelle Oberfläche.

- Mit ein wenig technischer Einrichtung kommst du klar? Web Scraper ist kostenlos und leistungsstark, aber rechne mit einer Lernkurve.

- Du willst wiederkehrende Jobs automatisieren oder im Team arbeiten? Dexi.io, Import.io oder Content Grabber sind für Business-Automatisierung gebaut.

- Du hast einen Entwickler zur Hand? ScraperAPI ist ein Plug-and-play-Backend für individuelle Workflows.

Starte immer mit einem kostenlosen Plan oder einer Testphase. Versuche, einen Beispielausschnitt deiner Zieldaten zu scrapen, und schau, welches Tool für dich „klickt“. Manchmal ist die beste Wahl die, die sich für deinen Workflow am natürlichsten anfühlt.

Fazit: Smarter scrapen, nicht härter

Web Scraping im Jahr 2025 ist nicht nur etwas für Entwickler – es ist für alle, die Webdaten schnell brauchen. Die Tools auf dieser Liste zeigen, dass du in Minuten statt in Monaten von „Ich brauche diese Daten“ zu „Ich habe sie in meiner Tabelle“ kommen kannst. Egal, ob du im Vertrieb arbeitest, E-Commerce managst oder einfach nur keine Lust mehr auf Copy-and-Paste hast: Es gibt einen einsteigerfreundlichen Web-Scraper für dich.

Wenn du sehen willst, wie modernes, KI-gestütztes Scraping sich anfühlt, . Und wenn Thunderbit nicht perfekt passt, teste einfach ein paar andere aus dieser Liste – es gab nie einen besseren Zeitpunkt, die langweiligen Aufgaben zu automatisieren und dich auf das Wesentliche zu konzentrieren.

Viel Erfolg beim Scraping – und möge deine Daten immer sauber, strukturiert und einsatzbereit sein. Weitere Tipps und tiefere Einblicke findest du im .

FAQs

1. Was macht einen Web-Scraper für Einsteiger „einfach zu nutzen“?

Die einfachsten Web-Scraper benötigen kein Coding, haben eine intuitive visuelle Oberfläche, erfordern nur wenig Einrichtung und übernehmen die Automatisierung (wie Pagination und Unterseiten) für dich. Außerdem solltest du Daten mit einem Klick exportieren können und guten Support sowie Dokumentation bekommen.

2. Ist Thunderbit wirklich der einfachste Web-Scraper für nicht-technische Nutzer?

Ja – Thunderbits KI-gestützte Feldvorschläge und der Workflow mit 2 Klicks machen das Tool außergewöhnlich einfach. Du beschreibst einfach, was du willst, klickst auf „Scrapen“ und erhältst strukturierte Daten – ohne Coding oder manuelle Einrichtung.

3. Kann ich diese Web-Scraper kostenlos nutzen?

Die meisten Tools auf dieser Liste bieten einen kostenlosen Plan oder eine Testphase. Thunderbit, ParseHub, Web Scraper, Octoparse und Data Miner haben alle kostenlose Stufen, auch wenn du für größere oder häufigere Aufgaben möglicherweise upgraden musst.

4. Welcher Web-Scraper eignet sich am besten für wiederkehrendes oder automatisiertes Scraping?

Für wiederkehrende Aufgaben solltest du nach Tools mit Zeitplanung und Cloud-Automatisierung suchen – etwa Thunderbit (geplantes Scraping), Octoparse, Dexi.io oder Import.io. Damit kannst du Scrapes nach Zeitplan ausführen und Daten automatisch liefern lassen.

5. Woher weiß ich, welcher Web-Scraper für mein Unternehmen der richtige ist?

Stimme deinen Anwendungsfall (z. B. Lead-Generierung, Preis-Monitoring) und deinen technischen Komfort mit den Funktionen des Tools ab. Starte mit einer kostenlosen Testphase, probiere eine echte Aufgabe aus und schau, welches Tool sich am natürlichsten anfühlt. Wenn du nicht weiterkommst, achte auf Tools mit starkem Support und guten Tutorials.

Bereit loszulegen? oder andere Optionen aus dieser Liste erkunden – und der No-Code-Datenrevolution beitreten.

Mehr erfahren