Daten sind heutzutage das Lebenselixier für jedes moderne Unternehmen – aber sie zu sammeln, fühlt sich oft eher wie ein chaotisches Jonglieren an als wie ein einfacher Tankstopp. Im Jahr 2025 ist die Menge und Vielfalt an Informationen, die Unternehmen brauchen, einfach riesig. Egal, ob du mal eben eine Kundenumfrage starten, die Preise der Konkurrenz im Blick behalten oder eine neue Lead-Liste aufbauen willst: Mit dem richtigen Online-Datenerfassungsdienst wird aus stundenlanger Fleißarbeit ein paar Klicks und eine frische Tabelle. Nach Jahren in der SaaS- und Automatisierungswelt weiß ich: Das passende Tool entscheidet oft über Erfolg oder Frust – und manchmal auch über die eigenen Nerven.

Aber bei so vielen Möglichkeiten – von Umfrageplattformen über Web-Scraper bis hin zu Formular-Buildern – wie findest du das richtige Tool? In diesem Guide stelle ich dir die 9 besten Online-Datenerfassungsdienste für 2025 vor, zeige ihre Stärken und Schwächen und helfe dir, das perfekte Werkzeug für deine Anforderungen zu finden. Egal, ob du im Vertrieb, in der Marktforschung oder einfach nur genervt vom ewigen Copy-Paste bist – hier ist für jeden was dabei.

Warum Online-Datenerfassungsdienste für Unternehmen heute unverzichtbar sind

Ein Blick auf die Zahlen: Bis 2025 werden weltweit schätzungsweise an Daten generiert. Unternehmen, die diese Datenflut gezielt nutzen, wachsen . Aber: Entscheidend ist, die richtigen Daten, zur richtigen Zeit, aus den richtigen Quellen zu erfassen – das trennt die Gewinner vom Rest.

Online-Datenerfassungsdienste sind das Rückgrat datengetriebener Entscheidungen. Sie nehmen dir die lästigen Aufgaben ab – Kundenfeedback einholen, Webdaten sammeln, Lead-Listen erstellen – damit dein Team sich auf Analyse und Umsetzung konzentrieren kann. Vertriebsteams holen sich mit Web-Scrapern tausende Leads pro Monat, E-Commerce-Unternehmen checken Preise und Lagerbestände der Konkurrenz in Echtzeit. Im Umfragebereich setzen auf Online-Umfragen für Kundenfeedback, und nutzen diese Rückmeldungen für die Produktentwicklung.

Fazit: Egal, ob du strukturierte Umfrageantworten oder unstrukturierte Webdaten sammelst – das richtige Tool spart Zeit, reduziert Fehler und verschafft dir einen echten Vorsprung.

So haben wir die besten Online-Datenerfassungsdienste ausgewählt

Nicht jedes Tool ist gleich. Nach diesen Kriterien habe ich die Top 9 ausgewählt:

- Automatisierung & KI: Spart das Tool manuelle Arbeit? Gibt es Terminplanung, KI-gestützte Feldvorschläge oder automatische Anpassungen bei Änderungen?

- Benutzerfreundlichkeit: Können auch Nicht-Programmierer oder Business-User direkt loslegen? Drag-and-Drop und KI-Unterstützung waren Pluspunkte.

- Integration & Export: Lässt sich das Tool einfach mit Excel, Google Sheets, Notion, Airtable oder deinem CRM verbinden?

- Skalierbarkeit & Zuverlässigkeit: Kommt das Tool auch mit tausenden Antworten oder Datensätzen klar? Ist es robust genug für den Unternehmenseinsatz?

- Preis & Mehrwert: Gibt es einen kostenlosen Einstieg? Ist die Preisgestaltung fair und wächst mit deinen Anforderungen?

- Bester Einsatzzweck: Manche Tools sind Umfrage-Spezialisten, andere Web-Scraping-Profis. Ich habe jedes Tool dem passenden Szenario zugeordnet.

Außerdem habe ich Nutzerbewertungen, Expertenmeinungen und aktuelle Feature-Updates einfließen lassen, damit du eine praxisnahe und aktuelle Auswahl bekommst.

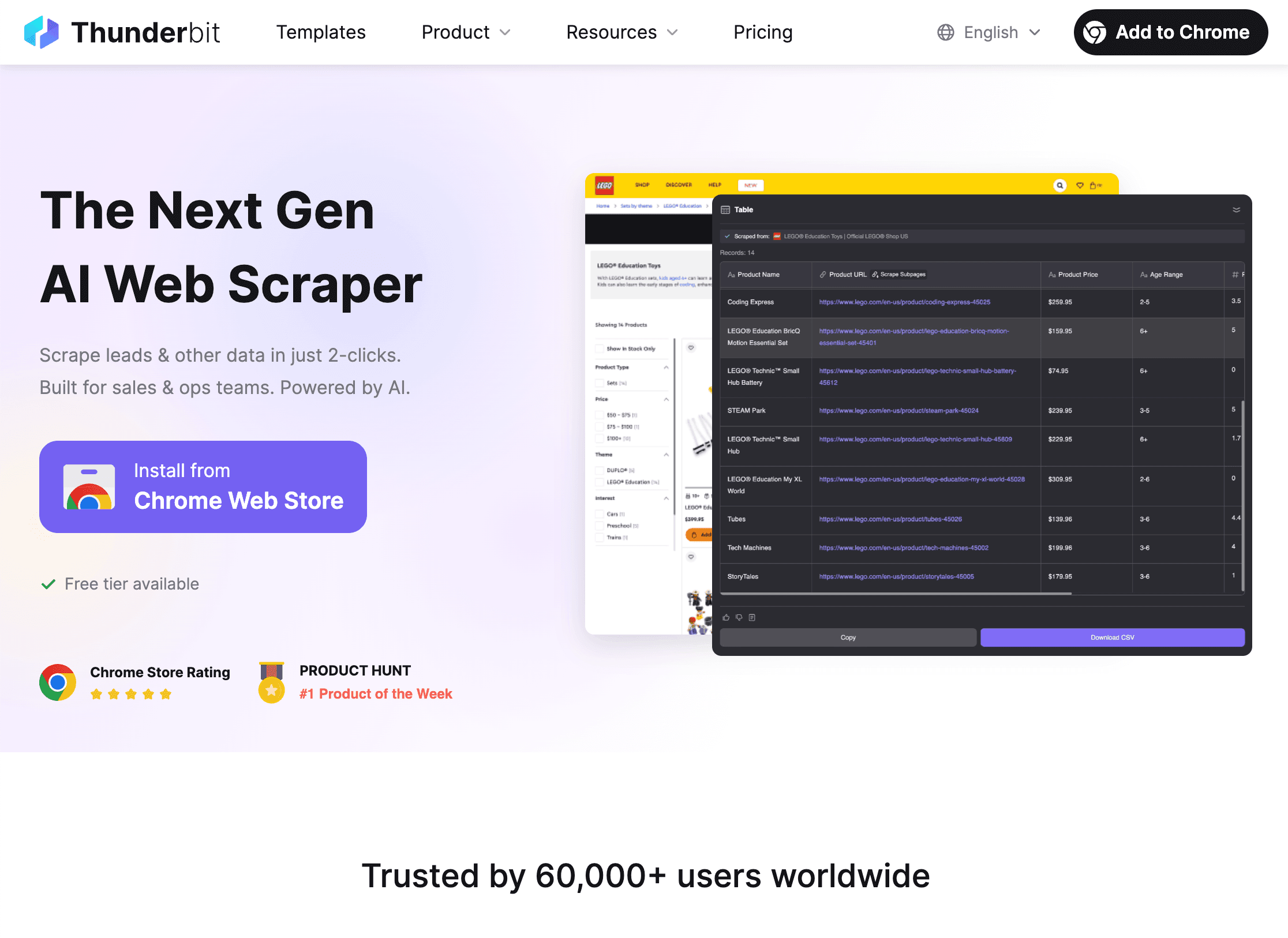

1. Thunderbit

ist meine erste Wahl, wenn es um Webdatenerfassung geht, die weit über klassische Formulare hinausgeht. Als richtet sich Thunderbit an Business-User, die strukturierte Daten von jeder Website extrahieren möchten – ganz ohne Programmierung, Vorlagen oder Frust.

ist meine erste Wahl, wenn es um Webdatenerfassung geht, die weit über klassische Formulare hinausgeht. Als richtet sich Thunderbit an Business-User, die strukturierte Daten von jeder Website extrahieren möchten – ganz ohne Programmierung, Vorlagen oder Frust.

Was Thunderbit besonders macht:

- KI-gestützte Einrichtung: Mit „KI-Felder vorschlagen“ scannt Thunderbit die Seite, erkennt relevante Daten und richtet den Scraper automatisch ein – wie ein Assistent, der sofort versteht, was du brauchst.

- Unterseiten & Paginierung: Du brauchst Daten von Detailseiten oder über mehrere Seiten hinweg? Thunderbit folgt Links, klickt auf „Weiter“ und sammelt alles in einer Tabelle – vollautomatisch.

- Sofort-Export: Exportiere deine Daten direkt nach Excel, Google Sheets, Airtable oder Notion. Keine Zusatzkosten, kein CSV-Chaos.

- Unstrukturierte Daten: Thunderbit kann nicht nur Tabellen, sondern auch E-Mails, Telefonnummern, Bilder und sogar Daten aus PDFs oder Bildern per OCR extrahieren.

- Zeitplanung & Cloud-Scraping: Lege wiederkehrende Aufgaben fest („täglich um 9 Uhr scrapen“) und lass Thunderbits Cloud-Server die Arbeit übernehmen – bis zu 50 Seiten gleichzeitig.

Ideal für: Lead-Generierung im Vertrieb, Wettbewerbsbeobachtung, E-Commerce, Marktforschung und alle, die komplexe oder unübersichtliche Websites auslesen möchten.

Preise: Kostenlos für bis zu 6 Seiten (bzw. 10 mit Test-Boost), danach ab 15 $/Monat für 500 Zeilen. Alle Funktionen inklusive – keine Zusatzkosten für Exporte oder KI.

Tipp: Wer genug vom Copy-Paste oder fehleranfälligen Scrapern hat, wird Thunderbits KI-Ansatz lieben. Besonders stark bei unstrukturierten Daten – etwa für Nischenverzeichnisse, Produktkataloge oder Kontaktdaten auf chaotischen Seiten.

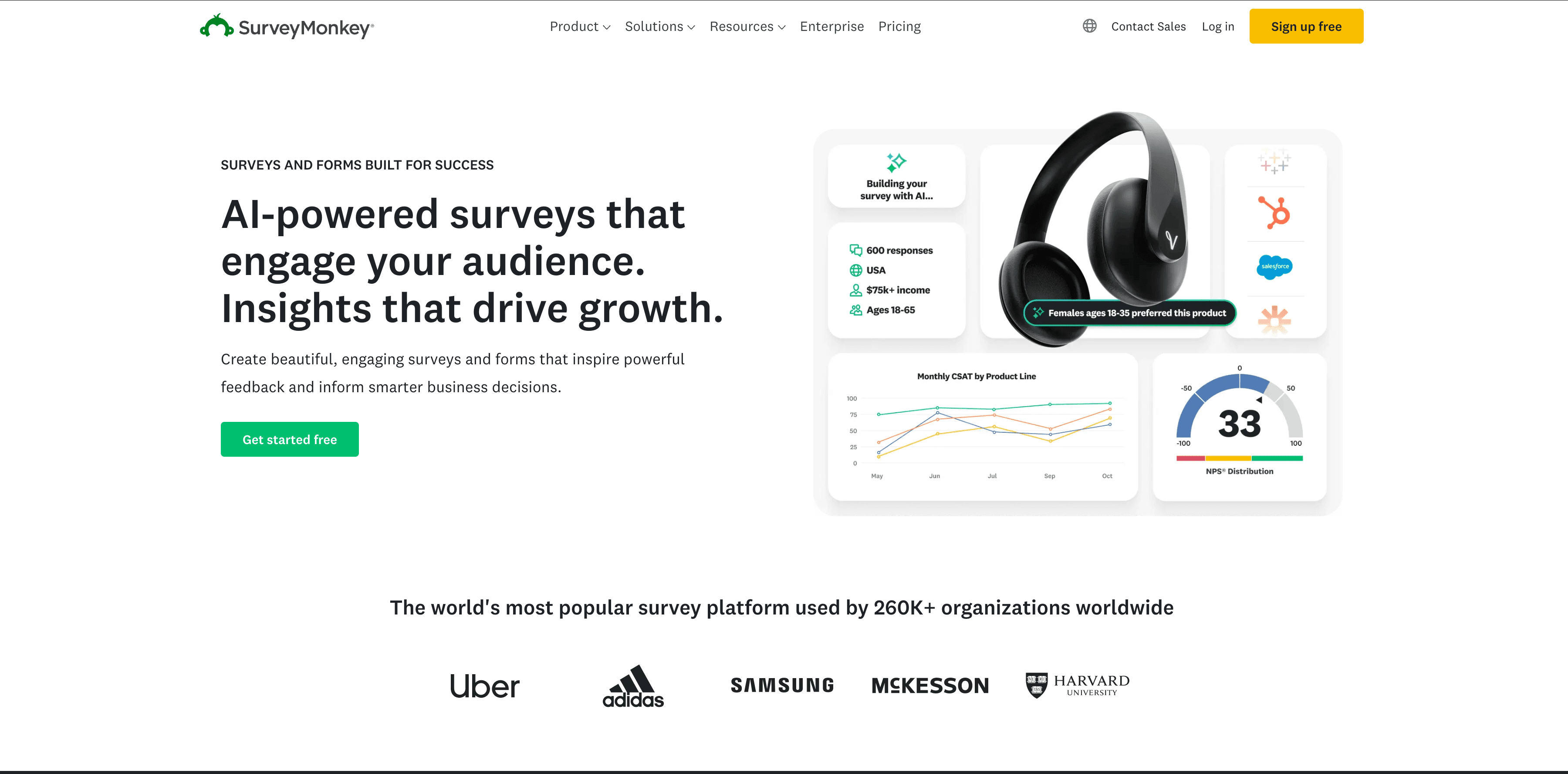

2. SurveyMonkey

ist der Klassiker unter den Online-Umfrageplattformen – vertraut von Start-ups bis Fortune 500, wenn es um Kunden-, Mitarbeiter- oder Marktforschung im großen Stil geht.

ist der Klassiker unter den Online-Umfrageplattformen – vertraut von Start-ups bis Fortune 500, wenn es um Kunden-, Mitarbeiter- oder Marktforschung im großen Stil geht.

Was SurveyMonkey besonders macht:

- Umfragevorlagen & KI-Builder: Über 400 Vorlagen und ein KI-gestützter Fragen-Generator ermöglichen professionelle Umfragen in wenigen Minuten.

- Erweiterte Logik: Unterstützt Sprunglogik, Verzweigungen und sogar A/B-Tests für differenziertes Feedback.

- Verteilung & Panel: Teile Umfragen per Web, E-Mail, Social Media oder kaufe gezielte Antworten aus dem globalen SurveyMonkey-Panel.

- Analyse & Integrationen: Echtzeit-Dashboards, Export zu CSV/SPSS und Anbindung an Salesforce, Mailchimp, Slack u.v.m.

Ideal für: Kundenzufriedenheitsumfragen, Mitarbeiter-Feedback, Marktforschung und alle, die skalierbares, professionelles Feedback benötigen.

Preise: Kostenlos (10 Fragen, 25 Antworten/Umfrage); kostenpflichtig ab ca. 25 $/Monat. Einige Integrationen und Features nur in höheren Tarifen.

Tipp: Das „Audience“-Panel ist Gold wert, wenn du keine eigene Liste hast – kaufe gezielt Antworten nach Zielgruppe oder Region.

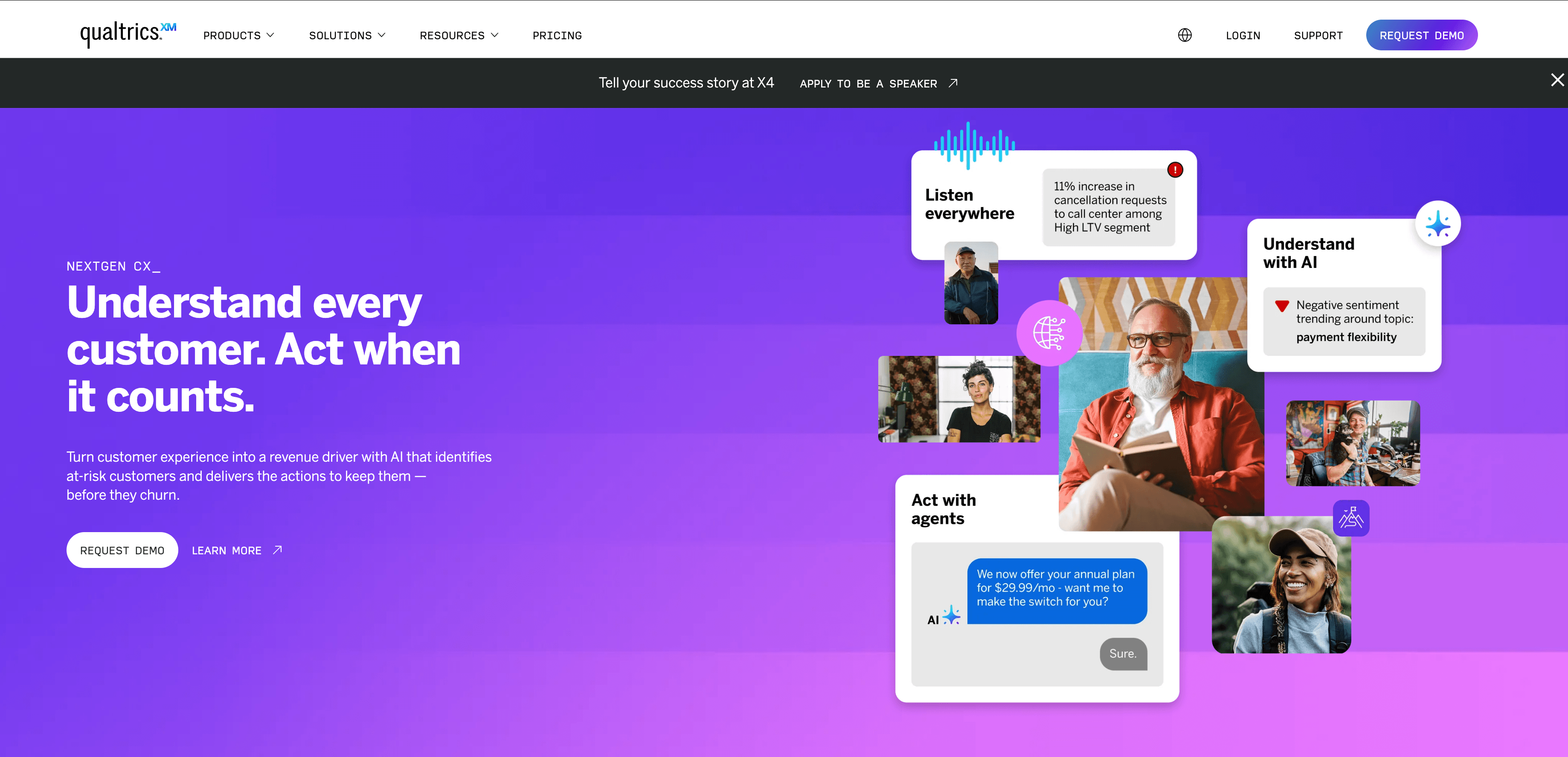

3. Qualtrics

ist der Platzhirsch für Enterprise-Umfragen, Experience Management und tiefgehende Analysen.

ist der Platzhirsch für Enterprise-Umfragen, Experience Management und tiefgehende Analysen.

Was Qualtrics besonders macht:

- Komplexe Umfragelogik: Dynamische Verzweigungen, eingebettete Daten, Randomisierung und fortgeschrittene Fragetypen (Conjoint, Max-Diff etc.).

- KI-Analysen: Integrierte Sentiment-Analyse (Text iQ), prädiktive Analysen und Stats iQ für anspruchsvolle Auswertungen – ohne Statistikstudium.

- Workflow-Automatisierung: Aktionen auf Basis von Antworten auslösen (z. B. Support-Ticket bei niedrigem NPS), Integration mit Salesforce, SAP u.v.m.

- Enterprise-Sicherheit & Skalierung: Rollenbasierte Zugriffe, Compliance (GDPR, HIPAA) und starker Support.

Ideal für: Große Unternehmen, Hochschulen oder Forschungsteams mit komplexen, großvolumigen Feedback- oder Marktforschungsprojekten.

Preise: Nur für Unternehmen (individuelle Angebote, meist im fünfstelligen Bereich pro Jahr).

Tipp: Wer tiefgehende Insights, individuelle Workflows oder die direkte Anbindung an Geschäftsprozesse braucht, ist mit Qualtrics bestens beraten.

4. Google Forms

ist die unkomplizierte, komplett kostenlose Lösung für schnelle Umfragen, Abstimmungen oder interne Datenerfassung.

ist die unkomplizierte, komplett kostenlose Lösung für schnelle Umfragen, Abstimmungen oder interne Datenerfassung.

Was Google Forms besonders macht:

- Einfachheit: Drag-and-Drop-Builder, Echtzeit-Zusammenarbeit und direkte Verknüpfung mit Google Sheets.

- Unbegrenzte Nutzung: Keine Limits bei Formularen oder Antworten – ideal für kleine Teams oder interne Projekte.

- Integration: Nahtlose Anbindung an Google Workspace (Sheets, Gmail) und erweiterbar über Zapier oder Google Apps Script.

Ideal für: Schnelle Umfragen, Event-Anmeldungen, interne Abstimmungen oder jedes Szenario, in dem du in Minuten ein Formular brauchst.

Preise: Kostenlos für alle mit Google-Konto.

Tipp: Nicht das individuellste oder analytischste Tool, aber unschlagbar in Sachen Schnelligkeit und Einfachheit – perfekt für kleine Unternehmen oder Ad-hoc-Projekte.

5. Typeform

ist der Spezialist für interaktive, ansprechende Umfragen – mit einem dialogorientierten, Frage-für-Frage-Design, das die Abschlussrate deutlich steigert.

ist der Spezialist für interaktive, ansprechende Umfragen – mit einem dialogorientierten, Frage-für-Frage-Design, das die Abschlussrate deutlich steigert.

Was Typeform besonders macht:

- Konversationelles Erlebnis: Formulare wirken wie ein Gespräch, nicht wie ein Fragebogen – mit , doppelt so hoch wie der Branchenschnitt.

- Design & Anpassung: Schöne Vorlagen, individuelle Designs und einfache Einbettung.

- Logik & Automatisierung: Visueller Logik-Builder, Workflow-Automatisierung (z. B. E-Mails senden, CRM-Anbindung) und Integrationen mit HubSpot, Slack u.v.m.

Ideal für: Marketing, Lead-Generierung, Nutzerforschung oder überall dort, wo Nutzererlebnis und hohe Rücklaufquoten entscheidend sind.

Preise: Kostenlos (10 Antworten/Monat); kostenpflichtig ab 25 $/Monat.

Tipp: Je attraktiver und angenehmer das Formular, desto mehr Antworten bekommst du. Typeform ist meine Empfehlung für externe Umfragen, bei denen jede Antwort zählt.

6. Zoho Survey

ist das ideale Umfragetool für Unternehmen, die bereits Zoho nutzen – oder für alle, die solide Funktionen zu einem günstigen Preis suchen.

ist das ideale Umfragetool für Unternehmen, die bereits Zoho nutzen – oder für alle, die solide Funktionen zu einem günstigen Preis suchen.

Was Zoho Survey besonders macht:

- Zoho-Integration: Nahtlose Anbindung an Zoho CRM, Campaigns, Analytics und mehr.

- Mehrsprachigkeit & Mobil: Unterstützt Umfragen in mehreren Sprachen und Offline-Datenerfassung per App.

- Automatisierung: Sprunglogik, E-Mail-Trigger und Workflow-Integration – besonders stark im Zusammenspiel mit anderen Zoho-Apps.

Ideal für: Kleine und mittlere Unternehmen, vor allem mit bestehender Zoho-Infrastruktur.

Preise: Kostenlos (100 Antworten/Umfrage); kostenpflichtig ab ca. 8 $/Monat (bei jährlicher Zahlung).

Tipp: Wer Zoho CRM nutzt, sollte Zoho Survey unbedingt testen – so schließt du die Lücke zwischen Feedback und Kundendaten.

7. JotForm

ist das Schweizer Taschenmesser unter den Online-Formularen – ideal für Umfragen, Bestellungen, Anmeldungen und Zahlungsabwicklung.

ist das Schweizer Taschenmesser unter den Online-Formularen – ideal für Umfragen, Bestellungen, Anmeldungen und Zahlungsabwicklung.

Was JotForm besonders macht:

- Drag-and-Drop-Builder: Über 2.000 Vorlagen und eine riesige Widget-Bibliothek (E-Signatur, Rechner, Datei-Uploads u.v.m.).

- Bedingte Logik & Workflows: Felder ein-/ausblenden, automatische E-Mails, Freigabeprozesse und berechnete Felder.

- Zahlungsintegration: Zahlungen direkt im Formular via PayPal, Stripe, Square u.a. abwickeln.

- Integrationen: 100+ direkte Integrationen (Salesforce, Google Drive, Airtable etc.), plus Zapier und API.

Ideal für: KMU, die flexible Formulare für Anmeldungen, Bestellungen, Umfragen oder komplexe Datenerfassung brauchen.

Preise: Kostenlos (5 Formulare, 100 Einreichungen/Monat); kostenpflichtig ab 34 $/Monat.

Tipp: JotForm ist ideal, wenn du mehr als nur Umfrageantworten erfassen willst – z. B. Event-Anmeldungen, Bestellformulare oder alles, was Berechnungen oder Zahlungen erfordert.

8. QuestionPro

ist eine funktionsreiche Umfrageplattform für Forscher, akademische Teams und Unternehmen mit Bedarf an fortgeschrittenen Fragetypen und Analysen.

ist eine funktionsreiche Umfrageplattform für Forscher, akademische Teams und Unternehmen mit Bedarf an fortgeschrittenen Fragetypen und Analysen.

Was QuestionPro besonders macht:

- Erweiterte Fragetypen: Unterstützt Conjoint, Max-Diff, Side-by-Side-Matrizen u.v.m. – ideal für Marktforschung.

- Komplexe Logik: Detaillierte Verzweigungen, Schleifen und Qualitätskontrollen (z. B. Aufmerksamkeits-Checks, Betrugserkennung).

- Panel-Management: Aufbau und Verwaltung von Teilnehmer-Panels für laufende Forschung.

- Integrationen: Google Sheets, Tableau, Salesforce, HubSpot u.a. (teilweise höhere Tarife erforderlich).

Ideal für: Marktforschung, akademische Studien, groß angelegte Feedback-Programme oder alle, die forschungsstarke Umfragefunktionen brauchen.

Preise: Kostenlose Basisversion; kostenpflichtig ab ca. 85 $/Nutzer/Monat für Teams.

Tipp: Wer „Qualtrics-Power“ ohne Enterprise-Preis sucht, findet in QuestionPro eine starke Alternative – besonders für forschungsintensive Teams.

9. Alchemer

(ehemals SurveyGizmo) ist das Tool für Unternehmen, die maximale Flexibilität, tiefe Anpassung und Workflow-Automatisierung ohne Enterprise-Ballast suchen.

(ehemals SurveyGizmo) ist das Tool für Unternehmen, die maximale Flexibilität, tiefe Anpassung und Workflow-Automatisierung ohne Enterprise-Ballast suchen.

Was Alchemer besonders macht:

- Maximale Anpassung: Erweiterte Verzweigungen, Scripting, Quoten und individuelles Branding (sogar eigenes HTML/CSS).

- Workflow-Automatisierung: 400+ Integrationen (CRM, Datenbanken, Helpdesks), unbegrenzt in allen Tarifen, und leistungsstarke Trigger (z. B. automatische Support-Tickets aus Umfrageantworten).

- Enterprise-Features: Rollenbasierte Zugriffe, SSO, hohe Sicherheit und schnelle Inbetriebnahme (meist in Tagen, nicht Monaten).

- Kosteneffizient: Bietet 90 % der Qualtrics-Funktionen zu etwa 20 % des Preises.

Ideal für: Unternehmen oder Teams, die maßgeschneiderte Umfragen, komplexe Feedback-Workflows oder tiefe Integration mit Geschäftssystemen brauchen.

Preise: Team- und Enterprise-Tarife (mittleres Preissegment, individuelle Angebote, deutlich günstiger als Qualtrics).

Tipp: Wer möchte, dass sich die Umfrageplattform an das eigene Business anpasst – und nicht umgekehrt – ist mit Alchemer bestens beraten.

Vergleichstabelle: Online-Datenerfassungsdienste im Überblick

| Service | Ideal für | Automatisierung & KI | Integrationen | Startpreis | Besonderes Merkmal |

|---|---|---|---|---|---|

| Thunderbit | Web-Scraping, Lead-Generierung, E-Commerce | KI-gestützt, Unterseiten/Paginierung, Zeitplan | Excel, Sheets, Airtable, Notion | Kostenlos, 15 $/Monat | Einfachster KI-Web-Scraper, 2-Klick-Setup, auch für unstrukturierte Daten |

| SurveyMonkey | Kunden-/Mitarbeiterfeedback, Marktforschung | KI-Fragen-Builder, Sprunglogik, A/B | Salesforce, Mailchimp, Slack, mehr | Kostenlos, 25 $/Monat | 400+ Vorlagen, Antworten aus Audience-Panel kaufen |

| Qualtrics | Enterprise-Forschung, CX/EX-Programme | Erweiterte Logik, Text iQ, Workflows | SAP, Salesforce, BI-Tools, APIs | $$$ (individuell) | Tiefe Analysen, Workflow-Automatisierung, Enterprise-Skalierung |

| Google Forms | Schnelle Umfragen, interne Formulare | Einfache Sprunglogik, Auto-Link zu Sheets | Google Workspace, Zapier | Kostenlos | Komplett kostenlos, sofort startklar, unbegrenzte Antworten |

| Typeform | Hohe Beteiligung, Marketing, Lead-Gen | Konversationelles UI, Logik, Workflows | HubSpot, Slack, Zapier, Webhooks | Kostenlos, 25 $/Monat | 47 % Abschlussrate, ansprechendes Design |

| Zoho Survey | KMU, Zoho-Nutzer, Mehrsprachigkeit | Sprunglogik, E-Mail-Trigger, Mobile-App | Zoho CRM, Analytics, Zapier, API | Kostenlos, 8 $/Monat | Nahtlose Zoho-Integration, günstig für KMU |

| JotForm | Flexible Formulare, Bestellungen, Anmeldungen | Bedingte Logik, Auto-E-Mails, Zahlungen | 100+ Apps, Salesforce, Drive, API | Kostenlos, 34 $/Monat | 2.000+ Vorlagen, Widgets, Zahlungs- & E-Signatur-Support |

| QuestionPro | Marktforschung, Wissenschaft, Großprojekte | Conjoint, Verzweigungen, Panel-Management, QA | Sheets, Tableau, Salesforce, API | Kostenlos, 85 $/Monat | Forschungsstarke Features, Panel-Management |

| Alchemer | Individuelle Workflows, Enterprise-Feedback | Erweiterte Logik, Scripting, Trigger | 400+ (CRM, DB, Helpdesk), API | $$ (individuell) | Maximale Flexibilität, unbegrenzte Integrationen, schnelle Umsetzung |

So findest du den passenden Online-Datenerfassungsdienst

Welches Tool passt zu dir? Hier meine Empfehlungen:

- Du willst komplexe Webdaten scrapen, Leads automatisieren oder Wettbewerber überwachen? Dann ist mit KI-Setup und Sofort-Export die einfachste Wahl für Web-Scraping 2025.

- Du brauchst schnelle, interne Umfragen oder einfaches Feedback? ist kostenlos, schnell und für einfache Anforderungen ideal.

- Du willst hohe Rücklaufquoten und ein tolles Nutzererlebnis? ist der König der interaktiven Formulare.

- Du nutzt bereits Zoho für CRM oder Prozesse? fügt sich nahtlos in deinen Workflow ein.

- Du brauchst fortgeschrittene Analysen, Verzweigungen oder Enterprise-Feedback? , oder sind deine Optionen – je nach Budget und Integrationsbedarf.

- Du suchst flexible Formulare für Bestellungen, Anmeldungen oder Zahlungen? ist der vielseitigste All-in-One-Builder.

- Du willst eine bewährte, vielseitige Umfrageplattform? ist nach wie vor das Arbeitstier für die meisten Feedback-Anforderungen.

Tipp: Starte mit einer kostenlosen Testversion, probiere ein kleines Pilotprojekt und finde heraus, welches Tool am besten zu deinem Team und Workflow passt. Lass dich nicht von Features blenden, die du nie brauchst – wähle das einfachste Tool, das deine Anforderungen erfüllt und sich gut integrieren lässt.

Denk dran: Der wahre Mehrwert liegt nicht nur im Sammeln von Daten, sondern darin, daraus Maßnahmen abzuleiten. Das beste Tool ist das, das dir hilft, den Kreis zu schließen – analysieren, teilen und bessere Entscheidungen treffen.

Häufige Fragen (FAQ)

1. Was ist der Unterschied zwischen einem Web-Scraper und einer Umfrageplattform?

Ein Web-Scraper (wie Thunderbit) extrahiert automatisch Daten von Websites – ideal für Produktinfos, Preise oder Kontaktdaten. Umfrageplattformen (wie SurveyMonkey oder Typeform) dienen dazu, strukturiertes Feedback von Menschen per Formular oder Fragebogen zu sammeln.

2. Welches Tool eignet sich am besten für Kundenfeedback?

Für schnelle, einfache Umfragen sind Google Forms oder SurveyMonkey ideal. Für fortgeschrittene Analysen oder großvolumiges Feedback sind Qualtrics oder Alchemer besser geeignet.

3. Kann ich Daten direkt nach Excel oder Google Sheets exportieren?

Ja – Thunderbit, SurveyMonkey, Google Forms, Zoho Survey, JotForm und andere unterstützen den direkten Export nach Excel, Sheets oder über Integrationen.

4. Gibt es kostenlose Optionen für die Online-Datenerfassung?

Auf jeden Fall. Google Forms sowie die Gratis-Tarife von SurveyMonkey, Zoho Survey, JotForm und Thunderbit ermöglichen den Einstieg ohne Kosten – kostenpflichtige Tarife bieten mehr Funktionen und höhere Limits.

5. Wie wähle ich den passenden Online-Datenerfassungsdienst für mein Unternehmen?

Definiere zuerst deinen Hauptanwendungsfall (Web-Scraping, Umfragen, Formulare etc.), deine Integrationsanforderungen und dein Budget. Teste ein paar Tools mit einem kleinen Projekt und wähle das, das am einfachsten zu deinem Team und Workflow passt.

Bereit, deine Datenerfassung 2025 aufs nächste Level zu bringen? , um KI-gestütztes Web-Scraping auszuprobieren, oder hol dir noch mehr Tipps und Anleitungen im . Viel Erfolg bei der Datensuche!