Das Web platzt vor Daten – und 2026 sind Web-Scraping-Projekte zu so etwas wie dem Geheimrezept geworden: für Business Analytics, Trend-Erkennung und sogar Forschungsdurchbrüche. Ich habe selbst erlebt, wie sich Python-Web-Scraping-Projekte von netten Nebenprojekten zu geschäftskritischen Treibern für Innovation entwickelt haben. Ob du Data Scientist, Entwickler:in oder einfach nur neugierig bist: Die richtige Projektidee und das passende Tool können Einblicke liefern, die sonst im digitalen Heuhaufen verborgen bleiben. Und das Beste daran? Mit KI-gestützten Lösungen wie sind selbst komplexeste Scraping-Aufgaben heute machbar – ganz ohne Doktortitel in Regex.

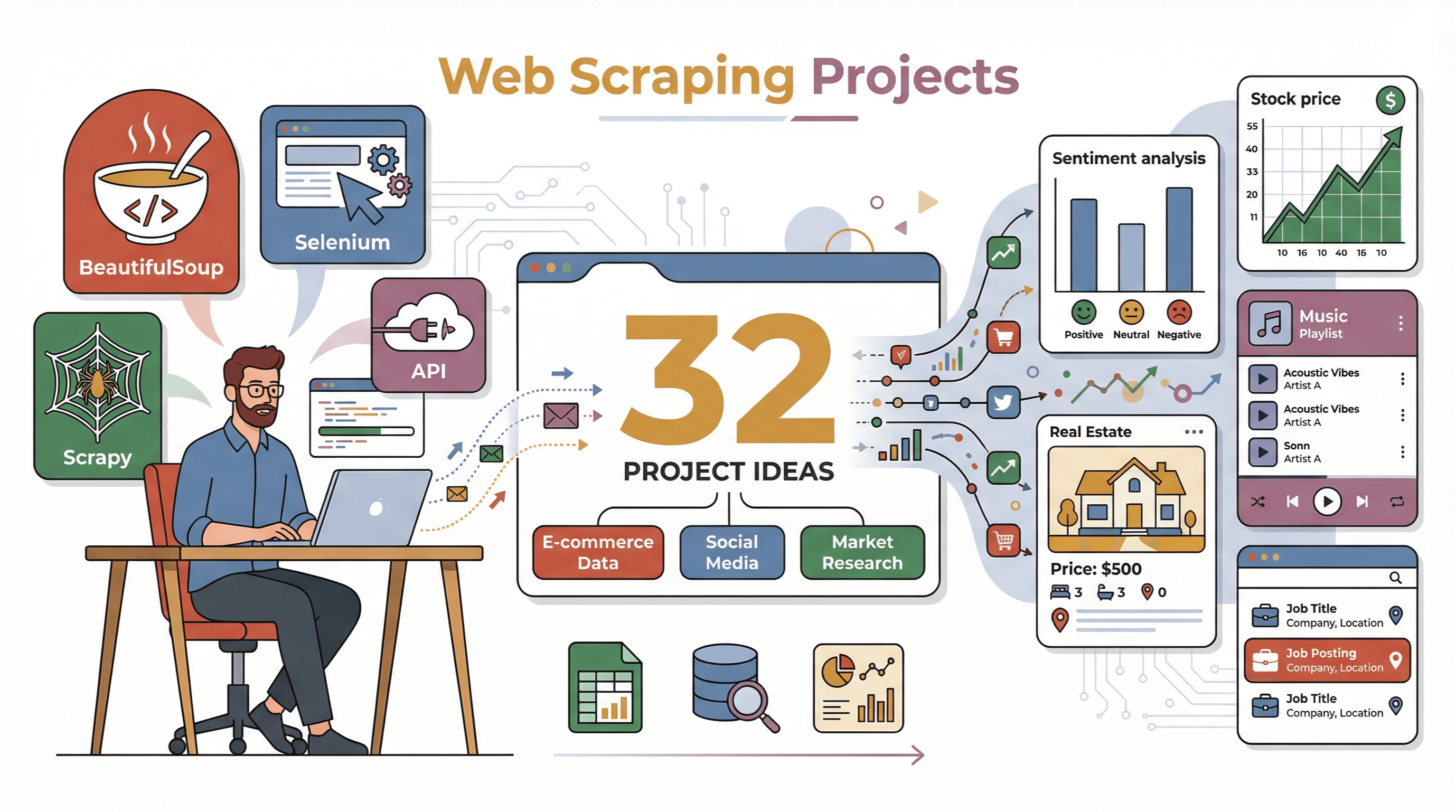

Bereit, dein Können aufs nächste Level zu bringen und etwas zu bauen, das wirklich etwas bewegt? Ich habe 32 kreative, fortgeschrittene und praxisnahe Ideen für Python-Web-Scraping-Projekte zusammengestellt – jeweils mit den passenden Tools (von BeautifulSoup über Scrapy bis Thunderbit), plus Tipps zu Komplexität, Automatisierung und echtem Praxisnutzen. Lass uns eintauchen und sehen, wie weit du dein nächstes datengetriebenes Projekt bringen kannst.

Warum Python-Web-Scraping-Projekte für datengetriebene Innovation unverzichtbar sind

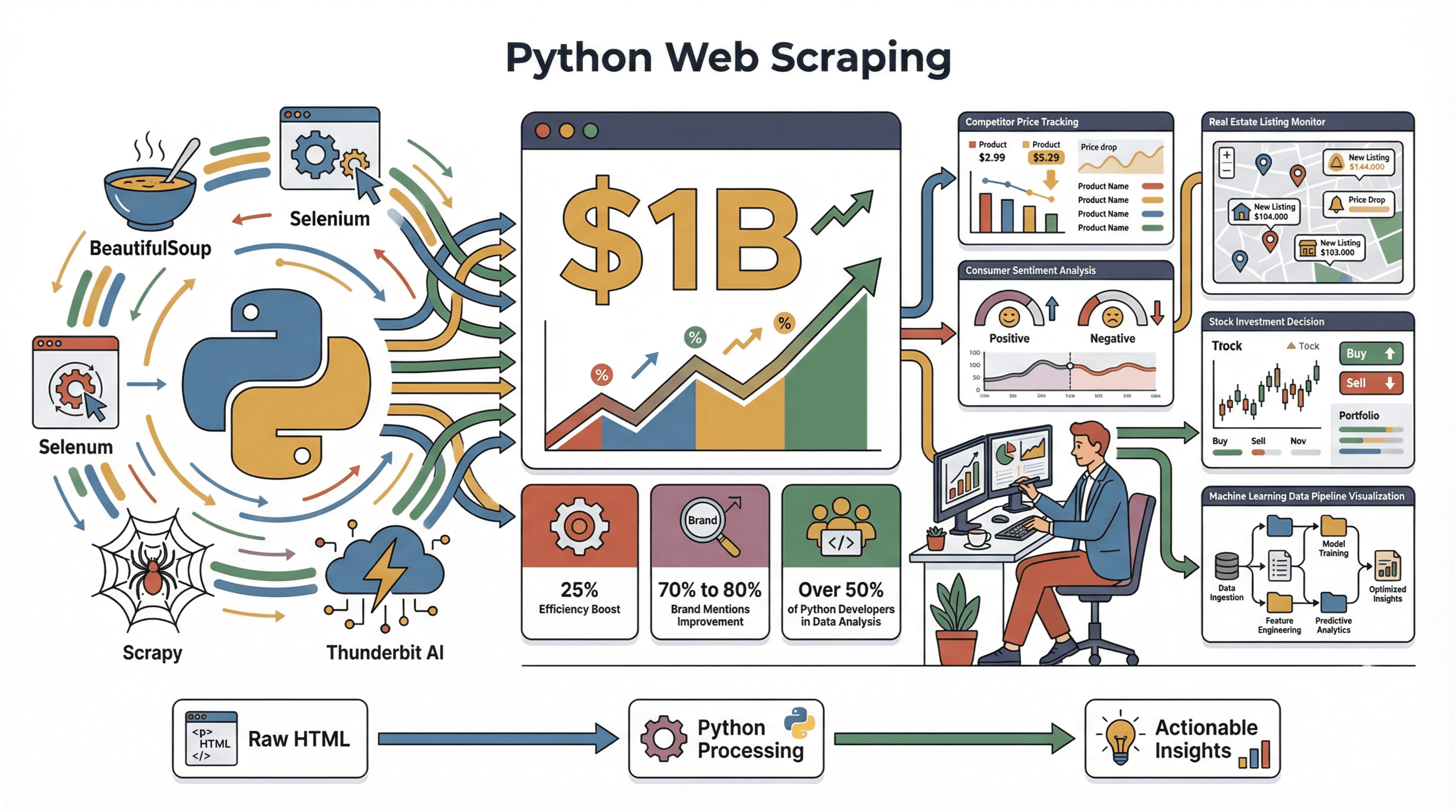

Web Scraping hat sich 2026 zu einer Branche im Milliardenwert entwickelt – und sie wächst weiter (). Unternehmen nutzen Scraping-Pipelines, um Konkurrenzpreise zu verfolgen, schwankende Verbraucherstimmungen im Blick zu behalten und sogar Anlageentscheidungen zu automatisieren. Eine Studie zeigte, dass das Scrapen von Finanzdaten in Echtzeit die Effizienz von Investitionsentscheidungen um 25 % steigerte (). Gleichzeitig stieg bei Marken, die Online-Bewertungen und Social Media aktiv auswerten, der Anteil positiver Markenerwähnungen innerhalb von fünf Jahren von 70 % auf 80 % ().

Python ist dafür die erste Wahl, und das aus gutem Grund. Mehr als die Hälfte der Python-Entwickler:innen geben 2026 an, in Datenanalyse und Datenverarbeitung zu arbeiten (), und das Python-Ökosystem – mit BeautifulSoup, Selenium, Scrapy und inzwischen auch KI-gestützten Tools wie – macht es leicht, von rohem HTML zu verwertbaren Erkenntnissen zu kommen. Ob du Produktbewertungen für Sentiment-Analysen scrapen, Immobilienangebote verfolgen oder einen maßgeschneiderten Datensatz für Machine Learning aufbauen willst: Python-Web-Scraping-Projekte sind das Rückgrat moderner datengetriebener Innovation.

So wählst du die richtige Web-Scraping-Projektidee aus

Bei so vielen Möglichkeiten: Wie entscheidest du dich für ein Projekt, das deine Zeit wert ist? Hier ist mein Ansatz:

- Mit dem Ziel anfangen: Welche Entscheidung oder welcher Prozess soll mit den Daten unterstützt werden? Wenn du Wettbewerbsinformationen brauchst, scrape Preise oder Produktlinien der Konkurrenz. Wenn du Kundeninsights willst, schau dir Bewertungen oder Social Media an.

- Datenverfügbarkeit prüfen: Sind die Daten öffentlich, hinter einem Login oder per API verfügbar? Öffentliche, statische Seiten sind einfacher; dynamische oder geschützte Seiten erfordern fortgeschrittenere Tools.

- Das Tool an die Aufgabe anpassen: Für statische Seiten ist BeautifulSoup ideal. Für dynamische Inhalte können Selenium oder Playwright nötig sein. Bei komplexen oder gemischten Datenformaten (wie PDFs oder Bildern) sparen dir KI-Tools wie viele Stunden.

- An Skalierbarkeit und Automatisierung denken: Muss das Projekt einmalig laufen oder regelmäßig? Geplantes Scraping und einfacher Export (in Google Sheets, Excel usw.) sind für laufende Projekte ein Muss.

Die besten Projekte balancieren Geschäftsnutzen und technische Machbarkeit. Und wenn du kein Coding-Profi bist, keine Sorge – KI-Tools wie Thunderbit machen fortgeschrittenes Scraping für alle zugänglich.

Python-Web-Scraping-Tools im Vergleich: von BeautifulSoup bis Thunderbit

Schauen wir uns die wichtigsten Tools in deinem Werkzeugkasten an:

| Tool | Am besten für | JavaScript? | Skalierbarkeit | Benutzerfreundlichkeit | Wartung |

|---|---|---|---|---|---|

| BeautifulSoup | Statische Seiten, schnelle Aufgaben | Nein | Gering | Hoch | Manuell |

| Selenium | Dynamische, JS-lastige Websites | Ja | Mittel | Mittel | Moderat |

| Scrapy | Crawling in großem Umfang, strukturierte Daten | Nein (erweiterbar) | Hoch | Mittel | Moderat |

| Thunderbit | KI-gestützt, komplexe/gemischte Daten | Ja | Hoch | Sehr hoch | Gering |

- BeautifulSoup ist perfekt für kleine, statische Websites – etwa Blogs oder einfache Verzeichnisse.

- Selenium spielt seine Stärken aus, wenn du mit dynamischen Inhalten, Logins oder Infinite Scroll arbeiten musst.

- Scrapy ist für Crawling im großen Stil und strukturierte Exporte gebaut, hat aber eine steilere Lernkurve.

- Thunderbit bringt KI ins Spiel und deckt alles ab – von der Navigation durch Unterseiten bis zur Extraktion von PDFs und Bildern – und schlägt sogar die besten Felder zum Scrapen vor. Für Projekte, bei denen Geschwindigkeit, Robustheit und einfache Bedienung zählen, ist es meine erste Wahl.

Für einen tieferen Einblick in die Tool-Auswahl schau dir an.

Projektkomplexität und Empfehlungsraster für Tools

Hier ist ein schneller Überblick, der dir hilft, jede Projektidee dem passenden Tool zuzuordnen und die Komplexität einzuschätzen:

Hier ist ein schneller Überblick, der dir hilft, jede Projektidee dem passenden Tool zuzuordnen und die Komplexität einzuschätzen:

| Projektidee | Empfohlenes Tool/Tools | Komplexität | Wichtigstes Ergebnis |

|---|---|---|---|

| Amazon-Bewertungs-Sentimentanalyse | BeautifulSoup + NLP | Mittel | Bewertungen + Sentiment-Werte |

| Live-Spielstände im Esport | Selenium | Hoch | Echtzeit-Statistiken |

| Quora-Trending-Q&A | Selenium | Mittel-hoch | Q&A-Datensatz |

| Spotify-Playlist-Daten | Spotify API | Niedrig | Playlist-Tracks, Kennzahlen |

| Bewertungen von Reiseattraktionen | BeautifulSoup | Mittel | Bewertungen, Rezensionen, Standortdaten |

| Trends bei Kino-Box-Office | API oder BeautifulSoup | Niedrig-mittel | Box-Office-Zeitreihen |

| Twitter-Trends & Inhalte | Selenium/API | Mittel | Trendthemen, Sentiment |

| Zhihu Q&A | Selenium | Hoch | Chinesischer Q&A-Datensatz |

| Immobilien-Monitoring in Echtzeit (Thunderbit) | Thunderbit | Niedrig-mittel | Angebotsdaten, Preistrends |

| Analyse von Bestseller-Rankings bei E-Books | Selenium/API | Mittel | Rankings, Bewertungen |

| Preisverfolgung im E-Commerce | Scrapy + Proxys | Hoch | Preisverlauf, Alarme |

| Reddit-Subreddit-Analyse | Reddit API | Mittel | Themenintensität, Engagement |

| Aktien-Daten-Tracking | yfinance/API | Niedrig | Historische Kurse, Indikatoren |

| Jobanzeigen (Scrapy) | Scrapy | Mittel | Stellenausschreibungen, Gehaltsinfos |

| Google-Play-Bewertungen | API/Selenium | Mittel | Bewertungen, Sterne, NLP-Zusammenfassung |

| Aggregation von Konkurrenz-Blog-Inhalten | RSS + BeautifulSoup | Mittel | Inhaltsarchiv, Themencluster |

| Feedback zu Online-Kursen | Selenium/API | Mittel | Kursbewertungen, Feedback |

| Aufbereitung von Branchenverzeichnissen | Scrapy + Python | Mittel | Bereinigte, deduplizierte Unternehmensliste |

| Podcast-Veröffentlichungen & Trends | API + NLP | Mittel | Trendpodcasts, Episodendaten |

| Thunderbit-Dateiextraktion | Thunderbit | Niedrig | Strukturierte Daten aus PDFs/Bildern |

| Analyse akademischer Zitationstrends | API + Parsing | Mittel | Zitationszahlen, Trendlinien |

| Web-Game-Daten per OCR | Selenium + OCR | Hoch | Spielstatistiken aus Bildern |

| Analyse von Händlerbewertungen | Scrapy + NLP | Mittel-hoch | Verbraucherbewertungsdatenbank, Zusammenfassung |

| Live-News mit Selenium | Selenium + Zeitplanung | Mittel | Nachrichten in Echtzeit |

| Verfolgung von Modetrends | Scrapy + Bildanalyse | Mittel | Beliebte Styles, Trenddaten |

| Konkurrenz-Produktexport (Thunderbit) | Thunderbit | Niedrig | Produktliste, wichtigste Attribute |

| Analyse von Tumblr-Multimedia | API/Selenium | Mittel | Posts, Tags, Medialinks |

| Bewertungen von Logistikunternehmen | BeautifulSoup + NLP | Mittel | Sentiment von Servicebewertungen |

| Regionale Marktpräsenz von Sportmarken | Social API + Scraping | Hoch | Kennzahlen zur regionalen Sichtbarkeit |

| YouTube-Produktkommentare | YouTube API + NLP | Mittel | Kommentarsentiment, Feature-Erwähnungen |

| Häufigkeit von E-Commerce-Aktionen | Scrapy | Mittel | Aktionskalender, Frequenzanalyse |

| Mehrsprachige Seriendaten | Scrapy + Übersetzungs-API | Hoch | Mehrsprachige Beschreibungen |

Jetzt geht’s ans Eingemachte – 32 Projektideen, jeweils mit kurzer Anleitung, Tool-Tipps und praxisnahen Insights.

1. Sentimentanalyse von Amazon-Produktbewertungen (BeautifulSoup)

Scrape Amazon-Produktbewertungen und führe eine Sentimentanalyse durch, um herauszufinden, was Kund:innen wirklich denken. Nutze BeautifulSoup, um Bewertungstext, Sternebewertungen und Metadaten der Rezensent:innen zu extrahieren. Behandle die Pagination, um einen belastbaren Datensatz zu sammeln, und wende dann Python-NLP-Bibliotheken wie VADER oder TextBlob an, um Sentiment zu bewerten und häufige Themen sichtbar zu machen. Für beste Ergebnisse solltest du deine Requests drosseln, um CAPTCHAs zu vermeiden ().

2. Live-Spielstände und Statistiken im Esport (Selenium)

Du willst Live-Spielstände im Esport verfolgen? Nutze Selenium, um dynamische, per JavaScript gerenderte Scoreboards von Seiten wie ESL oder Liquipedia zu scrapen. Mit Selenium kannst du Browseraktionen automatisieren, Logins handhaben und Echtzeit-Statistiken für Spiele wie League of Legends oder CS:GO extrahieren. Profi-Tipp: Prüfe die Netzwerkaufrufe des Browsers auf versteckte API-Endpunkte, um die Extraktion zu beschleunigen ().

3. Scraping von Quora-Trending-Q&A-Daten

Sammle trendende Fragen und Antworten von Quora mit Selenium, um Infinite Scroll und Login-Anforderungen zu bewältigen. Extrahiere Fragetext, Antwortinhalte, Upvotes und Autoreninformationen. Für tiefere Analysen kannst du auf „Mehr lesen“-Buttons klicken, um vollständige Antworten zu laden, und Anzeigen oder gesponserte Inhalte herausfiltern ().

4. Spotify-Playlist-Daten mit Python erfassen

Nutze die Spotify Web API (mit der spotipy-Bibliothek), um Playlist-Tracks, Metadaten und Audio-Features abzurufen. Analysiere Playlist-Trends, Track-Popularität und sogar Songmerkmale wie Tempo oder Energy. Ideen für Visualisierungen: Genre-Aufschlüsselungen, Künstlernetzwerke oder Raten der Track-Fluktuation ().

5. Web Scraping für Bewertungen von Touristenattraktionen

Scrape Bewertungen und Rezensionen von Touristenattraktionen auf Plattformen wie TripAdvisor mit BeautifulSoup. Extrahiere Namen der Attraktionen, Standorte, Durchschnittsbewertungen und Anzahl der Rezensionen. Bereinige und geokodiere die Daten für Kartenvisualisierungen und analysiere anschließend Trends nach Stadt oder Saison ().

6. Filmbox-Office-Daten und Trendvisualisierung

Rufe historische Box-Office-Daten von Quellen wie Box Office Mojo über deren API oder mit BeautifulSoup ab. Visualisiere Trends mit Python-Bibliotheken wie Matplotlib oder Plotly – etwa Umsatz über die Zeit, Genre-Aufschlüsselungen oder saisonale Spitzen ().

7. Twitter-Trendthemen und Inhaltsanalyse

Überwache Twitter-Trends über die API (falls du Zugriff hast) oder mit Tools wie snscrape und Selenium. Scrape trendende Hashtags, sammle Tweets und analysiere Sentiment oder das gemeinsame Auftreten von Hashtags. Bei starkem JS-Einsatz ist Browser-Automatisierung unverzichtbar ().

8. Interaktive Q&A-Daten aus Zhihu scrapen

Scrape die trendenden Fragen und Antworten von Zhihu mit Selenium (und gegebenenfalls Login-Cookies). Extrahiere Fragetext, Antwortinhalt, Upvotes und Nutzerengagement. Für die chinesische Textanalyse nutze Bibliotheken wie Jieba oder SnowNLP.

9. Echtzeit-Monitoring des Immobilienmarkts (Thunderbit)

Mit kannst du Immobilienangebote und Preise mit nur wenigen Klicks überwachen. Nutze „AI Suggest Fields“, um Immobiliendaten automatisch zu erkennen, setze Unterseiten-Scraping für Details ein und richte geplante Scrapes für tägliche Updates ein. Exportiere alles nach Google Sheets oder Airtable – ganz ohne Code ().

10. Analyse von Bestseller-Rankings auf E-Book-Plattformen

Scrape Bestseller-Listen und Rezensionen von Amazon Kindle oder Goodreads mit Selenium oder APIs. Verfolge Rangänderungen über die Zeit, analysiere Genre-Trends und korreliere Rezensionen mit dem Verkaufsrang ().

11. Analyse von Preisschwankungen im E-Commerce

Nutze Scrapy (mit Proxys), um Produktpreise auf E-Commerce-Seiten zu verfolgen. Sammle Daten regelmäßig, baue eine historische Preisdatenbank auf und richte Alarme für starke Preisrückgänge ein. Analysiere dynamische Preisstrategien und Wettbewerbsverhalten ().

12. Analyse der Themenintensität in Reddit-Subreddits

Extrahiere Beiträge und Kommentare aus Subreddits mit der Reddit API (PRAW). Analysiere Beitragsfrequenz, Upvotes und Kommentarvolumen, um heiße Themen und Engagement-Trends zu identifizieren. Visualisiere das Ganze mit Heatmaps oder Balkendiagrammen.

13. Verfolgung historischer Aktien- und Finanzindikatoren

Rufe Aktienkurse und Finanzindikatoren mit yfinance oder anderen Finanz-APIs ab. Baue Zeitreihendatensätze auf, plotte Trends und stelle Bezüge zu Wirtschaftsindikatoren her ().

14. Jobanzeigen mit Scrapy scrapen

Nutze Scrapy, um Jobbörsen zu crawlen und Stellenbezeichnungen, Unternehmen, Standorte und Gehälter zu extrahieren. Behandle Pagination und exportiere strukturierte Daten für die Analyse – etwa Gehaltsverteilungen, Nachfrage nach Skills oder Hiring-Trends ().

15. Google-Play-App-Bewertungen und -Sterne automatisieren

Scrape App-Bewertungen aus Google Play über die API oder mit Selenium. Extrahiere Bewertungstext, Sterne und Metadaten und nutze anschließend NLP, um Nutzerfeedback und Sentiment zusammenzufassen ().

16. Aggregation von Inhalten aus Konkurrenz-Blogs

Aggregiere Blogbeiträge von Wettbewerbern über RSS-Feeds und BeautifulSoup. Organisiere die Inhalte, dedupliziere sie und nutze Themenclustering, um Trends und Content-Lücken zu erkennen.

17. Kursfeedback und Bewertungen von Online-Bildungsplattformen scrapen

Extrahiere Kursbewertungen und Feedback von Plattformen wie Coursera oder Udemy mit Selenium oder APIs. Visualisiere Kursbeliebtheit, Zufriedenheit und häufige Feedbackmuster.

18. Datenorganisation aus Branchenverzeichnissen und Gelben Seiten

Scrape Unternehmenseinträge aus Verzeichnissen wie den Gelben Seiten mit Scrapy. Normalisiere Adressen, dedupliziere Einträge und baue eine saubere Unternehmensdatenbank auf ().

19. Neueste Veröffentlichungen und beliebte Inhalte von Podcast-Plattformen sammeln

Nutze die iTunes- oder Spotify-API, um Podcast-Metadaten, Episodenveröffentlichungen und Popularitätskennzahlen abzurufen. Analysiere neue Themen und Veröffentlichungs-Trends.

20. Dateien in Thunderbit hochladen für eine individuelle Datenerfassung

Lade PDFs oder Bilder in hoch und lass strukturierte Daten per KI-gestützter OCR extrahieren – ganz ohne manuelle Eingabe oder Regex. Perfekt zum Digitalisieren von Visitenkarten, Rechnungen oder Teilnehmerlisten ().

21. Analyse akademischer Zitationstrends

Scrape Zitationsdaten aus wissenschaftlichen Datenbanken über APIs (z. B. CrossRef). Analysiere Zitationszahlen im Zeitverlauf, um aufkommende Forschungstrends zu erkennen.

22. Web-Game-Daten per OCR extrahieren

Kombiniere Selenium und OCR-Bibliotheken (wie pytesseract), um Statistiken aus bildbasierten Webspielen zu extrahieren. Nützlich für Spiele, die Punkte oder Daten als Bilder anzeigen.

23. Verbraucherbewertungen von Online-Händlern extrahieren und analysieren

Scrape Verbraucherbewertungen von Online-Händlern mit Scrapy. Wende NLP für Sentiment-Bewertungen an, fasse wichtige Vor- und Nachteile von Produkten zusammen und vergleiche konkurrierende Produkte.

24. Nachrichtenüberschriften und Zusammenfassungen in Echtzeit scrapen (Selenium)

Nutze Selenium, um aktuelle Schlagzeilen und Zusammenfassungen von dynamischen Nachrichtenseiten zu scrapen. Plane regelmäßige Scrapes für aktuelle Updates.

25. Trend- und Stil-Tracking auf Modewebsites

Scrape Mode-Websites nach trendenden Produkten und Styles mit Scrapy. Optional kannst du Bildanalyse einsetzen, um beliebte Farben oder Muster zu erkennen.

26. Konkurrenz-Produktlisten mit Thunderbit exportieren

Mit exportierst du Produktlisten und Attribute von Wettbewerbern in wenigen Minuten. Nutze KI-Feldvorschläge und Unterseiten-Scraping für tiefere Daten und exportiere direkt in dein bevorzugtes Tabellenkalkulations-Tool.

27. Multimedia-Inhalte auf Tumblr analysieren

Scrape Multimedia-Posts von Tumblr über die API oder mit Selenium. Analysiere Bilder, Videos und Tags auf Content-Trends.

28. Auswertung von Bewertungsdaten zu Logistikunternehmen

Scrape Bewertungen und Sternebewertungen für Logistikunternehmen auf Plattformen wie Trustpilot mit BeautifulSoup. Überführe das Feedback mit Textanalyse in konkrete operative Verbesserungen.

29. Statistiken zur regionalen Marktpräsenz von Sportmarken

Sammle und analysiere Marktsichtbarkeitsdaten für Sportmarken mithilfe von Social-Media-APIs und Web Scraping. Verfolge Erwähnungen, Einzelhandelspräsenz und regionale Trends.

30. Analyse von YouTube-Produktkommentaren

Scrape YouTube-Kommentare über die API und extrahiere anschließend per NLP Sentiment und Feature-Erwähnungen rund um Produkterfahrungen.

31. Häufigkeit und Quote von E-Commerce-Aktionen verfolgen

Verfolge Werbeaktionen auf E-Commerce-Plattformen mit Scrapy. Aggregiere Ereignisdaten und visualisiere Trends im Zeitverlauf.

32. Mehrsprachiges Scraping von Serienbeschreibungen über mehrere Plattformen

Baue Skripte mit Scrapy und Übersetzungs-APIs, um Serienbeschreibungen von mehreren Streaming-Plattformen in verschiedenen Sprachen zu sammeln und zu vereinheitlichen.

Auf einen Blick: Vergleichstabelle der Projekte

| # | Projektidee | Tool(s) | Komplexität | Wichtigstes Ergebnis |

|---|---|---|---|---|

| 1 | Sentimentanalyse Amazon-Bewertungen | BeautifulSoup + NLP | Mittel | Bewertungen + Sentiment |

| 2 | Live-Spielstände im Esport | Selenium | Hoch | Echtzeit-Statistiken |

| 3 | Quora-Trending-Q&A | Selenium | Mittel-hoch | Q&A-Datensatz |

| 4 | Spotify-Playlist-Daten | Spotify API | Niedrig | Playlist-Tracks, Kennzahlen |

| 5 | Bewertungen von Reiseattraktionen | BeautifulSoup | Mittel | Bewertungen, Rezensionen, Mapping |

| 6 | Trends bei Kino-Box-Office | API/BeautifulSoup | Niedrig-mittel | Box-Office-Zeitreihen |

| 7 | Twitter-Trends & Inhalte | Selenium/API | Mittel | Trendthemen, Sentiment |

| 8 | Zhihu Q&A | Selenium | Hoch | Chinesischer Q&A-Datensatz |

| 9 | Immobilien-Monitoring (Thunderbit) | Thunderbit | Niedrig-mittel | Angebotsdaten, Preistrends |

| 10 | Analyse von Bestseller-Rankings bei E-Books | Selenium/API | Mittel | Rankings, Bewertungen |

| 11 | Preisverfolgung im E-Commerce | Scrapy + Proxys | Hoch | Preisverlauf, Alarme |

| 12 | Reddit-Subreddit-Analyse | Reddit API | Mittel | Themenintensität, Engagement |

| 13 | Aktien-Daten-Tracking | yfinance/API | Niedrig | Historische Kurse, Indikatoren |

| 14 | Jobanzeigen (Scrapy) | Scrapy | Mittel | Stellenausschreibungen, Gehaltsinfos |

| 15 | Google-Play-Bewertungen | API/Selenium | Mittel | Bewertungen, Sterne, NLP-Zusammenfassung |

| 16 | Aggregation von Konkurrenz-Blog-Inhalten | RSS + BeautifulSoup | Mittel | Inhaltsarchiv, Themencluster |

| 17 | Feedback zu Online-Kursen | Selenium/API | Mittel | Kursbewertungen, Feedback |

| 18 | Aufbereitung von Branchenverzeichnissen | Scrapy + Python | Mittel | Bereinigte, deduplizierte Unternehmensliste |

| 19 | Podcast-Veröffentlichungen & Trends | API + NLP | Mittel | Trendpodcasts, Episodendaten |

| 20 | Thunderbit-Dateiextraktion | Thunderbit | Niedrig | Strukturierte Daten aus PDFs/Bildern |

| 21 | Analyse akademischer Zitationstrends | API + Parsing | Mittel | Zitationszahlen, Trendlinien |

| 22 | Web-Game-Daten per OCR | Selenium + OCR | Hoch | Spielstatistiken aus Bildern |

| 23 | Analyse von Händlerbewertungen | Scrapy + NLP | Mittel-hoch | Verbraucherbewertungsdatenbank, Zusammenfassung |

| 24 | Live-News mit Selenium | Selenium + Zeitplanung | Mittel | Nachrichten in Echtzeit |

| 25 | Verfolgung von Modetrends | Scrapy + Bildanalyse | Mittel | Beliebte Styles, Trenddaten |

| 26 | Konkurrenz-Produktexport (Thunderbit) | Thunderbit | Niedrig | Produktliste, wichtigste Attribute |

| 27 | Analyse von Tumblr-Multimedia | API/Selenium | Mittel | Posts, Tags, Medialinks |

| 28 | Bewertungen von Logistikunternehmen | BeautifulSoup + NLP | Mittel | Sentiment von Servicebewertungen |

| 29 | Regionale Marktpräsenz von Sportmarken | Social API + Scraping | Hoch | Kennzahlen zur regionalen Sichtbarkeit |

| 30 | YouTube-Produktkommentare | YouTube API + NLP | Mittel | Kommentarsentiment, Feature-Erwähnungen |

| 31 | Häufigkeit von E-Commerce-Aktionen | Scrapy | Mittel | Aktionskalender, Frequenzanalyse |

| 32 | Mehrsprachige Seriendaten | Scrapy + Übersetzungs-API | Hoch | Mehrsprachige Beschreibungen |

Fazit: Neue Möglichkeiten mit Python-Web-Scraping-Projekten erschließen

Web Scraping mit Python ist mehr als nur eine technische Übung – es ist eine Startrampe für datengetriebene Durchbrüche. Ob du Dashboards baust, Machine-Learning-Modelle antriebst oder einfach deine Neugier stillst: Diese 32 Projektideen zeigen, dass nur deine Vorstellungskraft die Grenze setzt. Und mit Tools wie musst du kein Coding-Experte sein, um selbst die härtesten Scraping-Herausforderungen zu meistern.

Also: Such dir ein Projekt aus, richte deine Python-Umgebung ein und fang an zu experimentieren. Das Web ist dein Daten-Spielplatz – bau etwas Großartiges und lass die Erkenntnisse hereinströmen.

Für mehr tiefgehende Analysen und praxisnahe Leitfäden schau im vorbei.

FAQs

1. Was ist das beste Python-Tool für Web-Scraping-Projekte?

Das hängt vom Projekt ab. Für statische Seiten ist BeautifulSoup einfach und effektiv. Für dynamische oder interaktive Websites ist Selenium eine solide Wahl. Für Scraping in großem Umfang oder geplant laufende Aufgaben ist Scrapy ideal. Für KI-gestütztes No-Code-Scraping – inklusive PDFs und Bildern – ist eine Top-Wahl.

2. Wie verhindere ich, beim Scrapen von Websites blockiert zu werden?

Nutze realistische User-Agents, füge Pausen zwischen den Requests ein und respektiere die robots.txt. Bei häufig abgefragten oder sensiblen Websites solltest du rotierende Proxys und Browser-Automatisierung in Betracht ziehen, um menschliches Verhalten nachzuahmen.

3. Kann ich Web Scraping für kommerzielle Projekte nutzen?

Ja, aber prüfe immer die Nutzungsbedingungen und rechtlichen Einschränkungen der Zielwebsite. Viele Seiten erlauben Scraping für private oder Forschungszwecke, für kommerzielle Nutzung kann jedoch eine Genehmigung oder API-Zugriff erforderlich sein.

4. Wie vereinfacht Thunderbit komplexe Web-Scraping-Aufgaben?

Thunderbit nutzt KI, um Felder automatisch zu erkennen, Unterseiten zu verarbeiten und Daten von dynamischen Websites, PDFs und Bildern zu extrahieren. Es bietet Eingaben in natürlicher Sprache und exportiert Daten direkt nach Google Sheets, Excel, Airtable oder Notion – ganz ohne Programmierung.

5. Wie starte ich am besten mit Python-Web-Scraping-Projekten?

Such dir eine Projektidee, die dich begeistert, installiere die nötigen Bibliotheken (BeautifulSoup, Selenium, Scrapy oder Thunderbit) und fang klein an – scrape eine Seite und skaliere dann hoch. Experimentiere, verbessere iterativ und scheue dich nicht, KI-gestützte Tools auszuprobieren, um deinen Workflow zu beschleunigen.

Viel Erfolg beim Scrapen – und mögen deine Daten immer frisch, strukturiert und voller Erkenntnisse sein.

Mehr erfahren