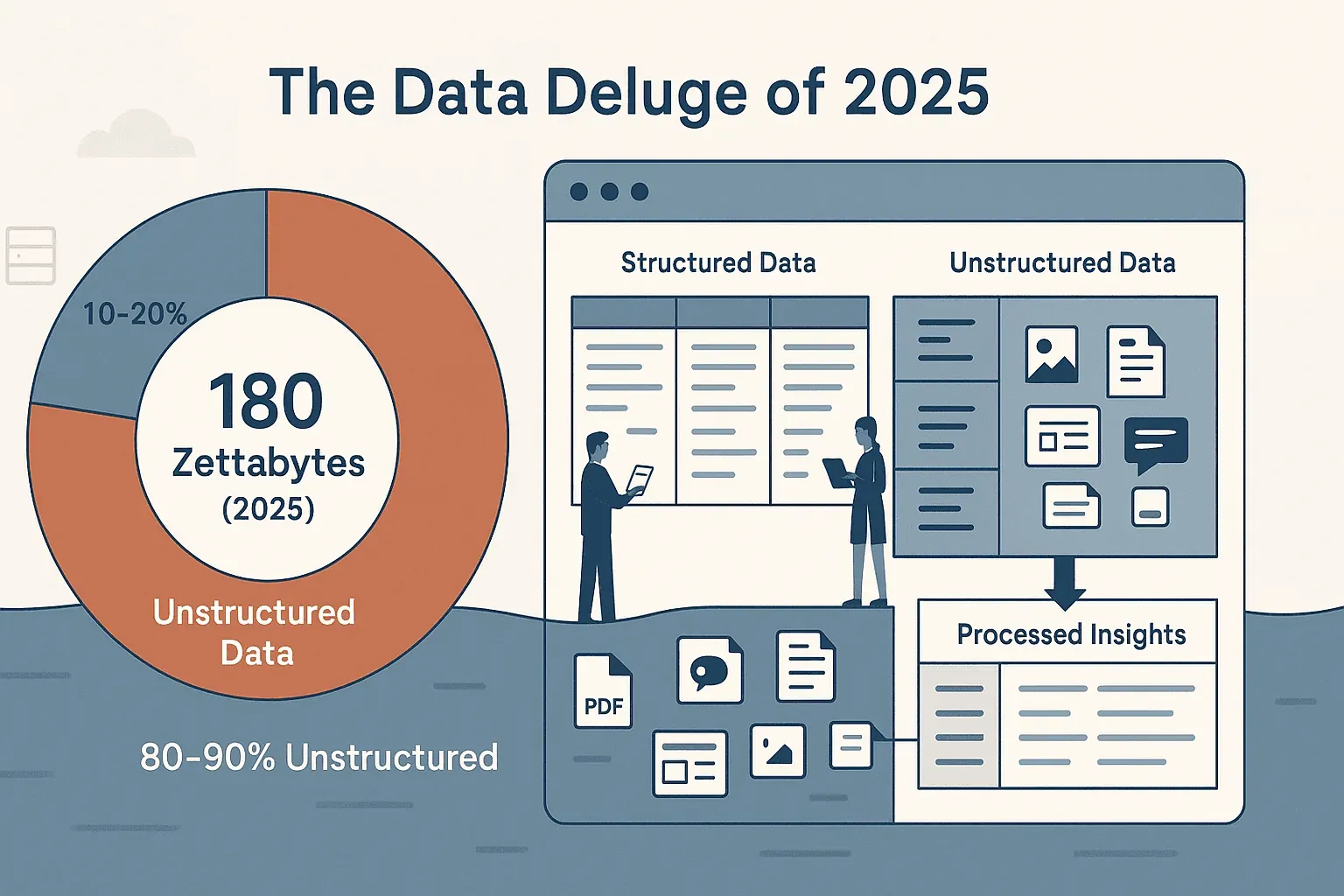

Wenn du schon einmal versucht hast, Daten von einer Website zu sammeln – sei es für Sales-Leads, Wettbewerberpreise oder einfach, um einen chaotischen Produktkatalog in den Griff zu bekommen –, weißt du: Das Web ist nicht gerade für müheloses Copy-and-paste gemacht. Die Menge an Online-Daten ist enorm: IDC und Statista bezifferten die globale Datasphäre für 2025 auf rund , und für 2026 liegen wir bereits auf Kurs für etwa 221 Zettabyte. Das größere Problem ist nicht die Menge, sondern die Struktur: , verborgen in Webseiten, PDFs, Bildern und dynamischen Feeds. Die meisten Business-Teams – mich eingeschlossen – haben viel zu viel Zeit damit verbracht, mit diesem Chaos zu ringen, nur um am Ende halbgare Tabellen und ein Déjà-vu-Gefühl zu bekommen.

Genau deshalb bin ich so besessen von effizientem Website-Crawling. In diesem Leitfaden zeige ich dir einen praktischen Schritt-für-Schritt-Ansatz, mit dem du jede Website crawlen kannst – ohne Code, ohne Kopfzerbrechen – mithilfe von , unserem KI-gestützten Web-Scraper. Egal, ob du im Vertrieb, im Operations-Bereich arbeitest oder einfach die manuelle Dateneingabe satt hast: Ich zeige dir, wie du komplexe Layouts, Paginierung, Unterseiten und sogar Daten aus PDFs und Bildern extrahierst. Lass uns das Chaos des Webs in deinen nächsten Geschäftsvorteil verwandeln.

Was bedeutet es, eine Website effizient zu crawlen?

Zerlegen wir das Ganze: Eine Website crawlen bedeutet, ein automatisiertes Tool zu verwenden – also so etwas wie einen Roboterassistenten –, um Webseiten systematisch zu besuchen und die Informationen zu extrahieren, die dich interessieren: Namen, Preise, E-Mails, Produktspezifikationen, was auch immer. Effizientes Crawling geht es nicht nur um Geschwindigkeit; es geht um Genauigkeit, minimalen manuellen Aufwand und die Fähigkeit, reale Hürden im Web zu bewältigen wie Paginierung, Unterseiten und unstrukturierte Daten ().

Was unterscheidet einen effizienten Crawl von einer Copy-and-paste-Marathonstrecke? Darauf kommt es an:

- Geschwindigkeit: Hunderte Seiten oder Datensätze in Minuten statt Stunden abrufen.

- Genauigkeit: Genau die Daten erfassen, die du brauchst – ohne Einträge zu übersehen oder Tippfehler einzubauen.

- Automatisierung: Das Tool wiederkehrende Aufgaben erledigen lassen, etwa auf „Weiter“ klicken oder Links zu Detailseiten folgen.

- Robustheit: Sich an komplexe Layouts, dynamische Inhalte und sogar Änderungen an der Website-Struktur anpassen.

- Wenig Einrichtung: Kein Coding, kein Herumhantieren mit Selektoren, keine ständige Wartung.

Die reale Welt besteht nicht aus perfekten Tabellen. Moderne Websites haben Infinite Scroll, mehrstufige Navigation, Login-Anforderungen und Daten, die in PDFs oder Bildern versteckt sind. Effizientes Crawling heißt, all das zu meistern – damit du weniger Zeit mit Fleißarbeit verbringst und mehr mit Analyse und Umsetzung ().

Warum effizientes Website-Crawling für Vertrieb und Operations wichtig ist

Warum kümmern sich Business-Teams so sehr ums Web-Crawling? Weil die richtigen Daten – schnell geliefert – über deine nächste Kampagne, einen Produktlaunch oder das Vertriebsergebnis eines Quartals entscheiden können. Hier sind einige der häufigsten (und ertragreichsten) Anwendungsfälle, die ich jede Woche sehe:

| Anwendungsfall | Nutzen & ROI | Beispielergebnis |

|---|---|---|

| Lead-Generierung | Den Sales-Funnel schneller füllen, Stunden bei der Prospektrecherche sparen, manuelle Fehler reduzieren | 5.000 gezielte Leads über Nacht extrahieren, Kampagnen 2 Wochen früher starten, Termine um 30 % steigern |

| Wettbewerber-Preisüberwachung | Dynamische Preisgestaltung ermöglichen, in Echtzeit auf Marktveränderungen reagieren, Margen schützen | Händler passt Preise täglich an und erzielt eine Umsatzsteigerung von 4 % |

| Extraktion von Produktkatalogen/Beständen | Listings aktuell halten, manuelle Dateneingabe reduzieren, Überverkäufe oder falsche Preise vermeiden | E-Commerce-Team aktualisiert 10.000 SKUs täglich und reduziert die Aktualisierungszeit um 90 % |

| Marktforschung & Analyse von Bewertungen | Große Einblicke in Kundenstimmung und Trends gewinnen, Chancen vor der Konkurrenz erkennen | 10.000+ Bewertungen analysieren, neue Produktchancen identifizieren, Marketingbotschaften verbessern |

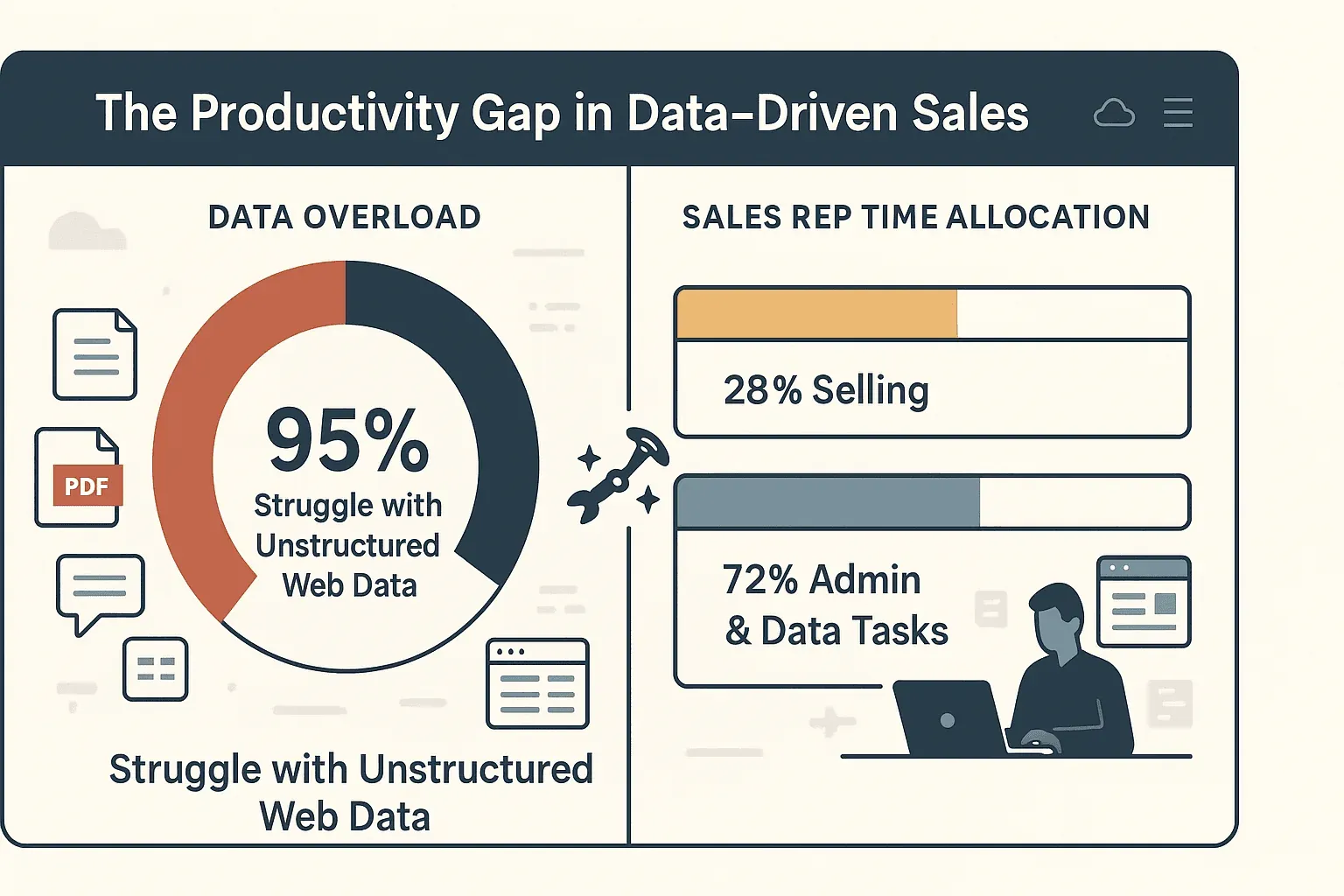

Kurz gesagt: Effizientes Crawling bedeutet schnellere, klügere Entscheidungen – und viel weniger Zeit mit Copy-and-paste. Tatsächlich geben zu, dass sie Schwierigkeiten haben, unstrukturierte Webdaten zu nutzen, und Vertriebsmitarbeiter verbringen nur . Der Rest geht durch manuelle Dateneingabe und Administration verloren.

Thunderbit: Der einfachste Weg, eine Website zu crawlen

Seien wir ehrlich: Die meisten Web-Scraping-Tools sind für Entwickler gebaut, nicht für Business-User. Deshalb haben wir entwickelt – einen KI-gestützten Web-Crawler, der so einfach ist wie Essen zu bestellen. Das zeichnet Thunderbit aus:

- Eingaben in natürlicher Sprache: Beschreibe einfach die gewünschten Daten („Hole alle Produktnamen und Preise von dieser Seite“), und Thunderbits KI erledigt den Rest.

- KI-Felder vorschlagen: Klicke auf „KI-Felder vorschlagen“, und Thunderbit scannt die Seite, empfiehlt die besten zu extrahierenden Spalten und richtet den Crawler für dich ein.

- Workflow in 2 Klicks: Sobald du mit den Feldern zufrieden bist, klickst du auf „Scrape“. Das war’s – kein Coding, keine Vorlagen, kein Ringen mit Selektoren.

- Beherrscht Paginierung & Unterseiten: Thunderbit erkennt und navigiert automatisch mehrseitige Listen und kann Links zu Detailseiten (Unterseiten) folgen, um deine Daten anzureichern.

- Sofortiger Export: Sende deine Daten direkt an Excel, Google Sheets, Airtable oder Notion – oder lade sie kostenlos als CSV/JSON herunter.

- OCR für PDFs & Bilder: Du brauchst Daten aus einer PDF, einem Bild oder einem gescannten Dokument? Thunderbits integrierte OCR extrahiert und strukturiert auch diese Inhalte.

Thunderbit ist für nicht-technische Nutzer gemacht – wenn du im Web surfen und einen Satz tippen kannst, kannst du wie ein Profi eine Website crawlen. Und ja, es gibt einen , damit du es risikofrei ausprobieren kannst.

Website-Crawling-Lösungen im Vergleich: Thunderbit vs. traditionelle Methoden

Stellen wir Thunderbit direkt neben die üblichen Verdächtigen:

| Ansatz | Einrichtungszeit & Komplexität | Erforderliche Kenntnisse | Wartung & Zuverlässigkeit |

|---|---|---|---|

| Manuelles Copy-and-paste | Extrem hoch, nicht skalierbar | Keine, aber fehleranfällig | 100 % manuell, bei jedem Update neu machen |

| Individueller Code (Python usw.) | Hohe Anfangseinrichtung, Stunden/Tage pro Website | Programmierkenntnisse erforderlich | Bricht bei Website-Änderungen, braucht ständige Fixes |

| Traditionelles No-Code-Tool | Mittel, Klick-und-Konfigurations-Setup | Gering/mittel | Braucht Updates bei Layoutänderungen, kommt nicht immer mit dynamischen Seiten klar |

| Thunderbit (KI-gestützt) | Sehr gering, 2-Klick-Setup | Keine | KI passt sich Änderungen an, minimaler Pflegeaufwand |

Traditionelle Tools bringen dich vielleicht halbwegs ans Ziel, aber sie scheitern oft an dynamischen Inhalten, Paginierung oder verlangen, dass du jede Änderung beaufsichtigst. Thunderbits KI liest die Website wie ein Mensch, passt sich neuen Layouts an und übernimmt den unübersichtlichen Kram – damit du das nicht tun musst ().

Schritt 1: Dein Website-Crawling mit Thunderbit einrichten

Der Einstieg ist kinderleicht:

- Installiere die . Erstelle ein kostenloses Konto.

- Öffne deine Zielwebsite. Lade die Seite, die du crawlen möchtest – das kann eine Produktliste, ein Verzeichnis oder sogar eine PDF sein.

- Öffne Thunderbit. Klicke in der Chrome-Symbolleiste auf das Thunderbit-Symbol.

- Beschreibe deinen Datenbedarf. Entweder klickst du auf „KI-Felder vorschlagen“, damit Thunderbit Spalten empfiehlt, oder du gibst einen Prompt in natürlicher Sprache ein (z. B. „Extrahiere für jeden Eintrag Produktname, Preis und Bild-URL“).

- Vorschau prüfen und anpassen. Thunderbit zeigt dir eine Vorschau-Tabelle – bearbeite Feldnamen, entferne Extras oder füge bei Bedarf eigene Anweisungen hinzu.

Profi-Tipp: Sei in deinen Prompts konkret, aber kurz. Nenne die Datenpunkte so, wie sie auf der Seite erscheinen („Preis“, „Adresse“ usw.), und lass Thunderbits KI die eigentliche Arbeit machen.

Schritt 2: Paginierung und Unterseiten beim Website-Crawling handhaben

Hier zeigt Thunderbit wirklich seine Stärke. Die meisten realen Daten liegen nicht auf einer einzigen Seite – sie verteilen sich über paginierte Listen oder sind in Unterseiten versteckt.

- Paginierung: Thunderbit erkennt automatisch „Weiter“-Schaltflächen, Seitennummern oder Infinite Scroll. Wenn du auf „Scrape“ klickst, lädt es weitere Seiten nach, bis alles erfasst ist – du musst keine URLs manuell eingeben und dich nicht durch jede Seite klicken.

- Unterseiten-Crawling: Brauchst du mehr Details? Nachdem die Hauptliste extrahiert wurde, klicke auf „Unterseiten scrapen“. Thunderbit folgt Links (etwa zu Produktdetailseiten oder Unternehmensprofilen), extrahiert zusätzliche Informationen und führt sie in deiner Tabelle zusammen.

Beispiel: Du scrapest eine E-Commerce-Website? Thunderbit holt die Produktliste, besucht dann die Detailseite jedes Produkts, um Spezifikationen, Bewertungen oder Bilder zu ziehen – alles in einem Durchgang.

Best Practice: Lass Thunderbit zuerst den Haupt-Crawl abschließen und nutze danach das Scraping von Unterseiten für tiefere Daten. Du siehst Fortschrittsmeldungen und kannst prüfen, ob Einträge fehlen.

Schritt 3: Intelligente Extraktion unstrukturierter Daten mit Thunderbit

Nicht alle Daten liegen in sauberen Tabellen vor. Produktbeschreibungen, Bewertungen oder Felder mit gemischtem Format können für traditionelle Scraper zum Albtraum werden. Thunderbits KI geht das direkt an:

- Bereinigt und formatiert Daten: Entfernt Währungssymbole, parst Zahlen und trennt komplexe Felder auf (z. B. wird aus „USD 299 (50 % Rabatt!)“ „299“ und „50 % Rabatt“).

- Parst komplexen Text: Extrahiert strukturierte Informationen aus Absätzen (z. B. findet „Standort: New York“ in einer Stellenbeschreibung).

- Klassifiziert und labelt: Fügt Kategorien oder Tags anhand des Inhalts hinzu (z. B. „Elektronik“ vs. „Kleidung“).

- Geht mit Inkonsistenzen um: Passt sich fehlenden Feldern oder Layoutänderungen an und hält deine Daten sauber und korrekt ausgerichtet.

- Fasst zusammen oder übersetzt: Du brauchst eine Ein-Satz-Zusammenfassung oder eine Übersetzung? Füge eine benutzerdefinierte Anweisung hinzu – Thunderbits KI kann das ebenfalls.

Das Ergebnis? Saubere, sofort nutzbare Daten – keine stundenlange Bereinigung mehr in Excel.

Schritt 4: Zwischen Cloud-Crawling und Browser-Crawling wählen

Thunderbit bietet dir zwei Wege zu crawlen, je nach Bedarf:

- Browser-Crawling: Läuft in deinem Chrome-Browser und nutzt deine angemeldete Sitzung. Perfekt für Websites, die Authentifizierung verlangen oder starke Anti-Bot-Maßnahmen haben. Du siehst den Crawl live und er ahmt menschliches Surfen nach.

- Cloud-Crawling: Verlagert die Arbeit auf Thunderbits Cloud-Server. Verarbeitet bis zu 50 Seiten parallel – ideal für große Jobs oder geplante Aufgaben. Du kannst deinen Laptop zuklappen und Thunderbit die Schwerarbeit überlassen.

Wann du was verwenden solltest:

- Nutze den Browser-Modus für Seiten mit Login-Pflicht oder wenn du mit der Seite interagieren musst.

- Nutze den Cloud-Modus für öffentliche Seiten, große Mengen oder wenn es dir um Geschwindigkeit und Automatisierung geht.

Das Wechseln zwischen den Modi ist einfach – wähle vor dem Start des Crawls einfach deine bevorzugte Option.

Schritt 5: Daten aus Dokumenten und Bildern mit OCR extrahieren

Manchmal stecken die benötigten Daten in PDFs, Bildern oder gescannten Dokumenten. Thunderbits integrierte OCR (Optical Character Recognition) ändert das Spiel:

- PDFs: Extrahiere Tabellen, E-Mails oder Text aus Berichten, Rechnungen oder Katalogen.

- Bilder: Ziehe Text aus Screenshots, Produktetiketten oder sogar Infografiken.

- Gescanntes Papier: Automatisiere die Dateneingabe aus Quittungen, Verträgen oder Visitenkarten.

Richte Thunderbit einfach auf die PDF- oder Bild-URL aus, und es extrahiert und strukturiert den Inhalt – ohne zusätzliche Software. Du kannst OCR sogar mit KI-Prompts kombinieren, um fortgeschrittene Extraktionen durchzuführen („Finde alle E-Mail-Adressen in dieser PDF“).

Schritt 6: Deine gecrawlten Daten exportieren und nutzen

Sobald dein Crawl abgeschlossen ist, ist es Zeit, die Daten in die Praxis zu bringen:

- Exportoptionen: Als CSV oder JSON herunterladen oder direkt nach exportieren. Alle Formate sind kostenlos – sogar im Basistarif.

- Sales & CRM: Lead-Listen in dein CRM importieren, Outreach-Kampagnen starten oder bestehende Kontakte anreichern.

- Marketing & Analyse: Wettbewerberpreise analysieren, Markttrends verfolgen oder Daten in Dashboards visualisieren.

- Operations & Bestand: Lagerbestände überwachen, Kataloge aktualisieren oder Warnungen bei wichtigen Änderungen auslösen.

- Automatisierung: Nutze Integrationen wie Zapier oder Google Apps Script, um Follow-ups, Reporting oder Data Enrichment zu automatisieren.

Thunderbits strukturierte Ausgabe sorgt dafür, dass du in Minuten vom Crawl zur Aktion kommst – nicht erst in Tagen.

Fazit und wichtigste Erkenntnisse

Eine Website effizient zu crawlen ist nicht nur ein Traum für Technik-Fans – es ist eine geschäftliche Superkraft. Mit Thunderbit kann jede:r:

- Einen Crawl in Sekunden einrichten – per natürlicher Sprache oder mit KI-vorgeschlagenen Feldern.

- Komplexe Websites bewältigen – mit Paginierung, Unterseiten und dynamischen Inhalten, ganz ohne Code.

- Saubere, strukturierte Daten extrahieren – aus unübersichtlichen Webseiten, PDFs und Bildern.

- Den besten Modus wählen – Browser oder Cloud, je nach Geschwindigkeit, Skalierung und Sicherheit.

- Daten sofort exportieren – in deine bevorzugten Tools und Workflows.

Die Zeiten von endlosem Copy-and-paste und kaputten Scrapern sind vorbei. , teste einen kostenlosen Crawl und sieh selbst, wie viel Zeit – und Nerven – du sparst. Dein nächster großer Erkenntnisgewinn oder Vertriebserfolg ist vielleicht nur einen Klick entfernt.

Du willst mehr Tipps und Deep Dives? Schau im vorbei – mit Tutorials, Anwendungsfällen und dem Neuesten rund um KI-gestütztes Web-Crawling.

FAQs

1. Was ist der Unterschied zwischen Web-Crawling und Web-Scraping?

Web-Crawling bedeutet, Websites systematisch zu durchsuchen, um Seiten und Links zu entdecken, während Web-Scraping darauf abzielt, spezifische Daten aus diesen Seiten zu extrahieren. Thunderbit kombiniert beides – es findet, navigiert und extrahiert die Informationen, die du brauchst.

2. Kann Thunderbit Websites mit Login-Anforderungen verarbeiten?

Ja! Nutze Thunderbits Browser-Modus, um Seiten zu crawlen, die eine Authentifizierung erfordern. Er verwendet deine eingeloggte Chrome-Sitzung, sodass du auf Daten hinter Logins oder Paywalls zugreifen kannst – solange das innerhalb der Nutzungsbedingungen der Website liegt.

3. Wie geht Thunderbit mit Paginierung und Infinite Scroll um?

Thunderbit erkennt und navigiert automatisch durch paginierte Listen und Seiten mit Infinite Scroll. Es klickt auf „Weiter“, scrollt oder lädt weitere Inhalte, bis alle Daten erfasst sind – keine manuelle Einrichtung nötig.

4. Welche Arten von Daten kann Thunderbit extrahieren?

Thunderbit kann Text, Zahlen, Datumsangaben, URLs, E-Mails, Telefonnummern, Bilder und sogar Daten aus PDFs und Bildern per OCR extrahieren. Du kannst Felder anpassen und KI-Prompts für fortgeschrittene Strukturierung und Bereinigung nutzen.

5. Ist Thunderbit kostenlos nutzbar?

Thunderbit bietet einen kostenlosen Tarif, mit dem du eine begrenzte Anzahl von Seiten crawlen kannst. Alle Exportformate (CSV, Excel, Google Sheets, Airtable, Notion) sind kostenlos enthalten. Bezahlte Tarife starten bei 15 $/Monat für größere Volumen und erweiterte Funktionen.

Bereit, smarter statt härter zu crawlen? und lass KI die Schwerarbeit für dein nächstes Web-Datenprojekt übernehmen. Mehr erfahren