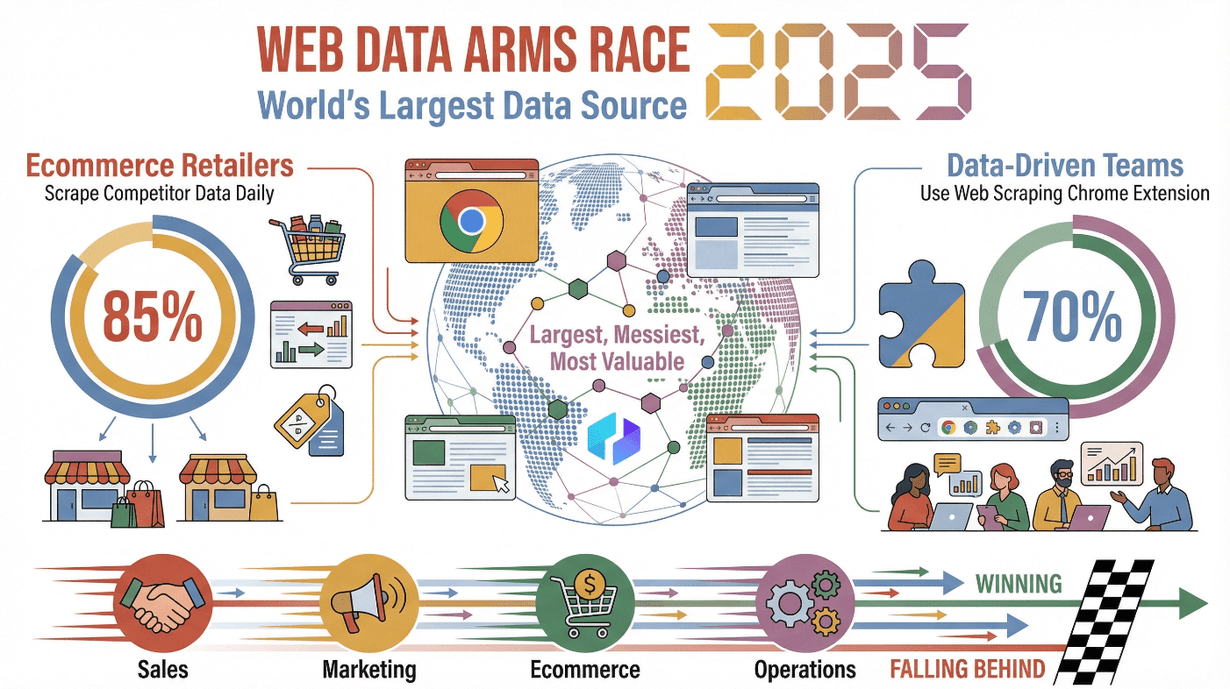

Das Internet ist heute viel mehr als nur ein Ort für lustige Katzenvideos und Memes – es ist die größte, chaotischste und wertvollste Datenquelle, die es gibt. Im Jahr 2025 liefern sich Unternehmen einen echten Daten-Wettlauf: , und mehr als . Egal ob Vertrieb, Marketing, E-Commerce oder Operations – wer schnell und im richtigen Format an die passenden Daten kommt, hat einen echten Vorsprung.

Aber es gibt einen Haken: Webseiten sind nicht dafür gemacht, Daten einfach herauszugeben. Sie sind oft unübersichtlich, dynamisch und für Menschen gestaltet – nicht für Tabellen. Genau hier kommen Web-Scraping-Tools ins Spiel: Sie machen aus dem Datenchaos strukturierte, nutzbare Tabellen. Aus meiner langjährigen Erfahrung im SaaS- und Automatisierungsbereich weiß ich, wie sehr das richtige Tool Zeit spart, die Genauigkeit erhöht und versteckte Insights ans Licht bringt.

Aber es gibt einen Haken: Webseiten sind nicht dafür gemacht, Daten einfach herauszugeben. Sie sind oft unübersichtlich, dynamisch und für Menschen gestaltet – nicht für Tabellen. Genau hier kommen Web-Scraping-Tools ins Spiel: Sie machen aus dem Datenchaos strukturierte, nutzbare Tabellen. Aus meiner langjährigen Erfahrung im SaaS- und Automatisierungsbereich weiß ich, wie sehr das richtige Tool Zeit spart, die Genauigkeit erhöht und versteckte Insights ans Licht bringt.

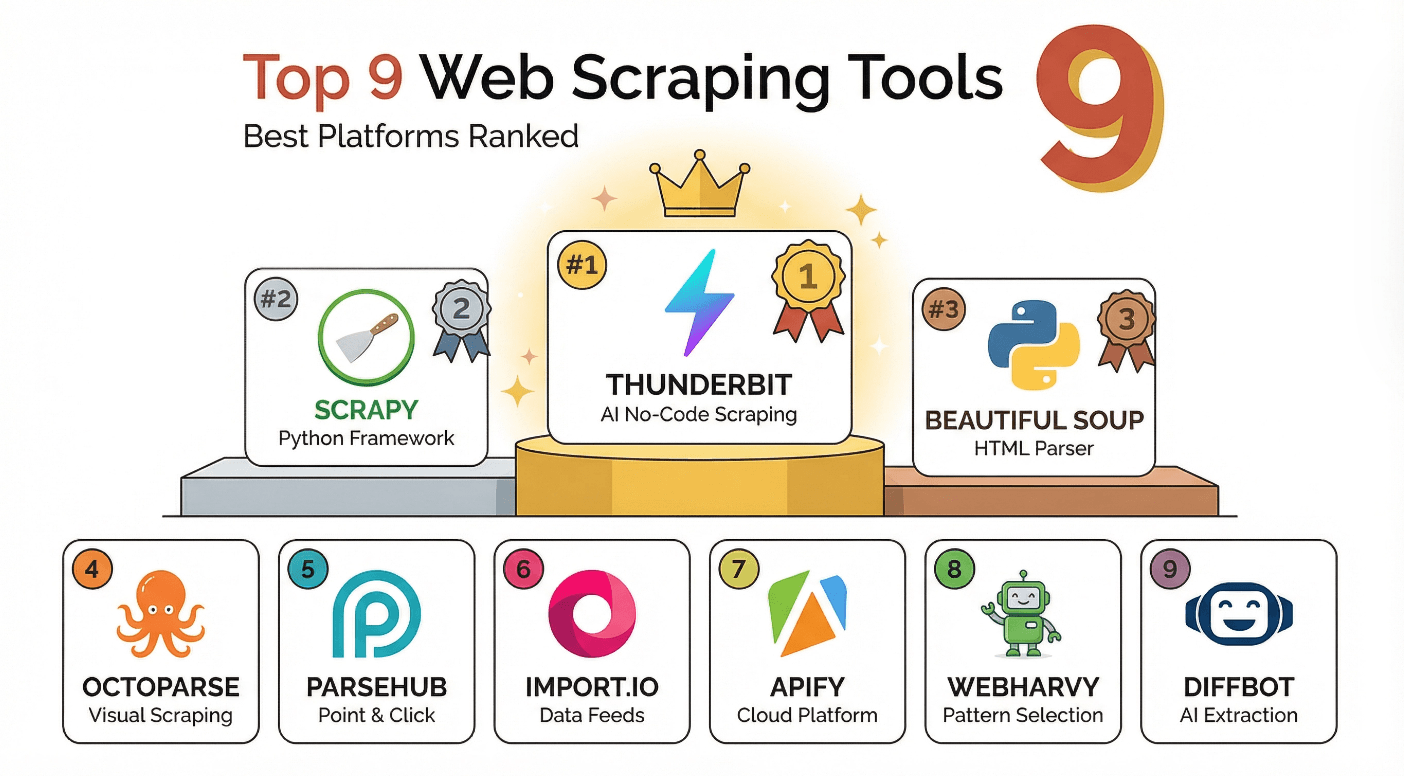

Welche Web-Scraping-Tools lohnen sich 2025 wirklich? Ich habe die neun besten Lösungen für dich zusammengestellt – von KI-basierten Chrome-Erweiterungen für Business-Anwender bis zu Open-Source-Frameworks für Entwickler. Los geht’s!

Warum Web-Scraping-Tools für moderne Unternehmen unverzichtbar sind

Web-Scraping-Tools sind das Geheimrezept für erfolgreiche Leadgenerierung, smarte Marktbeobachtung und flexible Geschäftsprozesse. Hier ein paar typische Anwendungsfälle:

- Leadgenerierung: Vertriebsteams sammeln gezielt Kontakte aus Verzeichnissen, LinkedIn oder Bewertungsportalen.

- Wettbewerbsanalyse: Marketing- und E-Commerce-Teams behalten Preise, Produktneuheiten und Aktionen der Konkurrenz im Blick – oft in Echtzeit.

- Marktforschung: Analysten bündeln Bewertungen, News und Nutzerstimmen, um Trends frühzeitig zu erkennen.

- Preisüberwachung: Händler und Marken checken Preise und Lagerbestände auf Hunderten von Seiten ().

- Content-Aggregation: Teams automatisieren das Sammeln von Daten aus Jobbörsen, Immobilienportalen oder Lieferantenkatalogen.

So helfen Web-Scraping-Tools Unternehmen auf einen Blick:

| Business Use Case | Manuelles Problem | Web-Scraping-Lösung |

|---|---|---|

| Leadgenerierung | Copy-Paste von Dutzenden Seiten | Automatisierte Extraktion, Massenexport |

| Preisüberwachung | Tägliche manuelle Kontrolle | Geplantes Scraping, Sofort-Benachrichtigungen |

| Marktforschung | Hunderte Bewertungen lesen | Strukturierte, aggregierte Datensätze |

| Content-Aggregation | Daten aus vielen Quellen zusammenführen | Einheitlicher Export nach Excel/Sheets |

| Wettbewerbsanalyse | Langsame, unvollständige Daten | Echtzeit, umfassende Einblicke |

Der Mehrwert ist messbar: Unternehmen, die moderne Scraping-Tools nutzen, , und .

So haben wir die besten Web-Scraping-Tools ausgewählt

Nicht jedes Web-Scraping-Tool ist gleich. Manche richten sich an Business-Anwender ohne Programmierkenntnisse, andere sind für Entwickler mit großen Projekten gemacht. Das waren meine Auswahlkriterien:

- Benutzerfreundlichkeit: Kommen auch Nicht-Programmierer schnell ans Ziel? Ist die Bedienung intuitiv?

- Skalierbarkeit: Schafft das Tool Hunderte oder Millionen von Seiten? Lassen sich Aufgaben automatisieren und planen?

- Exportmöglichkeiten: Kann ich nach Excel, Google Sheets, Airtable, Notion oder per API exportieren?

- Support & Community: Gibt es gute Dokus, Tutorials und schnellen Support?

- Preis-Leistungs-Verhältnis: Gibt es eine kostenlose Version? Sind die Preise transparent und fair?

- Besondere Funktionen: KI-gestützte Extraktion, Subseiten-Scraping, API-Anbindung oder visuelle Workflows.

Ich habe jedes Tool dem passenden Business-Szenario zugeordnet – so findest du schnell die Lösung, die zu deinen Anforderungen und deinem technischen Know-how passt.

1. Thunderbit

ist meine Empfehlung für alle, die ohne technisches Vorwissen mit KI-Unterstützung Webseiten auslesen möchten. Als Chrome-Erweiterung richtet sich Thunderbit an Teams aus Vertrieb, Marketing, E-Commerce und Operations, die schnell und zuverlässig strukturierte Daten brauchen.

Was macht Thunderbit besonders? Hier treffen Einfachheit und Power aufeinander:

- KI-gestützte Feldvorschläge: Mit „KI-Felder vorschlagen“ erkennt Thunderbit automatisch relevante Spalten (z. B. Name, Preis, E-Mail) und erstellt passende Extraktions-Prompts.

- Subseiten-Scraping: Mehr Details nötig? Thunderbit kann per KI automatisch Unterseiten (z. B. Produkt- oder Profilseiten) besuchen und die Tabelle anreichern – ganz ohne Konfiguration.

- Sofort-Export: Exportiere deine Daten direkt nach Excel, Google Sheets, Airtable oder Notion. Der Export ist immer kostenlos.

- Geplantes Scraping: Wiederkehrende Aufgaben (z. B. tägliche Preisüberwachung) lassen sich per natürlicher Sprache automatisieren.

- Kostenlose E-Mail-, Telefon- und Bild-Extraktoren: Kontaktinfos oder Bilder mit nur einem Klick extrahieren.

- KI-Autofill: Lass KI Online-Formulare für dich ausfüllen – ideal für Workflows und Routineaufgaben.

Thunderbit wird von über eingesetzt. Im kannst du bis zu 6 Seiten (bzw. 10 mit Test-Boost) extrahieren. Bezahlpläne starten ab nur 15 $/Monat für 500 Credits – ideal für Teams jeder Größe.

Du willst Thunderbit in Aktion sehen? Schau auf unserem vorbei oder stöbere in unserem für Anleitungen und Tipps.

2. Scrapy

ist das Open-Source-Framework der Wahl für Entwickler, die maximale Kontrolle über ihre Web-Scraping-Projekte wollen. In Python geschrieben, ermöglicht Scrapy den Bau individueller Spider, die Daten in großem Stil crawlen, extrahieren und verarbeiten.

Warum schwören Entwickler auf Scrapy?

- Leistungsstarkes Framework: Unterstützt komplexes, mehrstufiges Crawling, eigene Pipelines und API-Integration.

- Skalierbar: Bewältigt große Projekte, parallele Anfragen und kann viele Seiten gleichzeitig auslesen ().

- Erweiterbar: Middleware für Proxys, User Agents oder JavaScript-Rendering (mit Splash) einbindbar.

- Aktive Community: Viele Tutorials, Plugins und Support für fortgeschrittene Anwendungsfälle.

Scrapy eignet sich für Teams mit Python-Kenntnissen, die große Datenmengen verarbeiten, Datenpipelines integrieren oder robuste, wiederholbare Workflows aufbauen möchten. Es ist kostenlos und quelloffen – du musst aber deine Umgebung selbst einrichten und den Code pflegen.

3. Beautiful Soup

ist eine beliebte Python-Bibliothek, die besonders für Einsteiger geeignet ist, um HTML- und XML-Daten einfach zu parsen. Wer schnell Daten aus statischen Webseiten extrahieren möchte, ist hier richtig.

Warum Beautiful Soup wählen?

- Einsteigerfreundlich: Leicht zu erlernen, viele Tutorials und eine sanfte Lernkurve ().

- Flexibles Parsing: Kommt auch mit fehlerhaftem oder unstrukturiertem HTML zurecht.

- Ideal für kleine Projekte: Perfekt für einmalige Skripte, schnelle Datensammlungen oder zum Einstieg ins Web-Scraping.

Einschränkungen? Beautiful Soup ist nicht für große oder dynamische Seiten gemacht und kann kein JavaScript verarbeiten. Für solche Fälle empfiehlt sich die Kombination mit Requests oder Selenium – oder direkt der Umstieg auf Scrapy.

4. Octoparse

ist ein No-Code-Web-Scraping-Tool für alle – vom Einzelunternehmer bis zum Großunternehmen. Mit der Point-and-Click-Oberfläche lassen sich auch komplexe oder dynamische Webseiten einfach auslesen.

Warum Nutzer Octoparse schätzen:

- Kein Programmieren nötig: Visueller Workflow-Builder, Drag-and-Drop-Auswahl und Vorlagen.

- Cloud- & Desktop-Modus: Scraping lokal oder in der Cloud für größere und schnellere Jobs.

- Bewältigt Paginierung & dynamische Inhalte: „Mehr laden“-Seiten, Endlos-Scroll und AJAX werden unterstützt.

- Exportoptionen: Download als CSV, Excel, JSON, HTML oder Export in Datenbanken ().

Der kostenlose Tarif eignet sich für kleine Aufgaben, kostenpflichtige Pläne starten bei etwa 75 $/Monat für größere Projekte. Besonders beliebt für Marktforschung, Wettbewerbsanalyse und alle, die ohne Code Ergebnisse wollen.

5. ParseHub

ist ein visuelles Scraping-Tool, das besonders bei JavaScript-lastigen und dynamischen Webseiten punktet. Mit dem Workflow-Builder kannst du Elemente anklicken, Listen durchlaufen und auch verschachtelte Seiten auslesen.

ParseHubs Highlights:

- Visuelle Datenauswahl: Elemente anklicken, Listen durchlaufen und verschachtelte Seiten abbilden.

- Unterstützt dynamische Inhalte: JavaScript-geladene Daten, Dropdowns und Klick-Automatisierung.

- Flexible Exporte: Download als CSV, Excel, JSON oder Integration mit Dropbox/Amazon S3 ().

- Kostenloser Plan: Bis zu 5 Projekte und 200 Seiten pro Durchlauf; mehr Power in den Bezahlplänen.

ParseHub eignet sich für fortgeschrittene Nutzer, die Flexibilität ohne Programmierung suchen. Besonders beliebt für E-Commerce, Jobbörsen und Immobilienportale.

6. Import.io

ist auf die Extraktion und Visualisierung großer Datenmengen im Unternehmensumfeld spezialisiert. Die Plattform bietet eine intuitive Oberfläche, umfangreichen Support und fortschrittliche Analysefunktionen.

Was macht Import.io besonders?

- Point-and-Click-Extraktion: Kein Code nötig – einfach die gewünschten Daten auswählen.

- Datenvisualisierung: Integrierte Tools zur Analyse, Visualisierung und zum Teilen der Ergebnisse.

- Enterprise-Features: Compliance, Managed Services und Support für große Datenvolumen.

- Export & Integration: Download als CSV, Excel oder Integration mit Google Sheets und BI-Tools ().

Die Preisgestaltung richtet sich an Unternehmen mit großem Datenbedarf und entsprechendem Budget.

7. Apify

ist eine Plattform für skalierbare Web-Automatisierung und individuelle Datenextraktion. Entwickler können hier eigene oder vorgefertigte „Actors“ (Skripte) erstellen, ausführen und teilen.

Warum Apify überzeugt:

- Marketplace für Actors: Über 200 vorgefertigte Scraper für gängige Seiten oder eigene Skripte in JavaScript/Python.

- API-First: Integriere extrahierte Daten direkt in deine Workflows oder Apps.

- Cloud-Deployment: Jobs in der Cloud ausführen, wiederkehrende Aufgaben planen und alles zentral verwalten ().

- Flexible Preise: Kostenlos für kleine Aufgaben, Pay-as-you-go für größere Projekte.

Ideal für technisch versierte Teams, die Webdaten automatisiert, skalierbar und integriert nutzen möchten.

8. WebHarvy

ist ein Point-and-Click-Web-Scraping-Tool, das Datenmuster auf Webseiten automatisch erkennt. Es richtet sich an Anwender ohne Programmierkenntnisse, die ohne XPath oder CSS-Selektoren auskommen möchten.

WebHarvys Stärken:

- Automatische Mustererkennung: Ein Klick auf ein Datenfeld genügt, WebHarvy findet ähnliche Elemente ().

- Unterstützt AJAX/JavaScript: Dynamische Inhalte, Bildextraktion und Keyword-basiertes Scraping.

- Exportoptionen: Download als Excel, CSV, XML, JSON oder SQL.

- Einmalige Lizenz: Einmal zahlen, dauerhaft nutzen (inkl. 1 Jahr Updates/Support).

WebHarvy ist besonders bei kleinen Unternehmen, Forschern und Solo-Selbstständigen beliebt, die eine visuelle Lösung ohne komplexe Automatisierung suchen.

9. Diffbot

ist der KI-Spezialist unter den Web-Scraping-Tools. Mit Machine Learning und Computer Vision verwandelt Diffbot jede öffentliche Webseite in strukturierte Daten – ganz ohne manuelle Konfiguration.

Was macht Diffbot einzigartig?

- KI-gestützte Extraktion: Erkennt und extrahiert automatisch Entitäten, Beziehungen und Fakten aus Webseiten ().

- Knowledge Graph: Zugriff auf eine riesige, ständig aktualisierte Wissensdatenbank zu Personen, Unternehmen, Produkten und mehr.

- API-Zugriff: Integriere strukturierte Daten direkt in deine Apps, Analysen oder Forschungsprojekte ().

- Enterprise-Ready: Im Einsatz bei Microsoft, Adobe, Hubspot und weiteren großen Unternehmen.

Die Preise starten bei 299 $/Monat für Startups, mit Pay-per-Call-Optionen für die API-Nutzung (). Ideal für Forschung, Data Science im Unternehmen und alle, die KI-Genauigkeit im großen Stil brauchen.

Vergleichstabelle der Web-Scraping-Tools

Hier ein direkter Vergleich aller neun Tools:

| Tool | Ideal für | No-Code | KI-gestützt | API/Entwicklerfreundlich | Subseiten-Scraping | Exportoptionen | Preis (ab) |

|---|---|---|---|---|---|---|---|

| Thunderbit | Business-Anwender | Ja | Ja | Nein | Ja | Excel, CSV, Sheets, Notion, Airtable | Kostenlos (6 Seiten), $15/Monat |

| Scrapy | Entwickler | Nein | Nein | Ja | Ja (individuell) | CSV, JSON, XML, DB | Kostenlos, Open Source |

| Beautiful Soup | Einsteiger, Entwickler | Nein | Nein | Ja | Nein | Individuell (per Python) | Kostenlos, Open Source |

| Octoparse | Nicht-Programmierer, Teams | Ja | Nein | Teilweise | Ja | CSV, Excel, JSON, DB | Kostenlos, $75/Monat |

| ParseHub | Visuelle, dynamische Seiten | Ja | Nein | Teilweise | Ja | CSV, Excel, JSON, S3, Dropbox | Kostenlos, $189/Jahr |

| Import.io | Unternehmen, Analysen | Ja | Nein | Ja | Ja | CSV, Excel, Sheets, BI-Tools | Individuell, Enterprise |

| Apify | Entwickler, Automatisierung | Nein | Nein | Ja | Ja | CSV, JSON, Sheets, API | Kostenlos, Pay-as-you-go |

| WebHarvy | Nicht-Programmierer, KMU | Ja | Nein | Nein | Ja | Excel, CSV, XML, JSON, SQL | $139/Jahr (einmalig) |

| Diffbot | KI, Forschung, Unternehmen | Nein | Ja | Ja | Ja (KI-Crawl) | JSON, Knowledge Graph API | $299/Monat |

So findest du das passende Web-Scraping-Tool

Welches Tool passt zu dir? Hier ein schneller Überblick:

- Für Nicht-Programmierer/Business-Anwender: Thunderbit, Octoparse, ParseHub, WebHarvy

- Für Entwickler/Automatisierung: Scrapy, Beautiful Soup, Apify

- Für Unternehmen/KI-Anwendungen: Import.io, Diffbot

- Für dynamische oder JavaScript-lastige Seiten: ParseHub, Octoparse, Apify

- Für sofortige, strukturierte Exporte: Thunderbit, Import.io

Mein Tipp: Starte mit deinem Business-Ziel und deinem technischen Know-how. Wer KI-gestütztes, unkompliziertes Scraping und sofortige Exporte sucht, ist mit bestens beraten. Wer volle Kontrolle oder eigene Crawler bauen möchte, sollte Scrapy oder Apify testen. Für große Datenmengen oder KI-getriebene Analysen sind Import.io und Diffbot die richtige Wahl.

Die meisten Tools bieten kostenlose Testphasen – probiere ruhig mehrere aus und finde die Lösung, die am besten zu deinem Workflow passt.

Häufige Fragen (FAQ)

1. Was ist ein Web-Scraping-Tool und warum brauche ich es?

Ein Web-Scraping-Tool ist eine Software, die Daten von Webseiten extrahiert und in strukturierte Formate wie Tabellen oder Datenbanken umwandelt. Unternehmen nutzen sie für Leadgenerierung, Preisüberwachung, Marktforschung und mehr – das spart Zeit und erhöht die Genauigkeit im Vergleich zum manuellen Kopieren.

2. Ist Web Scraping legal?

Web Scraping ist legal, solange du öffentlich zugängliche Daten extrahierst und die Nutzungsbedingungen der Website beachtest. Verzichte auf das Scrapen persönlicher oder sensibler Daten ohne Zustimmung und prüfe die lokalen Vorschriften.

3. Welches Web-Scraping-Tool eignet sich für Nicht-Programmierer?

Thunderbit, Octoparse, ParseHub und WebHarvy sind ideal für Anwender ohne technische Vorkenntnisse. Thunderbit überzeugt besonders durch KI-gestützte Feldvorschläge und den Sofort-Export nach Excel, Google Sheets, Notion oder Airtable.

4. Kann ich dynamische oder JavaScript-lastige Webseiten scrapen?

Ja! Tools wie ParseHub, Octoparse und Apify sind speziell für dynamische Inhalte, AJAX und „Mehr laden“-Seiten entwickelt. Auch Thunderbits KI passt sich vielen modernen Webseitenlayouts an.

5. Wie finde ich das richtige Web-Scraping-Tool für mein Unternehmen?

Überlege dir, wie technisch du bist, wie viele Daten du brauchst, wie du exportieren willst und wie viel Budget du hast. Für Nicht-Programmierer sind Thunderbit oder Octoparse ein guter Start; Entwickler bevorzugen meist Scrapy oder Apify; Unternehmen mit großem Datenbedarf sollten Import.io oder Diffbot prüfen. Die meisten Tools bieten kostenlose Testphasen – probiere verschiedene aus und finde die beste Lösung.

Bereit, das Web zu deinem Wettbewerbsvorteil zu machen? oder entdecke weitere Tipps im . Viel Erfolg beim Scrapen!

Mehr erfahren