Letztes Quartal hat unser Ops-Team 40 Stunden pro Woche damit verbracht, Wettbewerbsdaten per Copy & Paste in Tabellen zu übertragen. Dieses Quartal dauert das Ganze 20 Minuten.

Der Unterschied? automatisierte Web-Scraping-Tools. Die sind schon lange nicht mehr nur was für Devs – heute kann sie praktisch jeder Sales- oder Marketing-Mitarbeiter mal eben in der Mittagspause aufsetzen.

Ich baue seit Jahren SaaS- und Automatisierungsprodukte (und ja, ich habe mitgegründet). Die Tool-Generation 2026 ist bisher die stärkste: KI-first, „self-healing“ und endlich so benutzbar, dass auch Nicht-Techniker wirklich damit klarkommen.

Hier sind 10 Tools, die ich selbst hands-on getestet habe – sortiert nach Use Case und dem Skill-Level, das du dafür brauchst.

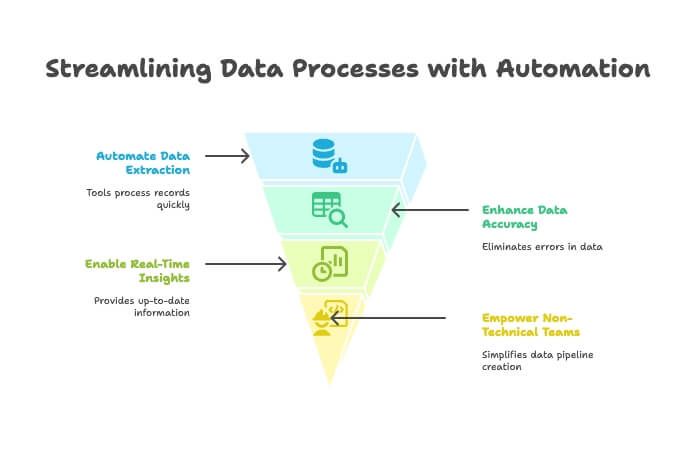

Warum automatisierte Web-Scraping-Tools für Business-Teams so wichtig sind

Mal ehrlich: Die Ära, in der man Daten manuell von Websites kopiert und einfügt, ist durch (außer du stehst auf monotone Arbeit und Handgelenk-Aua). automatisierte Web-Scraping-Tools sind für Unternehmen jeder Größe inzwischen ein echtes Must-have. Zumal , und Web Scraping dabei ein zentraler Baustein ist.

Warum diese Tools so viel bringen:

- Zeit sparen & manuelle Arbeit reduzieren: Automatisierte Scraper ziehen tausende Datensätze in Minuten – und geben dem Team Luft für Aufgaben mit echtem Impact. Ein Nutzer meinte, er habe durch automatisierte Datenerfassung „hunderte Stunden“ gespart ().

- Höhere Datenqualität: Keine Tippfehler, keine vergessenen Zeilen. Automatisierte Extraktion liefert sauberere, verlässlichere Daten.

- Schnellere Entscheidungen: Mit frischen Datenfeeds kannst du Wettbewerber beobachten, Preise tracken oder Lead-Listen bauen – ohne auf den monatlichen Praktikanten-Report zu warten.

- Auch für Nicht-Techniker nutzbar: Dank No-Code und KI-gestützten Tools können heute selbst Leute, die „XPath“ für eine Yoga-Übung halten, Web-Datenpipelines bauen ().

Kein Wunder also, dass – und fast 80 % sagen, ihre Organisation könnte ohne diese Daten nicht effizient arbeiten. 2026 gilt: Wer Datenerfassung nicht automatisiert, lässt Geld – und Erkenntnisse – auf dem Tisch liegen.

So haben wir die besten automatisierten Web-Scraping-Tools ausgewählt

Weil der Markt für Web-Scraping-Software voraussichtlich , fühlt sich die Tool-Auswahl schnell an wie Sneaker-Shopping in einem Laden mit 10.000 Modellen. So habe ich das Ganze runtergebrochen:

- Bedienbarkeit: Kommt man als Nicht-Entwickler schnell rein? Oder ist die Lernkurve eher „Bergsteigen“?

- KI-Funktionen: Erkennt das Tool Felder automatisch, kommt mit dynamischen Seiten klar oder versteht Anforderungen in normaler Sprache?

- Export & Integrationen: Wie easy landen die Daten in Excel, Google Sheets, Airtable, Notion oder im CRM?

- Preisgestaltung: Gibt’s eine kostenlose Testphase? Sind die Pläne für Einzelpersonen/kleine Teams bezahlbar oder nur Enterprise?

- Skalierung: Funktioniert es sowohl für kleine Ad-hoc-Jobs als auch für große, geplante Extraktionen?

- Zielgruppe: Für Business-User, Entwickler – oder beide?

- Alleinstellungsmerkmale: Was macht das Tool wirklich anders/besser?

Ich habe Tools für jedes Level aufgenommen – von „Ich will einfach nur eine Tabelle“ bis „Ich will das ganze Internet crawlen“. Let’s go.

1. Thunderbit: Der KI-Web-Scraper für alle

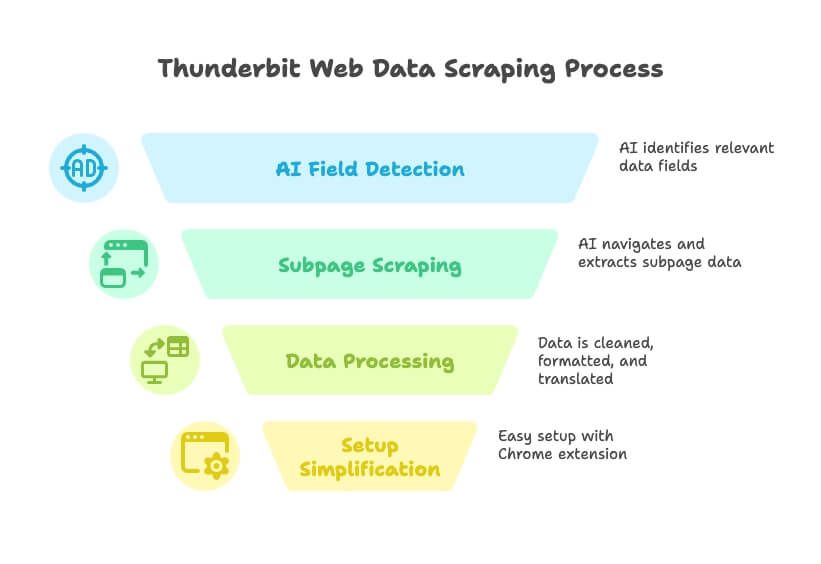

Ich starte mit dem Tool, das ich am besten kenne – weil mein Team und ich es genau für die Pain Points gebaut haben, die ich bei Business-Teams seit Jahren sehe. ist weder ein klassischer „Drag-and-drop“-Scraper noch ein „Bau dir deine Selektoren selbst“-Tool. Es ist ein KI-Datenassistent: Du sagst, was du brauchst – und die KI macht den Rest. Ohne Code, ohne XPath-Gefummel, ohne Stress.

Warum Thunderbit ganz oben steht

Thunderbit kommt dem am nächsten, was ich „jede Website in eine Datenbank verwandeln“ nennen würde. So läuft’s:

- Steuerung per natürlicher Sprache: Sag Thunderbit einfach, welche Daten du brauchst („Ich will alle Firmennamen, E-Mails und Telefonnummern aus diesem Verzeichnis“), und die KI erkennt passende Felder automatisch.

- AI Suggest Fields: Ein Klick – Thunderbit liest die Seite und schlägt die sinnvollsten Spalten vor. Kein Rätselraten, kein Trial-and-Error.

- Unterseiten & mehrstufiges Scraping: Du brauchst Details aus jeder Detailseite? Thunderbit klickt sich durch, sammelt Zusatzinfos und ergänzt sie in deiner Tabelle.

- Datenbereinigung, Übersetzung & Klassifizierung: Thunderbit sammelt nicht nur Rohdaten – es kann beim Scrapen bereinigen, formatieren, übersetzen und Felder kategorisieren.

- Kein Setup-Stress: installieren, „AI Suggest Fields“ klicken – und in unter einer Minute scrapen.

- Gratis testen & günstiger Einstieg: Großzügiger Free-Tier (bis zu 6 Seiten kostenlos), bezahlte Pläne ab 9 $/Monat. Das ist weniger als mein wöchentliches Kaffee-Budget.

Thunderbit ist für Sales-, Marketing- und Ops-Teams gebaut, die schnell an Daten kommen müssen. Kein Coding, keine Plugins, kein Training. Wie ein Daten-Praktikant, der wirklich zuhört – und nie rumjammert.

Thunderbits stärkste Funktionen

- KI-gestütztes Scraping: Die KI versteht Seitenstrukturen, passt sich Layout-Änderungen an und kommt auch mit Pagination und Unterseiten automatisch klar ().

- Sofortiger Export: Ergebnisse direkt nach Excel, Google Sheets, Airtable, Notion senden oder als CSV/JSON herunterladen.

- Cloud- oder lokale Runs: In der Cloud für Tempo und Skalierung – oder lokal im Browser, wenn du Login/Session brauchst.

- Geplanter Scraper: Wiederkehrende Jobs einrichten, damit Daten aktuell bleiben – ideal für Preisbeobachtung oder regelmäßige Lead-Updates.

- Wartungsarm: Thunderbits KI reagiert auf Website-Änderungen, sodass du weniger Zeit mit kaputten Scrapern verbringst ().

Für wen ist es? Für alle, die in Minuten von „Ich brauche diese Daten“ zu „Hier ist deine Tabelle“ kommen wollen – besonders für Nicht-Techniker. Mit und 4,9★ Bewertung wird Thunderbit schnell zur Standardlösung für Business-Teams, die Ergebnisse statt Kopfschmerzen wollen.

Wenn du es live sehen willst: Schau beim vorbei oder stöbere in weiteren .

2. Clay: Automatisierte Datenanreicherung trifft Web Scraping

Clay ist so etwas wie das Schweizer Taschenmesser für Growth-Teams. Es ist nicht nur ein Web-Scraper Tool – eher eine Automatisierungs-Tabelle, die sich mit 50+ Live-Datenquellen verbindet (z. B. Apollo, LinkedIn, Crunchbase) und mit integrierter KI Leads anreichert, Outreach-Mails schreibt und Prospects bewertet.

- Workflow-Automatisierung: Jede Zeile ist ein Lead, jede Spalte kann Daten ziehen oder eine Aktion auslösen. Firmenliste scrapen, LinkedIn-Profile anreichern, personalisierte Mail senden? Clay kann das.

- KI-Integration: Nutzt GPT-4 für Icebreaker, Bio-Zusammenfassungen und mehr.

- Integrationen: Native Anbindungen an HubSpot, Salesforce, Gmail, Slack u. a.

- Preise: Startet bei ca. 99 $/Monat (Professional), mit kostenloser Testphase für leichte Nutzung.

Am besten für: Outbound Sales, Growth Hacker und Marketer, die eigene Lead-Pipelines bauen wollen – Scraping, Enrichment und Outreach in einem Tool. Extrem stark, aber für Einsteiger in Automatisierungstools mit Lernkurve ().

3. Bardeen: Browser-Web-Scraper für Workflow-Automatisierung

Bardeen ist wie ein Browser-Roboter, der Data Scraping kann und wiederkehrende Web-Aufgaben automatisiert – direkt aus einer Chrome-Erweiterung heraus.

- No-Code-Automation: Über 500 „Playbooks“ fürs Scraping, Formular-Ausfüllen, Daten zwischen Apps verschieben und mehr.

- AI Command Builder: Aufgabe in normalem Deutsch/Englisch beschreiben – Bardeen baut den Workflow.

- Integrationen: Funktioniert mit Notion, Trello, Slack, Salesforce und 100+ weiteren Apps.

- Preise: Kostenlos für leichte Nutzung (100 Automation-Credits/Monat), Team-Pläne ab 99 $/Monat.

Am besten für: Power-User und Go-to-Market-Teams, die Scraping plus Folgeaktionen über mehrere Apps hinweg automatisieren wollen. Super flexibel, aber für Anfänger teils anspruchsvoll ().

4. Bright Data: Automatisierte Web-Scraping-Tools auf Enterprise-Niveau

Bright Data (früher Luminati) ist das schwere Gerät im Web Scraping – mit globalen Proxy-Netzwerken, fortgeschrittenen APIs und der Fähigkeit, tausende Seiten pro Tag zu crawlen.

- Enterprise-Skalierung: 100+ Millionen IPs, Web Scraper IDE, Web Unlocker zum Umgehen von Anti-Bot-Maßnahmen.

- Anpassbar: Komplexe, großvolumige Extraktionen mit hoher Zuverlässigkeit.

- Preise: Ab 499 $/Monat für die Web Scraper IDE, kleinere „Micro“-Pakete verfügbar.

Am besten für: Große Unternehmen, Datenaggregatoren und fortgeschrittene Nutzer, die robuste, skalierbare Lösungen brauchen. Wenn du täglich tausende Seiten crawlen musst und IP-Blocks vermeiden willst, ist Bright Data dafür gebaut ().

5. Octoparse: Visueller Web-Scraper für Fortgeschrittene

Octoparse ist ein beliebtes No-Code-Tool mit visueller Point-and-Click-Oberfläche – ideal, wenn man Power will, ohne zu programmieren.

- Drag-and-drop-UI: Elemente anklicken, um Extraktion zu definieren; Logins, Pagination usw. abbilden.

- Templates: 500+ fertige Vorlagen für gängige Websites (Amazon, Twitter etc.).

- Cloud Scraping: Jobs auf Octoparse-Servern ausführen, planen und IP-Rotation nutzen.

- Preise: Kostenloser Plan mit Limits; bezahlte Pläne ab 119 $/Monat.

Am besten für: Nicht-Programmierer und Data Analysts, die ein leistungsfähiges Web-Scraper Tool ohne Code suchen. Stark für Preisbeobachtung, Produktlisten und Research-Projekte ().

6. : Data-Scraping-Plattform für Unternehmen

gehört zu den Web-Scraping-Urgesteinen und hat sich zu einer umfassenden Data Scraping-Plattform weiterentwickelt.

- Point-and-Click-Extraktion: Unterstützt Logins, Dropdowns und interaktive Elemente.

- Cloud-basiert: Tausende URLs parallel verarbeiten, Extraktionen planen und APIs nutzen.

- Enterprise-Fokus: Für Preisbeobachtung, Marktforschung und ML-Datensätze.

- Preise: Starter 199 $/Monat, Standard 599 $/Monat, Advanced 1.099 $/Monat.

Am besten für: Mittelgroße bis große Unternehmen und Datenteams, die zuverlässige, betreute Lösungen für große Jobs brauchen. Für Hobby-Projekte meist overkill, für Business-Skalierung aber richtig stark ().

7. Parsehub: Flexibler Web-Scraper mit visuellem Editor

Parsehub ist eine Desktop-App (Windows, Mac, Linux), mit der du Scraper per Klick durch die Website-Oberfläche zusammenbaust.

- Visueller Workflow: Elemente auswählen, Regeln definieren, Logins/Dropdowns/Infinite Scroll abdecken.

- Cloud-Funktionen: Cloud-Runs, geplante Jobs und API-Zugriff.

- Preise: Kostenlos für kleine Jobs; bezahlte Pläne ab 149 $/Monat.

Am besten für: Research, kleine Unternehmen oder Einzelpersonen, die mehr Kontrolle als mit einer Browser-Erweiterung wollen, aber nicht selbst coden möchten ().

8. Common Crawl: Offene Webdaten für KI und Forschung

Common Crawl ist kein Tool im klassischen Sinn, sondern ein riesiger offener Datensatz mit Web-Crawl-Daten, der monatlich aktualisiert wird.

- Größe: ~400 TB Webdaten, Milliarden von Webseiten.

- Kostenlos & offen: Kein eigener Crawler nötig.

- Technisches Know-how erforderlich: Du brauchst Big-Data-Tools und Engineering-Skills, um Daten zu filtern und zu parsen.

Am besten für: Data Scientists und Engineers, die KI-Modelle bauen oder großflächige Forschung betreiben. Für allgemeine Webtexte oder Langzeit-Archive ist es eine Goldgrube ().

9. Crawly: Leichtgewichtiges automatisiertes Web-Scraping-Tool für Startups

Crawly (von Diffbot) ist ein cloudbasierter, KI-gestützter Crawler, der Daten aus Millionen Websites erfassen und strukturiert zurückgeben kann – ohne dass du Parsing-Regeln definieren musst.

- KI-Extraktion: Nutzt Machine Vision und NLP, um Inhalte zu erkennen und zu extrahieren.

- API-Zugriff: Gesammelte Daten abfragen und in Analytics/DBs integrieren.

- Preise: Enterprise; Preis auf Anfrage.

Am besten für: Startups und Teams mit etwas technischem Hintergrund, die großflächig und „intelligent“ Webdaten extrahieren wollen, ohne eigene Scraper zu bauen ().

10. Apify: Entwicklerfreundlicher Web-Scraper mit Marketplace

Apify ist eine Cloud-Plattform, auf der du eigene Scraper („Actors“) bauen oder eine große Bibliothek vorgefertigter Community-Scraper nutzen kannst.

- Flexibilität für Entwickler: JavaScript/Python-Scraping, Headless Chrome, Proxy-Management und Scheduling.

- Marketplace: Große Auswahl fertiger Scraper für gängige Websites.

- Preise: Kostenloser Einstieg mit 5 $/Monat Credits; bezahlte Pläne ab 49 $/Monat.

Am besten für: Entwickler und technisch versierte Analysten, die volle Kontrolle und Skalierung wollen. Auch Nicht-Coder können fertige Actors für Standardaufgaben nutzen ().

Vergleichstabelle: Automatisierte Web-Scraping-Tools

| Tool | Bedienbarkeit | KI-Funktionen | Preis (ab) | Zielgruppe | Besondere Stärken |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Natürliche Sprache, AI Suggest Fields, Unterseiten-Scraping | 9 $/Monat | Nicht-technische Business-User | Setup in 2 Klicks, kein Code, Sofort-Export, kostenlos testen |

| Clay | ★★★★☆ | KI-Enrichment, GPT-4 | 99 $/Monat | Growth/Sales Ops | Automatisierungs-Spreadsheet, Enrichment, Outreach |

| Bardeen | ★★★★☆ | KI-Command-Builder | 99 $/Monat | Power-User, GTM-Teams | Browser-RPA, 500+ Playbooks, starke Integrationen |

| Bright Data | ★★☆☆☆ | Proxy-Rotation, Anti-Bot-KI | 499 $/Monat | Enterprises, Devs | Skalierung, Zuverlässigkeit, globale Proxies |

| Octoparse | ★★★★☆ | Visuelle KI-Erkennung | 119 $/Monat | Analysten, Nicht-Coder | Drag-and-drop, Templates, Cloud Scraping |

| Import.io | ★★★☆☆ | Interaktive Extractors | 199 $/Monat | Enterprises, Datenteams | Parallelisierung, Scheduling, API, Support |

| Parsehub | ★★★★☆ | Visuelle Workflows | 149 $/Monat | Research, KMU | Desktop-App, kommt mit dynamischen Seiten klar |

| Common Crawl | ★☆☆☆☆ | k. A. (nur Datensatz) | Kostenlos | Data Scientists, Engineers | Riesiger Open-Dataset, Web-Archive im großen Maßstab |

| Crawly | ★★☆☆☆ | KI-Extraktion | Individuell/Enterprise | Startups, Tech-Teams | KI-basiert, keine Parsing-Regeln, API-Zugriff |

| Apify | ★★★★☆ | Actor-Marketplace | 49 $/Monat | Entwickler, Tech-Analysten | Bauen/Marketplace, Cloud-Automation, flexibel |

So findest du den passenden Web-Scraper für deinen Bedarf

Welches automatisierte Web-Scraping-Tool am besten passt, hängt von Teamgröße, technischem Know-how und Zielen ab. Meine Kurz-Empfehlung:

- Für Nicht-Techniker (Sales, Marketing, Ops): Nimm . Für dich gebaut: kein Code, kein Setup, einfach Ergebnisse. Ideal für Lead-Generierung, Preisbeobachtung und schnelle Datenprojekte.

- Für Teams, die Automatisierung lieben: Clay und Bardeen sind stark, wenn du Web Scraping mit Enrichment, Outreach oder Workflow-Automatisierung kombinieren willst.

- Für Enterprises & Entwickler: Bright Data, und Apify sind die beste Wahl für große, stark anpassbare Projekte.

- Für Research & Analysten: Octoparse und Parsehub liefern visuelle Oberflächen und viele Features – ohne selbst zu programmieren.

- Für KI- & Data-Science-Projekte: Common Crawl und Crawly liefern riesige Datensätze bzw. KI-Extraktion für alle, die Modelle bauen oder trainieren wollen.

Frag dich: Willst du in Minuten starten – oder brauchst du eine maßgeschneiderte Enterprise-Lösung? Wenn du unsicher bist, starte mit einer kostenlosen Testphase; die meisten Tools bieten eine.

Thunderbits besonderer Mehrwert: KI-Assistent für Business-Daten

Unter all diesen Tools sticht Thunderbit heraus, weil es als einziges wirklich wie ein „KI-Assistent“ für Web Scraping und Datentransformation funktioniert. Es geht nicht nur ums Einsammeln – sondern darum, chaotische Websites ohne technische Hürden in saubere, strukturierte Insights zu verwandeln.

- Interface in natürlicher Sprache: Du beschreibst, was du brauchst – Thunderbit erledigt den Rest.

- End-to-End-Automatisierung: Von Extraktion über Bereinigung, Übersetzung bis Export – alles in einem Flow.

- Ideal für schnelle Tests: Neuen Markt validieren, Lead-Liste bauen, Wettbewerber monitoren? Thunderbit ist der schnellste und günstigste Einstieg.

Wie ein Data Analyst im Browser – einer, der nie nach mehr Gehalt fragt und keinen Urlaub nimmt.

Fazit: Mit dem richtigen automatisierten Web-Scraping-Tool smarter starten

Die Scraping-Welt 2026 hat mit der von vor zwei Jahren kaum noch etwas gemeinsam. Self-healing KI-Scraper, LLM-native Pipelines und wirklich nutzbare No-Code-Tools haben die Spielregeln verändert. Ob Solo-Founder, hungriges Sales-Team oder Enterprise-Data-Scientist: In dieser Liste ist ein Tool, das zu deinem Bedarf passt. Entscheidend ist, Workflow und Skill-Level mit der richtigen Plattform zu matchen – damit du weniger mit Code kämpfst und mehr Insights gewinnst.

Wenn du manuelles Copy & Paste hinter dir lassen willst, und sieh selbst, wie einfach Web Scraping sein kann. Oder wähle eine der Alternativen je nach Ziel. So oder so: Die Zukunft datengetriebener Unternehmen gehört denen, die automatisieren.

Mehr wissen? Im findest du Deep Dives, Tutorials und Tipps, wie du das Maximum aus Webdaten herausholst. Viel Erfolg beim Scrapen – und mögen deine Daten immer sauber sein und deine Scraper nie kaputtgehen (und falls doch: Lass die KI ran).

FAQs

1. Warum sind automatisierte Web-Scraping-Tools 2026 für Business-User so wichtig?

automatisierte Web-Scraping-Tools machen Datenerfassung deutlich einfacher, sparen Zeit und drücken den Anteil manueller Arbeit. Sie verbessern die Datenqualität, ermöglichen Entscheidungen mit aktuellen Daten und geben auch nicht-technischen Teams Zugriff auf Webdaten – ohne Code. Für Sales, Marketing und Operations sind sie inzwischen essenziell.

2. Was unterscheidet Thunderbit von anderen Web-Scraping-Tools?

Thunderbit setzt auf KI, sodass du in normaler Sprache beschreiben kannst, welche Daten du brauchst. Das Tool erkennt Felder automatisch, verarbeitet Unterseiten und Pagination und exportiert Ergebnisse sofort in Tools wie Excel oder Airtable. Es ist für Nicht-Techniker gebaut und bietet Funktionen wie Datenbereinigung und geplantes Scraping zu einem niedrigen Einstiegspreis.

3. Welches Tool eignet sich am besten für großskalige Enterprise-Scraping-Projekte?

Bright Data und sind besonders passend für Enterprise-Anforderungen. Sie bieten u. a. Proxy-Rotation, Anti-Bot-Mechanismen, hohe Parallelisierung und API-Zugriff – ideal für Organisationen, die tausende Webseiten zuverlässig und in großem Umfang verarbeiten müssen.

4. Gibt es Tools, die Scraping mit Automatisierung und Outreach kombinieren?

Ja. Clay und Bardeen verbinden Webdaten-Scraping mit Workflows. Clay reichert Leads an und automatisiert Outreach, während Bardeen browserbasierte Aufgaben und Abläufe mit KI-gestützten Playbooks automatisiert.

5. Was ist die beste Option für Nutzer ohne technischen Hintergrund?

Thunderbit ist für Nicht-Techniker besonders geeignet – dank Interface in natürlicher Sprache, KI-gestützter Einrichtung und sehr einfacher Bedienung. Kein Coding, kein Setup-Aufwand – ideal für Business-Teams, die schnell und zuverlässig Daten brauchen, ohne technische Komplexität.