Walmart.com hat über , rund 50 Milliarden US-Dollar an Nettoumsatz im E-Commerce und einige der aggressivsten Anti-Bot-Abwehrmechanismen im Handel. Wenn Sie schon einmal versucht haben, Produktdaten von Walmart zu scrapen — Preise, Lagerbestände, Verkäuferinfos — sind Sie wahrscheinlich an eine Wand gelaufen, die statt der gewünschten Daten leere Felder oder eine CAPTCHA-Seite zurückgab.

Ich habe wochenlang 9 verschiedene Walmart-Scraping-Tools getestet, von No-Code-Chrome-Erweiterungen bis hin zu APIs für den Enterprise-Einsatz. Mein Ziel war simpel: herauszufinden, welche im Jahr 2026 tatsächlich nutzbare Walmart-Produktdaten liefern und welche nur Credits verbrennen. Die Antwort hängt stark davon ab, wer Sie sind — ein einzelner Händler mit 50 SKUs, ein Entwickler, der eine Pipeline baut, oder ein Enterprise-Team, das täglich Tausende Produkte überwacht. Im Folgenden zeige ich, was funktioniert hat, was nicht und wie Sie das richtige Tool für Ihren Anwendungsfall auswählen.

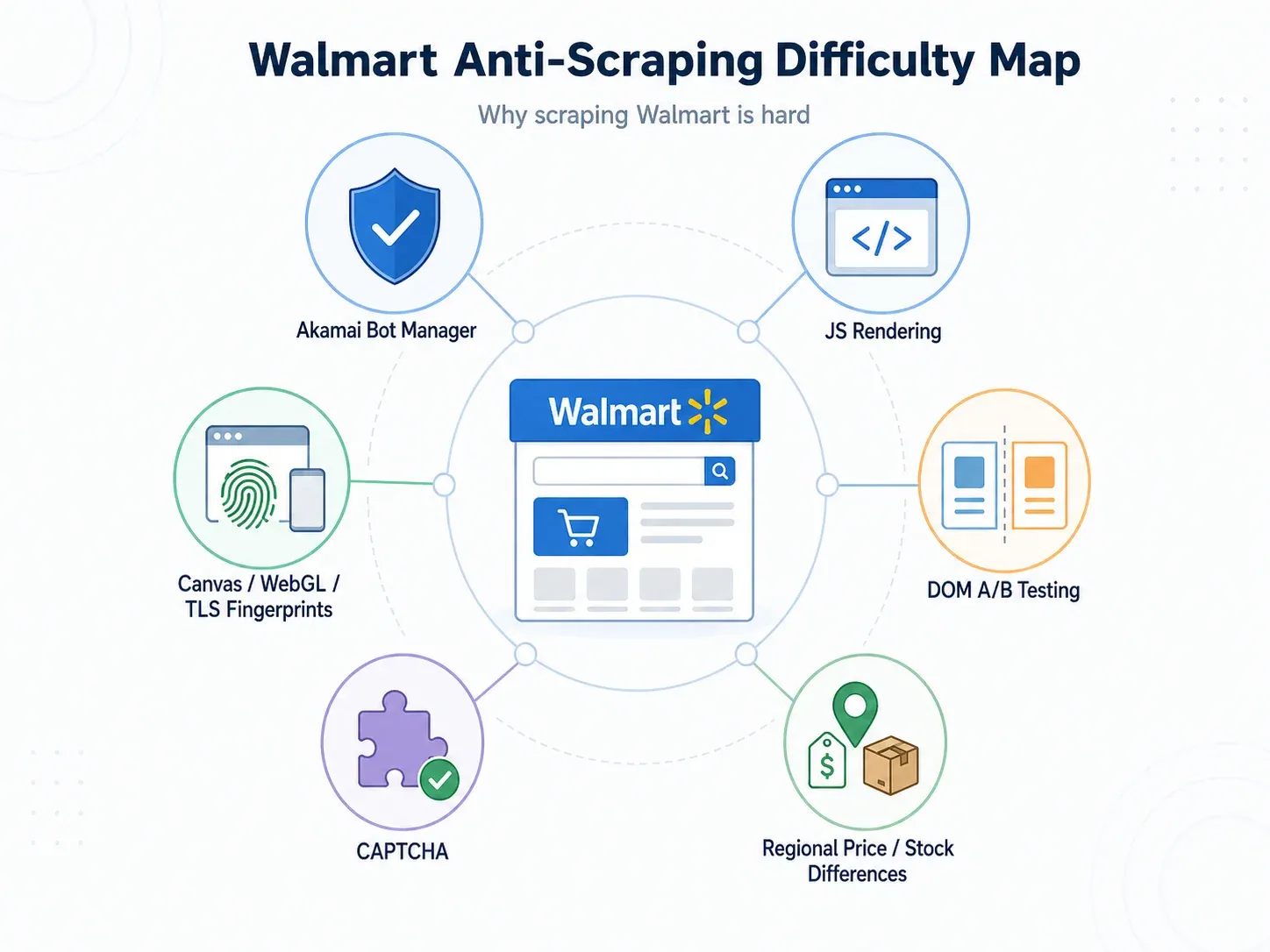

Warum das Scraping von Walmart schwieriger ist als bei den meisten Retail-Seiten

Die meisten gehen davon aus, dass Walmart zu scrapen genauso ist wie jede andere Handelsseite zu scrapen. Ist es nicht. Der Anti-Bot-Stack von Walmart wird von Quellen aus der Scraping-Branche häufig mit 9/10 Schwierigkeitsgrad bewertet — und das aus gutem Grund.

Das ist die eigentliche Herausforderung:

- Akamai Bot Manager: Walmart nutzt , der Anfragen anhand KI-/ML-gestützter Verhaltensanalysen, Browser-/Device-Fingerprinting, HTTP-Anomalieerkennung und Signalen aus der Benutzerinteraktion bewertet. Akamai verarbeitet täglich 40 Milliarden Bot-Anfragen und analysiert pro Tag 946 TB neue Sicherheitsdaten.

- JavaScript-gerenderte Inhalte: Preise, Fulfillment-Optionen, Verkäuferinfos und Lagerstatus tauchen oft nicht im initialen HTML auf. Dafür braucht es ein vollständiges Rendering im Browser.

- Canvas/WebGL/TLS-Fingerprinting: Wie es in einem Production-Thread hieß: „Walmart fingerprintet mehr als nur Ihre IP — Canvas, WebGL, Timing, TLS.“ Einfache Proxy-Rotation reicht hier nicht aus.

- Häufige DOM-Änderungen durch A/B-Tests: Walmart fährt ständig Layout-Experimente. Ein CSS-Selektor, der am Montag den Preis ausliest, kann bis Mittwoch nur noch einen leeren String zurückgeben — ohne offensichtlichen Fehler.

- CAPTCHA-Abfang: Manche Scraper lesen stillschweigend eine CAPTCHA-Challenge-Seite ein und behandeln sie als „Erfolg“ — am Ende stehen dann unbrauchbare Daten.

Das praktische Ergebnis? Ein Scraper, der auf den meisten Retail-Seiten „funktioniert“, scheitert bei Walmart oft stillschweigend — und liefert HTTP-200-Antworten mit fehlenden oder falschen Daten.

Matrix der Anti-Bot-Herausforderungen

| Herausforderung | Was passiert | Tools, die damit klarkommen |

|---|---|---|

| JS-Rendering erforderlich | Einfaches HTTP liefert leere HTML-Hülle | Thunderbit, Bright Data, Oxylabs, Zyte, ScraperAPI, ScrapingBee, Decodo |

| Canvas/WebGL-Fingerprinting | Bot-Erkennung trotz Proxies | Bright Data, Decodo, Zyte, Oxylabs |

| Selektor-Bruch (A/B-Tests) | Datenfelder sind leer oder falsch | Thunderbit (KI liest die Seite jedes Mal frisch), Zyte AI, strukturierte APIs von Bright Data/Oxylabs |

| CAPTCHA-Abfang | Parser liest CAPTCHA-Seite stillschweigend ein | ScraperAPI, Bright Data, Oxylabs, ScrapingBee |

| Regionale Preise/Bestände | Preis hängt vom ZIP-/Store-Kontext ab | Geo-Targeting von Bright Data, Oxylabs, Decodo, ScraperAPI, ScrapingBee |

Worauf ich beim Testen dieser Walmart-Scraper geachtet habe

Nicht jeder Walmart-Scraper löst dasselbe Problem. Ein einzelner Händler, der 30 Preise prüft, ist nicht dasselbe wie ein Enterprise-Team, das täglich 10.000 SKUs überwacht. Das habe ich bei allen 9 Tools bewertet:

- Erfolgsrate gegen Anti-Bot-Systeme: Liefert das Tool echte Produktdaten oder nur HTTP 200 mit leeren Feldern?

- Feldabdeckung: Kann es Titel, Preis, Verfügbarkeit, Verkäufer, Bewertung, Rezensionen, UPC, Bilder, Fulfillment-Optionen und Spezifikationen extrahieren?

- JS-Rendering: Kommt es mit dem clientseitigen Rendering von Walmart zurecht?

- Abrechnungsmodell: Pay-per-Success (Sie zahlen nicht für blockierte Anfragen) vs. Pay-per-Request (Credits werden auch bei Fehlschlägen verbraucht).

- Einrichtungsaufwand: No-Code (klicken und loslegen) vs. API (Code schreiben und integrieren).

- Wartungsaufwand: Feste Selektoren brechen bei Walmart oft. KI-/semantische Extraktion oder vom Anbieter gepflegte Endpunkte reduzieren das.

- Export/Output: Business-User brauchen Sheets/Excel/Airtable/Notion. Entwickler brauchen JSON/CSV/Webhooks.

- Skalierbarkeit: Einmalige Recherche, tägliches Monitoring und große Katalog-Datasets sind unterschiedliche Aufgaben.

- Free-Tier: Was lässt sich für 0 € wirklich erledigen?

Unabhängige Benchmarks halfen dabei, die Erwartungen einzuordnen. testete 200 URLs mit insgesamt 2.000 Anfragen und verglich strukturierten Output, Feldabdeckung und Antwortzeit. stuft Walmart als Akamai-Ziel ein und vergleicht 10 Anbieter nach Erfolgsrate und Geschwindigkeit. Bright Datas Walmart-Ranking-Artikel nennt Antwortzeiten von 2,31 s bis 11,12 s und Feldzahlen von unter 300 bis über 650 pro Produktseite über die getesteten Tools hinweg.

Die 9 besten Walmart-Scraper auf einen Blick

| Tool | Typ | Anti-Bot-Umgang | Free-Tier | Startpreis | Am besten für | Code erforderlich? |

|---|---|---|---|---|---|---|

| Thunderbit | Chrome-Erweiterung / KI-Scraper | Browser-/Cloud-Scraping, adaptive KI-Extraktion | 6 Seiten/Monat (10 mit Test) | ca. 9 $/Monat | Nicht-technische Teams | Nein |

| Bright Data | Walmart-API / Dataset / Scraping-Browser | Managed Unblocking, JS, CAPTCHA, Geo | Test/Guthaben | ca. 0,75 $/1.000 erfolgreiche Anfragen | Enterprise-Skalierung | Optional |

| Oxylabs | Web-Scraper-API | JS-Rendering, Proxy-/Unblocking, Parser | Bis zu 2.000 Testergebnisse | 49 $/Monat | Vollständige Datenabdeckung | Ja |

| Decodo | E-Commerce-Scraping-API | JS, Premium-Modi, Anti-Bot | 2.000 reguläre oder 667 Premium+JS | ca. 9 $/Monat | Bestes Preis-Leistungs-Verhältnis bei APIs | Meist ja |

| Zyte API | Generische Scraping-API | Automatisches Tiering, Browser-Requests | 5 $ Guthaben | Ab 0,06 $/1.000 | Schnelle API-Workflows | Ja |

| ScraperAPI | Walmart-Endpunkte / REST-API | Proxy-Rotation, Render, Premium-Modi | 7 Tage / 5.000 Credits | 49 $/Monat | Entwickler mit kleinem Budget | Ja |

| Apify | Actor-Marktplatz / Plattform | Hängt vom Actor/Proxy ab | 5 $/Monat Plattform-Guthaben | 49 $/Monat + Nutzung | Eigene Workflows | Optional |

| Octoparse | No-Code-Desktop-/Cloud-Scraper | Visuelle Selektoren, Cloud-/Proxy-Add-ons | Kostenloser Plan (eingeschränkt) | 69 $/Monat Standard | Einsteiger | Nein |

| ScrapingBee | Walmart-API / HTML-API | JS, Premium-/Stealth-Proxies, CAPTCHA | 1.000 Credits | 49 $/Monat | Leichte API-Projekte | Ja |

Preise Stand April 2026; bitte vor dem Kauf prüfen.

1. Thunderbit

ist eine KI-gestützte Chrome-Erweiterung und ein Web-Scraper für Business-User, die strukturierte Daten von Walmart brauchen — ohne Code zu schreiben, Selektoren zu konfigurieren oder Proxies zu verwalten.

Der Ablauf ist tatsächlich in zwei Klicks erledigt. Öffnen Sie eine Walmart-Suchergebnisseite oder eine Produktliste, klicken Sie auf „KI-Felder vorschlagen“, und Thunderbit liest die sichtbare Seite aus und schlägt Spalten vor: Produktname, Preis, Bewertung, Lagerstatus, Verkäufer, Rezensionen, Bild-URL, Produkt-URL. Klicken Sie auf „Scrapen“, und die Tabelle füllt sich. Brauchen Sie tiefere Daten? Klicken Sie auf „Unterseiten scrapen“, und Thunderbit besucht jede Produktseite, um Spezifikationen, UPC, detaillierte Beschreibungen und mehr zu holen.

Der entscheidende Vorteil bei Walmart ist die adaptive Extraktion. Klassische Scraper verlassen sich auf feste CSS-Selektoren oder XPath — und die brechen jedes Mal, wenn Walmart einen A/B-Test fährt oder sein DOM aktualisiert. Thunderbits KI liest die Seitenstruktur jedes Mal neu und versteht Inhalte semantisch statt rein positionsbasiert. In meinen Tests bedeutete das: Ich musste nach Layout-Änderungen bei Walmart keine kaputten Selektoren reparieren — genau der Wartungsaufwand, der selektorbasierte Tools häufig lahmlegt.

Wichtige Funktionen für das Scraping von Walmart

- KI-Felder vorschlagen: Liest Walmart-Seiten und erstellt automatisch Spaltennamen und Datentypen — kein manuelles Selektor-Setup.

- Unterseiten-Scraping: Scrapen Sie eine Listing-Seite und reichern Sie anschließend jede Zeile mit detaillierten Spezifikationen von den einzelnen Produktseiten an.

- Paginierung und Infinite Scroll: Kommt mit Walmarts paginierten Suchergebnissen und „Mehr laden“-Mustern zurecht.

- Geplantes Scraping: Richten Sie wiederkehrende Läufe für tägliches oder wöchentliches Preis-/Bestandsmonitoring ein.

- Kostenlose Exporte: Excel, CSV, Google Sheets, Airtable, Notion — ohne versteckte Download-Gebühren.

- Browser- und Cloud-Modus: Browser-Scraping für eingeloggte bzw. standortspezifische Inhalte; Cloud-Scraping für schnellere öffentliche Seitenläufe (bis zu 50 Seiten gleichzeitig).

- Kostenlose E-Mail- und Telefon-Extraktoren: Nützlich, wenn Sie Verkäuferseiten im Walmart Marketplace nach Kontaktdaten durchsuchen.

- 34 Sprachunterstützungen.

Vor- und Nachteile

| Vorteile | Nachteile |

|---|---|

| Kein Setup, kein Code | Free-Tier für starkes Monitoring eher klein |

| KI passt sich Layout-Änderungen an — keine Selektor-Wartung | Keine dedizierte Enterprise-API nur für Walmart |

| Kostenlose Exporte nach Sheets, Excel, Airtable, Notion | Bezahlplan nötig für größere Unterseiten-/Paginierungsjobs |

| Unterseiten-Scraping reichert Listing-Daten an | Jüngeres Tool im Vergleich zu Enterprise-API-Anbietern |

| Browser- und Cloud-Modus für unterschiedliche Workflows |

Preis: Free-Tier (6 Seiten/Monat, 10 mit Test). Bezahlpläne ab ca. 9 $/Monat. 1 Credit = 1 Ausgabenzeile.

Am besten für: Nicht-technische Teams — Sales Ops, E-Commerce-Operatoren, VAs, kleine Händler — die Walmart-Produktdaten in einer Tabelle wollen, ohne Code zu schreiben oder Infrastruktur zu verwalten.

2. Bright Data

Bright Data ist die umfassendste Enterprise-Plattform für Walmart-Daten — nicht nur eine einzelne API. Sie bietet eine dedizierte Walmart Scraper API, vorab gesammelte Walmart-Datasets (über 267 Mio. Datensätze), einen Scraping Browser für JS-/CAPTCHA-Handling und einen MCP Server für KI-/LLM-Workflows.

In Benchmark-Tests meldete Bright Data eine Erfolgsrate von 98,44 % über 11 Anbieter hinweg in einem unabhängigen Scrape.do-Benchmark. Das Pay-per-Success-Modell bedeutet, dass Sie nicht zahlen, wenn Walmart eine Anfrage blockiert. In großem Maßstab macht dieser Unterschied enorm viel aus.

Wichtige Funktionen für das Scraping von Walmart

- Dedizierter Walmart-Endpunkt: Strukturiertes JSON mit Feldern wie URL, Endpreis, SKU, Währung, GTIN, Spezifikationen, Bild-URLs und Top-Bewertungen.

- Vorab gesammelte Datasets: Historischer Massen-Zugriff auf Walmart-Produktdaten.

- Scraping Browser: Übernimmt JS-Rendering, CAPTCHA-Lösung und Fingerprinting-Umgehung.

- Geo-Targeting auf Stadtebene: Kritisch für regionale Preisanalyse.

- Proxy-Netzwerk: Über 150 Mio. Residential IPs.

- MCP Server: Für LLM-/KI-Agenten-Integration.

Vor- und Nachteile

| Vorteile | Nachteile |

|---|---|

| Höchste Erfolgsrate in Benchmarks | Premium-Preise und hohe Komplexität |

| Pay-per-Success-Abrechnung | Mehrere Produktlinien können verwirrend sein |

| Geo-Targeting für regionale Preise | Mindestumsatz bei Enterprise-Plänen |

| Datasets für historischen Massen-Zugriff |

Preis: Walmart Scraper API ab ca. 0,75 $/1.000 erfolgreiche Anfragen. Datasets ab ca. 50 $/100.000 Datensätze. Enterprise-Pläne mit Mindestumsätzen.

Am besten für: Enterprise-Teams, die maximale Zuverlässigkeit, Geo-Targeting und strukturierte Walmart-Daten in großem Umfang brauchen.

3. Oxylabs

Oxylabs ist eine starke Enterprise-Alternative mit Fokus auf Datenvollständigkeit. Die Web Scraper API listet Walmart-Ziele direkt: Walmart Product (59 geparste Datenpunkte), Walmart Search (58 geparste Datenpunkte) und Walmart URL mit Roh-HTML oder geparster Ausgabe.

In Benchmark-Zusammenfassungen wird Oxylabs für seine hohe Feldtiefe genannt — in einigen Tests rund 620+ Felder pro Walmart-Produktseite. Der kostenlose Test umfasst bis zu 2.000 Ergebnisse, und die bezahlten Pläne starten bei 49 $/Monat.

Wichtige Funktionen für das Scraping von Walmart

- Hohe Feldanzahl: 59 geparste Datenpunkte pro Walmart-Produktseite.

- Anti-Bot-Handling: Beherrscht Akamai- und HUMAN-Security-Schichten.

- Mehrere Ausgabeformate: Geparstes JSON und Roh-HTML.

- Skalierbare API-Architektur.

Vor- und Nachteile

| Vorteile | Nachteile |

|---|---|

| Tiefgehende Datenextraktion (59+ Felder) | Höherer Preis |

| Zuverlässiges Anti-Bot-Handling | Code für API-Integration erforderlich |

| Guter Test (2.000 Ergebnisse) | Steilere Lernkurve für nicht-technische Nutzer |

| Enterprise-Support |

Preis: Kostenloser Test bis zu 2.000 Ergebnisse. Bezahlte Pläne ab 49 $/Monat. JS-Rendering etwa 0,35 $/1.000 Ergebnisse.

Am besten für: Teams, die maximale Feldabdeckung und strukturierte Walmart-Daten per API brauchen.

4. Decodo

Decodo (früher Smartproxy) bietet die beste Balance aus Preis und Leistung für Walmart-Scraping im mittleren Maßstab. Die eCommerce Scraper API unterstützt Walmart mit fertigen Templates, Anti-Bot-Umgehung und JS-Rendering.

Der kostenlose Plan gibt Ihnen bis zu 2.000 reguläre Anfragen oder 667 Premium+JS-Anfragen — genug, um zu testen, ob Walmart-Seiten verwertbare Daten zurückgeben, bevor Sie sich festlegen. Bezahlpläne starten bei etwa 9 $/Monat, mit Preisen im mittleren Segment ab nur 0,30 $/1.000 reguläre Anfragen.

Wichtige Funktionen für das Scraping von Walmart

- Günstige Preisgestaltung pro Anfrage.

- E-Commerce-fokussierte API mit Templates.

- CAPTCHA- und Anti-Bot-Handling.

- Geolocation-Targeting.

- Kostenloser Starter-Plan zum Testen.

Vor- und Nachteile

| Vorteile | Nachteile |

|---|---|

| Wettbewerbsfähige Preise | Weniger Walmart-spezifische Funktionen als Bright Data |

| Solide Leistung für den Preis | Code erforderlich |

| Großzügiger Free-Plan zum Testen | Modus-Multiplikatoren können die effektiven Kosten erhöhen |

| Gut für Projekte im mittleren Maßstab | Kleineres Proxy-Netzwerk als die Enterprise-Spitze |

Preis: Kostenloser Plan (2.000 reguläre Anfragen). Bezahlte Pläne ab ca. 9 $/Monat.

Am besten für: Teams, die eine leistungsfähige Walmart-API ohne Enterprise-Preise wollen — besonders für Monitoring oder Katalogaufbau im mittleren Umfang.

5. Zyte API

Zyte ist laut Benchmarks die schnellste Option, mit einer berichteten medianen Antwortzeit von 2,31 Sekunden und einer Erfolgsrate von 96,22 % auf Walmart-Seiten. Die API nutzt automatisches Tiering — wählt also je nach Anfrage Datacenter-, Residential- oder Rendering-Technologien — und berechnet nur das, was nötig ist.

Neue Nutzer erhalten 5 $ kostenloses Guthaben. Die Preise beginnen bei 0,06 $/1.000 erfolgreiche Antworten, Browser-Tier-Anfragen kosten mehr.

Wichtige Funktionen für das Scraping von Walmart

- Schnelle Antwortzeiten (median ca. 2–3 Sekunden).

- KI-gestützte strukturierte Extraktion für E-Commerce-Daten.

- Flexible Pay-per-Request-Preisgestaltung mit automatischem Tiering.

- Browser-Requests für JavaScript-gerenderte Walmart-Seiten.

Vor- und Nachteile

| Vorteile | Nachteile |

|---|---|

| Schnellste Antwortzeit in Benchmarks | Kleineres Free-Tier |

| KI-Extraktionsfunktionen | Weniger Walmart-spezifische Tools als Bright Data |

| Flexible Preisgestaltung | Technisches Setup erforderlich |

| Gut für Echtzeit-Monitoring | Automatisches Tiering macht die exakten Kosten weniger vorhersehbar |

Preis: 5 $ kostenloses Guthaben. Ab 0,06 $/1.000 erfolgreiche Antworten; Browser-Tiers teurer.

Am besten für: Entwickler, die Echtzeit-Monitoring-Pipelines bauen und Geschwindigkeit sowie flexible Preise brauchen.

6. ScraperAPI

ScraperAPI hat eines der klarsten Walmart-spezifischen Entwicklerangebote. Die Walmart Scraper bietet strukturierte Endpunkte für Produktseiten, Suche, Kategorien und Rezensionen — mit synchronen und asynchronen Optionen.

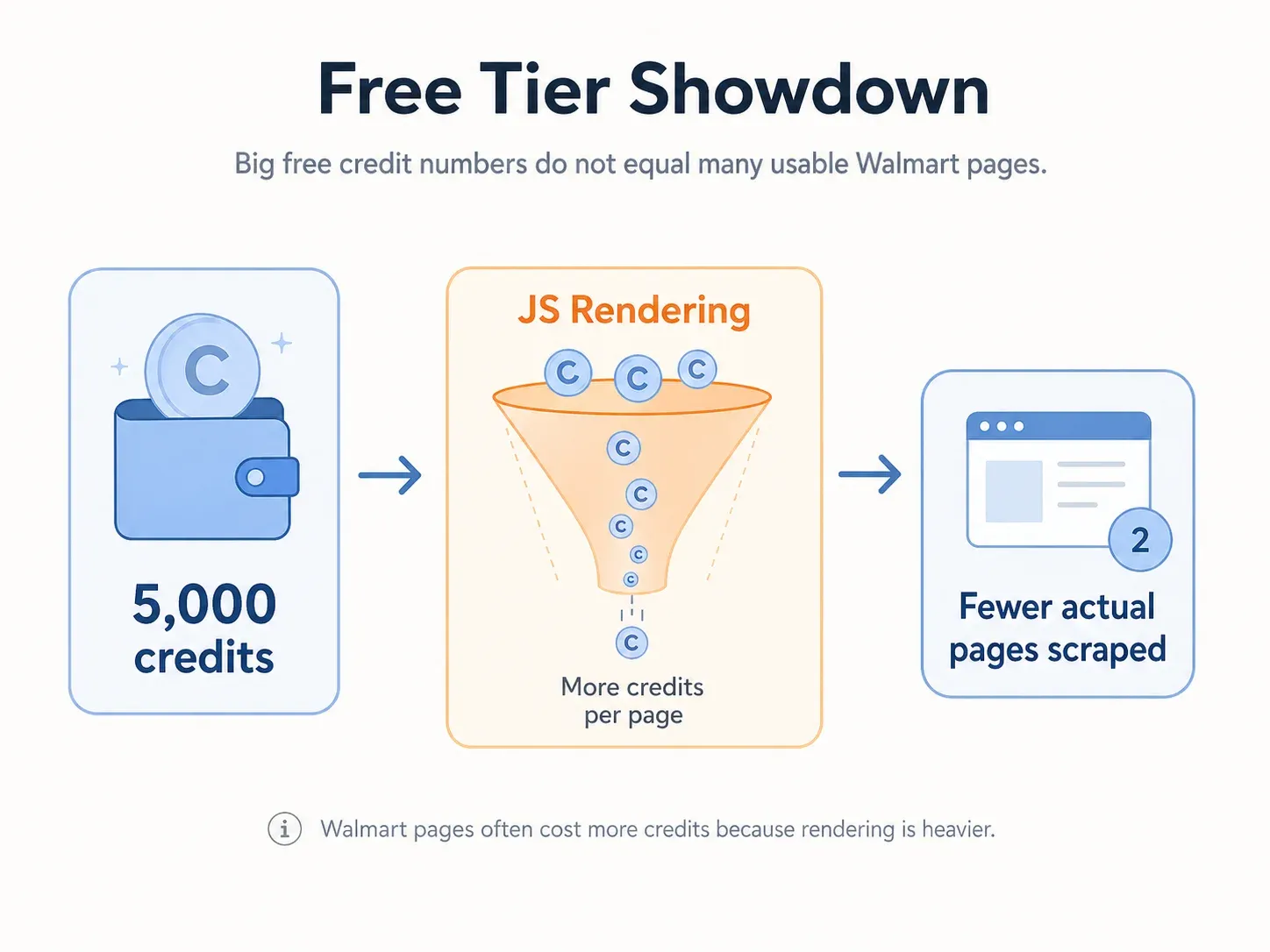

Der 7-Tage-Test gibt Ihnen 5.000 Credits, und bezahlte Pläne starten bei 49 $/Monat mit 100.000 Credits. Aber hier kommt der Haken: Das Credit-System von ScraperAPI berechnet 1 Credit für einfache Anfragen, 10 für JS-Rendering, 25 für Premium+Render und bis zu 75 für Ultra Premium+Render. Walmart erfordert fast immer JS-Rendering, also ist die effektive Seitenzahl deutlich kleiner als die rohe Credit-Zahl.

Wichtige Funktionen für das Scraping von Walmart

- Dedizierte Walmart-Endpunkte (Produkt, Suche, Kategorie, Rezensionen).

- Einfache REST-API-Integration.

- Automatische Proxy-Rotation und CAPTCHA-Handling.

- JavaScript-Rendering.

- Geolocation-Targeting.

Vor- und Nachteile

| Vorteile | Nachteile |

|---|---|

| Günstiger Einstiegspreis | Credits verbrennen bei Walmart schnell (JS = 10+ Credits/Seite) |

| Einfache API mit guter Dokumentation | Niedrigere Erfolgsrate als Enterprise-Tools bei Walmart |

| Dedizierte Walmart-Endpunkte | Credits werden auch bei fehlgeschlagenen Anfragen verbraucht |

| Kostenloser Test |

Preis: 7-Tage-Test (5.000 Credits). Bezahlte Pläne ab 49 $/Monat.

Am besten für: Entwickler, die eine unkomplizierte Walmart-API zu einem vernünftigen Preis wollen — und die die Credit-Multiplikatoren korrekt kalkulieren.

7. Apify

Apify ist eine Plattform und ein Actor-Marktplatz, kein einzelner Scraper. Dort finden Sie vorgefertigte Walmart-Actors wie automation-lab/walmart-scraper (ca. 0,004 $ pro Produkt plus Laufkosten), Axesso-Walmart-Lookup-/Search-Actors und andere, die von Community-Entwicklern gepflegt werden.

Der kostenlose Plan bietet 5 $/Monat an Nutzungsguthaben. Bezahlpläne starten bei 49 $/Monat plus Pay-as-you-go-Compute. Die Plattform unterstützt Scheduling, Batch-Verarbeitung, Webhooks, Dataset-Exporte und API-Clients.

Wichtige Funktionen für das Scraping von Walmart

- Vorgefertigte Walmart-Scraper-Actors im Marktplatz.

- Skalierbare Cloud-Plattform zum Ausführen von Aufgaben.

- APIs für benutzerdefinierte Integrationen und Pipeline-Building.

- Scheduling und Batch-Verarbeitung.

- Mehrere Exportformate (JSON, CSV, Excel).

Vor- und Nachteile

| Vorteile | Nachteile |

|---|---|

| Flexibel und anpassbar | Die Qualität der Actors hängt vom jeweiligen Maintainer ab |

| Guter Marktplatz mit Walmart-Actors | Kosten steigen bei intensiver Nutzung |

| Skalierbare Cloud-Infrastruktur | Für eigene Actors braucht man mehr technisches Wissen |

| Entwicklerfreundliche APIs | Proxy-/Anti-Bot-Handling hängt von der Actor-Konfiguration ab |

Preis: Kostenloser Plan (5 $/Monat Guthaben). Starter 49 $/Monat + Nutzung.

Am besten für: Teams, die eigene Walmart-Scraping-Workflows mit Scheduling, Batch-Verarbeitung und API-Integration brauchen.

8. Octoparse

Octoparse ist der klassische No-Code-Scraper zum Klicken und Loslegen. Mit dem visuellen Workflow-Builder können Sie Elemente auf einer Walmart-Seite auswählen, Extraktionsregeln konfigurieren und Scraper lokal oder in der Cloud ausführen. Für einen schnelleren Start gibt es eine .

Der kostenlose Plan umfasst begrenzte lokale Extraktion und Export. Bezahlpläne starten bei 69 $/Monat (Standard, jährlich abgerechnet).

Wichtige Funktionen für das Scraping von Walmart

- Visueller Point-and-Click-Workflow-Builder.

- Cloud- und lokale Scraping-Optionen.

- Geplantes Scraping für wiederkehrendes Monitoring.

- Vorlagenbibliothek inklusive Walmart.

- Mehrere Exportformate (CSV, Excel).

Vor- und Nachteile

| Vorteile | Nachteile |

|---|---|

| Kein Coding nötig | Feste Selektoren brechen, wenn Walmart Layouts ändert |

| Visuelle Oberfläche für Einsteiger | Langsamere Cloud-Ausführung |

| Großzügige Zeilenlimits im Free-Plan | Teurer für Teams |

| Geplantes Scraping | Weniger KI-Anpassung als Thunderbit |

Preis: Kostenloser Plan (eingeschränkt). Bezahlte Pläne ab 69 $/Monat Standard.

Am besten für: Einsteiger, die eine visuelle No-Code-Oberfläche wollen und bereit sind, Selektoren zu pflegen, wenn Walmart-Layouts sich ändern.

Der wesentliche Unterschied zwischen Octoparse und Thunderbit: Beide sind No-Code, aber Thunderbit nutzt KI, um sich automatisch an Seitenänderungen anzupassen, während Octoparse auf feste Selektoren setzt, die bei DOM-Änderungen bei Walmart manuell aktualisiert werden müssen.

9. ScrapingBee

ScrapingBee ist eine leichte API für Entwickler, die einfache Proxy-Rotation und JS-Rendering ohne große Plattform wollen. Es bietet sowohl eine allgemeine HTML-API als auch eine dedizierte Walmart Scraper API für Produkt- und Suchextraktion.

Das Free-Tier gibt 1.000 Credits. Bezahlte Pläne starten bei 49 $/Monat (Freelance, 250.000 Credits). Das Credit-System von ScrapingBee berechnet jedoch 1 Credit für klassische Anfragen ohne JS, 5 für JS-Rendering, 10 für Premium ohne JS, 25 für Premium mit JS und bis zu 75 für Stealth-Modus. Da Walmart mindestens JS-Rendering erfordert, liegt das effektive Free-Tier eher bei rund 200 Seiten — oder weniger, wenn Premium/Stealth nötig ist.

Wichtige Funktionen für das Scraping von Walmart

- Einfache REST-API mit Proxy-Rotation.

- JavaScript-Rendering (für Walmart erforderlich).

- Geolocation-Targeting.

- CAPTCHA-Handling.

- Walmart-spezifische API-Endpunkte.

Vor- und Nachteile

| Vorteile | Nachteile |

|---|---|

| Einfache API | Credits verbrennen bei Walmart schnell (JS = 5+ Credits/Seite) |

| Beherrscht JS-Rendering | Eingeschränktes Free-Tier für Walmart |

| Geo-Unterstützung | Code erforderlich |

| Vernünftiger Einstiegspreis | Weniger Walmart-spezifische Optimierung als Enterprise-Tools |

Preis: 1.000 kostenlose Credits. Bezahlte Pläne ab 49 $/Monat.

Am besten für: Entwickler, die eine leichte, einfache API für Walmart-Projekte brauchen — und die die Credit-Rechnung vorab kalkulieren können.

Welcher Walmart-Scraper passt zu Ihrem Workflow?

Kein Konkurrenzartikel, den ich gefunden habe, segmentiert die Tools klar nach Anwendungsfall. Diese Entscheidungstabelle hätte ich mir gewünscht, als ich angefangen habe:

| Anwendungsfall | Bestes Tool / beste Tools | Warum |

|---|---|---|

| Schnelle Produktrecherche (<100 Artikel, kein Code) | Thunderbit, Octoparse | 2-Klick-Setup, visuelle Oberfläche, Export nach Sheets |

| Preisüberwachung in großem Maßstab (1.000+ SKUs täglich) | Bright Data, Oxylabs | Pay-per-Success, strukturierter Output, hohe Erfolgsraten |

| Aufbau eines Dropshipping-Katalogs | Thunderbit, Apify | Unterseiten-Scraping reichert Listings an; template-basierte Batch-Läufe |

| Competitive Intelligence (Preise + Bewertungen) | Zyte, Decodo, Bright Data | API-Pipelines, strukturierte Felder, wiederkehrende Analysen |

| Entwickler baut eine Datenpipeline | ScraperAPI, ScrapingBee, Zyte | Einfache REST-APIs, Kontrolle über Rohantworten, Code-first |

| Enterprise-Preisanalysen nach Region | Bright Data, Oxylabs | Geo-Targeting, Infrastruktur, Enterprise-Support, Datasets |

Thunderbit passt natürlich für nicht-technische E-Commerce-Operator und kleine Teams, die Produktdaten ohne Code brauchen. Die Funktion „KI-Felder vorschlagen“ liest Walmart-Seiten und schlägt Spalten automatisch vor, und Unterseiten-Scraping kann eine Listing-Seite mit detaillierten Produktspezifikationen von jeder Artikelseite anreichern.

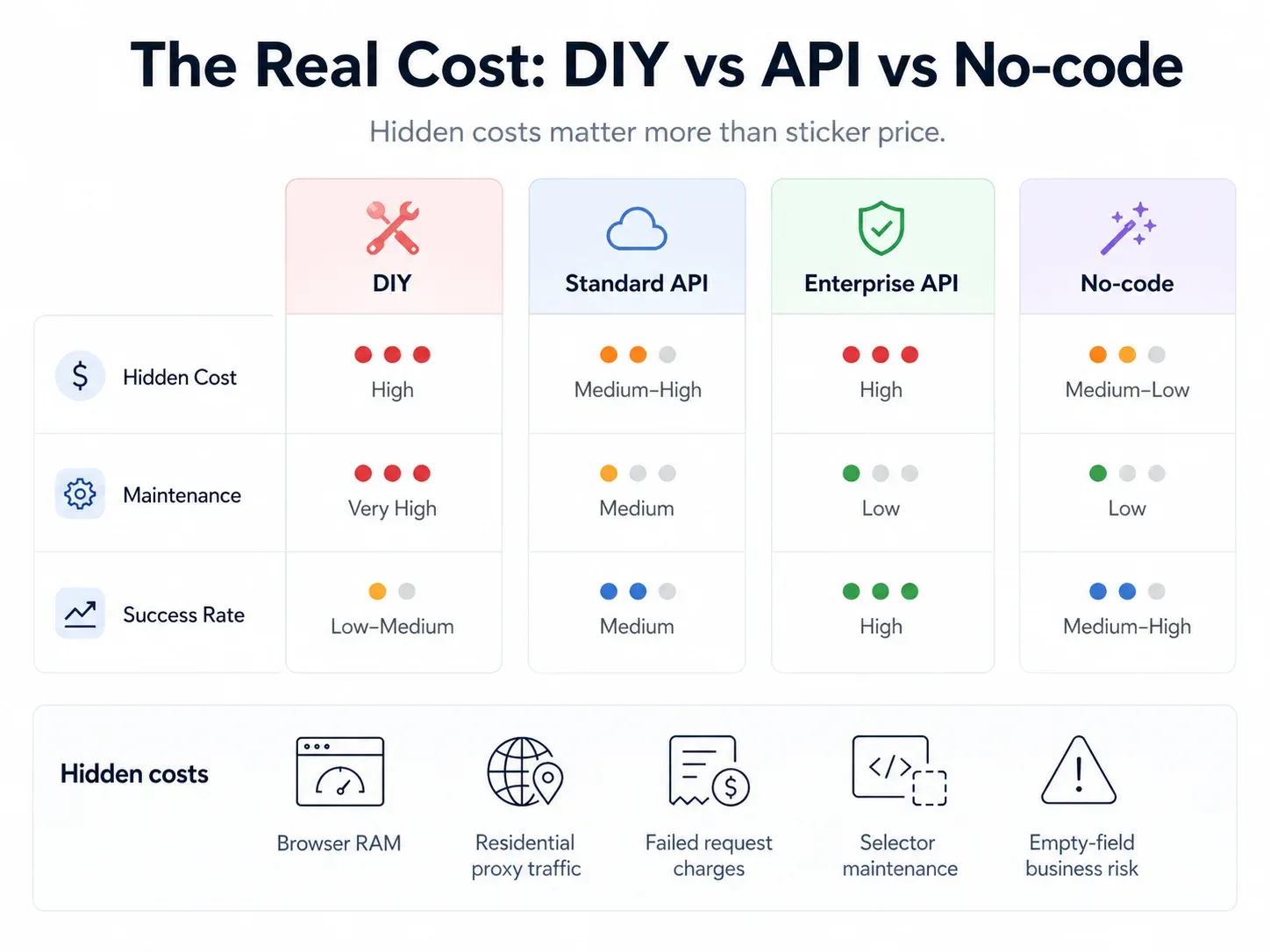

DIY-Scraper vs. Scraping-API vs. No-Code-Tool: Die wahren Kosten beim Scraping von Walmart

Diese Frage sehe ich in Foren ständig: „Soll ich meinen eigenen Walmart-Scraper bauen oder lieber für ein Tool bezahlen?“ Die Antwort hängt von den echten Kosten ab — nicht nur vom Abo-Preis.

| Ansatz | Vorlaufkosten | Monatliche Betriebskosten (1.000 Seiten/Tag) | Wartung | Tendenzielle Erfolgsrate |

|---|---|---|---|---|

| DIY (Playwright + Residential Proxies) | 0 $ (Open Source) | 200–500+ $ (Proxies + Server + Browser-Infrastruktur) | HOCH (wöchentliche Fixes) | ca. 70–85 % |

| Scraping-API (ScraperAPI, ScrapingBee) | 0 $ (Free-Tier) | 49–149 $/Monat | NIEDRIG | ca. 85–95 % |

| Enterprise-API (Bright Data, Oxylabs) | 0 $ (Test) | 300–1.000+ $/Monat | SEHR NIEDRIG | ca. 95–99 % |

| No-Code-Tool (Thunderbit, Octoparse) | 0 $ (Free-Tier) | 9–99 $/Monat | KEINE bei KI-Tools (KI passt sich an) | ca. 85–95 % |

Versteckte Kosten, die viele übersehen:

- RAM: Jede Chromium-Instanz frisst etwa 150–300 MB RAM. Bei 1.000 parallelen Seiten nähert sich Ihre Infrastrukturrechnung den Kosten bezahlter APIs an.

- Proxy-Komplexität: Residential Proxies werden pro GB und nicht pro Anfrage abgerechnet. JS-lastige Walmart-Seiten können teurer werden als erwartet.

- Fehlgeschlagene Anfragen: Manche APIs verbrauchen auch bei geblockten Anfragen Credits.

- Stille Fehler: Ein leerer Preis oder ein fehlender Bestandswert ist ein geschäftlicher Fehler, selbst wenn der Scraper „Erfolg“ meldet.

- Entwicklerzeit: Stunden mit dem Fixen kaputter Selektoren nach Walmart-Layoutänderungen haben echte Kosten.

Für die meisten Teams spricht der Break-even eher für ein bezahltes Tool — außer Sie haben bereits dedizierte Scraping-Ingenieure und Infrastruktur im Haus.

Wie extrahierte Walmart-Daten tatsächlich aussehen

Kein Konkurrenzartikel, den ich geprüft habe, zeigt eine echte Datenvorschau. Unten sehen Sie, was ein typisches Walmart-Produkt-Scraping liefert — im Tabellenformat (wie Thunderbit es ausgibt) und als API-JSON (wie Entwickler-Tools es zurückgeben):

Tabellen-Ausgabe (Thunderbit)

| Produktname | Preis | Verfügbarkeit | Verkäufer | Bewertung | Rezensionen | Bild-URL | UPC | Fulfillment |

|---|---|---|---|---|---|---|---|---|

| Great Value Sparkling Water 12pk | $4.98 | Auf Lager | Walmart.com | 4.6 | 1,284 | https://i5.walmartimages.com/...jpg | 078742000000 | Abholung / Lieferung |

| onn. Wireless Earbuds | $19.88 | Online verfügbar | Walmart.com | 4.3 | 3,912 | https://i5.walmartimages.com/...jpg | 681131000000 | Versand / Abholung |

API-JSON-Antwort (Entwickler-Tools)

1{

2 "title": "onn. Wireless Earbuds",

3 "url": "https://www.walmart.com/ip/example",

4 "price": 19.88,

5 "currency": "USD",

6 "availability": "In stock",

7 "seller": "Walmart.com",

8 "rating": 4.3,

9 "review_count": 3912,

10 "sku": "123456789",

11 "gtin": "681131000000",

12 "images": ["https://i5.walmartimages.com/...jpg"],

13 "fulfillment": {

14 "shipping": true,

15 "pickup": true,

16 "delivery": "store-dependent"

17 }

18}Zu den Kernfeldern, die über die getesteten APIs unterstützt werden, gehören Titel, URL, Preis, Währung, Bild, Rezensionsanzahl, Verfügbarkeit, Breadcrumb und Bewertung. Quelle: .

Bei Thunderbit ist der visuelle Ablauf: KI-Felder vorschlagen → Scrapen füllt die Tabelle → Export nach Google Sheets, Excel, Airtable oder Notion. Kein JSON-Parsing nötig.

Free-Tier-Duell: Was lässt sich bei Walmart für 0 $ wirklich scrapen?

Wenn Sie Student, Einzelhändler oder einfach nur beim Testen sind, das hier bekommen Sie mit dem Free-Tier der einzelnen Tools bei Walmart wirklich:

| Tool | Limit im Free-Tier | Funktioniert kostenlos mit Walmart? | Ausgabeformate | Wichtige Einschränkung |

|---|---|---|---|---|

| Thunderbit | 6 Seiten/Monat (10 mit Test) | ✅ Ja (Browser-Scraping) | Excel, CSV, Sheets, Airtable, Notion | Seitenlimit |

| ScraperAPI | 5.000 Credits (7 Tage) | ⚠️ Eingeschränkt (~500 Seiten, wenn JS = 10 Credits) | JSON | Credits verbrennen schnell |

| Apify | 5 $ kostenlose Credits/Monat | ⚠️ ~50 Seiten (abhängig vom Actor) | JSON, CSV, Excel | Actor-Laufgrenzen |

| Octoparse | Kostenloser Plan (lokal eingeschränkt) | ✅ Ja (lokale Extraktion) | CSV, Excel | Cloud-/Proxy-Funktionen kostenpflichtig |

| ScrapingBee | 1.000 Credits | ⚠️ ~200 Seiten (JS = 5 Credits) | JSON, HTML | Credits verbrennen schnell |

| Decodo | 2.000 reguläre oder 667 Premium+JS | ✅ Ja, zum Testen | HTML, JSON, CSV | Modus-Multiplikatoren zählen |

| Zyte | 5 $ kostenloses Guthaben | ✅ Ja, zum Testen | HTTP-/Browser-Antworten | Automatisches Tiering macht die Seitenzahl unsicher |

| Bright Data | Test/Guthaben (variiert) | ✅ Wenn freigeschaltet | JSON, NDJSON, CSV | Sales-/Testberechtigung |

| Oxylabs | Bis zu 2.000 Testergebnisse | ✅ Zum Testen | Geparstes JSON, Roh-HTML | API-Setup erforderlich |

Wichtige Erkenntnis für preisbewusste Nutzer: Thunderbits kostenloser Export (Excel, Google Sheets, Airtable, Notion) bedeutet, dass Sie selbst im Free-Tier saubere Ausgaben ohne versteckte Download-Gebühren erhalten — etwas, das bei mehreren API-basierten Tools extra kostet. Außerdem sind die E-Mail- und Telefon-Extraktoren komplett kostenlos, wenn Sie Kontaktdaten von Verkäuferseiten im Marketplace scrapen.

Direktvergleich: Alle 9 Walmart-Scraper im Vergleich

| Tool | Typ | Anti-Bot-Umgang | Free-Tier | Startpreis | Am besten für | Code erforderlich? |

|---|---|---|---|---|---|---|

| Thunderbit | Chrome-Erweiterung / KI-Scraper | KI-adaptiv, Browser/Cloud | 6 Seiten/Monat | ca. 9 $/Monat | Nicht-technische Teams | Nein |

| Bright Data | Walmart-API / Dataset / Browser | Managed Unblocking, Geo, CAPTCHA | Test | ca. 0,75 $/1K Erfolg | Enterprise-Skalierung | Optional |

| Oxylabs | Web Scraper API | JS, Proxy, Parser | 2.000 Testergebnisse | 49 $/Monat | Datenvollständigkeit | Ja |

| Decodo | E-Commerce-API | JS, Premium, Anti-Bot | 2.000 regulär | ca. 9 $/Monat | Bestes Preis-Leistungs-Verhältnis bei APIs | Meist ja |

| Zyte | Generische API | Auto-Tiering, Browser | 5 $ Guthaben | 0,06 $/1K | Schnelle API | Ja |

| ScraperAPI | Walmart-Endpunkte / REST | Proxy, Render, Premium | 5.000 Credits (7 Tage) | 49 $/Monat | Entwickler mit kleinem Budget | Ja |

| Apify | Actor-Marktplatz | Actor-abhängig | 5 $/Monat Guthaben | 49 $/Monat + Nutzung | Eigene Workflows | Optional |

| Octoparse | No-Code-Desktop-/Cloud | Visuelle Selektoren | Kostenloser Plan | 69 $/Monat | Einsteiger | Nein |

| ScrapingBee | HTML-/Walmart-API | JS, Premium, CAPTCHA | 1.000 Credits | 49 $/Monat | Leichte API | Ja |

Wenn Sie Enterprise-Zuverlässigkeit brauchen, nehmen Sie Bright Data oder Oxylabs. Wenn Sie das schnellste No-Code-Setup für Walmart wollen, probieren Sie Thunderbit. Wenn Sie als Entwickler mit kleinem Budget unterwegs sind, sind ScraperAPI oder Decodo solide Ausgangspunkte.

Fazit: So wählen Sie den besten Walmart-Scraper für Ihren Bedarf

Walmart ist eine der schwierigsten Retail-Seiten, wenn es um zuverlässiges Scraping geht. Das richtige Tool hängt von Ihrem Anwendungsfall, Budget und technischen Kenntnisstand ab. Meine Kurzempfehlung nach Persona:

- Nicht-technische Teams, die schnelle Ergebnisse wollen → . Zwei Klicks, KI-gestützt, Export nach Sheets/Excel/Airtable/Notion.

- Enterprise-Teams, die maximale Zuverlässigkeit im großen Maßstab brauchen → Bright Data oder Oxylabs. Pay-per-Success, Geo-Targeting, strukturierte Endpunkte.

- Entwickler, die Datenpipelines bauen → ScraperAPI, ScrapingBee oder Zyte. Einfache REST-APIs, Code-first.

- Preisbewusste Nutzer, die das beste Preis-Leistungs-Verhältnis suchen → Decodo oder Thunderbits Free-Tier.

- Bauer individueller Workflows → Apify für Actor-basierte Komponierbarkeit.

Mein Rat: Starten Sie mit einem Free-Tier und testen Sie, ob ein Tool wirklich die Walmart-Felder liefert, die Sie brauchen. Gehen Sie erst dann in einen Bezahlplan, wenn Sie die Ausgabequalität auf Ihren konkreten Produktkategorien validiert haben — denn Walmarts Abwehrmechanismen treffen unterschiedliche Seiten unterschiedlich stark.

Wenn Sie sehen möchten, wie KI-gestütztes Walmart-Scraping ohne eine einzige Codezeile aussieht, . Meiner Erfahrung nach ist das der reibungsärmste Weg, saubere Walmart-Daten in eine Tabelle zu bekommen. Und wenn Sie eher Entwickler sind, geben Ihnen die API-basierten Tools oben die Kontrolle und Skalierung, die Sie brauchen.

Viel Erfolg beim Scraping — und mögen Ihre Preise immer aktuell und Ihre Felder nie leer sein.

FAQs

1. Ist es legal, Walmart-Produktdaten zu scrapen?

Das Scrapen öffentlich verfügbarer Produktdaten gilt im Allgemeinen als weniger riskant als das Scrapen von Login-geschützten oder personenbezogenen Daten. Allerdings verbieten ausdrücklich den Einsatz von Robots, Spiders oder automatisierten Geräten zum Abrufen oder Indexieren von Inhalten ohne schriftliche Zustimmung. Nutzer sollten die Nutzungsbedingungen, robots.txt, Rate Limits respektieren und keine personenbezogenen oder urheberrechtlich geschützten Inhalte scrapen. Für die kommerzielle Nutzung sollten Sie rechtlichen Rat einholen.

2. Brauche ich Programmierkenntnisse, um Walmart zu scrapen?

Nein. Tools wie Thunderbit und Octoparse bieten vollständig No-Code-Oberflächen — klicken, konfigurieren, exportieren. API-Tools wie ScraperAPI, ScrapingBee und Zyte erfordern grundlegende Programmierung. Enterprise-Plattformen wie Bright Data und Oxylabs bieten sowohl API-Zugriff als auch Dashboard-/Template-Optionen.

3. Wie oft ändert Walmart das Website-Layout?

Häufig. Walmart führt regelmäßig A/B-Tests durch und aktualisiert seine DOM-Struktur. Community-Berichte erwähnen immer wieder Selektor-Brüche und leere Felder nach Layout-Änderungen. Genau deshalb haben KI-gestützte Tools, die die Seite jedes Mal frisch lesen (wie Thunderbit), oder vom Anbieter gepflegte strukturierte Endpunkte (wie Bright Data, Oxylabs) geringeren Wartungsaufwand als feste Selektoransätze.

4. Welche Daten kann ich von Walmart-Produktseiten extrahieren?

Häufige Felder sind: Produktname, URL, Preis (aktuell und früher/Rollback), Verfügbarkeit, Verkäufer, Bewertungen, Anzahl der Rezensionen, Bild-URLs, UPC/GTIN, SKU/Artikel-ID, Spezifikationen, Fulfillment-Optionen (Versand, Abholung, Lieferung), Varianten, Breadcrumb/Kategorie und manchmal Store-/Gang-Kontext, wenn Standortdaten verfügbar sind.

5. Was ist der beste kostenlose Walmart-Scraper für schnelle Tests?

Für nicht-technische Nutzer sind Thunderbit (6 kostenlose Seiten, 10 mit Test) und Octoparse (kostenloser Plan mit lokaler Extraktion) am einfachsten. Für Entwickler bieten ScraperAPI (5.000 Credits), ScrapingBee (1.000 Credits), Decodo (2.000 Anfragen) und Zyte (5 $ Guthaben) jeweils nutzbare Free-Tiers — denken Sie aber daran, dass Walmart-Seiten wegen des JS-Renderings mehr Credits verbrauchen als einfache statische Seiten.

Mehr erfahren