Trustpilot verfügt über von 1,27 Millionen Unternehmen — und die meisten Scraper, die für das Extrahieren dieser Daten gebaut wurden, sind schon vor Monaten kaputtgegangen. Wenn du in letzter Zeit versucht hast, Bewertungen zu ziehen, bist du vermutlich auf die berüchtigte Login-Sperre ab Seite 10 gestoßen und hast gesehen, wie dein Tool nur einen Fehler zurückgab.

Ich habe die letzten Wochen damit verbracht, Tools zu testen, zu recherchieren und zu vergleichen, die Trustpilot-Bewertungsdaten auch 2026 noch zuverlässig extrahieren können. Die Lage hat sich deutlich verändert: Trustpilots Anti-Bot-Schutz ist aggressiver geworden, sein Next.js-Frontend erzeugt Klassennamen, die sich mit jedem Deployment ändern, und — am wichtigsten — der Zugriff ohne Authentifizierung endet inzwischen schon nach 10 Bewertungsseiten. Ein brachte die Frustration perfekt auf den Punkt: „none of the actors on the store work.“

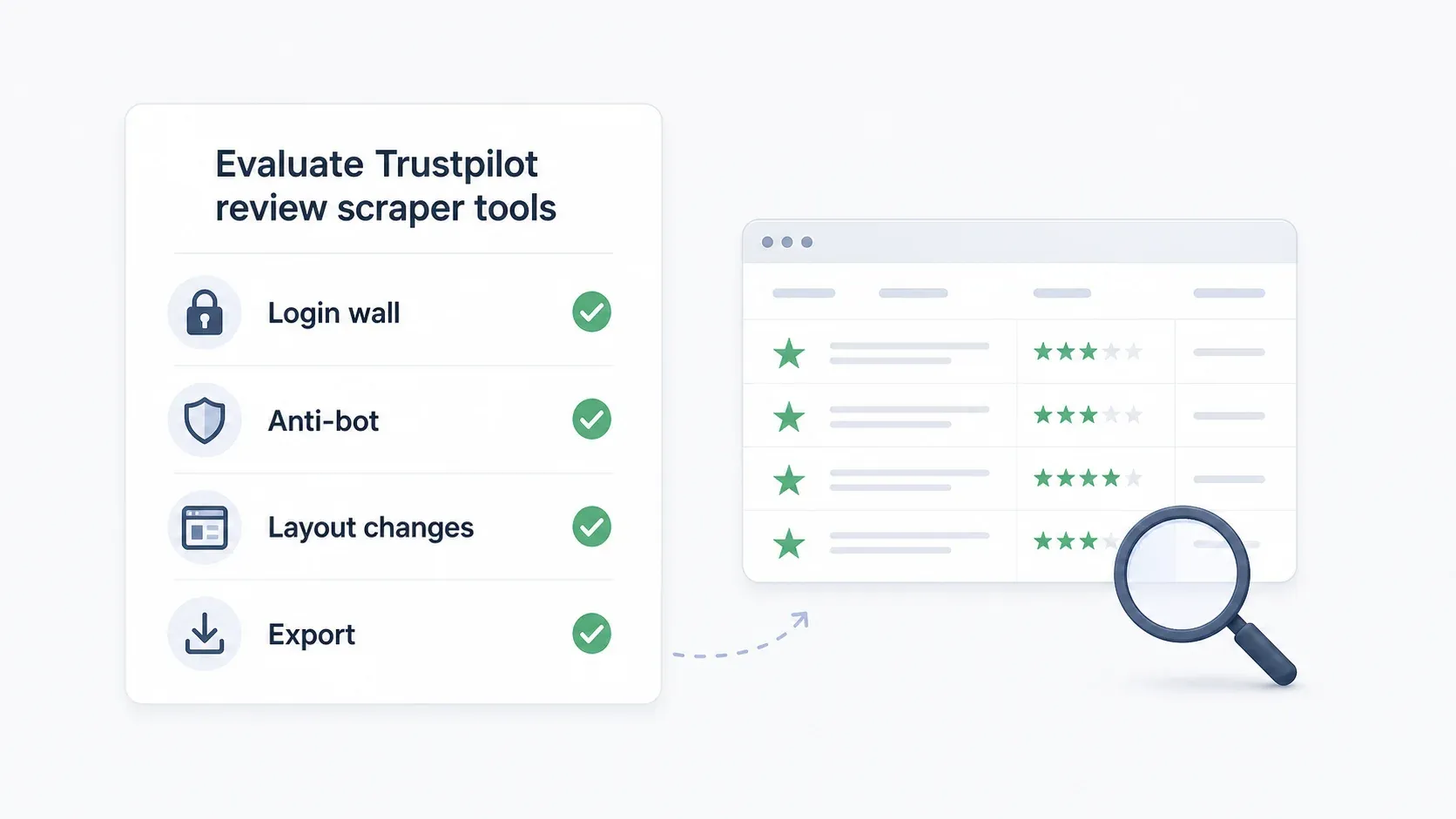

Welche Tools funktionieren also wirklich? Ich habe fünf Tools danach bewertet, wie sie mit der Login-Sperre, Anti-Bot-Maßnahmen, Wartungsaufwand und den praktischen Anforderungen von Marketer:innen und Entwickler:innen umgehen.

Warum das Scrapen von Trustpilot-Bewertungen 2026 schwieriger ist, als es aussieht

Trustpilot ist keine einfache statische Website, die man mit einer grundlegenden HTTP-Anfrage abrufen und mit BeautifulSoup parsen kann. Es ist eine moderne, dynamisch gerenderte Plattform auf Basis von Next.js, und die Schutzmechanismen sind im letzten Jahr spürbar strenger geworden.

Womit du es tatsächlich zu tun hast:

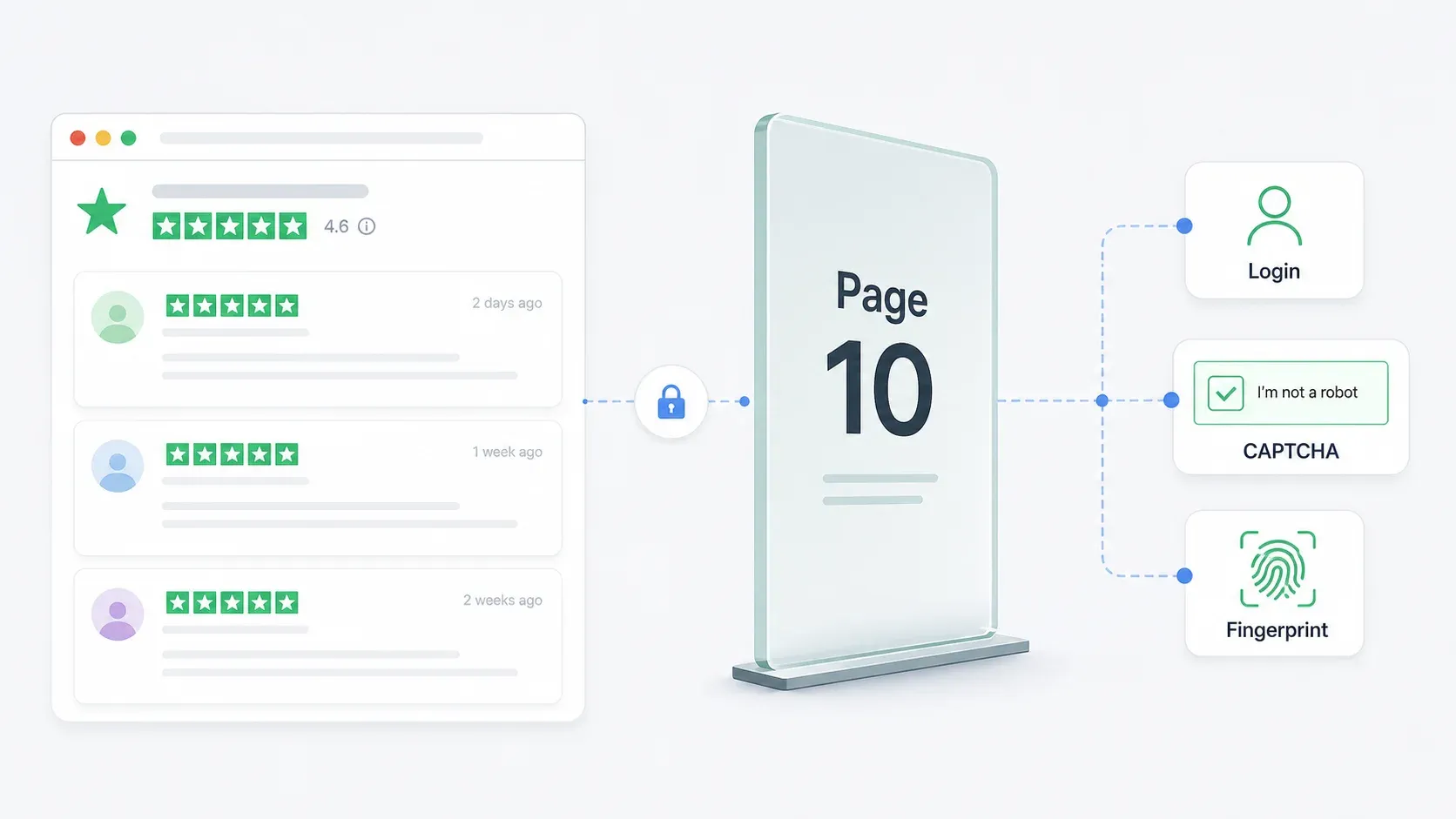

Die Login-Sperre ab Seite 10. Das ist der größte Schmerzpunkt. bestätigt, dass Trustpilot nur die ersten 10 Bewertungsseiten zulässt, bevor eine Login-Aufforderung erscheint. Für ein Unternehmen mit 2.000 Bewertungen (also ungefähr 100 Seiten bei 20 Bewertungen pro Seite) kommst du ohne authentifizierte Sitzung nicht an 90 % der Daten heran.

Anti-Bot-Schutz. Trustpilot nutzt reCAPTCHA, sitzungsbasiertes Blocking, Filterung auf CDN-Ebene und Browser-Fingerprinting. Auf der steht ausdrücklich, dass die Seite „protected by reCAPTCHA“ ist und Geräte- sowie Interaktionssignale erfasst.

Dynamische CSS-Klassennamen. Weil Trustpilot Next.js mit CSS Modules verwendet, werden Klassennamen wie styles_reviewCardInner__EwDq2 beim Build generiert und ändern sich jedes Mal, wenn Trustpilot ein Update ausrollt. Das verlässt sich genau auf diese Selektoren — jeder Code, der diesem Tutorial folgt, bricht also beim nächsten Frontend-Update von Trustpilot.

Änderungen der DOM-Struktur. Nicht nur die Klassennamen, auch die eigentliche HTML-Hierarchie kann sich verschieben. Elemente werden anders verschachtelt, neue Wrapper kommen hinzu und Pagination-Komponenten werden umgebaut.

Scraper auf Basis von CSS-Selektoren — egal ob Apify Actors, Octoparse-Workflows oder eigene Python-Skripte — sind auf Trustpilot strukturell fragil. Sie funktionieren, bis sie es nicht mehr tun. Und „bis sie es nicht mehr tun“ bedeutet oft Wochen statt Monate.

Worauf wir bei den besten Trustpilot-Review-Scrapern geachtet haben

Ich habe diese Tools nicht nach einem allgemeinen „kann es eine Webseite scrapen?“-Kriterium bewertet. Jedes Tool auf dieser Liste kann Daten von einer einfachen HTML-Seite extrahieren.

Die eigentliche Frage lautet: Kann es speziell Trustpilot mit all seinen Eigenheiten im Jahr 2026 bewältigen?

Das war uns am wichtigsten:

| Kriterium | Warum es für Trustpilot wichtig ist |

|---|---|

| Umgang mit der Login-Sperre (ab Seite 10) | Die meisten Unternehmen haben weit mehr als 200 Bewertungen. Ein Limit von 10 Seiten bedeutet, dass dir der Großteil der historischen Daten fehlt. |

| Umgehung von Anti-Bot-Schutz | reCAPTCHA, Sitzungs-Blocking und CDN-Filter stoppen naive Scraper sofort. |

| Robustheit der Selektoren / Wartung | Generierte CSS-Klassen bringen selektorbasierte Tools regelmäßig zum Scheitern. Heilt sich das Tool selbst? |

| Pagination-Unterstützung | Bewertungen verteilen sich über Hunderte Seiten. Manuelles Extrahieren Seite für Seite ist nicht praktikabel. |

| No-Code vs. Code-Anforderung | Marketer:innen brauchen Point-and-Click; Entwickler:innen wollen volle Kontrolle. |

| Preisgestaltung / Free Tier | Budgetbewusste Teams brauchen Klarheit, bevor sie sich festlegen. |

| Exportoptionen | Business-Nutzer brauchen Google Sheets, Airtable, Notion — nicht nur rohes JSON. |

Die Login-Sperre ist der Dealbreaker.

Wenn ein Tool nicht über Seite 10 hinauskommt — oder zumindest einen klaren Weg für authentifizierten Zugriff bietet — ist es 2026 kein brauchbarer Trustpilot-Scraper.

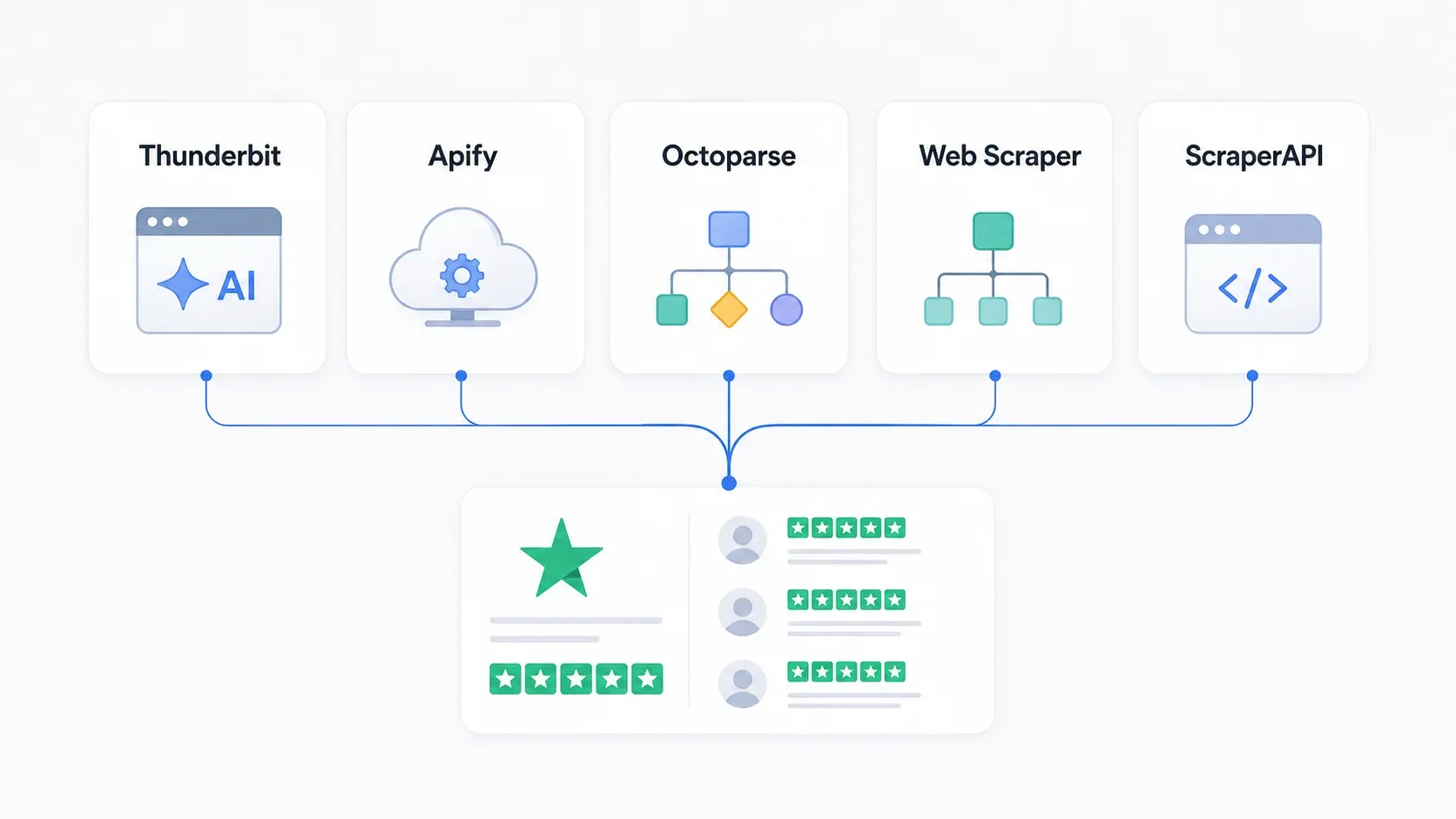

Die besten Trustpilot-Review-Scraper im Überblick

Der vollständige Vergleich:

| Tool | Kenntnisstand | Umgang mit der Login-Sperre | Anti-Bot-Ansatz | Pagination | Free Tier | Exportoptionen |

|---|---|---|---|---|---|---|

| Thunderbit | No-Code | Browser-Modus (nutzt deine eingeloggte Chrome-Sitzung) | KI-gestützte semantische Extraktion passt sich Layoutänderungen an | Automatische Erkennung, mehrere Seiten | 6 Seiten gratis/Monat | Excel, Sheets, Airtable, Notion, CSV, JSON |

| Apify | Low-Code | Hängt vom Actor ab; einige erfordern Cookie-Konfiguration für Seiten >10 | Integrierte Proxy-Rotation, actorspezifisch | Pro Actor konfigurierbar | 5 $/Monat Gratis-Credits für die Plattform | JSON, CSV, Excel, XML, RSS |

| Octoparse | No-Code (visuell) | Manuelle Cookie-/Sitzungskonfiguration | IP-Rotation, Residential Proxies, CAPTCHA-Lösung (kostenpflichtig) | Klick-/Scroll-Workflow | Free Plan + 14-tägige Premium-Testphase | CSV, Excel, JSON, HTML, XML, Datenbanken |

| Web Scraper | No-Code (Sitemap) | Eingeschränkt — der eigene Leitfaden dokumentiert ein 10-Seiten-Limit für Bewertungen | Cloud + Proxy in kostenpflichtigen Plänen | Konfigurierbar; JS-Klicks empfohlen | Kostenlose Chrome-Erweiterung | CSV, XLSX |

| ScraperAPI | Entwickler (Python) | Session-/Cookie-Management auf Code-Ebene | Über 40 Mio. Residential Proxies, JS-Rendering, CAPTCHA-Behandlung | Code-basiert | 7-Tage-Test, 5.000 API-Guthaben | Vom Entwickler definiert (CSV, JSON usw.) |

1. Thunderbit

ist eine KI-gestützte Chrome-Erweiterung für Business-Teams, die strukturierte Daten von Websites brauchen, ohne Code zu schreiben. Speziell für Trustpilot bietet sie eine , die Name des Rezensenten, Bewertung, Bewertungstitel, Bewertungstext, Datum und Unternehmensantwort mit zwei Klicks extrahiert.

Ich bin befangen — ich arbeite hier — aber der Grund, warum wir Thunderbit genau so gebaut haben, hängt direkt damit zusammen, warum Trustpilot-Scraping schwierig ist. Unsere KI liest Seiten semantisch statt über CSS-Selektoren. Wenn Trustpilot seine Klassennamen ändert oder die DOM-Struktur umbaut, passt sich Thunderbit an, weil es nach der Bedeutung der Seitenelemente sucht und nicht nach ihren spezifischen HTML-Adressen.

Wie Thunderbit die Login-Sperre ab Seite 10 handhabt

Hier ist der Browser-Modus entscheidend. Thunderbit läuft in deinem Chrome-Browser — also genau in dem Browser, in dem du bereits bei Trustpilot eingeloggt bist. Wenn du in den Browser-Scraping-Modus wechselst, liest die Erweiterung die Seiten, die in deiner authentifizierten Sitzung sichtbar sind. Kein Proxy-Gefrickel. Keine Cookie-Injektion. Kein Playwright-Session-Pool.

Der praktische Ablauf: Bei Trustpilot in Chrome einloggen, zur gewünschten Bewertungsseite gehen, auf „AI Suggest Fields“ klicken und dann auf „Scrape“. Die Pagination läuft danach automatisch — Thunderbit arbeitet sich durch jede Seite, auf die deine Browser-Sitzung zugreifen kann.

Warum Thunderbit nicht kaputtgeht, wenn Trustpilot Änderungen ausrollt

Unsere stellt den Unterschied direkt heraus: Traditionelle Scraper brechen, wenn sich Layouts ändern und CSS-Selektoren aktualisiert werden müssen. Thunderbit nutzt semantische KI, die Inhalte ohne spezifisches CSS versteht, dynamische Inhalte verarbeitet und automatische Pagination übernimmt.

Vergleich das mit dem Tutorial-Code von ScraperAPI, der anhand von Klassennamen wie styles_reviewCardInner__EwDq2 parst. Dieser Selektor wird beim nächsten Trustpilot-Deployment brechen. Thunderbits KI fragt: „Wo steht auf dieser Seite der Bewertungstext?“ statt „Was steckt in genau dieser div-Klasse?“

Zentrale Funktionen für Trustpilot-Scraping

- AI Suggest Fields: erkennt Bewertungsfelder automatisch (Name, Bewertung, Datum, Titel, Text, Unternehmensantwort) ohne manuelle Konfiguration

- Workflow mit zwei Klicks: AI Suggest Fields → Scrape. Mehr braucht es nicht.

- Browser-Modus für Seiten mit Login-Zwang: funktioniert innerhalb deiner authentifizierten Chrome-Sitzung für Zugriff ab Seite 10

- Automatische Pagination: verarbeitet mehrseitige Bewertungssets ohne manuelles Eingreifen

- Subpage-Scraping: kann einzelne Rezensentenprofile für zusätzliche Daten besuchen

- Geplantes Scraping: wöchentliche oder monatliche Bewertungsüberwachung für Reputations-Tracking einrichten

- Exporte: Google Sheets, Airtable, Notion, CSV, JSON — alles kostenlos enthalten

Preisgestaltung

- Kostenloser Plan: 6 Seiten/Monat, keine Kreditkarte erforderlich

- Credit-basiertes System: 1 Credit = 1 Ausgabereihe

- Kostenpflichtige Pläne: ab ca. 9 $/Monat auf der

Am besten geeignet für: Marketing-Teams, Operations-Teams und Business-Nutzer, die Trustpilot-Bewertungen ohne Code brauchen — und keinen Scraper pflegen wollen, der alle paar Wochen kaputtgeht.

2. Apify

ist eine Cloud-basierte Scraping-Plattform mit einem Marktplatz für vorgefertigte „Actors“ — Scraping-Vorlagen, die andere Nutzer:innen und das Apify-Team erstellt haben. Für Trustpilot gibt es im Store mehrere von der Community gepflegte Actors mit unterschiedlicher Zuverlässigkeit.

Der Kompromiss bei Apify: Es kann mächtig sein, ist aber fragmentiert. Manche Actors funktionieren. Manche sind veraltet. Manche brauchen Cookies für Seiten >10. Und die Reddit-Beschwerden über „none of the actors on the store work“ sind real — sie zeigen, wie schnell Trustpilot-Änderungen die logik eines bestimmten Actors zerstören können.

Trustpilot-Actors und bekannte Einschränkungen

Im gibt es mehrere Trustpilot-Actors. Mindestens einer (vom Entwickler „burbn“) dokumentiert ausdrücklich, dass für Seiten jenseits von 10 eine Cookie-Eingabe erforderlich ist. Andere haben Bewertungen von 0,0, sehr wenige Nutzer:innen oder sehr aktuelle Änderungsdaten — Anzeichen dafür, dass zwar gewartet wird, die Zuverlässigkeit aber variiert.

Auch die veralteten Actors sind erwähnenswert. Ein älterer Actor las Trustpilots eingebettetes __NEXT_DATA__-JSON direkt aus — ein cleverer Ansatz, schneller als DOM-Parsing, der aber ebenfalls brach, als Trustpilot seine Datenstruktur änderte.

Umgang mit Login-Sperre und Anti-Bot-Schutz

- Login-Sperre: hängt vollständig vom gewählten Actor ab. Einige unterstützen Cookie-Injektion für Seite 10+; andere nicht.

- Anti-Bot: Die Plattform von Apify umfasst Proxy-Rotation und Infrastruktur auf Basis von Compute Units. Residential Proxies sind ab verfügbar.

- Wartung: Wenn ein Actor kaputtgeht, wartest du entweder auf den Maintainer, wechselst zu einem anderen Actor oder beauftragst einen eigenen privaten Actor.

Preisgestaltung

- Free Plan: 5 $/Monat vorab bezahlte Nutzung, keine Kreditkarte erforderlich

- Starter: 9 $/Monat + nutzungsabhängig

- Scale: 99 $/Monat + nutzungsabhängig

- Exporte: JSON, CSV, Excel, XML, RSS (abhängig vom Actor)

Am besten geeignet für: Technisch versierte Nutzer:innen, die mehrere Actors bewerten, Cookies konfigurieren und Probleme selbst beheben können. Nicht ideal für Teams, die eine Lösung zum Einrichten und Vergessen suchen.

3. Octoparse

ist ein desktopbasierter No-Code-Scraper mit einem visuellen Point-and-Click-Workflow-Builder. Er liegt zwischen Thunderbits Zwei-Klick-Einfachheit und ScraperAPIs voller Entwicklerkontrolle — du bekommst visuelle Konfiguration ohne Code, musst aber trotzdem einen Workflow bauen und pflegen.

Einen Trustpilot-Scrape in Octoparse einrichten

Der Workflow ist unkompliziert, aber manuell:

- Trustpilot-Bewertungs-URL eines Unternehmens einfügen

- Bewertungselemente visuell auswählen (Titel, Text, Bewertung, Datum, Name des Rezensenten)

- Eine Pagination-Schleife über den „Nächste Seite“-Button definieren

- Wartezeiten konfigurieren (2–5 Sekunden empfohlen, um reCAPTCHA zu vermeiden)

- Lokal für kleine Stichproben oder in der Cloud für größere Jobs ausführen

Das Setup dauert für jemanden, der das Tool kennt, 10–15 Minuten. Der Haken: Weil Octoparse visuelle Selektoren verwendet, die an DOM-Elemente gebunden sind, musst du deinen Workflow jedes Mal aktualisieren, wenn Trustpilot seine Seitenstruktur ändert.

Umgang mit Login-Sperre und Anti-Bot-Schutz

- Login-Sperre: erfordert manuelle Login-/Cookie-/Sitzungskonfiguration. Nicht automatisch abgedeckt.

- Anti-Bot: enthalten IP-Rotation, Residential Proxies (3 $/GB) und automatische CAPTCHA-Lösung (1–1,5 $ pro Tausend).

- Wartung: mittel. Rechne damit, dass du deinen Workflow neu aufbauen oder anpassen musst, wenn Trustpilot sein Frontend aktualisiert.

Preisgestaltung

- Kostenloser Plan: für immer kostenlos, 10 Tasks, 1 Gerät, lokale Extraktion, bis zu 50.000 Zeilen/Monat

- Standard: 69 $/Monat (jährliche Abrechnung)

- Professional: 149 $/Monat

- 14-tägige Premium-Testphase: inklusive Cloud-Extraktion, Planung, API und Vorlagen

- Exporte: Excel, CSV, JSON, HTML, XML; Datenbanken und Google Sheets in höheren Tarifen

Am besten geeignet für: Nutzer:innen, die visuelle Workflow-Kontrolle wollen, die anfängliche Einrichtungszeit nicht scheuen und es akzeptieren, Workflows bei Seitenänderungen zu pflegen. Gut für Teams, die mehr Anpassung als ein Zwei-Klick-Tool brauchen, aber weniger Komplexität als Python-Code.

4. Web Scraper

ist eine Chrome-Erweiterung und Cloud-Plattform mit einem Sitemap-basierten Ansatz fürs Scraping. Sein stärkstes Trustpilot-Angebot ist eine , die Daten auf Unternehmensebene extrahiert: Firmenname, Kategorie, Adresse, Bewertung, Anzahl der Bewertungen, TrustScore und Website-URL.

Für das Scrapen von Bewertungen selbst gibt es bei Web Scraper eine dokumentierte Einschränkung, die erwähnenswert ist.

Vorgefertigte Vorlage vs. individuelle Einrichtung

Die Marktplatzvorlage funktioniert gut für die Unternehmenssuche — also zum Scrapen von Unternehmensprofilen über Trustpilot-Kategorien hinweg. Für benutzerdefinierte Bewertungsextraktion kannst du mit dem Sitemap-Wizard in der Chrome-Erweiterung visuell einen Scraper erstellen.

empfiehlt JavaScript-Klick-Pagination statt URL-basierter Pagination, weil Trustpilot Inhalte zwischen Seiten dynamisch neu anordnen kann, was zu verschobenen Ergebnissen führt.

Umgang mit Login-Sperre und Anti-Bot-Schutz

Hier ist Offenheit wichtig: Web Scrapers offizieller Leitfaden sagt ausdrücklich, dass Trustpilot nur die ersten 10 Bewertungsseiten zulässt, bevor eine Login-Aufforderung erscheint. Der Leitfaden dokumentiert das als bekannte Einschränkung und bietet keinen Workaround an.

- Login-Sperre: eingeschränkter Umgang. Das 10-Seiten-Limit für Bewertungen ist in der eigenen Dokumentation festgehalten.

- Anti-Bot: Cloud-Pläne enthalten Proxy-Support; der Leitfaden empfiehlt Verzögerungen von 2–5 Sekunden und geringere Parallelität.

- Pagination: konfigurierbar, aber bei nicht authentifiziertem Zugriff praktisch auf die ersten 10 Bewertungsseiten begrenzt.

Preisgestaltung

- Kostenlose Chrome-Erweiterung: lokale Extraktion, eingeschränkter Funktionsumfang

- Project: 50 $/Monat (5.000 URL-Credits)

- Professional: 100 $/Monat (20.000 URL-Credits)

- Scale: ab 200 $/Monat (unbegrenzte URL-Credits unter Bedingungen)

- 7-tägige kostenlose Testphase auf kostenpflichtigen Cloud-Plänen

- Exporte: CSV, XLSX

Am besten geeignet für: Nutzer:innen, die eine fertige Vorlage für das Scrapen von Trustpilot-Unternehmensprofilen wollen oder nur Bewertungen von den ersten 10 Seiten brauchen. Nicht die richtige Wahl, wenn du die vollständige Bewertungshistorie von Unternehmen mit vielen Bewertungen brauchst.

5. ScraperAPI

ist Scraping-Infrastruktur für Entwickler:innen — kein Point-and-Click-Tool, sondern eine Proxy-/Rendering-Schicht, die Anti-Bot-Maßnahmen abfedert, während du die Parsing-Logik schreibst. Auf der werden JS-Rendering, CAPTCHA-Behandlung und über 40 Mio. Proxies beworben.

Wenn du ein Python-Entwickler bist, der volle Kontrolle über die Extraktionslogik will, liefert dir ScraperAPI die Infrastruktur.

Die Wartung liegt dann aber bei dir.

Einen eigenen Trustpilot-Scraper mit ScraperAPI bauen

zeigt einen Python- + BeautifulSoup-Workflow:

1import requests

2from bs4 import BeautifulSoup

3payload = {

4 "api_key": "YOUR_API_KEY",

5 "url": "https://www.trustpilot.com/review/example.com",

6 "render": "true",

7 "keep_headers": "true",

8}

9html = requests.get("https://api.scraperapi.com", params=payload).text

10soup = BeautifulSoup(html, "html.parser")Im fertigen Code des Tutorials wird pages_to_scrape = 10 gesetzt — ein implizites Eingeständnis des öffentlichen Seitenlimits. Für Seite 10+ müssen Entwickler:innen authentifizierte Sitzungen, Cookies und Tokens selbst verwalten.

Umgang mit Login-Sperre und Anti-Bot-Schutz

- Login-Sperre: Session-/Cookie-Management auf Code-Ebene erforderlich. ScraperAPI übernimmt Proxies und Rendering; die Authentifizierungslogik liegt bei dir.

- Anti-Bot: Residential-Proxy-Pool mit automatischer IP-Rotation, JS-Rendering über

render=true, CAPTCHA-Behandlung durch intelligente Proxy-Rotation. Verfügbar in . - Wartung: Wenn Trustpilot Klassennamen ändert (was regelmäßig passiert), musst du deinen Parsing-Code aktualisieren. Der Selektor

styles_reviewCardInner__EwDq2aus dem Tutorial ist bereits eine tickende Uhr.

Preisgestaltung

- 7-Tage-Test: , keine Kreditkarte erforderlich

- Hobby: 49 $/Monat (100.000 API-Credits)

- Startup: 149 $/Monat (1.000.000 Credits)

- Business: 299 $/Monat (3.000.000 Credits)

- Exporte: was auch immer dein Code erzeugt (typischerweise CSV-, JSON- oder Datenbank-Schreibvorgänge)

Am besten geeignet für: Entwickler:innen, die volle Anpassbarkeit wollen, ihre eigenen Parsing-Skripte pflegen können und programmierbare Kontrolle über Sitzungsmanagement, Pagination-Logik und Datenstruktur brauchen. Nichts für nicht-technische Nutzer:innen.

Warum Trustpilot-Scraper ständig kaputtgehen (und wie man einen auswählt, der es nicht tut)

Das ist der am meisten unterschätzte Faktor bei der Wahl eines Trustpilot-Scrapers. Die Frage ist nicht: „Funktioniert dieses Tool heute?“ Sondern: „Wird dieses Tool in drei Wochen noch funktionieren?“

Scraper gehen auf Trustpilot aus vier wiederkehrenden Gründen kaputt:

-

Änderungen generierter CSS-Klassen. Next.js-CSS-Module erzeugen Klassennamen wie

styles_reviewCardInner__EwDq2. Diese ändern sich bei jedem Frontend-Deployment. Jeder Scraper, der auf diese Klassen abzielt, bricht. -

Änderungen der DOM-Struktur. Trustpilot kann seine HTML-Hierarchie umbauen — Review-Karten anders verschachteln, Wrapper-Elemente ändern, Metadaten an andere Positionen verschieben.

-

Änderungen bei Anti-Bot-Auslösern. reCAPTCHA-Schwellen verschieben sich. Die Rotation von Session-Tokens wird aggressiver. CDN-Filterregeln werden angepasst.

-

Änderungen bei Authentifizierung/Sitzung. Die Login-Sperre ab Seite 10 wurde Ende 2025 eingeführt (oder strenger durchgesetzt). Zukünftige Zugriffsbeschränkungen können jederzeit auftauchen.

Der grundlegende architektonische Unterschied liegt zwischen selektorbasiertem und semantischem Extrahieren:

-

Selektorbasierte Tools (Apify Actors, Octoparse-Workflows, ScraperAPI-Skripte, Web-Scraper-Sitemaps) fragen: „Finde das Element an genau diesem CSS-Pfad.“ Wenn sich der Pfad ändert, scheitern sie still oder liefern leere Daten.

-

Semantische/KI-Tools (Thunderbit) fragen: „Finde den Bewertungstext, die Bewertung und das Datum auf dieser Seite.“ Die KI interpretiert Seiteninhalte nach Bedeutung, nicht nach Adresse. Layoutänderungen brechen sie nicht, weil sich die Bedeutung nicht geändert hat.

Meine Empfehlung:

- Null Toleranz für Wartung? → KI-basiert (Thunderbit)

- Etwas Wartung okay, du willst Cloud-Automatisierung? → Apify (mit Actor-Auswahl und Monitoring)

- Visuelle Steuerung, moderate Wartung? → Octoparse

- Vorlagenbasiert, begrenzter Anwendungsbereich? → Web Scraper

- Volle Kontrolle, alles selbst verwalten? → ScraperAPI

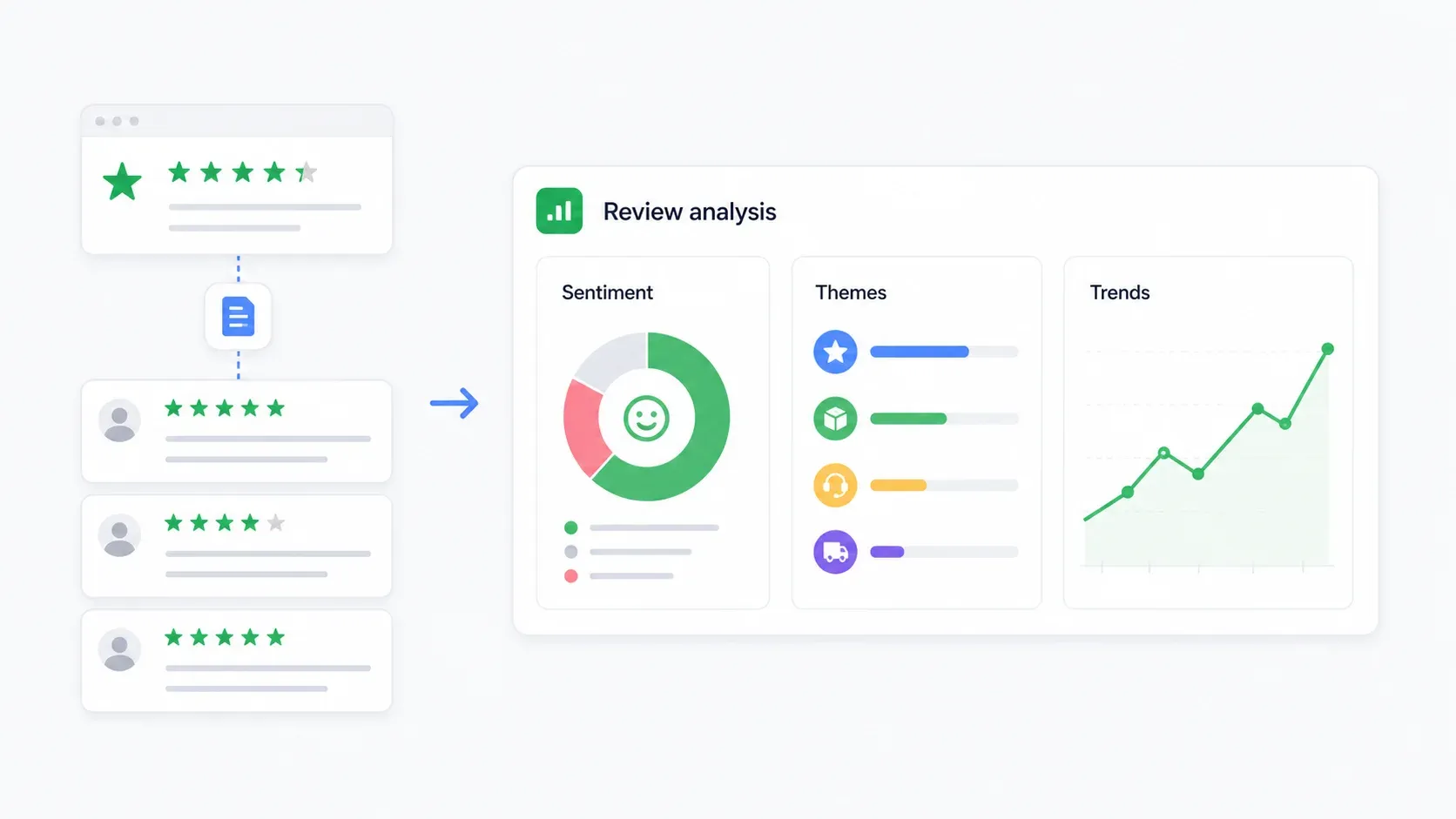

Was du mit gescrapten Trustpilot-Bewertungen machen solltest

Bewertungen zu extrahieren ist Schritt eins. Die Frage, die ich in Foren ständig sehe: „Ich habe die Daten — und jetzt?“

Sentiment-Analyse

Der einfachste Workflow: Bewertungen nach Google Sheets exportieren und dann ein KI-Tool (ChatGPT, Claude oder eine Sheets-KI-Funktion) verwenden, um jede Bewertung als positiv, neutral oder negativ einzuordnen. Füge Spalten für Beschwerdekategorie, Dringlichkeit und empfohlene Priorität für die Maßnahme hinzu.

Für größere Datensätze kannst du die CSV in ChatGPT hochladen und um eine Zusammenfassung bitten: „Klassifiziere diese Bewertungen nach Sentiment und identifiziere die 5 häufigsten Beschwerdethemen mit repräsentativen Zitaten.“

Wettbewerbsbeobachtung

Nutze Thunderbits geplantes Scraping, um Wettbewerbsbewertungen wöchentlich oder monatlich abzurufen. Verfolge dabei:

- Entwicklung der durchschnittlichen Bewertung über die Zeit

- Anteil an 1- und 2-Sterne-Bewertungen

- Veränderungen beim Bewertungsvolumen (bekommen sie mehr oder weniger Bewertungen?)

- Häufigste Beschwerdethemen

- Quote und Geschwindigkeit der Unternehmensantworten

Ein einfaches Google-Sheets-Dashboard mit Pivot-Tabellen nach Bewertung und Datum liefert dir einen automatisch aktualisierten Feed für Competitive Intelligence.

Themenextraktion

Gruppiere Bewertungen nach gängigen Kategorien: Versand/Lieferung, Kundensupport, Rückerstattungen, Produktqualität, Abrechnung, App-Bedienbarkeit, Preis/Leistung und Betrugsverdacht. Das Ergebnis sollte eine Tabelle sein mit: Thema, Anzahl, durchschnittliche Bewertung, repräsentative Zitate und empfohlene Unternehmensmaßnahme.

Das ist nützlicher als eine Word-Cloud. Es zeigt dir, was tatsächlich Zufriedenheit oder Unzufriedenheit treibt.

Analyse vieler Unternehmen auf einmal

Für Research auf Kategoriebene kannst du Bewertungen über mehrere Unternehmen innerhalb derselben Trustpilot-Kategorie hinweg scrapen. Vergleiche Bewertungsvolumen, Durchschnittsbewertungen, Sterneverteilungen und Themenhäufigkeiten über ein ganzes Marktsegment hinweg. Web Scrapers Vorlage für Unternehmenslisten ist nützlich, um Firmen zu entdecken; Thunderbit oder ScraperAPI können für jede davon Stichproben auf Bewertungsebene verarbeiten.

Rechtliche und ethische Überlegungen beim Scrapen von Trustpilot

Ich bin kein Anwalt, und das ist keine Rechtsberatung. Aber die Compliance-Realität ist hier wichtig.

Trustpilots Nutzungsbedingungen sind eindeutig. Sie Nutzer:innen, Inhalte „by any means other than as provided or specifically approved by Trustpilot“ abzurufen oder zu sammeln, und nennen ausdrücklich Text-Mining, Data-Mining und Web-Scraping ohne ausdrückliche Genehmigung.

Das Risikospektrum sieht so aus:

- Geringeres Risiko: Die Bewertungen des eigenen Unternehmens für interne Analysen exportieren, insbesondere mit den offiziellen Business-Tools oder der API von Trustpilot.

- Mittleres Risiko: Öffentliche Wettbewerberseiten in kleiner Menge für Marktforschung scrapen. Trotzdem unterliegt das den AGB und Datenschutzpflichten.

- Höheres Risiko: Inhalte hinter der Login-Sperre ab Seite 10 scrapen, technische Schutzmaßnahmen umgehen, Rezensentendaten weiterverbreiten oder gescrapte Bewertungen für das Training von KI-Modellen verwenden.

DSGVO-Aspekte: Namen von Rezensenten, Profil-Links, Bewertungstexte und Standortdaten können nach EU-Datenschutzrecht personenbezogene Daten darstellen. Praktische Schutzmaßnahmen sind: nur benötigte Felder erfassen, Rezensentennamen für interne Analysen hashen, Aufbewahrungsfristen festlegen und Rohtexte nicht in großem Umfang erneut veröffentlichen.

Öffentliche vs. authentifizierte Daten: Es gibt einen wichtigen rechtlichen und ethischen Unterschied zwischen dem Scrapen von Seiten, die jede:r sehen kann (die ersten 10 Bewertungsseiten), und dem Scrapen von Daten hinter einer Authentifizierungssperre. Tools, die nur mit öffentlichen Daten arbeiten, bergen ein geringeres Compliance-Risiko als solche, die Login-Zugangsdaten erfordern.

Das sollte bei der Tool-Auswahl eine Rolle spielen. Thunderbits Browser-Modus arbeitet mit Seiten, die in deiner eigenen Sitzung sichtbar sind — er umgeht die Authentifizierung nicht eigenständig. ScraperAPI gibt Entwickler:innen volle Kontrolle, aber auch die volle Verantwortung für die Rechtmäßigkeit des Sitzungsmanagements.

Wie du den richtigen Trustpilot-Review-Scraper auswählst

Entscheidungsrahmen nach Persona:

- Nicht-technische:r Marketer:in und du brauchst Bewertungen ohne Code? → Thunderbit. Zwei Klicks, KI erledigt den Rest, Export nach Sheets/Notion/Airtable.

- Low-Code-Nutzer:in mit Komfort bei Konfiguration und Debugging? → Apify. Actor wählen, Cookies für Seite 10+ konfigurieren, auf Ausfälle achten.

- Visuelle:r Builder und du willst Workflow-Kontrolle? → Octoparse. Point-and-Click-Setup, aber mit Wartungsaufwand rechnen, wenn Trustpilot sich ändert.

- Du brauchst Daten auf Unternehmensebene oder nur Bewertungen der ersten 10 Seiten? → Web Scraper. Starke vorgefertigte Vorlagen für Unternehmensprofile.

- Entwickler:in und du willst volle Anpassung? → ScraperAPI. Deine Parsing-Logik, dein Sitzungsmanagement, deine Datenpipeline.

Wenn Wartungsarmut deine wichtigste Anforderung ist, reicht die Spanne von Thunderbit (nahezu keine Wartung) bis ScraperAPI (du wartest alles selbst). Beim Budget hat jedes Tool auf dieser Liste einen kostenlosen Einstiegspunkt — fang dort an, bevor du dich festlegst.

Fazit

Trustpilot-Bewertungsdaten sind für Competitive Intelligence, Reputationsmonitoring und Kundeneinblicke wirklich wertvoll.

Aber 2026 erfordert das zuverlässige Extrahieren ein Tool, das mit der Login-Sperre ab Seite 10 umgehen, sich an DOM-Änderungen anpassen und Anti-Bot-Schutz ohne ständige manuelle Eingriffe bewältigen kann.

Für die meisten Business-Nutzer:innen ist der Weg mit dem geringsten Widerstand — zwei Klicks, KI-gestützte Felderkennung, Browser-Modus für authentifizierte Seiten und keine Wartung, wenn Trustpilot sein Frontend ändert. Du kannst es mit .

Für Entwickler:innen, die volle Kontrolle wollen, liefert ScraperAPI die Infrastruktur. Für alle dazwischen bedienen Apify, Octoparse und Web Scraper jeweils eine bestimmte Nische. Entscheidend ist, dass das Tool zu deinem technischen Komfort, deiner Wartungstoleranz und deinen Compliance-Anforderungen passt.

Wenn du sehen möchtest, wie Thunderbit konkret mit Trustpilot umgeht, haben wir einen . Und für mehr Kontext zu oder decken diese Leitfäden die Grundlagen ab.

FAQs

1. Kann man Trustpilot-Bewertungen jenseits von Seite 10 scrapen?

Ja, aber nur mit einem authentifizierten Weg. Trustpilot blockiert nicht authentifizierten Zugriff nach den ersten 10 Bewertungsseiten. Thunderbits Browser-Modus arbeitet innerhalb deiner eingeloggten Chrome-Sitzung, sodass er auf Seiten zugreifen kann, die du sehen kannst. ScraperAPI erfordert Session-/Cookie-Management auf Code-Ebene. Apify-Actors brauchen Cookie-Konfiguration. Octoparse benötigt manuelles Login-/Cookie-Setup. Web Scrapers eigene Dokumentation erkennt die 10-Seiten-Grenze an, ohne einen eingebauten Workaround anzubieten.

2. Ist das Scrapen von Trustpilot-Bewertungen legal?

Trustpilots Nutzungsbedingungen verbieten automatisierte Datenerfassung ohne ausdrückliche Genehmigung. Das rechtliche Risiko hängt von Methode und Anwendungsfall ab: Das Scrapen eigener öffentlicher Bewertungen ist weniger riskant als das Umgehen von Authentifizierungssperren, um Wettbewerber zu scrapen. Die DSGVO gilt für EU-Rezensentendaten. Das ist keine Rechtsberatung — hol dir für groß angelegte oder kommerzielle Scraping-Projekte juristischen Rat.

3. Welche Daten kann man von Trustpilot extrahieren?

Häufige Felder sind: Name des Rezensenten, Sternebewertung, Bewertungstitel, Bewertungstext, Veröffentlichungsdatum, Datum der Erfahrung, Verifizierungsstatus des Kaufs, Standort des Rezensenten, Text der Unternehmensantwort, Firmenname, TrustScore, Gesamtzahl der Bewertungen, Sterneverteilung und Bewertungs-URL.

4. Wie oft gehen Trustpilot-Scraper kaputt?

Selektorbasierte Tools (Apify Actors, Octoparse-Workflows, eigene Python-Skripte) können immer dann brechen, wenn Trustpilot seine CSS-Klassen oder DOM-Struktur ändert — was mehrmals pro Monat passieren kann. KI-semantische Tools wie Thunderbit passen sich automatisch an, weil sie die Bedeutung der Seite interpretieren statt auf bestimmte Selektoren zu zielen. Kein Tool ist jedoch immun gegen größere Änderungen bei den Zugriffskontrollen wie die Login-Sperre ab Seite 10.

5. Kann ich Trustpilot-Bewertungen kostenlos scrapen?

Jedes Tool auf dieser Liste hat einen kostenlosen Einstiegspunkt: Thunderbit bietet 6 kostenlose Seiten/Monat, ScraperAPI stellt 5.000 Test-Credits für 7 Tage bereit, Web Scraper hat eine kostenlose Chrome-Erweiterung für die lokale Nutzung, Octoparse hat einen dauerhaft kostenlosen Plan (10 Tasks, 50.000 Zeilen/Monat) und Apify enthält 5 $/Monat an kostenlosen Plattform-Credits. Für kleine Stichproben oder Tests funktioniert jedes davon ohne Zahlung.

Mehr erfahren