Temu erreicht inzwischen über in mehr als 50 Märkten. Der Produktkatalog reicht von Küchen-Gadgets über Haustierzubehör bis zu LED-Streifen. Wenn Sie im E-Commerce, Dropshipping oder in der Wettbewerbsanalyse arbeiten, wollten Sie Temu-Daten wahrscheinlich schon einmal in eine Tabelle ziehen — und haben dann festgestellt, dass Temu das ganz und gar nicht möchte.

Ich habe viel Zeit damit verbracht, Scraping-Tools für geschützte E-Commerce-Websites zu recherchieren und zu testen. Temu gehört zu den schwierigsten Zielen überhaupt. Die meisten Anleitungen im Netz liefern entweder ein Python-Tutorial, das nach einer Woche kaputtgeht, oder verweisen auf Enterprise-APIs, die mehr kosten als Ihr monatliches Werbebudget.

Die Realität ist: Die meisten Business-Anwender — Dropshipper, Solo-Selbstständige, Marketing-Teams — wollen einfach nur eine saubere Tabelle mit Produktnamen, Preisen, Bildern, Bewertungen und Verkäuferinfos. Sie möchten nachts um 2 Uhr nicht erst Playwright-Skripte debuggen.

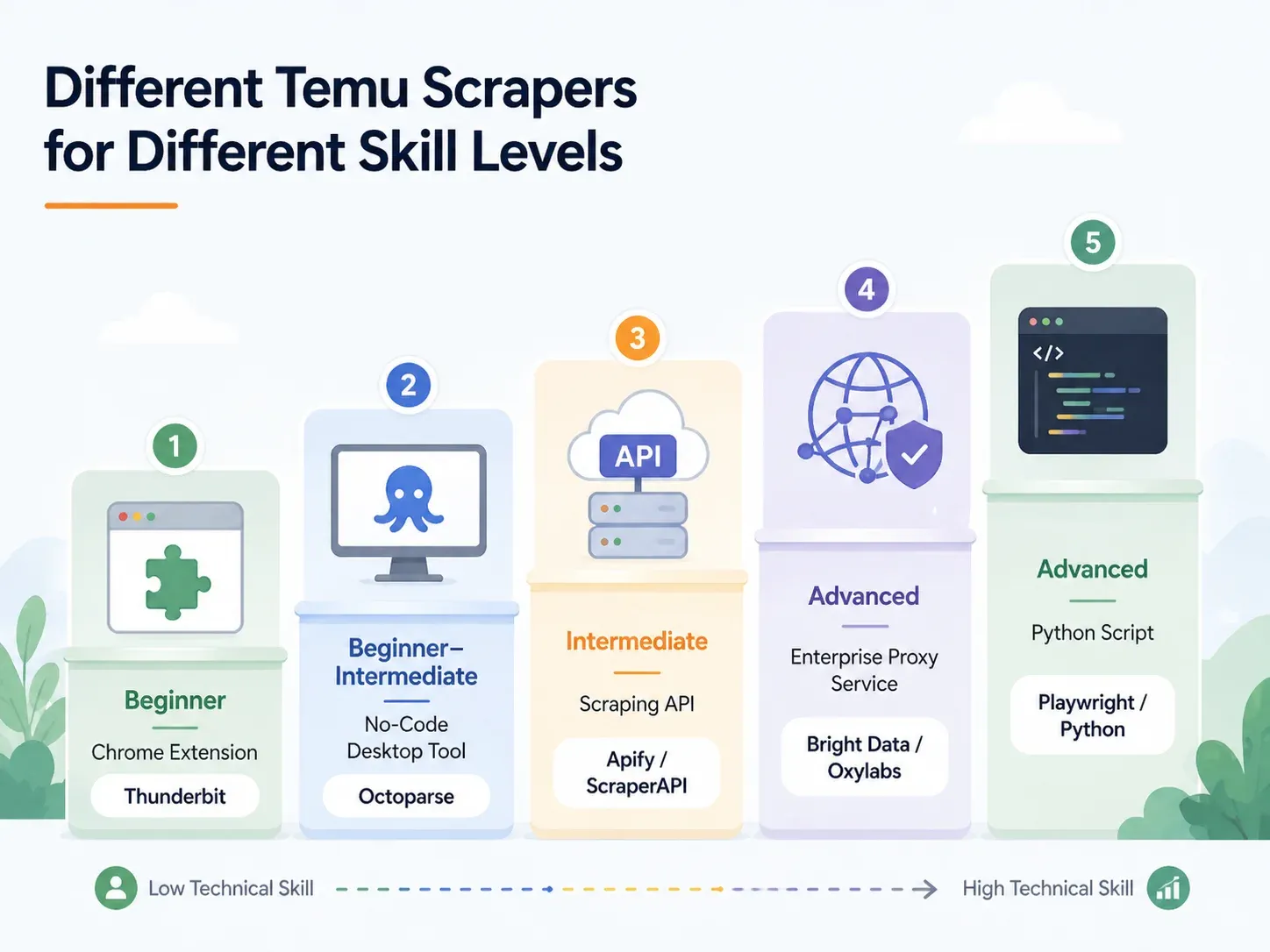

Dieser Leitfaden schließt genau diese Lücke: eine praxisnahe, nach Kenntnisstand geordnete Übersicht der besten Temu-Scraper, die 2026 tatsächlich funktionieren, plus Best Practices, mit denen aus einem Roh-Scrape laufende Wettbewerbsanalysen werden. Egal, ob Sie kompletter Anfänger sind oder als Entwickler eine Datenpipeline bauen — hier finden Sie den passenden Abschnitt.

Warum Temu scrapen? Die wichtigsten Anwendungsfälle für Business-Teams

Temu-Daten sind nicht nur interessant — sie sind strategisch nützlich.

Die Plattform ist in Kategorien mit niedrigen und mittleren Preispunkten zu einer maßgeblichen Preisreferenz geworden. Selbst wenn Sie nicht auf Temu verkaufen, vergleichen Ihre Kunden Ihre Preise mit dem, was sie dort sehen. So nutzen verschiedene Teams Temu-Daten:

| Anwendungsfall | Benötigte Daten | Warum das wichtig ist |

|---|---|---|

| Produktrecherche für Dropshipping | Titel, Preis, Bild, Bewertung, Anzahl der Rezensionen, Verkaufszahl, Varianten | Findet günstige Produkte mit Nachfrage-Signalen für den Vergleich über Amazon, Shopify, AliExpress und TikTok Shop hinweg |

| Wettbewerbsfähige Preisgestaltung | Aktueller Preis, Originalpreis, Rabatt %, Währung, Versand, Zeitstempel | Schafft eine Grundlage für Preisstrategie und Aktionsplanung |

| Produktsourcing | Spezifikationen, Bilder, Varianten, Verkäufer/Shop, Artikel-ID, Kategorie | Identifiziert Produkttypen und Anbieter-Listings, die eine genauere Prüfung wert sind |

| Analyse von Markttrends | Suchbegriff, Kategorie, Verkaufszahl, Rezensionsanzahl, Bewertung | Zeigt, welche Produkte in den Kategorien an Zugkraft gewinnen |

| Marketing- und Kreativrecherche | Titel, Bild, Rezensionsanzahl, Bewertung, Beschreibungen, Kategorien | Macht Messaging, visuelle Aufhänger, Bundles und Claims sichtbar, die bei Listings mit hohem Volumen verwendet werden |

| Bestands- und Verfügbarkeitsmonitoring | Produkt-URL, Verfügbarkeit, Versandprognose, Preis, Zeitstempel | Erfasst Ausverkäufe, Änderungen im lokalen Lagerbestand und Preisbewegungen im Zeitverlauf |

Die Zielgruppe, die nach „best Temu scrapers“ sucht, lässt sich meist in drei Gruppen einteilen. Nicht-technische Nutzer wollen eine Chrome-Erweiterung, die eine Tabelle ausgibt. Halb-technische Anwender wollen ein visuelles Tool mit Vorlagen und Zeitplanung. Entwickler wollen eine API, ein Playwright-Skript und eine Proxy-Strategie.

Dieser Artikel behandelt alle drei — beginnt aber mit der größten Gruppe: Menschen, die Daten brauchen, nicht Code.

Woran man die besten Temu-Scraper 2026 erkennt

Ein Scraper, der Amazon oder Shopify bewältigt, überlebt Temu nicht automatisch. Die Bewertungskriterien für diesen Artikel sind:

- Zuverlässigkeit bei Temu — Liefert er wirklich saubere Daten, oder wird er blockiert, gibt leere Zeilen zurück oder bricht nach einem Layout-Change ab?

- Benutzerfreundlichkeit — Kann ein nicht-technischer Business-Nutzer ohne Code starten?

- Vollständigkeit der Daten — Unterstützt er die Anreicherung von Unterseiten (jeder Produktdetailseite für Spezifikationen, Varianten, Verkäuferinfos)?

- Wartungsaufwand — Passt er sich an, wenn Temu seine Seitenstruktur ändert?

- Zeitplanung und Monitoring — Kann er wiederkehrende Scrapes ausführen und in ein dauerhaftes Datenziel exportieren?

- Export-Ziele — CSV, Excel, Google Sheets, Airtable, Notion, JSON?

- Kostenklarheit — Was kostet ein realistischer Temu-Scraping-Workflow tatsächlich pro Monat?

Community-Berichte auf beschreiben Temu durchgängig als eine der schwierigsten E-Commerce-Websites zum Scrapen. Ein Nutzer schrieb, er könne „als Käufer nicht einmal einen Preis bekommen“, während ein anderer anmerkte, dass Temu und Shopee Teams haben, die ihre Anti-Bot-Mechanismen kontinuierlich verstärken. Öffentliche Temu-spezifische Ausfallraten-Benchmarks gibt es nicht, aber der zeigt, dass automatisierter Traffic menschlichen Traffic überholt hat und Bots des gesamten Internetverkehrs ausmachen. Genau gegen dieses Umfeld verteidigt sich Temu.

Temus Anti-Bot-Abwehr: Warum die meisten Scraper scheitern

Die meisten Artikel über Temu-Scraping widmen Anti-Bot-Maßnahmen genau einen Satz: „Temu nutzt Anti-Bot.“ Das hilft nicht weiter.

Wenn Sie ein Tool auswählen, müssen Sie wissen, welche Abwehrmechanismen Temu einsetzt und welche Funktionen eines Tools jeden einzelnen umgehen. Hier ist die praktische Zuordnung:

| Temu-Abwehr | Was sie bewirkt | Benötigte Tool-Funktion | Beispiel-Tools |

|---|---|---|---|

| Cloudflare WAF / Browser-Checks | Blockiert automatisierte User-Agents, erkennt Bot-Fingerprints, liefert Challenge-Seiten aus | Cloud-Infrastruktur mit rotierenden Residential IPs und echten Browser-Fingerprints | Thunderbit (Cloud-Scraping), Bright Data, Oxylabs, ScraperAPI |

| Starkes JavaScript-Rendering | Produktdaten werden per JS geladen; rohes HTML ist leer | Headless-Browser oder vollständiges Browser-Rendering | Thunderbit (Browser-Scraping-Modus), Playwright, Selenium, ParseHub, Apify Browser Actors |

| Dynamische CSS-Selektoren | Klassennamen ändern sich zwischen Deployments und brechen CSS-basierte Scraper | KI-gestützte Felderkennung (nicht abhängig von festen Selektoren) | Thunderbit (KI liest die Seite jedes Mal neu), Bright Data AI Scraper Builder |

| Rate Limiting | Drosselt schnelle aufeinanderfolgende Anfragen | Gleichzeitige Cloud-Anfragen mit intelligenter Drosselung | Thunderbit (bis zu 50 Seiten gleichzeitig per Cloud), ScraperAPI, Bright Data |

| CAPTCHA-Abfragen | Unterbrechen Sitzungen nach verdächtigem Verhalten | Integriertes CAPTCHA-Lösen oder eine weniger triggernde Strategie | Bright Data, Oxylabs, ScraperAPI Premium/Ultra-Premium |

| Endloses Scrollen / Lazy Loading | Nur die ersten Produkte erscheinen ohne Interaktion | Intelligentes Scrollen, Erkennung von Paginierung, Interaktionsautomatisierung | Thunderbit Paginierung, Apify Smart Scrolling, Octoparse Workflow Builder |

Cloudflare WAF und IP-Blockierung

Temus Eingangstür wird von browserbasierten Integritätsprüfungen im Cloudflare-Stil bewacht. Einfache HTTP-Anfragen — wie sie ein schlichtes Python-requests.get() ausführt — werden abgefangen, mit 403 beantwortet oder mit unvollständigen Daten beliefert.

Tools, die hier funktionieren, brauchen rotierende Residential- oder Mobile-IPs und echte Browser-Fingerprints. Der berichtete, dass Nicht-KI-Bots zu Beginn des Jahres 2025 für ungefähr die Hälfte aller HTML-Seitenanfragen verantwortlich waren. In genau diesem Maßstab verteidigen sich Plattformen wie Temu gegen Automatisierung.

JavaScript-Rendering und dynamische Selektoren

Hier scheitern die meisten Anfänger-Scraper still und leise.

Wenn Sie den Quelltext von Temus Seite ansehen, finden Sie oft nur eine leere Hülle — die eigentlichen Produktkarten, Preise und Bilder werden erst nach dem Laden per JavaScript eingefügt. Ein Scraper, der nur das rohe HTML liest, liefert dann nichts Brauchbares. Hinzu kommt: Temus CSS-Klassennamen und DOM-Strukturen ändern sich zwischen Deployments. Ein Scraper, der sich auf einen festen CSS-Selektor wie .product-card__price verlässt, funktioniert heute und liefert morgen leere Spalten.

KI-basierte Scraper (wie ) lesen die Seite jedes Mal semantisch, sind also nicht davon abhängig, dass bestimmte Klassennamen gleich bleiben.

Rate Limiting und CAPTCHA-Abfragen

Wenn Sie Temu von einer IP-Adresse aus zu schnell oder zu oft ansprechen, lösen Sie Rate Limits oder CAPTCHA-Abfragen aus. Manche Tools lösen das mit intelligenter Drosselung und integriertem CAPTCHA-Solving. Andere überlassen es Ihnen — was für nicht-technische Nutzer praktisch eine Sackgasse ist.

Beim Cloud-Scraping ist der Schlüssel: gleichzeitige Anfragen über saubere IPs verteilt, mit automatischer Wiederholungslogik.

Die besten Temu-Scraper nach Kenntnisstand: Vollständiger Überblick

Finden Sie Ihre Zeile und springen Sie zum passenden Abschnitt:

| Ansatz | Kenntnisstand | Einrichtungszeit | Anti-Bot-Handhabung | Am besten geeignet für |

|---|---|---|---|---|

| KI-Chrome-Erweiterung (z. B. Thunderbit) | Anfänger | < 2 Min. | Abgedeckt (Cloud oder Browser) | Dropshipper, Marketer, E-Commerce-Operations |

| No-Code-Desktop-Tool (z. B. Octoparse, ParseHub) | Anfänger–Fortgeschritten | 10–60 Min. | Teilweise (Proxy-Konfiguration nötig) | Regelmäßiges Scraping mit Vorlagen |

| Scraping-API/Service (z. B. ScraperAPI, Apify) | Fortgeschritten | 15–45 Min. | Integriert | Entwickler, die in Pipelines integrieren |

| Managed Proxy/Enterprise (z. B. Bright Data, Oxylabs) | Fortgeschritten/Enterprise | Stunden–Tage | Vollständige Infrastruktur | Hohe Volumina, Warehouse-Zustellung |

| Eigenes Python-Skript (Playwright/Selenium) | Fortgeschritten | 1–4 Std.+ | Manuell (Proxy- und CAPTCHA-Setup) | Volle Kontrolle, Sonderfälle, Anpassungen |

Thunderbit: Der beste Temu-Scraper für nicht-technische Nutzer

ist eine KI-gestützte Chrome-Erweiterung für Business-Anwender — Vertriebsteams, E-Commerce-Operatoren, Dropshipper, Marketer — die strukturierte Daten von Websites brauchen, ohne Code zu schreiben. Ich arbeite im Thunderbit-Team, kenne das Produkt also sehr gut. Ich sage offen, was es kann und wo es passt.

Der Kern-Workflow ist in zwei Klicks erledigt: Eine Temu-Seite öffnen, auf KI-Felder vorschlagen klicken, die vorgeschlagenen Spalten prüfen (Produktname, Preis, Bild, Bewertung usw.) und dann auf Scrapen klicken.

Die KI von Thunderbit liest die Seitenstruktur aus und schlägt automatisch Spaltennamen und Datentypen vor. Sie hängt nicht an festen CSS-Selektoren, daher passt sich der Scraper an, wenn Temu seine Klassennamen oder Kartenlayouts ändert.

Wichtige Funktionen für Temu:

- Cloud-Scraping-Modus: Schneller für öffentliche Seiten, verarbeitet bis zu 50 Seiten gleichzeitig. Ideal für Kategorieseiten, Suchergebnisse und Produktlisten ohne Login.

- Browser-Scraping-Modus: Nutzt Ihre aktuelle Chrome-Sitzung inklusive Cookies, Spracheinstellung und Login-Status. Ideal, wenn Region, Pop-ups oder eingeloggte Inhalte das angezeigte Ergebnis beeinflussen.

- Unterseiten scrapen: Nach dem Scrapen einer Listing-Seite können Sie auf „Unterseiten scrapen“ klicken, um jede Produktdetailseite zu besuchen und Spalten wie vollständige Beschreibung, Varianten, Verkäuferinfos, Versandprognose und Spezifikationen hinzuzufügen — ganz ohne zusätzliche Konfiguration.

- KI-Eingabeaufforderungen für Felder: Daten während des Scrapes klassifizieren, übersetzen oder umformatieren. Beispiel: „Kategorisiere dieses Produkt in Küchenutensilien, Kleingeräte, Aufbewahrung oder Sonstiges.“

- Geplantes Scraping: Einen Zeitplan in natürlicher Sprache festlegen („jeden Montag um 9 Uhr“), URLs eingeben, und Thunderbit führt den Scrape in der Cloud aus und exportiert zu Google Sheets, Airtable oder einem anderen Ziel.

- Kostenlose Exporte: Excel, CSV, Google Sheets, Airtable, Notion, JSON — kein Bezahlschranken beim Export. Bilder werden in Airtable und Notion als echte Anhänge exportiert.

Preis: Gratis-Stufe mit bis zu 6 Seiten (oder 10 mit Test-Boost); kostenpflichtige Pläne starten bei etwa für 500 Credits, wobei 1 Credit = 1 Ergebniszeile ist.

Direktvergleich: Thunderbit vs. Python-Skript auf derselben Temu-Seite

Der Unterschied ist deutlich:

| Aufgabe | Thunderbit | Python (Playwright) |

|---|---|---|

| Temu-Kategorieseite öffnen | Seite in Chrome öffnen | Python-Umgebung einrichten, Playwright installieren, Browser installieren |

| Felder erkennen | Auf „KI-Felder vorschlagen“ klicken | DOM, Netzwerkaufrufe und JSON-Payloads analysieren |

| Dynamisches Laden behandeln | Browser-/Cloud-Modus plus Paginierung | Scroll-/Warte-Logik schreiben, Anfragen abfangen |

| Blocks behandeln | Cloud-Modus oder Browser-Modus versuchen | Proxys, Header, Fingerprinting, Retries, CAPTCHA hinzufügen |

| Listing-Felder extrahieren | Auf „Scrapen“ klicken | Selektoren oder API-Parsing-Logik schreiben |

| Produktseiten anreichern | Auf „Unterseiten scrapen“ klicken | Einen separaten PDP-Crawler bauen |

| Export | Auf Sheets/Airtable/Notion/Excel klicken | CSV-/JSON-/Sheets-Integrationscode schreiben |

| Typisches Setup für einen Business-Nutzer | Unter 2 Minuten | Mindestens 1–4 Stunden; laufende Wartung |

Ein minimales Playwright-Prototyp für Temu könnte so aussehen (Pseudocode — nicht produktionsreif):

1from playwright.sync_api import sync_playwright

2with sync_playwright() as p:

3 browser = p.chromium.launch(headless=False)

4 page = browser.new_page()

5 page.goto("https://www.temu.com/search_result.html?search_key=kitchen+organizer")

6 page.wait_for_load_state("networkidle")

7 for _ in range(8):

8 page.mouse.wheel(0, 2000)

9 page.wait_for_timeout(1200)

10 cards = page.locator("[data-product-id], a[href*='goods.html']")

11 # Produktionscode braucht trotzdem noch Selektoren, Proxys, Retries,

12 # CAPTCHA-Behandlung, PDP-Crawling und Exportlogik.

13 print(cards.count())Das sind schon mehr als 10 Zeilen, bevor Sie ein einziges Feld extrahiert haben — und Proxys, CAPTCHA, PDP-Anreicherung oder Export sind noch gar nicht berücksichtigt. Für nicht-technische Nutzer komprimiert Thunderbit diesen gesamten Workflow auf ein paar Klicks. Für Entwickler bietet der Python-Weg mehr Kontrolle — aber zu deutlich höheren Wartungskosten.

Octoparse und ParseHub: No-Code-Desktop-Scraper für Temu

Wenn Sie mehr Kontrolle als bei einer Chrome-Erweiterung wollen, aber keinen Code schreiben möchten, sind Octoparse und ParseHub die wichtigsten Optionen.

Octoparse bietet eine öffentliche Temu-Details-Scraper-Vorlage. Die Beispielausgabe enthält Produkt-IDs, Titel, Preise, Verkäufer-/Shop-Daten, Bild-URLs, Rabatte, Shop-URLs und ausführliche Spezifikationen. Das ist ein echter Vorteil — Sie können mit einer Vorlage starten, statt einen Workflow von Grund auf neu zu bauen. Octoparse unterstützt außerdem Cloud-Extraktion, Zeitplanung und visuelles Workflow-Building.

Die Einschränkungen bei Temu:

- Anti-Bot-Add-ons (Residential Proxys zu , CAPTCHA-Lösen für $1–$1,50 pro Tausend) können sich schnell summieren.

- Vorlagen können brechen, wenn Temu sein Layout ändert. Dann müssen Sie eventuell Selektoren aktualisieren oder warten, bis Octoparse die Vorlage pflegt.

- Das Setup dauert je nach Seitenkomplexität 10–60 Minuten.

Octoparse-Preise: kostenloser Plan mit 10 Aufgaben und 50.000 monatlichem Datenexport; Standard etwa $75/Monat jährlich; Professional etwa $108/Monat jährlich. Add-ons für Proxys, CAPTCHA und Managed Services kosten extra.

ParseHub ist ein visueller Desktop-/Web-Scraper, der dynamische Seiten gut beherrscht (er nutzt einen vollständigen Chromium-Browser). Die bezahlten Pläne beginnen jedoch bei $189/Monat, was für einen Solo-Anwender happig ist. In meiner Recherche fand sich keine starke öffentliche Temu-spezifische Vorlage. ParseHub passt eher zu Teams, die bereits mit visuellen Scraping-Projekten vertraut sind.

| Tool | Stärken für Temu | Schwächen bei Temu | Preis |

|---|---|---|---|

| Octoparse | Öffentliche Temu-Vorlage, visueller Workflow, Cloud-Extraktion, Zeitplanung | Vorlagen müssen gepflegt werden, Anti-Bot-Add-ons erhöhen die Kosten | Kostenlos; ca. $75/Monat jährlich Standard; ca. $108/Monat jährlich Pro; Add-ons extra |

| ParseHub | Handhabung dynamischer Seiten, Projekt-Workflow-Builder, IP-Rotation in bezahlten Plänen | Höherer Einstiegspreis, keine öffentliche Temu-Vorlage gefunden | Bezahlte Pläne ab $189/Monat |

Scraping-APIs: ScraperAPI, Apify und Bright Data für Temu

API-basierte Scraping-Services übernehmen Proxys, Rendering und Anti-Bot-Logik, damit sich Entwickler auf das Parsen und Speichern von Daten konzentrieren können. Sie passen gut, wenn Sie eine Pipeline bauen und nicht nur einen einmaligen Tabellenexport ausführen.

ScraperAPI ist eine Entwickler-API für Proxy-Rotation und Rendering. Auf der Preisseite stehen ein 7-Tage-Test mit 5.000 Credits, Hobby für $49/Monat mit 100.000 Credits und darüber hinaus höhere Stufen. Der Haken bei Temu: JavaScript-Rendering und Premium-Proxy-Pools kosten je nach Tarif 10–75 Credits pro Anfrage. Diese Credit-Multiplikation kann die effektiven Kosten pro Zeile deutlich über den angezeigten Preis treiben.

Apify ist eine Plattform mit einem Marktplatz vorgefertigter „Actors“ (Scraper). Es gibt mehrere Temu-Actors. Ein community-gepflegter Temu Scraper nennt ein Pay-per-Event-Preismodell von etwa $5 pro 1.000 Produkte in der Gratis-Stufe. Ein anderer Temu Products Scraper nennt $4 pro 1.000 Ergebnisse. Das Risiko: Die Qualität der Actors schwankt, die Wartung hängt von der Community ab, und manche Actors können veraltet sein oder nach Temu-Updates brechen. Prüfen Sie vor einer Entscheidung immer das Änderungsdatum und die Nutzerbewertungen.

Bright Data ist die Enterprise-Option. Auf der Temu-Scraper-Seite heißt es, dass Jobs auf Bright-Data-Infrastruktur mit Proxy-Rotation, Geo-Targeting, CAPTCHA-/Unblocking-Logik und Autoscaling ausgeführt werden. Ausgabeformate sind JSON, CSV, Parquet sowie direkte Auslieferung an S3, GCS, Azure Blob, BigQuery und Snowflake. Branchenbewertungen nennen für die Web Scraper API ein Pay-as-you-go von etwa $2,5 pro 1.000 Datensätze, während vertraglich gebundene Pläne bei etwa $499/Monat beginnen. Leistungsstark, aber für Teams mit echtem Budget.

Oxylabs hat ebenfalls eine eigene Temu Scraper API-Seite. Die Pläne starten bei $49/Monat, mit einer kostenlosen Testphase von bis zu 2.000 Ergebnissen. Das ist eine starke Alternative zu Bright Data für Entwicklerteams, die strukturierte Temu-Daten über eine API wollen.

| API/Plattform | Temu-spezifische Hinweise | Stärke | Schwäche | Am besten für |

|---|---|---|---|---|

| ScraperAPI | Keine Temu-spezifische Seite gefunden, aber E-Commerce-Anti-Bot-Funktionen dokumentiert | Einfacher Endpunkt, JS-Rendering, Premium-Proxys | Credit-Multiplikatoren für Premium-Funktionen; Entwickler müssen Daten parsen | Entwickler-Pipelines |

| Apify | Mehrere Temu-Actors im Marktplatz | Schnellster Entwicklerpfad, wenn der Actor passt und gepflegt wird | Actor-Qualität variiert; einige veraltet | Entwickler, die Marktplatz + Zeitplanung wollen |

| Bright Data | Eigene Temu-Scraper-Seite | Enterprise-Infrastruktur, Unblocking, Zustellung ans Data Warehouse | Teuer; Web-Scraping-Konzepte bleiben notwendig | Enterprise-Datenteams |

| Oxylabs | Eigene Temu-Scraper-API-Seite | Klare Preisgestaltung pro Ergebnis, JS-Verarbeitung, IP-/CAPTCHA-Ansprüche | Entwickler-API-Workflow | Entwicklerteams mit Bedarf an Temu-API-Zugang |

Eigene Python-Skripte (Playwright/Selenium): Volle Kontrolle, hoher Aufwand

Eigene Python-Scraper bieten maximale Flexibilität — das ist der Vorteil. Playwright ist für Temu meist ein besserer Ausgangspunkt als Selenium, weil es ein Auto-Wait-Modell und einen besseren Umgang mit JavaScript-lastigen Seiten bietet.

Aber der Preis dafür ist hoch.

Ein Prototyp braucht 1–4 Stunden. Ein produktionsreifer Scraper braucht Proxy-Rotation, realistische Browser-Fingerprints, CAPTCHA-Strategie, Retries, Schema-Validierung, Speicher für Ausgaben, Monitoring, Benachrichtigungen und eine rechtliche Prüfung.

Und er geht kaputt. Scraping-Communities auf Reddit beschreiben modernes E-Commerce-Scraping immer wieder als instabil, wenn Websites Cloudflare, JavaScript-Rendering und Anti-Bot-Fingerprints einsetzen.

| Fehlerbild | Typische Ursache | Gegenmaßnahme |

|---|---|---|

| Leeres HTML / fehlende Produkte | JS lädt Produktkarten erst nach dem initialen HTML | Playwright verwenden, auf Netzwerk und DOM warten |

| Nur die ersten paar Produkte | Endloses Scrollen / Lazy Loading | Scroll-Schleife, Netzwerk-Idle-Wartezeiten, Schwellenwerte für Kartenanzahl |

| Preise fehlen oder sind inkonsistent | Region-/Sitzungs-/Währungsstatus oder Anti-Bot-Antwort | Locale setzen, Cookies, geotargeteter Proxy |

| 403 / Challenge / CAPTCHA | IP-Reputation, Headless-Fingerprint, Anfragefrequenz | Residential Proxys, Stealth-Browser, niedrigere Rate |

| Selektoren brechen | DOM-/Klassennamen-Änderungen, A/B-Tests | Semantische Extraktion oder API-Parsing, falls verfügbar |

Eigene Skripte sind nicht die „kostenlose“ Option. Sie verschieben Kosten von Abo-Gebühren auf Entwicklerzeit, Proxy-Rechnungen, CAPTCHA-Kosten und Wartungsrisiko. Wenn Sie intern einen Scraping-Engineer haben und ungewöhnliche Logik brauchen, ist das der richtige Weg. Für alle anderen ist es in der Praxis die teuerste Option.

Best Practice: Unterseiten-Scraping für vollständige Temu-Produktdaten

Das ist die in diesem Artikel wirkungsvollste Best Practice — und fast kein anderer Leitfaden behandelt sie.

Eine Temu-Kategorie- oder Suchseite zeigt die Basics: Titel, Vorschaubild, Preis, grobe Bewertung. Aber die Felder, die eine Zeile wirklich handlungsfähig machen — ausführliche Beschreibungen, Variantenlisten, vollständige Rezensionszahlen, Versandprognosen, Verkäufernamen, Spezifikationstabellen — stehen auf der Produktdetailseite (PDP).

Wenn Sie nur die Listing-Seite scrapen, arbeiten Sie mit einem unvollständigen Datensatz.

Der Zwei-Schritte-Workflow:

- Schritt 1 — Listing-Seite scrapen (PLP): Produktname, Preis, Vorschaubild und Bewertung von einer Temu-Suche oder Kategorieseite extrahieren.

- Schritt 2 — Über Unterseiten anreichern: Jede PDP besuchen und Spalten wie vollständige Beschreibung, Anzahl der Rezensionen, Variantenoptionen, Lieferzeit und Verkäuferinfos ergänzen.

So sieht der Unterschied vor und nachher aus:

| Feld | Aus der PLP (Schritt 1) | Von der PDP ergänzt (Schritt 2) | |---|---|---|---| | Produkttitel | ✅ | — | | Preis | ✅ | ✅ (verifiziert / Rabatt %) | | Vorschaubild | ✅ | — | | Sternebewertung | ✅ | ✅ (mit Rezensionsanzahl) | | Vollständige Beschreibung | ❌ | ✅ | | Varianten (Größen, Farben) | ❌ | ✅ | | Verkäufername | ❌ | ✅ | | Versandprognose | ❌ | ✅ | | Detaillierte Spezifikationen | ❌ | ✅ |

In Thunderbit ist das ein Klick: Nach dem ersten Scrape auf „Unterseiten scrapen“ klicken. Die KI besucht jede Produkt-URL und ergänzt die zusätzlichen Spalten — keine zusätzliche Konfiguration, kein separater Spider, keine Selektorpflege. Die Temu-Details-Vorlage von Octoparse und der Temu-Actor von Apify unterstützen ebenfalls Felder auf PDP-Ebene, allerdings mit mehr Setup und Wartung. In Python müssten Sie einen separaten PDP-Crawler bauen, dessen Selektoren pflegen und die Paginierung innerhalb der Detailseiten behandeln — ein erheblicher zusätzlicher Aufwand.

Best Practice: Geplantes Temu-Scraping für laufendes Preis- und Bestandsmonitoring

Einmalige Scrapes sind nützlich zur Produktentdeckung. Wettbewerbsanalyse erfordert wiederholte Beobachtung.

Preise ändern sich, Produkte gehen ausverkauft, neue Artikel erscheinen täglich, und die Rabatttiefe verschiebt sich mit Aktionen. Ein wöchentlicher oder täglicher Scrape erstellt eine Verlaufstabelle, mit der Ihr Team wirklich arbeiten kann.

Drei Automatisierungsfälle, die sich lohnen:

- Preis-Monitoring: Verfolgen Sie wöchentlich die Top-50-SKUs eines Wettbewerbers auf Temu. Lassen Sie die aktualisierten Preise automatisch in Google Sheets exportieren, um sie auf einen Blick mit Ihren eigenen Preisen zu vergleichen.

- Bestands- und Verfügbarkeitsmonitoring: Erkennen Sie, wenn ein Trendprodukt ausverkauft ist, eine neue Variante auftaucht oder sich die Versandprognosen ändern.

- Erkennung neuer Produkte/Trends: Planen Sie täglich einen Scrape von Temus „Neu eingetroffen“-Bereich oder einer priorisierten Kategorieseite. Sortieren Sie nach Verkaufszahl oder Rezensionsanzahl, um aufkommende Produkte früh zu erkennen.

In Thunderbit richten Sie das ein, indem Sie das Intervall in natürlicher Sprache beschreiben („jeden Montag um 9 Uhr“), Ihre Ziel-URLs eingeben und auf „Planen“ klicken. Der Scrape läuft in der Cloud und exportiert an Ihr gewünschtes Ziel. Weil die KI die Seite jedes Mal frisch liest, passen sich geplante Scrapes automatisch an Layout-Änderungen bei Temu an — Sie müssen Selektoren nicht aktualisieren, wenn Temu eine Produktkarte neu gestaltet.

Die Alternative: einen Cron-Job einrichten, ein Python-Skript pflegen, Proxy-Rotation konfigurieren, eine Export-Pipeline bauen und Selektoren jedes Mal reparieren, wenn Temu sein Layout ändert. Für ein nicht-technisches Team ist das keine Option. Für Entwickler ist es fortlaufender Aufwand. Apify und Bright Data unterstützen ebenfalls geplante Läufe, allerdings mit mehr technischem Setup und höheren Einstiegskosten.

Best Practice: Der komplette Temu-Datenworkflow (Scrapen → Bereinigen → Exportieren → Handeln)

Die meisten Scraping-Leitfäden enden bei „CSV herunterladen“.

Doch Business-Nutzer brauchen Daten in den Tools, mit denen sie tatsächlich arbeiten — Google Sheets für die Zusammenarbeit, Airtable für Produktdatenbanken, Notion für Team-Dashboards. Die eigentliche Best Practice ist ein End-to-End-Workflow:

| Workflow-Schritt | Was passiert | Thunderbit-Funktion |

|---|---|---|

| Scrapen | Daten von Temu-Seiten extrahieren | KI-Felder vorschlagen → Scrapen (2 Klicks) |

| Anreichern | Jede Produktdetailseite besuchen | Unterseiten scrapen (1 Klick) |

| Bereinigen & Beschriften | Produkte kategorisieren, Preise normalisieren, Titel übersetzen | KI-Eingabeaufforderung für Felder — während des Scrapes labeln, formatieren, übersetzen |

| Exportieren | Daten in Business-Tools übertragen | Kostenloser Export zu Excel, Google Sheets, Airtable, Notion; CSV/JSON herunterladen |

| Überwachen | Änderungen im Zeitverlauf verfolgen | Geplanter Scraper mit Intervallen in natürlicher Sprache |

Ein konkretes Beispiel: Sie scrapen 200 Temu-Küchenprodukte. Während des Scrapes kategorisiert eine KI-Eingabeaufforderung jedes Produkt automatisch in „Utensilien / Kleingeräte / Aufbewahrung / Reinigung / Deko“. Preise werden in numerische USD-Werte normalisiert. Chinesische Produkttitel werden ins Englische übersetzt. Die Daten werden direkt in eine Airtable-Basis exportiert, inklusive Produktbildern (nicht nur URLs — echte Bildanhänge, wie in beschrieben). Ein geplanter Scrape aktualisiert die Daten wöchentlich.

Einige nützliche KI-Eingabeaufforderungen für Temu-Daten:

- „Kategorisiere dieses Produkt in eine der folgenden Kategorien: Küchenutensilien, Kleingeräte, Aufbewahrung, Reinigung, Deko, Sonstiges. Gib nur die Kategorie zurück.“

- „Übersetze den Produkttitel in prägnantes Englisch und behalte Marken, Mengen, Größen und Modellnummern bei.“

- „Normalisiere den Preis als Zahl ohne Währungssymbole.“

- „Bewerte die Nachfrage als Hoch, Mittel oder Niedrig anhand von Bewertung, Rezensionsanzahl und Verkaufszahl. Wenn Daten fehlen, gib Unbekannt zurück.“

Dieser Workflow macht aus einem Roh-Scrape eine lebendige Produkt-Intelligence-Datenbank — ohne dass ein Entwickler eine separate ETL-Pipeline bauen muss.

Die besten Temu-Scraper im Vergleich: Tabelle nebeneinander

| Tool | Kenntnisstand | Einrichtungszeit | Anti-Bot-Handhabung | Unterseiten-Scraping | Zeitplanung | Export-Optionen | Preisstufe | Am besten für |

|---|---|---|---|---|---|---|---|---|

| Thunderbit | Anfänger | Minuten | Browser-Modus, Cloud-Modus, KI-Felderkennung | Ja (Unterseiten scrapen) | Ja (Zeitpläne in natürlicher Sprache) | Excel, CSV, Google Sheets, Airtable, Notion, JSON | Kostenlos 6 Seiten; kostenpflichtig ab ca. $9–15/Monat für 500 Credits | Nicht-technische E-Commerce-Teams, Dropshipper |

| Octoparse | Anfänger–Fortgeschritten | 10–60 Min. | Cloud-Extraktion, Proxy/CAPTCHA-Add-ons | Ja (Vorlagen-Workflows) | Ja (bezahlte/Cloud-Pläne) | Excel, CSV, JSON, HTML, XML, Datenbank, Google Sheets | Kostenlos; ca. $75/Monat jährlich Standard; Add-ons extra | Anwender, die visuelle Workflows + Temu-Vorlage wollen |

| ParseHub | Anfänger–Fortgeschritten | 30–60 Min. | Dynamisches Rendering, bezahlte IP-Rotation | Ja (Projektflüsse) | Bezahlte Pläne | CSV/JSON, Dropbox/S3 in bezahlten Plänen | Ab $189/Monat | Teams, die visuelle Projekte für dynamische Websites bauen |

| ScraperAPI | Entwickler | Stunden | Proxy-Rotation, JS-Rendering, Premium-Pools | Eigene Programmierung erforderlich | DataPipeline/Planer | HTML/JSON/CSV | Test mit 5K Credits; Hobby $49/Monat; höhere Stufen verfügbar | Entwickler, die benutzerdefinierte Temu-Pipelines bauen |

| Apify | Fortgeschritten | 10–30 Min., wenn der Actor passt | Actor-spezifische Browser-/Proxy-Logik | Actor-abhängig | Ja | JSON, CSV, Excel, API/Datasets | Kostenlose Plattform; Temu-Actors ca. $4–5/1K Produkte | Entwickler/Anwender, die die Actor-Qualität prüfen können |

| Bright Data | Fortgeschritten/Enterprise | Stunden–Tage | Vollständige Proxy-, CAPTCHA-, Unblocking- und Autoscaling-Infrastruktur | Eigene Programmierung über Scraper/API | Ja | JSON, CSV, Parquet, S3, GCS, Azure, BigQuery, Snowflake | ca. $2,5/1K Datensätze PAYG; vertraglich ab ca. $499/Monat | Enterprise-Datenteams, Extraktion mit hohem Volumen |

| Oxylabs | Fortgeschritten | Stunden | JS-Verarbeitung, IP-/CAPTCHA-Ansprüche | Eigene Programmierung über API | Ja | JSON/API-Ausgabe | Ab $49/Monat; Test bis zu 2K Ergebnisse | Entwicklerteams mit Bedarf an Temu-API-Zugang |

| Custom Python (Playwright) | Fortgeschritten | 1–4 Std.+; laufende Wartung | Manuelle Proxys, CAPTCHA, Fingerprints | Vollständig individuell | Cron/Warteschlange/manuell | Individuell | Entwicklerzeit + Proxy-/CAPTCHA-/Hosting-Kosten | Sonderfälle, Teams mit Scraping-Engineers |

Welchen Temu-Scraper sollten Sie wählen? Schnelle Empfehlungen

- Dropshipper, der schnelle Produktrecherche braucht? Starten Sie mit . Das ist der schnellste Weg von „Ich will Temu-Daten“ zu „Ich habe eine Tabelle“. Wenn es auf Ihren Zielseiten funktioniert (und das sollte es bei den meisten öffentlichen Kategorien- und Produktseiten), sind Sie fertig.

- Anwender, der visuelle Kontrolle und wiederverwendbare Vorlagen möchte? Octoparse hat eine öffentliche Temu-Details-Vorlage und einen visuellen Workflow-Builder. Rechnen Sie mit 10–30 Minuten Einrichtung und etwas Proxy-/CAPTCHA-Konfiguration.

- Entwickler, der eine Datenpipeline oder ein internes Tool baut? ScraperAPI oder Apify bieten API-/Actor-Workflows, die sich in Code und geplante Jobs integrieren lassen. Prüfen Sie Apify-Actors sorgfältig — achten Sie auf Wartungsstatus und Nutzerbewertungen.

- Enterprise-Team mit Bedarf an Temu-Daten in großem Volumen und Warehouse-Zustellung? Bright Data ist der Infrastruktur-Ansatz. Teuer, aber es beherrscht Skalierung, Unblocking und die Zustellung an S3/BigQuery/Snowflake.

- Scraping-Engineer mit Sonderlogik? Eigenes Playwright/Selenium gibt Ihnen volle Kontrolle. Planen Sie aber laufende Wartung, Proxy-Kosten und CAPTCHA-Behandlung mit ein.

Für die meisten nicht-technischen Business-Nutzer würde ich empfehlen, zuerst die Gratis-Stufe von Thunderbit zu testen. Die erste Frage lautet immer: „Kann ich die Zeilen bekommen, die ich von genau dieser Temu-Seite brauche?“ — und das können Sie in unter zwei Minuten beantworten, ohne etwas auszugeben. Entwickler sollten vor dem Budget-Freigeben einen Kosten-pro-erfolgreicher-Zeile-Benchmark zwischen Apify, ScraperAPI und einem kleinen Playwright-Prototyp fahren.

FAQs zum Scrapen von Temu

Ist es legal, Temu zu scrapen?

Das hängt von der Gerichtsbarkeit, den gesammelten Daten, der Zugriffsmethode und der Nutzung der Daten ab. Temus schränken automatisierten Zugriff ausdrücklich ein, einschließlich Crawling, Scraping oder Spidering von Seiten oder Daten. US-Gerichte haben für den Zugriff auf öffentlich verfügbare Daten einige günstige Präzedenzfälle geschaffen (die hiQ-v.-LinkedIn-Entscheidung des Ninth Circuit), aber haben auch Vertragsverletzungs- und Trespass-Ansprüche bestätigt. Kurz gesagt: Das Scrapen öffentlich verfügbarer Produktdaten zu Forschungszwecken kann in manchen Kontexten vertretbar sein, aber Nutzungsbedingungen, Datenschutzrecht, Urheberrecht und die Art der Verwendung der Daten spielen alle eine Rolle. Das ist keine Rechtsberatung — ziehen Sie für kommerzielle Nutzung einen Anwalt hinzu.

Wie oft ändert Temu sein Website-Layout?

Ein offizieller Rhythmus ist nicht dokumentiert. Community-Berichte und das Tool-Ökosystem behandeln Temu als ein dynamisches, häufig aktualisiertes Ziel. Gehen Sie davon aus, dass CSS-Selektoren jederzeit brechen können, und bevorzugen Sie KI-/semantische Extraktion oder aktiv gepflegte Vorlagen statt fest kodierter Selektoren.

Kann ich Temu scrapen, ohne blockiert zu werden?

Bei begrenzten öffentlichen Seiten mit verantwortlicher Taktung: ja — besonders mit Tools, die echtes Browser-Rendering, Sitzungsunterstützung und Drosselung bieten. Kein Tool sollte als universelle Garantie betrachtet werden. Cloud-Scraping mit rotierenden IPs funktioniert gut für öffentliche Katalogseiten; Browser-Scraping mit Ihrer aktuellen Sitzung ist besser, wenn Region, Login oder Pop-ups die Daten beeinflussen.

Welche Daten kann ich aus Temu-Produktseiten extrahieren?

Häufige öffentliche Felder sind Produkttitel, URL, aktueller Preis, Originalpreis, Rabattprozentsatz, Bild-URLs, Sternebewertung, Anzahl der Rezensionen, Verkaufszahl, Verkäufer-/Shop-Name, Versandinformationen, Kategorie, Produktspezifikationen, Varianten (Farben, Größen) und der Scrape-Zeitstempel. Welche Felder genau verfügbar sind, hängt vom Seitentyp (Listing vs. Detailseite) und der Region ab.

Brauche ich Proxys, um Temu zu scrapen?

Für kleine manuelle Extraktionen im Browser-Modus (ein paar Seiten auf einmal) eventuell nicht. Für Cloud-, geplante oder hochvolumige Erfassung sind Proxys oder eine verwaltete Anti-Blocking-Infrastruktur normalerweise notwendig. Tools wie Thunderbit, Bright Data und ScraperAPI bündeln die Proxy-Verwaltung in ihrer Plattform, sodass Sie sie nicht separat konfigurieren müssen.

Wenn Sie tiefer in verwandte Themen einsteigen möchten, sehen Sie sich unsere Leitfäden zu , , und an. Außerdem können Sie Walkthroughs auf dem ansehen.

Mehr erfahren