Das Web quillt über vor Daten, und wenn du in Sales, Marketing, E-Commerce oder Operations arbeitest, weißt du, wie schnell dein Tag im schwarzen Loch der manuellen Datenerfassung verschwinden kann. Ich habe das selbst erlebt: Teams sitzen über Tabellen gebeugt und kopieren sich durch endlose Listen, während die Konkurrenz mit aktuelleren Insights und schnelleren Workflows davonzieht. Die gute Nachricht: Scraper-Plugins sind inzwischen im Mainstream angekommen und verändern, wie Unternehmen Webdaten extrahieren, analysieren und nutzen.

Bis 2025 hatten über irgendeine Form von Web-Scraping-Automatisierung eingeführt und die manuelle Datenerfassung um bis zu 60 % reduziert. Der globale Markt für Web Scraping steuert auf atemberaubende zu. Warum? Weil Scraper-Plugins — diese praktischen Browser-Erweiterungen und Desktop-Tools — Teams dabei helfen, Leads zu generieren, Preise zu überwachen, Märkte zu analysieren und die mühsame Arbeit zu automatisieren, die früher hunderte Stunden verschlungen hat.

Aber bei so vielen Optionen: Wie wählst du das richtige Scraper-Plugin für dein Unternehmen? Egal, ob du als Nicht-Entwickler eine unkomplizierte Lösung suchst oder als Entwickler eine maßgeschneiderte Datenpipeline aufbaust — diese Liste stellt die 18 besten Scraper-Plugins für 2026 vor. Ich zeige dir die Stärken der einzelnen Tools, die idealen Anwendungsfälle und die wichtigsten Auswahlkriterien — damit du aufhören kannst zu kopieren und zu pasten und stattdessen schneller bessere Entscheidungen triffst.

Warum Unternehmen bei der Datenextraktion auf Scraper-Plugins setzen

Fangen wir ganz vorne an: Was ist ein Scraper-Plugin? Einfach gesagt ist es ein Tool — meist eine Browser-Erweiterung oder Desktop-App —, das den Prozess automatisiert, Daten von Websites zu ziehen und in strukturierte Formate wie Tabellen zu überführen. Statt stundenlang zu kopieren und einzufügen, kannst du in wenigen Minuten Tausende von Datenpunkten extrahieren.

Der Nutzen ist enorm:

- Zeitersparnis: Ein Scraping-Skript kann 12.000 Datensätze pro Woche verarbeiten und dabei sparen.

- Kostensenkung: Unternehmen, die Scraper-Plugins einsetzen, berichten von bis zu .

- Bessere Entscheidungen: Mit aktuelleren und reichhaltigeren Daten können Teams auf Marktveränderungen reagieren, Wettbewerber beobachten und Trends erkennen, bevor es andere tun.

- Wettbewerbsvorteil: Händler haben ihren Umsatz um 4 % gesteigert, indem sie einfach gescrapte Preisdaten genutzt haben, und andere konnten ihre internationalen Verkäufe verdoppeln, indem sie regionsspezifische Webdaten auswerteten.

Praxisbeispiele? Vertriebsteams scrapen Verzeichnisse nach Leads, Marketingteams überwachen Online-Stimmungen, E-Commerce-Manager verfolgen Preise von Wettbewerbern, und Operations-Teams speisen gescrapte Daten in Dashboards oder KI-Modelle ein. Und ehrlich: Das alles per Hand zu machen ist ein Rezept für Erschöpfung und Fehler. Scraper-Plugins sind die Produktivitäts-Superkraft, auf die moderne Unternehmen nicht verzichten sollten.

So wählst du das richtige Scraper-Plugin: Wichtige Kriterien

Bei so vielen Scraper-Plugins auf dem Markt fühlt sich die Auswahl fast wie Speed-Dating auf einer Tech-Konferenz an. Darauf achte ich — und du solltest es auch tun:

- Benutzerfreundlichkeit: Braucht es Programmierung, oder kann das jeder im Team nutzen? Tools mit Point-and-Click-Oberfläche oder KI-Unterstützung sind für nicht-technische Nutzer ein Gewinn.

- Anpassbarkeit & Flexibilität: Kann es die speziellen Datenformate und Website-Komplexitäten abbilden, die du brauchst (Pagination, Unterseiten, dynamische Inhalte)?

- Plattformkompatibilität: Ist es eine Browser-Erweiterung, eine Desktop-App oder ein Cloud-Dienst? Läuft es auf deinem bevorzugten Betriebssystem?

- Datenausgabe & Integration: Kannst du nach Excel, Google Sheets, Airtable oder in dein CRM exportieren? Unterstützt es APIs oder Webhooks für Automatisierung?

- Skalierbarkeit: Kann es dein Datenvolumen bewältigen — egal ob 50 Seiten oder 50.000?

- Preisgestaltung: Gibt es einen kostenlosen Tarif? Wie entwickelt sich der Preis mit der Nutzung?

- Support & Community: Gibt es gute Dokumentation, Nutzerforen oder schnellen Support?

Hier ist eine kurze Vergleichstabelle, die dir auf einen Blick hilft:

| Plugin | Benutzerfreundlichkeit | Anpassbarkeit | Plattform | Preisgestaltung | Am besten geeignet für |

|---|---|---|---|---|---|

| Thunderbit | No-Code, KI | Mittel | Chrome/Cloud | Kostenlos/15 $+/Monat | Nicht-Entwickler, Business-Nutzer |

| ScraperAPI | Programmierung erforderlich | Hoch | API/Cloud | Kostenlos/49 $+/Monat | Entwickler, Unternehmen |

| Octoparse | No-Code, visuell | Hoch | Windows/Cloud | Kostenlos/119 $+/Monat | Analysten, Power-User |

| Beautiful Soup | Python-Programmierung | Sehr hoch | Python | Kostenlos | Entwickler |

| ParseHub | Visuell, moderat | Hoch | Desktop/Cloud | Kostenlos/189 $+/Monat | Komplexe Projekte ohne Code |

| DataMiner | No-Code, Rezepte | Mittel | Chrome/Edge | Kostenlos/20 $+/Monat | Schnelles, tabellenbasiertes Scraping |

| ... | ... | ... | ... | ... | ... |

(Siehe die vollständige Vergleichstabelle weiter unten im Artikel.)

Jetzt tauchen wir in die 18 besten Scraper-Plugins für 2026 ein — was jedes einzelne besonders macht und für welche geschäftlichen Anforderungen es sich am besten eignet.

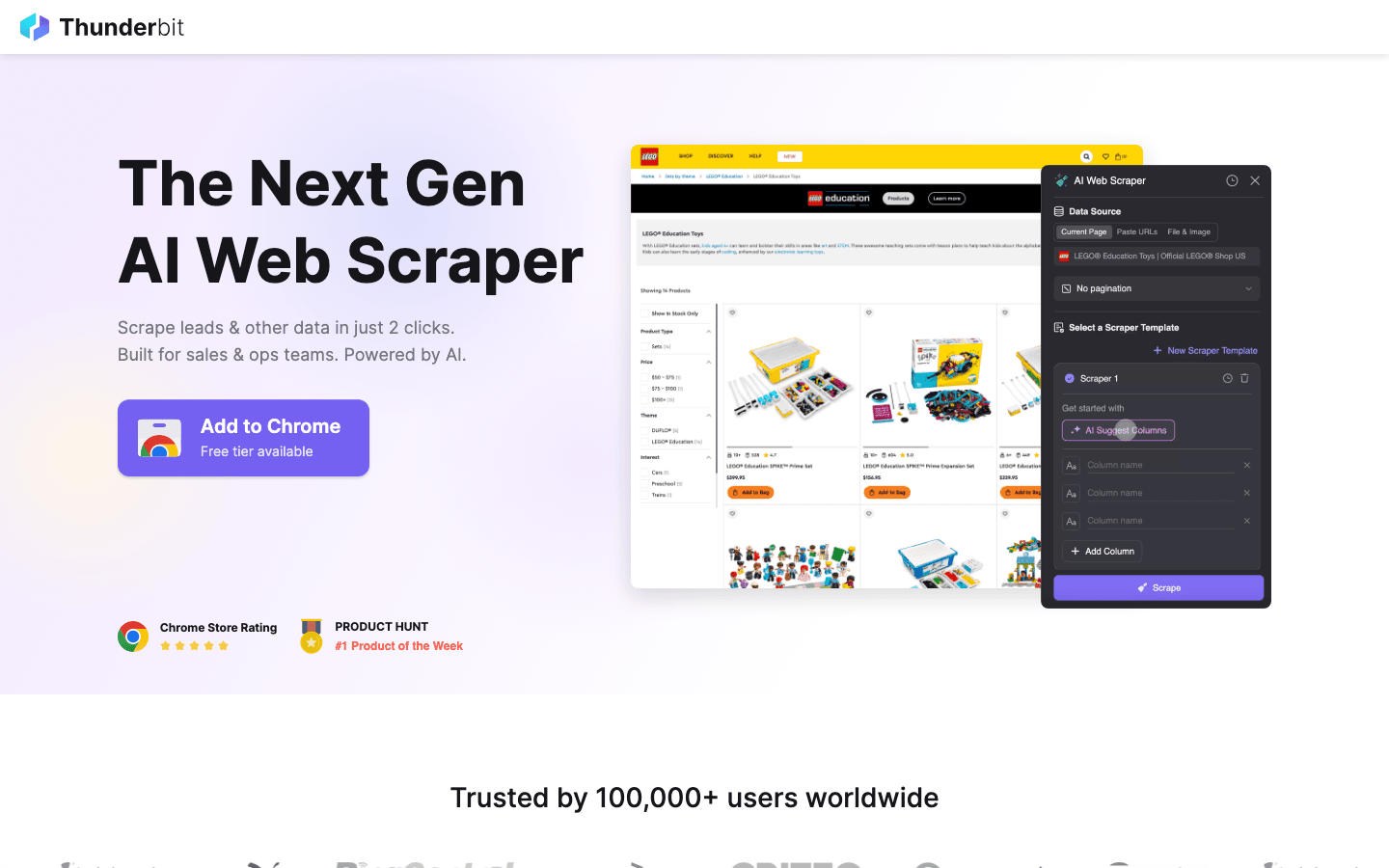

1. Thunderbit

ist meine erste Empfehlung für Business-Nutzer, die Webdaten ohne technischen Stress wollen. Als Mitgründer bin ich natürlich nicht ganz unvoreingenommen — aber ich habe Thunderbit gebaut, weil ich es satt hatte zu sehen, wie Teams mit klobigen, code-lastigen Scrapern kämpfen.

ist meine erste Empfehlung für Business-Nutzer, die Webdaten ohne technischen Stress wollen. Als Mitgründer bin ich natürlich nicht ganz unvoreingenommen — aber ich habe Thunderbit gebaut, weil ich es satt hatte zu sehen, wie Teams mit klobigen, code-lastigen Scrapern kämpfen.

Was macht Thunderbit besonders? Es geht vor allem um Einfachheit und KI. Du öffnest einfach eine Webseite, klickst auf „KI-Felder vorschlagen“, und Thunderbits KI scannt die Seite, empfiehlt die besten zu extrahierenden Spalten und erzeugt sogar die Scraping-Logik für dich. Du brauchst Daten von Unterseiten, etwa Produktdetails oder LinkedIn-Profile? Das Scrapen von Unterseiten mit Thunderbit ist ein Kinderspiel — ganz ohne Skripting.

Weitere Highlights:

- Sofortvorlagen für beliebte Websites (Amazon, Zillow, Shopify usw.) — ein Klick und fertig.

- Kostenloser Datenexport nach Excel, Google Sheets, Airtable oder Notion.

- Extraktion von E-Mails, Telefonnummern und Bildern mit einem Klick — perfekt für Lead-Generierung oder E-Commerce.

- Scraping in der Cloud oder im Browser — wähle zwischen Geschwindigkeit und Zugriff mit Login.

- Unterstützt 34 Sprachen und wird von über 100.000 Nutzern weltweit vertraut.

Thunderbit ist ein Favorit für Sales-, Marketing- und E-Commerce-Teams, die Datenerfassung automatisieren, Wettbewerber beobachten oder eigene Lead-Listen erstellen wollen — ganz ohne eine einzige Zeile Code. Und ja, es gibt eine , mit der du direkt starten kannst.

2. ScraperAPI

ist die Power hinter vielen groß angelegten Scraping-Projekten. Es ist kein visuelles Tool, sondern ein API-Dienst, der sich um Proxies, Anti-Bot-Schutz und JavaScript-Rendering für dich kümmert. Entwickler lieben es, weil man es in Python-, Node.js- oder PHP-Skripte einbinden kann und ScraperAPI sich um IP-Sperren und CAPTCHAs kümmert.

ist die Power hinter vielen groß angelegten Scraping-Projekten. Es ist kein visuelles Tool, sondern ein API-Dienst, der sich um Proxies, Anti-Bot-Schutz und JavaScript-Rendering für dich kümmert. Entwickler lieben es, weil man es in Python-, Node.js- oder PHP-Skripte einbinden kann und ScraperAPI sich um IP-Sperren und CAPTCHAs kümmert.

Wichtige Features:

- Verarbeitet Millionen von Anfragen mit unbegrenzter Bandbreite.

- Automatischer Proxy-Wechsel und Geo-Targeting.

- JavaScript-Rendering für dynamische Websites.

- Pay-as-you-go-Preismodell — kostenlose Testphase, danach 49 $/Monat für 100.000 Anfragen.

Wenn du einen eigenen Scraper entwickelst oder Daten von schwierigen, stark geschützten Websites im großen Maßstab extrahieren musst, ist ScraperAPI dein Backend-Kraftpaket.

3. Octoparse

ist ein No-Code-Scraper-Plugin für Windows mit Drag-and-drop-Oberfläche. Es steckt voller Funktionen für Einsteiger und Power-User: erkennt Datenmuster automatisch, kommt mit Logins und AJAX zurecht und unterstützt Cloud-Scraping für große Jobs.

ist ein No-Code-Scraper-Plugin für Windows mit Drag-and-drop-Oberfläche. Es steckt voller Funktionen für Einsteiger und Power-User: erkennt Datenmuster automatisch, kommt mit Logins und AJAX zurecht und unterstützt Cloud-Scraping für große Jobs.

Warum Nutzer es mögen:

- Hunderte vorgefertigte Vorlagen für beliebte Websites.

- Cloud-Extraktion und Zeitplanung — Jobs rund um die Uhr ausführen, ganz ohne lokalen Rechner.

- Export nach Excel, CSV, JSON oder in Datenbanken.

- Kostenloser Plan für kleine Projekte; kostenpflichtige Tarife schalten Cloud- und erweiterte Funktionen frei.

Octoparse passt hervorragend für Analysten, Forscher und Business-Teams, die die Leistung eines robusten Scrapers wollen, ohne Code zu schreiben.

4. Beautiful Soup

ist die klassische Python-Bibliothek zum Parsen von HTML und XML. Wenn du als Entwickler die volle Kontrolle über deine Scraping-Logik willst, ist Beautiful Soup dein bester Freund.

ist die klassische Python-Bibliothek zum Parsen von HTML und XML. Wenn du als Entwickler die volle Kontrolle über deine Scraping-Logik willst, ist Beautiful Soup dein bester Freund.

Highlights:

- Kommt problemlos mit chaotischem HTML zurecht.

- Lässt sich mit Requests, Selenium oder ScraperAPI integrieren, um Seiten abzurufen.

- Open Source und kostenlos — perfekt für maßgeschneiderte Scraping-Projekte im kleinen bis mittleren Umfang.

Nur nicht vergessen: Du musst Python-Code schreiben, bekommst dafür aber maximale Flexibilität.

5. ParseHub

ist eine plattformübergreifende Desktop-App (Windows, Mac, Linux) mit visueller Point-and-click-Oberfläche. Sie spielt ihre Stärken aus, wenn du komplexe, dynamische Websites scrapen musst — etwa Dropdowns, Logins oder mehrstufige Navigation.

ist eine plattformübergreifende Desktop-App (Windows, Mac, Linux) mit visueller Point-and-click-Oberfläche. Sie spielt ihre Stärken aus, wenn du komplexe, dynamische Websites scrapen musst — etwa Dropdowns, Logins oder mehrstufige Navigation.

Funktionen:

- Visueller Workflow-Builder für erweiterte Extraktion.

- Unterstützt AJAX, endloses Scrollen und bedingte Logik.

- Cloud-Zeitplanung und API-Zugriff in kostenpflichtigen Tarifen.

- Kostenloser Plan für kleine Aufgaben; kostenpflichtige Tarife für intensivere Nutzung.

ParseHub ist ideal für Nicht-Entwickler, die knifflige Websites angehen müssen und eine kleine Einarbeitungszeit nicht scheuen.

6. DataMiner

ist eine Chrome-/Edge-Erweiterung, die für ihre riesige Bibliothek mit über 60.000 öffentlichen „Rezepten“ (vorgefertigten Extraktionsregeln) geschätzt wird. Wenn du Tabellen oder Listen von beliebten Websites scrapen willst, gibt es dafür mit hoher Wahrscheinlichkeit schon ein Rezept.

ist eine Chrome-/Edge-Erweiterung, die für ihre riesige Bibliothek mit über 60.000 öffentlichen „Rezepten“ (vorgefertigten Extraktionsregeln) geschätzt wird. Wenn du Tabellen oder Listen von beliebten Websites scrapen willst, gibt es dafür mit hoher Wahrscheinlichkeit schon ein Rezept.

Warum es so beliebt ist:

- Scraping mit einem Klick mithilfe von Rezepten.

- Export nach CSV, Excel oder Google Sheets.

- Batch-Scraping und Unterstützung für Pagination.

- Kostenlos für bis zu 500 Seiten pro Monat; kostenpflichtige Tarife für mehr.

Ideal für schnelle Aufgaben im kleinen bis mittleren Umfang — vor allem bei Verzeichnissen, Suchergebnissen oder tabellarischen Daten.

7. OutWit Hub

ist eine Desktop-App (Windows, Mac, Linux), die wie ein Browser mit Superkräften funktioniert. Sie erkennt automatisch Links, Bilder, E-Mails, Tabellen und mehr — und macht das Erfassen strukturierter und unstrukturierter Daten ganz einfach.

ist eine Desktop-App (Windows, Mac, Linux), die wie ein Browser mit Superkräften funktioniert. Sie erkennt automatisch Links, Bilder, E-Mails, Tabellen und mehr — und macht das Erfassen strukturierter und unstrukturierter Daten ganz einfach.

Besondere Funktionen:

- Eigene Scraper mit Regex oder Markern.

- Batch-Crawling und Makro-Automatisierung.

- Export nach CSV, HTML, XML oder SQL.

- Kostenlose Light-Version (100 Datensätze); Pro-Version für unbegrenzte Extraktion.

Perfekt für Forscher und Power-User, die feine Steuerung und Automatisierung wollen.

8. WebHarvy

ist ein Windows-Scraper-Plugin mit Point-and-click-Bedienung und klarem Fokus auf Bilder und visuelle Daten. Es ist extrem benutzerfreundlich — einfach auf die gewünschten Daten klicken, und WebHarvy erkennt wiederkehrende Muster automatisch.

ist ein Windows-Scraper-Plugin mit Point-and-click-Bedienung und klarem Fokus auf Bilder und visuelle Daten. Es ist extrem benutzerfreundlich — einfach auf die gewünschten Daten klicken, und WebHarvy erkennt wiederkehrende Muster automatisch.

Wichtige Stärken:

- Bild-Scraping und Downloads.

- Kommt mit Pagination, Dropdowns und Formularübermittlungen zurecht.

- Einmalige Lizenzgebühr (rund 129 $).

Eine Top-Wahl für E-Commerce-Manager, Marketer oder alle, die schnell Produktbilder und -details brauchen.

9. Content Grabber

(heute Sequentum Enterprise) ist der Rolls-Royce unter den Enterprise-Scrapern. Es ist eine Windows-basierte Plattform für IT-Teams und Datenprofis, die robuste, skalierbare und wartbare Scraping-Agents brauchen.

(heute Sequentum Enterprise) ist der Rolls-Royce unter den Enterprise-Scrapern. Es ist eine Windows-basierte Plattform für IT-Teams und Datenprofis, die robuste, skalierbare und wartbare Scraping-Agents brauchen.

Funktionen:

- Visueller Agent-Editor mit Skriptunterstützung (C#/VB.NET).

- Mehrthreadiges, geplantes und überwachtes Scraping.

- Integration mit Datenbanken, APIs und Geschäftsprozessen.

- Enterprise-Preisgestaltung (ab etwa 5.000 $/Jahr).

Wenn Webdaten für dein Unternehmen geschäftskritisch sind, ist Content Grabber die Investition wert.

10. Scrapy

ist das Open-Source-Python-Framework zum Aufbau eigener, skalierbarer Web-Crawler. Es ist der Goldstandard für Entwickler, die Geschwindigkeit, Flexibilität und Kontrolle brauchen.

ist das Open-Source-Python-Framework zum Aufbau eigener, skalierbarer Web-Crawler. Es ist der Goldstandard für Entwickler, die Geschwindigkeit, Flexibilität und Kontrolle brauchen.

Warum Entwickler es lieben:

- Asynchrones, leistungsstarkes Crawling.

- Erweiterbar mit Plugins und Middleware.

- Open Source und kostenlos.

Scrapy ist ideal für Großprojekte, individuelle Datenpipelines und Teams, die ihre Scraping-Infrastruktur selbst kontrollieren wollen.

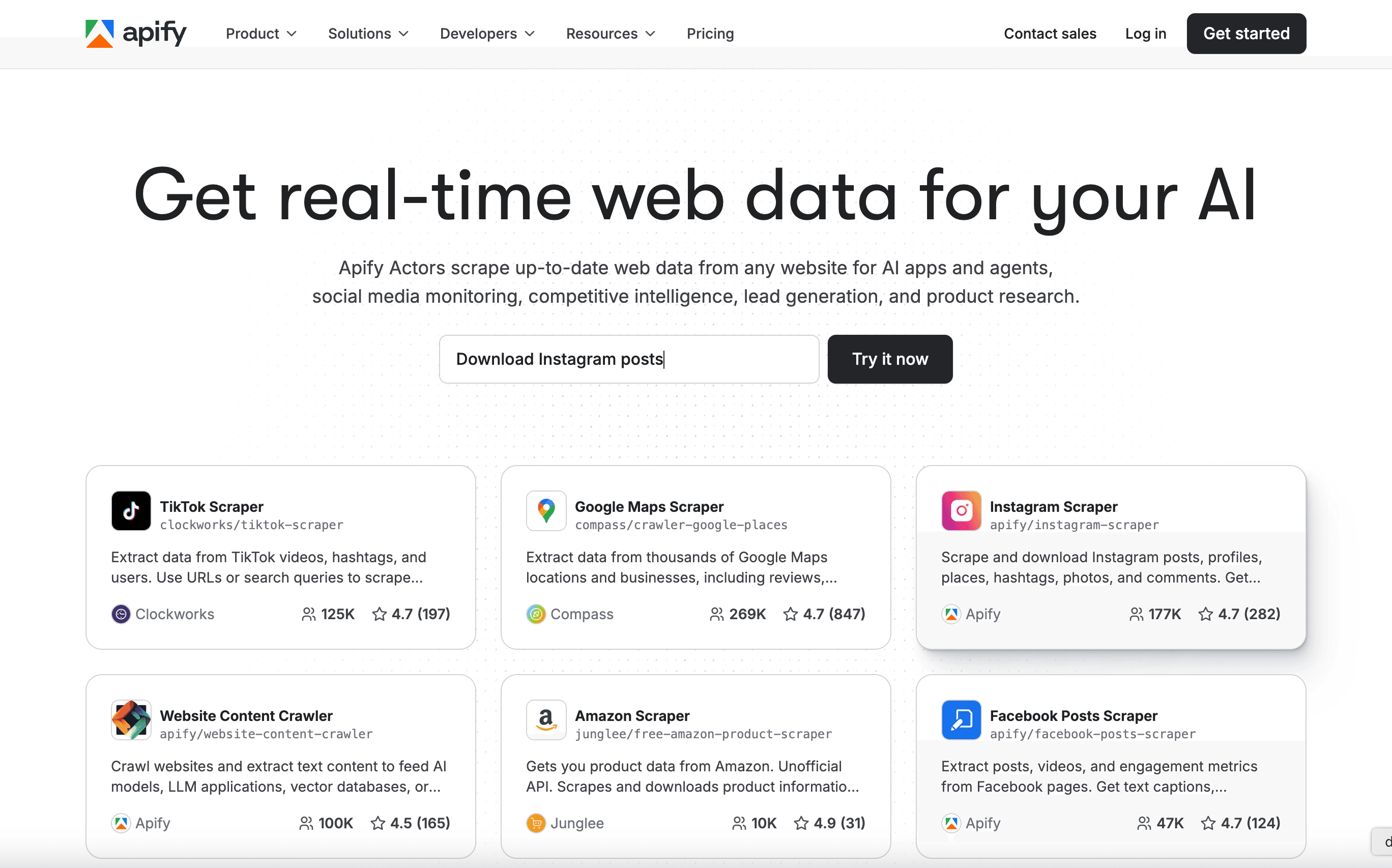

11. Apify

ist eine Cloud-basierte Plattform für Scraping und Automatisierung mit einem Marktplatz von über 10.000 fertigen „Actors“ (vorgefertigten Scrapern). Du kannst Scraping-Aufgaben in der Cloud ausführen, planen und integrieren — ganz ohne lokale Einrichtung.

ist eine Cloud-basierte Plattform für Scraping und Automatisierung mit einem Marktplatz von über 10.000 fertigen „Actors“ (vorgefertigten Scrapern). Du kannst Scraping-Aufgaben in der Cloud ausführen, planen und integrieren — ganz ohne lokale Einrichtung.

Highlights:

- Marktplatz für No-Code- und Low-Code-Scraper.

- Cloud-Zeitplanung, API-Zugriff und Workflow-Automatisierung.

- Kostenloser Tarif; kostenpflichtige Pläne ab 39 $/Monat.

Ideal für Teams, die Webdatenpipelines automatisieren und von der Community erstellte Scraper nutzen möchten.

12. Instant Data Scraper

ist eine kostenlose Chrome-Erweiterung, die perfekt für Einsteiger ist. Ein Klick, und Tabellen oder Listen auf einer Seite werden automatisch erkannt — kein Setup, kein Code.

ist eine kostenlose Chrome-Erweiterung, die perfekt für Einsteiger ist. Ein Klick, und Tabellen oder Listen auf einer Seite werden automatisch erkannt — kein Setup, kein Code.

Funktionen:

- KI-basierte Mustererkennung.

- Export nach Excel oder CSV.

- Kommt mit Pagination und endlosem Scrollen zurecht.

- Völlig kostenlos und unbegrenzt.

Wenn du einfach nur eine Tabelle oder Liste von einer Webseite holen willst, ist das der schnellste Weg.

13. Helium Scraper

ist ein Windows-Desktop-Tool mit visuellem Workflow-Builder. Es ist flexibel, unterstützt dynamische Inhalte und ermöglicht mehrstufige Scraping-Aufgaben.

ist ein Windows-Desktop-Tool mit visuellem Workflow-Builder. Es ist flexibel, unterstützt dynamische Inhalte und ermöglicht mehrstufige Scraping-Aufgaben.

Wichtige Features:

- Drag-and-drop-Design für Workflows.

- Kommt mit AJAX, Formularen und mehrthreadigem Scraping zurecht.

- Export nach CSV, HTML, XML, JSON oder in Datenbanken.

- Einmalige Lizenz (ab 99 $).

Ideal für Analysten und KMU, die ein No-Code-Tool mit Tiefe und Automatisierung suchen.

14. UiPath

ist eine führende Plattform für Robotic Process Automation (RPA) mit integriertem Web Scraping. Sie ist für die End-to-End-Automatisierung von Geschäftsprozessen gedacht — Scraping ist nur ein Schritt in einem größeren Workflow.

ist eine führende Plattform für Robotic Process Automation (RPA) mit integriertem Web Scraping. Sie ist für die End-to-End-Automatisierung von Geschäftsprozessen gedacht — Scraping ist nur ein Schritt in einem größeren Workflow.

Warum Unternehmen sie nutzen:

- Visueller Workflow-Designer mit Assistent für Datenextraktion.

- Verknüpft Scraping mit E-Mail, Datenbanken und Apps.

- Zeitplanung, Monitoring und Compliance auf Enterprise-Niveau.

- Community Edition kostenlos; Enterprise-Tarife kostenpflichtig.

Wenn du ganze Geschäftsprozesse automatisieren willst, nicht nur das Scraping, ist UiPath ein echtes Kraftpaket.

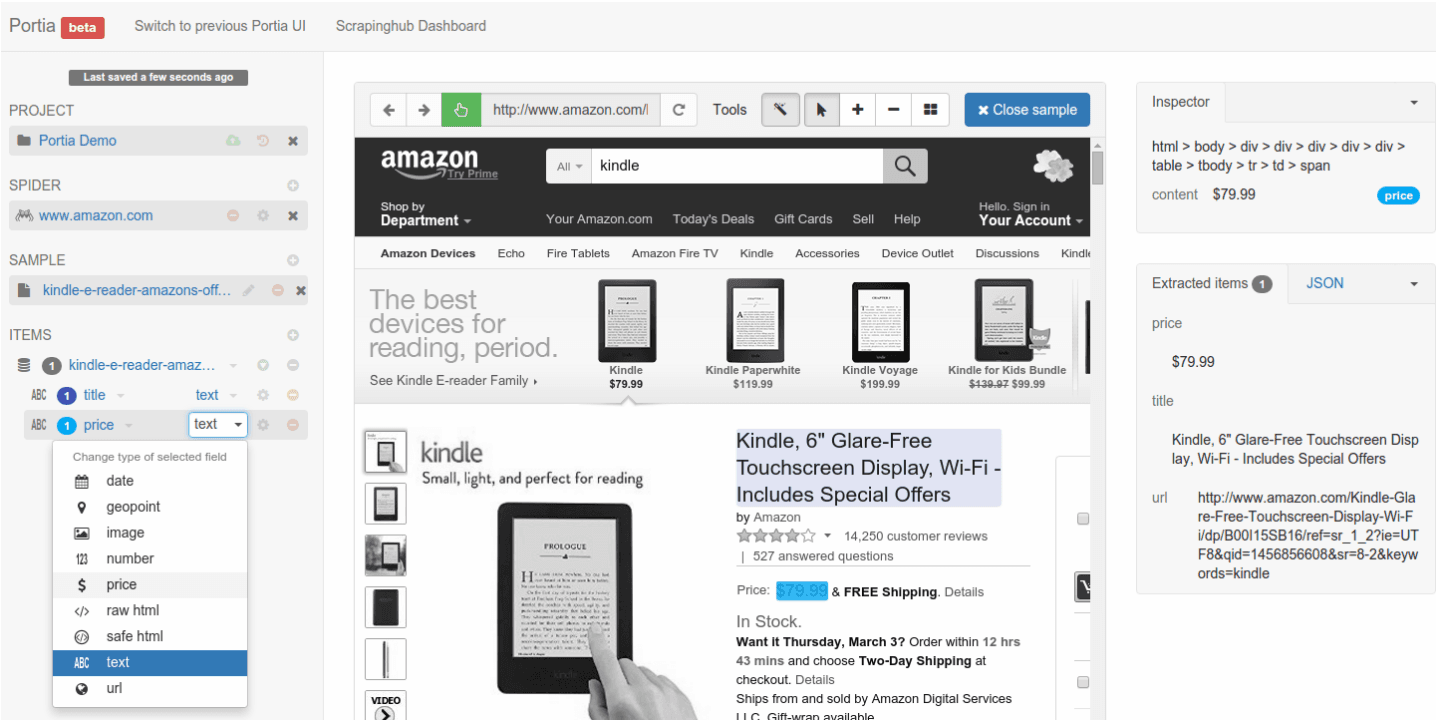

15. Portia by Scrapinghub

ist ein Open-Source, browserbasiertes visuelles Scraper-Tool. Du baust Scraper, indem du auf Seitenelemente zeigst und klickst — ganz ohne Code.

ist ein Open-Source, browserbasiertes visuelles Scraper-Tool. Du baust Scraper, indem du auf Seitenelemente zeigst und klickst — ganz ohne Code.

Funktionen:

- Vorlagenbasierte Extraktion für ähnliche Seiten.

- Integration mit Scrapy und Scrapinghub Cloud.

- Open Source und kostenlos (Self-Hosting).

Eine solide Wahl für Nicht-Entwickler, die die Power von Scrapy über eine visuelle Oberfläche nutzen möchten.

16. Easy Web Extract

ist ein leichtgewichtiges Windows-Tool mit Fokus auf Einfachheit. Es eignet sich hervorragend, um Texte, URLs, Bilder und Dateien mit minimalem Aufwand von Webseiten zu extrahieren.

ist ein leichtgewichtiges Windows-Tool mit Fokus auf Einfachheit. Es eignet sich hervorragend, um Texte, URLs, Bilder und Dateien mit minimalem Aufwand von Webseiten zu extrahieren.

Highlights:

- Erkennt gängige Muster automatisch.

- Unterstützt Formularübermittlungen und Batch-Aufgaben.

- Export nach CSV, Excel, HTML oder XML.

- Einmalige Gebühr (rund 70 $).

Perfekt für kleine Unternehmen oder alle, die schnelles, unkompliziertes Scraping wollen.

17. Dexi.io

ist eine Cloud-basierte Plattform für Scraping und Workflow-Automatisierung. Sie bietet einen visuellen Workflow-Builder, Cloud-Zeitplanung und tiefgehende Integrationsmöglichkeiten.

ist eine Cloud-basierte Plattform für Scraping und Workflow-Automatisierung. Sie bietet einen visuellen Workflow-Builder, Cloud-Zeitplanung und tiefgehende Integrationsmöglichkeiten.

Warum Teams Dexi wählen:

- End-to-End-Datenpipelines (Scraping + ETL).

- API-/Webhook-Integrationen mit Business-Tools.

- Preisgestaltung für Unternehmen.

Am besten geeignet für Datenteams und Unternehmen, die Webdatenerfassung automatisieren und direkt in ihre Workflows integrieren wollen.

18. Web Scraper

ist eine beliebte Chrome-Erweiterung und Cloud-Plattform, die mit einem Sitemap-basierten Ansatz arbeitet. Du definierst visuell, wie navigiert und extrahiert werden soll, und das Tool übernimmt mehrstufiges, strukturiertes Scraping.

ist eine beliebte Chrome-Erweiterung und Cloud-Plattform, die mit einem Sitemap-basierten Ansatz arbeitet. Du definierst visuell, wie navigiert und extrahiert werden soll, und das Tool übernimmt mehrstufiges, strukturiertes Scraping.

Funktionen:

- Visueller Sitemap-Builder.

- Große Vorlagenbibliothek und aktive Community.

- Export nach CSV, Excel, JSON; Cloud-Zeitplanung verfügbar.

- Für lokale Nutzung kostenlos; Cloud-Pläne ab 50 $/Monat.

Ein Favorit für Studierende, Forscher und Business-Nutzer, die strukturierte Datenextraktion mit wenig Code möchten.

Vergleichstabelle der Scraper-Plugins: Features auf einen Blick

Hier ist ein kurzer Vergleich, damit du die passende Lösung schneller findest:

| Plugin | Benutzerfreundlichkeit | Anpassbarkeit | Plattform | Preisgestaltung | Am besten geeignet für |

|---|---|---|---|---|---|

| Thunderbit | No-Code, KI | Mittel | Chrome/Cloud | Kostenlos/15 $+/Monat | Nicht-Entwickler, Business-Nutzer |

| ScraperAPI | Programmierung erforderlich | Hoch | API/Cloud | Kostenlos/49 $+/Monat | Entwickler, Unternehmen |

| Octoparse | No-Code, visuell | Hoch | Windows/Cloud | Kostenlos/119 $+/Monat | Analysten, Power-User |

| Beautiful Soup | Python-Programmierung | Sehr hoch | Python | Kostenlos | Entwickler |

| ParseHub | Visuell, moderat | Hoch | Desktop/Cloud | Kostenlos/189 $+/Monat | Komplexe Projekte ohne Code |

| DataMiner | No-Code, Rezepte | Mittel | Chrome/Edge | Kostenlos/20 $+/Monat | Schnelles, tabellenbasiertes Scraping |

| OutWit Hub | Desktop, automatisch | Hoch | Win/Mac/Linux | Kostenlos/89 $ | Forscher, Power-User |

| WebHarvy | Point-and-click | Mittel | Windows | 129 $ einmalig | E-Commerce, Bild-Scraping |

| Content Grabber | Visuell + Code | Sehr hoch | Windows/Server | 5.000 $+/Jahr | Unternehmen, IT-Teams |

| Scrapy | Python-Programmierung | Sehr hoch | Python | Kostenlos | Entwickler, Großprojekte |

| Apify | Cloud, gemischt | Hoch | Cloud | Kostenlos/39 $+/Monat | Teams, Automatisierungs-Pipelines |

| Instant Data Scraper | Ein Klick | Gering | Chrome | Kostenlos | Einsteiger, schnelle Aufgaben |

| Helium Scraper | Visuell, Drag-and-drop | Hoch | Windows | 99 $+ einmalig | Analysten, KMU |

| UiPath | Visuelles RPA | Hoch | Desktop/Cloud | Kostenlos/Enterprise | Unternehmen, Prozessautomatisierung |

| Portia | Visuell, Browser | Mittel | Web (Self-Hosted) | Kostenlos | Nicht-Entwickler, Scrapy-Nutzer |

| Easy Web Extract | Einfaches GUI | Gering bis mittel | Windows | 70 $ einmalig | Kleine Unternehmen, schnelle Aufgaben |

| Dexi.io | Cloud, visuell | Hoch | Cloud | Enterprise | Datenteams, Workflow-Automatisierung |

| Web Scraper | Visuelle Sitemap | Mittel bis hoch | Chrome/Cloud | Kostenlos/50 $+/Monat | Allzweck, strukturierte Daten |

Welches Scraper-Plugin ist am besten für deine Geschäftsanforderungen?

Es gibt keine Einheitslösung — das beste Scraper-Plugin hängt von den Fähigkeiten deines Teams, deinen Datenanforderungen und deinem Workflow ab. Hier ist meine Kurzfassung:

- Für Nicht-Entwickler und Business-Teams: Starte mit oder für intuitives, visuelles Scraping. Thunderbits KI-Feldvorschläge und Unterseiten-Scraping machen es zu einer Top-Wahl für Sales, Marketing und E-Commerce.

- Für Entwickler und individuelle Projekte: , und bieten maximale Flexibilität und Skalierbarkeit.

- Für schnelle Einzelaufgaben: oder sind perfekt, um Tabellen und Listen in Sekunden zu erfassen.

- Für Workflow-Automatisierung und Integration: und sind für die End-to-End-Automatisierung von Geschäftsprozessen gebaut.

- Für bildlastige oder E-Commerce-Aufgaben: und sind Top-Empfehlungen.

- Für Scraping im Enterprise-Maßstab und geschäftskritische Szenarien: und liefern robuste, skalierbare Lösungen mit fortgeschrittener Integration.

Profi-Tipp: Scheu dich nicht davor, Tools zu kombinieren — viele Teams nutzen Thunderbit für das tägliche Scraping und ergänzen es bei Sonderfällen mit Entwickler-Tools wie Scrapy oder Beautiful Soup. Die meisten Plugins bieten kostenlose Testphasen an, also probiere aus, was am besten zu deinem Workflow passt.

FAQs

1. Was ist ein Scraper-Plugin und wie funktioniert es?

Ein Scraper-Plugin ist ein Tool (meist eine Browser-Erweiterung oder Desktop-App), das die Extraktion von Daten von Websites automatisiert. Es wandelt Webseiten in strukturierte Daten wie Tabellen um und erspart dir das manuelle Kopieren und Einfügen.

2. Welches Scraper-Plugin ist für nicht-technische Nutzer am besten?

und sind dank ihrer intuitiven Oberflächen und der visuellen Einrichtung die besten Optionen für Nicht-Entwickler. eignet sich ebenfalls hervorragend für schnelle, einfache Aufgaben.

3. Können Scraper-Plugins dynamische oder JavaScript-lastige Websites verarbeiten?

Ja, Tools wie , , und sind dafür ausgelegt, dynamische Inhalte, AJAX und JavaScript-Rendering zu verarbeiten.

4. Gibt es kostenlose Scraper-Plugins?

Auf jeden Fall! , , und bieten kostenlose Tarife oder sind Open Source.

5. Wie wähle ich das richtige Scraper-Plugin für mein Unternehmen aus?

Berücksichtige deine technischen Fähigkeiten, die Komplexität deiner Datenanforderungen, Integrationsbedarf und Budget. Nutze die Vergleichstabelle oben, um die Auswahl einzugrenzen, und teste kostenlose Versionen, um zu sehen, welches Tool zu deinem Workflow passt.

Bist du bereit, die manuelle Datenerfassung hinter dir zu lassen? oder entdecke weitere Leitfäden im , um deine Webdatenstrategie 2026 auf das nächste Level zu heben. Viel Erfolg beim Scrapen!

Mehr erfahren