Das Internet wächst gefühlt schneller als meine Lust auf einen zweiten Kaffee – und das will schon was heißen. Im Jahr 2026 ist das Extrahieren von Webdaten längst keine Spielwiese mehr für Daten-Nerds, sondern das Fundament für Business Intelligence, KI-Training und Automatisierung. Egal, ob du Markttrends tracken, dein nächstes LLM füttern oder einfach nur die Preise der Konkurrenz im Auge behalten willst: Der Hunger nach aktuellen, strukturierten Webdaten war noch nie so groß. Und im Zentrum dieses Daten-Hypes? Natürlich Python. Mit seiner riesigen Community und der super zugänglichen Syntax bleibt Python die Nummer eins für Web Scraping – von schnellen Einzelskripten bis zu professionellen Crawlern im großen Stil.

Aber hier kommt der Haken: Die Wahl der richtigen python web scraping pakete entscheidet, ob dein Projekt ein Erfolg wird oder du dich nur ärgerst. Ich habe schon Teams gesehen, die tagelang an Anti-Bot-Sperren verzweifelt sind oder Stunden mit chaotischem HTML vergeudet haben – obwohl eine smartere Bibliothek das Problem in Minuten gelöst hätte. Nach vielen Jahren in SaaS, Automatisierung und KI (und als Gründer von , um Scraping für alle zugänglich zu machen) habe ich die 12 besten python web scraping pakete für 2026 zusammengestellt – jedes mit eigenen Stärken, Eigenheiten und idealen Einsatzbereichen. Lass uns gemeinsam herausfinden, welches Tool zu deinem nächsten Datenprojekt passt.

Warum die Wahl des richtigen Python Web-Scraping-Pakets so wichtig ist

Mal ehrlich: Kein Web-Scraping-Projekt gleicht dem anderen. Manchmal willst du nur ein paar Produktpreise von einer statischen Seite abgreifen. Ein anderes Mal kämpfst du mit einer JavaScript-lastigen Website, die störrischer ist als eine Katze beim Baden. Das richtige Paket spart dir Stunden (oder sogar Tage), minimiert Fehler und hilft dir, typische Stolperfallen wie Anti-Bot-Schutz oder fehlerhaftes HTML zu umgehen.

Dass Python beim Web Scraping so beliebt ist, kommt nicht von ungefähr. Bibliotheken wie requests und urllib3 werden über heruntergeladen, und fast jedes große Scraping-Tool setzt auf Python. Aber: Mit großer Macht kommt große Verantwortung. Wählst du das falsche Tool, fühlt sich dein Projekt an wie Modem-Internet. Triffst du die richtige Wahl, schwimmst du in sauberen, strukturierten Daten, bevor dein Kaffee kalt wird.

So haben wir die besten python web scraping pakete ausgewählt

Ich habe nicht einfach nur auf die PyPI-Downloads geschaut. Das waren meine Kriterien:

- Performance & Parallelität: Wie schnell kann das Paket hunderte oder tausende Seiten abfragen?

- Benutzerfreundlichkeit: Kommt man auch als Anfänger klar oder braucht man ein Informatik-Studium?

- HTML-Parsing: Wie gut kommt das Paket mit fehlerhaftem Markup klar, unterstützt es XPath/CSS-Selektoren und macht die Datenauslese einfach?

- Dynamische Inhalte: Kann es mit JavaScript-lastigen Seiten umgehen oder nur mit statischen?

- Community & Dokumentation: Gibt es eine aktive Nutzerbasis und gute Dokus oder bist du auf Stack Overflow verloren?

- Bester Anwendungsfall: Eignet es sich für schnelle Skripte, große Crawler oder etwas dazwischen?

Außerdem habe ich echtes Entwickler-Feedback, aktuelle Benchmarks und meine eigenen (teils schmerzhaften) Erfahrungen einfließen lassen. Hier sind die Top-Kandidaten.

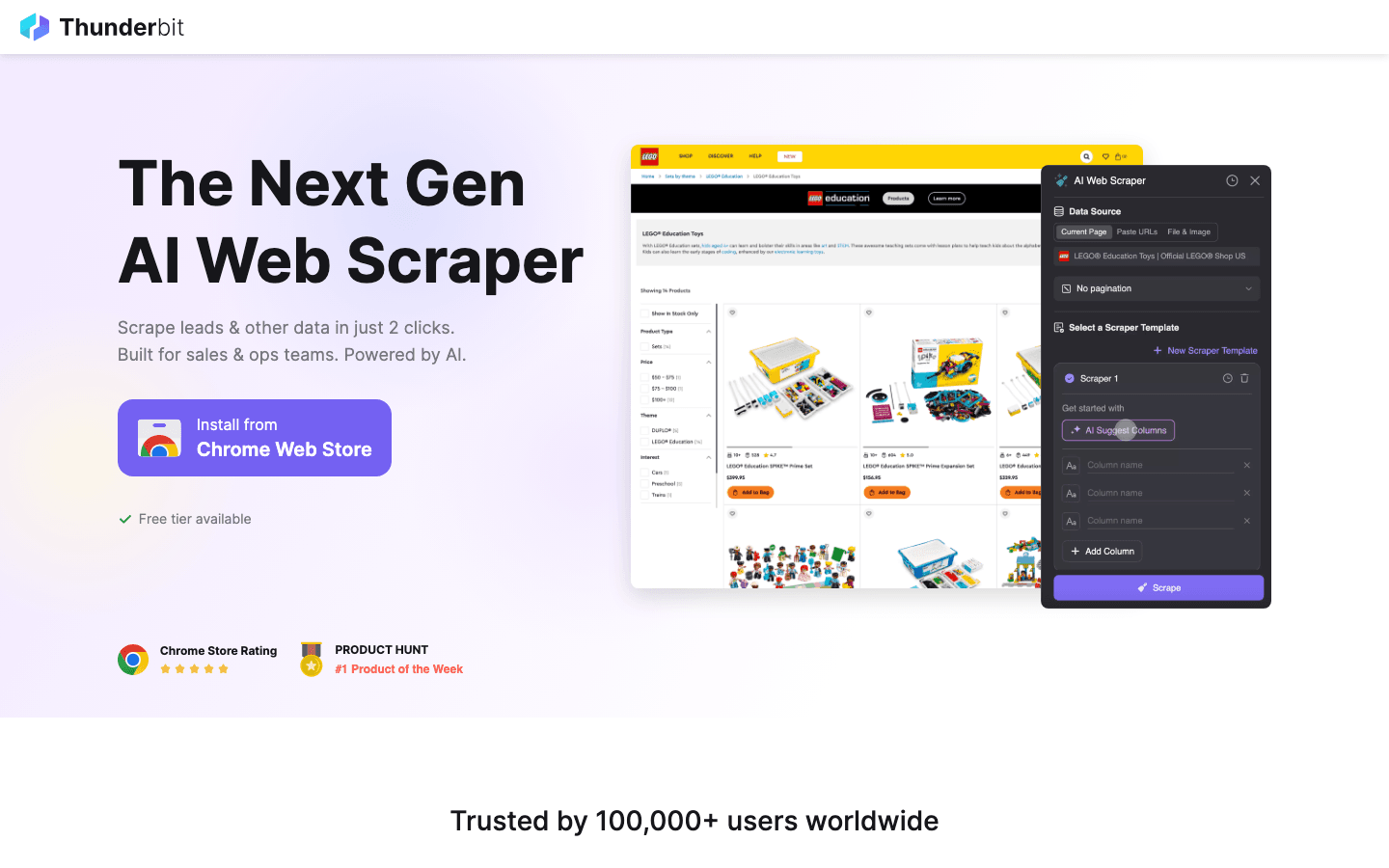

1. Thunderbit

ist keine klassische Python-Bibliothek, sondern eine KI-gestützte Chrome-Erweiterung, die das Web Scraping auf ein neues Level hebt – vor allem für Python-Entwickler, die Wert auf Tempo, Präzision und KI-Unterstützung legen. Das Besondere: Mit natürlichen Sprachbefehlen sagst du der KI, welche Daten du brauchst, und Thunderbit erledigt den Rest – von Feldvorschlägen über Unterseiten-Navigation und Paginierung bis zum Export nach Excel, Google Sheets, Notion oder Airtable.

ist keine klassische Python-Bibliothek, sondern eine KI-gestützte Chrome-Erweiterung, die das Web Scraping auf ein neues Level hebt – vor allem für Python-Entwickler, die Wert auf Tempo, Präzision und KI-Unterstützung legen. Das Besondere: Mit natürlichen Sprachbefehlen sagst du der KI, welche Daten du brauchst, und Thunderbit erledigt den Rest – von Feldvorschlägen über Unterseiten-Navigation und Paginierung bis zum Export nach Excel, Google Sheets, Notion oder Airtable.

Thunderbit ist ein echter Gamechanger, wenn es um komplexe, unstrukturierte Daten geht – zum Beispiel bei chaotischen Verzeichnissen, Produktlisten oder Seiten, deren HTML eher „Kunstwerk“ als „Struktur“ ist. Die Funktion KI-Feldvorschläge liest die Seite und schlägt passende Spalten vor, während Unterseiten-Scraping automatisch verlinkte Detailseiten besucht und die Daten anreichert. Und falls du genug von Anti-Bot-Problemen hast: Thunderbit bietet Scraping im Browser und in der Cloud.

Python-Entwickler schätzen Thunderbit für schnelles Prototyping, Lead-Generierung und Marktanalysen. Die Ergebnisse lassen sich direkt in Python-Datenpipelines einbinden oder per API automatisieren. Es ist zwar keine klassische Code-Bibliothek, aber für alle, die weniger coden und mehr analysieren wollen, wird Thunderbit schnell zum Favoriten.

Wichtige Funktionen:

- KI-gestützte Feldvorschläge und Datenerfassung

- Unterstützt Unterseiten, Paginierung sowie PDFs/Bilder

- Export nach CSV, Excel, Google Sheets, Notion, Airtable

- Kein Programmieren nötig – ideal für Einsteiger und Profis, die schnell Ergebnisse wollen

- Kostenlose Basisversion, bezahlte Pläne skalierbar

Ideal für: Lead-Generierung, Marktanalysen, schnelles Prototyping und das Extrahieren komplexer oder unstrukturierter Webdaten.

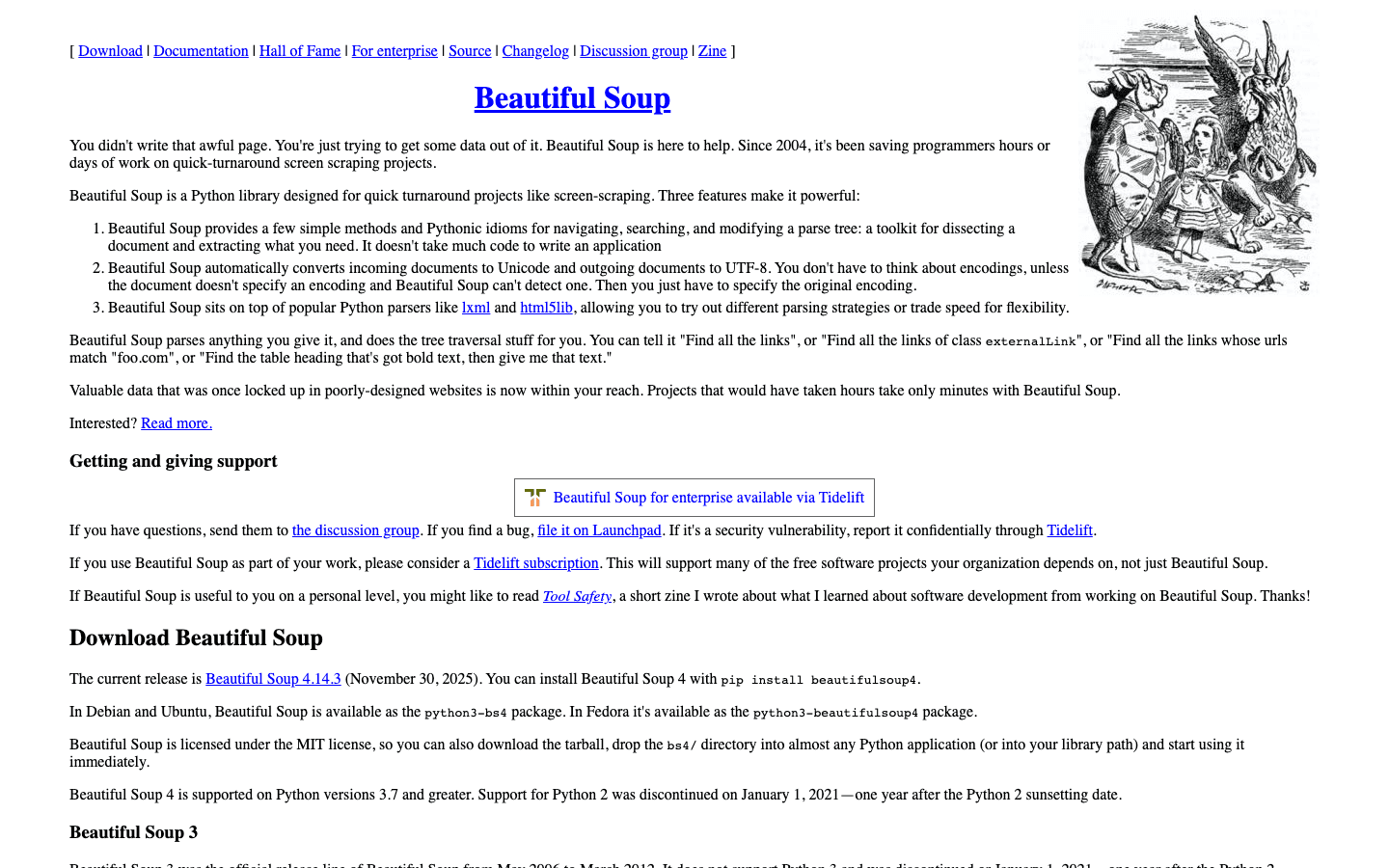

2. Beautiful Soup

ist der Klassiker unter den HTML-Parsern für Python. Wer gerade erst anfängt oder Daten von statischen Seiten extrahieren will, ist hier bestens aufgehoben. Beautiful Soup glänzt beim Navigieren und Parsen von fehlerhaftem HTML („Tag-Suppe“) und ist damit ein Retter für Seiten, die sich nicht an Standards halten.

ist der Klassiker unter den HTML-Parsern für Python. Wer gerade erst anfängt oder Daten von statischen Seiten extrahieren will, ist hier bestens aufgehoben. Beautiful Soup glänzt beim Navigieren und Parsen von fehlerhaftem HTML („Tag-Suppe“) und ist damit ein Retter für Seiten, die sich nicht an Standards halten.

Die API ist einsteigerfreundlich – mit Methoden wie .find(), .select() und .text – und harmoniert perfekt mit requests zum Laden von Webseiten. Unter der Haube kannst du verschiedene Parser wählen (z.B. lxml für Geschwindigkeit oder html5lib für maximale Kompatibilität). Die Dokumentation ist hervorragend und die Community riesig.

Wichtige Funktionen:

- Intuitive, Python-typische API für HTML/XML

- Kommt mit fehlerhaftem oder inkonsistentem Markup klar

- Unterstützt verschiedene Parser für Geschwindigkeit oder Kompatibilität

- Große Community und viele Tutorials

Ideal für: Schnelle Skripte, statische Seiten und Einsteiger mit Lernbedarf.

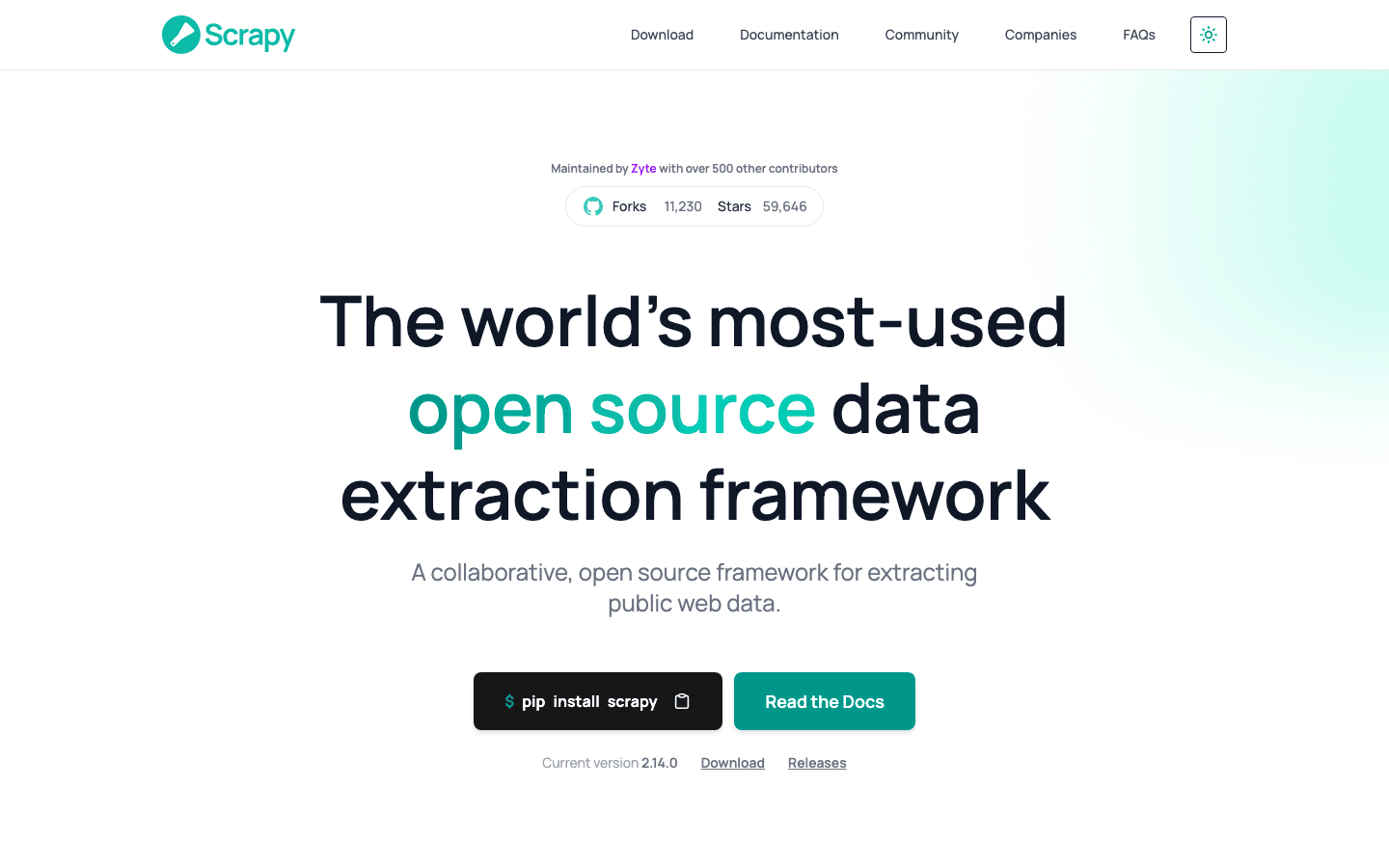

3. Scrapy

ist der Platzhirsch für groß angelegte, automatisierte Web-Crawler. Wer hunderte oder tausende Seiten scrapen, Datenpipelines verwalten oder wiederkehrende Jobs planen will, ist mit Scrapy bestens beraten. Dank Twisted-Engine ist Scrapy extrem schnell, unterstützt asynchrones Crawling, Pipelines zur Datenbereinigung und den Export in JSON, CSV oder Datenbanken.

ist der Platzhirsch für groß angelegte, automatisierte Web-Crawler. Wer hunderte oder tausende Seiten scrapen, Datenpipelines verwalten oder wiederkehrende Jobs planen will, ist mit Scrapy bestens beraten. Dank Twisted-Engine ist Scrapy extrem schnell, unterstützt asynchrones Crawling, Pipelines zur Datenbereinigung und den Export in JSON, CSV oder Datenbanken.

Scrapy ist erweiterbar, mit Plugins für Proxies, Caching und sogar eingeschränktem JavaScript-Rendering (über Splash oder Selenium). Die Lernkurve ist steiler als bei Beautiful Soup, aber für große Datenprojekte führt kaum ein Weg daran vorbei.

Wichtige Funktionen:

- Asynchrones, performantes Crawling

- Integrierte Pipelines für Datenbereinigung und Speicherung

- Export in verschiedene Formate (JSON, CSV, DB)

- Große, aktive Community und Plugin-Ökosystem

Ideal für: Großprojekte, wiederkehrende Scraping-Aufgaben, Datenpipelines und alle, die Wert auf Geschwindigkeit und Zuverlässigkeit legen.

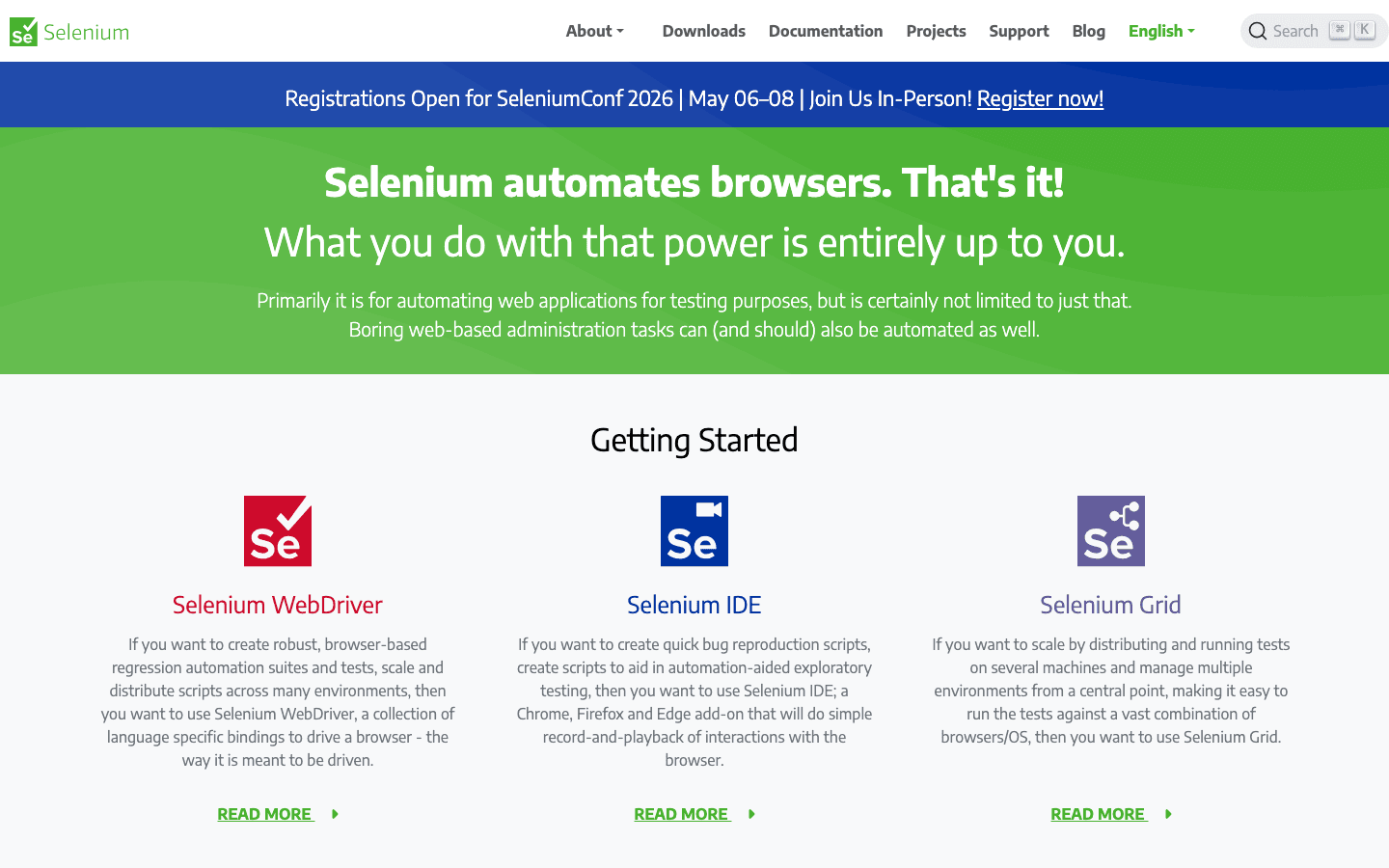

4. Selenium

ist das Standard-Tool für das Scraping von JavaScript-lastigen oder interaktiven Seiten. Es steuert echte Browser (Chrome, Firefox etc.) und kann Nutzeraktionen wie Klicks, Scrollen oder Formulareingaben simulieren. Wenn die gewünschten Daten erst nach JavaScript-Ausführung erscheinen, ist Selenium oft die einzige Lösung.

ist das Standard-Tool für das Scraping von JavaScript-lastigen oder interaktiven Seiten. Es steuert echte Browser (Chrome, Firefox etc.) und kann Nutzeraktionen wie Klicks, Scrollen oder Formulareingaben simulieren. Wenn die gewünschten Daten erst nach JavaScript-Ausführung erscheinen, ist Selenium oft die einzige Lösung.

Der Nachteil: Selenium ist langsam und ressourcenhungrig, da für jeden Scrape ein kompletter Browser läuft. Für besonders knifflige Fälle ist es aber unverzichtbar.

Wichtige Funktionen:

- Vollständige Browser-Automatisierung (Chrome, Firefox, Edge etc.)

- Kann JavaScript-Inhalte und interaktive Elemente verarbeiten

- Headless-Modus für schnelleres Scraping ohne UI

- Große Community und umfassende Dokumentation

Ideal für: Dynamische, JavaScript-lastige Seiten, Login-Prozesse, CAPTCHAs und komplexe Nutzerinteraktionen.

5. PyQuery

bringt jQuery-ähnliche Syntax nach Python und macht das Parsen von HTML für alle, die jQuery kennen, besonders einfach. Es nutzt den schnellen

bringt jQuery-ähnliche Syntax nach Python und macht das Parsen von HTML für alle, die jQuery kennen, besonders einfach. Es nutzt den schnellen lxml-Parser und erlaubt CSS-Selektoren wie $('div.classname').

PyQuery eignet sich hervorragend für schnelles Prototyping und für Entwickler, die Wert auf kurze, lesbare Codes legen. Es ist schneller als Beautiful Soup bei komplexen Abfragen und lässt sich gut mit asynchronen Tools oder Selenium kombinieren.

Wichtige Funktionen:

- jQuery-ähnliche Selektoren und Syntax in Python

- Schnelles Parsen dank lxml-Backend

- Ideal für Entwickler mit JavaScript-Erfahrung

- Unterstützt Verkettung und kompakte Abfragen

Ideal für: Prototyping, jQuery-Fans und alle, die beim HTML-Parsing wenig Code schreiben wollen.

6. LXML

ist der Geschwindigkeits-Champion beim Parsen von HTML und XML in Python. Basierend auf den C-Bibliotheken

ist der Geschwindigkeits-Champion beim Parsen von HTML und XML in Python. Basierend auf den C-Bibliotheken libxml2 und libxslt ist lxml bekannt für seine Performance und die starke Unterstützung von XPath und CSS-Selektoren. Wer große Dokumente oder komplexe Abfragen hat, ist hier richtig.

LXML kann direkt oder als Backend für Beautiful Soup oder PyQuery genutzt werden. Die API ist etwas anspruchsvoller, aber für große Aufgaben lohnt sich der Aufwand.

Wichtige Funktionen:

- Schnellster Parser in Python

- Volle Unterstützung für XPath und CSS-Selektoren

- Effizient bei großen und komplexen Dokumenten

- Kann eigenständig oder als Parser für andere Bibliotheken genutzt werden

Ideal für: Hochperformantes Parsen, große Scraping-Projekte und fortgeschrittene Abfragen.

7. Requests

ist der Standard für HTTP-Anfragen in Python. Die einfache, intuitive API macht das Laden von Webseiten zum Kinderspiel (

ist der Standard für HTTP-Anfragen in Python. Die einfache, intuitive API macht das Laden von Webseiten zum Kinderspiel (requests.get(url)). Cookies, Sessions und sogar JSON werden direkt unterstützt.

Requests arbeitet synchron (jede Anfrage wartet auf Antwort), ist aber ideal für kleine Skripte und überschaubares Scraping. In Kombination mit Beautiful Soup oder lxml ergibt sich ein bewährter Workflow.

Wichtige Funktionen:

- Einfache, Python-typische API für HTTP-Anfragen

- Unterstützt Cookies, Sessions und Weiterleitungen

- Lässt sich nahtlos mit Parsing-Bibliotheken kombinieren

- Riesige Community und Dokumentation

Ideal für: Einfache Skripte, statische Seiten und Einsteiger, die schnell loslegen wollen.

8. MechanicalSoup

ist eine schlanke Bibliothek, die einfache Browser-Interaktionen automatisiert – etwa Formulare ausfüllen oder mehrstufige Logins – ohne einen kompletten Browser zu starten. Sie basiert auf

ist eine schlanke Bibliothek, die einfache Browser-Interaktionen automatisiert – etwa Formulare ausfüllen oder mehrstufige Logins – ohne einen kompletten Browser zu starten. Sie basiert auf requests und Beautiful Soup und ist damit deutlich schneller und ressourcenschonender als Selenium, solange die Seite nicht zu dynamisch ist.

Wer sich einloggen, Formulare absenden oder ein paar Seiten durchklicken muss (und die Seite nicht zu viel JavaScript nutzt), findet hier eine gute Lösung.

Wichtige Funktionen:

- Automatisiert Formulare und Navigation

- Baut auf Requests und Beautiful Soup auf

- Leichtgewichtig und schnell (kein Browser-Overhead)

- Einfach zu bedienen für moderate Interaktivität

Ideal für: Seiten mit Login oder Formularen, einfache Automatisierung und alle, die Selenium vermeiden wollen.

9. Aiohttp

ist das asynchrone Kraftpaket für schnelle, parallele Webanfragen. Wer hunderte Seiten in kurzer Zeit scrapen will, kann mit aiohttp Anfragen parallel abfeuern und so die Laufzeit drastisch verkürzen. In einem Benchmark wurden 50 Seiten in nur 3 Sekunden mit aiohttp gescrapt – im Vergleich zu 16 Sekunden mit synchronen Requests ().

ist das asynchrone Kraftpaket für schnelle, parallele Webanfragen. Wer hunderte Seiten in kurzer Zeit scrapen will, kann mit aiohttp Anfragen parallel abfeuern und so die Laufzeit drastisch verkürzen. In einem Benchmark wurden 50 Seiten in nur 3 Sekunden mit aiohttp gescrapt – im Vergleich zu 16 Sekunden mit synchronen Requests ().

Aiohttp erfordert asynchrone Programmierung (async def, await), aber für große Projekte lohnt sich der Aufwand.

Wichtige Funktionen:

- Asynchrones HTTP-Client/Server-Framework

- Unterstützt Sessions, Cookies und HTTP/2

- Enorme Geschwindigkeitsvorteile bei parallelen Anfragen

- Lässt sich mit asynchronen Parsing-Bibliotheken kombinieren

Ideal für: Hochgeschwindigkeits-Scraping, API-Harvesting und Entwickler mit Erfahrung in asynchroner Programmierung.

10. Twisted

ist die eventbasierte Netzwerk-Engine hinter Scrapy. Zwar keine Scraping-Bibliothek im engeren Sinne, aber fortgeschrittene Nutzer können Twisted direkt nutzen, um eigene Crawler, nicht-HTTP-Protokolle oder hochgradig parallele Spider zu bauen.

ist die eventbasierte Netzwerk-Engine hinter Scrapy. Zwar keine Scraping-Bibliothek im engeren Sinne, aber fortgeschrittene Nutzer können Twisted direkt nutzen, um eigene Crawler, nicht-HTTP-Protokolle oder hochgradig parallele Spider zu bauen.

Twisted ist mächtig, aber die Lernkurve ist steil. Am besten für sehr individuelle Anforderungen oder wenn du Frameworks von Grund auf bauen willst.

Wichtige Funktionen:

- Eventbasiertes Networking für HTTP, WebSockets, SSH und mehr

- Unterstützt SSL, Parallelität und eigene Protokolle

- Das Herzstück von Scrapys asynchronem Motor

- Extrem flexibel für Spezialfälle

Ideal für: Eigene Protokolle, Framework-Entwicklung und fortgeschrittene Nutzer mit hohen Ansprüchen.

11. Grab

ist ein All-in-One-Scraping-Toolkit, das HTTP-Anfragen, Parsing, Automatisierung, Proxy-Rotation und CAPTCHA-Handling vereint. Es ähnelt Scrapy, ist aber leichter zu erlernen und bietet von Haus aus Proxies, Caching und asynchrone Spider.

ist ein All-in-One-Scraping-Toolkit, das HTTP-Anfragen, Parsing, Automatisierung, Proxy-Rotation und CAPTCHA-Handling vereint. Es ähnelt Scrapy, ist aber leichter zu erlernen und bietet von Haus aus Proxies, Caching und asynchrone Spider.

Das Highlight ist das Grab:Spider-System, das tausende Anfragen parallel per multicurl abwickeln kann. Wer eine Komplettlösung mit weniger Setup als Scrapy sucht, sollte Grab ausprobieren.

Wichtige Funktionen:

- Integrierte Unterstützung für Proxies, User-Agent-Rotation und Caching

- Asynchrones Spider-System für hohe Parallelität

- XPath-Parsing und modulare Architektur

- Wird produktiv für große Scraping-Projekte eingesetzt

Ideal für: Komplettlösungen, Proxy-intensive Aufgaben und Nutzer, die Power ohne Scrapys Komplexität wollen.

12. Urllib3

ist die Low-Level-HTTP-Engine, auf der viele Python-Clients (u.a. Requests) aufbauen. Sie bietet Connection-Pooling, Thread-Sicherheit, Wiederholungen und feine Kontrolle über HTTP-Verbindungen. Die meisten nutzen urllib3 indirekt, aber für maximale Performance oder eigene Bibliotheken ist es die erste Wahl.

ist die Low-Level-HTTP-Engine, auf der viele Python-Clients (u.a. Requests) aufbauen. Sie bietet Connection-Pooling, Thread-Sicherheit, Wiederholungen und feine Kontrolle über HTTP-Verbindungen. Die meisten nutzen urllib3 indirekt, aber für maximale Performance oder eigene Bibliotheken ist es die erste Wahl.

Nicht ganz so einsteigerfreundlich wie Requests, aber extrem robust und bewährt.

Wichtige Funktionen:

- Connection-Pooling und Thread-Sicherheit

- Feine Kontrolle über HTTP-Verbindungen

- Grundlage vieler anderer Bibliotheken

- Hohe Performance bei wiederholten Anfragen

Ideal für: Eigene HTTP-Clients, Multi-Threaded-Crawler und Entwickler, die auf dem Python-HTTP-Stack aufbauen.

Vergleichstabelle: python web scraping pakete im Überblick

| Paket | Benutzerfreundlichkeit | Performance | Dynamische Inhalte | Parsing-Power | Community/Doku | Ideal für |

|---|---|---|---|---|---|---|

| Thunderbit | ★★★★☆ (GUI/KI) | Schnell (Cloud/Lokal) | Ja (per KI) | Auto-Felder, Unterseiten | Wächst (KI-Trend) | Lead-Gen, Marktforschung, No-Code-Nutzer |

| Beautiful Soup | ★★★★★ (sehr einfach) | Mittel | Nein | HTML/XML, fehlertolerant | Riesig | Statische Seiten, Einsteiger |

| Scrapy | ★★☆☆☆ (anspruchsvoll) | ★★★★★ (sehr hoch) | Plugins nur | CSS/XPath, Pipelines | Groß, aktiv | Großprojekte, wiederkehrendes Scraping |

| Selenium | ★★☆☆☆ (mittel) | ★☆☆☆☆ (langsam) | Ja (vollständig) | Vollständiges DOM, JS | Ausgereift | JS-lastige, interaktive Seiten |

| PyQuery | ★★★★☆ (jQuery) | Schnell (lxml) | Nein* | jQuery-Selektoren | Mittel | Prototyping, jQuery-Entwickler |

| LXML | ★★★☆☆ (fortgeschritten) | ★★★★★ (am schnellsten) | Nein | XPath/CSS, XML | Mittel | Große Dokumente, fortgeschrittene Abfragen |

| Requests | ★★★★★ (sehr einfach) | ★★☆☆☆ (synchron) | Nein | HTTP, JSON | Riesig | Einfache Skripte, statische Seiten |

| MechanicalSoup | ★★★★☆ (einfach) | ★★☆☆☆ (synchron) | Nein | Formulare, Navigation | Klein | Login-Flows, Formular-Automatisierung |

| Aiohttp | ★★☆☆☆ (async) | ★★★★★ (parallel) | Nein | Async HTTP | Groß (async) | Hochgeschwindigkeits-, paralleles Scraping |

| Twisted | ★☆☆☆☆ (komplex) | ★★★★★ (individuell) | Nein | Networking, Protokolle | Nische | Eigene Frameworks, fortgeschrittene Nutzer |

| Grab | ★★★☆☆ (modular) | ★★★★☆ (async) | Nein | Proxies, XPath | Klein | Komplettlösungen, Proxy/Captcha-intensiv |

| Urllib3 | ★★★★☆ (Low-Level) | ★★★★☆ (gepoolt) | Nein | HTTP, Pooling | Riesig | Eigene Clients, Multi-Threaded-Crawler |

*PyQuery kann mit Selenium für dynamische Seiten kombiniert werden.

Wie du das richtige python web scraping paket auswählst

Welches Paket passt zu deinem Vorhaben? Hier mein Spickzettel:

- Statische Seiten, kleine Aufgaben oder Scraping-Neulinge: Starte mit Requests + Beautiful Soup.

- Großprojekte, wiederkehrende oder produktive Scraping-Jobs: Scrapy oder Grab (für Komplettlösungen).

- JavaScript-lastige oder interaktive Seiten: Selenium (oder Thunderbit für KI-gestütztes, No-Code-Scraping).

- Hochgeschwindigkeits-, paralleles Scraping: Aiohttp (wenn du mit async vertraut bist).

- Formular-Automatisierung oder Login-Flows: MechanicalSoup (für einfache Seiten), Selenium (für komplexes JS).

- Fortgeschrittenes Parsing oder riesige Dokumente: LXML oder PyQuery.

- Eigene Protokolle oder Netzwerk-Features: Twisted.

- Schnelles Prototyping, Lead-Gen oder chaotische/unstrukturierte Daten: Thunderbit.

Scheue dich nicht, Tools zu kombinieren – viele Workflows nutzen mehrere Pakete für maximale Effizienz. Zum Beispiel kannst du mit Selenium eine Seite rendern und das HTML dann mit Beautiful Soup oder PyQuery parsen.

Fazit: Mit den richtigen Python-Tools Web Scraping aufs nächste Level bringen

Web Scraping ist 2026 mächtiger – und wichtiger – als je zuvor. Mit den passenden python web scraping pakete verwandelst du das Chaos des Internets in saubere, nutzbare Daten für dein Business, deine Forschung oder deine nächste große Idee. Egal, ob du erfahrener Entwickler bist oder gerade erst einsteigst: In dieser Liste findest du das passende Tool.

Du willst sehen, wie KI-gestütztes, No-Code-Scraping aussieht? . Und wenn du noch mehr Tipps, Deep Dives und Tutorials suchst, schau im vorbei – für alles rund um Web Scraping, Automatisierung und datengetriebene Workflows.

Viel Erfolg beim Scraping – möge dein Selector immer passen, deine Proxies nie ausfallen und deine Daten so sauber sein wie dein Code.

FAQs

1. Welches python web scraping paket ist am besten für Einsteiger?

Für die meisten Anfänger ist die Kombination aus und der einfachste Einstieg. Beide bieten intuitive APIs, viele Tutorials und meistern die meisten Aufgaben auf statischen Seiten.

2. Wie kann ich JavaScript-lastige Websites mit Python scrapen?

Nutze zur Automatisierung eines echten Browsers oder probiere für KI-gestütztes, No-Code-Scraping, das auch dynamische Inhalte verarbeitet. Für große Projekte kann Scrapy mit Splash oder Selenium kombiniert werden.

3. Welches Paket eignet sich für groß angelegtes, schnelles Scraping?

ist für große, asynchrone Crawls gemacht. Wer noch mehr Geschwindigkeit will und mit async vertraut ist, sollte für parallele Anfragen nutzen.

4. Kann ich diese Pakete in meinem Workflow kombinieren?

Absolut! Viele Entwickler nutzen Requests oder Selenium zum Laden der Seiten und parsen dann mit Beautiful Soup, lxml oder PyQuery. Thunderbits Exporte lassen sich problemlos in Python-Skripte für weitere Analysen einbinden.

5. Ist Thunderbit eine Python-Bibliothek oder ein eigenständiges Tool?

Thunderbit ist eine KI-gestützte Chrome-Erweiterung und Plattform, keine klassische Python-Bibliothek. Die Ergebnisse (CSV, Excel, Sheets, Notion, Airtable) lassen sich aber nahtlos in Python-Datenpipelines integrieren – ein starker Begleiter für Python-Entwickler.

Du willst beim Web Scraping immer einen Schritt voraus sein? Abonniere den und behalte den für weitere Guides, Vergleiche und Automatisierungstipps im Auge.

Mehr erfahren