Letzte Woche schickte mir ein Kollege einen 47-seitigen Lieferantenvertrag und bat mich, „einfach die Preis-Tabellen in eine Tabelle zu übernehmen“. Ich starrte drei Sekunden lang auf das PDF, bevor ich es schloss und stattdessen einen PDF-Scraper öffnete. Dieser Reflex kam nicht von Faulheit, sondern aus jahrelanger Erfahrung mit Menschen, die ganze Nachmittage damit verbringen, Daten aus Dateien herauszuziehen, die nie dafür gedacht waren, sie wieder herzugeben.

Auch die Zahlen machen die Frustration deutlich. Eine Umfrage von Airbase unter aus dem Jahr 2024 ergab, dass 38 % der Teams mehr als ein Viertel ihrer gesamten Zeit mit manuellen Aufgaben verbringen. Der AP-Automatisierungsbericht von SAP Concur ergänzt, dass in ERP- oder Buchhaltungssystemen immer noch per Hand erfasst werden.

PDFs sind überall – Rechnungen, Verträge, Finanzberichte, gescannte Belege – und viel zu viel davon wird immer noch per Copy-and-paste verarbeitet. Im Jahr 2026 reicht die Spanne der PDF-Scraper von kostenlosen Python-Bibliotheken bis zu KI-gestützten No-Code-Tools, und die falsche Wahl kann dich Tage kosten statt sie dir einzusparen. Ich habe 12 der besten PDF-Scraper mit Blick auf Tabellenextraktion, OCR, Preisgestaltung und Bedienbarkeit getestet, damit du in wenigen Minuten das passende Tool findest.

Was ist ein PDF-Scraper – und warum solltest du dich darum kümmern?

Ein PDF-Scraper ist Software, die Text, Tabellen, Felder und strukturierte Daten automatisch aus PDF-Dateien extrahiert. Wenn du schon einmal versucht hast, eine Tabelle aus einem PDF nach Excel zu kopieren und dabei die Spalten zu einer einzigen unleserlichen Zeile zusammengefallen sind, kennst du das Problem bereits.

PDF-Scraper und Web-Scraper werden ständig durcheinandergebracht, daher hilft eine kurze Unterscheidung. Ein Web-Scraper liest HTML, das wenigstens einige strukturelle Tags enthält – Überschriften, Tabellen, Divs. Ein PDF-Scraper beginnt mit einem visuellen Seitenbeschreibungsformat. Adobes eigene Dokumentation macht klar: konsistent über Geräte hinweg zu bewahren, nicht saubere Tabellen- oder semantische Strukturen offenzulegen. Deshalb zerstört Copy-and-paste Zeilen, Spalten und Lesereihenfolge.

Wo spart PDF-Scraping tatsächlich Zeit?

- Rechnungsverarbeitung: Lieferantennamen, Rechnungs-IDs, Summen, Steuern und Positionen extrahieren

- Finanzberichte: Tabellen aus Jahresberichten, Abschlüssen und Offenlegungen herausziehen

- Gescanntes Material: Kontaktdaten oder Transaktionsdaten aus bildbasierten PDFs rekonstruieren

- Altbestände migrieren: Alte Archive in durchsuchbare, strukturierte Datensätze umwandeln

Die geschäftliche Wirkung geht über einen einzelnen Workflow hinaus. Gartner veranschlagt schlechte Datenqualität weiterhin mit durchschnittlich für Unternehmen. Und im Februar 2025 erklärte Gartner, dass entweder keine passenden Data-Management-Praktiken für KI haben oder sich nicht sicher sind, ob sie diese haben. Bis 2026 werde man laut Gartner 60 % der KI-Projekte aufgeben, die nicht durch KI-bereite Daten unterstützt werden. Wenn PDFs nach wie vor einen großen Teil der Rohdaten enthalten, ist die Qualität der Dokumentenextraktion heute direkt mit der KI-Bereitschaft verknüpft.

Adobes Umfrage unter Finanzfachleuten aus dem Jahr 2025 ergab, dass und 64 % sie regelmäßig unterschreiben. Die PDF Association weist außerdem darauf hin, dass PDF in den CommonCrawl-Daten als eingestuft wurde. PDFs werden also nicht verschwinden.

Wie wir die besten PDF-Scraper bewertet haben

Bevor wir in die Tools einsteigen, hier das Raster, das ich verwendet habe. Die acht Kriterien unten spiegeln direkt die Schmerzpunkte wider, die ich am häufigsten in Foren, GitHub-Issues und Produktbewertungen sehe:

| Kriterium | Was es misst | Warum Nutzer sich darum kümmern |

|---|---|---|

| Unterstützte PDF-Typen | Nativer Text, gescannt/nur Bild, gemischt | Viele Tools scheitern, bevor die Extraktion überhaupt beginnt |

| Genauigkeit der Tabellenextraktion | Einfache, rahmenlose, mehrseitige, zusammengeführte Tabellen | Die häufigste Beschwerde bei der PDF-Extraktion |

| OCR-Fähigkeit | Integriert, als Zusatz oder gar nicht | Gescannte PDFs sind ohne OCR unbrauchbar |

| Ausgabe-/Exportformate | Excel, CSV, JSON, Sheets, Notion, APIs | Daten sind wertlos, wenn sie das Tool nicht sauber verlassen können |

| Einrichtungsaufwand | No-Code, Low-Code oder Code-first | Teams brauchen sehr unterschiedliche Kontrollniveaus |

| Preise / Gratisstufe | Öffentlicher Preis, Testphase, realistischer Einstieg | Abrechnungsmodelle unterscheiden sich extrem |

| Automatisierung / Integrationen | Zapier, API, Zeitpläne, Webhooks | Manuelle Exporte skalieren nicht |

| Bester Anwendungsfall | Worin das Tool tatsächlich gut ist | Die meisten Tools sind nicht universell gut, sondern workflow-spezifisch |

Damit es übersichtlich bleibt, fallen die 12 Tools in drei Kategorien: KI-No-Code-Scraper, vorlagenbasierte bzw. SaaS-Dokumentenparser und Entwicklerbibliotheken / APIs / Open-Source-Tools.

Die 12 besten PDF-Scraper im Überblick

Hier ist der Gesamtvergleich, damit du nach deinem Profil scannen und direkt zum passenden Abschnitt springen kannst:

| Tool | Typ | Tabellenextraktion | OCR integriert | No-Code | Gratisstufe | Am besten für |

|---|---|---|---|---|---|---|

| Thunderbit | KI-No-Code-Scraper | ✅ KI-gestützt | ✅ Ja | ✅ Ja | ✅ Gratis-Credits | Business-Anwender, unterschiedliche Layouts |

| Tabula | Open-Source-Desktop | ✅ Gut (Text-PDFs) | ❌ Nein | ✅ GUI | ✅ Komplett kostenlos | Einfache, tabellenlastige Text-PDFs |

| Parseur | Hybrides SaaS | ⚠️ Vorlage + KI | ✅ Ja | ✅ Ja | ⚠️ Eingeschränkt | Wiederkehrende Rechnungs-/E-Mail-Extraktion |

| Nanonets | KI-IDP-SaaS | ✅ Stark | ✅ Ja | ✅ Low-Code | ⚠️ Test-Credits | Dokumentenautomatisierung mit hohem Volumen |

| Adobe Acrobat | PDF-Produktivitätssuite | ⚠️ Grundlegend | ✅ Ja | ✅ Ja | ❌ Export kostenpflichtig | Gelegentliches PDF-zu-Excel |

| PyMuPDF | Python-Bibliothek | ⚠️ Manuelle Analyse | ❌ Nein (Tesseract optional) | ❌ Code erforderlich | ✅ Komplett kostenlos | Entwickler, textlastige PDFs |

| Camelot | Python-Tabellenbibliothek | ✅ Stark (lattice + stream) | ❌ Nein | ❌ Code erforderlich | ✅ Komplett kostenlos | Entwickler, komplexe Tabellen |

| Docparser | Vorlagen-SaaS | ⚠️ Vorlagenbasiert | ✅ Ja | ✅ Ja | ⚠️ Testphase | Wiederkehrende Dokumente + Zapier-Workflows |

| pdfplumber | Python-Bibliothek | ✅ Gut (feingranular) | ❌ Nein | ❌ Code erforderlich | ✅ Komplett kostenlos | Entwickler, detaillierte Kontrolle |

| AWS Textract | Cloud-API | ✅ Stark | ✅ Ja | ❌ API erforderlich | ⚠️ Eingeschränkte Gratisstufe | Unternehmensweite Pipelines |

| Docling | Open-Source-Python | ✅ Gut | ✅ Über Integration | ❌ Code erforderlich | ✅ Komplett kostenlos | LLM-/RAG-Pipelines |

| Parsio | Hybrides SaaS | ⚠️ KI-unterstützt | ✅ Ja | ✅ Ja | ⚠️ Eingeschränkt | Wiederkehrende Dokumenttypen |

Du willst keine Einrichtung? Dann beginne mit den No-Code- oder SaaS-Zeilen. Du brauchst maximale Kontrolle? Dann starte bei den Entwickler-Tools. Arbeitest du mit gescannten PDFs? Streiche jede Zeile, bei der OCR = Nein ist.

1. Thunderbit

ist der PDF-Scraper, den ich jedem in die Hand drücken würde, der sagt: „Ich brauche nur die Daten aus diesem PDF“ und nichts von Python, Vorlagen oder API-Keys hören will. Es ist ein KI-Webdaten-Agent – eine Chrome-Erweiterung –, die PDFs, Bilder und Websites liest und strukturierte Daten ausgibt. Keine Vorlagen, kein Code.

ist der PDF-Scraper, den ich jedem in die Hand drücken würde, der sagt: „Ich brauche nur die Daten aus diesem PDF“ und nichts von Python, Vorlagen oder API-Keys hören will. Es ist ein KI-Webdaten-Agent – eine Chrome-Erweiterung –, die PDFs, Bilder und Websites liest und strukturierte Daten ausgibt. Keine Vorlagen, kein Code.

Wir haben Thunderbit genau für den Fall gebaut, an dem die meisten Tools scheitern: Du bekommst PDFs von fünf verschiedenen Lieferanten, jedes mit leicht anderem Layout, und brauchst aus allen dieselben Felder. Die KI liest jedes Dokument frisch ein, schlägt über die Funktion „AI Suggest Fields“ Spaltennamen und Datentypen vor und extrahiert die Daten in eine strukturierte Tabelle. Die integrierte OCR verarbeitet gescannte PDFs und Bilder nativ, mit Unterstützung für .

Wichtige Funktionen:

- AI Suggest Fields erkennt automatisch Spalten und Datentypen aus jedem PDF-Layout – ganz ohne manuelle Konfiguration

- Integrierte OCR für gescannte PDFs und Bilder

- Exporte nach Excel, Google Sheets, Airtable, Notion, CSV und JSON – alles kostenlos

- KI-Labeling und Umformatierung: Die KI kann extrahierte Daten während der Extraktion übersetzen, kategorisieren oder umstrukturieren, nicht erst danach

- Tabellenextraktion liest das Layout visuell wie ein Mensch und passt sich rahmenlosen, unregelmäßigen und herstellerübergreifenden Formaten an

So extrahierst du ein PDF mit Thunderbit:

- Installiere die

- Öffne oder lade dein PDF im Browser hoch

- Klicke auf „AI Suggest Fields“ – die KI liest das Dokument und schlägt Spaltennamen und Typen vor

- Klicke auf „Scrape“ – die Daten werden in eine strukturierte Tabelle extrahiert

- Exportiere nach Google Sheets, Excel, Airtable, Notion, CSV oder JSON

Preis: Gratisstufe mit Credits (etwa 6 Seiten kostenlos, 10 mit Testphase). Starter-Plan ab ca. 15 $/Monat oder etwa 9 $/Monat bei jährlicher Abrechnung. Credits sind zeilenbasiert (1 Credit = 1 Ausgabzeile). Details siehe .

Am besten für: Nicht-technische Nutzer, die mit unterschiedlichen PDF-Layouts arbeiten (Rechnungen mehrerer Anbieter, Berichte in Mischformaten) und in 2 Klicks Ergebnisse wollen.

Vorteile: Einfachstes Setup in dieser Liste; integrierte OCR; direkte Exporte zu Sheets, Notion, Airtable und Excel; funktioniert ohne Vorlagen mit unterschiedlichen Layouts.

Nachteile: Die Credit-basierte Abrechnung braucht einen Moment, um sie auf Seitenkosten herunterzubrechen; weniger Drittanbieter-Bewertungen als bei größeren SaaS-Anbietern.

2. Tabula

ist die klassische kostenlose Antwort für die Tabellenextraktion aus textbasierten PDFs – und gleichzeitig inzwischen eindeutig ein Legacy-Projekt. Im Repo steht, dass es von Freiwilligen gepflegt wird, und die Desktop-Anwendung . Die letzte Desktop-Version ist immer noch 1.2.1 aus dem Jahr 2018, während tabula-java zuletzt veröffentlicht hat.

ist die klassische kostenlose Antwort für die Tabellenextraktion aus textbasierten PDFs – und gleichzeitig inzwischen eindeutig ein Legacy-Projekt. Im Repo steht, dass es von Freiwilligen gepflegt wird, und die Desktop-Anwendung . Die letzte Desktop-Version ist immer noch 1.2.1 aus dem Jahr 2018, während tabula-java zuletzt veröffentlicht hat.

Wichtige Funktionen:

- Point-and-Click-GUI zur Auswahl von Tabellenbereichen

- Läuft lokal – Daten verlassen deinen Rechner nie

- Kein Konto, kein Abo, keine Registrierung

Preis: Komplett kostenlos, für immer. Open Source.

Am besten für: Nutzer mit einfachen, textbasierten PDFs und klar umrandeten Tabellen, die eine kostenlose lokale Lösung suchen.

Vorteile: Kostenlos; lokal; für grundlegende Tabellen kinderleicht.

Nachteile: Keine OCR (gescannte PDFs sind ein No-Go); schwach bei rahmenlosen Tabellen; keine Automatisierung oder API; keine Cloud-Option; faktisch nicht mehr gepflegt.

3. Parseur

ist im SaaS-Umfeld der stärkste Hybrid, weil es KI-Parsing, Vorlagen-Parsing und kombiniert. Das macht es flexibler als einen reinen Zonen-Parser, aber immer noch strukturierter als einen voll allgemeinen KI-Scraper.

ist im SaaS-Umfeld der stärkste Hybrid, weil es KI-Parsing, Vorlagen-Parsing und kombiniert. Das macht es flexibler als einen reinen Zonen-Parser, aber immer noch strukturierter als einen voll allgemeinen KI-Scraper.

Wichtige Funktionen:

- Integrierte OCR mit Unterstützung für (160+ experimentell)

- Integrationen mit Zapier, Make, Power Automate, API, Webhooks, Google Sheets

- Gut geeignet für Rechnungen, Lieferavis, Auftragsbestätigungen und wiederkehrende Dokumenttypen

Preis: Gratisstufe mit etwa 20 Seiten/Monat. Die niedrigste bezahlte Self-Service-Stufe liegt bei rund . Die normalisierten Kosten auf dem kleinsten Plan liegen ungefähr bei 390 $ pro 1.000 Seiten, wobei die effektiven Kosten bei höherem Volumen sinken.

Am besten für: Teams, die regelmäßig dieselben Dokumenttypen erhalten und Automatisierung ohne Code wollen.

Vorteile: Integrierte OCR; starke Automatisierung; funktioniert gut mit wiederkehrenden Layouts.

Nachteile: Jedes neue oder driftende Layout kann Vorlagenarbeit oder KI-Fallback erfordern; komplexe Tabellenstrukturen bleiben schwieriger.

4. Nanonets

ist eher eine Plattform für intelligente Dokumentenverarbeitung (IDP) als ein einfacher PDF-Scraper – und genau das ist zugleich ihre Stärke und ihre Komplexität. Das Unternehmen und stellte von einem einfachen seitenbasierten Plan auf vorausbezahlte Usage-Credits um.

ist eher eine Plattform für intelligente Dokumentenverarbeitung (IDP) als ein einfacher PDF-Scraper – und genau das ist zugleich ihre Stärke und ihre Komplexität. Das Unternehmen und stellte von einem einfachen seitenbasierten Plan auf vorausbezahlte Usage-Credits um.

Wichtige Funktionen:

- KI-gestützte Tabellenextraktion und Felderkennung

- Integrierte OCR mit Unterstützung für

- Workflow-Automatisierung mit Freigabeschritten

- Breiter Enterprise-Integrationsstack

Preis: Credits bei der Anmeldung. Nutzungsbasiertes Modell. Eine grobe Schätzung auf Basis der liegt bei etwa 300–380 $ pro 1.000 Seiten für einen einfachen Extraktions-Workflow.

Am besten für: Mittelgroße bis große Teams, die monatlich Tausende Dokumente verarbeiten (AP-Automatisierung, Logistik, Versicherungsansprüche).

Vorteile: Starke KI-Extraktion; Enterprise-Integrationen; Workflow-Automatisierung.

Nachteile: Preise sind schwerer vorherzusagen; Lernkurve für fortgeschrittene Workflows; eingeschränkte Gratisstufe.

5. Adobe Acrobat

ist das Standard-PDF-Tool, das fast jeder kennt. Es ist stark bei OCR und Konvertierung, aber im selben Sinn wie die übrigen Tools auf dieser Liste eigentlich kein echter Scraper.

ist das Standard-PDF-Tool, das fast jeder kennt. Es ist stark bei OCR und Konvertierung, aber im selben Sinn wie die übrigen Tools auf dieser Liste eigentlich kein echter Scraper.

Wichtige Funktionen:

- In Pro integrierte OCR

- Export nach Word, Excel, PowerPoint, HTML, TXT und Bildformaten

- Breite OCR-Unterstützung für viele Sprachen

Preis: Acrobat Standard ab ; Acrobat Pro für 19,99 $/Monat. Reader ist kostenlos, aber Exportfunktionen erfordern einen kostenpflichtigen Plan.

Am besten für: Nutzer, die gelegentlich ein PDF in Word oder Excel umwandeln müssen und bereits ein Adobe-Abo haben.

Vorteile: Weit verbreitet und vertrauenswürdig; integrierte OCR; viele Nutzer haben es ohnehin schon.

Nachteile: Die Tabellenextraktion ist bei komplexen Layouts nur grundlegend; keine Automatisierung oder API für Batch-Verarbeitung; nicht als „Scraper“ konzipiert.

6. PyMuPDF

(auch bekannt als „fitz“) bleibt die schnellste allgemeine Python-Bibliothek zur PDF-Extraktion in diesem Vergleich. Die aktuelle Version ist , und zeigen weiterhin, dass sie deutlich schneller ist als viele andere Python-PDF-Bibliotheken.

(auch bekannt als „fitz“) bleibt die schnellste allgemeine Python-Bibliothek zur PDF-Extraktion in diesem Vergleich. Die aktuelle Version ist , und zeigen weiterhin, dass sie deutlich schneller ist als viele andere Python-PDF-Bibliotheken.

Wichtige Funktionen:

- Extrem schnelle Rohtext-Extraktion

- Bildextraktion und Metadatenzugriff

- Optionale OCR über Tesseract (die Doku weist allerdings darauf hin, dass OCR etwa ist als die Standardextraktion)

- Tabellenerkennung über

find_tables()

Preis: Komplett kostenlos, Open Source.

Am besten für: Entwickler, die Pipelines bauen und hauptsächlich mit textlastigen, nativen PDFs arbeiten.

Vorteile: Sehr schnell; leichtgewichtig; aktive Community; starke Textextraktion.

Nachteile: Keine integrierte OCR; Tabellenextraktion erfordert manuelle Parsing-Logik; Code erforderlich.

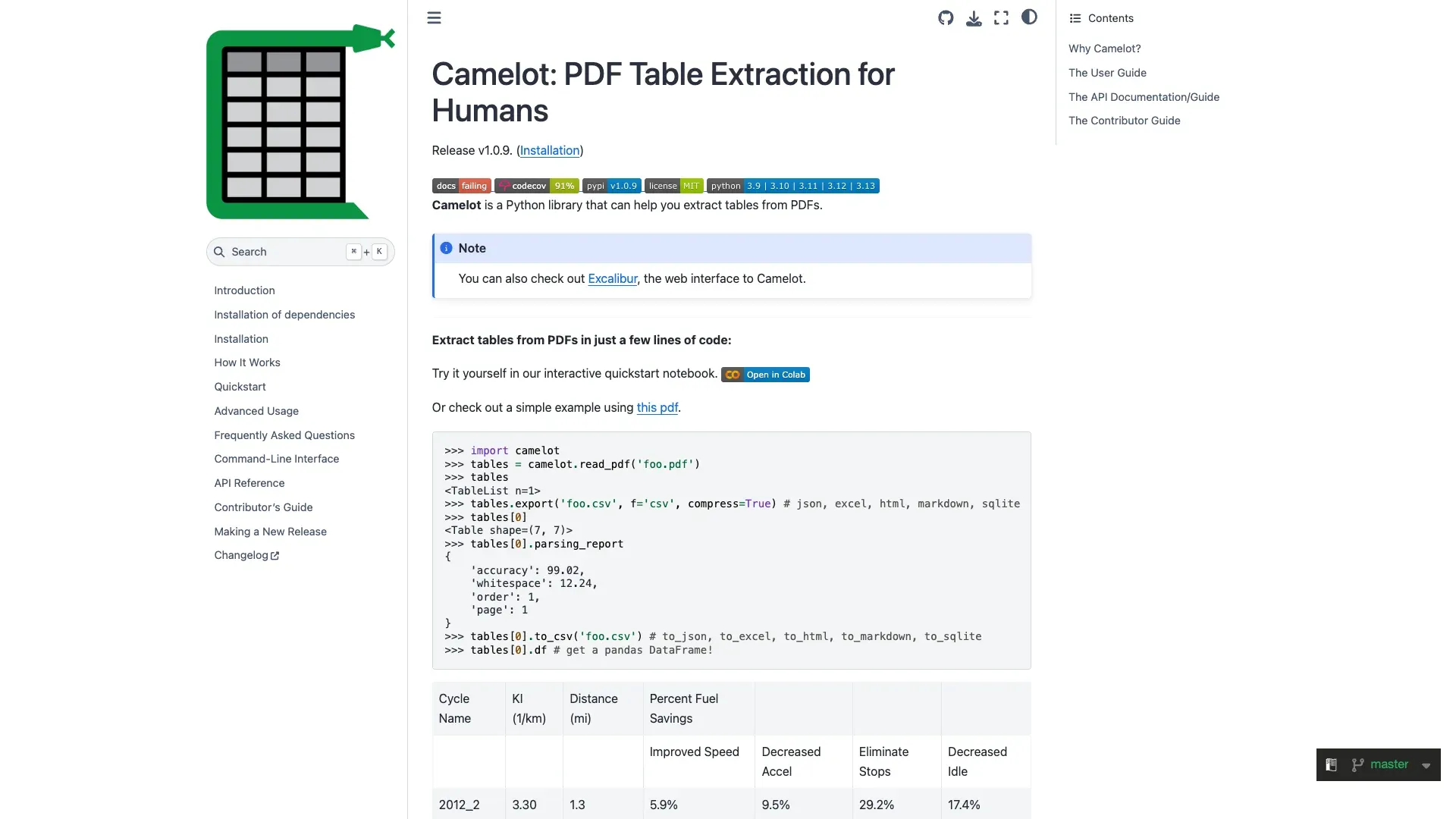

7. Camelot

ist nach wie vor eines der bekanntesten Python-Tools für die Tabellenextraktion, weil es zuerst für Tabellen und nicht für allgemeine Dokumente gebaut wurde. Das aktuelle Repo wird gepflegt, mit .

ist nach wie vor eines der bekanntesten Python-Tools für die Tabellenextraktion, weil es zuerst für Tabellen und nicht für allgemeine Dokumente gebaut wurde. Das aktuelle Repo wird gepflegt, mit .

Wichtige Funktionen:

- Zwei Extraktionsmodi:

latticefür umrandete Tabellen,streamfür rahmenlose bzw. Leerraum-Tabellen - Genauigkeitsmetriken im – eine der nützlichsten Funktionen von Camelot für Automatisierungs-Workflows

- Ausgabe nach pandas DataFrames, CSV, JSON und Excel

Preis: Komplett kostenlos, Open Source.

Am besten für: Entwickler, die präzise Tabellenextraktion aus strukturierten, textbasierten PDFs brauchen.

Vorteile: Hervorragende Tabellenpräzision; zwei Extraktionsmodi; Genauigkeitsbewertung.

Nachteile: Keine OCR; nur textbasierte PDFs; Code erforderlich; kann bei großen Dokumenten langsam sein.

8. Docparser

ist das am klarsten regelbasierte SaaS-Tool in diesem Set. Es nutzt zonale OCR, Ankerbegriffe und feste Parsing-Regeln statt so zu tun, als sei es ein allzweckfähiger KI-Leser für beliebige Layouts.

ist das am klarsten regelbasierte SaaS-Tool in diesem Set. Es nutzt zonale OCR, Ankerbegriffe und feste Parsing-Regeln statt so zu tun, als sei es ein allzweckfähiger KI-Leser für beliebige Layouts.

Wichtige Funktionen:

- Integrierte OCR

- Integrationen mit Zapier, Workato, Power Automate, Google Sheets, Salesforce und REST API

- Gut geeignet, um extrahierte Daten in Business-Workflows zu routen

Preis: ; Professional für 74 $/Monat; Business für 159 $/Monat. 14-tägige kostenlose Testphase. Abrechnung pro Dokument, daher hängt der normalisierte Preis pro 1.000 Seiten von der Dokumentlänge ab – in der Starter-Stufe ungefähr 78–390 $.

Am besten für: Teams, die wiederkehrende Dokumenten-Workflows mit enger Integration in Tools wie Zapier oder Salesforce automatisieren müssen.

Vorteile: Integrierte OCR; starke Workflow-Integrationen; gut für stabile Layouts.

Nachteile: Vorlagenbasiert – jedes neue Layout erfordert Einrichtung; die Tabellenextraktion hängt von Zonen-Definitionen ab; am stärksten auf Seite 1.

9. pdfplumber

bleibt die granularste Entwicklerbibliothek in diesem Set. Die aktuelle Version ist , und das Repo sagt, es befinde sich in aktiver Entwicklung.

bleibt die granularste Entwicklerbibliothek in diesem Set. Die aktuelle Version ist , und das Repo sagt, es befinde sich in aktiver Entwicklung.

Wichtige Funktionen:

- Feingranulare Kontrolle über Zeichenobjekte, Linien, Rechtecke und Strategien für die Tabellenerkennung

- Zuschneidungsbasiertes Filtern und visuelles Debugging

- Ausgabe der Daten als Python-Listen/Dicts zur einfachen Weiterverarbeitung

Preis: Komplett kostenlos, Open Source.

Am besten für: Python-Entwickler, die detaillierte, anpassbare Tabellenextraktionslogik brauchen.

Vorteile: Hervorragende Low-Level-Kontrolle; gute Genauigkeit bei komplexen Tabellen; aktive Entwicklung.

Nachteile: Keine OCR; steilere Lernkurve als Camelot; Code erforderlich.

10. AWS Textract

ist die am stärksten auf Unternehmen ausgerichtete API in dieser Liste. Sie ist für Skalierung, Dokumentenvielfalt und programmgesteuerten Einsatz gebaut – nicht für GUI-Komfort.

ist die am stärksten auf Unternehmen ausgerichtete API in dieser Liste. Sie ist für Skalierung, Dokumentenvielfalt und programmgesteuerten Einsatz gebaut – nicht für GUI-Komfort.

Wichtige Funktionen:

- KI-gestützte Tabellen- und Formularextraktion

- Integrierte OCR mit Handschrift-Unterstützung (am nächsten an dieser Liste, aber weiterhin unvollkommen)

- Enterprise-taugliche Skalierbarkeit

- Saubere Integration in das AWS-Ökosystem

Preis: . Gratisstufe: 1.000 Seiten/Monat für 3 Monate. Danach: Text-OCR für 1,50 $/1.000 Seiten; Tabellen für 15 $/1.000 Seiten; Formulare + Tabellen für 65 $/1.000 Seiten; Ausgaben-Dokumente für 10 $/1.000 Seiten.

Am besten für: Enterprise-Teams, die 10.000+ Dokumente pro Monat über eine API-Pipeline verarbeiten.

Vorteile: Präzise Formular- und Tabellenextraktion; integrierte OCR; Enterprise-Skalierbarkeit.

Nachteile: Nur API; keine visuelle Oberfläche; Kosten steigen bei erweiterten Modi schnell; starke Bindung an das AWS-Ökosystem.

11. Docling

ist hier das zukunftsorientierteste Open-Source-Tool, weil es direkt auf Dokument-zu-LLM-Pipelines ausgerichtet ist. Die aktuelle Version ist , und das Projekt entwickelt sich schnell weiter.

ist hier das zukunftsorientierteste Open-Source-Tool, weil es direkt auf Dokument-zu-LLM-Pipelines ausgerichtet ist. Die aktuelle Version ist , und das Projekt entwickelt sich schnell weiter.

Wichtige Funktionen:

- Ausgabe nach Markdown, HTML, WebVTT, DocTags und verlustfreiem JSON

- OCR-Unterstützung über

- Für LangChain, LlamaIndex, CrewAI, Haystack und ähnliche Ökosysteme gebaut

- Starkes Community-Wachstum

Preis: Komplett kostenlos, Open Source.

Am besten für: Entwickler, die LLM-/RAG-Anwendungen bauen und PDFs in strukturiertes, KI-bereites Markdown umwandeln müssen.

Vorteile: Saubere Markdown-Ausgabe; OCR über Integration; für moderne KI-Workflows gebaut; aktive Entwicklung.

Nachteile: Code erforderlich; primär für Entwickler gedacht; weniger ausgereifte GUI- oder Exportoptionen als bei SaaS-Tools.

12. Parsio

ist ein hybrider SaaS-Parser, der Vorlagen, OCR, KI-Parsing und GPT-gestütztes Parsing kombiniert. Vom Grundgedanken her liegt es zwischen Parseur und Docparser: flexibler als reine Zonenlösungen, aber immer noch optimiert für wiederkehrenden Dokumenteneingang.

ist ein hybrider SaaS-Parser, der Vorlagen, OCR, KI-Parsing und GPT-gestütztes Parsing kombiniert. Vom Grundgedanken her liegt es zwischen Parseur und Docparser: flexibler als reine Zonenlösungen, aber immer noch optimiert für wiederkehrenden Dokumenteneingang.

Wichtige Funktionen:

- Integrierte OCR

- KI-gestützte Felderkennung

- Integrationen mit Google Sheets, Webhooks, API, Zapier, Make, n8n, Pabbly

Preis: . Starter für 41 $/Monat mit 1.000 Credits; Growth für 124 $/Monat; Business für 249 $/Monat. Ein geparstes Dokument oder eine PDF-Seite kann je nach Parser-Modus 1, 2 oder 5 Credits kosten, daher liegt die normalisierte Schätzung im Starter-Plan ungefähr bei 41–205 $ pro 1.000 Seiten.

Am besten für: Kleine bis mittelgroße Teams, die wiederkehrende Dokumenttypen (Rechnungen, Belege) verarbeiten und eine No-Code-SaaS-Lösung mit etwas KI wollen.

Vorteile: Integrierte OCR; breite Abdeckung von Dokumenttypen; breiter Automatisierungsstack.

Nachteile: Die Tiefe der Drittanbieter-Bewertungen ist gering; die Preislogik wird über verschiedene Parser-Modi hinweg weniger transparent; nicht so klar positioniert wie Parseur oder Nanonets.

Tabellenextraktion im Duell: Wie die besten PDF-Scraper mit echten Tabellen umgehen

Die Tabellenextraktion ist der am häufigsten diskutierte Schmerzpunkt unter PDF-Scraper-Nutzern – und das aus gutem Grund. Neuere Benchmarks wie (1.651 Seiten über 10 Dokumenttypen) und wissenschaftliche Arbeiten zur bestätigen, dass „Tabellenextraktion“ keine einheitliche Aufgabe ist. Sie ist ein Spektrum.

Einfache Tabellen (klare Rahmen, eine Seite)

Die meisten Tools kommen damit gut zurecht. Tabula, Camelot, pdfplumber, Thunderbit und AWS Textract liefern hier alle gute Ergebnisse. Wenn deine PDFs nur einfache umrandete Tabellen enthalten, funktioniert fast jedes Tool auf dieser Liste.

Rahmenlose Tabellen und Tabellen mit viel Leerraum

Hier wird der Unterschied deutlich. Ohne Linien haben regelbasierte Parser Schwierigkeiten, Spaltengrenzen zu erkennen. Der stream-Modus von Camelot und die Feinjustierung eigener Parameter in pdfplumber sind stark für Entwickler, die Einstellungen präzise anpassen können. KI-gestützte Tools wie Thunderbit, Nanonets und AWS Textract interpretieren das Layout visuell, was für Nicht-Entwickler mit inkonsistenten Formaten meist besser funktioniert.

Mehrseitig verlaufende Tabellen

Ein häufiger Fehlerfall. Vorlagentools und einfache Extraktoren behandeln jede Seite oft als separate Tabelle, sofern der Workflow sie nicht ausdrücklich wieder zusammenführt. KI-first-Tools haben hier einen Vorteil, weil sie Kontinuität semantisch statt nur geometrisch interpretieren können – auch wenn kein Anbieter in dieser Problemklasse perfekt ist.

Zusammengeführte Zellen und verschachtelte Überschriften

Das schwierigste Szenario. Die berichtet F1-Werte zwischen 74,2 und 96,1, abhängig von Methode und Szenario. KI-gestützte Tools (Thunderbit, Nanonets, AWS Textract) schneiden hier tendenziell besser ab als regelbasierte Parser, weil sie das Layout semantisch interpretieren statt sich auf Linien zu verlassen.

OCR im Vergleich: Welche PDF-Scraper verarbeiten gescannte Dokumente?

OCR ist die Trennlinie zwischen Tools, die echte Geschäftspdfs verarbeiten können, und Tools, die nur idealisierte, maschinell erzeugte Dokumente beherrschen. Hier ist die Matrix:

| Tool | OCR nativ | Unterstützung für gescannte PDFs | OCR für mehrere Sprachen | Unterstützung für Handschrift |

|---|---|---|---|---|

| Thunderbit | ✅ Integriert | ✅ Ja | ✅ 34 Sprachen | ⚠️ Eingeschränkt |

| Adobe Acrobat | ✅ Integriert | ✅ Ja | ✅ Stark | ⚠️ Eingeschränkt |

| AWS Textract | ✅ Integriert | ✅ Ja | ✅ Mehrere große Sprachen | ✅ Am nächsten dran, aber unvollkommen |

| Nanonets | ✅ Integriert | ✅ Ja | ✅ 40+ Sprachen | ⚠️ Eingeschränkt |

| Parseur | ✅ Integriert | ✅ Ja | ✅ Über 60 Sprachen | ❌ Nein |

| Parsio | ✅ Integriert | ✅ Ja | ✅ Mehrsprachig | ⚠️ Eingeschränkt |

| Docparser | ✅ Integriert | ✅ Ja | ✅ Ja | ⚠️ Eingeschränkt |

| Docling | ✅ Über Integration | ✅ Ja | Hängt von der Engine ab | ⚠️ Eingeschränkt |

| Tabula | ❌ Keine | ❌ Nein | N/A | N/A |

| PyMuPDF | ❌ Nein (Tesseract optional) | ❌ Erfordert Zusatzmodul | Hängt von der Engine ab | Hängt von der Engine ab |

| Camelot | ❌ Keine | ❌ Nein | N/A | N/A |

| pdfplumber | ❌ Keine | ❌ Nein | N/A | N/A |

Kein Tool verarbeitet Handschrift 2026 in allen Fällen zuverlässig. AWS Textract ist die am ehesten geeignete Enterprise-API, aber Handschrift bleibt eine Funktion, die man mit Vorsicht einsetzen sollte. Wenn deine PDFs gescannt, aber getippt sind, reicht dir jedes Tool mit integrierter OCR. Wenn sie handschriftlich sind, setze realistische Erwartungen.

KI-gestützt vs. regelbasiert vs. vorlagenbasiert: Drei Generationen des PDF-Scrapings

Der einfachste Weg, den PDF-Scraper-Markt 2026 zu verstehen, ist in drei Generationen:

Generation 1: Regelbasiert (Tabula, Camelot, pdfplumber)

Diese funktionieren am besten bei strukturierten, textbasierten PDFs mit konsistentem Layout. In den Händen von Entwicklern sind sie leistungsstark, bei wechselnden Layouts aber fragil. Wenn deine Dokumente vorhersehbar sind, sind sie weiterhin hervorragend – und kostenlos.

Generation 2: Vorlagenbasiert (Parseur, Docparser, Parsio)

Nutzer definieren Zonen oder Felder pro Dokumenttyp. Ideal für wiederkehrende Formate wie Rechnungen desselben Anbieters. Der Haken: Jedes neue Layout oder jede Layout-Verschiebung erfordert Einrichtung oder Pflege.

Generation 3: KI-/LLM-gestützt (Thunderbit, Nanonets, AWS Textract, Docling für LLM-Pipelines)

Die KI liest das Dokument semantisch, passt sich neuen Layouts ohne Vorlagen an und kann Daten gleichzeitig markieren und umwandeln. In diese Richtung entwickelt sich der Markt. Die und die zeigen beide in Richtung LLM- und agentenbasierter Extraktion als nächsten Standard.

Für Nicht-Techniker ist das praktisch relevant: Wenn deine PDFs aus vielen verschiedenen Quellen kommen (Lieferanten, Partner, Kunden), werden vorlagenbasierte Tools schnell zur Wartungsaufgabe. KI-gestützte Tools kommen mit Vielfalt direkt out of the box zurecht. Genau für diese Nische wurde Thunderbit gebaut – für Business-Anwender mit vielfältigen PDFs und ohne Interesse daran, Python zu schreiben oder Extraktionsvorlagen zu pflegen.

Preisübersicht: Was die besten PDF-Scraper tatsächlich kosten

Das ist der Vergleich, den sonst niemand veröffentlicht – und der, nach dem Nutzer am meisten fragen. Hier ist die ehrliche Sicht:

| Tool | Gratisstufe | Startpreis bezahlt | Geschätzte Kosten pro 1.000 Seiten | Open Source? |

|---|---|---|---|---|

| Thunderbit | ✅ Gratis-Credits | ca. 15 $/Monat (9 $/Monat jährlich) | ca. 18–30 $ | Nein |

| Tabula | ✅ Unbegrenzt | Für immer kostenlos | 0 $ | Ja |

| Camelot | ✅ Unbegrenzt | Für immer kostenlos | 0 $ | Ja |

| PyMuPDF | ✅ Unbegrenzt | Für immer kostenlos | 0 $ | Ja |

| pdfplumber | ✅ Unbegrenzt | Für immer kostenlos | 0 $ | Ja |

| Docling | ✅ Unbegrenzt | Für immer kostenlos | 0 $ | Ja |

| Parseur | ⚠️ ca. 20 Seiten/Monat | ca. 39 $/Monat | ca. 390 $ (niedrigste Stufe) | Nein |

| Nanonets | ⚠️ Credits bei Anmeldung | Nutzungsbasiert | ca. 300–380 $ | Nein |

| Docparser | ⚠️ 14-tägige Testphase | 39 $/Monat | ca. 78–390 $ | Nein |

| Parsio | ⚠️ 30 Credits | 41 $/Monat | ca. 41–205 $ | Nein |

| Adobe Acrobat | ❌ (Export ist kostenpflichtig) | 19,99 $/Monat Pro | Nicht seitenbasiert | Nein |

| AWS Textract | ⚠️ 1.000 Seiten/Monat (3 Monate) | Pay-per-Use | 1,50–65 $ | Nein |

Der versteckte Kostenfaktor ist wichtiger als der Listenpreis. Open-Source-Python-Tools kosten zwar nichts in Dollar, aber sie kosten Entwicklerzeit für Einrichtung, Wartung und Debugging. Vorlagenbasierte SaaS-Tools sind bei geringer Varianz unkompliziert, aber teuer, wenn Layouts abweichen. KI-No-Code-Tools wie Thunderbit kosten Credits pro Zeile, reduzieren aber den Einrichtungsaufwand drastisch. Cloud-APIs wie AWS Textract sind im großen Maßstab am günstigsten – allerdings nur, wenn du bereits über Engineering-Ressourcen verfügst.

Wenn ich an die „echten Kosten“ denke, rechne ich auch das Gehalt der Person mit ein, die die Arbeit erledigt. Eine Stunde Zeit eines Data Analysts für das Konfigurieren von Vorlagen oder das Schreiben von Python ist nicht kostenlos, selbst wenn die Software es ist.

Welchen PDF-Scraper solltest du wählen?

Hier ist ein kurzer Entscheidungsleitfaden:

| Deine Situation | Empfohlene(s) Tool(s) |

|---|---|

| Nicht-technisch, unterschiedliche PDF-Layouts, schnelle Ergebnisse gewünscht | Thunderbit, Nanonets |

| Wiederkehrende Rechnungen/Belege im gleichen Format | Parseur, Docparser, Parsio |

| Entwickler baut eine Datenpipeline | PyMuPDF, Camelot, pdfplumber |

| Enterprise, 10.000+ Dokumente/Monat, API nötig | AWS Textract, Nanonets |

| LLM-/RAG-Anwendung bauen | Docling |

| Gelegentlich PDF zu Excel, Adobe bereits vorhanden | Adobe Acrobat |

| Kostenlos, lokal, tabellenfokussiert, ohne Code | Tabula |

Wenn du ein Business-Anwender bist, der einfach Daten aus PDFs herausbekommen will, ohne Code zu schreiben oder Vorlagen einzurichten, fang mit Thunderbit an. Es liest jedes PDF frisch mit KI ein und exportiert in die Tools, die du bereits nutzt. Wenn deine Dokumente in wiedererkennbaren Layouts wiederkehren, sind Parseur oder Docparser die bessere Wahl. Und wenn du Engineering-Kontrolle willst, bleibt der Open-Source-Stack die Kostenuntergrenze.

Fazit

PDF-Scraping ist 2026 kein einzelnes Problem mehr mit einer einzigen Antwort. Das richtige Tool hängt davon ab, ob du Entwickler, Business-Analyst oder ein Enterprise-Team bist – und ob deine PDFs saubere Textdateien oder chaotische Scans von einem Dutzend Anbietern sind.

Wenn du sehen willst, wie KI-gestützte PDF-Extraktion in der Praxis aussieht, probiere die aus. Ich glaube, du wirst überrascht sein, wie viel du mit nur wenigen Klicks aus einem PDF herausholen kannst. Und wenn Thunderbit nicht perfekt passt, teste ein paar andere Tools aus dieser Liste. Es gab nie einen besseren Zeitpunkt, mit Copy-and-paste aus PDFs aufzuhören und die Daten darin wirklich zu nutzen.

Mehr zu Datenextraktion und Automatisierung findest du in unseren Leitfäden zum , zu den , zu und dazu, . Außerdem kannst du dir Schritt-für-Schritt-Anleitungen auf dem ansehen.

FAQs

1. Was ist der beste kostenlose PDF-Scraper?

Für Nicht-Entwickler ist Tabula das einfachste komplett kostenlose GUI-Tool für textbasierte PDF-Tabellen. Für Entwickler sind Camelot, pdfplumber, PyMuPDF und Docling allesamt starke kostenlose Optionen. Für eine No-Code-Option mit Gratisstufe ist Thunderbit der beste Ausgangspunkt.

2. Können PDF-Scraper gescannte Dokumente verarbeiten?

Nur Tools mit integrierter OCR können gescannte PDFs direkt verarbeiten. Dazu gehören Thunderbit, Adobe Acrobat, AWS Textract, Nanonets, Parseur, Docparser, Parsio und Docling (mit integrierten OCR-Engines). Tabula, Camelot und pdfplumber können gescannte PDFs nicht allein verarbeiten – sie brauchen externe OCR wie Tesseract.

3. Wie genau ist die Tabellenextraktion aus PDFs?

Das hängt stark von der Tabellenkomplexität ab. Die meisten Tools verarbeiten einfache umrandete Tabellen gut. Rahmenlose Tabellen, zusammengeführte Zellen und mehrseitige Tabellen sind deutlich schwieriger. KI-gestützte Tools wie Thunderbit, Nanonets und AWS Textract übertreffen regelbasierte Parser bei unterschiedlichen Layouts meist, während regelbasierte Tools bei stabilen, textbasierten PDFs weiterhin ausgezeichnet sein können.

4. Brauche ich Programmierkenntnisse, um PDFs zu scrapen?

Nein. Tools wie Thunderbit, Parseur, Docparser, Parsio, Nanonets und Adobe Acrobat lassen sich ohne Code verwenden. Auch Tabula hat eine GUI. Python-Bibliotheken wie PyMuPDF, Camelot, pdfplumber und Docling erfordern Code.

5. Kann ich PDF-Daten direkt nach Excel oder Google Sheets exportieren?

Die meisten Tools unterstützen mindestens den Export nach CSV oder Excel. Thunderbit exportiert außerdem kostenlos direkt nach Google Sheets, Airtable und Notion. Parseur, Docparser und Parsio unterstützen Exporte in Business-Workflows über Integrationen wie Zapier, Webhooks und APIs.

Mehr erfahren