Fast die Hälfte des gesamten Internetverkehrs besteht inzwischen aus Bots. Die meisten von ihnen scrapen Links, Daten und URLs in großem Umfang. Wenn Sie das noch manuell machen, verlieren Sie schnell den Anschluss.

Ich habe 12 Link-Extraktor-Tools getestet – von KI-gestützten Chrome-Erweiterungen bis hin zu Python-Bibliotheken –, um herauszufinden, welche wirklich liefern, wenn Tausende URLs schnell extrahiert werden müssen.

Das ist mein Fazit.

Warum Link-Extraktoren wichtig sind

Ganz ehrlich: Das Web ist voller Daten, und Unternehmen wollen aus diesem Chaos verwertbare Erkenntnisse machen. und sind heute unverzichtbar für Teams, die:

- Leads generieren: Vertriebsteams können in Minuten Unternehmensprofile aus Verzeichnissen oder LinkedIn ziehen und diese URLs anschließend in Tools einspeisen, um Kontaktdaten zu extrahieren. Schluss mit endlosem Klicken.

- Inhalte bündeln und SEO verbessern: Marketingteams können alle Artikel-URLs aus einem Blog sammeln, Backlinks von Wettbewerbern überwachen oder die Seitenstruktur auf defekte Links prüfen.

- Wettbewerber beobachten und Marktanalysen durchführen: Operations-Teams können automatisch Links zu neuen Produkten, Preis-Seiten oder Pressemitteilungen erfassen – und so den Wettbewerb im Blick behalten, ohne ins Schwitzen zu geraten.

- Workflows automatisieren und Zeit sparen: Moderne Link-Scraper verarbeiten große URL-Mengen, crawlen Unterseiten und exportieren Daten in strukturierte Formate (CSV, Excel, Google Sheets, Notion, ganz nach Bedarf). Das bedeutet: kein Copy-Paste-Marathon und keine chaotischen Textdateien mehr.

Angesichts der Tatsache, dass , ist das manuell keine Option. Der richtige Link-Extraktor ist wie ein hochgezüchteter Assistent, der nie müde wird, keinen Link verpasst und nie eine Kaffeepause braucht.

Wie wir die besten Link-Extraktoren ausgewählt haben

Bei so vielen Tools da draußen kann sich die Wahl des richtigen Link-Extraktors anfühlen wie Speed-Dating auf einer Tech-Konferenz – alle versprechen, „der Richtige“ zu sein, aber nur wenige halten wirklich, was sie versprechen. So habe ich die Top 12 eingegrenzt:

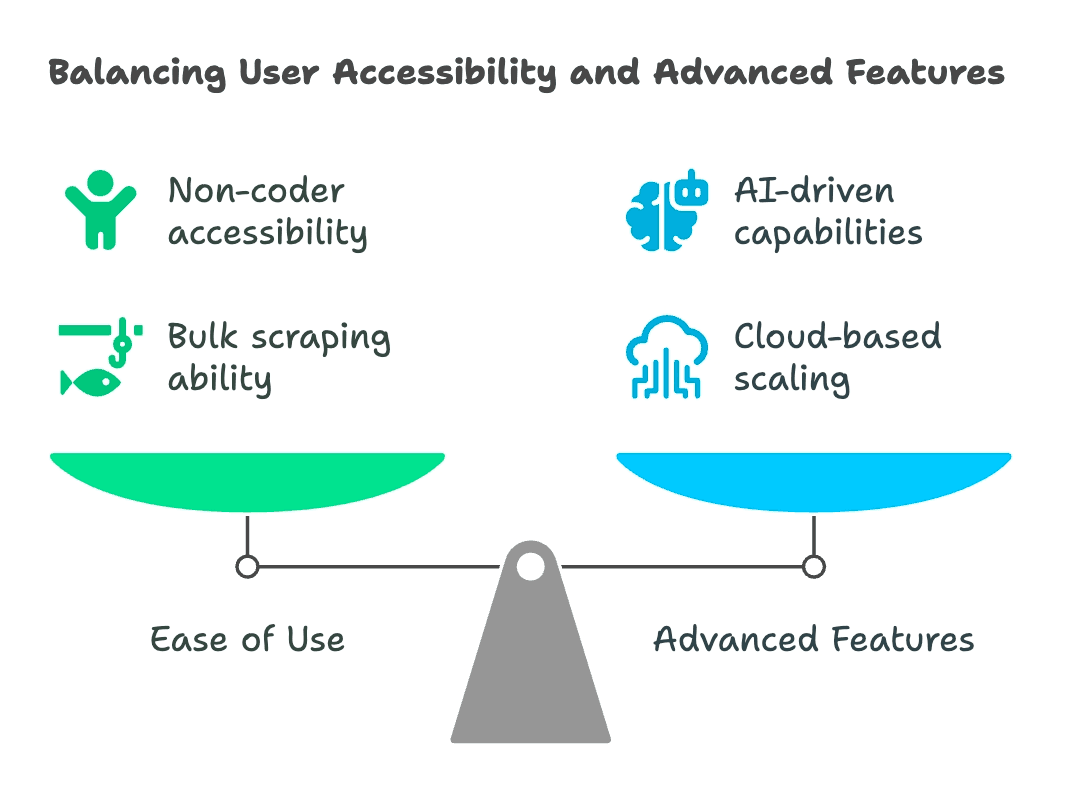

- Einfachheit: Können auch Nicht-Programmierer damit arbeiten, ohne einen PhD in Regex zu haben? No-Code- und Low-Code-Lösungen bekamen Extra-Punkte.

- Bulk- und Multi-Level-Scraping: Kann das Tool Hunderte URLs auf einmal verarbeiten? Crawlt es Unterseiten und folgt Links automatisch?

- Export & Integration: Exportiert es nach CSV, Excel, Google Sheets, Notion, Airtable oder per API? Je weniger Handarbeit, desto besser.

- Benutzertyp & Flexibilität: Ist es für Business-Anwender, Analysten oder Entwickler gedacht? Manche Tools sind für alle gebaut, andere eher für Nischen.

- Erweiterte Funktionen: KI-gestützte Erkennung, Zeitplanung, cloudbasiertes Skalieren, Datenbereinigung und Vorlagen für gängige Seiten.

- Preis & Skalierbarkeit: Kostenloses Kontingent, Pay-as-you-go oder Enterprise? Ich habe mir angesehen, was man fürs Geld bekommt.

Ich habe alles aufgenommen – von Browser-Erweiterungen bis hin zu Enterprise-Plattformen. Egal, ob Sie Solo-Founder oder Teil eines Data-Teams bei Fortune 500 sind, hier sollte etwas Passendes dabei sein.

Thunderbit: Der intelligenteste Link-Extraktor für Business-Anwender

Fangen wir ganz oben an. ist meine erste Empfehlung für Link-Extraktion – und nicht nur, weil ich selbst daran mitgebaut habe. Thunderbit ist eine , die für Business-Anwender entwickelt wurde, die schnell Ergebnisse wollen.

Was Thunderbit besonders macht? Es ist, als hätte man einen KI-Praktikanten, der wirklich zuhört. Sie beschreiben einfach in natürlicher Sprache, was Sie möchten („Zieh alle Produktlinks und Preise von dieser Seite“), und die KI von Thunderbit erledigt den Rest. Kein Herumfummeln an Selektoren, kein Schreiben von Scripts.

Aber das war noch nicht alles:

- Unterstützung für Bulk-URLs: Eine einzelne URL oder eine Liste mit Hunderten einfügen – Thunderbit verarbeitet alles in einem Durchgang.

- Navigation auf Unterseiten: Müssen Links von einer Listen-Seite extrahiert und anschließend jede Detailseite für weitere URLs besucht werden? Die mehrschichtige Scraping-Logik von Thunderbit deckt das ab.

- Strukturierter Export: Sobald die Links extrahiert sind, können Sie Felder umbenennen, kategorisieren und direkt nach Google Sheets, Notion, Airtable, Excel oder CSV exportieren. Kein Nachbearbeiten mehr nötig.

Thunderbit wird weltweit von über 30.000 Nutzern vertrauensvoll eingesetzt – von Vertriebsteams über Makler bis hin zu Indie-E-Commerce-Shops. Und ja, es gibt ein (bis zu 6 Seiten, bzw. 10 mit Trial-Boost), sodass Sie es risikofrei ausprobieren können.

Thunderbits herausragende Funktionen

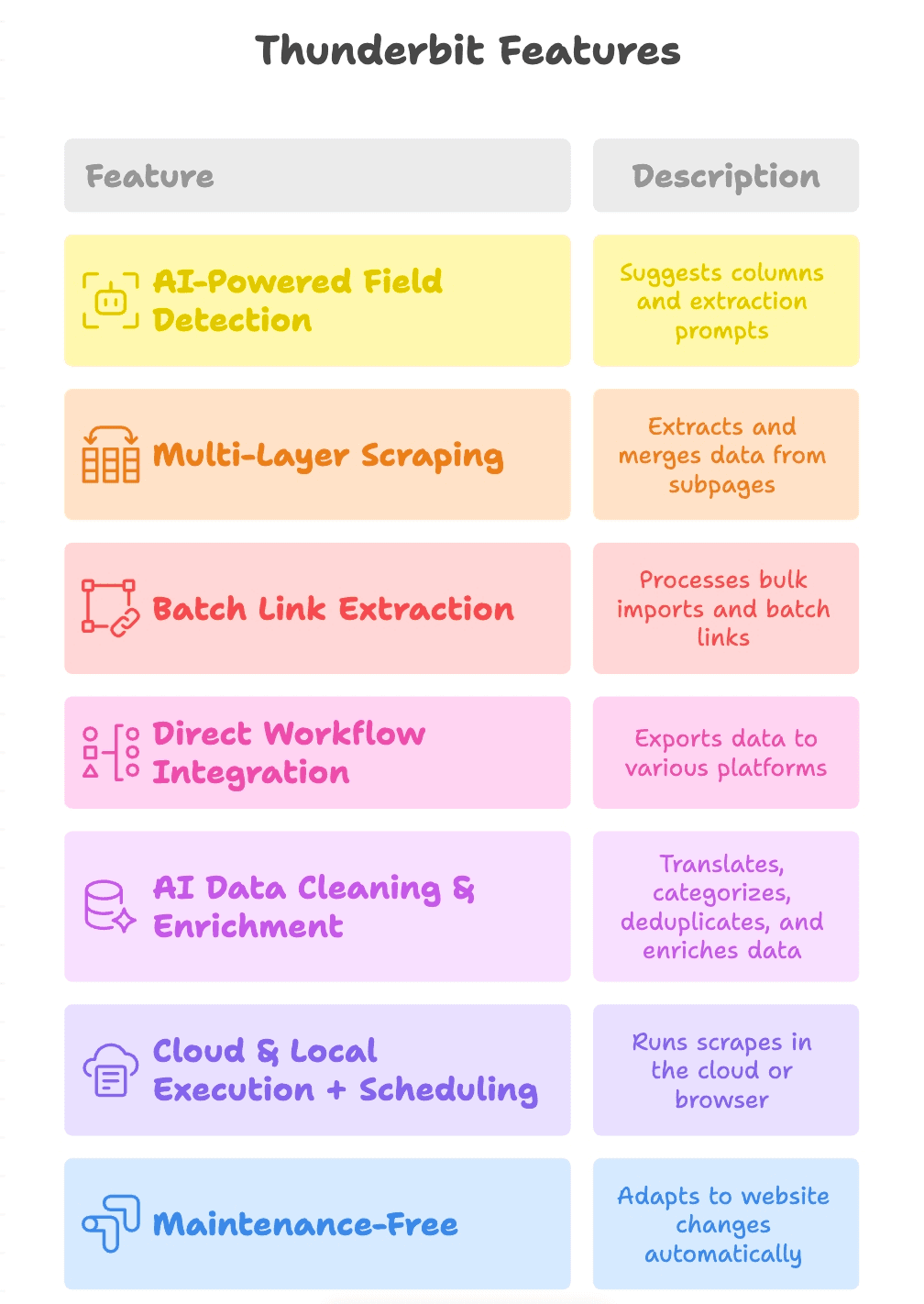

Schauen wir uns an, was Thunderbit wirklich abhebt:

- KI-gestützte Felderkennung: Einfach auf „KI-Felder vorschlagen“ klicken, und Thunderbit liest die Seite, schlägt Spalten vor (etwa „Produktlink“, „PDF-URL“, „Kontakt-E-Mail“) und erstellt sogar Extraktions-Prompts für jedes Feld.

- Mehrschichtiges Scraping: Thunderbit kann Links von einer Hauptseite zu Unterseiten verfolgen (z. B. Produktdetailseiten oder PDF-Downloads), weitere Links extrahieren und alles in einer einzigen Tabelle zusammenführen.

- Batch-Link-Extraktion: Ob eine Seite oder tausend – Thunderbit kann Bulk-Importe und Batch-Extraktion von Links mühelos verarbeiten.

- Direkte Workflow-Integration: Ergebnisse direkt nach Google Sheets, Notion, Airtable exportieren oder als CSV/Excel herunterladen. Ihre Daten landen genau dort, wo Ihr Team sie braucht.

- KI-Datenbereinigung & Anreicherung: Thunderbit kann beim Scraping übersetzen, kategorisieren, deduplizieren und Ihre Daten sogar anreichern – damit das Ergebnis sofort nutzbar ist und nicht nur ein Roh-Dump.

- Cloud- und lokale Ausführung + Zeitplanung: Scrapes in der Cloud für Geschwindigkeit oder im Browser bei Seiten mit Login-Anforderung. Wiederkehrende Jobs planen, damit Ihre Daten aktuell bleiben.

- Wartungsfrei: Die KI von Thunderbit passt sich an Website-Änderungen an, sodass Sie weniger Zeit mit defekten Scrapern verbringen und mehr Zeit mit Ergebnissen.

Octoparse: No-Code-Link-Scraper für alle

ist ein Klassiker in der No-Code-Scraping-Welt. Es handelt sich um eine Desktop-App (Windows/Mac) mit einer visuellen Point-and-Click-Oberfläche. Sie laden eine Webseite, klicken auf die gewünschten Links, und Octoparse erledigt den Rest.

- Ideal für Einsteiger: Kein Code nötig. Einfach klicken, extrahieren, fertig.

- Beherrscht Paginierung & dynamische Inhalte: Octoparse kann auf „Weiter“-Buttons klicken, scrollen und sich sogar auf Websites einloggen.

- Cloud-Scraping & Zeitplanung: Bezahlte Tarife ermöglichen Jobs in der Cloud und wiederkehrende Aufgaben.

- Exportoptionen: Daten als CSV, Excel, JSON herunterladen oder in Datenbanken übertragen.

Der Gratis-Tarif ist für kleinere Jobs großzügig bemessen (bis zu 10 Aufgaben und 50.000 Zeilen/Monat), aber für intensivere Nutzung braucht man einen kostenpflichtigen Plan (ab etwa 75 $/Monat).

Apify: Flexibler URL-Extraktor für individuelle Workflows

ist das Schweizer Taschenmesser des Web-Scrapings. Es bietet einen Marktplatz mit vorgefertigten „Actors“ (Scraping-Tools) sowie die Möglichkeit, eigene Scripts in JavaScript oder Python zu schreiben.

- Vorgefertigt & anpassbar: Community-Actors für gängige Aufgaben nutzen oder eigene Workflows bauen.

- Bulk- & geplantes Scraping: URLs in die Warteschlange stellen, Jobs parallel ausführen und wiederkehrende Scrapes planen.

- API-first: Export nach JSON, CSV, Excel oder Google Sheets und Integration in Ihre Daten-Pipeline.

- Pay-as-you-go: Jeden Monat kostenlose Credits, danach nutzungsbasierte Abrechnung.

Apify ist ideal für semi-technische Teams und Entwickler, die Flexibilität und Skalierbarkeit wollen.

Bright Data URL Scraper: Link-Scraping auf Enterprise-Niveau

ist für Unternehmen gebaut, die in großem Maßstab scrapen müssen. Der Data Collector bietet einen vorgefertigten URL Scraper für Jobs mit hohem Volumen.

- Bewältigt massive Skalierung: Tausende oder Millionen Seiten scrapen – mit robuster Proxy-Infrastruktur, um Sperren zu vermeiden.

- Vordefinierte Vorlagen: Fertige Scraper für E-Commerce, Social Media, Immobilien und mehr.

- Enterprise-Funktionen: Compliance-Tools, Experten-Support und fortgeschrittene Anti-Blocking-Technologie.

- Preis: Ab etwa 350 $ für 100.000 Seitenaufrufe – klar auf größere Unternehmen ausgerichtet.

Für ein Startup ist das womöglich überdimensioniert. Aber für geschäftskritisches Scraping mit hohem Volumen ist Bright Data ein Kraftpaket.

WebHarvy: Visueller Link-Extraktor mit Point-and-Click-Einfachheit

ist eine Desktop-App (Windows), mit der Sie Links scrapen können, indem Sie sie einfach im integrierten Browser anklicken.

- Extrem einfach: Auf einen Link klicken, und WebHarvy markiert alle ähnlichen Elemente zur Extraktion.

- Unterstützung für reguläre Ausdrücke: Integrierte Muster für gängige Aufgaben, kein Code erforderlich.

- Export nach Excel, CSV, JSON, XML, SQL: Ideal für Business-Anwender, die Daten in vertrauten Formaten möchten.

- Einmallizenz: Einmal zahlen, unbegrenzt nutzen.

Perfekt für kleine Unternehmen, Forschende oder alle, die Links schnell und unkompliziert ohne Code extrahieren wollen.

Web Scraper (Chrome-Erweiterung): Schnelles Link-Scraping direkt im Browser

Die ist ein kostenloses Open-Source-Tool, das Ihren Browser in einen Scraper verwandelt.

- Sitemaps definieren: Geben Sie an, wie navigiert und was extrahiert werden soll.

- Beherrscht Paginierung & mehrstufiges Crawling: Kategorien, Unterkategorien und Detailseiten crawlen.

- Export nach CSV/XLSX: Daten direkt aus dem Browser herunterladen.

- Community-Vorlagen: Viele gemeinsam genutzte Sitemaps für beliebte Websites.

Es ist perfekt für schnelle Einmal-Jobs oder für Studierende und kleine Teams mit begrenztem Budget.

ScraperAPI: Skalierbarer Link-Scraper für Entwickler

ist für Entwickler gedacht, die Webseiten im großen Stil abrufen wollen, ohne sich um Proxies, Sperren oder CAPTCHAs kümmern zu müssen.

- API-gesteuert: URL senden, HTML oder extrahierte Daten zurückbekommen.

- Skalierung & Anti-Bot-Maßnahmen: Proxy-Rotation, JavaScript-Rendering und CAPTCHA-Lösung sind integriert.

- Integration in eigenen Code: Nutzbar mit Python, Node.js oder jeder anderen Sprache.

- Preis: Kostenloses Kontingent (~1000 API-Aufrufe), danach Bezahlung pro Anfrage.

Ideal für eigene Crawler oder wenn Sie auf Skalierung Zuverlässigkeit und Tempo brauchen.

ParseHub: Visueller Link-Scraper mit erweiterter Auswahl

ist eine Desktop-App (Windows, Mac, Linux), mit der Sie Scraping-Projekte visuell erstellen können.

- Erweiterte Auswahl & Navigation: Klicken, Schleifen definieren und Links bedingt extrahieren – sogar aus dynamischen oder versteckten Elementen.

- Beherrscht verschachtelte Seiten: Erst Kategorien crawlen, dann Detailseiten und anschließend weitere Links extrahieren.

- Export nach CSV, Excel, JSON: Cloud-Läufe und API-Zugriff in bezahlten Tarifen.

- Gratisplan: 5 Projekte, bis zu 200 Seiten pro Lauf.

ParseHub ist ein Favorit für Marketer und Forschende, die Power ohne Code wollen.

Scrapy: Python-Link-Extraktor für Entwickler

ist der Goldstandard für Python-Entwickler, die volle Kontrolle wollen.

- Code-first: Eigene Spiders bauen, um Links in jeder Größenordnung zu crawlen und zu extrahieren.

- Beherrscht verteiltes Crawling: Effizient, asynchron und hochgradig anpassbar.

- Export nach CSV, JSON, XML oder Datenbank: Sie bestimmen die Ausgabe.

- Open Source & kostenlos: Allerdings müssen Sie Ihre Umgebung selbst verwalten.

Wenn Sie mit Python vertraut sind, ist Scrapy kaum zu übertreffen.

Diffbot: KI-gestützter Link-Scraper für strukturierte Daten

ist das „KI-Gehirn“ des Web-Scrapings. Es analysiert Seiten und liefert strukturierte Daten – inklusive Links – ganz ohne manuelle Einrichtung.

- Automatische Inhaltserkennung: URL einfügen, strukturierte Daten zurückbekommen (Artikel, Produkte, Links usw.).

- Crawlbot & Knowledge Graph: Ganze Websites crawlen oder den riesigen Web-Index abfragen.

- API-gesteuert: Integration in BI-Tools oder Ihre Daten-Pipeline.

- Enterprise-Preise: Ab etwa 299 $/Monat, aber Sie bekommen, wofür Sie zahlen.

Am besten für Unternehmen, die saubere, strukturierte Daten wollen, ohne Scraper zu verwalten.

Cheerio: Leichter Link-Scraper für Node.js

ist ein schneller, jQuery-ähnlicher HTML-Parser für Node.js.

- Extrem schnell: Analysiert HTML in Millisekunden.

- Vertraute Syntax: Wer jQuery kennt, kommt mit Cheerio sofort zurecht.

- Ideal für statische Seiten: Rendert kein JavaScript, ist aber perfekt für serverseitig gerenderte Inhalte.

- Open Source & kostenlos: Für Anfragen mit axios oder fetch kombinieren.

Ideal für Entwickler, die eigene Scripts bauen und dabei Tempo und Einfachheit wollen.

Puppeteer: Browser-Automatisierung für fortgeschrittenes Link-Scraping

ist eine Node.js-Bibliothek zur Steuerung von Chrome im Headless-Modus.

- Vollständige Browser-Automatisierung: Seiten laden, klicken, scrollen und interagieren wie ein echter Nutzer.

- Beherrscht dynamische Inhalte & Logins: Perfekt für JavaScript-lastige Websites oder komplexe Workflows.

- Feingranulare Kontrolle: Auf Elemente warten, Screenshots aufnehmen, Netzwerkanfragen abfangen.

- Open Source & kostenlos: Allerdings ressourcenintensiv und langsamer als leichte Tools.

Nutzen Sie Puppeteer, wenn Sie Links von Websites scrapen müssen, die mit einfachen Scrapern nicht gut zusammenspielen.

Vergleich auf einen Blick: Welcher Link-Extraktor passt zu Ihnen?

Hier ein schneller Vergleich aller 12 Tools:

| Tool | Am besten geeignet für | Bulk- & Unterseiten-Unterstützung | Datenexport-Optionen | Preis |

|---|---|---|---|---|

| Thunderbit | Nicht-Programmierer, Business | Ja (KI, mehrstufig) | Excel, CSV, Sheets, Notion, Airtable | Kostenlos testen, ab ca. 9 $/Monat |

| Octoparse | No-Code-Nutzer, Analysten | Ja | CSV, Excel, JSON, Cloud-Speicher | Gratis-Tarif, ca. 75 $/Monat |

| Apify | Semi-technisch, Entwickler | Ja | CSV, JSON, Sheets via API | Kostenlose Credits, nutzungsbasiert |

| Bright Data | Enterprise | Ja (hohes Volumen) | CSV, JSON, NDJSON via API | ca. 350 $/100k Seiten |

| WebHarvy | Nicht-Programmierer, Desktop | Ja | Excel, CSV, JSON, XML, SQL | Kostenpflichtige Lizenz |

| Web Scraper Extension | Alle, schnell/kostenlos | Ja | CSV, XLSX | Kostenlos, Open Source |

| ScraperAPI | Entwickler, API-Nutzer | Ja | JSON (HTML per API) | 1k Anfragen gratis, kostenpflichtige Stufen |

| ParseHub | Nicht-Programmierer, fortgeschritten | Ja | CSV, Excel, JSON, API | 5 Projekte gratis, kostenpflichtig |

| Scrapy | Entwickler, Python | Ja | CSV, JSON, XML, DB | Kostenlos, Open Source |

| Diffbot | Enterprise, KI | Ja (KI-Crawl) | JSON (strukturierte Daten per API) | ab ca. 299 $/Monat+ |

| Cheerio | Entwickler, Node.js | Ja (Custom Code) | Benutzerdefiniert (JSON usw.) | Kostenlos, Open Source |

| Puppeteer | Entwickler, komplexe Websites | Ja (vollständige Automatisierung) | Benutzerdefiniert (Script-Ausgabe) | Kostenlos, Open Source |

Das richtige Link-Scraper-Tool für Ihr Unternehmen wählen

Wie trifft man also die richtige Wahl? Hier ist meine Kurzfassung:

- Keine Programmierkenntnisse? Starten Sie mit Thunderbit, Octoparse, ParseHub, WebHarvy oder der Web-Scraper-Erweiterung.

- Sie brauchen individuelle Workflows? Apify, ScraperAPI oder Cheerio sind stark für Entwickler.

- Enterprise-Skalierung? Bright Data oder Diffbot sind dafür gebaut.

- Python- oder Node.js-Entwickler? Scrapy (Python) oder Cheerio/Puppeteer (Node.js) geben Ihnen volle Kontrolle.

- Direkter Export nach Sheets/Notion gewünscht? Thunderbit ist die beste Wahl.

Wählen Sie das Tool passend zu Ihrem technischen Komfort, Ihrem Datenvolumen und Ihren Integrationsanforderungen. Die meisten bieten kostenlose Testversionen an – scheuen Sie sich also nicht zu experimentieren.

Thunderbits einzigartiger Mehrwert für Link-Extraktion im Jahr 2026

Kommen wir noch einmal darauf zurück, was Thunderbit wirklich anders macht:

- KI-gestützte Einfachheit: Beschreiben Sie in klarem Deutsch, was Sie möchten – die KI von Thunderbit erledigt den Rest.

- Mehrschichtiges Scraping: Links von Hauptseiten extrahieren, zu Unterseiten folgen und weitere URLs einsammeln – alles in einem Ablauf.

- Bulk-Import & Batch-Verarbeitung: Hunderte URLs einfügen, Links in großen Mengen extrahieren und strukturierte Daten sofort exportieren.

- Workflow-Integration: Direkt nach Google Sheets, Notion, Airtable exportieren oder als CSV/Excel herunterladen.

- Null Wartungsaufwand: Die KI von Thunderbit passt sich an Website-Änderungen an, sodass Sie nicht ständig defekte Scraper reparieren müssen.

Thunderbit überbrückt die Lücke zwischen „einfach Daten scrapen“ und „Daten bekommen, die man wirklich nutzen kann“. Es ist das Tool, das ich mir vor Jahren gewünscht hätte, als ich in manuellen Datentasks versank.

Fazit: Links intelligenter scrapen und Ihren Workflow verbessern

Web-Daten sind der Treibstoff für Unternehmenswachstum – und der richtige Link-Extraktor ist Ihr Motor. Ob Sie Lead-Listen aufbauen, Wettbewerber beobachten oder Recherchen automatisieren: Hier gibt es ein Tool, das zu Ihren Anforderungen und Ihrem Skillset passt.

Wenn Sie sehen möchten, wie moderne Link-Extraktion aussieht, . Ich glaube, Sie werden überrascht sein, wie viel Sie schon mit wenigen Klicks schaffen können. Und falls Thunderbit nicht perfekt passt, testen Sie ein paar andere Tools aus dieser Liste – es gab nie einen besseren Zeitpunkt, langweilige Aufgaben zu automatisieren und sich auf das Wesentliche zu konzentrieren.

Viel Erfolg beim Scrapen – und mögen Ihre Links immer sauber, strukturiert und einsatzbereit sein. Wenn Sie tiefer in Web-Scraping einsteigen möchten, schauen Sie im vorbei, dort finden Sie weitere Anleitungen und Tipps.

FAQs

1. Warum sind Link-Extraktoren so wichtig?

Da fast die Hälfte des Internetverkehrs von Bots stammt und Unternehmen aggressiv Daten scrapen, sind Link-Extraktoren entscheidend, um Web-Chaos in verwertbare Erkenntnisse zu verwandeln. Sie helfen dabei, Aufgaben wie Lead-Generierung, Content-Aggregation, SEO-Audits und Wettbewerbsbeobachtung zu automatisieren und sparen dadurch enorm viel Zeit und Aufwand.

2. Was hebt Thunderbit von anderen Link-Extraktoren ab?

Thunderbit nutzt KI, um das Scraping zu vereinfachen: Beschreiben Sie Ihr Ziel einfach in klarer Sprache, und der Rest läuft automatisch. Das Tool unterstützt Bulk-URL-Eingaben, mehrschichtiges Scraping, intelligente Felderkennung und nahtlosen Export zu Plattformen wie Google Sheets und Notion. Ideal für Nicht-Programmierer und Business-Anwender, die starke Ergebnisse ohne technischen Aufwand wollen.

3. Gibt es Link-Extraktor-Tools für Entwickler und individuelle Workflows?

Ja. Tools wie Apify, ScraperAPI, Cheerio, Puppeteer und Scrapy richten sich an Entwickler. Sie bieten Scripting, API-Integration und die Flexibilität, um komplexe Scraping-Aufgaben, große Jobs und fortgeschrittene Automatisierung zu bewältigen.

4. Welche Tools sind am besten für Nutzer ohne Programmiererfahrung geeignet?

Thunderbit, Octoparse, ParseHub, WebHarvy und die Web-Scraper-Chrome-Erweiterung sind Top-Empfehlungen für nicht-technische Nutzer. Diese Tools bieten visuelle Oberflächen, vorgefertigte Vorlagen und KI-gestützte Funktionen, die Link-Extraktion für alle zugänglich machen.

5. Wie sollte ich den richtigen Link-Extraktor für meine Anforderungen auswählen?

Berücksichtigen Sie Ihre technischen Fähigkeiten, Ihr Datenvolumen und Ihre Exportanforderungen. Nicht-Programmierer sollten Tools wie Thunderbit oder Octoparse wählen, während Entwickler vielleicht Scrapy oder Puppeteer bevorzugen. Unternehmen sollten für große Einsätze Bright Data oder Diffbot in Betracht ziehen. Beginnen Sie immer mit einer kostenlosen Testversion, um herauszufinden, was am besten passt.