Welche Programmiersprache solltest du für Web-Scraping verwenden? Das hängt von deinem Projekt ab – und ich habe schon Entwickler komplett ausrasten sehen, weil sie die falsche Wahl getroffen haben.

Der Markt für Web-Scraping-Software erreichte . Die richtige Sprache kann schnellere Ergebnisse und weniger Wartung bedeuten. Die falsche führt zu kaputten Scrapern und vergeudeten Wochenenden.

Ich baue seit Jahren Automatisierungstools. Hier sind sieben Sprachen, die ich fürs Scraping verwendet habe – mit Code-Snippets, ehrlichen Abwägungen und einem Blick darauf, wann du das Programmieren ganz überspringen und stattdessen nutzen solltest.

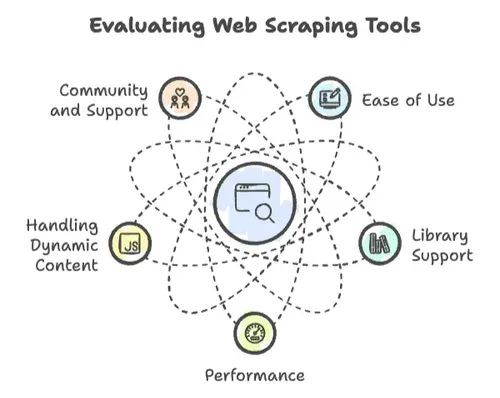

So haben wir die beste Sprache für Web-Scraping ausgewählt

Beim Web-Scraping sind nicht alle Programmiersprachen gleich. Ich habe Projekte anhand einiger zentraler Faktoren glänzen – und scheitern – sehen:

- Einfachheit: Wie schnell bist du startklar? Ist die Syntax angenehm, oder brauchst du einen Doktortitel in Informatik, nur um „Hello, World“ auszugeben?

- Bibliotheksunterstützung: Gibt es robuste Bibliotheken für HTTP-Anfragen, HTML-Parsing und dynamische Inhalte? Oder musst du das Rad neu erfinden?

- Performance: Kann die Sprache Millionen Seiten scrapen, oder ist nach ein paar Hundert Schluss?

- Umgang mit dynamischen Inhalten: Moderne Websites lieben JavaScript. Kommt deine Sprache damit klar?

- Community und Support: Wenn du an eine Wand läufst – und das wirst du – gibt es eine Community, die dir hilft?

Auf Basis dieser Kriterien – und nach vielen Tests bis spät in die Nacht – sind das die sieben Sprachen, die ich hier behandle:

- Python: Die erste Wahl für Einsteiger und Profis.

- JavaScript & Node.js: Der König der dynamischen Inhalte.

- Ruby: Saubere Syntax, schnelle Skripte.

- PHP: Einfache serverseitige Lösung.

- C++: Wenn du rohe Geschwindigkeit brauchst.

- Java: Enterprise-tauglich und skalierbar.

- Go (Golang): Schnell und nebenläufig.

Und falls du denkst: „Shuai, ich will überhaupt nicht coden“, bleib bis zum Ende dran – dann kommt Thunderbit.

Web-Scraping mit Python: Das anfängerfreundliche Kraftpaket

Fangen wir mit dem Publikumsfavoriten an: Python. Frag eine Runde Data-Leute: „Was ist die beste Programmiersprache für Web-Scraping?“, und du wirst Python zurückhallen hören wie einen Chor auf einem Taylor-Swift-Konzert.

Warum Python?

- Anfängerfreundliche Syntax: Python-Code lässt sich fast wie normales Englisch laut lesen.

- Unschlagbare Bibliotheksunterstützung: Von fürs HTML-Parsing über für Crawling im großen Stil bis zu für HTTP und für Browser-Automatisierung – Python hat alles.

- Riesige Community: Allein zu Web-Scraping gibt es über .

Beispielcode in Python: Einen Seitentitel scrapen

1import requests

2from bs4 import BeautifulSoup

3response = requests.get("<https://example.com>")

4soup = BeautifulSoup(response.text, 'html.parser')

5title = soup.title.string

6print(f"Seitentitel: \{title\}")Stärken:

- Schnelle Entwicklung und Prototyping.

- Unmengen an Tutorials und Q&A.

- Stark für Datenanalyse – mit Python scrapen, mit pandas analysieren, mit matplotlib visualisieren.

- Die Bibliotheken entwickeln sich weiter: Scrapy 2.14 (Januar 2026) brachte natives

async/awaitdurch das ganze Framework, sodass asynchrone Workflows nicht mehr nur ein Selenium- oder Playwright-Thema sind.

Grenzen:

- Langsamer als kompilierte Sprachen bei sehr großen Jobs.

- Sehr dynamische Websites können umständlich werden – obwohl Selenium und Playwright helfen.

- Nicht ideal, um Millionen Seiten mit Höchsttempo zu scrapen.

Fazit:

Wenn du neu im Scraping bist oder Dinge einfach schnell erledigen willst, ist Python die beste Sprache für Web-Scraping – ganz klar. .

JavaScript & Node.js: Dynamische Websites mühelos scrapen

Wenn Python das Schweizer Taschenmesser ist, dann ist JavaScript (und Node.js) die Bohrmaschine – vor allem für moderne, stark auf JavaScript basierende Websites.

Warum JavaScript/Node.js?

- Nativ für dynamische Inhalte: Es läuft im Browser und sieht daher, was Nutzer sehen – selbst wenn die Seite mit React, Angular oder Vue gebaut ist.

- Standardmäßig asynchron: Node.js kann Hunderte von Anfragen gleichzeitig jonglieren.

- Vertraut für Webentwickler: Wer schon eine Website gebaut hat, kennt bereits etwas JavaScript.

Wichtige Bibliotheken:

- : Mehrere Browser (Chromium, Firefox, WebKit) mit Auto-Waiting und Proxies pro Kontext. Wenn du 2026 einen neuen Node-Scraper startest, ist das die Standardwahl.

- : Headless Chrome über das Chrome-DevTools-Protokoll. Weiterhin stark für Chrome-only-Jobs und schlankere Abhängigkeiten.

- : jQuery-ähnliches HTML-Parsing für Node, wenn du keinen echten Browser brauchst.

Beispielcode in Node.js: Einen Seitentitel mit Puppeteer scrapen

1const puppeteer = require('puppeteer');

2(async () => {

3 const browser = await puppeteer.launch();

4 const page = await browser.newPage();

5 await page.goto('<https://example.com>', { waitUntil: 'networkidle2' });

6 const title = await page.title();

7 console.log(`Seitentitel: $\{title\}`);

8 await browser.close();

9})();Stärken:

- Kommt nativ mit JavaScript-gerenderten Inhalten klar.

- Ideal für Infinite Scroll, Pop-ups und interaktive Websites.

- Effizient für umfangreiches, paralleles Scraping.

Grenzen:

- Asynchrone Programmierung kann für Einsteiger knifflig sein.

- Headless Browser fressen Speicher, wenn du zu viele gleichzeitig laufen lässt.

- Weniger Werkzeuge für Datenanalyse als bei Python.

Wann ist JavaScript/Node.js die beste Programmiersprache für Web-Scraping?

Wenn deine Zielseite dynamisch ist oder du Browser-Aktionen automatisieren willst. .

Ruby: Saubere Syntax für schnelle Web-Scraping-Skripte

Ruby ist nicht nur für Rails-Apps und elegante Code-Poesie da. Für Web-Scraping ist es eine solide Wahl – besonders, wenn du Code magst, der sich fast wie ein Haiku liest.

Warum Ruby?

- Lesbare, ausdrucksstarke Syntax: Ein Scraper in Ruby ist fast so leicht zu lesen wie deine Einkaufsliste.

- Gut für Prototyping: Schnell geschrieben, leicht anzupassen.

- Wichtige Bibliotheken: fürs Parsing, für automatisierte Navigation.

Beispielcode in Ruby: Einen Seitentitel scrapen

1require 'open-uri'

2require 'nokogiri'

3html = URI.open("<https://example.com>")

4doc = Nokogiri::HTML(html)

5title = doc.at('title').text

6puts "Seitentitel: #\{title\}"Stärken:

- Sehr lesbar und knapp.

- Gut für kleine Projekte, Einmal-Skripte oder wenn du ohnehin Ruby nutzt.

Grenzen:

- Langsamer als Python oder Node.js bei großen Jobs.

- Weniger Scraping-Bibliotheken und weniger Community-Support fürs Scraping.

- Nicht ideal für JavaScript-lastige Websites – auch wenn du Watir oder Selenium verwenden kannst.

Beste Wahl:

Wenn du Ruby ohnehin nutzt oder schnell ein Skript zusammenschustern willst, ist Ruby angenehm. Für massives, dynamisches Scraping solltest du eher woanders suchen.

PHP: Einfache serverseitige Lösung für Webdaten-Extraktion

PHP wirkt vielleicht wie ein Relikt aus den frühen Tagen des Webs, ist aber immer noch im Einsatz – vor allem, wenn du Daten direkt auf deinem Server scrapen willst.

Warum PHP?

- Überall lauffähig: Die meisten Webserver haben PHP ohnehin installiert.

- Leicht in Web-Apps integrierbar: Scrapen und direkt auf deiner Website anzeigen.

- Wichtige Bibliotheken: für HTTP, für Requests, für Headless-Browser-Automatisierung.

Beispielcode in PHP: Einen Seitentitel scrapen

1<?php

2$ch = curl_init("<https://example.com>");

3curl_setopt($ch, CURLOPT_RETURNTRANSFER, true);

4$html = curl_exec($ch);

5curl_close($ch);

6$dom = new DOMDocument();

7@$dom->loadHTML($html);

8$title = $dom->getElementsByTagName("title")->item(0)->nodeValue;

9echo "Seitentitel: $title\n";

10?>Stärken:

- Leicht auf Webservern bereitzustellen.

- Gut für Scraping als Teil eines Web-Workflows.

- Schnell für einfache serverseitige Scraping-Aufgaben.

Grenzen:

- Begrenzte Bibliotheksunterstützung für fortgeschrittenes Scraping.

- Nicht für hohe Parallelität oder Scraping in großem Maßstab gebaut.

- JavaScript-lastige Websites sind schwierig – auch wenn Panther hilft.

Beste Wahl:

Wenn dein Stack ohnehin auf PHP basiert oder du Daten scrapen und direkt auf deiner Website anzeigen willst, ist PHP praktisch. .

C++: Hochleistungs-Web-Scraping für Großprojekte

C++ ist der Muscle Car unter den Programmiersprachen. Wenn du rohe Geschwindigkeit und Kontrolle brauchst und vor etwas Handarbeit nicht zurückschreckst, bringt dich C++ weit.

Warum C++?

- Extrem schnell: Übertrifft die meisten Sprachen bei CPU-lastigen Aufgaben.

- Feingranulare Kontrolle: Speicher, Threads und Performance-Optimierungen selbst verwalten.

- Wichtige Bibliotheken: für HTTP, fürs Parsing.

Beispielcode in C++: Einen Seitentitel scrapen

1#include <curl/curl.h>

2#include <iostream>

3#include <string>

4size_t WriteCallback(void* contents, size_t size, size_t nmemb, void* userp) {

5 std::string* html = static_cast<std::string*>(userp);

6 size_t totalSize = size * nmemb;

7 html->append(static_cast<char*>(contents), totalSize);

8 return totalSize;

9}

10int main() {

11 CURL* curl = curl_easy_init();

12 std::string html;

13 if(curl) {

14 curl_easy_setopt(curl, CURLOPT_URL, "<https://example.com>");

15 curl_easy_setopt(curl, CURLOPT_WRITEFUNCTION, WriteCallback);

16 curl_easy_setopt(curl, CURLOPT_WRITEDATA, &html);

17 CURLcode res = curl_easy_perform(curl);

18 curl_easy_cleanup(curl);

19 }

20 std::size_t startPos = html.find("<title>");

21 std::size_t endPos = html.find("</title>");

22 if(startPos != std::string::npos && endPos != std::string::npos) {

23 startPos += 7;

24 std::string title = html.substr(startPos, endPos - startPos);

25 std::cout << "Seitentitel: " << title << std::endl;

26 } else {

27 std::cout << "Title-Tag nicht gefunden" << std::endl;

28 }

29 return 0;

30}Stärken:

- Unübertroffene Geschwindigkeit bei riesigen Scraping-Jobs.

- Gut geeignet, um Scraping in leistungsstarke Systeme zu integrieren.

Grenzen:

- Steile Lernkurve – Kaffee nicht vergessen.

- Manuelle Speicherverwaltung.

- Begrenzte High-Level-Bibliotheken; nicht ideal für dynamische Inhalte.

Beste Wahl:

Wenn du Millionen Seiten scrapen musst oder Performance absolut kritisch ist. Sonst verbringst du vielleicht mehr Zeit mit Debugging als mit Scraping.

Java: Enterprise-taugliche Web-Scraping-Lösungen

Java ist das Arbeitstier der Enterprise-Welt. Wenn du etwas baust, das ewig laufen, tonnenweise Daten verarbeiten und sogar eine Zombie-Apokalypse überstehen soll, ist Java dein Freund.

Warum Java?

- Robust und skalierbar: Ideal für große, langfristige Scraping-Projekte.

- Starke Typisierung und Fehlerbehandlung: Weniger Überraschungen in der Produktion.

- Wichtige Bibliotheken: fürs Parsing, für Browser-Automatisierung, für HTTP.

Beispielcode in Java: Einen Seitentitel scrapen

1import org.jsoup.Jsoup;

2import org.jsoup.nodes.Document;

3public class ScrapeTitle {

4 public static void main(String[] args) throws Exception {

5 Document doc = Jsoup.connect("<https://example.com>").get();

6 String title = doc.title();

7 System.out.println("Seitentitel: " + title);

8 }

9}Stärken:

- Hohe Performance und Parallelität.

- Sehr gut für große, wartbare Codebasen.

- Gute Unterstützung für dynamische Inhalte (über Selenium oder HtmlUnit).

Grenzen:

- Ausführliche Syntax; mehr Setup als bei Skriptsprachen.

- Für kleine Einmal-Skripte oft überdimensioniert.

Beste Wahl:

Scraping in Enterprise-Größe oder wenn du kompromisslose Zuverlässigkeit und Skalierbarkeit brauchst.

Go (Golang): Schnelles und nebenläufiges Web-Scraping

Go ist der Neuling im Block, sorgt aber schon für Aufsehen – besonders beim schnellen, nebenläufigen Scraping.

Warum Go?

- Kompilierte Geschwindigkeit: Nahezu so schnell wie C++.

- Integrierte Nebenläufigkeit: Goroutines machen paralleles Scraping zum Kinderspiel.

- Wichtige Bibliotheken: fürs Scraping, fürs Parsing.

Beispielcode in Go: Einen Seitentitel scrapen

1package main

2import (

3 "fmt"

4 "github.com/gocolly/colly"

5)

6func main() {

7 c := colly.NewCollector()

8 c.OnHTML("title", func(e *colly.HTMLElement) {

9 fmt.Println("Seitentitel:", e.Text)

10 })

11 err := c.Visit("<https://example.com>")

12 if err != nil {

13 fmt.Println("Fehler:", err)

14 }

15}Stärken:

- Blitzschnell und effizient für Scraping im großen Maßstab.

- Leicht bereitzustellen (eine einzelne Binärdatei).

- Sehr gut für paralleles Crawling.

Grenzen:

- Kleinere Community als Python oder Node.js.

- Weniger High-Level-Scraping-Bibliotheken.

- JavaScript-lastige Websites erfordern zusätzlichen Aufwand (Chromedp oder Selenium).

Beste Wahl:

Wenn du in großem Umfang scrapen musst oder Python einfach nicht schnell genug ist. .

Die besten Programmiersprachen für Web-Scraping im Vergleich

Fassen wir alles zusammen. Hier ist ein direkter Vergleich, der dir hilft, 2026 die beste Sprache für Web-Scraping zu wählen:

| Sprache/Tool | Einfachheit | Performance | Bibliotheksunterstützung | Umgang mit dynamischen Inhalten | Bester Anwendungsfall |

|---|---|---|---|---|---|

| Python | Sehr hoch | Mittel | Hervorragend | Gut (Selenium/Playwright) | Allzweck, Einsteiger, Datenanalyse |

| JavaScript/Node.js | Mittel | Hoch | Stark | Hervorragend (nativ) | Dynamische Sites, asynchrones Scraping, Webentwickler |

| Ruby | Hoch | Mittel | Solide | Begrenzt (Watir) | Schnelle Skripte, Prototyping |

| PHP | Mittel | Mittel | Solide | Begrenzt (Panther) | Server-seitig, Integration in Web-Apps |

| C++ | Niedrig | Sehr hoch | Begrenzt | Sehr begrenzt | Leistungs-kritisch, extrem großer Maßstab |

| Java | Mittel | Hoch | Gut | Gut (Selenium/HtmlUnit) | Enterprise, langlebige Services |

| Go (Golang) | Mittel | Sehr hoch | Wächst | Mittel (Chromedp) | Schnelles, paralleles Scraping |

Wann du auf Code verzichten solltest: Thunderbit als No-Code-Lösung für Web-Scraping

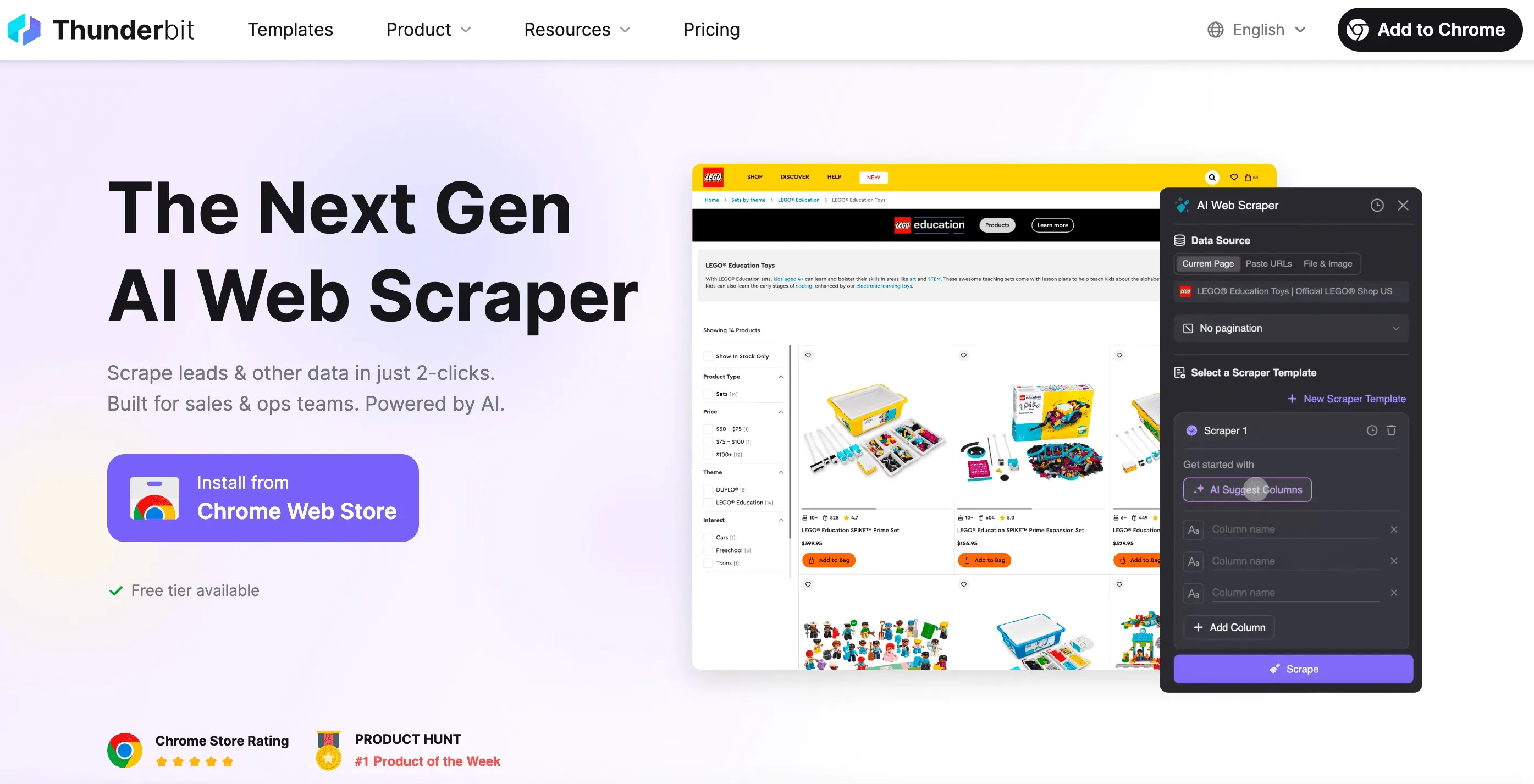

Okay, ehrlich gesagt: Manchmal willst du einfach nur die Daten – ohne Coding, ohne Debugging und ohne das ständige „Warum funktioniert dieser Selector nicht?“. Genau dafür gibt es .

Als Mitgründer von Thunderbit wollte ich ein Tool bauen, das Web-Scraping so einfach macht wie Essen bestellen. Das zeichnet Thunderbit aus:

- Einrichtung in 2 Klicks: Einfach auf „KI-Felder vorschlagen“ und „Scrapen“ klicken. Kein Herumfummeln mit HTTP-Anfragen, Proxys oder Anti-Bot-Tricks.

- Intelligente Vorlagen: Eine Scraper-Vorlage kann sich an mehrere Seitenlayouts anpassen. Du musst deinen Scraper nicht jedes Mal neu schreiben, wenn sich eine Website ändert.

- Browser- und Cloud-Scraping: Wähle zwischen Scraping im Browser (ideal für eingeloggte Seiten) oder in der Cloud (sehr schnell für öffentliche Daten).

- Kommt mit dynamischen Inhalten klar: Thunderbits KI steuert einen echten Browser – sie kommt also mit Infinite Scroll, Pop-ups, Logins und mehr zurecht.

- Export überallhin: Exportiere nach Excel, Google Sheets, Airtable, Notion oder kopiere einfach in die Zwischenablage.

- Keine Wartung: Wenn sich eine Website ändert, starte einfach den KI-Vorschlag erneut. Keine nächtlichen Debugging-Sessions mehr.

- Zeitplanung und Automatisierung: Lege fest, dass Scraper nach Zeitplan laufen – ohne Cronjobs, ohne Server-Setup.

- Spezialisierte Extraktoren: Du brauchst E-Mails, Telefonnummern oder Bilder? Thunderbit hat dafür ebenfalls Extraktoren mit einem Klick.

Und das Beste? Du musst keine einzige Zeile Code kennen. Thunderbit ist für Business-Anwender, Marketing-Teams, Vertriebsteams, Immobilienprofis – also für alle, die schnell Daten brauchen.

Willst du Thunderbit in Aktion sehen? oder schau auf unserem für Demos vorbei.

Fazit: Die beste Sprache für Web-Scraping im Jahr 2026 wählen

Web-Scraping ist 2026 zugänglicher – und leistungsfähiger – als je zuvor. Das habe ich nach Jahren im Automatisierungsalltag gelernt:

- Python ist weiterhin die beste Sprache für Web-Scraping, wenn du schnell loslegen und viele Ressourcen zur Hand haben willst.

- JavaScript/Node.js ist unschlagbar für dynamische, stark auf JavaScript basierende Websites.

- Ruby und PHP eignen sich super für schnelle Skripte und Web-Integration, besonders wenn du sie ohnehin schon nutzt.

- C++ und Go sind deine Freunde, wenn Geschwindigkeit und Skalierung wichtig sind.

- Java ist die erste Wahl für Enterprise- und Langzeitprojekte.

- Und wenn du ganz ohne Code auskommen willst? ist deine Geheimwaffe.

Bevor du loslegst, frag dich:

- Wie groß ist mein Projekt?

- Muss ich dynamische Inhalte verarbeiten?

- Wie sicher fühle ich mich technisch?

- Will ich etwas bauen – oder einfach nur die Daten haben?

Probier oben ein Code-Snippet aus oder teste Thunderbit für dein nächstes Projekt. Und wenn du tiefer einsteigen willst, schau in unseren für weitere Anleitungen, Tipps und echte Scraping-Geschichten.

Viel Spaß beim Scrapen – und möge deine Datenquelle immer sauber, strukturiert und nur einen Klick entfernt sein.

P.S. Falls du dich jemals um 2 Uhr nachts in einem Web-Scraping-Kaninchenbau verirrst, denk einfach daran: Es gibt immer Thunderbit. Oder Kaffee. Oder beides.

FAQs

1. Was ist 2026 die beste Programmiersprache für Web-Scraping?

Python bleibt dank seiner lesbaren Syntax, leistungsstarken Bibliotheken wie BeautifulSoup, Scrapy und Selenium sowie der großen Community die erste Wahl. Es ist ideal für Einsteiger und Profis, besonders wenn Scraping mit Datenanalyse kombiniert wird.

2. Welche Sprache eignet sich am besten für Websites mit viel JavaScript?

JavaScript (Node.js) ist die beste Wahl für dynamische Websites. Tools wie Puppeteer und Playwright geben dir volle Browserkontrolle und ermöglichen die Interaktion mit Inhalten, die über React, Vue oder Angular geladen werden.

3. Gibt es eine No-Code-Option für Web-Scraping?

Ja – ist ein KI-Web-Scraper ohne Code, der alles von dynamischen Inhalten bis hin zu Zeitplänen abdeckt. Einfach auf „KI-Felder vorschlagen“ klicken und loslegen. Perfekt für Sales-, Marketing- oder Ops-Teams, die schnell strukturierte Daten brauchen.

4. Muss ich überhaupt noch eine Sprache auswählen, wenn ein KI-Coding-Agent den Scraper für mich schreiben kann?

Eine berechtigte Frage im Jahr 2026. Tools wie Claude Code, Cursor und OpenAI Codex erzeugen aus einer kurzen Prompt-Beschreibung problemlos einen Scrapy-Spider, ein Playwright-Skript oder einen Go-+Colly-Crawler – die Hürde „Welche Sprache lerne ich zuerst?“ ist also deutlich geringer als noch vor zwei Jahren. Aber der Agent gibt den Code trotzdem in irgendeiner Sprache aus, und du – oder die Person, die das Projekt später übernimmt – musst ihn lesen, debuggen und deployen. Die Wahl ist also weiterhin wichtig; sie betrifft nur mehr die Wartung als die ersten 30 Zeilen. Wenn du überhaupt keinen Code anfassen willst, passt genau hier: Es überspringt die Sprachfrage komplett.

Mehr erfahren: