Der Arbeitsmarkt im Jahr 2026 ist ein echter Datendschungel. Jeden Tag gehen weltweit Millionen neuer Stellenanzeigen auf Jobbörsen, Nischenportalen und Karriereseiten von Unternehmen online – so viele, dass es inzwischen gibt. Wer schon einmal versucht hat, all diese Angebote manuell im Blick zu behalten, kennt das Produktivitätsloch nur zu gut: offene Tabs überall, endlose Copy-Paste-Marathons und die ständige Angst, die besten Chancen zu verpassen. Ich habe erlebt, wie Recruiter, Vertriebsteams und Marktanalysten alle an derselben Frage hängen bleiben: Wie lassen sich Jobdaten in großem Maßstab sammeln, organisieren und nutzen, ohne daran zu verzweifeln – oder das Wochenende zu opfern?

Genau hier kommen automatisierte Job-Scraping-Tools ins Spiel. Diese digitalen Assistenten holen Stellenanzeigen von jeder Website, strukturieren sie und bündeln sie an einem Ort – und machen aus stundenlanger Handarbeit Minuten sauberer, verwertbarer Daten. Ob Sie eine Talent-Pipeline aufbauen, das Recruiting der Konkurrenz verfolgen oder Ihr CRM mit frischen Leads füttern: Die richtige Job-Scraping-Software kann den entscheidenden Unterschied machen. Nach Jahren in SaaS und Automatisierung sowie viel Praxistesting habe ich diese endgültige Liste der 12 besten Job-Scraping-Tools für 2026 zusammengestellt – von KI-gestützten No-Code-Lösungen bis hin zu Enterprise-Automatisierung. Los geht’s.

Warum Job-Scraping-Tools für die automatisierte Extraktion von Jobdaten nutzen?

Seien wir ehrlich: Die alte Methode, Jobdaten manuell von Dutzenden von Websites zu kopieren, reicht heute einfach nicht mehr aus. Automatisierte Job-Scraping-Tools sind ein echter Produktivitätsbooster für Business-Teams und bieten:

- Geschwindigkeit & Skalierung: Erfassen Sie statt 100 per Hand. Das ist nicht nur schneller – es ist der Unterschied zwischen proaktiv handeln und ständig hinterherlaufen.

- Genauigkeit & Konsistenz: Keine übersehenen Anzeigen und keine Copy-Paste-Fehler mehr. Scraper ziehen jedes Feld – Jobtitel, Unternehmen, Standort, Gehalt – in eine einheitliche Tabelle und machen Analyse und Reporting zum Kinderspiel.

- Markteinblicke in Echtzeit: Mit Zeitplanung und Automatisierung können Sie Trends im Recruiting, Gehaltsbenchmarks und Bewegungen der Konkurrenz beobachten, sobald sie entstehen – nicht erst Wochen später.

- Zentralisierte Daten: Ziehen Sie Anzeigen von LinkedIn, Indeed, Glassdoor und Unternehmensseiten in eine einzige Tabelle oder Datenbank. Erkennen Sie Dubletten, vergleichen Sie Plattformen und erhalten Sie einen echten 360°-Blick auf den Arbeitsmarkt.

- Strategischer Vorteil: Für HR bedeutet das klügeres Recruiting und bessere Gehaltsangebote. Für den Vertrieb ist es eine Goldgrube an B2B-Leads (Unternehmen, die für bestimmte Rollen einstellen, sind oft kaufbereit). Für Operations und Research ist es Competitive Intelligence auf Abruf.

Kurz gesagt: Automatisierte Job-Scraping-Tools sparen Zeit, erhöhen die Genauigkeit und erschließen Einblicke, die man manuell nie bekommen würde. Und mit modernen No-Code- und KI-gestützten Optionen können sogar nicht-technische Teams mitmischen.

Wie wir die beste Job-Scraping-Software ausgewählt haben

Nicht jeder Scraper ist gleich. Bei der Bewertung der besten Job-Scraping-Tools habe ich Folgendes berücksichtigt:

- Benutzerfreundlichkeit: Können Nicht-Programmierer schnell loslegen? Gibt es eine visuelle Oberfläche oder KI-Hilfe?

- Datenqualität: Werden alle wichtigen Felder zuverlässig extrahiert, auch von dynamischen oder komplexen Websites?

- Automatisierung & Zeitplanung: Läuft das Tool in der Cloud, kann es Pagination verarbeiten und wiederkehrende Jobs planen?

- Export & Integration: Lässt es sich nach Excel, Google Sheets, Airtable, Notion oder per API exportieren?

- Abdeckung der Quellen: Funktioniert es auf populären Jobbörsen und Karriereseiten von Unternehmen?

- Erweiterte Funktionen: KI-Felderkennung, Subpage-Scraping, Datenbereinigung und Anreicherung.

- Preise & Skalierbarkeit: Kostenlose Stufen für kleinere Aufgaben, bezahlbare Pläne für wachsende Teams und Enterprise-Optionen für große Anforderungen.

Mit diesen Kriterien im Blick sind hier meine Empfehlungen für die 12 besten Job-Scraping-Software-Tools im Jahr 2026.

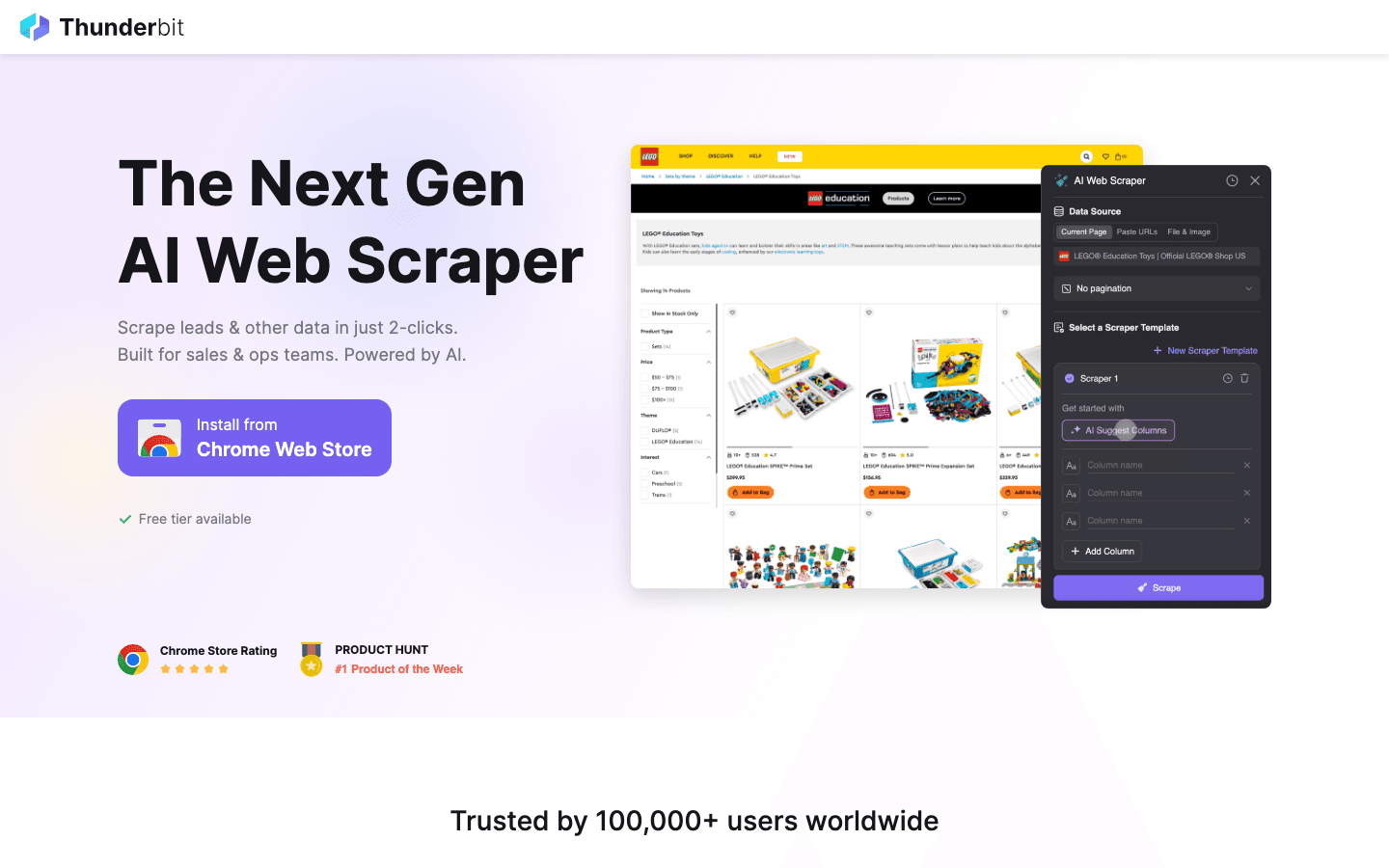

1. Thunderbit

ist meine erste Wahl für KI-gestütztes Job-Scraping ohne Code. Als Mitgründer bin ich natürlich nicht ganz unvoreingenommen – aber ich habe Thunderbit gebaut, weil ich es leid war zu sehen, wie Business-Anwender mit sperrigen, code-lastigen Scrapern kämpfen. Thunderbit ist eine Chrome-Erweiterung, mit der Sie jede Jobbörse oder Karriereseite in nur zwei Klicks scrapen können: Seite öffnen, „AI Suggest Fields“ anklicken, und die KI von Thunderbit liest die Website, empfiehlt die besten Spalten (Jobtitel, Unternehmen, Standort, Gehalt, Anforderungen usw.) und strukturiert die Daten für Sie. Klicken Sie auf „Scrape“, und Sie erhalten eine saubere Tabelle, die direkt exportiert werden kann.

ist meine erste Wahl für KI-gestütztes Job-Scraping ohne Code. Als Mitgründer bin ich natürlich nicht ganz unvoreingenommen – aber ich habe Thunderbit gebaut, weil ich es leid war zu sehen, wie Business-Anwender mit sperrigen, code-lastigen Scrapern kämpfen. Thunderbit ist eine Chrome-Erweiterung, mit der Sie jede Jobbörse oder Karriereseite in nur zwei Klicks scrapen können: Seite öffnen, „AI Suggest Fields“ anklicken, und die KI von Thunderbit liest die Website, empfiehlt die besten Spalten (Jobtitel, Unternehmen, Standort, Gehalt, Anforderungen usw.) und strukturiert die Daten für Sie. Klicken Sie auf „Scrape“, und Sie erhalten eine saubere Tabelle, die direkt exportiert werden kann.

Warum Thunderbit heraussticht

- KI-gestützte Felderkennung: Erkennt und vereinheitlicht Felder automatisch – selbst wenn verschiedene Websites unterschiedliche Bezeichnungen verwenden (z. B. „Qualifikationen“ vs. „In dieser Rolle könnten Sie aufblühen, wenn …“).

- Subpage- und Pagination-Scraping: Erfassen Sie Joblisten und lassen Sie Thunderbit automatisch in jede Detailseite klicken, um vollständige Beschreibungen, Anforderungen und mehr zu holen. Mehrseitige Listen und Endlos-Scrollen sind kein Problem.

- Sofortiger Export: Export mit einem Klick nach Excel, Google Sheets, Airtable, Notion, CSV oder JSON. Bilder (etwa Firmenlogos) werden beim Export nach Notion/Airtable inline hochgeladen.

- Cloud- oder lokales Scraping: Wählen Sie den Browser-Modus für eingeloggte Seiten oder den Cloud-Modus für besonders schnelles Scraping (bis zu 50 Seiten parallel).

- Zeitplanung & Automatisierung: Beschreiben Sie Ihren Zeitplan in Alltagssprache („jeden Montag um 9 Uhr“), und Thunderbit führt die Scrapes automatisch aus.

- Datenanreicherung: KI kann Stellenbeschreibungen bei Bedarf bereinigen, standardisieren, übersetzen und sogar zusammenfassen.

- Kostenlose Hilfsfunktionen: Ein-Klick-Extraktion von E-Mail-Adressen, Telefonnummern und Bildern; AI Autofill für Formulare; 34 unterstützte Sprachen.

Preise: Freemium – einige Seiten kostenlos scrapen, danach zahlen Sie per Credits (pro Zeile). Pläne starten bei 15 $/Monat für 500 Credits, mit höheren Stufen für Power-User. .

Am besten geeignet für: HR-, Vertriebs- und Marketing-Teams, die Stellenanzeigen von jeder Website so schnell und einfach wie möglich scrapen wollen – ohne Programmierung, ohne Vorlagen, einfach Ergebnisse.

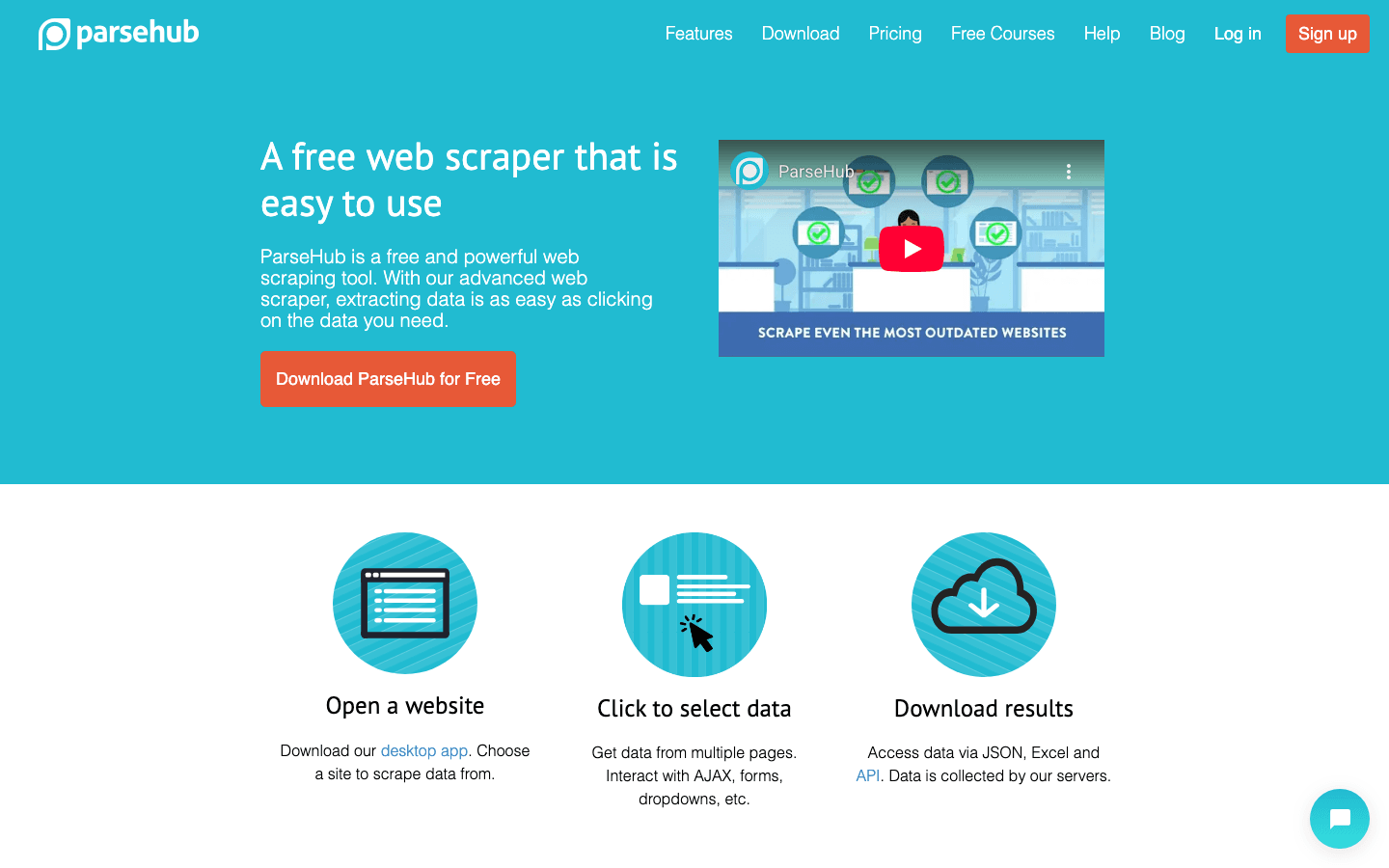

2. ParseHub

ist ein Klassiker in der No-Code-Scraping-Welt und bekannt für seine visuelle Point-and-Click-Oberfläche. Es ist eine Desktop-App (Windows, Mac, Linux), in der Sie auf Stellenanzeigen und Felder klicken und ParseHub das Muster erkennt. Das Tool verarbeitet dynamische Inhalte, Dropdowns, Endlos-Scrollen und kann im Rahmen eines Workflows in Detailseiten von Jobs hineinklicken.

ist ein Klassiker in der No-Code-Scraping-Welt und bekannt für seine visuelle Point-and-Click-Oberfläche. Es ist eine Desktop-App (Windows, Mac, Linux), in der Sie auf Stellenanzeigen und Felder klicken und ParseHub das Muster erkennt. Das Tool verarbeitet dynamische Inhalte, Dropdowns, Endlos-Scrollen und kann im Rahmen eines Workflows in Detailseiten von Jobs hineinklicken.

- Visueller Workflow: Scraping-Logik per Klicken und Ziehen aufbauen – kein Code nötig.

- Beherrscht komplexe Websites: Funktioniert mit AJAX, JavaScript-lastigen Seiten und Login-Flows.

- Cloud-Ausführung: Bezahlte Pläne erlauben Scrapes in der Cloud und die Zeitplanung von Jobs.

- Exporte: CSV, Excel, JSON und API-Zugriff.

Preise: Kostenlos für bis zu 5 Projekte und 200 Seiten pro Lauf. Bezahlte Pläne beginnen bei etwa 50 $/Monat.

Am besten geeignet für: Nicht-technische Nutzer, die die Kontrolle über die Scraping-Logik behalten wollen, besonders bei kniffligen Jobbörsen mit vielen Interaktionen.

3. Octoparse

ist ein weiteres erstklassiges No-Code-Scraper-Tool, bekannt für seinen Drag-and-Drop-Workflow-Builder und robuste Cloud-Automatisierung. Es kommt mit zahlreichen Vorlagen für beliebte Jobbörsen (LinkedIn, Indeed usw.), sodass Sie schnell starten können.

ist ein weiteres erstklassiges No-Code-Scraper-Tool, bekannt für seinen Drag-and-Drop-Workflow-Builder und robuste Cloud-Automatisierung. Es kommt mit zahlreichen Vorlagen für beliebte Jobbörsen (LinkedIn, Indeed usw.), sodass Sie schnell starten können.

- Vorgefertigte Vorlagen: Große Jobportale sofort scrapen.

- Cloud-Scraping & Zeitplanung: Jobs in der Cloud ausführen, wiederkehrende Scrapes planen und große Datenmengen verarbeiten.

- Visueller Workflow: Felder, Pagination und Aktionen per Klick definieren.

- Exporte: CSV, Excel, JSON, API.

Preise: Kostenlose Stufe mit Einschränkungen. Bezahlte Pläne starten bei rund 99 $/Monat für Cloud-Funktionen.

Am besten geeignet für: Power-User und Analysten, die No-Code-Scraping mit starker Automatisierung wollen – besonders für regelmäßige, groß angelegte Jobdaten-Abfragen.

4. Data Miner

ist eine leichte Chrome-Erweiterung, perfekt für schnelle, ad-hoc Jobdatenextraktion. Das Tool nutzt „Rezepte“ (vorgefertigt oder individuell), um Daten von einer Seite zu scrapen – einfach navigieren, klicken und exportieren.

ist eine leichte Chrome-Erweiterung, perfekt für schnelle, ad-hoc Jobdatenextraktion. Das Tool nutzt „Rezepte“ (vorgefertigt oder individuell), um Daten von einer Seite zu scrapen – einfach navigieren, klicken und exportieren.

- Scraping mit einem Klick: Nutzen Sie öffentliche Rezepte für LinkedIn, Indeed, Glassdoor und mehr.

- No-Code-Anpassung: Bei Bedarf neue Felder per Klick definieren.

- Exporte: CSV, Excel, Google Sheets.

- Kostenlose & kostenpflichtige Pläne: Kostenlos für bis zu ca. 500 Seiten/Monat; Pro startet bei etwa 20 $/Monat.

Am besten geeignet für: Recruiter und Vertriebsmitarbeiter, die Jobdaten schnell von einer Seite nach Excel übernehmen müssen – ohne Einrichtung, ohne Aufwand.

5. Import.io

ist eine Enterprise-Webdaten-Plattform für automatisiertes Job-Scraping in großem Maßstab. Sie kombiniert eine Point-and-Click-Oberfläche mit leistungsstarker Cloud-Infrastruktur, APIs und Datenumwandlung.

ist eine Enterprise-Webdaten-Plattform für automatisiertes Job-Scraping in großem Maßstab. Sie kombiniert eine Point-and-Click-Oberfläche mit leistungsstarker Cloud-Infrastruktur, APIs und Datenumwandlung.

- Visuelle Extraktion: Felder per Klick definieren, auch auf dynamischen oder login-geschützten Websites.

- Enterprise-Maßstab: Tausende URLs parallel scrapen, Jobs planen und Ergebnisse überwachen.

- Datenintegration: Export nach CSV, JSON, Excel oder per API/Webhooks. Integriertes ETL für Datenbereinigung.

- Managed Service: Das Team kann Scraper für Sie einrichten und betreiben.

Preise: Individuelle Enterprise-Angebote; bei groß angelegter Nutzung sollten Sie mit mehreren Tausend Dollar pro Monat rechnen.

Am besten geeignet für: Große Organisationen, die zuverlässige Extraktion von Jobdaten im großen Stil brauchen – inklusive Support und Integration in Business-Intelligence-Systeme.

6. Scrapy

ist das Python-Framework der Wahl für Entwickler, die eigene Job-Scraping-Projekte bauen. Es ist codebasiert, Open Source und extrem leistungsstark für komplexe oder groß angelegte Crawls.

ist das Python-Framework der Wahl für Entwickler, die eigene Job-Scraping-Projekte bauen. Es ist codebasiert, Open Source und extrem leistungsstark für komplexe oder groß angelegte Crawls.

- Volle Kontrolle: Schreiben Sie Spiders für jede Website, Logik oder Datenumwandlung.

- Hohe Leistung: Asynchrones, paralleles Crawling; skalierbar auf Millionen von Seiten.

- Exporte: CSV, JSON, XML, direkt in Datenbanken.

- Kostenlos & Open Source: Die Kosten liegen in Entwicklerzeit und Infrastruktur.

Am besten geeignet für: Technische Teams, die maximale Flexibilität, individuelle Logik oder einen eigenen Job-Aggregator bauen wollen.

7. WebHarvy

ist ein Point-and-Click-Desktop-Scraper (Windows/Mac), der nicht nur Text, sondern auch Bilder und Dateien aus Stellenanzeigen hervorragend extrahiert.

ist ein Point-and-Click-Desktop-Scraper (Windows/Mac), der nicht nur Text, sondern auch Bilder und Dateien aus Stellenanzeigen hervorragend extrahiert.

- Visuelle Auswahl: Per Klick Felder erfassen; erkennt Muster und Listen automatisch.

- Multimedia-Extraktion: Firmenlogos, PDFs und mehr herunterladen.

- Batch- und Keyword-Scraping: Suchen über Kategorien oder Keywords automatisieren.

- Exporte: CSV, Excel, JSON, XML, SQL.

- Preise: Einmalkauf, etwa 129 $ für eine Einzel-Lizenz.

Am besten geeignet für: Nicht-technische Nutzer oder kleine Unternehmen, die ein zuverlässiges, einfaches Tool für das Scrapen von Jobs und zugehörigen Bildern/Dokumenten möchten.

8. Helium Scraper

verbindet visuelle Oberfläche und Skriptmöglichkeiten für individuelle Job-Scraping-Workflows. Es ist eine Desktop-App (Windows) mit starker paralleler Extraktion und Datenbankunterstützung.

verbindet visuelle Oberfläche und Skriptmöglichkeiten für individuelle Job-Scraping-Workflows. Es ist eine Desktop-App (Windows) mit starker paralleler Extraktion und Datenbankunterstützung.

- Point-and-Click + Scripting: Visuell starten, für komplexe Fälle JavaScript ergänzen.

- Paralleles Browsing: Mehrere Seiten gleichzeitig abrufen – für mehr Tempo.

- Integrierte Datenbank: Große Datensätze speichern, Export nach CSV, Excel, JSON, XML.

- Preise: Einmalkauf, Basic ca. 99 $, Pro ca. 199 $.

Am besten geeignet für: Power-User, die Bedienkomfort plus die Möglichkeit brauchen, knifflige Websites oder individuelle Logik zu handhaben – ohne laufende Kosten.

9. Diffbot

ist eine KI-gestützte Webdaten-Extraktions-API. Geben Sie eine beliebige Stellenanzeige-URL ein (oder eine ganze Website), und die KI von Diffbot parst strukturierte Jobdaten heraus – ohne Konfiguration.

ist eine KI-gestützte Webdaten-Extraktions-API. Geben Sie eine beliebige Stellenanzeige-URL ein (oder eine ganze Website), und die KI von Diffbot parst strukturierte Jobdaten heraus – ohne Konfiguration.

- Keine Einrichtung: Einfach die API aufrufen; die KI erkennt Jobfelder automatisch.

- Bulk-Crawling: Ganze Websites crawlen oder Tausende URLs im großen Stil verarbeiten.

- JSON-Ausgabe: Einfache Integration in Datenpipelines oder Apps.

- Preise: API-basiert, ab etwa 299 $/Monat.

Am besten geeignet für: Unternehmen, die aus vielen unterschiedlichen Job-Websites mit minimaler Entwicklung extrahieren müssen – etwa Job-Aggregatoren, Analysefirmen oder alle, die sich auf die Nutzung von Daten statt auf den Bau von Scrapern konzentrieren wollen.

10. Avochato

ist zwar kein Scraper, aber eine leistungsstarke Messaging- und Automatisierungsplattform in Echtzeit, die Ihre Jobdaten-Workflows verstärken kann. Nutzen Sie sie, um sofort SMS-, Slack- oder E-Mail-Benachrichtigungen zu senden, wenn neue Jobs erfasst werden.

ist zwar kein Scraper, aber eine leistungsstarke Messaging- und Automatisierungsplattform in Echtzeit, die Ihre Jobdaten-Workflows verstärken kann. Nutzen Sie sie, um sofort SMS-, Slack- oder E-Mail-Benachrichtigungen zu senden, wenn neue Jobs erfasst werden.

- Automatisierte Nachrichten: Benachrichtigungen oder Kandidatenansprache auf Basis neuer Jobdaten auslösen.

- KI-Agenten: Antwortvorschläge und automatisierte Gespräche.

- Integrationen: Slack, Teams, CRM, Zapier, API.

- Preise: Abo-basiert, ab den unteren dreistelligen Dollarbeträgen pro Monat.

Am besten geeignet für: Teams, die sofortige Benachrichtigungen oder Kandidateninteraktion auf Basis von Jobdaten brauchen – etwa Recruiting-Agenturen oder Vertriebsteams, die frische Leads direkt nutzen.

11. OutWit Hub

ist ein All-in-one-Desktop-Tool für Scraping und Datenmanagement. Es erkennt Tabellen, Links, E-Mails und Bilder auf jeder Seite automatisch und ermöglicht es Ihnen, Jobdaten mit minimaler Einrichtung zu organisieren und zu exportieren.

ist ein All-in-one-Desktop-Tool für Scraping und Datenmanagement. Es erkennt Tabellen, Links, E-Mails und Bilder auf jeder Seite automatisch und ermöglicht es Ihnen, Jobdaten mit minimaler Einrichtung zu organisieren und zu exportieren.

- Automatische Datenerkennung: Erfasst alles auf einer Seite – Sie filtern anschließend nur das, was Sie brauchen.

- Makros & Stapelautomatisierung: Mehrere Seiten oder Websites crawlen.

- Exporte: CSV, Excel, HTML, SQL.

- Preise: Kostenlose Light-Version (eingeschränkt), Pro ca. 80 $ einmalig.

Am besten geeignet für: Datenanalysten oder Journalisten, die Jobdaten interaktiv durchsuchen, scrapen und organisieren wollen – besonders bei vielfältigen oder unübersichtlichen Websites.

12. Content Grabber

ist eine Enterprise-Web-Scraping-Plattform für groß angelegte, geschäftskritische Datenextraktion. Sie bietet viele Funktionen für Teamverwaltung, Zeitplanung, Fehlerbehandlung und Integration.

ist eine Enterprise-Web-Scraping-Plattform für groß angelegte, geschäftskritische Datenextraktion. Sie bietet viele Funktionen für Teamverwaltung, Zeitplanung, Fehlerbehandlung und Integration.

- Visueller Agent-Designer: Scraper visuell aufbauen, C#/VB.NET-Skripte für fortgeschrittene Logik ergänzen.

- Enterprise-Management: Zentrale Zeitplanung, Überwachung und Bereitstellung über mehrere Server hinweg.

- Integration: Export in Datenbanken, APIs, Excel und mehr.

- Preise: Hochpreisig; früher etwa 1.500 $ einmalig, heute wahrscheinlich abonnementbasiert für Enterprise-Kunden.

Am besten geeignet für: Unternehmen, die Dutzende Scraper betreiben, Jobdaten in großem Maßstab zusammenführen und Zuverlässigkeit, Versionskontrolle sowie zentrale Verwaltung benötigen.

Feature-Vergleichstabelle: Die besten Job-Scraping-Softwarelösungen auf einen Blick

| Tool | Benutzerfreundlichkeit | KI-Funktionen | Automatisierung & Skalierung | Export/Integration | Preise | Am besten geeignet für |

|---|---|---|---|---|---|---|

| Thunderbit | Hervorragend (ohne Code) | Ja (KI-Felder, NLP) | Cloud/lokal, Zeitplanung | Excel, Sheets, Notion, API | Freemium, ab 15 $/Monat | Nicht-technische Teams, schnelles Multi-Site-Scraping |

| ParseHub | Gut (visuell) | Nein | Cloud/lokal, Zeitplanung | CSV, Excel, JSON, API | Kostenlos, ab 50 $/Monat | Visuelle Nutzer, komplexe Websites |

| Octoparse | Gut (Drag-and-Drop) | Teilweise (Vorlagen) | Cloud, Zeitplanung, Skalierung | CSV, Excel, JSON, API | Kostenlos, ab 99 $/Monat | Power-User, regelmäßige Großaufträge |

| Data Miner | Hervorragend (1 Klick) | Nein | Manuell, einzelne Seite | CSV, Excel, Sheets | Kostenlos, ab 20 $/Monat | Schnelle, ad-hoc Aufträge |

| Import.io | Mittel (visuell) | Ja (KI/ML) | Enterprise-Cloud, Skalierung | CSV, JSON, Excel, API | Individuell, $$$$ | Unternehmen, BI-Integration |

| Scrapy | Nur für Entwickler (Code) | Nein (erweiterbar) | Unbegrenzt, eigene Infrastruktur | CSV, JSON, DB | Kostenlos, Open Source | Entwickler, individuelle/große Projekte |

| WebHarvy | Hervorragend (visuell) | Nein | Desktop, Batch, Bilder | CSV, Excel, JSON, XML | 129 $ einmalig | Kleine Unternehmen, Bild-/Dokumenten-Scraping |

| Helium Scraper | Gut (visuell+Code) | Nein (JS-Scripting) | Paralleler Desktop, Zeitplanung | CSV, Excel, JSON, DB | 99–199 $ einmalig | Power-User, knifflige Websites |

| Diffbot | API (Entwickler) | Ja (vollständige KI/NLP) | Cloud-API, Bulk, Crawling | JSON-API | Ab 299 $/Monat | Aggregatoren, Analytics, Multi-Source |

| Avochato | Hervorragend (ohne Code) | Ja (KI-Messaging) | Echtzeit, Integrationen | Slack, SMS, API | Ab den unteren dreistelligen $/Monat | Benachrichtigungen, Kandidatenansprache |

| OutWit Hub | Gut (GUI) | Nein | Batch, Makros, Desktop | CSV, Excel, HTML, SQL | Kostenlos/80 $ einmalig | Analysten, interaktives Scraping |

| Content Grabber | Mittel (visuell) | Nein (skriptbar) | Enterprise, Multi-Server | DB, API, Excel, mehr | Hochpreisig, $$$$ | Unternehmen, geschäftskritische Jobs |

So wählen Sie das richtige Job-Scraping-Tool für Ihre Anforderungen

- Nicht-technische Nutzer: Thunderbit, ParseHub, Octoparse, WebHarvy, Data Miner, OutWit Hub.

- Visuelle Workflows gewünscht: ParseHub und Octoparse glänzen mit Drag-and-Drop- und Point-and-Click-Setups.

- Entwickler/individuelle Logik: Scrapy (Python), Helium Scraper (JS), Content Grabber (C#/VB.NET).

- Enterprise/Skalierung: Import.io, Content Grabber, Diffbot.

- Echtzeit-Warnungen/Aktionen: Kombinieren Sie Ihren Scraper mit Avochato für sofortige Benachrichtigungen oder Kandidatenansprache.

- Budgetbewusst: Starten Sie mit der kostenlosen Stufe von Thunderbit, Data Miner oder der Light-Version von OutWit Hub.

- KI-Anreicherung benötigt: Thunderbit und Diffbot bieten die fortschrittlichste KI-Felderkennung und Datenbereinigung.

Starten Sie immer mit einer kostenlosen Testphase oder Demo – testen Sie das Tool an Ihren Ziel-Jobsites, schauen Sie, wie es mit den Feldern umgeht, die Ihnen wichtig sind, und prüfen Sie die Exportformate. Weitere Tipps finden Sie im mit tiefen Einblicken und Schritt-für-Schritt-Anleitungen.

Fazit: Nutzen Sie die Power der automatisierten Extraktion von Jobdaten

Job-Scraping-Software hat sich von einem Nischen-Tool für Entwickler zu einem Must-have für jedes moderne Business-Team entwickelt. Ob Sie rekrutieren, verkaufen oder den Markt analysieren – das richtige Tool kann Ihnen hunderte Stunden sparen, die Datenqualität verbessern und Ihnen einen echten Vorsprung vor der Konkurrenz verschaffen. Mein Rat? Geben Sie sich nicht mit manuellem Copy-Paste oder veralteten Tabellen zufrieden. Probieren Sie eines dieser 12 Top-Job-Scraping-Tools aus – besonders , wenn Sie die schnellste und KI-gestützte Erfahrung wollen – und sehen Sie, wie viel mehr Sie schaffen, wenn die Daten zu Ihnen kommen.

Bereit, Ihr Jobdaten-Game aufs nächste Level zu bringen? – kostenlos – oder die anderen Tools auf dieser Liste erkunden. Und wenn Sie mehr Automatisierungs-Tipps möchten, abonnieren Sie den für Tutorials und Updates.

FAQs

1. Was ist ein Job-Scraping-Tool und wie funktioniert es?

Ein Job-Scraping-Tool ist eine Software, die Stellenanzeigen und zugehörige Daten automatisch von Websites extrahiert. Es navigiert durch Jobbörsen oder Unternehmensseiten, erkennt relevante Felder (wie Jobtitel, Unternehmen, Gehalt) und gibt die Daten in einem strukturierten Format aus (Excel, CSV usw.), damit sie leicht ausgewertet werden können.

2. Ist es legal, Jobdaten von Websites zu scrapen?

Das Scrapen öffentlich zugänglicher Jobdaten ist für den privaten oder internen geschäftlichen Gebrauch im Allgemeinen legal, aber Sie sollten immer die Nutzungsbedingungen der Website prüfen und lokale Gesetze einhalten. Scrapen Sie keine vertraulichen oder login-geschützten Daten ohne Erlaubnis.

3. Welches Job-Scraping-Tool ist am besten für nicht-technische Nutzer geeignet?

Thunderbit, ParseHub, Octoparse, WebHarvy und Data Miner sind alle hervorragend für Nicht-Programmierer geeignet. Thunderbit sticht durch sein KI-gestütztes Zwei-Klick-Setup und sofortige Exportoptionen hervor.

4. Wie kann ich die tägliche Sammlung von Jobdaten automatisieren?

Wählen Sie ein Tool mit Zeitplanung und Cloud-Automatisierung (Thunderbit, Octoparse, Import.io, Content Grabber). Legen Sie Ihren Scraping-Zeitplan fest (z. B. täglich um 8 Uhr), und das Tool holt neue Anzeigen automatisch ab.

5. Können Job-Scraping-Tools Daten direkt nach Google Sheets oder Airtable exportieren?

Ja! Thunderbit bietet direkten Export nach Google Sheets, Airtable, Notion und mehr. Viele andere Tools unterstützen CSV-/Excel-Export, den Sie dann in Ihre bevorzugte Plattform importieren können.

Möchten Sie mehr über Web-Scraping, Automatisierung oder datengetriebenes Recruiting erfahren? Schauen Sie im vorbei – mit Leitfäden, Vergleichen und den neuesten Entwicklungen in der KI-gestützten Datenerfassung.

Mehr erfahren