Das Web wächst in atemberaubendem Tempo – bis 2025 sprechen wir von an digitalen Inhalten, die da draußen kreisen. Das ist genug Datenmenge, um einem schwindlig zu werden – und jede Tabelle zum Absturz zu bringen. Doch hier kommt der eigentliche Clou: Immer mehr dieser Daten werden von KI-gestützten Web-Scrapern eingesammelt, nicht von Menschen. Tatsächlich sorgten automatisierte Crawler und Scraper allein Ende 2024 für einen .

Wenn du im Vertrieb, Marketing oder Operations arbeitest – oder einfach keine Lust mehr hast, dir Daten mühsam durchs Internet zusammenzukopieren – kennst du das Problem: Manuelle Datenerfassung ist langsam, fehleranfällig und ungefähr so spannend wie trocknende Farbe. Genau deshalb sind kostenlose KI-Web-Scraping-Tools zum Geheimtipp für Teams geworden, die das Chaos des Webs in saubere, strukturierte Daten verwandeln wollen – ganz ohne eine einzige Zeile Code zu schreiben.

Ich arbeite seit Jahren im SaaS- und Automatisierungsumfeld und habe aus erster Hand erlebt, wie der richtige KI-gestützte Web-Scraper Teams Tausende von Stunden sparen und Erkenntnisse freisetzen kann, die man manuell nie bekommen würde. In diesem Leitfaden stelle ich die 12 besten kostenlosen KI-Web-Scraping-Tools 2026 vor – mit besonderem Fokus darauf, was jedes Tool einzigartig macht, wie es sich für Business-Anwender schlägt und wie du das richtige Tool für deinen Workflow auswählst.

Warum kostenlose KI-gestützte Web-Scraper für Business-Anwender wichtig sind

Seien wir ehrlich: Die Zeiten von „einfach einen Werkstudenten anheuern, der Leads kopiert“ sind vorbei. Moderne Unternehmen müssen schnell sein, lästige Aufgaben automatisieren und sich auf das konzentrieren, was wirklich Ergebnisse bringt. Genau hier kommen kostenlose KI-gestützte Web-Scraper ins Spiel – sie senken die Hürde für alle, nicht nur für Entwickler, um:

- Leads zu generieren aus Verzeichnissen, LinkedIn oder Nischen-Websites in wenigen Minuten.

- Wettbewerber zu beobachten – Preise, Produktlaunches oder Bewertungen, ohne endloses Klicken.

- Workflows zu automatisieren, etwa CRM-Datensätze zu aktualisieren, Bestände zu verfolgen oder Marktforschung zu sammeln.

Und der Effekt ist enorm. Laut aktuellen Branchenberichten können KI-gestützte Scraper Daten liefern als herkömmliche Methoden und dabei Kosten sowie Einrichtungszeit deutlich senken. Teams, die auf solche Tools umsteigen, berichten häufig von Tausenden gesparter Stunden und deutlich weniger manuellen Fehlern ().

Wie wir die besten kostenlosen KI-Web-Scraping-Tools ausgewählt haben

Nicht alle Scraper sind gleich. Darauf habe ich bei der Auswahl der Top 12 geachtet:

- Benutzerfreundlichkeit: No-Code- oder Low-Code-Oberflächen sind Pflicht. Wenn du einen Doktortitel in Python brauchst, fliegt das Tool aus der Liste.

- KI-Unterstützung: Tools, die KI nutzen, um Felder automatisch zu erkennen, Spalten vorzuschlagen oder sich an veränderte Websites anzupassen, bekommen Pluspunkte.

- Grenzen des kostenlosen Plans: Wie viel kannst du wirklich kostenlos machen? Ich habe Seiten-/Datensatzlimits, Exportoptionen und die Frage verglichen, ob sich Kernfunktionen ohne Bezahlung nutzen lassen.

- Funktionsumfang: Unterstützung für Pagination, Scraping von Unterseiten, Bild-/E-Mail-/Telefonextraktion und Vorlagenbibliotheken.

- Skalierbarkeit & Integration: Kannst du nach Excel, Google Sheets oder Notion exportieren oder per API verbinden? Packt das Tool große Jobs oder nur schnelle Einzelaufgaben?

- Best-Fit-Szenarien: Manche Tools sind perfekt für Einsteiger, andere glänzen bei Entwicklern oder großen Projekten.

Am Ende findest du außerdem eine kurze Vergleichstabelle, damit du deine Anforderungen schnell dem passenden Tool zuordnen kannst.

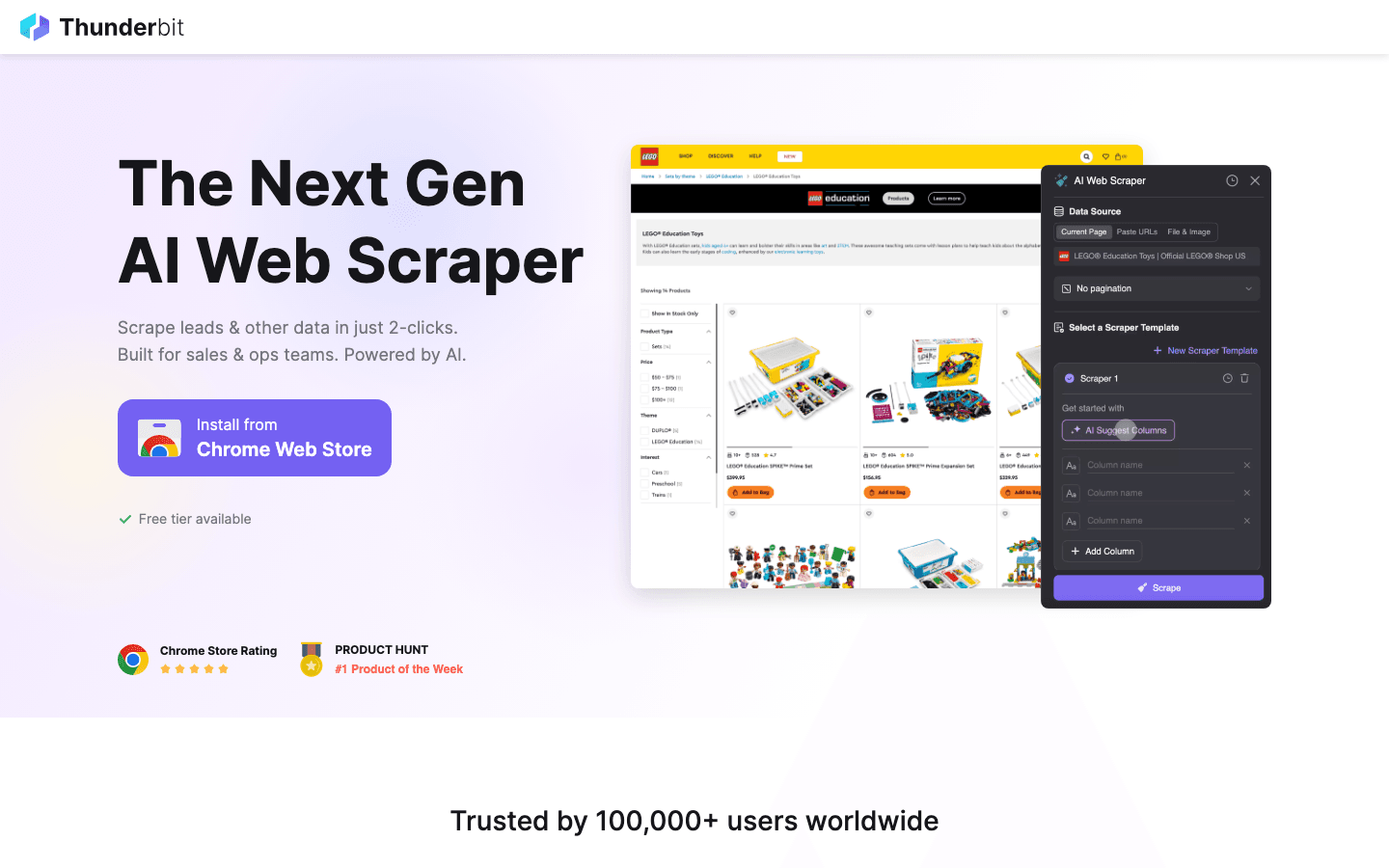

1. Thunderbit

ist meine erste Wahl für Business-Anwender, die einen wirklich kostenlosen KI-gestützten Web-Scraper suchen, der auch tatsächlich einfach zu bedienen ist. Als Chrome-Erweiterung ist Thunderbit für nicht-technische Teams gebaut – etwa Vertrieb, Operations, E-Commerce und Immobilien –, die Daten von jeder Website in nur zwei Klicks extrahieren wollen.

ist meine erste Wahl für Business-Anwender, die einen wirklich kostenlosen KI-gestützten Web-Scraper suchen, der auch tatsächlich einfach zu bedienen ist. Als Chrome-Erweiterung ist Thunderbit für nicht-technische Teams gebaut – etwa Vertrieb, Operations, E-Commerce und Immobilien –, die Daten von jeder Website in nur zwei Klicks extrahieren wollen.

Was Thunderbit besonders macht:

- KI-Feldvorschläge: Einfach auf „AI Suggest Fields“ klicken, und Thunderbits KI liest die Seite, empfiehlt die besten Spalten (z. B. Name, E-Mail, Preis usw.) und schreibt sogar individuelle Extraktions-Prompts für jedes Feld.

- Scraping von Unterseiten & Pagination: Musst du Detailseiten auslesen oder unendliches Scrollen verarbeiten? Thunderbits KI kann Links folgen, Pagination handhaben und alle Daten in einer einzigen Tabelle zusammenführen.

- Sofortige Vorlagen: Für beliebte Websites (Amazon, Zillow, Instagram, Shopify und mehr) kannst du vorgefertigte Vorlagen für Scraping mit einem Klick verwenden – ohne Einrichtung.

- Kostenloser Datenexport: Exportiere deine Daten kostenlos nach Excel, Google Sheets, Airtable oder Notion. CSV oder JSON kannst du ebenfalls herunterladen.

- Bild-/E-Mail-/Telefon-Extraktion: Extrahiere Bilder, E-Mails und Telefonnummern mit nur einem Klick von jeder Website.

- No-Code, kein Aufwand: Kein Programmieren, keine Vorlagen, keine Wartung. Thunderbits KI passt sich automatisch an Website-Änderungen an.

Kostenloser Plan: Bis zu 6 Seiten pro Monat scrapen (oder 10 mit einem kostenlosen Test-Boost), mit allen aktivierten Funktionen. Mehr nötig? Bezahlpläne starten schon bei 15 $/Monat für 500 Credits.

Nutzerfeedback: Teams schwärmen von Thunderbits Einfachheit und Genauigkeit – besonders bei langen, unübersichtlichen Nischen-Websites, an denen andere Scraper scheitern. Für schnelle Lead-Listen, Produkt-Monitoring und Marktforschung ist es zum Standard geworden ().

Willst du es in Aktion sehen? und probiere aus, deine erste Website in weniger als einer Minute zu scrapen.

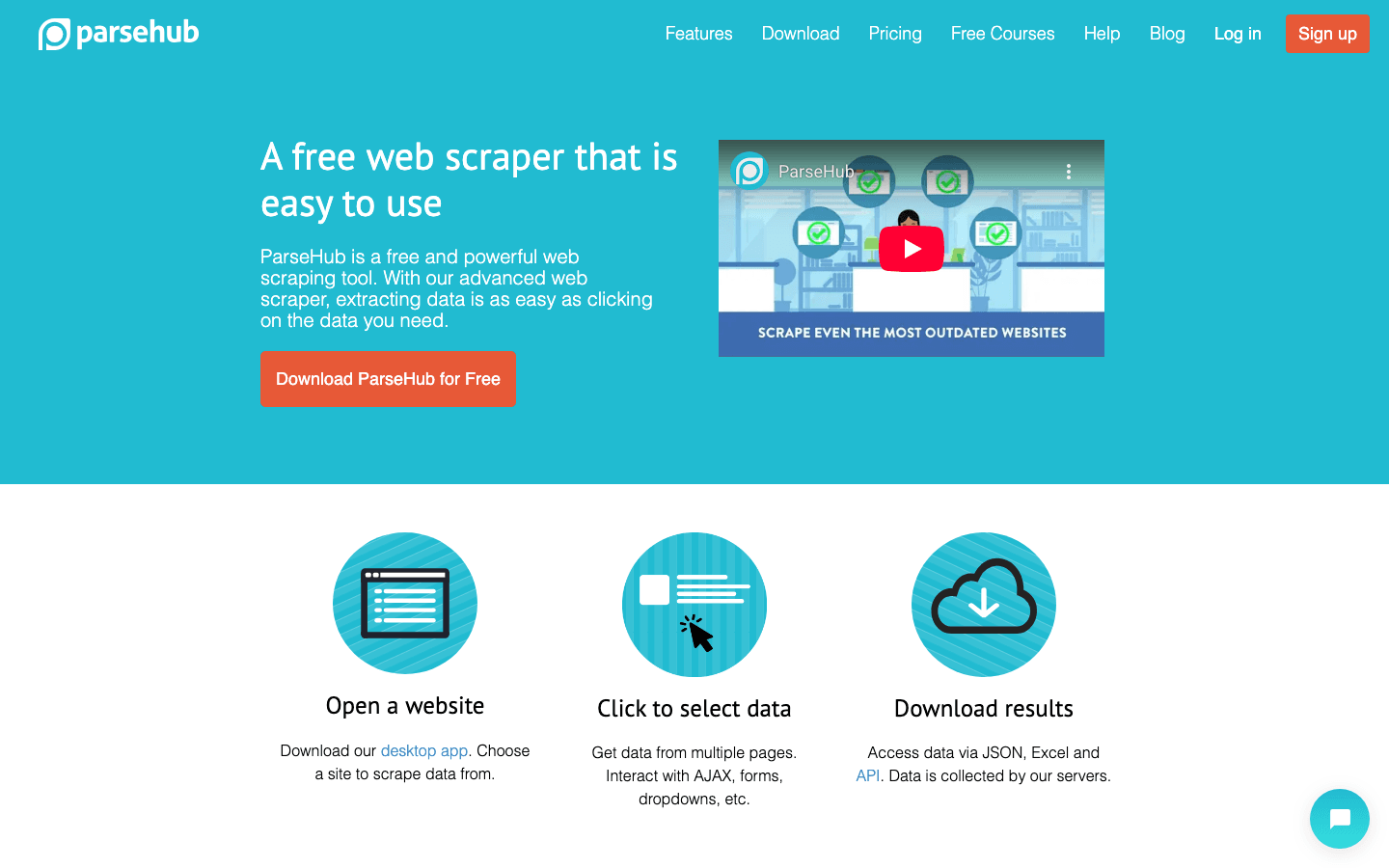

2. ParseHub

ist ein visueller No-Code-Web-Scraper, der sich hervorragend für Einsteiger und kleine Teams eignet. Er nutzt Machine Learning, um Elemente zu gruppieren, und kann komplexe Websites mit AJAX, Formularen und Bildern verarbeiten.

ist ein visueller No-Code-Web-Scraper, der sich hervorragend für Einsteiger und kleine Teams eignet. Er nutzt Machine Learning, um Elemente zu gruppieren, und kann komplexe Websites mit AJAX, Formularen und Bildern verarbeiten.

- Visuelles Point-and-Click: Einfach auf die gewünschten Elemente klicken, und ParseHub erledigt den Rest.

- Bilderkennung & API: Scrape Bilder, verarbeite dynamische Inhalte und greife per API auf deine Daten zu.

- Cloud oder Desktop: Jobs in der Cloud oder auf dem Desktop ausführen.

- Kostenloser Plan: Bis zu 200 Seiten pro Lauf, verteilt auf 5 Projekte. Export nach CSV oder JSON.

Am besten geeignet für: Kleine visuelle Projekte – etwa das Scraping von Produktlisten oder News-Artikeln. Die Lernkurve ist sanft, aber für mehr Skalierung braucht man einen bezahlten Plan ().

3. Octoparse

ist ein No-Code-Scraper für Desktop oder Cloud mit einer umfangreichen Vorlagenbibliothek und starken KI-Funktionen.

ist ein No-Code-Scraper für Desktop oder Cloud mit einer umfangreichen Vorlagenbibliothek und starken KI-Funktionen.

- KI-Auto-Erkennung: Die KI von Octoparse erstellt Workflows für dich, selbst auf JavaScript-lastigen oder durch CAPTCHA geschützten Websites.

- Batch-Verarbeitung: Tausende Datensätze auf einmal scrapen, Jobs planen und Logins oder unendliches Scrollen handhaben.

- Kostenloser Plan: 10.000 Datensätze pro Monat, mit Zugriff auf die meisten Kernfunktionen.

- Exportoptionen: CSV, Excel, Google Sheets und direkte API-Integration.

Am besten geeignet für: Teams, die dynamische Websites scrapen oder wiederkehrende, groß angelegte Jobs ausführen müssen. Die Lernkurve ist etwas steiler, aber die Dokumentation ist solide ().

4. Scrapy

ist das weltweit beliebteste Open-Source-Python-Framework für Web-Scraping. Es ist nichts für schwache Nerven – du musst coden –, aber für individuelle Großprojekte ist es unglaublich leistungsfähig.

ist das weltweit beliebteste Open-Source-Python-Framework für Web-Scraping. Es ist nichts für schwache Nerven – du musst coden –, aber für individuelle Großprojekte ist es unglaublich leistungsfähig.

- Volle Flexibilität: Baue eigene Spiders, verarbeite jede beliebige Website-Struktur und integriere KI-Module.

- Keine Nutzungslimits: Als Open Source kannst du so viel scrapen, wie deine Hardware erlaubt.

- Erweiterbar: Unzählige Plugins und starke Community-Unterstützung.

Am besten geeignet für: Entwickler und technische Teams, die volle Kontrolle und Skalierbarkeit wollen. Für Nicht-Programmierer nicht empfohlen ().

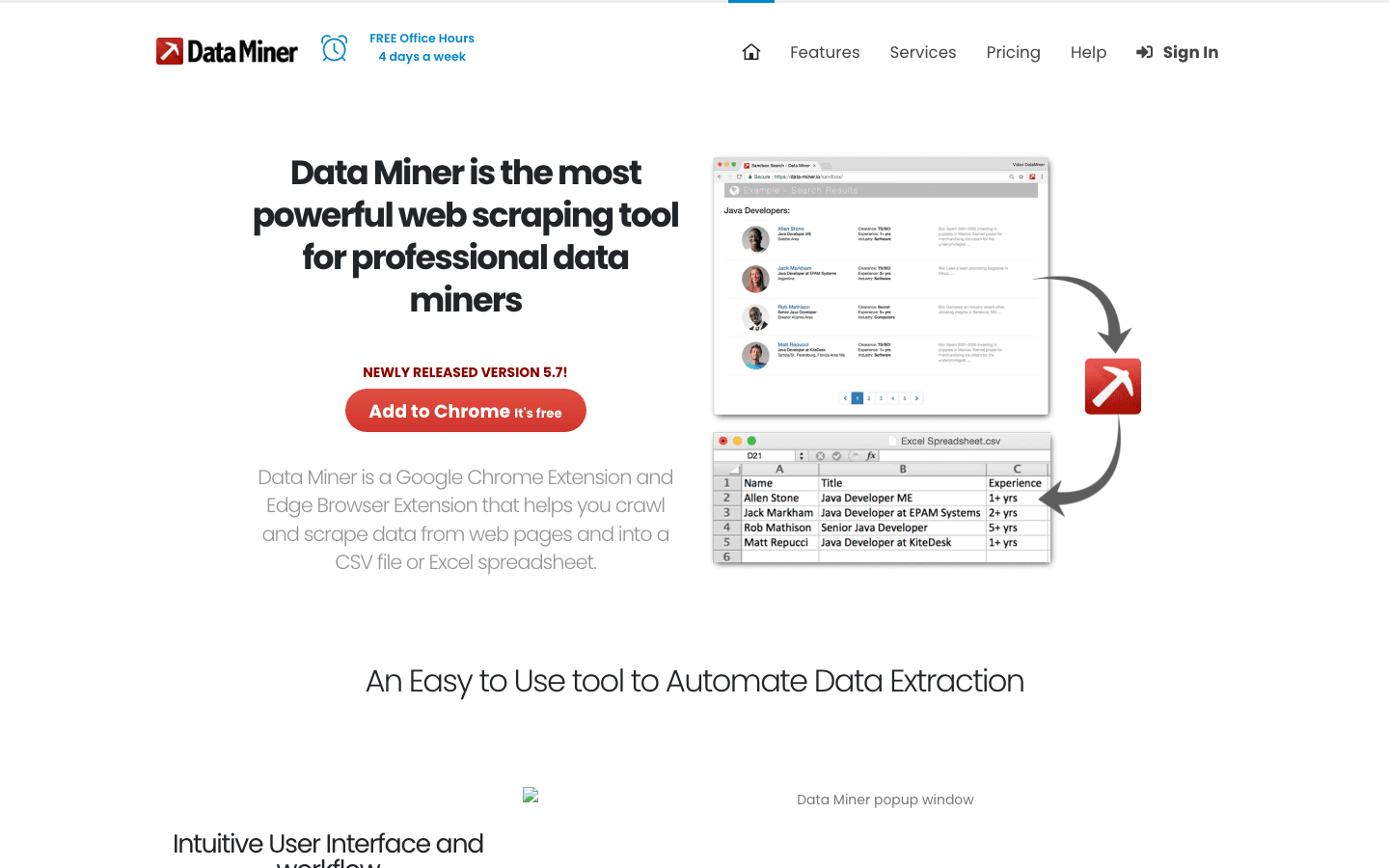

5. Data Miner

ist eine Chrome-/Edge-Erweiterung mit einer riesigen Bibliothek von über 50.000 vorgefertigten „Recipes“ zum Scrapen von Tabellen, Listen und Kontaktdaten von mehr als 15.000 beliebten Websites.

ist eine Chrome-/Edge-Erweiterung mit einer riesigen Bibliothek von über 50.000 vorgefertigten „Recipes“ zum Scrapen von Tabellen, Listen und Kontaktdaten von mehr als 15.000 beliebten Websites.

- Scraping mit einem Klick: Recipe auswählen, klicken, Daten erhalten.

- Pagination & Autofill: Verarbeitet mehrseitige Listen und kann Formulare automatisch ausfüllen.

- Kostenloser Plan: Bis zu 500 Seiten pro Monat scrapen. Export nach CSV, Excel oder Google Sheets.

Am besten geeignet für: Schnelle, tabellarische Datenextraktion – etwa Lead-Listen oder Produktkataloge – ganz ohne Einrichtung ().

6. WebHarvy

ist ein Windows-Desktop-Scraper mit visueller Point-and-Click-Oberfläche und intelligenter Mustererkennung.

ist ein Windows-Desktop-Scraper mit visueller Point-and-Click-Oberfläche und intelligenter Mustererkennung.

- Mustererkennung: Ein Produkt anklicken, und WebHarvy wählt automatisch alle ähnlichen Elemente aus.

- Bild-Scraping: Bilder, E-Mails und URLs lassen sich mühelos herunterladen.

- Kostenlose Testversion: Kein kostenloser Tarif, aber eine Testversion ist verfügbar. Für die dauerhafte Nutzung ist ein Einmalkauf erforderlich.

Am besten geeignet für: E-Commerce-Teams oder alle, die viele Bilder oder Produktdaten scrapen müssen ().

7. Dexi.io

ist eine cloudbasierte Plattform für fortgeschrittenes, skalierbares Web-Scraping und Workflow-Automatisierung.

ist eine cloudbasierte Plattform für fortgeschrittenes, skalierbares Web-Scraping und Workflow-Automatisierung.

- Visueller Workflow-Builder: Komplexe Scraping-Pipelines mit Drag-and-drop-Tools entwerfen.

- API-Integrationen: Mit Data Warehouse, CRM oder Analytics-Stack verbinden.

- Kostenlose Testversion: Begrenzte kostenlose Testphase, bezahlte Pläne ab 119 $/Monat.

Am besten geeignet für: Enterprise-Teams oder Operations-Profis, die komplexe, wiederkehrende Datentasks automatisieren müssen ().

8. Apify

ist eine entwicklerfreundliche Cloud-Plattform mit einem riesigen Marktplatz von über 6.000 fertigen „Actors“ (Scraping-Skripte) und vollständigem API-Zugriff.

ist eine entwicklerfreundliche Cloud-Plattform mit einem riesigen Marktplatz von über 6.000 fertigen „Actors“ (Scraping-Skripte) und vollständigem API-Zugriff.

- Marktplatz & Anpassung: Vorgefertigte Actors nutzen oder eigene in JavaScript/Python programmieren.

- Cloud-Runs & Scheduling: Jobs in der Cloud ausführen, wiederkehrende Scrapes planen und mit KI-Workflows integrieren.

- Kostenloser Tarif: 30 Compute Units pro Monat.

Am besten geeignet für: Technische Teams, die individuelle Workflows automatisieren oder Scraping-Pipelines skalieren wollen ().

9. Import.io

ist eine Enterprise-Plattform mit KI-Unterstützung für Datenextraktion, die sich auf strukturierte Daten und Compliance konzentriert.

ist eine Enterprise-Plattform mit KI-Unterstützung für Datenextraktion, die sich auf strukturierte Daten und Compliance konzentriert.

- KI-gestützte Selektoren: Passt sich automatisch an veränderte Website-Layouts an.

- Datentransformation: Daten vor dem Export bereinigen, anreichern und umwandeln.

- Kostenlose Testversion: 14 Tage kostenlos, danach starten bezahlte Pläne bei 249 $/Monat.

Am besten geeignet für: Unternehmen, die große, regelkonforme Datenfeeds für BI oder Analytics benötigen ().

10. Diffbot

ist eine KI-gestützte Plattform, die NLP und Computer Vision nutzt, um strukturierte Daten aus jeder Webseite zu extrahieren – ganz ohne Einrichtung.

ist eine KI-gestützte Plattform, die NLP und Computer Vision nutzt, um strukturierte Daten aus jeder Webseite zu extrahieren – ganz ohne Einrichtung.

- Knowledge Graph: Erkennt automatisch Personen, Produkte, Artikel und mehr.

- API-Zugriff: Strukturierte Daten per API für News-Feeds, Analysen oder Forschung abrufen.

- Kostenloser Plan: 10.000 Credits pro Monat für die APIs Extract, NLP und Knowledge Graph.

Am besten geeignet für: Teams, die hochwertige, strukturierte Daten aus News-, Produkt- oder Diskussionsseiten benötigen ().

11. VisualScraper

ist ein einfaches Web-Scraping-Tool mit Point-and-Click-Bedienung für Einsteiger.

ist ein einfaches Web-Scraping-Tool mit Point-and-Click-Bedienung für Einsteiger.

- Kein Coding nötig: Einfach Felder auswählen und scrapen.

- Unterstützung für mehrere Seiten: Mehrere Seiten in Echtzeit scrapen.

- Kostenloser Plan: Unbegrenzte Nutzung der Basisfunktionen. Export nach CSV, JSON, XML oder SQL.

Am besten geeignet für: Schnelle, einmalige Scrapes öffentlicher Daten – etwa News, Foren oder kleine Verzeichnisse ().

12. Portia von Scrapinghub

ist ein Open-Source-Visual-Web-Scraper, mit dem du Seiten direkt im Browser annotieren kannst, um einen Spider zu trainieren – ganz ohne Programmierung.

ist ein Open-Source-Visual-Web-Scraper, mit dem du Seiten direkt im Browser annotieren kannst, um einen Spider zu trainieren – ganz ohne Programmierung.

- Drag-and-drop-Oberfläche: Elemente anklicken, und Portia leitet die Extraktionsregeln ab.

- Open Source: Kostenlos nutzbar, aber seit 2018 ohne offiziellen Support.

- Scrapy-Integration: Exportiert Daten über Scrapy-Pipelines.

Am besten geeignet für: Technikaffine Teams, die eine kostenlose visuelle Alternative zu codebasierten Scrapern suchen ().

Kurze Vergleichstabelle: Die besten kostenlosen KI-Web-Scraping-Tools auf einen Blick

| Tool | Benutzerfreundlichkeit | KI-/Smart-Funktionen | Grenzen des kostenlosen Plans | Exportoptionen | Am besten für |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ (2 Klicks) | KI-Feldvorschläge, Unterseiten/Pagination | 6 Seiten/Monat (10 im Test) | Excel, Sheets, Airtable, Notion, CSV | Nicht-technische Teams, schnelle Webdaten |

| ParseHub | ★★★★☆ (visuelle UI) | ML-Elementgruppierung, API | 200 Seiten/Lauf, 5 Projekte | CSV, JSON, API | Kleine Projekte, AJAX-/JS-Websites |

| Octoparse | ★★★★☆ (visuelle UI) | KI-Auto-Erkennung, JS-/CAPTCHA-Support | 10.000 Datensätze/Monat | CSV, Excel, Sheets, API | Dynamische Websites, Planung, Cloud-Runs |

| Scrapy | ★★☆☆☆ (Code nötig) | Erweiterbar, Open Source | Unbegrenzt (Open Source) | Alles (programmatisch) | Entwickler, individuelles/skalierbares Scraping |

| Data Miner | ★★★★☆ (Browser-Erw.) | 50.000+ Recipes, Selektor-Finder | 500 Seiten/Monat | CSV, Excel, Sheets | Schnelle tabellarische/Listen-/Kontaktdaten |

| WebHarvy | ★★★★☆ (visuelle UI) | Mustererkennung, Bild-Scraping | Testversion (Lizenz erforderlich) | CSV, SQL, Excel | E-Commerce, Produktbilder |

| Dexi.io | ★★★☆☆ (Cloud-App) | Workflow-Automatisierung, APIs | Testversion | JSON, CSV, Integrationen | Enterprise, komplexe Workflows |

| Apify | ★★★☆☆ (Entwickler) | Actor-Marktplatz, API | 30 Compute Units/Monat | JSON, API, Webhooks | Individuelle Automatisierung, Dev-Teams |

| Import.io | ★★★☆☆ (Enterprise) | KI-Selektoren, Compliance-Funktionen | 14-Tage-Test | CSV, Excel, Datenbanken | Großangelegte, regulierte Daten |

| Diffbot | ★★★☆☆ (API/UI) | NLP, Computer Vision, Knowledge Graph | 10.000 Credits/Monat | JSON, API | Hochwertige Entitäts-, News- und Produktdaten |

| VisualScraper | ★★★☆☆ (Web-UI) | Point-and-Click-Auswahl | Unbegrenzt (Basisfunktionen) | CSV, JSON, XML, SQL | Einfache, geplante, mehrseitige Scrapes |

| Portia | ★★★☆☆ (Browser-UI) | Visuelle Scrapy-Hülle | Unbegrenzt (Open Source) | JSON, XML (über Scrapy) | Kostenloses visuelles Scraping für Tech-Teams |

So wählst du das richtige kostenlose KI-Web-Scraping-Tool für deine Anforderungen aus

Hier ist meine Kurz-Checkliste für die Auswahl des passenden Tools:

- Einsteiger/No-Code: Probiere Thunderbit, ParseHub, Data Miner oder VisualScraper für die schnellsten Ergebnisse.

- Komplexe/dynamische Websites: Octoparse, Dexi.io oder ParseHub kommen gut mit JavaScript-lastigen oder schwierigen Layouts zurecht.

- Große Projekte/Custom: Scrapy, Apify oder Import.io eignen sich am besten für Entwickler oder Enterprise-Teams.

- Bild-/Produktdaten: WebHarvy und Thunderbit glänzen beim Extrahieren von Bildern und strukturierten Produktinfos.

- Strukturierte Knowledge-/Entity-Daten: Diffbot ist die erste Wahl für hochwertige, KI-angereicherte Daten.

- Open Source/Community: Scrapy und Portia sind kostenlos, solange du mit etwas technischem Setup zurechtkommst.

Profi-Tipp: Prüfe immer die Grenzen des kostenlosen Plans und die Exportoptionen, bevor du ein großes Projekt startest. Und denk daran: Nur weil ein Tool „kostenlos“ ist, heißt das noch lange nicht, dass es zu deinem Workflow passt. Ordne deinen konkreten Anwendungsfall – Lead-Generierung, Wettbewerbsbeobachtung, Recherche usw. – den Stärken des Tools zu.

Fazit: Geschäftlichen Mehrwert mit den besten kostenlosen KI-Web-Scraping-Tools freisetzen

KI-gestütztes Web-Scraping ist längst nicht mehr nur etwas für Entwickler oder Data Scientists. Mit dem richtigen kostenlosen Tool kann jeder Datenerfassung automatisieren, intelligentere Workflows aufbauen und Erkenntnisse gewinnen, die echten Geschäftswert schaffen. Ob du eine Lead-Liste aufbaust, Preise verfolgst oder einfach keine Lust mehr auf Copy-and-paste hast – auf dieser Liste findest du ein Tool, das dir Zeit und Nerven spart.

Wenn du nach dem einfachsten Einstieg suchst – vor allem bei unübersichtlichen, langschwänzigen Websites – sticht mit seinen KI-gestützten Feldvorschlägen, dem Scraping von Unterseiten und dem sofortigen Export in deine Lieblings-Apps hervor. Aber scheu dich nicht, ein paar Tools auszuprobieren und zu sehen, was am besten zu dir passt.

Bereit, die manuelle Dateneingabe endgültig hinter dir zu lassen? Lade einen kostenlosen KI-Web-Scraper herunter, teste ihn und sieh zu, wie deine Produktivität und deine Datenqualität durch die Decke gehen.

Weitere Tipps, Deep Dives und Tutorials zum Web-Scraping findest du im .

Häufig gestellte Fragen

1. Was ist ein KI-gestützter Web-Scraper, und wie unterscheidet er sich von herkömmlichen Scrapern?

Ein KI-gestützter Web-Scraper nutzt künstliche Intelligenz, um Daten von Websites automatisch zu erkennen, zu extrahieren und zu strukturieren – oft ganz ohne Programmierung. Im Gegensatz zu herkömmlichen Scrapern, die auf festen Vorlagen oder manueller Einrichtung basieren, passen sich KI-Scraper an veränderte Seitenlayouts an und können unübersichtliche, unstrukturierte Daten verarbeiten.

2. Gibt es wirklich kostenlose KI-Web-Scraping-Tools für den geschäftlichen Einsatz?

Ja! Tools wie , ParseHub, Octoparse und Data Miner bieten alle kostenlose Pläne mit großzügigen Funktionen. Prüfe immer die konkreten Limits (Seiten pro Monat, Exportoptionen), damit sie zu deinen Anforderungen passen.

3. Welcher kostenlose KI-Web-Scraper ist am besten für nicht-technische Nutzer geeignet?

Thunderbit, ParseHub, Data Miner und VisualScraper sind alle für Nicht-Programmierer gedacht. Thunderbit sticht mit seinem 2-Klick-Workflow und den KI-Feldvorschlägen heraus und ist dadurch besonders einfach für Vertriebs-, Ops- und Marketing-Teams.

4. Kann ich diese Tools zum Scrapen von Bildern, E-Mails oder Telefonnummern verwenden?

Ja! Thunderbit, WebHarvy und Data Miner unterstützen alle die Extraktion von Bildern, E-Mails und Telefonnummern. Verwende ausgelesene Kontaktdaten immer verantwortungsvoll und im Einklang mit den Datenschutzgesetzen.

5. Wie entscheide ich zwischen No-Code- und codebasierten Scrapern?

Wenn du Geschwindigkeit und Einfachheit willst, fang mit einem No-Code-Tool wie Thunderbit oder ParseHub an. Wenn du volle Anpassbarkeit, Automatisierung in großem Maßstab oder Integrationen mit anderen Systemen brauchst, ist ein codebasiertes Tool wie Scrapy oder Apify die bessere Wahl.

Viel Erfolg beim Scrapen – und möge deine Daten stets sauber, strukturiert und einsatzbereit sein.

Mehr erfahren