Im letzten Quartal hat unser Ops-Team 40 Stunden pro Woche damit verbracht, Wettbewerbsdaten per Copy-and-Paste in Tabellen zu übertragen. In diesem Quartal sind es 20 Minuten.

Der Unterschied? Automatisierte Web-Scraper. Aus einem Tool nur für Entwickler sind sie zu etwas geworden, das jeder Vertriebsmitarbeiter oder Marketer über das Mittagessen einrichten kann.

Ich entwickle seit Jahren SaaS- und Automatisierungstools — und ja, ich habe mitgegründet. Die Tool-Generation von 2026 ist die bislang stärkste: KI-nativ, selbstheilend und tatsächlich auch für Menschen ohne technischen Hintergrund nutzbar.

Hier sind 10 Tools, die ich selbst praktisch getestet und nach Anwendungsfall und Kenntnisstand verglichen habe.

Warum automatisierte Web-Scraper für Business-User wichtig sind

Seien wir ehrlich: Die Zeiten, in denen man Daten manuell von Websites kopiert und einfügt, sind vorbei — außer Sie stehen auf monotone Wiederholungen und existenzielle Verzweiflung. Automatisierte Web-Scraper sind für Unternehmen jeder Größe geschäftskritisch geworden. Tatsächlich investieren , und Web-Scraping ist ein zentraler Baustein dieser Strategie.

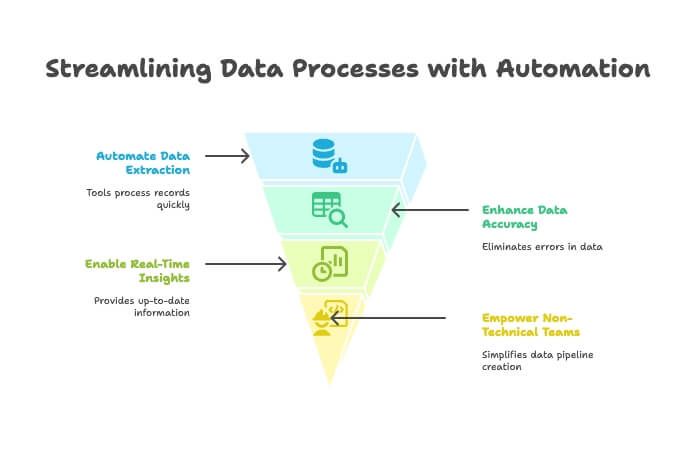

Darum sind diese Tools so wertvoll:

- Zeit sparen und manuelle Arbeit reduzieren: Automatisierte Scraper können Tausende Datensätze in wenigen Minuten verarbeiten und geben Ihrem Team Zeit für Aufgaben mit höherem Wert. Ein Nutzer berichtete, durch die Automatisierung der Datenerfassung „Hunderte Stunden“ gespart zu haben ().

- Datenqualität verbessern: Keine Tippfehler und keine übersehenen Einträge mehr. Automatisches Extrahieren bedeutet sauberere, verlässlichere Daten.

- Schnellere Entscheidungen ermöglichen: Mit Daten in Echtzeit können Sie Wettbewerber beobachten, Preise verfolgen oder Lead-Listen erstellen, ohne auf den monatlichen Praktikumsbericht zu warten.

- Nicht-technische Teams befähigen: Dank No-Code- und KI-gestützter Tools können heute selbst Leute, die „XPath“ für eine Yoga-Pose halten, Web-Daten-Pipelines bauen ().

Es überrascht kaum, dass , und fast 80 % sagen, ihr Unternehmen könne ohne sie nicht effektiv arbeiten. Wenn Sie Ihre Datenerfassung 2026 nicht automatisieren, lassen Sie wahrscheinlich Geld — und Erkenntnisse — auf dem Tisch liegen.

Wie wir die besten automatisierten Web-Scraper ausgewählt haben

Da der Markt für Web-Scraping-Software laut Prognosen , kann sich die Auswahl des richtigen Tools anfühlen wie ein Schuhkauf in einem Laden mit 10.000 Optionen. So habe ich die Auswahl eingegrenzt:

- Benutzerfreundlichkeit: Kann eine Person ohne Entwicklerhintergrund schnell starten? Gibt es eine steile Lernkurve?

- KI-Funktionen: Nutzt das Tool KI, um Datenfelder automatisch zu erkennen, dynamische Seiten zu handhaben oder Anforderungen in einfacher Sprache zu beschreiben?

- Datenexport & Integration: Wie einfach lassen sich Daten in Excel, Google Sheets, Airtable, Notion oder Ihr CRM übertragen?

- Preisgestaltung: Gibt es eine kostenlose Testphase? Sind die kostenpflichtigen Pläne für Einzelpersonen und kleine Teams erschwinglich oder nur für Enterprise-Kunden gedacht?

- Skalierbarkeit: Kann das Tool sowohl kleine Einmalaufgaben als auch große, geplante Extraktionen bewältigen?

- Zielgruppe: Ist es für Business-User, Entwickler oder beide gemacht?

- Besondere Stärken: Was hebt dieses Tool von der Masse ab?

Ich habe Tools für jedes Niveau aufgenommen — von „Ich will einfach nur eine Tabelle“ bis zu „Ich will das ganze Internet crawlen“. Schauen wir uns die Liste an.

1. Thunderbit: Der KI-gestützte Web-Scraper für alle

Ich starte mit dem Tool, das ich am besten kenne — weil mein Team und ich es genau für die Probleme gebaut haben, mit denen Business-User meiner Erfahrung nach seit Jahren kämpfen. ist nicht der typische Scraper mit „Drag-and-Drop“ oder „eigene Selektoren schreiben“. Es ist ein KI-gestützter Datenassistent, dem Sie einfach sagen, was Sie wollen, und der dann die schwere Arbeit übernimmt — kein Code, kein Herumfummeln mit XPath, keine Tränen.

Warum Thunderbit ganz oben steht

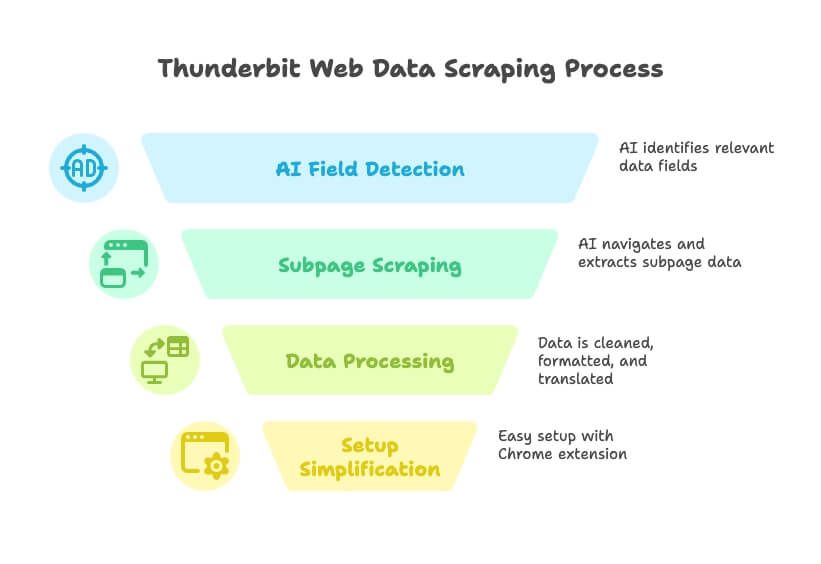

Thunderbit kommt dem, was ich je gesehen habe, am nächsten, um „jede Website in eine Datenbank zu verwandeln“. So funktioniert es:

- Sprachgesteuert in natürlicher Sprache: Sagen Sie Thunderbit einfach, welche Daten Sie brauchen („Ich will alle Firmennamen, E-Mails und Telefonnummern aus diesem Verzeichnis“), und die KI erkennt die relevanten Felder automatisch.

- KI-Vorschläge für Felder: Mit einem Klick liest Thunderbit die Seite und schlägt die besten zu extrahierenden Spalten vor — kein Rätselraten und kein Ausprobieren mehr.

- Unterseiten- und mehrstufiges Scraping: Benötigen Sie Details von jeder Unterseite eines Eintrags? Thunderbit kann sich durchklicken, zusätzliche Infos abrufen und sie Ihrer Tabelle hinzufügen.

- Datenbereinigung, Übersetzung und Klassifizierung: Thunderbit sammelt nicht nur Rohdaten — es kann Felder beim Scrapen bereinigen, formatieren, übersetzen und sogar kategorisieren.

- Kein Einrichtungsstress: Installieren Sie die , klicken Sie auf „KI-Felder vorschlagen“, und schon scrapen Sie in weniger als einer Minute.

- Kostenlose Testphase & niedrige Kosten: Großzügiger Free-Tarif (bis zu 6 Seiten gratis scrapen), kostenpflichtige Pläne ab nur 9 $/Monat. Das ist weniger, als ich pro Woche für Kaffee ausgebe.

Thunderbit ist für Sales-, Marketing- und Operations-Teams gemacht, die schnell Daten brauchen. Kein Programmieren, keine Plugins, keine Schulung nötig. Es ist wie ein Datenpraktikant, der wirklich zuhört und sich nie beschwert.

Die herausragenden Funktionen von Thunderbit

- KI-gestütztes Scraping: Die KI versteht die Seitenstruktur, passt sich an Layoutänderungen an und verarbeitet sogar Pagination und Unterseiten automatisch ().

- Sofortiger Datenexport: Senden Sie Ergebnisse direkt an Excel, Google Sheets, Airtable oder Notion oder laden Sie sie als CSV/JSON herunter.

- Cloud- oder lokale Ausführung: Führen Sie Scrapes in der Cloud für mehr Geschwindigkeit und Skalierung aus oder im Browser, wenn Sie Ihre Login-/Session-Daten benötigen.

- Geplantes Scraping: Richten Sie wiederkehrende Jobs ein, um Ihre Daten aktuell zu halten — ideal für Preisüberwachung oder regelmäßige Lead-Updates.

- Wartungsfrei: Die KI von Thunderbit passt sich Website-Änderungen an, sodass Sie weniger Zeit mit kaputten Scrapern verbringen ().

Für wen ist es gedacht? Für alle, die von „Ich brauche diese Daten“ zu „Hier ist Ihre Tabelle“ in wenigen Minuten kommen wollen — besonders für nicht-technische Nutzer. Mit und einer Bewertung von 4,9★ entwickelt sich Thunderbit schnell zur ersten Wahl für Business-Teams, die Ergebnisse statt Kopfschmerzen wollen.

Möchten Sie es in Aktion sehen? Schauen Sie sich den an oder lesen Sie weitere .

2. Clay: Automatisierte Datenanreicherung trifft Web-Scraping

Clay ist wie das Schweizer Taschenmesser für Growth-Teams. Es ist nicht nur ein Web-Scraper — es ist eine Automatisierungs-Tabelle, die mit über 50 Live-Datenquellen verbunden ist (denken Sie an Apollo, LinkedIn, Crunchbase) und eingebettete KI nutzt, um Leads anzureichern, Outreach-E-Mails zu schreiben und Prospects zu bewerten.

- Workflow-Automatisierung: Jede Zeile ist ein Lead, jede Spalte kann Daten abrufen oder eine Aktion auslösen. Sie wollen eine Unternehmensliste scrapen, mit LinkedIn-Profilen anreichern und eine personalisierte E-Mail versenden? Clay macht’s möglich.

- KI-Integration: Nutzt GPT-4 für Icebreaker, Biografie-Zusammenfassungen und mehr.

- Integrationen: Verbindet sich nativ mit HubSpot, Salesforce, Gmail, Slack und weiteren Tools.

- Preisgestaltung: Der Professional-Plan startet bei etwa 99 $/Monat, mit einer kostenlosen Testphase für leichte Nutzung.

Am besten geeignet für: Outbound-Sales, Growth-Hacker und Marketer, die eigene Lead-Pipelines aufbauen möchten — mit Scraping, Anreicherung und Outreach an einem Ort. Das Tool ist leistungsstark, hat aber eine Lernkurve, wenn Sie neu bei Automatisierungstools sind ().

3. Bardeen: Browserbasiertes Web-Scraper-Tool für Workflow-Automatisierung

Bardeen ist, als hätten Sie einen Browser-Roboter, der Daten scrapen und wiederkehrende Webaufgaben automatisieren kann — alles über eine Chrome-Erweiterung.

- No-Code-Automatisierung: Über 500 „Playbooks“ zum Scrapen, Ausfüllen von Formularen, Verschieben von Daten zwischen Apps und mehr.

- KI-Befehlsgenerator: Beschreiben Sie Ihre Aufgabe in einfacher Sprache, und Bardeen baut den Workflow.

- Integrationen: Funktioniert mit Notion, Trello, Slack, Salesforce und über 100 weiteren Apps.

- Preisgestaltung: Für leichte Nutzung kostenlos (100 Automatisierungs-Credits/Monat), kostenpflichtige Pläne ab 99 $/Monat für Teams.

Am besten geeignet für: Power-User und Go-to-Market-Teams, die Scraping und Folgeaktionen über mehrere Apps hinweg automatisieren wollen. Es gibt viel Flexibilität, aber Einsteiger könnten die Lernkurve etwas steil finden ().

4. Bright Data: Automatisierte Web-Scraper auf Enterprise-Niveau

Bright Data (früher Luminati) ist die Schwerindustrie des Web-Scrapings — denken Sie an globale Proxy-Netzwerke, fortschrittliche APIs und die Möglichkeit, Tausende Seiten pro Tag zu crawlen.

- Für Enterprise-Scale: Über 100 Millionen IPs, Web Scraper IDE, Web Unlocker zum Umgehen von Anti-Bot-Maßnahmen.

- Anpassbar: Erstellen Sie komplexe, groß angelegte Extraktionen mit hoher Zuverlässigkeit.

- Preisgestaltung: Ab 499 $/Monat für die Web Scraper IDE, kleinere Micro-Pakete sind ebenfalls verfügbar.

Am besten geeignet für: Große Unternehmen, Datenaggregatoren und fortgeschrittene Nutzer, die robuste, skalierbare Lösungen brauchen. Wenn Sie täglich Tausende Seiten crawlen und IP-Sperren vermeiden müssen, ist Bright Data dafür gebaut ().

5. Octoparse: Visuelles Web-Scraper-Tool für fortgeschrittene Nutzer

Octoparse ist ein beliebtes No-Code-Tool mit einer visuellen Point-and-Click-Oberfläche — perfekt für Nutzer, die Leistung ohne Programmierung wollen.

- Drag-and-Drop-UI: Klicken Sie Elemente an, um festzulegen, was extrahiert werden soll, und handhaben Sie Logins, Pagination und mehr.

- Vorlagen: Über 500 fertige Vorlagen für gängige Websites (Amazon, Twitter usw.).

- Cloud-Scraping: Führen Sie Jobs auf den Servern von Octoparse aus, planen Sie Extraktionen und nutzen Sie IP-Rotation.

- Preisgestaltung: Kostenloser Plan mit Einschränkungen; kostenpflichtige Pläne ab 119 $/Monat.

Am besten geeignet für: Nicht-Programmierer und Datenanalysten, die einen leistungsfähigen Scraper ohne Code wollen. Ideal für Preisüberwachung, Produktlisten und Rechercheprojekte ().

6. : Daten-Scraping-Plattform für Unternehmen

ist einer der OGs des Web-Scrapings und hat sich inzwischen zu einer vollwertigen Datenextraktionsplattform entwickelt.

- Point-and-Click-Extraktion: Handhabt Logins, Dropdowns und interaktive Elemente.

- Cloud-basiert: Verarbeitet Tausende URLs parallel, plant Extraktionen und bietet API-Zugriff.

- Enterprise-Fokus: Wird für Preisüberwachung, Marktforschung und den Aufbau von Machine-Learning-Datensätzen eingesetzt.

- Preisgestaltung: Starter-Plan ab 199 $/Monat, Standard ab 599 $/Monat, Advanced ab 1.099 $/Monat.

Am besten geeignet für: Mittlere bis große Unternehmen und Datenteams, die zuverlässige, gepflegte Lösungen für große Aufgaben benötigen. Für Hobbyprojekte wahrscheinlich überdimensioniert, aber ein Kraftpaket für Anforderungen auf Business-Niveau ().

7. Parsehub: Flexibles Web-Scraper-Tool mit visuellem Editor

Parsehub ist eine Desktop-App (Windows, Mac, Linux), mit der Sie Scraper erstellen, indem Sie sich durch die Benutzeroberfläche einer Website klicken.

- Visueller Workflow: Elemente auswählen, Extraktionsregeln einrichten und Logins, Dropdowns sowie Infinite Scroll handhaben.

- Cloud-Funktionen: Scrapes in der Cloud ausführen, Jobs planen und API-Zugriff nutzen.

- Preisgestaltung: Kostenloser Tarif für kleine Aufgaben; kostenpflichtige Pläne ab 149 $/Monat.

Am besten geeignet für: Forscher, kleine Unternehmen oder Einzelpersonen, die mehr Kontrolle als mit einer Browser-Erweiterung wollen, aber noch keinen eigenen Scraper programmieren möchten ().

8. Common Crawl: Offene Webdaten für KI und Forschung

Common Crawl ist im klassischen Sinn kein Tool — sondern ein riesiger offener Datensatz von Web-Crawl-Daten, der monatlich aktualisiert wird.

- Skalierung: Rund 400 TB Webdaten, die Milliarden von Webseiten abdecken.

- Kostenlos und offen: Sie müssen keinen eigenen Crawler betreiben.

- Technische Kenntnisse erforderlich: Sie brauchen Big-Data-Tools und etwas Engineering-Know-how, um die Daten zu filtern und zu parsen.

Am besten geeignet für: Data Scientists und Engineers, die KI-Modelle bauen oder groß angelegte Forschung betreiben. Wenn Sie allgemeinen Webtext oder langfristige Archive brauchen, ist das eine Goldgrube ().

9. Crawly: Leichtgewichtiges automatisiertes Web-Scraper-Tool für Start-ups

Crawly (von Diffbot) ist ein cloudbasierter, KI-gestützter Crawler, der Daten von Millionen Websites erfassen und strukturierte Ergebnisse zurückgeben kann — ohne Parsing-Regeln.

- KI-Extraktion: Nutzt Computer Vision und NLP, um Inhalte zu erkennen und zu extrahieren.

- API-Zugriff: Fragen Sie die gesammelten Daten ab und integrieren Sie sie in Analytics oder Datenbanken.

- Preisgestaltung: Enterprise-Niveau; Preis auf Anfrage.

Am besten geeignet für: Start-ups und Teams mit etwas technischem Hintergrund, die groß angelegte, intelligente Web-Datenextraktion brauchen, ohne eigene Scraper zu bauen ().

10. Apify: Entwicklerfreundliches Web-Scraper-Tool mit Marktplatz

Apify ist eine Cloud-Plattform, auf der Sie eigene Scraper („Actors“) bauen oder eine Bibliothek vorgefertigter Community-Scraper nutzen können.

- Entwicklerflexibilität: Unterstützt Scraping mit JavaScript/Python, Headless Chrome, Proxy-Management und Scheduling.

- Marktplatz: Umfangreiche Bibliothek fertiger Scraper für gängige Websites.

- Preisgestaltung: Kostenloser Tarif mit 5 $/Monat Credits; kostenpflichtige Pläne ab 49 $/Monat.

Am besten geeignet für: Entwickler und technikaffine Analysten, die volle Kontrolle und Skalierbarkeit wollen. Selbst Nicht-Programmierer können vorgefertigte Actors für gängige Aufgaben nutzen ().

Vergleichstabelle der automatisierten Web-Scraper

| Tool | Benutzerfreundlichkeit | KI-Funktionen | Preis (ab) | Zielgruppe | Besondere Stärken |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Natürliche Sprache, KI-Felder vorschlagen, Unterseiten-Scraping | 9 $/Monat | Nicht-technische Business-User | Einrichtung in 2 Klicks, kein Code, Sofort-Export, kostenlose Testphase |

| Clay | ★★★★☆ | KI-Anreicherung, GPT-4 | 99 $/Monat | Growth-/Sales-Operations | Automatisierungs-Tabelle, Anreicherung, Outreach |

| Bardeen | ★★★★☆ | KI-Befehlsgenerator | 99 $/Monat | Power-User, GTM-Teams | Browser-RPA, über 500 Playbooks, tiefe Integrationen |

| Bright Data | ★★☆☆☆ | Proxy-Rotation, Anti-Bot-KI | 499 $/Monat | Unternehmen, Entwickler | Skalierung, Zuverlässigkeit, globale Proxys |

| Octoparse | ★★★★☆ | Visuelle KI-Erkennung | 119 $/Monat | Analysten, Nicht-Programmierer | Drag-and-Drop, Vorlagen, Cloud-Scraping |

| Import.io | ★★★☆☆ | Interaktive Extraktoren | 199 $/Monat | Unternehmen, Datenteams | Parallelität, Scheduling, API, Support |

| Parsehub | ★★★★☆ | Visuelle Workflows | 149 $/Monat | Forscher, KMU | Desktop-App, handhabt dynamische Websites |

| Common Crawl | ★☆☆☆☆ | N. a. (nur Datensatz) | Kostenlos | Data Scientists, Engineers | Riesiger offener Datensatz, Web-Scale-Archive |

| Crawly | ★★☆☆☆ | KI-Extraktion | Individuell/Enterprise | Start-ups, Tech-Teams | KI-gestützt, keine Parsing-Regeln, API-Zugriff |

| Apify | ★★★★☆ | Actor-Marktplatz | 49 $/Monat | Entwickler, Tech-Analysten | Baukasten/Marktplatz, Cloud-Automatisierung, Flexibilität |

So wählen Sie das richtige Web-Scraper-Tool für Ihre Anforderungen aus

Das beste automatisierte Web-Scraper-Tool hängt von Teamgröße, technischen Fähigkeiten und Geschäftszielen ab. Hier ist mein kurzer Leitfaden:

- Für nicht-technische Nutzer (Sales, Marketing, Ops): Nehmen Sie . Es ist für Sie gemacht — kein Code, kein Setup, einfach Ergebnisse. Perfekt für Lead-Generierung, Preisüberwachung und schnelle Datenprojekte.

- Für Teams, die Automatisierung lieben: Clay und Bardeen glänzen, wenn Sie Scraping mit Anreicherung, Outreach oder Workflow-Automatisierung kombinieren wollen.

- Für Unternehmen & Entwickler: Bright Data, und Apify sind die besten Optionen für groß angelegte, stark anpassbare Projekte.

- Für Forscher & Analysten: Octoparse und Parsehub bieten visuelle Oberflächen und leistungsstarke Funktionen ohne Programmieraufwand.

- Für KI- und Data-Science-Projekte: Common Crawl und Crawly liefern riesige Datensätze und KI-gestützte Extraktion für alle, die Modelle bauen oder trainieren möchten.

Fragen Sie sich: Möchten Sie in wenigen Minuten loslegen, oder brauchen Sie eine maßgeschneiderte Lösung auf Enterprise-Niveau? Wenn Sie unsicher sind, starten Sie mit einer kostenlosen Testphase — die meisten Tools bieten eine an.

Der einzigartige Wert von Thunderbit: KI-Assistent für Geschäftsdaten

Unter all diesen Tools hebt sich Thunderbit als das einzige hervor, das wirklich als „KI-Assistent“ für Web-Scraping und Datentransformation fungiert. Es geht nicht nur darum, Daten zu ziehen — sondern darum, unübersichtliche Websites ohne technische Hürden in saubere, strukturierte Erkenntnisse zu verwandeln.

- Oberfläche in natürlicher Sprache: Beschreiben Sie Ihren Bedarf auf Deutsch, und Thunderbit erledigt den Rest.

- Vollständige Workflow-Automatisierung: Von der Extraktion über Bereinigung und Übersetzung bis hin zum Export — Thunderbit deckt den gesamten Prozess ab.

- Perfekt für schnelles Experimentieren: Müssen Sie einen neuen Markt validieren, eine Lead-Liste aufbauen oder Wettbewerber überwachen? Thunderbit ist der schnellste und günstigste Einstieg.

Es ist, als hätte man einen Datenanalysten direkt im Browser — einen, der nie nach einer Gehaltserhöhung fragt und nie Urlaub nimmt.

Fazit: Starten Sie smarter mit dem richtigen automatisierten Web-Scraper-Tool

Die Scraping-Landschaft von 2026 ist kaum noch mit der von vor zwei Jahren zu vergleichen. Selbstheilende KI-Scraper, LLM-native Pipelines und wirklich nutzbare No-Code-Tools haben das Spiel verändert. Ob Sie Solo-Gründer, ein kleines, schlagkräftiges Sales-Team oder Data Scientist in einem Großunternehmen sind — in dieser Liste gibt es ein Tool, das zu Ihren Anforderungen passt. Entscheidend ist, Workflow und Fähigkeiten mit der richtigen Plattform abzugleichen, damit Sie aufhören können, mit Code zu ringen, und anfangen, Erkenntnisse freizusetzen.

Wenn Sie bereit sind, das manuelle Copy-and-Paste hinter sich zu lassen und smarter zu starten, und erleben Sie, wie einfach Web-Scraping sein kann. Oder erkunden Sie die anderen Optionen oben — je nach Ihren Zielen. So oder so: Die Zukunft datengetriebener Unternehmen gehört denen, die automatisieren.

Neugierig auf mehr? Schauen Sie im vorbei für tiefere Einblicke, Tutorials und Tipps, wie Sie das Beste aus Ihren Webdaten herausholen. Viel Spaß beim Scrapen — und denken Sie daran: Mögen Ihre Daten immer sauber sein und Ihre Scraper nie kaputtgehen (und falls doch, soll die KI sich darum kümmern).

FAQs

1. Warum sind automatisierte Web-Scraper 2026 für Business-User wichtig?

Automatisierte Web-Scraper vereinfachen die Datenerfassung, sparen Zeit und reduzieren manuelle Arbeit. Sie verbessern die Datenqualität, unterstützen Entscheidungen in Echtzeit und befähigen nicht-technische Teams, Webdaten ohne Programmierung zu extrahieren und zu nutzen. Diese Tools sind heute für Sales, Marketing und Operations unverzichtbar.

2. Was unterscheidet Thunderbit von anderen Web-Scraping-Tools?

Thunderbit nutzt KI, damit Nutzer beschreiben können, welche Daten sie in einfacher Sprache benötigen. Es erkennt Datenfelder automatisch, verarbeitet Unterseiten und Pagination und exportiert Ergebnisse sofort an Plattformen wie Excel und Airtable. Es ist für nicht-technische Nutzer konzipiert und bietet leistungsstarke Funktionen wie Datenbereinigung und geplantes Scraping zu einem niedrigen Preis.

3. Welches Tool ist am besten für groß angelegte Enterprise-Scraping-Projekte geeignet?

Bright Data und sind ideal für den Unternehmenseinsatz. Sie bieten Funktionen wie Proxy-Rotation, Anti-Bot-Maßnahmen, hohe Parallelität und API-Zugriff und eignen sich damit für Organisationen, die Tausende Webseiten zuverlässig und in großem Umfang verarbeiten müssen.

4. Gibt es Tools, die Scraping mit Automatisierung und Outreach kombinieren?

Ja, Tools wie Clay und Bardeen scrapen nicht nur Webdaten, sondern integrieren sie auch in Workflows. Clay reichert Leads an und automatisiert Outreach, während Bardeen es Nutzern ermöglicht, browserbasierte Aufgaben und Workflows mit KI-gesteuerten Playbooks zu automatisieren.

5. Was ist die beste Option für Nutzer ohne technischen Hintergrund?

Thunderbit hebt sich für nicht-technische Nutzer durch seine Oberfläche in natürlicher Sprache, die KI-gestützte Einrichtung und die einfache Bedienung hervor. Es erfordert weder Programmierung noch Setup und ist ideal für Business-User, die schnell verlässliche Daten ohne technische Komplexität benötigen.