Seien wir ehrlich: Amazon ist im Grunde Einkaufszentrum, Supermarkt und Elektronikladen für das ganze Internet. Wenn Sie im Vertrieb, im E-Commerce oder im Operations-Bereich arbeiten, wissen Sie längst, dass das, was auf Amazon passiert, nicht auf Amazon bleibt – es beeinflusst Ihre Preisgestaltung, Ihren Lagerbestand und sogar den nächsten großen Produktlaunch. Aber genau da liegt das Problem: All diese spannenden Produktdetails, Preise, Bewertungen und Rezensionen stecken hinter einer Weboberfläche, die für Käufer gebaut wurde, nicht für datenhungrige Teams. Wie kommen Sie also an diese Daten, ohne am Wochenende alles per Copy & Paste zusammenzuklicken, als wäre es 1999?

Genau hier kommt Web-Scraping ins Spiel. In diesem Leitfaden zeige ich Ihnen zwei Wege, Amazon-Produktdaten zu extrahieren: den klassischen Ansatz „Ärmel hochkrempeln und in Python programmieren“ sowie den modernen Weg „KI die Schwerstarbeit erledigen lassen“ mit einem No-Code-Web-Scraper wie . Ich führe Sie durch echten Python-Code, inklusive aller Stolperfallen und Workarounds, und zeige Ihnen anschließend, wie Thunderbit dieselben Daten in nur wenigen Klicks liefert – ganz ohne Programmierung. Egal, ob Sie Entwickler, Business Analyst oder einfach jemand sind, der genug von manueller Dateneingabe hat: Hier sind Sie richtig.

Warum Amazon-Produktdaten extrahieren? (amazon scraper python, web scraping with python)

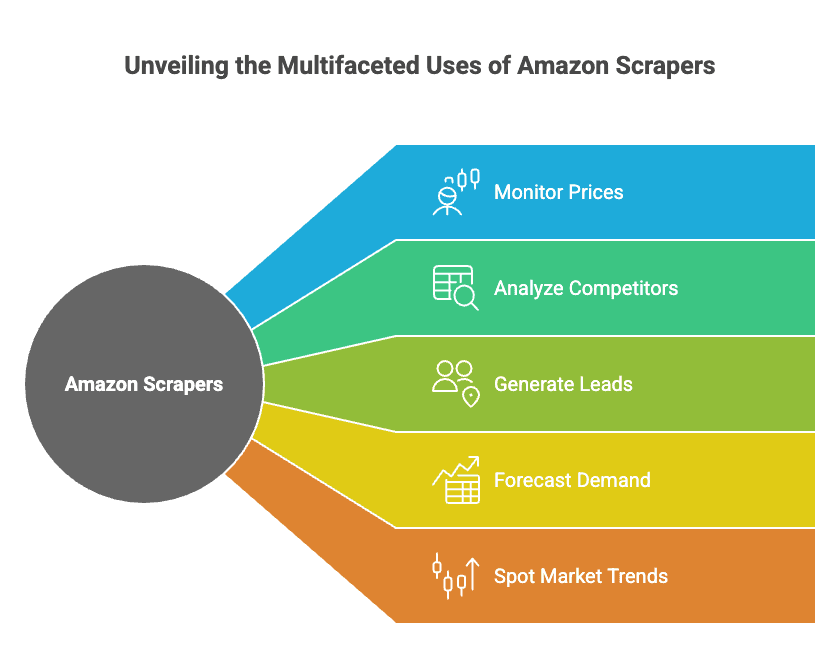

Amazon ist nicht nur der weltweit größte Onlinehändler – es ist auch der weltweit größte offene Marktplatz für Competitive Intelligence. Mit und ist Amazon eine Goldgrube für alle, die:

- Preise überwachen (und die eigenen Preise in Echtzeit anpassen)

- Wettbewerber analysieren (neue Produkteinführungen, Bewertungen und Rezensionen verfolgen)

- Leads generieren (Verkäufer, Lieferanten oder sogar potenzielle Partner finden)

- Nachfrage prognostizieren (indem Lagerbestände und Verkaufsrang beobachtet werden)

- Markttrends erkennen (durch das Auswerten von Rezensionen und Suchergebnissen)

Und das ist nicht nur Theorie – echte Unternehmen sehen echte Rendite. So konnte beispielsweise ein Elektronikhändler mit gescrapten Amazon-Preisdaten , während eine andere Marke nach der Automatisierung des Wettbewerber-Preis-Monitorings einen verzeichnete.

Hier ist eine kurze Tabelle mit Anwendungsfällen und der typischen Rendite, die Sie erwarten können:

| Anwendungsfall | Wer nutzt ihn | Typischer ROI / Nutzen |

|---|---|---|

| Preisüberwachung | E-Commerce, Operations | 15 %+ höhere Gewinnmarge, 4 % mehr Umsatz, 30 % weniger Analystenzeit |

| Wettbewerbsanalyse | Vertrieb, Produkt, Operations | Schnellere Preisanpassungen, bessere Wettbewerbsfähigkeit |

| Marktforschung (Rezensionen) | Produkt, Marketing | Schnellere Produktiteration, bessere Anzeigentexte, SEO-Erkenntnisse |

| Lead-Generierung | Vertrieb | 3.000+ Leads/Monat, 8+ Stunden pro Mitarbeiter und Woche eingespart |

| Bestands- und Nachfrageprognose | Operations, Supply Chain | 20 % weniger Überbestand, weniger Lagerengpässe |

| Trend-Erkennung | Marketing, Führungsebene | Frühe Erkennung gefragter Produkte und Kategorien |

Und jetzt kommt der eigentliche Punkt: berichten mittlerweile von messbarem Nutzen durch Datenanalyse. Wenn Sie Amazon nicht scrapen, lassen Sie Erkenntnisse – und Geld – liegen.

Überblick: Amazon Scraper Python vs. No-Code-Web-Scraper-Tools

Es gibt zwei Hauptwege, Amazon-Daten aus dem Browser in Ihre Tabellen oder Dashboards zu bringen:

-

Amazon Scraper Python (web scraping with python):

Schreiben Sie Ihr eigenes Skript mit Python-Bibliotheken wie Requests und BeautifulSoup. Das gibt Ihnen volle Kontrolle, aber Sie müssen programmieren können, Anti-Bot-Maßnahmen handhaben und Ihr Skript pflegen, wenn Amazon seine Website ändert.

-

No-Code-Web-Scraper-Tools (wie Thunderbit):

Nutzen Sie ein Tool, mit dem Sie per Zeigen, Klicken und Extrahieren Daten erfassen können – ganz ohne Programmierung. Moderne Tools wie setzen sogar KI ein, um herauszufinden, welche Daten geholt werden sollen, Unterseiten und Pagination zu verarbeiten und direkt nach Excel oder Google Sheets zu exportieren.

So schneiden die beiden Ansätze ab:

| Kriterium | Python-Scraper | No-Code (Thunderbit) |

|---|---|---|

| Einrichtungszeit | Hoch (installieren, programmieren, debuggen) | Gering (Erweiterung installieren) |

| Erforderliche Kenntnisse | Programmieren erforderlich | Keine (zeigen & klicken) |

| Flexibilität | Unbegrenzt | Hoch für gängige Anwendungsfälle |

| Wartung | Sie beheben den Code | Das Tool aktualisiert sich selbst |

| Anti-Bot-Behandlung | Sie kümmern sich um Proxys und Header | Integriert, für Sie übernommen |

| Skalierbarkeit | Manuell (Threads, Proxys) | Cloud-Scraping, parallelisiert |

| Datenexport | Individuell (CSV, Excel, DB) | Mit einem Klick nach Excel, Sheets |

| Kosten | Kostenlos (Ihre Zeit + Proxys) | Freemium, bezahlt wird bei größerem Umfang |

In den nächsten Abschnitten führe ich Sie durch beide Ansätze – zuerst, wie Sie mit Python einen Amazon-Scraper bauen (mit echtem Code), und dann, wie Sie dasselbe mit Thunderbits KI-Web-Scraper erledigen.

Einstieg in Amazon Scraper Python: Voraussetzungen & Setup

Bevor wir in den Code einsteigen, richten wir Ihre Umgebung ein.

Sie benötigen:

- Python 3.x (Download von )

- Einen Code-Editor (ich mag VS Code, aber jedes Tool funktioniert)

- Die folgenden Bibliotheken:

requests(für HTTP-Anfragen)beautifulsoup4(für HTML-Parsing)lxml(schneller HTML-Parser)pandas(für Datentabellen/Export)re(reguläre Ausdrücke, eingebaut)

Bibliotheken installieren:

1pip install requests beautifulsoup4 lxml pandasProjekt-Setup:

- Erstellen Sie einen neuen Ordner für Ihr Projekt.

- Öffnen Sie Ihren Editor, legen Sie eine neue Python-Datei an (z. B.

amazon_scraper.py). - Los geht’s!

Schritt für Schritt: Web-Scraping mit Python für Amazon-Produktdaten

Schauen wir uns an, wie man eine einzelne Amazon-Produktseite scrapt. (Keine Sorge, das Scrapen mehrerer Produkte und Seiten kommt gleich noch.)

1. Anfragen senden und HTML abrufen

Zuerst holen wir das HTML einer Produktseite. (Ersetzen Sie die URL durch ein beliebiges Amazon-Produkt.)

1import requests

2url = "<https://www.amazon.com/dp/B0ExampleASIN>"

3response = requests.get(url)

4html_content = response.text

5print(response.status_code)Achtung: Diese einfache Anfrage wird von Amazon wahrscheinlich blockiert. Statt der Produktseite sehen Sie möglicherweise einen 503-Fehler oder ein CAPTCHA. Warum? Weil Amazon weiß, dass Sie kein echter Browser sind.

Amazons Anti-Bot-Maßnahmen umgehen

Amazon ist kein Fan von Bots. Um nicht blockiert zu werden, sollten Sie:

- Einen User-Agent-Header setzen (also so tun, als wären Sie Chrome oder Firefox)

- User-Agents rotieren (nicht jedes Mal denselben verwenden)

- Anfragen drosseln (zufällige Verzögerungen einbauen)

- Proxys nutzen (für Scraping in größerem Umfang)

So setzen Sie Header:

1headers = {

2 "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64)... Safari/537.36",

3 "Accept-Language": "en-US,en;q=0.9",

4}

5response = requests.get(url, headers=headers)Möchten Sie es etwas ausgefeilter? Verwenden Sie eine Liste von User-Agents und rotieren Sie sie für jede Anfrage. Für größere Projekte sollten Sie einen Proxy-Dienst einsetzen (davon gibt es viele), aber für kleinere Scraping-Aufgaben reichen Header und Verzögerungen meist aus.

Wichtige Produktfelder extrahieren

Sobald Sie das HTML haben, parsen Sie es mit BeautifulSoup.

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html_content, "lxml")Jetzt ziehen wir uns die wichtigsten Daten heraus:

Produkttitel

1title_elem = soup.find(id="productTitle")

2product_title = title_elem.get_text(strip=True) if title_elem else NonePreis

Amazon-Preise können an mehreren Stellen stehen. Probieren Sie diese Varianten:

1price = None

2price_elem = soup.find(id="priceblock_ourprice") or soup.find(id="priceblock_dealprice")

3if price_elem:

4 price = price_elem.get_text(strip=True)

5else:

6 price_whole = soup.find("span", {"class": "a-price-whole"})

7 price_frac = soup.find("span", {"class": "a-price-fraction"})

8 if price_whole and price_frac:

9 price = price_whole.text + price_frac.textBewertung und Anzahl der Rezensionen

1rating_elem = soup.find("span", {"class": "a-icon-alt"})

2rating = rating_elem.get_text(strip=True) if rating_elem else None

3review_count_elem = soup.find(id="acrCustomerReviewText")

4reviews_text = review_count_elem.get_text(strip=True) if review_count_elem else ""

5reviews_count = reviews_text.split()[0] # z. B. "1,554 ratings"Hauptbild-URL

Amazon versteckt hochauflösende Bilder manchmal in JSON innerhalb des HTML. Hier ist ein schneller Regex-Ansatz:

1import re

2match = re.search(r'"hiRes":"(https://.*?.jpg)"', html_content)

3main_image_url = match.group(1) if match else NoneOder Sie greifen direkt das Hauptbild-Tag ab:

1img_tag = soup.find("img", {"id": "landingImage"})

2img_url = img_tag['src'] if img_tag else NoneProduktdetails

Spezifikationen wie Marke, Gewicht und Maße stehen meist in einer Tabelle:

1details = {}

2rows = soup.select("#productDetails_techSpec_section_1 tr")

3for row in rows:

4 header = row.find("th").get_text(strip=True)

5 value = row.find("td").get_text(strip=True)

6 details[header] = valueOder, wenn Amazon das „detailBullets“-Format verwendet:

1bullets = soup.select("#detailBullets_feature_div li")

2for li in bullets:

3 txt = li.get_text(" ", strip=True)

4 if ":" in txt:

5 key, val = txt.split(":", 1)

6 details[key.strip()] = val.strip()Geben Sie Ihre Ergebnisse aus:

1print("Titel:", product_title)

2print("Preis:", price)

3print("Bewertung:", rating, "basierend auf", reviews_count, "Rezensionen")

4print("Hauptbild-URL:", main_image_url)

5print("Details:", details)Mehrere Produkte scrapen und Pagination verarbeiten

Ein Produkt ist nett, aber wahrscheinlich brauchen Sie eine ganze Liste. So scrapen Sie Suchergebnisse und mehrere Seiten.

Produktlinks von einer Suchseite holen

1search_url = "<https://www.amazon.com/s?k=bluetooth+headphones>"

2res = requests.get(search_url, headers=headers)

3soup = BeautifulSoup(res.text, "lxml")

4product_links = []

5for a in soup.select("h2 a.a-link-normal"):

6 href = a['href']

7 full_url = "<https://www.amazon.com>" + href

8 product_links.append(full_url)Pagination handhaben

Amazons Such-URLs nutzen &page=2, &page=3 usw.

1for page in range(1, 6): # erste 5 Seiten scrapen

2 search_url = f"<https://www.amazon.com/s?k=bluetooth+headphones&page=\{page\}>"

3 res = requests.get(search_url, headers=headers)

4 if res.status_code != 200:

5 break

6 soup = BeautifulSoup(res.text, "lxml")

7 # ... Produktlinks wie oben extrahieren ...Über Produktseiten iterieren und nach CSV exportieren

Sammeln Sie Ihre Produktdaten in einer Liste von Dictionaries und nutzen Sie dann pandas:

1import pandas as pd

2df = pd.DataFrame(product_data_list) # Liste von Dicts

3df.to_csv("amazon_products.csv", index=False)Oder nach Excel:

1df.to_excel("amazon_products.xlsx", index=False)Best Practices für Amazon-Scraper-Python-Projekte

Seien wir ehrlich: Amazon ändert seine Website ständig und bekämpft Scraper aktiv. So bleibt Ihr Projekt stabil:

- Header und User-Agents rotieren (verwenden Sie eine Bibliothek wie

fake-useragent) - Proxys für Scraping in großem Umfang nutzen

- Anfragen drosseln (zufälliges

time.sleep()zwischen den Anfragen) - Fehler sauber behandeln (bei 503 erneut versuchen, bei Blockierung langsamer werden)

- Flexible Parsing-Logik schreiben (pro Feld mehrere Selektoren prüfen)

- Auf HTML-Änderungen achten (wenn Ihr Skript plötzlich überall

Nonezurückgibt, prüfen Sie die Seite) - robots.txt respektieren (Amazon untersagt das Scraping vieler Bereiche – verantwortungsvoll scrapen)

- Daten unterwegs bereinigen (Währungszeichen, Kommas und Leerzeichen entfernen)

- Mit der Community verbunden bleiben (Foren, Stack Overflow, Reddit’s r/webscraping)

Checkliste für die Pflege Ihres Scrapers:

- [ ] User-Agents und Header rotieren

- [ ] Proxys bei großem Umfang verwenden

- [ ] Zufällige Verzögerungen einbauen

- [ ] Den Code modular aufbauen, damit Updates leichter sind

- [ ] Auf Sperren oder CAPTCHAs achten

- [ ] Daten regelmäßig exportieren

- [ ] Selektoren und Logik dokumentieren

Für einen tieferen Einblick lesen Sie meinen .

Die No-Code-Alternative: Amazon mit Thunderbit AI Web Scraper scrapen

Okay, Sie haben also den Python-Weg gesehen. Aber was, wenn Sie gar nicht programmieren wollen – oder einfach in zwei Klicks an die Daten kommen und dann weitermachen möchten? Genau dafür gibt es .

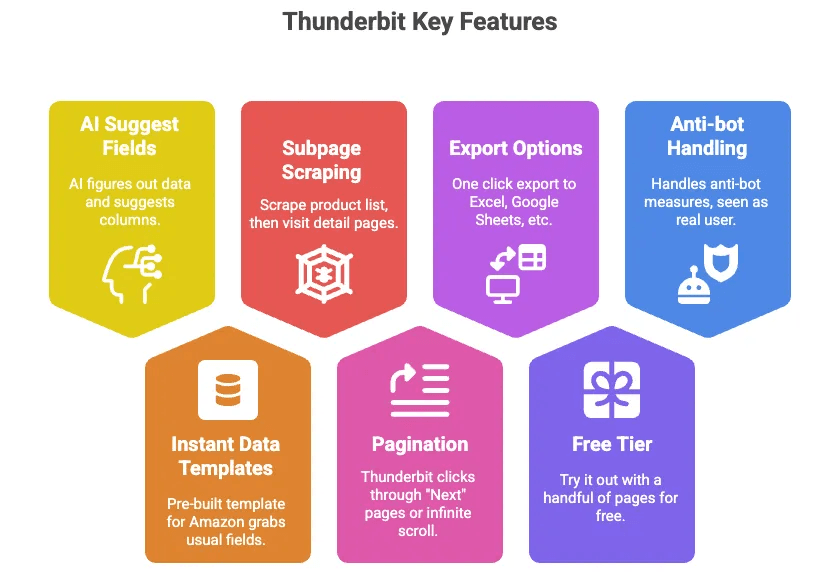

Thunderbit ist eine KI-Web-Scraper-Chrome-Erweiterung, mit der Sie Amazon-Produktdaten – und Daten von praktisch jeder Website – ganz ohne Programmierung extrahieren können. Deshalb gefällt mir das Tool so gut:

- KI-Feldvorschläge: Einfach auf eine Schaltfläche klicken, und die KI von Thunderbit erkennt, welche Daten auf der Seite vorhanden sind, und schlägt Spalten vor (z. B. Titel, Preis, Bewertung usw.).

- Sofortige Datenvorlagen: Für Amazon gibt es eine vorgefertigte Vorlage, die alle üblichen Felder erfasst – ohne Setup.

- Unterseiten-Scraping: Scrapen Sie eine Produktliste und lassen Sie Thunderbit anschließend die Detailseite jedes Produkts besuchen, um automatisch mehr Informationen zu ziehen.

- Pagination: Thunderbit kann für Sie durch „Weiter“-Seiten klicken oder Infinite Scroll verarbeiten.

- Export nach Excel, Google Sheets, Airtable, Notion: Ein Klick, und Ihre Daten sind einsatzbereit.

- Kostenlose Stufe: Testen Sie das Tool mit einigen Seiten gratis.

- Anti-Bot-Sachen werden für Sie übernommen: Da das Tool in Ihrem Browser (oder in der Cloud) läuft, erscheint Amazon es als echter Nutzer.

Schritt für Schritt: Mit Thunderbit Amazon-Produktdaten scrapen

So einfach geht’s:

-

Thunderbit installieren:

Laden Sie die herunter und melden Sie sich an.

-

Amazon öffnen:

Gehen Sie auf die Amazon-Seite, die Sie scrapen möchten (Suchergebnisse, Produktdetailseite, was auch immer).

-

„KI-Felder vorschlagen“ klicken oder eine Vorlage nutzen:

Thunderbit schlägt Spalten zum Extrahieren vor (oder Sie wählen die Amazon-Produktvorlage).

-

Spalten prüfen:

Passen Sie die Spalten bei Bedarf an (Felder hinzufügen/entfernen, umbenennen usw.).

-

„Scrapen“ klicken:

Thunderbit holt die Daten von der Seite und zeigt sie in einer Tabelle an.

-

Unterseiten & Pagination verarbeiten:

Wenn Sie eine Liste gescrapt haben, klicken Sie auf „Unterseiten scrapen“, um die Detailseite jedes Produkts zu besuchen und mehr Informationen zu ziehen. Thunderbit kann auch automatisch durch „Weiter“-Seiten klicken.

-

Daten exportieren:

Klicken Sie auf „Nach Excel exportieren“ oder „Nach Google Sheets exportieren“. Fertig.

-

(Optional) Scraping planen:

Sie brauchen diese Daten jeden Tag? Nutzen Sie den Thunderbit-Planer, um den Vorgang zu automatisieren.

Das war’s. Kein Code, kein Debugging, keine Proxys, kein Stress. Für eine visuelle Anleitung schauen Sie auf den oder auf die .

Amazon Scraper Python vs. No-Code-Web-Scraper: Direktvergleich

Fassen wir alles zusammen:

| Kriterium | Python-Scraper | Thunderbit (No-Code) |

|---|---|---|

| Einrichtungszeit | Hoch (installieren, programmieren, debuggen) | Gering (Erweiterung installieren) |

| Erforderliche Kenntnisse | Programmieren erforderlich | Keine (zeigen & klicken) |

| Flexibilität | Unbegrenzt | Hoch für gängige Anwendungsfälle |

| Wartung | Sie beheben den Code | Das Tool aktualisiert sich selbst |

| Anti-Bot-Behandlung | Sie kümmern sich um Proxys und Header | Integriert, für Sie übernommen |

| Skalierbarkeit | Manuell (Threads, Proxys) | Cloud-Scraping, parallelisiert |

| Datenexport | Individuell (CSV, Excel, DB) | Mit einem Klick nach Excel, Sheets |

| Kosten | Kostenlos (Ihre Zeit + Proxys) | Freemium, bezahlt wird bei größerem Umfang |

| Am besten geeignet für | Entwickler, individuelle Anforderungen | Geschäftsanwender, schnelle Ergebnisse |

Wenn Sie Entwickler sind, der gerne tüftelt und etwas sehr Individuelles braucht, ist Python Ihr Freund. Wenn Sie Geschwindigkeit, Einfachheit und null Code wollen, ist Thunderbit der richtige Weg.

Wann Sie Python, No-Code oder einen KI-Web-Scraper für Amazon-Daten wählen sollten

Nehmen Sie Python, wenn:

- Sie individuelle Logik brauchen oder Scraping in Backend-Systeme integrieren möchten

- Sie in sehr großem Umfang scrapen (Zehntausende Produkte)

- Sie verstehen wollen, wie Scraping technisch funktioniert

Nehmen Sie Thunderbit (No-Code, KI-Web-Scraper), wenn:

- Sie schnell Daten brauchen, ohne zu programmieren

- Sie Business-User, Analyst oder Marketer sind

- Sie Ihrem Team ermöglichen wollen, Daten selbst zu beschaffen

- Sie den Aufwand für Proxys, Anti-Bot-Maßnahmen und Wartung vermeiden möchten

Nutzen Sie beides, wenn:

- Sie mit Thunderbit schnell einen Prototypen bauen und dann für den produktiven Einsatz eine maßgeschneiderte Python-Lösung entwickeln wollen

- Sie Thunderbit für die Datenerfassung und Python für Bereinigung/Analyse nutzen möchten

Für die meisten Geschäftsanwender deckt Thunderbit 90 % der Amazon-Scraping-Anforderungen in einem Bruchteil der Zeit ab. Für die übrigen 10 % – also sehr individuelle, groß angelegte oder tief integrierte Anforderungen – bleibt Python weiterhin die erste Wahl.

Fazit und wichtigste Erkenntnisse

Amazon-Produktdaten zu scrapen ist eine Superkraft für jedes Vertriebs-, E-Commerce- oder Operations-Team. Ob Sie Preise verfolgen, Wettbewerber analysieren oder einfach Ihr Team vor endlosem Copy-Paste bewahren möchten – es gibt eine Lösung dafür.

- Python-Scraping gibt Ihnen volle Kontrolle, bringt aber eine Lernkurve und laufende Wartung mit sich.

- No-Code-Web-Scraper wie Thunderbit machen Amazon-Datenextraktion für alle zugänglich – kein Code, kein Stress, nur Ergebnisse.

- Der beste Ansatz? Nutzen Sie das Tool, das zu Ihren Fähigkeiten, Ihrem Zeitplan und Ihren Geschäftszielen passt.

Wenn Sie neugierig sind, testen Sie Thunderbit – der Einstieg ist kostenlos, und Sie werden erstaunt sein, wie schnell Sie an die benötigten Daten kommen. Und wenn Sie Entwickler sind: Haben Sie keine Scheu, beides zu kombinieren. Manchmal ist der schnellste Weg zum Ziel, der KI die langweiligen Teile zu überlassen.

FAQs

1. Warum sollte ein Unternehmen Amazon-Produktdaten scrapen?

Das Scraping von Amazon ermöglicht es Unternehmen, Preise zu überwachen, Wettbewerber zu analysieren, Rezensionen für die Produktrecherche zu sammeln, die Nachfrage zu prognostizieren und Sales-Leads zu generieren. Mit über 600 Millionen Produkten und nahezu 2 Millionen Verkäufern auf Amazon ist es eine reichhaltige Quelle für Competitive Intelligence.

2. Was sind die Hauptunterschiede zwischen Python und No-Code-Tools wie Thunderbit für das Scrapen von Amazon?

Python-Scraper bieten maximale Flexibilität, erfordern aber Programmierkenntnisse, Einrichtungszeit und laufende Wartung. Thunderbit, ein No-Code-KI-Web-Scraper, ermöglicht es Nutzern, Amazon-Daten sofort per Chrome-Erweiterung zu extrahieren – ohne Programmierung, mit integrierter Anti-Bot-Behandlung und Exportoptionen nach Excel oder Sheets.

3. Ist es legal, Daten von Amazon zu scrapen?

Die Nutzungsbedingungen von Amazon verbieten Scraping im Allgemeinen, und Amazon setzt aktiv Anti-Bot-Maßnahmen ein. Viele Unternehmen scrapen jedoch weiterhin öffentlich verfügbare Daten und achten dabei auf verantwortungsvolles Vorgehen, etwa durch das Einhalten von Rate Limits und das Vermeiden übermäßiger Anfragen.

4. Welche Daten kann ich mit Web-Scraping-Tools von Amazon extrahieren?

Typische Datenfelder sind Produkttitel, Preise, Bewertungen, Anzahl der Rezensionen, Bilder, Produktspezifikationen, Verfügbarkeit und sogar Verkäuferinformationen. Thunderbit unterstützt außerdem Unterseiten-Scraping und Pagination, um Daten über mehrere Listings und Seiten hinweg zu erfassen.

5. Wann sollte ich Python-Scraping gegenüber einem Tool wie Thunderbit wählen – oder umgekehrt?

Verwenden Sie Python, wenn Sie volle Kontrolle, individuelle Logik oder die Integration in Backend-Systeme benötigen. Verwenden Sie Thunderbit, wenn Sie schnelle Ergebnisse ohne Programmierung möchten, leicht skalieren müssen oder als Business-Anwender eine wartungsarme Lösung suchen.

Möchten Sie tiefer einsteigen? Schauen Sie sich diese Ressourcen an:

Viel Erfolg beim Scrapen – und mögen Ihre Tabellen immer auf dem neuesten Stand sein.