Eine GitHub-Suche nach „amazon scraper“ liefert ungefähr . Schränkt man das auf Repos ein, die in den letzten sechs Monaten gepusht wurden, bleiben nur noch rund übrig — kaum 20 %. Der Rest? Verlassene Tutorials, veraltete Wrapper und Skripte, die in dem Moment nicht mehr funktionierten, als Amazon seine Abwehrmaßnahmen verschärfte.

Ich habe viel Zeit damit verbracht, Amazon-Scraper-Repos zu durchforsten, GitHub-Issues zu lesen und Community-Threads auf Reddit und Stack Overflow zu verfolgen. Das Muster ist immer dasselbe: Jemand findet ein beliebtes Repo, verbringt eine Stunde mit dem Setup, startet es einmal — und landet sofort vor einer Wand aus CAPTCHAs oder 503-Fehlern. Amazons Anti-Bot-Strategie im Jahr 2026 ist nicht mehr dieselbe wie noch vor zwei Jahren: TLS-Fingerprinting, Verhaltensanalyse und der aggressive Einsatz von CAPTCHAs haben das alte „User-Agents rotieren und das Beste hoffen“-Playbook praktisch nutzlos gemacht. Dieser Leitfaden zeigt die Best Practices, die wirklich zählen, wenn du zuverlässige Amazon-Daten aus einem GitHub-Repo holen willst — und was du tun solltest, wenn dein Scraper bricht (nicht: falls).

Was ist ein Amazon Scraper auf GitHub – und warum scheitern so viele?

Ein Amazon-Scraper-GitHub-Repo ist typischerweise ein Open-Source-Skript — meist auf Python, Node.js oder Scrapy-Basis — das strukturierte Daten von Amazon-Seiten extrahiert. Die Ziel-Daten sind vertraut: Produkttitel, Preis, ASIN, Bewertungen, Anzahl der Rezensionen, Verfügbarkeit, Verkäuferinformationen, Suchergebnis-Kacheln und Rezensionstexte.

Die Architektur ist meist recht simpel:

- Ein HTTP-Client oder ein Headless Browser lädt die Seite.

- Ein HTML- oder JSON-Parser extrahiert die Felder.

- Die Daten werden als CSV, JSON oder in einer Datenbank gespeichert.

Repos lassen sich grob in vier Gruppen einteilen:

- Leichtgewichtige Python-Bibliotheken (z. B. )

- Scrapy-Spiders (z. B. )

- Browser-Automatisierer mit Selenium oder Playwright

- API-Wrapper-Projekte, die in Wahrheit nur Frontends für einen kommerziellen Scraping-Dienst sind (z. B. )

Das Ausfallmuster ist vorhersehbar. Die meisten Repos brechen, weil:

- Amazon das Seitenlayout oder einzelne HTML-Fragmente verändert

- Amazon statt echter Inhalte einen 503 oder ein CAPTCHA ausliefert

- Der TLS- und HTTP-Fingerprint des Scrapers nicht mehr wie ein Browser aussieht

- Locale-, Sprach- oder Header-Abweichungen Misstrauen auslösen

- Der Maintainer nach der Lösung seines ursprünglichen, sehr engen Anwendungsfalls weitermacht

Viele Sterne und „gerade noch nutzbar“ sind zwei völlig verschiedene Dinge. In dem Audit, das ich für diesen Artikel durchgeführt habe, wirkten nur etwa drei von acht weit verbreiteten Repos im Jahr 2026 eindeutig aktiv.

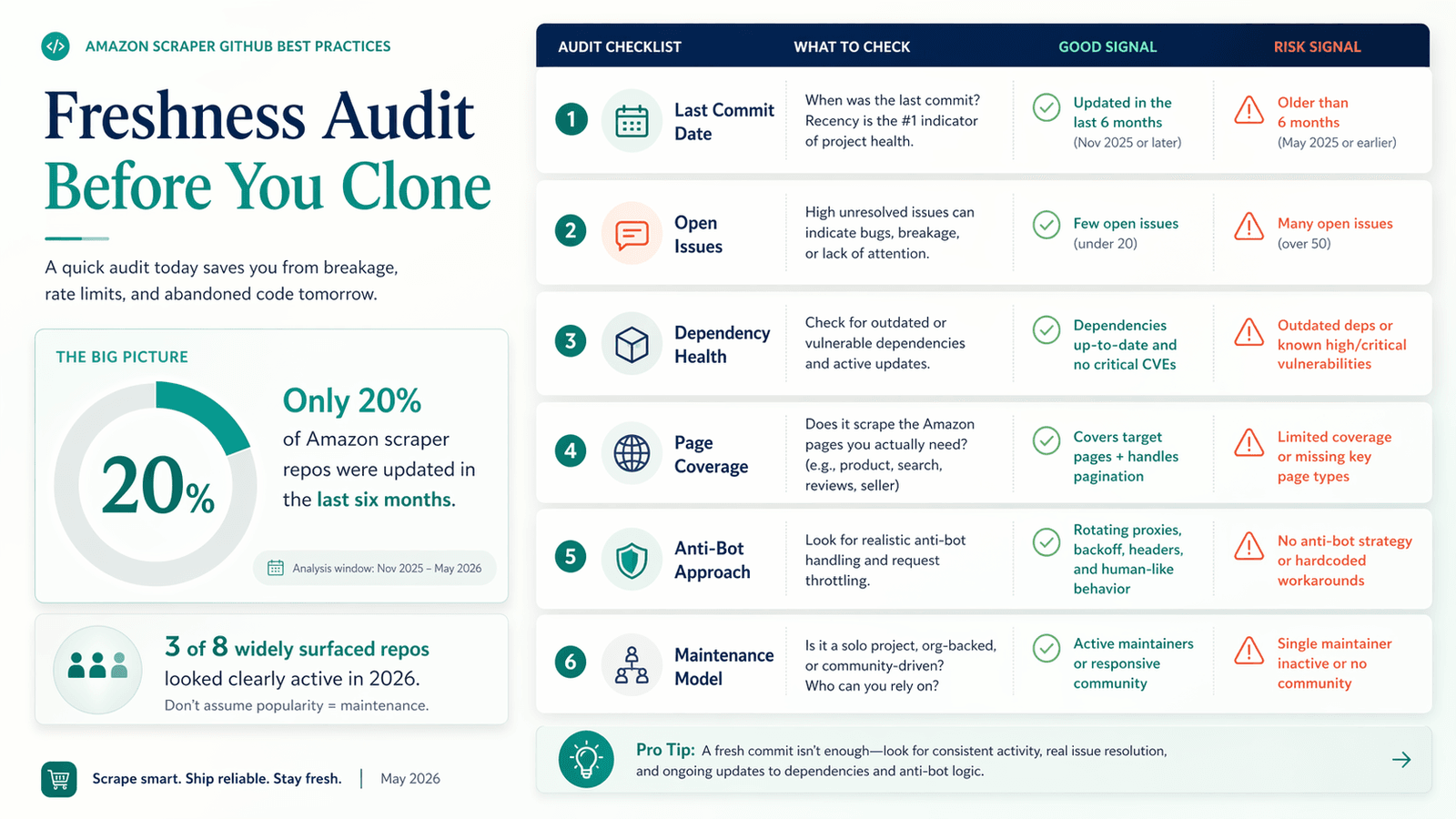

Führe 2026 einen Frische-Check durch, bevor du irgendein Amazon-Scraper-GitHub-Repo klonst

Dieser Schritt ist bei Amazon wichtiger als bei den meisten anderen Zielen. Amazons Schutzmechanismen ändern sich schneller als bei einer typischen E-Commerce-Seite, sodass ein Repo, das auf einer einfachen Firmenwebsite problemlos läuft, auf Amazon schon nach wenigen Wochen wertlos sein kann. Trotzdem empfehlen die meisten „best amazon scraper github“-Listen Repos, ohne zu prüfen, ob sie überhaupt noch funktionieren. Nutzer verschwenden Stunden mit kaputten Tools.

So prüfst du, ob ein GitHub-Repo noch lebt

Bevor du irgendetwas mit git clone holst, gehe diese Checks durch:

- Datum des letzten Commits: Alles, was älter als 6 Monate ist, ist bei Amazon ein klares Warnsignal.

- Offene Issues vs. Reaktionsrate: Suche im Issues-Tab nach „captcha“, „503“, „blocked“ und „not working“. Wenn sich diese Meldungen häufen und der Maintainer nicht reagiert, lieber die Finger davon lassen.

- Gesundheit der Abhängigkeiten: Öffne

requirements.txtoderpackage.json. Veraltete Bibliotheken (z. B. alterequestsohne moderne TLS-Unterstützung) sind ein Alarmsignal. - Abdeckung von Amazon-Seitentypen: Kann das Repo Produktseiten, Suchergebnisse und Rezensionen verarbeiten? Oder nur einen Typ?

- Anti-Bot-Ansatz: Hart codierte Header ohne Proxy-Unterstützung sind ein Ansatz aus 2023 — der 2026 nicht mehr lange hält.

Amazon-Scraper-GitHub-Frische-Checkliste

| Frischesignal | Was prüfen | Warnsignal 🚩 |

|---|---|---|

| Datum des letzten Commits | Commit-Feed oder Repo-Push-Datum | Älter als 6 Monate |

| Offene Issues | Issues-Tab — nach „captcha“, „503“, „blocked“ filtern | Wiederholte Ausfälle ohne Antwort des Maintainers |

| Gesundheit der Abhängigkeiten | requirements.txt / package.json | Veraltete Bibliotheken, keine moderne TLS-Strategie |

| Amazon-Seitenabdeckung | README + Codebeispiele | Unterstützt nur einen Seitentyp (z. B. Produktseiten, aber nicht Suche oder Rezensionen) |

| Anti-Bot-Ansatz | Quellcode, Proxy-Konfiguration | Nur hart codierte Header und UA-Strings |

| Wartungsmodell | Ist es ein echter Scraper, ein Tutorial oder ein kommerzieller API-Wrapper? | Repo ist in Wahrheit nur ein Frontend für einen bezahlten Dienst |

Was das Audit tatsächlich ergeben hat

Ich habe acht weit verbreitete Amazon-Scraper-Repos anhand dieser Kriterien geprüft. Das Ergebnis ist ernüchternd:

| Repo / Tool | Sterne | Signal des letzten Commits | Umfang | Status 2026 | Hinweise |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2.872 | 2026-04-02 | Verwalteter Scraper-API-Wrapper | Aktiv, aber nicht DIY | Aktuell, aber in Wahrheit ein Frontend für einen Managed Service |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | Verwaltete API für Suche, Details, Rezensionen | Aktiv, aber nicht DIY | Gute Abdeckung, aber ein API-Produkt, kein roher Scraper |

| theonlyanil/amzpy | ~110 | 2026-02-26 | Leichtgewichtige Python-Bibliothek | Aktiv | Der klarste direkte GitHub-Scraper mit curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | Nur Rezensionen | Eingeschränkt, aber nutzbar | Alt und sehr auf Rezensionen fokussiert |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | Letzter Commit 2023; Repo gepusht 2024-08-20 | Scrapy-Spiders + Proxy-Middleware | Tutorial-Niveau, alternd | Gut zum Lernen, aber kein fertiger 2026-Stack |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | Node-CLI für Suche, Details, Rezensionen | Hohes Risiko | Große Abdeckung, aber die Wartung ist zu alt |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | Suche nach CSV | Für 2026 tot | Historisch beliebt, heute klar veraltet |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | Such-/Produkt-Tutorial | Für 2026 tot | Praktisch Archivmaterial |

Die öffentlichen Issues erzählen dieselbe Geschichte. hat ein Issue mit dem Titel „All requests receive captcha response.“ enthält „Doesn't seem to be working.“ fragt nach „Bypass Amazon protection.“ Das sind keine seltenen Sonderfälle — das sind genau die ersten Hürden, auf die Nutzer stoßen.

Der Anti-Ban-Plan: So vermeidest du Sperren mit einem Amazon-Scraper von GitHub

Geblockt zu werden ist das größte Schmerzthema für alle, die ein Amazon-Scraper-GitHub-Projekt einsetzen. Allgemeine Tipps wie „nutze Proxies und rotiere User-Agents“ reichen längst nicht mehr aus. Amazons Anti-Bot-Stack für 2025–2026 umfasst TLS-Fingerprinting, Verhaltensanalyse und den aggressiven Einsatz von CAPTCHAs. Du brauchst einen mehrschichtigen Ansatz.

TLS-Fingerprinting: Warum dich simples requests in Schwierigkeiten bringt

Das ist eine der am häufigsten übersehenen Anti-Ban-Techniken. TLS-Fingerprinting funktioniert so: Wenn dein Skript eine sichere Verbindung zu Amazon öffnet, kann der Server anhand des „Handshake“-Verhaltens viel über den Client erkennen — angebotene Cipher Suites, Reihenfolge der Extensions, HTTP/2-Einstellungen. Browser verwenden relativ feste TLS- und HTTP/2-Parameter, und genau solche Kombinationen lassen sich mit Techniken wie identifizieren.

Normales requests und gewöhnliches httpx können Header kopieren, aber nicht das Chrome-ähnliche TLS- und HTTP/2-Verhalten. Amazon erkennt den Unterschied.

löst dieses Problem direkt. Es bietet Browser-Impersonation — unterstützte Ziele sind unter anderem chrome136, safari184 und firefox133 — sodass der TLS-Fingerprint deines HTTP-Clients wie der eines echten Browsers aussieht. In der Doku wird ausdrücklich davor gewarnt, zufällige JA3-Strings zu erzeugen: Browser-Fingerprints sind pro Version weitgehend fest, und zufälliger Unsinn ist leichter zu erkennen als ein kopierter, echter Fingerprint.

Auch die Community-Daten passen dazu. Ein bestätigt, dass der impersonate-Parameter nützlich ist, weil er Browser-Profile rotiert und Header sauber abstimmt. Ein anderer berichtet, dass Amazon Clients anhand des TLS-Fingerprints „nach ungefähr ein oder zwei Monaten“ blockiert. Ein fragt sogar explizit, ob Amazon python-requests fingerprintet (Spoiler: ja).

Wenn du also immer noch normales requests als deinen ersten Amazon-Client nutzt, solltest du diese Annahme zuerst ändern — noch bevor du irgendetwas anderes optimierst.

Proxy-Rotation richtig gemacht (nicht einfach nur „Proxies verwenden“)

Der Sinn von Proxies ist nicht, so oft wie möglich zu rotieren. Der Sinn ist, Sitzungen glaubwürdig aussehen zu lassen.

Residential vs. Datacenter: Datacenter-Proxies sind günstiger, aber leichter zu erkennen. Residential-Proxies kosten mehr, sind für Amazon aber viel schwerer zu markieren. beginnt bei 4,00 $/GB im Pay-as-you-go-Modell und sinkt auf 3,50 $/GB bei größeren Plänen. startet bei 6 $/GB. Amazon gehört klar in die Kategorie „anspruchsvolles Ziel“, bei dem Residential-Proxies den Aufpreis wert sind.

Rotation pro Anfrage vs. pro Sitzung: Hier liegen die meisten Tutorials falsch. Pro Anfrage einen Proxy zu wechseln, während Cookies und Header konstant bleiben, kann weniger menschlich wirken, nicht mehr. Das sicherere Muster:

- Suche → Produkt → Rezensionen möglichst innerhalb derselben Sticky Session durchlaufen

- Sitzungen wechseln, wenn du eine neue Suchreise startest, nicht bei jeder Anfrage

- Zwischen Sitzungen rotieren, nicht zufällig innerhalb einer einzigen Browsing-Session

Ein bemerkte, dass normale ISP-IPs auf beliebten E-Commerce-Seiten deutlich schlechter abschnitten als mobile IPs. Ein anderer berichtete von Sperren trotz rotierender User-Agents und Residential-Proxies — eine gute Erinnerung daran, dass Proxies allein nicht ausreichen.

Anfrage-Taktung, Backoff und Rate Limiting

Amazons 503-Seiten sind kein Zufall. Sie sind Feedback.

Ein zum Scraping von mehr als 500 ASINs berichtete, dass immer an derselben Stelle ein 503 auftrat — ungefähr bei ASIN 101 — sogar trotz Pausen. Das Muster ist alt, die Lehre aber aktuell: Reines Volumen von einer IP oder einem Fingerprint wird irgendwann abgefangen.

Best-Practice-Taktung für DIY-GitHub-Scraper:

- Zufällige Verzögerungen zwischen Anfragen (keine festen Intervalle, die erkennbar sind)

- 2 bis 5 Sekunden zwischen öffentlichen Produktanfragen bei einfachen HTTP-Clients

- Exponentielles Backoff nach 503 oder CAPTCHA — also schrittweise zurückfahren statt sofort erneut versuchen

- Niedrigere Parallelität, als du denkst zu brauchen

- Fail-open-Logging statt enger Retry-Schleifen

Die meisten Amazon-Scraper-GitHub-Repos haben kein eingebautes Rate Limiting. Das musst du selbst ergänzen.

Header-Orchestrierung: Mehr als nur User-Agent-Strings

Amazon prüft den gesamten Header-Satz, nicht nur den User-Agent.

Ein realistischer Browser-Header-Satz sollte Folgendes enthalten:

User-AgentAcceptAccept-LanguageAccept-EncodingSec-CH-*-Hinweise, wenn sinnvoll- Ein Verbindungsverhalten, das zum gewählten Browser-Profil passt

Die Header müssen zur Marketplace-Locale passen. Ein stellte fest, dass dieselbe Bot-Konfiguration nur in einigen Länderversionen erkannt wurde; ein anderer Kommentator verwies auf regionbezogene Header wie Accept-Language.

Die Regel lautet: Header, TLS-/Browser-Profil und Proxy-Geografie dürfen sich nicht widersprechen. Schicke keine Chrome-Header mit einer Firefox-UA. Verwende keinen US-Proxy mit Accept-Language: de-DE.

CAPTCHA-Behandlung: Wann lösen, wann zurückfahren

Ein CAPTCHA bedeutet, dass Amazon bereits misstrauisch ist. Es zu lösen setzt deinen Vertrauenswert nicht zurück.

Für einzelne, seltene CAPTCHA-Fälle:

- Das PyPI-Paket ist ein reiner Python-Amazon-Text-CAPTCHA-Solver, auch wenn die neueste Version von Mai 2023 stammt — behandle es als taktisches Werkzeug, nicht als dauerhafte Strategie

- listet Amazon Captcha bei 0,45 $ pro 1.000 Lösungen

Für wiederholte CAPTCHA-Schleifen:

- Nicht weiter lösen, sondern Abstand vergrößern

- Wiederholte CAPTCHAs bedeuten, dass die Sitzung verbrannt ist — das Lösen baut kein Vertrauen in Fingerprint, Sitzungsverlauf oder IP-Reputation wieder auf

- Wenn CAPTCHAs sich nach Proxy-Subnetzen clustern, liegt das Problem in der Netzwerkschicht, nicht im Parser

Wann du wirklich einen Headless Browser brauchst — und wann nicht

Die falsche Reflexreaktion ist, für alles Playwright zu starten.

Gute Browser-Anwendungsfälle:

- Suchergebnisse, die JavaScript-Rendering oder locale-abhängigen Zustand brauchen

- Rezensionen-Flows, die zu Login- oder Anmeldeseiten weiterleiten

- Workflows, bei denen Cookies und Browser-Kontext wichtiger sind als reine Geschwindigkeit

Schlechte Browser-Anwendungsfälle:

- Normale öffentliche Produktseiten

- Statische Produktdetail-Extraktion, bei der ein browserähnlicher HTTP-Client ausreicht

- Groß angelegte Massenerfassung, bei der Recheneffizienz zählt

Beginne mit dem leichtesten Client, der funktioniert. Ein zum Scraping in großem Maßstab beschreibt die Abfolge: erst requests, dann curl_cffi — und nur dann ein kompletter Browser, wenn die leichteren Optionen scheitern. Headless Browser sind für Amazon-Produktseiten-Scraping spürbar langsamer und ressourcenintensiver als HTTP-Clients.

Anti-Ban-Entscheidungsmatrix für Amazon-Scraper-GitHub-Projekte

| Szenario | Empfohlener Ansatz | Warum |

|---|---|---|

| Öffentliche Produktseiten (kleiner Umfang) | curl_cffi + Sticky Residential Session | Günstigster Weg, der trotzdem wie ein Browser wirkt |

| Suchergebnisseiten | Erst curl_cffi, Playwright nur bei Rendering- oder State-Problemen | Suche ist zustandsbehafteter und stärker lokalisierungsabhängig |

| Rezensionen (Login erforderlich) | Browser-Modus mit echten Cookies/Sitzung | Login- und dynamische Review-Flows sind mit reinem HTTP schwerer nachzubilden |

| Großer Umfang (5k+ täglich) | Managed Scraper API, Unlocker oder No-Code-Plattform | Reiner DIY-GitHub-Code wird dann zum Infrastrukturproblem |

Wenn dein Amazon-Scraper-GitHub-Projekt bricht: Lege einen No-Code-Plan B an

Jeder erfahrene Scraper hat einen Plan B.

Amazon-Updates werden früher oder später jedes GitHub-Repo im ungünstigsten Moment zerstören. Für E-Commerce-Teams bedeutet ein kaputter Scraper verpasste Preisänderungen, veraltete Wettbewerbsdaten und Lücken in Dashboards.

Viele Menschen, die nach „amazon scraper github“ suchen, sind in Wahrheit Business-Anwender — E-Commerce-Operations, Marketer, FBA-Researcher — die Programmierlösungen ausprobiert haben, weil sie keine bessere Option gefunden haben. Auch zu Amazons offizieller gibt es in Foren spürbare Frustration: eingeschränkter Zugang, begrenzte Daten und , die viele Händler nicht erfüllen können.

Warum GitHub-Amazon-Scraper ständige Pflege brauchen

Das Audit oben macht es deutlich:

- Veraltete Repos sammeln immer mehr Fehlerberichte an, ohne dass etwas gefixt wird

- „Funktionierende“ Repos sprechen im README inzwischen offen über Anti-Bot-Maßnahmen

- Community-Threads drehen sich zunehmend um TLS-Fingerprints, CAPTCHA-Schleifen und Proxy-Qualität — nicht mehr um CSS-Selektoren

Für Business-Anwender ist dieser Pflegeaufwand die eigentliche versteckte Kostenstelle. Das Repo ist kostenlos. Deine Zeit, die du um 2 Uhr nachts mit Debugging verbringst, ist es nicht.

Thunderbit als praktische Alternative für Amazon-Scraping

bietet eine , die Titel, Preis, ASIN, Bewertungen, Marke, Verfügbarkeit, Versandherkunft und die Original-URL extrahiert — ganz ohne Code.

So sieht das in der Praxis aus:

- Scraping in 2 Klicks statt Python-Umgebungen, Abhängigkeiten und Proxy-Konfigurationen aufzusetzen

- Sofort einsatzbereite Amazon-Vorlage — kein KI-Overhead, einfach Extraktion mit 1 Klick

- Browser-Scraping-Modus für Seiten, die ein Login erfordern (wie Review-Seiten, die GitHub-Scraper-Nutzer frustrieren)

- Cloud-Scraping für öffentliche Produktseiten in hoher Geschwindigkeit (50 Seiten auf einmal)

- Kostenloser Export nach Google Sheets, Airtable, Notion und Excel — nicht nur CSV/JSON

- Geplanter Scraper für laufendes Preis-Monitoring

- KI passt sich Layout-Änderungen an — kein Wartungsaufwand für dich

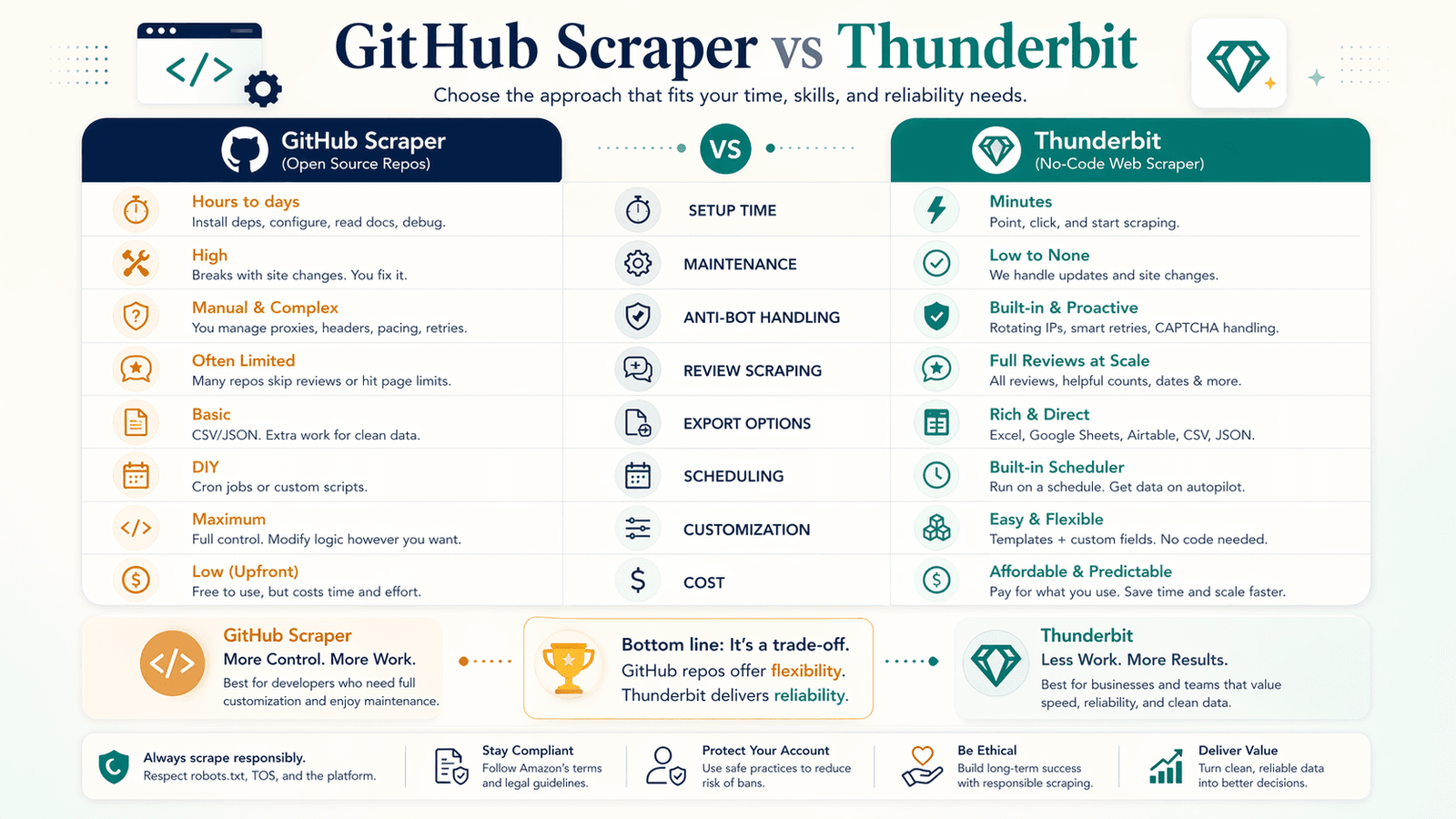

GitHub-Amazon-Scraper vs. Thunderbit: Ehrlicher Vergleich

| Faktor | GitHub-Scraper (z. B. AmzPy) | Thunderbit |

|---|---|---|

| Einrichtungszeit | 15–60 Min. (Python, Abhängigkeiten, Proxies) | ~2 Min. (Chrome-Erweiterung installieren) |

| Wartung | Du behebst Brüche selbst | KI passt sich Layout-Änderungen an |

| Anti-Bot-Behandlung | DIY (Proxies, Header, TLS) | Integriert (Cloud- und Browser-Modus) |

| Review-Scraping (eingeloggt) | Komplexes Sitzungsmanagement | Browser-Scraping-Modus |

| Datenexport | Nur CSV/JSON | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Planung | DIY (cron, Airflow usw.) | Integrierter geplanter Scraper |

| Anpassbarkeit | Höher | Geringer |

| Kosten | Kostenlos (plus Proxy-Kosten) | Kostenlose Stufe verfügbar; kreditbasiert |

Der ehrliche Trade-off: GitHub-Repos bieten mehr Anpassbarkeit; Thunderbit bietet mehr Zuverlässigkeit. Wenn deinem Team Verfügbarkeit wichtiger ist als Flexibilität, ist der No-Code-Weg meist die rationalere Wahl.

Best Practices für geplantes und wiederkehrendes Amazon-Scraping

Die meisten Amazon-Scraper-GitHub-Projekte sind für Einmal-Läufe gebaut, aber echte Business-Use-Cases — Preisüberwachung, Bestandsverfolgung, Wettbewerbsanalyse — brauchen wiederkehrende Scrapes. GitHub-Repos bringen Scheduling fast nie nativ mit, also müssen Nutzer Cron-Jobs, Airflow oder n8n-Workflows zusammenstecken.

DIY-Scheduling für GitHub-Amazon-Scraper

Das minimale Setup für wiederkehrende Läufe:

- Cron-Job unter Linux oder macOS, um das Skript nach Zeitplan zu starten

- Nur-anhängen-Logs, damit du Fehler im Nachhinein debuggen kannst

- Deduplizierung über ASIN + Zeitstempel, damit keine doppelten Daten gespeichert werden

- Fehleralarme (zur Not schon eine E-Mail bei einem nicht-null Exit-Code), damit du merkst, wenn ein Lauf um 3 Uhr nachts scheitert

Für komplexere Teams:

- n8n für leichte Workflow-Automatisierung (wird in Community-Threads häufig erwähnt)

- Airflow für schwerere geplante Pipelines

- Datenbankgestützter Zustand, wenn du Diffs und Historie brauchst

Die wichtigste Best Practice ist nicht der Scheduler selbst — sondern das State Management. Verfolge den letzten erfolgreichen Lauf, den letzten ASIN-Satz, geänderte Preise und fehlgeschlagene URLs.

Einfacheres Scheduling mit Thunderbit

Thunderbits lässt dich das Intervall in normalem Deutsch beschreiben, URLs eingeben und auf „Planen“ klicken. Die KI übersetzt natürliche Sprache in einen Cron-Plan — ganz ohne technisches Setup. Für nicht-technische E-Commerce-Teams, die Preise oder Produktstarts von Wettbewerbern überwachen, ist das eine spürbare Reduktion des operativen Aufwands.

Best Practices für wiederkehrende Amazon-Scrapes

Diese gelten unabhängig vom eingesetzten Tool:

- Nach ASIN + Zeitfenster deduplizieren — dasselbe Produkt nicht pro Lauf zweimal speichern

- Preise als Zahlen, nicht als Rohstrings speichern — spart späteren Bereinigungsaufwand

- Scrape-Zeitstempel an jede Zeile anhängen — für Trendanalysen unverzichtbar

- Deltas tracken, nicht nur den aktuellen Zustand — „Preis seit letzter Woche um 12 % gefallen“ ist nützlicher als „Preis ist 24,99 $“

- Bei relevanten Änderungen alarmieren — ein Preisrückgang eines Konkurrenten um 15 % ist eine Nachricht wert; eine Schwankung von 0,5 % ist Rauschen

- Über Datenspeicherung nachdenken — Flat Files reichen für kleine Läufe; bei 5k+ ASINs pro Tag solltest du eine Datenbank oder eine Cloud-Spreadsheet-Lösung erwägen

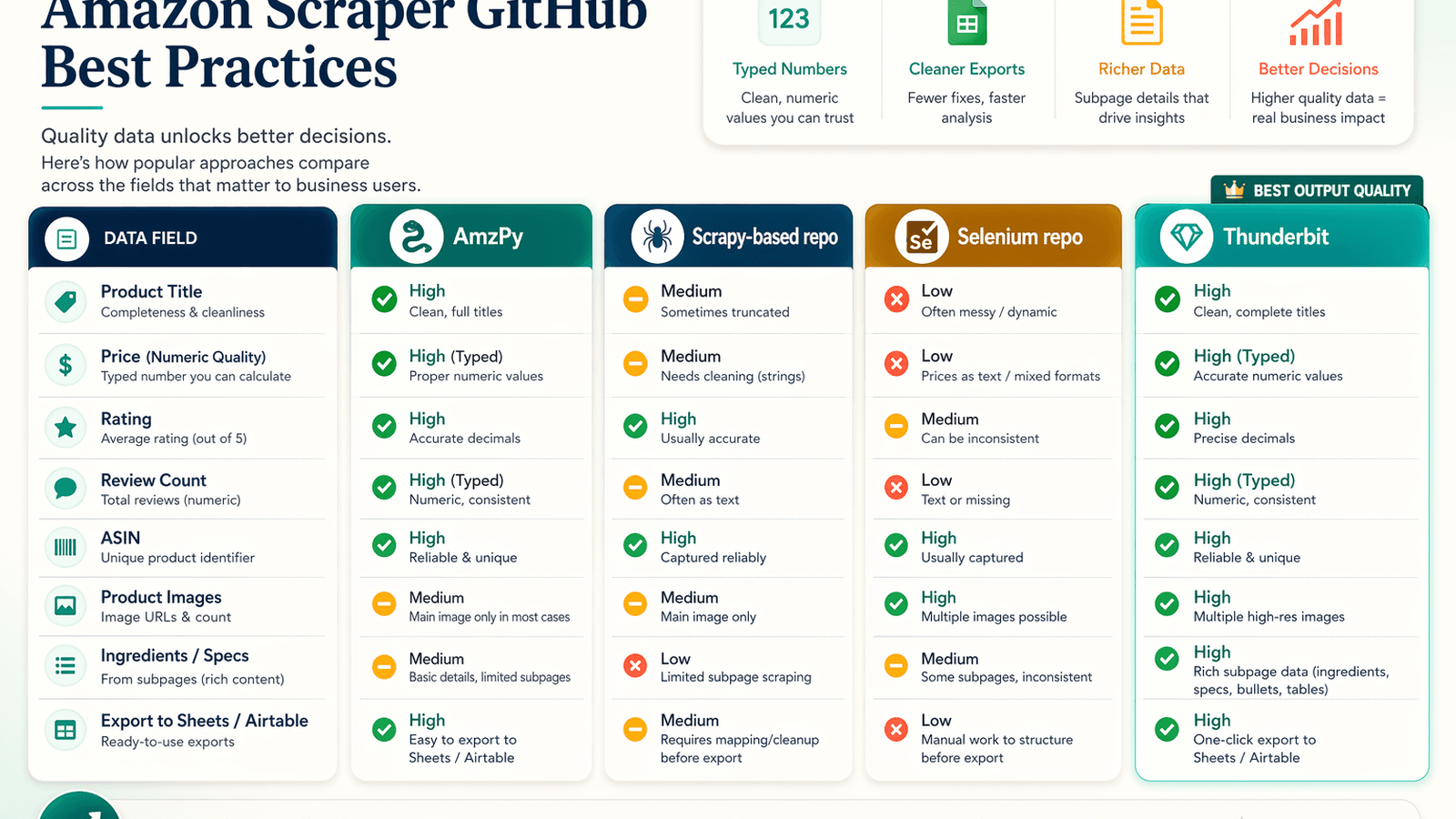

Vergleich der Ausgabequalität: Was die einzelnen Amazon-Scraper-GitHub-Ansätze tatsächlich liefern

Niemand vergleicht die tatsächliche Ausgabequalität zwischen Amazon-Scraper-GitHub-Repos. Nutzer legen großen Wert auf Datenqualität — „welches Tool liefert die saubersten, vollständigsten Daten?“ — müssen aber jedes Repo selbst klonen und testen. Dieser Abschnitt schließt diese Lücke.

Was beliebte GitHub-Repos tatsächlich extrahieren — und was ihnen fehlt

Basierend auf README-Beispielen, öffentlichen Beispielen und dokumentierten Ausgabeformaten:

| Ansatz | Was klar extrahiert wird | Häufige Lücken / Kompromisse |

|---|---|---|

| amzpy | Titel, Preis, Währung, Bild-URL, Bewertungen, Rezensionen, Varianten, ASIN | Auf Produktseiten ausgerichtet; weniger umfangreich bei vollständigen Rezensionen/Specs |

| tducret/amazon-scraper-python | CSV mit Titel, Bewertung, Rezensionsanzahl, Produkt-URL, Bild-URL, ASIN | Veraltet, auf Listings fokussiert, schwache Anti-Bot-Story |

| python-scrapy-playbook scraper | Suchergebnisse, Produktseiten, Rezensionen, CSV/JSON-Pipelines | Tutorial-Niveau; verlässt sich auf externe Proxy-Middleware; mehr Nacharbeit wahrscheinlich |

| omkarcloud/amazon-scraper | Suche, Kategorie, Details, Top-Rezensionen, viele Bilder/Videos/Specs | Kein roher Scraper — es ist ein verwalteter API-Dienst |

| Thunderbit Amazon template | Titel, Preis, ASIN, Marke, Bewertung, Rezensionen, Verfügbarkeit, Versandherkunft, Anreicherung über Unterseiten | Weniger Code-Kontrolle als bei eigenen Skripten |

Vergleichstabelle der Ausgabequalität

| Datenfeld | AmzPy | Scrapy-basiertes Repo | Selenium-Repo | Thunderbit |

|---|---|---|---|---|

| Produkttitel | ✅ | ✅ | ✅ | ✅ |

| Preis (numerisch) | ⚠️ String | ✅ | ⚠️ String | ✅ (Zahlentyp) |

| Bewertung | ✅ | ✅ | ✅ | ✅ |

| Anzahl der Rezensionen | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Produktbilder | ❌ | ⚠️ nur Thumbnail | ✅ | ✅ (hochauflösend, exportierbar) |

| Inhaltsstoffe/Specs | ❌ | ❌ | ❌ | ✅ (über Unterseiten-Scraping + KI) |

| Export nach Sheets/Airtable | ❌ | ❌ | ❌ | ✅ kostenlos |

Warum Datenformatierung für Business-Anwender wichtig ist

Unsaubere Daten erzeugen versteckte Mehrarbeit. Selbst ein erfolgreicher Scraper kann operativ scheitern, wenn:

- Preise als Strings mit Währungssymbolen statt als saubere Zahlen gespeichert werden

- Fehlende Werte inkonsistent sind (leerer String vs. null vs. „N/A“)

- Bilder nur in geringer Auflösung vorliegen

- Rezensionen oder Specs vor der Analyse noch nachbearbeitet werden müssen

Für E-Commerce-Operations-Teams beeinflussen saubere Daten direkt die Geschwindigkeit der Analyse und die Entscheidungsfindung. Thunderbits KI formatiert Daten nach Typ — Zahlen als Zahlen, Daten als Daten, URLs als URLs — sodass sie sofort einsatzbereit sind. GitHub-Repos unterscheiden sich hier stark, und die Bereinigungszeit summiert sich schnell.

Schnellreferenz: Checkliste der Best Practices für Amazon-Scraper-GitHub

- Vor dem Klonen das Datum des letzten Commits prüfen. Älter als sechs Monate ist bei Amazon ein klares Warnsignal.

- Issues nach „captcha“, „503“, „blocked“ und „not working“ durchsuchen, bevor du das Setup startest.

curl_cffibevorzugen oder einen anderen Browser-Imitations-HTTP-Client statt einfachemrequests.- Header, TLS-Profil, Sprache und Proxy-Geografie konsistent halten — keine Widersprüche.

- Sticky Sessions für Browsing-Flows verwenden; nicht blind bei jeder Anfrage rotieren.

- Zufällige Taktung und exponentielles Backoff ergänzen.

- Wiederholte CAPTCHAs als verbrannte Sitzung behandeln, nicht als Rätsel, das man mit roher Gewalt löst.

- Headless Browser nur einsetzen, wenn HTTP-Clients die Seite nicht zuverlässig reproduzieren können.

- Checkpoints und Zustand speichern, damit fehlgeschlagene Läufe sicher fortgesetzt werden können.

- Einen Fallback-Plan haben — ob verwaltete API oder No-Code-Tool wie .

Rechtliche und ethische Überlegungen zum Amazon-Scraping 2026

Ein paar Dinge, die du kurz kennen solltest.

Amazons Haltung ist restriktiv und wird immer strenger. Die stärksten Signale:

- Amazons eigene Hilfeseiten liefern inzwischen eine mit dem Hinweis: „To discuss automated access to Amazon data please contact api-services-support@amazon.com.“

- Amazons untersagt eine breite Palette dynamischer, rezensionsbezogener, profilbezogener, Wunschlisten- und Angebotslisten-Pfade.

- Amazons wendet sich ausdrücklich gegen verdeckten oder getarnten Agentenzugriff, das Umgehen von Sicherheitsmaßnahmen und das falsche Identifizieren eines Agenten als Google Chrome. Amazon hat dazu auch eine veröffentlicht.

- Amazon hat Ende 2025 gegen OpenAI-Crawler ausgeweitet.

Das praktische Risiko ist eindeutig höher, wenn du von öffentlichen Produktseiten zu authentifizierten Flows, getarnter Automatisierung oder großvolumiger kommerzieller Extraktion übergehst. Das ist keine Rechtsberatung — sprich mit deinem eigenen Legal-Team über deinen konkreten Fall.

Kernaussagen: Zuverlässige Amazon-Daten ohne Sperre bekommen

In der Reihenfolge der Wichtigkeit:

- Vor dem Klonen prüfen. Geh davon aus, dass die meisten GitHub-Treffer veraltet, Tutorials oder Wrapper um kommerzielle APIs sind.

- Zuerst die Netzwerkschicht verbessern. TLS-Fingerprinting und Session-Kohärenz sind wichtiger als HTML-Selektoren.

- Sticky Residential Sessions verwenden, nicht zufälliges Proxy-Chaos. Zwischen Sitzungen rotieren, nicht innerhalb einer Sitzung.

- Anfragen wie ein Nutzer takten, nicht wie ein Stresstest. Zufällige Verzögerungen und exponentielles Backoff sind nicht verhandelbar.

- Isolierte CAPTCHAs lösen; wiederholt angegriffene Sitzungen beenden. Kein Brute-Force gegen einen verbrannten Fingerprint.

- Einen Fallback haben. Amazon wird mitten in der Woche etwas ändern, und dein GitHub-Scraper wird brechen. Ein gepflegtes No-Code-Tool wie oder eine Managed API kann deine Datenpipeline am Laufen halten, während du debugst.

- Die Ausgabequalität priorisieren. Saubere, typisierte Daten sparen downstream mehr Zeit als ein schneller, aber chaotischer Scraper.

Wenn dir Zuverlässigkeit wichtiger ist als Anpassbarkeit, bietet Thunderbit eine gepflegte Alternative — schau dir die an oder sieh dir Tutorials auf dem an. Entwickler, die volle Kontrolle wollen, können GitHub-Repos natürlich weiter nutzen — aber nur mit den Anti-Ban- und Wartungspraktiken aus diesem Leitfaden.

FAQs

Ist es legal, Amazon-Produktdaten mit einem GitHub-Scraper zu scrapen?

Amazons Nutzungsbedingungen beschränken die automatisierte Datenerfassung, und Amazon setzt das aktiv mit Unterlassungsaufforderungen und technischen Gegenmaßnahmen durch — besonders in den Jahren 2025–2026. Das Scraping öffentlich zugänglicher Produktdaten bewegt sich in einer Grauzone; Scraping hinter einem Login oder das Tarnen deines Bots als echter Browser ist deutlich riskanter. Das ist keine Rechtsberatung — sprich für deinen konkreten Anwendungsfall mit deinem Legal-Team.

Wie oft brechen Amazon-Scraper-GitHub-Repos?

Häufig. Amazon ändert Seitenlayouts, fügt neue Anti-Bot-Schichten hinzu und deprecatet Endpunkte regelmäßig. In dem Audit für diesen Artikel waren nur etwa 3 von 8 weit verbreiteten Repos im Jahr 2026 klar funktionsfähig. Selbst „funktionierende“ Repos haben oft offene Issues zu CAPTCHAs und 503-Fehlern. Rechne damit, dein Setup alle paar Wochen bis Monate zu aktualisieren oder zu debuggen.

Welcher ist 2026 der beste Amazon Scraper auf GitHub?

Es gibt keinen eindeutigen Sieger — es hängt von deinem Anwendungsfall und deinem technischen Komfort ab. Für einen leichten, direkten Python-Scraper gehört zu den aktuelleren Optionen. Für breitere Abdeckung über eine verwaltete API funktioniert , ist aber nicht wirklich DIY. Nutze die Frische-Checkliste aus diesem Artikel, um jedes Repo vorab selbst zu bewerten.

Kann Thunderbit Amazon ohne Code scrapen?

Ja. Thunderbits extrahiert Produkttitel, Preis, ASIN, Bewertungen, Marke, Verfügbarkeit und mehr mit einem Klick. Sie unterstützt den Browser-Scraping-Modus für Seiten mit Login-Anforderung, Cloud-Scraping für öffentliche Seiten mit hoher Geschwindigkeit, geplantes Scraping für wiederkehrende Jobs und den kostenlosen Export nach Google Sheets, Airtable, Notion und Excel. Du kannst starten, indem du die installierst.

Wie vermeide ich eine IP-Sperre beim Scraping von Amazon?

Nutze einen mehrschichtigen Ansatz: (1) Wechsel von einfachem requests zu einem TLS-imitierten Client wie curl_cffi, (2) nutze Residential-Proxies mit Sticky Sessions statt zufälliger Datacenter-Rotation, (3) füge zufällige Taktung und exponentielles Backoff hinzu, (4) halte deinen gesamten Header-Satz konsistent mit Browser-Profil und Marketplace-Locale, und (5) behandle wiederholte CAPTCHAs als Signal, die Sitzung zu beenden, nicht als Rätsel, das man endlos lösen sollte. Mehr Details findest du in der Anti-Ban-Entscheidungsmatrix weiter oben in diesem Artikel.