網路上充滿了資料,但問題在於:要手動蒐集它,無聊程度大概跟看油漆乾掉差不多——效率也一樣低。到了 2025 年,企業接觸到的網頁內容比以往任何時候都多,平均每天的網路資料攝取量,已從 2020 年的 1.2 TB 增加到 2025 年的 8 TB ()。不管您是在做銷售、行銷、電商還是營運,對快速、結構化且精準的網路資料需求,早就不只是「有更好」而已,而是營運上的必要條件。說真的,沒人有時間無止盡地複製貼上。

這也是內容爬取工具會迅速走紅的原因。這些工具——從 AI 驅動的 Chrome 擴充功能到企業級平台——都能幫您把整個流程自動化,將雜亂的網頁轉換成乾淨的試算表、資料庫或即時儀表板。我在 SaaS 和自動化領域做了很多年,老實說:選對工具不只是省時間,還能改變整個團隊的工作方式。接下來,就一起看看 2025 年最值得關注的 18 款內容爬取工具,重點會放在每款工具的特色、它們適合哪些商業需求,以及您該怎麼挑選最符合工作流程的方案。

為什麼企業需要頂尖的內容爬取工具

如果您曾經手動建立潛在客戶名單、監控競爭對手價格,或追蹤市場情緒,就會知道人工資料蒐集很快就會變成惡夢。速度慢、容易出錯,而且等您做完時,資料可能早就過時了。也因此,到 2025 年,超過 70% 的企業已採用自動化網頁擷取,把人工作業量大幅減少約 60% ()。

內容爬取工具能自動從網站擷取結構化資料,讓您可以:

- 把最新潛在客戶名單送進 CRM(不用再從目錄逐一複製貼上)

- 即時監控競爭對手價格與庫存

- 彙整評論、新聞與社群提及,作為行銷洞察

- 建立研究或分析用的客製資料集

- 排程定期擷取資料,持續產出報表

而且投資報酬率確實看得到:在 2020 到 2025 年間,使用網頁爬取的企業合計省下超過 5 億美元,營運效率提升約 20–40% ()。結論很簡單:內容爬取工具能讓團隊把時間花在策略上,而不是重複性勞務上。

我們如何挑選頂尖內容爬取工具

不是每款網頁爬蟲都一樣。這份清單是我用真實商業使用者的角度來看待——銷售、行銷、營運與研究團隊要的是結果,不是麻煩。以下幾點最重要:

- 易用性: 非技術人員能不能快速上手?有沒有點選式介面或 AI 協助?

- 自動化與功能: 能不能處理分頁、子頁面、排程與動態內容?能不能在雲端執行以提升速度與規模?

- 資料輸出與整合: 能不能匯出到 Excel、CSV、Google Sheets、Airtable、Notion,或透過 API 連接?

- 擴展性: 適不適合一次性任務,還是大規模、持續性的專案?

- 客製化: 能不能調整擷取邏輯、新增自訂欄位,或處理棘手網站?

- 合規與隱私: 這個工具能不能幫您守住 GDPR、CCPA 以及網站條款的界線?

- 支援與社群: 有沒有文件、客服或使用者社群能協助排除問題?

- 成本: 有沒有免費方案或試用?價格是否符合您的規模與預算?

當然,我也特別聚焦在 Thunderbit——這是我和團隊打造的工具——因為我真心認為,它是商務使用者開始 AI 網頁爬蟲最簡單的方式。

2025 年最適合高效率網頁爬取的 18 款內容爬取工具

接下來就來拆解這些最強工具,從 AI 驅動的簡易方案,到給開發者用的強大工具,以及介於兩者之間的各種選擇。

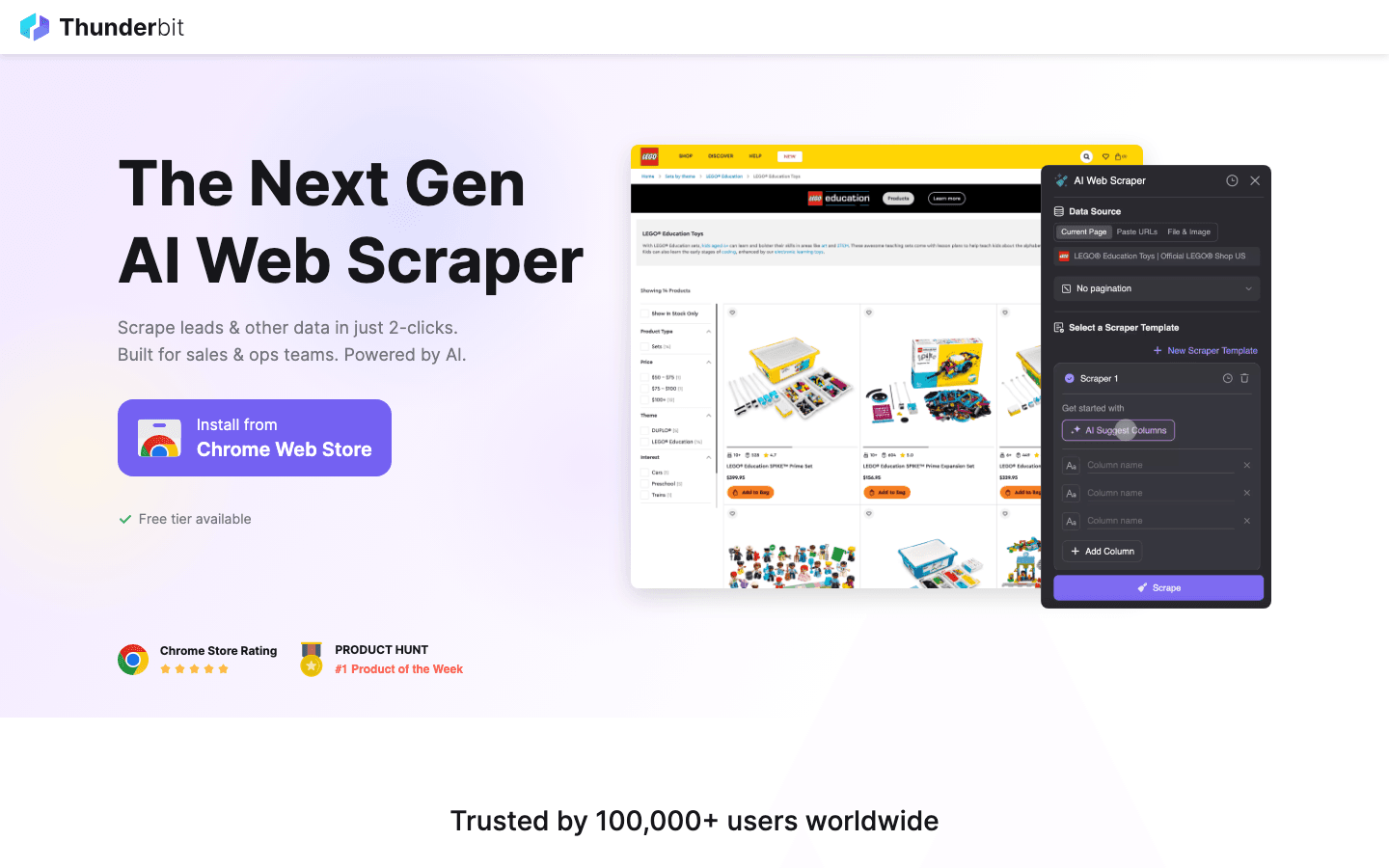

1. Thunderbit

是一款專為商務使用者設計的 AI 網頁爬蟲 Chrome 擴充功能,目標就是快、準、好上手。它最突出的功能是 AI 建議欄位:只要前往網頁、點一下「AI Suggest」,Thunderbit 的 AI 就會讀取頁面、建議要擷取的欄位,並幫您把爬蟲設定好。不用寫程式,也不用調整 selector——只要點擊、爬取、匯出。

是一款專為商務使用者設計的 AI 網頁爬蟲 Chrome 擴充功能,目標就是快、準、好上手。它最突出的功能是 AI 建議欄位:只要前往網頁、點一下「AI Suggest」,Thunderbit 的 AI 就會讀取頁面、建議要擷取的欄位,並幫您把爬蟲設定好。不用寫程式,也不用調整 selector——只要點擊、爬取、匯出。

- 子頁面爬取: Thunderbit 能自動造訪每個子頁面(例如產品或個人檔案詳情),並強化您的資料集,非常適合開發名單或電商研究。

- 分頁與範本: 可處理多頁清單,並提供 Amazon、Zillow、Instagram 等網站的即用範本。

- 免費資料匯出: 可匯出到 Excel、Google Sheets、Airtable、Notion、CSV 或 JSON,沒有付費牆。

- AI 自動填表: 用 AI 自動完成線上表單填寫,讓功能從爬取延伸到工作流程自動化。

- 雲端與瀏覽器爬取: 可依需求選擇快速的雲端爬取(公開網站)或瀏覽器模式(登入後工作階段)。

- 價格: 免費可爬取最多 6 頁(試用則可到 10 頁),付費方案從每月 15 美元起。

Thunderbit 非常適合想要在沒有技術困擾下自動化資料蒐集的銷售、行銷與營運團隊。這是我希望幾年前就有的工具——現在,任何人都能在幾分鐘內建立潛在客戶名單或監控競爭對手。

2. Scrapy

是開發者最愛的開源強力工具。它是一個以 Python 為基礎的框架,讓您可以撰寫自訂 spider 來大規模爬取與擷取資料。Scrapy 以速度與彈性見長,支援非同步爬取、自訂 pipeline、proxy 輪換,以及與資料庫或 API 整合。

是開發者最愛的開源強力工具。它是一個以 Python 為基礎的框架,讓您可以撰寫自訂 spider 來大規模爬取與擷取資料。Scrapy 以速度與彈性見長,支援非同步爬取、自訂 pipeline、proxy 輪換,以及與資料庫或 API 整合。

- 最適合: 建立大型、複雜或重複性爬取專案的開發者與資料工程師。

- 優點: 完整控制權、可延伸性強、社群龐大、可靠度經過實戰驗證。

- 缺點: 非程式開發者學習曲線較陡;沒有視覺化介面。

如果您熟悉 Python,又想打造穩健、可擴充的爬蟲,Scrapy 就是業界標準。

3. Octoparse

是一款免寫程式、雲端式的網頁爬蟲,提供視覺化拖放介面。您可以用點選方式選取資料、設定分頁,甚至用 AI 輔助的模式偵測來加快設定。

是一款免寫程式、雲端式的網頁爬蟲,提供視覺化拖放介面。您可以用點選方式選取資料、設定分頁,甚至用 AI 輔助的模式偵測來加快設定。

- 內建範本: 幾分鐘內即可從 Amazon、Twitter、Google 地圖等熱門網站擷取資料。

- 雲端爬取與排程: 可在 Octoparse 的伺服器上執行任務、安排週期性作業,並處理大規模專案。

- 匯出選項: CSV、Excel、JSON、API 整合。

- 價格: 有免費方案但有限制;付費方案約從每月 75 美元起。

Octoparse 很適合想要強大爬取能力、但又不想寫程式的商業分析師與非程式人員。

4. ParseHub

是一款視覺化網頁爬蟲,在處理動態內容與複雜網站結構方面表現出色。它的點選式介面可讓您建立帶有條件邏輯、迴圈與多層級導覽的工作流程。

是一款視覺化網頁爬蟲,在處理動態內容與複雜網站結構方面表現出色。它的點選式介面可讓您建立帶有條件邏輯、迴圈與多層級導覽的工作流程。

- 動態內容: 可處理下拉選單、無限捲動與互動元素。

- 雲端與本機執行: 可在雲端執行專案(付費),或針對小型任務在本機執行。

- 匯出: CSV、Excel、JSON、API。

- 價格: 免費方案相當大方;付費方案從每月 49 美元起。

ParseHub 很適合需要彈性與強大功能、但不會寫程式的人來應付棘手網站。

5. Data Miner

是一款 Chrome/Edge 擴充功能,主打快速、以範本為基礎的爬取。它提供超過 50,000 種公開擷取 recipe,涵蓋 15,000 多個網站,很多時候只要按一下就能完成爬取。

是一款 Chrome/Edge 擴充功能,主打快速、以範本為基礎的爬取。它提供超過 50,000 種公開擷取 recipe,涵蓋 15,000 多個網站,很多時候只要按一下就能完成爬取。

- Google Sheets 整合: 可直接把擷取的資料上傳到 Sheets。

- 自訂 Recipe: 可用點選方式或 XPath 建立自己的擷取邏輯。

- 分頁與自動化: 支援多頁爬取與排程執行。

- 價格: 有免費方案;付費方案從每月 19 美元起。

非常適合需要在瀏覽器中快速抓取中小型資料的分析師與行銷人員。

6. WebHarvy

是一款 Windows 桌面應用程式,具備點選式介面與自動模式偵測。只要點一下元素,WebHarvy 就會把所有相似項目高亮標示,方便擷取。

是一款 Windows 桌面應用程式,具備點選式介面與自動模式偵測。只要點一下元素,WebHarvy 就會把所有相似項目高亮標示,方便擷取。

- 支援圖片、文字、分頁: 可爬取產品圖片、電子郵件、URL 等多種內容。

- 桌面排程: 可在您的電腦上安排爬取任務。

- 一次性授權: 每台電腦約 199 美元。

很適合想要簡單、不要訂閱制、而且會定期爬取的小型企業使用者。

7. Import.io

是一個企業級雲端平台,專為大規模資料擷取設計。它提供 AI 驅動的資料清理、即時監控,以及完善的合規功能。

是一個企業級雲端平台,專為大規模資料擷取設計。它提供 AI 驅動的資料清理、即時監控,以及完善的合規功能。

- API 整合: 可直接把資料送到資料庫、BI 儀表板或應用程式。

- 合規性: 以 GDPR 與 CCPA 為設計考量。

- 價格: 企業合約,屬於高階方案。

最適合需要可靠、合規且可擴展網路資料管線的大型組織。

8. Apify

是一個雲端自動化平台,也是一個網頁爬取「actors」(機器人)市集。您可以使用針對常見網站的預建 actors,也能用 JavaScript 或 Python 自行開發。

是一個雲端自動化平台,也是一個網頁爬取「actors」(機器人)市集。您可以使用針對常見網站的預建 actors,也能用 JavaScript 或 Python 自行開發。

- 市集: 提供數百種即用爬蟲,適用於 LinkedIn、Amazon 等網站。

- 排程與 API: 可透過 API 執行、排程與整合 actors。

- 價格: 有免費方案;付費使用從每月 49 美元起。

很適合想要自動化、彈性與社群驅動解決方案的開發者與技術型團隊。

9. Visual Web Ripper

是一款桌面工具,專攻進階、大量資料擷取。它的工作流程建構器可讓您設計多層級爬取流程,並自動化大規模專案。

是一款桌面工具,專攻進階、大量資料擷取。它的工作流程建構器可讓您設計多層級爬取流程,並自動化大規模專案。

- 排程與自動化: 可依固定間隔執行專案。

- 資料庫整合: 可直接匯出到 SQL、Excel、CSV、XML 或 JSON。

- 一次性授權: 約 349 美元。

最適合需要在內部擷取大量資料的 IT 團隊或重度使用者。

10. Dexi.io

是一個雲端平台,適合協作型網路資料專案。它提供工作流程自動化、排程與團隊管理功能。

是一個雲端平台,適合協作型網路資料專案。它提供工作流程自動化、排程與團隊管理功能。

- 工作流程自動化: 可跨團隊建立並分享資料管線。

- API 與匯出: 可整合資料庫、雲端儲存或 BI 工具。

- 價格: 客製化報價;目標客群是團隊與企業。

很適合管理持續性、協作型資料專案的組織。

11. Content Grabber

是專為代理商與企業打造的專業級爬取工具。它提供進階自動化、錯誤處理,甚至還有白牌化選項。

是專為代理商與企業打造的專業級爬取工具。它提供進階自動化、錯誤處理,甚至還有白牌化選項。

- 腳本與客製化: 可使用 C# 或 VB.NET 進行深度控制。

- 錯誤復原與記錄: 為大型任務的穩定性而設計。

- 企業定價: 屬於高階方案;提供免費試用。

最適合需要為客戶打造可重複、可客製化爬取方案的代理商或企業。

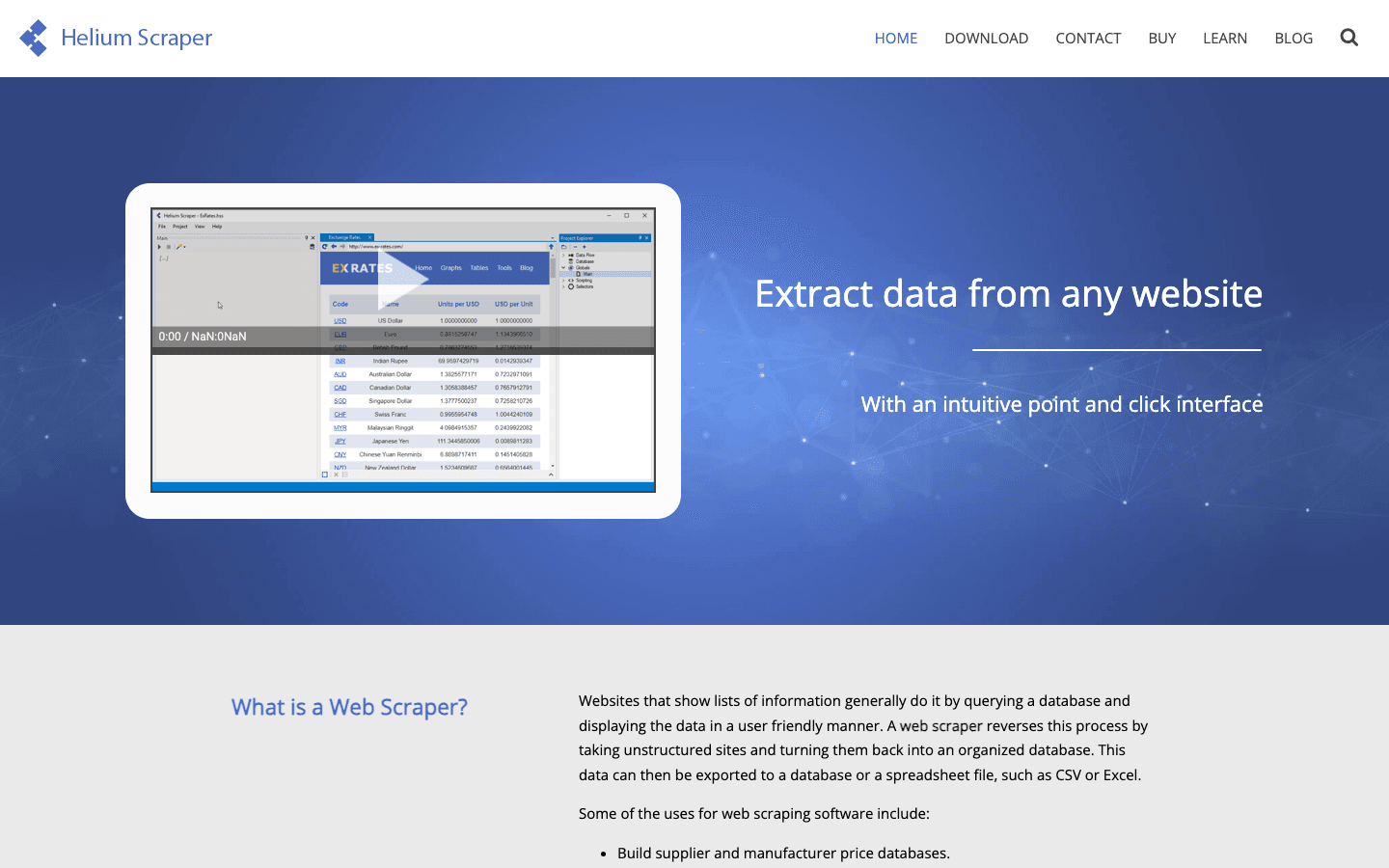

12. Helium Scraper

是一款結合視覺化擷取與腳本彈性的桌面工具。多數任務可用點選方式完成;需要進階邏輯時,也可以直接進入自訂 JavaScript。

是一款結合視覺化擷取與腳本彈性的桌面工具。多數任務可用點選方式完成;需要進階邏輯時,也可以直接進入自訂 JavaScript。

- 可處理動態內容: 適合 AJAX 內容很多的網站。

- 資料清理與轉換: 內建腳本功能,支援自訂工作流程。

- 一次性授權: 約 99 美元。

很適合想要彈性、又不想訂閱的重度使用者。

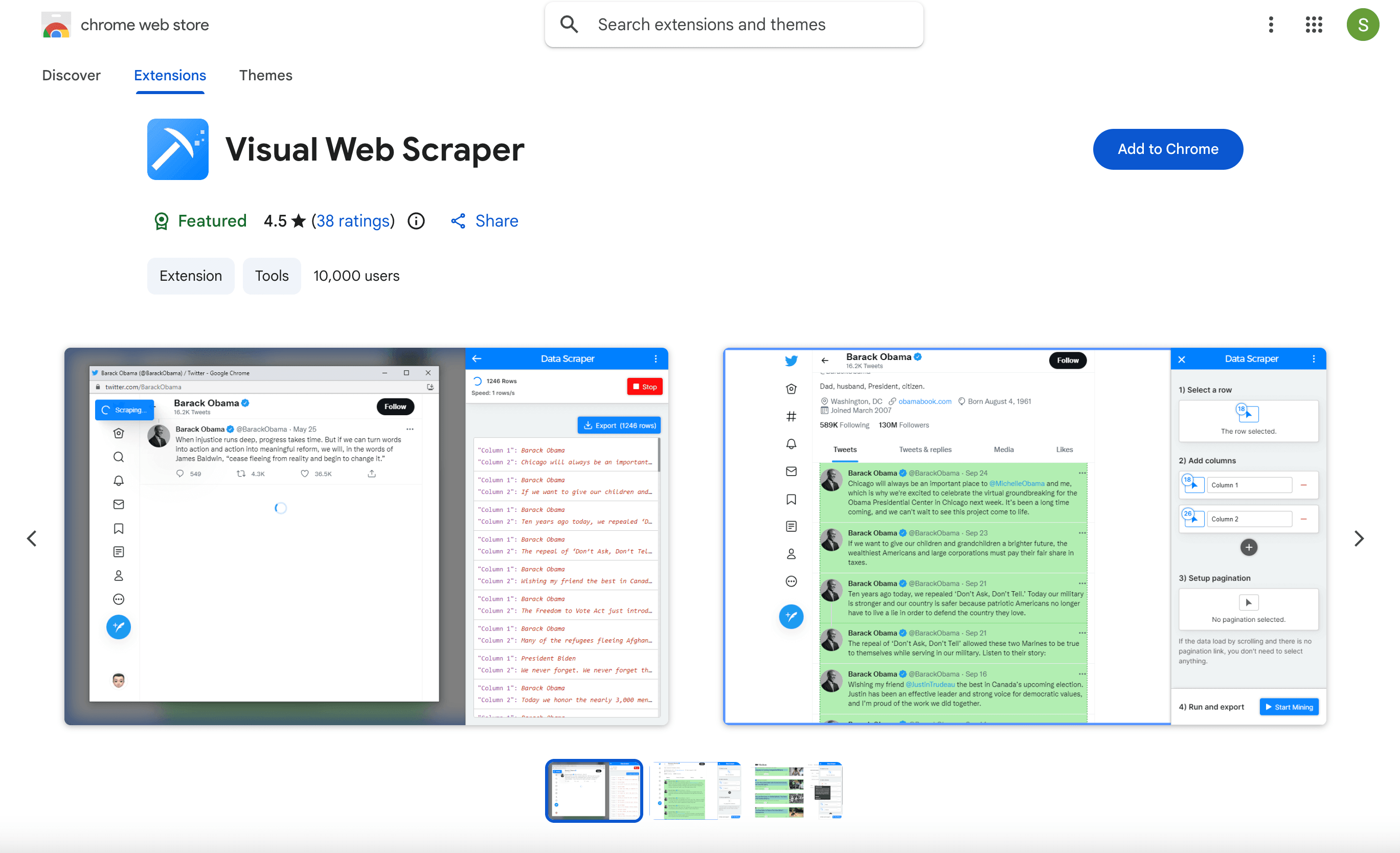

13. Web Scraper

是一款免費的 Chrome 擴充功能,很多人都是從它開始認識網頁爬取。只要定義 sitemap、點選元素,就能匯出到 CSV 或 JSON。

是一款免費的 Chrome 擴充功能,很多人都是從它開始認識網頁爬取。只要定義 sitemap、點選元素,就能匯出到 CSV 或 JSON。

- 多層級爬取: 可追蹤連結、處理分頁與巢狀資料。

- 本機免費使用: 也有付費雲端版本可用於排程與擴展規模。

很適合初學者、學生,或任何需要快速、免費、小型任務解決方案的人。

14. Mozenda

是一個企業雲端平台,主打合規、擴展性與代管服務。它的點選式介面可讓您建立資料擷取「agents」。

是一個企業雲端平台,主打合規、擴展性與代管服務。它的點選式介面可讓您建立資料擷取「agents」。

- 代管服務: Mozenda 團隊可以代您建立並維護爬蟲。

- 合規與支援: 對 GDPR、CCPA 與企業需求有很強的支援。

- 價格: 起價約每月 500 美元。

最適合希望一次到位、可擴展且有強大支援的大型組織。

15. SimpleIndex

是一款同時支援文件與網頁資料擷取的自動化工具,重點放在 OCR 與索引。

是一款同時支援文件與網頁資料擷取的自動化工具,重點放在 OCR 與索引。

- 螢幕擷取 OCR: 可從掃描文件、PDF,甚至畫面上的網頁表單擷取資料。

- 整合: 可輸出到資料庫、文件管理系統。

- 一次性授權: 每台工作站約幾百美元。

很適合把文件流程與網頁資料流程一起整合的組織。

16. Spinn3r

是一個即時內容爬取平台,涵蓋部落格、新聞與社群媒體。它的 Firehose API 可持續輸出來自數百萬來源的新內容。

是一個即時內容爬取平台,涵蓋部落格、新聞與社群媒體。它的 Firehose API 可持續輸出來自數百萬來源的新內容。

- 垃圾內容過濾與語言處理: 產出乾淨、結構化的資料流。

- API 存取: 可直接整合進您的系統。

- 訂閱制價格: 依使用量計費。

最適合需要即時內容流的媒體監測、新聞彙整或研究團隊。

17. FMiner

是一款用於複雜網頁爬取的視覺化工作流程建構器。它的拖放介面可讓您設計多層級、具條件判斷的爬取流程。

是一款用於複雜網頁爬取的視覺化工作流程建構器。它的拖放介面可讓您設計多層級、具條件判斷的爬取流程。

- Python 腳本: 可插入自訂程式碼以實作進階邏輯。

- 跨平台: 支援 Windows 與 Mac。

- 一次性授權: 起價約 168 美元。

很適合想用視覺化方式規劃複雜流程的分析師或資料科學家。

18. G2 Webscraper

(這裡指的是 G2 上評價很高的工具)因為簡單又有效而廣受好評。使用者特別喜歡免費、容易上手、而且能省下大量時間的工具——像是 Web Scraper Chrome 擴充功能或 Data Miner。

(這裡指的是 G2 上評價很高的工具)因為簡單又有效而廣受好評。使用者特別喜歡免費、容易上手、而且能省下大量時間的工具——像是 Web Scraper Chrome 擴充功能或 Data Miner。

- 使用者評價高: 在易用性與可靠性方面評分很高。

- 快速上手: 基礎到中階任務的學習曲線很低。

如果您想要一款「裝了就能用」的簡單爬取工具,G2 上使用者最愛的那些工具通常是最穩妥的選擇。

比較表:頂尖內容爬取工具一覽

| 工具 | 易用性 | 自動化與功能 | 匯出格式 | 合規與隱私 | 價格 | 最適合 |

|---|---|---|---|---|---|---|

| Thunderbit | ⭐⭐⭐⭐⭐ | AI 欄位、子頁面、雲端 | Excel、CSV、Sheets、Notion、Airtable、JSON | 使用者引導 | 免費,起價每月 $15 | 非程式人員、銷售、營運 |

| Scrapy | ⭐ | 完整程式碼、非同步、外掛 | CSV、JSON、DB | 使用者自主管理 | 免費、開源 | 開發者、大型專案 |

| Octoparse | ⭐⭐⭐⭐ | 視覺化、範本、雲端 | CSV、Excel、JSON、API | 使用者引導 | 免費,起價每月 $75 | 分析師、電商、非程式人員 |

| ParseHub | ⭐⭐⭐⭐ | 視覺化、動態內容、雲端 | CSV、Excel、JSON、API | 使用者引導 | 免費,起價每月 $49 | 非程式人員、複雜網站 |

| Data Miner | ⭐⭐⭐⭐⭐ | 範本、瀏覽器、Sheets | CSV、Excel、Sheets | 使用者引導 | 免費,起價每月 $19 | 快速瀏覽器任務 |

| WebHarvy | ⭐⭐⭐⭐⭐ | 視覺化、模式偵測 | Excel、CSV、XML、JSON | 使用者引導 | 一次性 $199 | Windows 使用者、小型企業 |

| Import.io | ⭐⭐⭐⭐ | AI、雲端、監控 | CSV、API、DB | GDPR、CCPA | 企業級 | 大型組織、合規需求 |

| Apify | ⭐⭐⭐ | 雲端、市集、API | JSON、API、Sheets | 使用者自主管理 | 免費,起價每月 $49 | 開發者、自動化、整合 |

| Visual Web Ripper | ⭐⭐⭐ | 工作流程、排程 | CSV、Excel、DB | 使用者引導 | 一次性 $349 | IT 團隊、大量資料 |

| Dexi.io | ⭐⭐⭐ | 雲端、團隊、工作流程 | CSV、API、DB、Storage | 使用者引導 | 客製化 | 團隊、持續性專案 |

| Content Grabber | ⭐⭐⭐ | 腳本、自動化 | CSV、XML、DB | 使用者引導 | 企業級 | 代理商、客製化解決方案 |

| Helium Scraper | ⭐⭐⭐ | 視覺化 + 腳本 | CSV、DB | 使用者引導 | 一次性 $99 | 重度使用者、客製邏輯 |

| Web Scraper | ⭐⭐⭐⭐⭐ | sitemap、瀏覽器 | CSV、JSON | 使用者引導 | 免費(本機) | 初學者、小型任務 |

| Mozenda | ⭐⭐⭐ | 雲端、代管、合規 | CSV、API、DB | GDPR、CCPA | 每月 $500+ | 企業、代管服務 |

| SimpleIndex | ⭐⭐⭐ | OCR、網頁、文件 | DB、DMS | 使用者引導 | 一次性 $500 | 文件 + 網頁資料 |

| Spinn3r | ⭐⭐ | 即時、API | JSON、API | 使用者引導 | 訂閱制 | 媒體、新聞、研究 |

| FMiner | ⭐⭐⭐ | 視覺化工作流程、Python | CSV、DB | 使用者引導 | 一次性 $168 | 複雜、視覺化工作流程 |

| G2 Webscraper | ⭐⭐⭐⭐⭐ | 簡單、瀏覽器 | CSV、JSON | 使用者引導 | 免費/不定 | 簡單、快速見效 |

如何為您的企業選擇合適的內容爬取工具

挑對工具的關鍵,就是把您的需求和工具優勢對上。下面是我的快速檢查清單:

- 先定義使用情境: 一次性還是持續性?小規模還是大規模?公開資料還是登入後資料?

- 對應技能程度: 非程式人員可先從 Thunderbit、Octoparse、ParseHub 或 WebHarvy 開始。開發者則可以深入使用 Scrapy 或 Apify。

- 確認匯出需求: 需要 Excel、Sheets 或 API 整合嗎?先確認工具支不支援。

- 考量合規性: 如果您身處受監管產業,或正在爬取個人資料,請優先選擇具備合規功能的工具(例如 Import.io、Mozenda)。

- 先從小規模開始: 先用免費方案或試用,在真實資料上測試後再正式採用。

- 提前思考擴展性: 未來需求會不會成長?選一款您能持續擴充的工具。

也別忘了:有時候最簡單的工具,反而最適合。若您只是需要一份快速的試算表,就別把事情搞得太複雜。

資料隱私與合規:該注意什麼

網頁爬取打開了無限可能,也帶來了相應責任。以下幾點能幫您守住法律與實務上的底線:

- 尊重 robots.txt 與網站政策: 永遠先確認網站是否允許爬取,並遵守其規範。

- 除非有正當理由與同意,否則避免爬取個人資料: GDPR 和 CCPA 不是開玩笑的。

- 不要過度打擾伺服器: 使用內建的節流、延遲與排程,避免被封鎖,也算是當個好網路公民。

- 如果您在敏感產業,請使用具合規功能的工具: Import.io 和 Mozenda 在設計上就已考量 GDPR/CCPA。

- 記錄您的操作: 保留您爬取了什麼、為什麼爬取的紀錄,特別是商業或受監管用途。

有道德的爬取,才是可持續的爬取,也能讓您的企業遠離麻煩。

結論:用對內容爬取工具,為您的團隊賦能

網路就是您企業最大、也最混亂的資料庫——但只要有對的內容爬取工具,您就能真正讓它發揮價值。不管您是在建立潛在客戶名單、追蹤競爭對手,還是為即時儀表板供資料,這 18 款工具都涵蓋了各種情境、技術程度與預算需求。

如果您想要最快看到成果, 是我最推薦給商務使用者的選擇:AI 驅動、免寫程式,而且能在幾分鐘內把任何網站變成結構化資料集。不過不管您的需求是什麼,建議先從免費試用開始、實際測試,看看哪一款最符合您的工作流程。

準備好告別複製貼上的苦工了嗎?下載 ,看看網路資料可以有多簡單。若您想更深入了解網頁爬取,也可以到 查看更多指南、技巧與教學。

常見問題

1. 什麼是內容爬取工具?它和一般網頁爬蟲有什麼不同?

內容爬取工具是一種網頁爬蟲,專門用來自動從網站擷取結構化資料。雖然所有網頁爬蟲都能蒐集資料,但內容爬取工具通常會提供排程、子頁面導覽、AI 欄位偵測,以及與商業工作流程整合等功能,對企業團隊來說更強大也更好上手。

2. 哪一款內容爬取工具最適合非技術使用者?

Thunderbit、Octoparse、ParseHub、Data Miner 和 WebHarvy 都非常適合非程式人員。Thunderbit 的 AI 簡潔體驗,以及能即時匯出到 Excel、Sheets、Airtable 或 Notion 的能力,特別突出。

3. 我要怎麼確保我的網頁爬取是合法且合規的?

請務必遵守網站條款、robots.txt 以及像 GDPR 和 CCPA 這類隱私法規。除非有正當理由與同意,否則避免爬取個人資料。若屬敏感產業,請選擇內建合規功能的工具(例如 Import.io、Mozenda)。

4. 這些工具能處理有 JavaScript 或無限捲動的動態網站嗎?

可以——像 Thunderbit、Octoparse、ParseHub、Apify 和 FMiner 這類工具,都能處理動態內容、無限捲動與多層級導覽。某些較複雜網站可能需要額外設定或雲端執行。

5. 為企業選擇內容爬取工具時,我應該考慮什麼?

請考量團隊的技術能力、資料需求規模、匯出/整合需求、合規考量與預算。先從免費方案或試用開始,並在正式採用前,用您的真實使用情境測試工具。

祝您爬取愉快——也希望您的資料永遠新鮮、結構化,並隨時可行動。

深入了解