網路上的資料多到爆,老實說,沒有人想一條一條手動複製貼上上千筆商品或職缺資訊。這也是為什麼網頁爬蟲成為銷售、營運、電商等商務工作者的必備技能。Python 因為語法簡單、函式庫又強大,早就成為開發網頁爬蟲的首選語言。根據 都愛用 Python,遠遠甩開其他語言。

但現實是:雖然 Python 爬蟲很強大,對新手來說還是很容易卡關,甚至有經驗的工程師也常被動態網站、防爬蟲機制或亂七八糟的資料搞到頭痛。所以我整理了這份超實用教學,從零開始帶你做一個 python 網頁爬蟲範例,還會介紹怎麼把 Python 跟像 這種 AI 工具結合,讓你抓資料更聰明、更輕鬆。不管你是想自動化名單蒐集、監控競品價格,還是把網頁資料整理進試算表,這裡都能找到實用步驟和實戰技巧。

Python 網頁爬蟲入門:從零開始環境建置

先來搞懂基本觀念。網頁爬蟲,其實就是自動化從網站抓資料的過程。比起手動複製貼上,爬蟲會自動瀏覽網頁、讀取 HTML,然後把你要的資訊(像商品價格、聯絡方式或評論)抓下來。對商務工作者來說,這代表你能即時取得銷售名單、價格監控或市場調查資料,隨時掌握商機(參考 )。

步驟 1:安裝 Python

首先,你要先安裝 Python 3。大部分人直接去 下載最新版就好。Windows 用戶安裝時記得勾選「Add Python to PATH」。Mac 用戶可以用 執行 brew install python,或直接下載安裝。安裝好之後,打開終端機(或命令提示字元),輸入:

1python --version或

1python3 --version如果看到像 Python 3.11.0 這樣的訊息,就代表安裝成功啦。

步驟 2:建立虛擬環境

虛擬環境 可以讓每個專案的套件互不干擾,避免衝突。在你的專案資料夾下執行:

1# macOS/Linux

2python3 -m venv .venv

3# Windows

4py -m venv .venv啟動虛擬環境:

- macOS/Linux:

source .venv/bin/activate - Windows:

.venv\Scripts\activate

這樣你安裝的套件都只會存在這個專案裡(參考 )。

步驟 3:安裝必要套件

你會用到幾個超常見的套件:

- Requests:抓網頁內容用的。

- BeautifulSoup (bs4):解析 HTML。

- Scrapy:進階、大規模爬取用。

安裝指令:

1pip install requests beautifulsoup4 scrapy- Requests 讓你像讀檔案一樣簡單發送 HTTP 請求。

- BeautifulSoup 幫你從 HTML 裡找出並擷取資料。

- Scrapy 則是功能超完整的爬蟲框架,適合大量頁面、錯誤處理和資料匯出。

新手建議先用 Requests + BeautifulSoup,等需要擴充時再考慮 Scrapy。

步驟 4:建立專案資料夾

養成好習慣,把專案檔案、資料檔和虛擬環境都放在同一個資料夾,未來維護起來會輕鬆很多。

python 網頁爬蟲範例:基礎腳本與程式架構

我們來實作一個簡單的爬蟲,抓網頁、解析內容並擷取資料。以下是針對 的最小範例:

1import requests

2from bs4 import BeautifulSoup

3URL = "https://example.com"

4response = requests.get(URL)

5response.raise_for_status() # 非 200 OK 會拋出錯誤

6soup = BeautifulSoup(response.text, "html.parser")

7# 找出所有段落標籤

8paragraphs = soup.find_all('p')

9for idx, p in enumerate(paragraphs, start=1):

10 print(f"Paragraph {idx}: {p.get_text()}")這段程式在做什麼?

- 匯入套件。

- 用

requests.get取得網頁內容。 - 用 BeautifulSoup 解析 HTML。

- 找出所有

<p>標籤並印出文字。

常見錯誤提醒:

- 忽略檢查

response.status_code(一定要確認是 200 OK)。 - 對

None物件呼叫.get_text()(找不到元素時會出錯)。 - 忘記啟動虛擬環境(導致套件無法匯入)。

這個流程——匯入、抓取、解析、擷取、輸出——就是大多數 Python 爬蟲的基本架構。

用 Python 實作網頁爬蟲:逐步流程

我們來拆解一個實際爬蟲任務的步驟。

1. 檢查網站結構

打開瀏覽器,右鍵點你想抓的資料,選「檢查」或「Inspect」,開啟開發者工具。觀察 HTML 結構,找出有辨識度的標籤、class 或 id(參考 )。

2. 抓取網頁內容

用 Requests 取得 HTML:

1headers = {"User-Agent": "Mozilla/5.0"}

2response = requests.get(URL, headers=headers)

3response.raise_for_status()加上 User-Agent 可以避開一些簡單的防爬蟲機制。

3. 解析 HTML

1soup = BeautifulSoup(response.text, "html.parser")4. 定位並擷取資料

假設你要抓每個 <div class="job-card"> 的職缺資訊:

1job_cards = soup.find_all('div', class_='job-card')

2for card in job_cards:

3 title = card.find('h2', class_='title').get_text(strip=True)

4 company = card.find('h3', class_='company').get_text(strip=True)

5 print(title, company)你可以用 .find()、.find_all() 或 .select()(CSS 選擇器)來做更複雜的查詢。

5. 處理多筆資料(清單)

針對多個容器(像商品列表、職缺卡片等)用迴圈擷取欄位,然後存成字典清單,方便後續匯出。

6. 疑難排解

- 如果抓不到資料,檢查選擇器是不是寫錯——有可能 class 名稱變了,或內容是 JavaScript 動態載入。

- 印出

response.text[:500],確認拿到的 HTML 是否正確。

python 網頁爬蟲範例:資料儲存與匯出

資料抓下來後,通常會想存起來。常見做法有:

印出到終端機

適合快速測試,不建議正式專案用。

匯出成 CSV

1import csv

2data = [

3 {"Name": "Alice", "Age": 25},

4 {"Name": "Bob", "Age": 30},

5]

6with open("output.csv", "w", newline="", encoding="utf-8") as f:

7 writer = csv.DictWriter(f, fieldnames=["Name", "Age"])

8 writer.writeheader()

9 writer.writerows(data)匯出到 Excel

如果有安裝 pandas 和 openpyxl:

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_excel("output.xlsx", index=False)存進資料庫

簡單需求可以用 Python 內建的 SQLite:

1import sqlite3

2conn = sqlite3.connect("scraped_data.db")

3cursor = conn.cursor()

4cursor.execute("CREATE TABLE IF NOT EXISTS people (name TEXT, age INTEGER)")

5for row in data:

6 cursor.execute("INSERT INTO people VALUES (?, ?)", (row["Name"], row["Age"]))

7conn.commit()

8conn.close()什麼時候用哪種方式?

- CSV:適合試算表、分享。

- Excel:需要格式化報表、多工作表時。

- 資料庫:大量或長期專案。

記得加上 encoding="utf-8",避免亂碼問題(參考 )。

Thunderbit 結合 Python:讓你的爬蟲流程更高效

接下來介紹 ,這款專為商務用戶設計的人工智慧網頁爬蟲 Chrome 擴充功能。

接下來介紹 ,這款專為商務用戶設計的人工智慧網頁爬蟲 Chrome 擴充功能。

Thunderbit 有哪些獨特之處?

- AI 智能欄位建議: Thunderbit 的 AI 會自動分析網頁,推薦你可以擷取哪些資料欄位,完全不用自己找 HTML 或寫選擇器。

- 點選式操作流程: 開啟擴充功能,讓 AI 建議欄位,點擊「爬取」就能完成。

- 自動抓取子頁面: Thunderbit 能自動拜訪細節頁(像商品頁、個人頁),幫你補充更多資料。

- 多元匯出: 支援下載 CSV、Excel,或直接匯出到 Google Sheets、Notion、Airtable(參考 )。

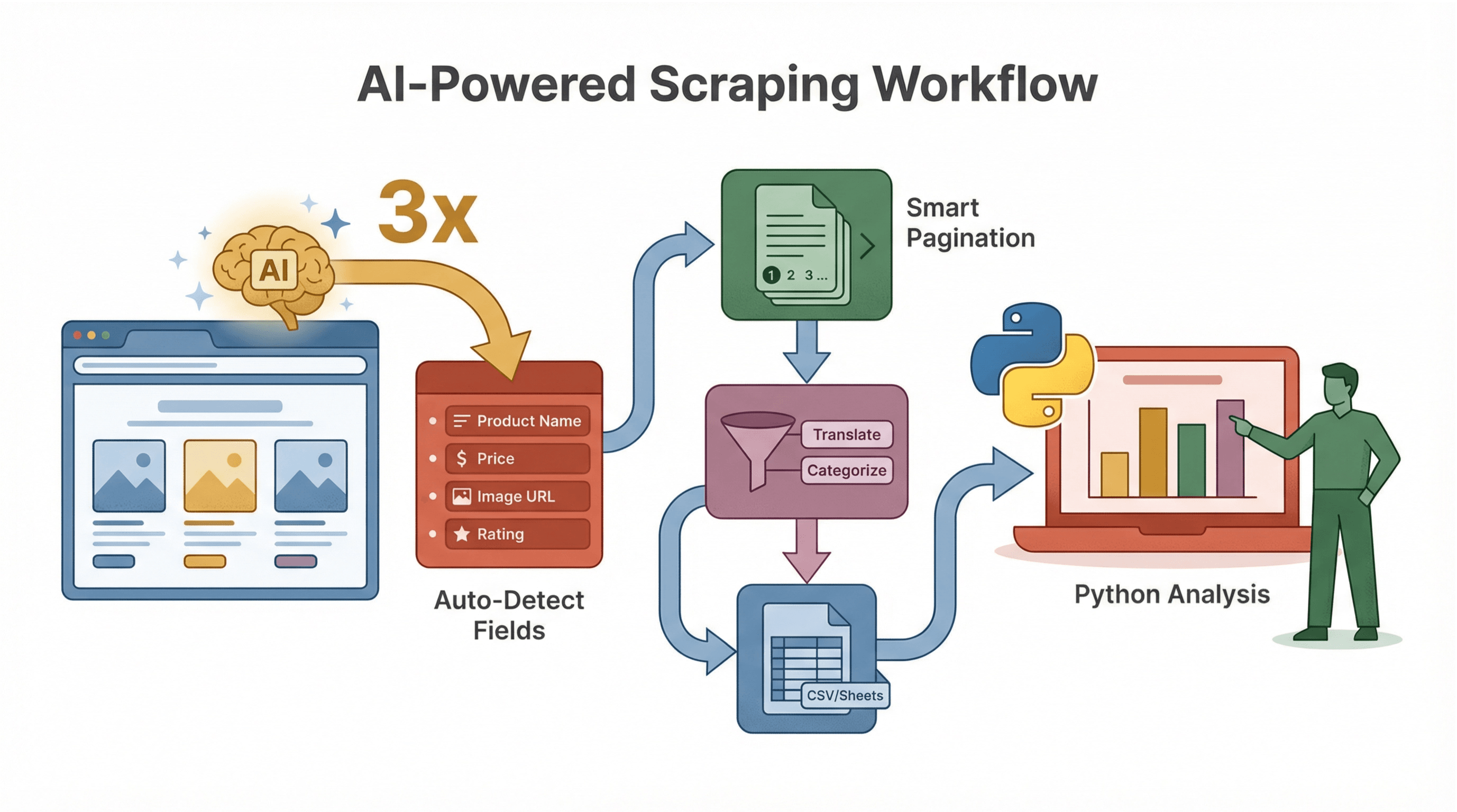

Thunderbit 如何與 Python 搭配?

假設你要抓一個大量 JavaScript 或需要登入的電商網站,傳統 Python 腳本可能會卡住,但 Thunderbit 在瀏覽器裡運作,能輕鬆處理這些情境。你可以先用 Thunderbit 抓資料,再用 Python 進一步分析、做報表或自動化。

實際應用範例:

- 用 Thunderbit 抓動態網站的商品清單(包含圖片、價格、評論)。

- 匯出成 CSV。

- 用 Python 分析趨勢、合併其他資料集或自動發送通知。

這種組合讓你不管程式能力如何,都能解決最棘手的爬蟲需求。

提升 Python 網頁爬蟲的準確性與穩定性

網頁爬蟲不只是抓資料,更要抓得準、抓得穩。以下是幾個實用建議:

1. 應對網站結構變動

網站 HTML 常常會改。選擇器盡量用獨特的 id 或穩定的 class,避免只靠標籤順序。

2. 加入錯誤處理

用 try/except 包住請求和解析程式碼:

1import time

2for attempt in range(3):

3 try:

4 response = requests.get(url, timeout=10)

5 response.raise_for_status()

6 break

7 except Exception as e:

8 if attempt < 2:

9 time.sleep(5)

10 else:

11 print(f"Failed after 3 attempts: {e}")3. 隨機 User-Agent 與代理伺服器

很多網站會封鎖像機器人的腳本。隨機 User-Agent 字串,如果大量爬取建議搭配代理伺服器,避免 IP 被封(參考 )。

4. 尊重 robots.txt 與網站規範

一定要檢查網站的 robots.txt 和服務條款。只抓公開資料,避免個資,並控制請求頻率(參考 )。

5. 日誌與監控

用 Python 的 logging 模組記錄錯誤與成功紀錄。如果定期執行爬蟲,建議設置失敗或無資料時的通知。

Thunderbit AI 功能如何強化 Python 網頁爬蟲

Thunderbit 不只是爬蟲,更讓整個流程變得更聰明、更高效。

Thunderbit 不只是爬蟲,更讓整個流程變得更聰明、更高效。

AI 智能欄位建議

Thunderbit 的 AI 能即時推薦可擷取的欄位,省去你檢查 HTML、寫選擇器的麻煩。例如在商品頁會自動偵測「商品名稱」、「價格」、「圖片網址」等。

子頁面與分頁自動處理

Thunderbit AI 能偵測有細節頁或多頁結果,自動幫你全部爬下來,完全不用寫額外程式。這對電商、房仲、名單蒐集等場景超級實用。

AI 資料清理與增強

想在爬取時自動翻譯、摘要或分類資料?Thunderbit 支援每個欄位加上 AI 提示詞,例如自動標記評論為「正面」或「負面」,或只擷取價格中的數字。

實際工作流程

- 用 Thunderbit 抓取並結構化資料(AI 自動建議欄位)。

- 匯出成 CSV 或 Google Sheets。

- 用 Python 進行分析、視覺化或自動後續處理。

這種流程很適合團隊合作——Thunderbit 負責爬取,Python 處理進階應用。

python 網頁爬蟲範例:進階技巧與常見問題

想更進階?這裡有幾個專業建議:

處理動態內容

很多現代網站用 JavaScript 載入資料。如果 Requests + BeautifulSoup 抓不到或資料不完整,可以試試:

- Selenium 或 Playwright:自動操作瀏覽器,完整渲染網頁後再擷取 HTML。

- 尋找 API:有時資料是透過背景 API 載入(通常回傳 JSON)。用瀏覽器的 Network 分頁找出這些端點,通常更容易抓!

處理分頁

透過改網址參數(像 ?page=2)迴圈抓取,或用 BeautifulSoup 找到「下一頁」連結,直到沒有更多頁。

定時自動爬取

用 Python 的 schedule 套件或排程工具(cron job)自動執行爬蟲。或直接用 Thunderbit 內建的排程功能,完全不用寫程式。

常見問題

- 驗證碼(CAPTCHA): 降低請求速度、用代理,或考慮人工協助。

- 編碼問題: 寫檔案時一定要指定

encoding="utf-8"。 - IP 被封鎖: 輪換代理、隨機 User-Agent,並遵守速率限制。

結論與重點整理

學會用 Python 做網頁爬蟲,其實沒那麼難。重點如下:

- 建好環境、安裝必要套件。

- 仔細檢查目標網站,規劃選擇器。

- 寫簡單腳本抓取、解析、擷取資料。

- 根據需求匯出成合適的格式。

進階時,結合 Python 跟像 這種 AI 工具,能輕鬆搞定動態、複雜或大量爬取任務。Thunderbit 的 AI 欄位建議、子頁面自動爬取、即時匯出等功能,能大幅減少人工操作,讓不會寫程式的人也能輕鬆上手。

記住:最好的爬蟲是穩定、合規又能解決問題。不管你是銷售、電商經理還是資料愛好者,網頁爬蟲都能帶給你全新洞察——從小地方開始,不斷優化學習。

想深入了解?歡迎參考 更多教學,或直接安裝 ,體驗 AI 驅動的爬蟲流程。

常見問答

1. Python 網頁爬蟲最簡單的入門方式是什麼?

建議先安裝 Python 3,再用 Requests 和 BeautifulSoup 套件抓取、解析網頁。從簡單網站開始,逐步挑戰更複雜的目標。

2. 如何處理用 JavaScript 載入資料的網站?

遇到大量 JavaScript 的網站,可以用 Selenium 或 Playwright 這類瀏覽器自動化工具,或在瀏覽器 Network 分頁找回傳 JSON 的 API。

3. 商務應用上,爬取的資料該如何匯出?

CSV 是最通用的格式(可用 Excel、Google Sheets 開啟),也可匯出成 Excel、JSON 或 SQLite 資料庫。Thunderbit 也支援直接匯出到 Google Sheets、Notion、Airtable。

4. 如何避免爬蟲被封鎖?

隨機 User-Agent、大量爬取時用代理伺服器、控制請求速率,並檢查 robots.txt。避免抓取個資或敏感資料。

5. Thunderbit 如何讓不會寫程式的人也能輕鬆爬取資料?

Thunderbit 利用 AI 自動建議欄位、處理子頁面與分頁,還能一鍵匯出結構化資料,完全不用寫程式,讓商務用戶也能快速取得所需資訊。

想自動化你的資料蒐集流程?現在就免費體驗 ,讓 AI 幫你升級網頁爬蟲效率!

延伸閱讀