想像一下:週一早上,您一邊喝著咖啡,一邊看著收件匣不停跳出通知。又有一款 AI 工具因為外洩敏感資料登上頭條。您的執行長要答案,法務團隊全面戒備,而客戶呢?他們正追問那些您在上一季上線的「智慧」系統,到底如何使用他們的資料。歡迎來到 2026 年,在這裡,AI 資料隱私不只是技術問題——它是董事會層級、定義品牌、決定職涯成敗的關鍵議題。

事實是,AI 已經深入商業運作的各個角落,從銷售與行銷到房地產與電商無一不包。但隨著 AI 採用率飆升,風險也同步增加。就在過去一年,與 AI 相關的隱私事件暴增 56%,而全球只有 47% 的人信任 AI 公司能保護他們的個人資料——這個數字還在快速下滑中(、)。作為多年來投入 SaaS 與自動化平台建設的人,現在又是 的共同創辦人,我可以很直接地說:理解最新的 AI 資料隱私統計,不只是合規打勾而已——它決定您能在這個新數位時代蓬勃發展,還是勉強求生。

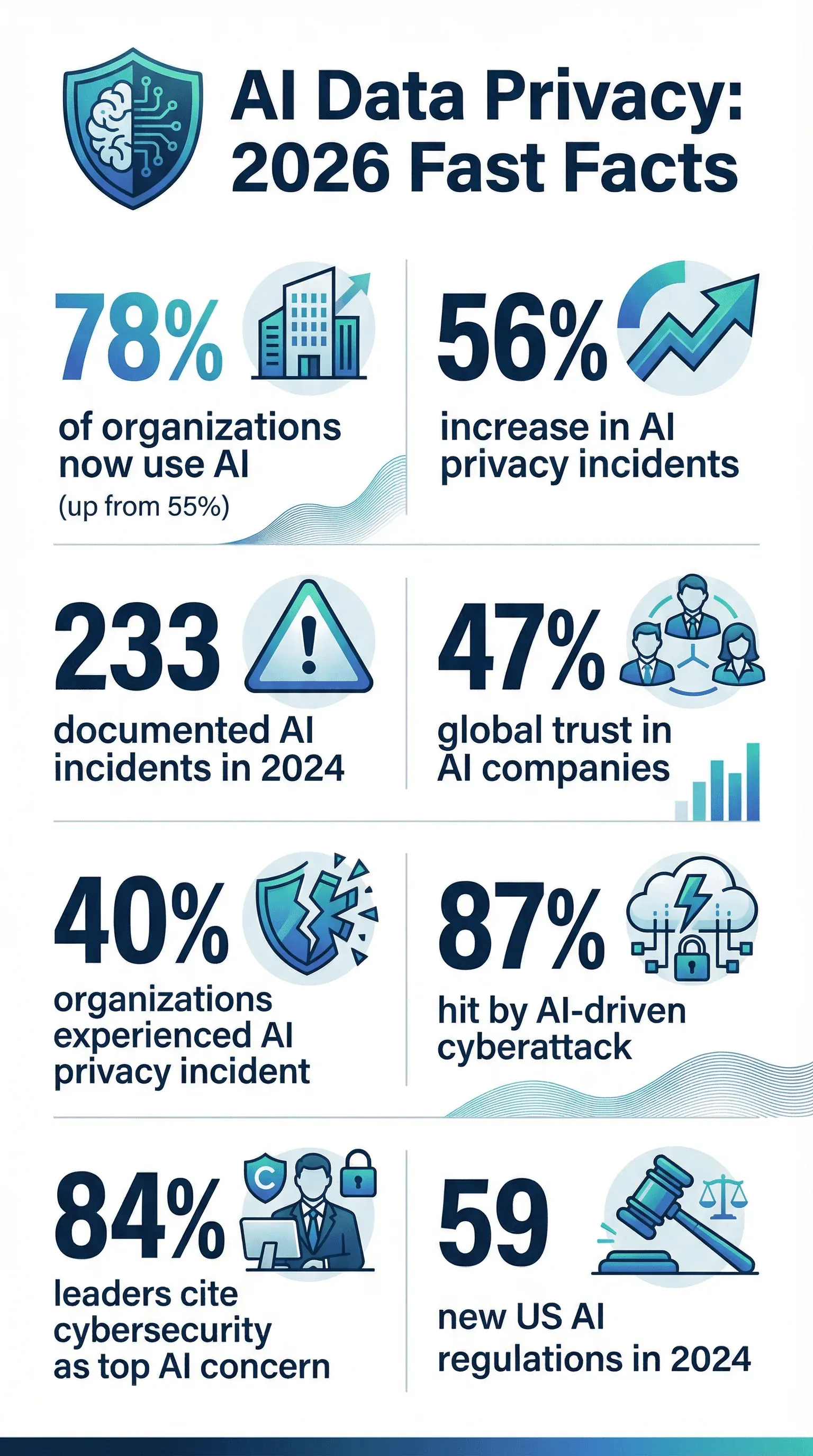

2026 年 AI 資料隱私現況:快速重點

先講結論。如果您想在下一場董事會或客戶簡報中快速抓住重點,以下是 2026 年最有影響力的 AI 資料隱私統計:

- AI 無所不在: 78% 的組織表示他們在 2024 年已使用 AI,較前一年僅 55% 大幅成長()。

- 事件激增: 2025 年可記錄的 AI 事件上升到 362 起,高於 2024 年的 233 起——年增率達 55%()。

- 外洩很常見: 40% 的組織已經發生過與 AI 相關的隱私事件(),而且 21% 在過去一年遭遇過網路攻擊()。

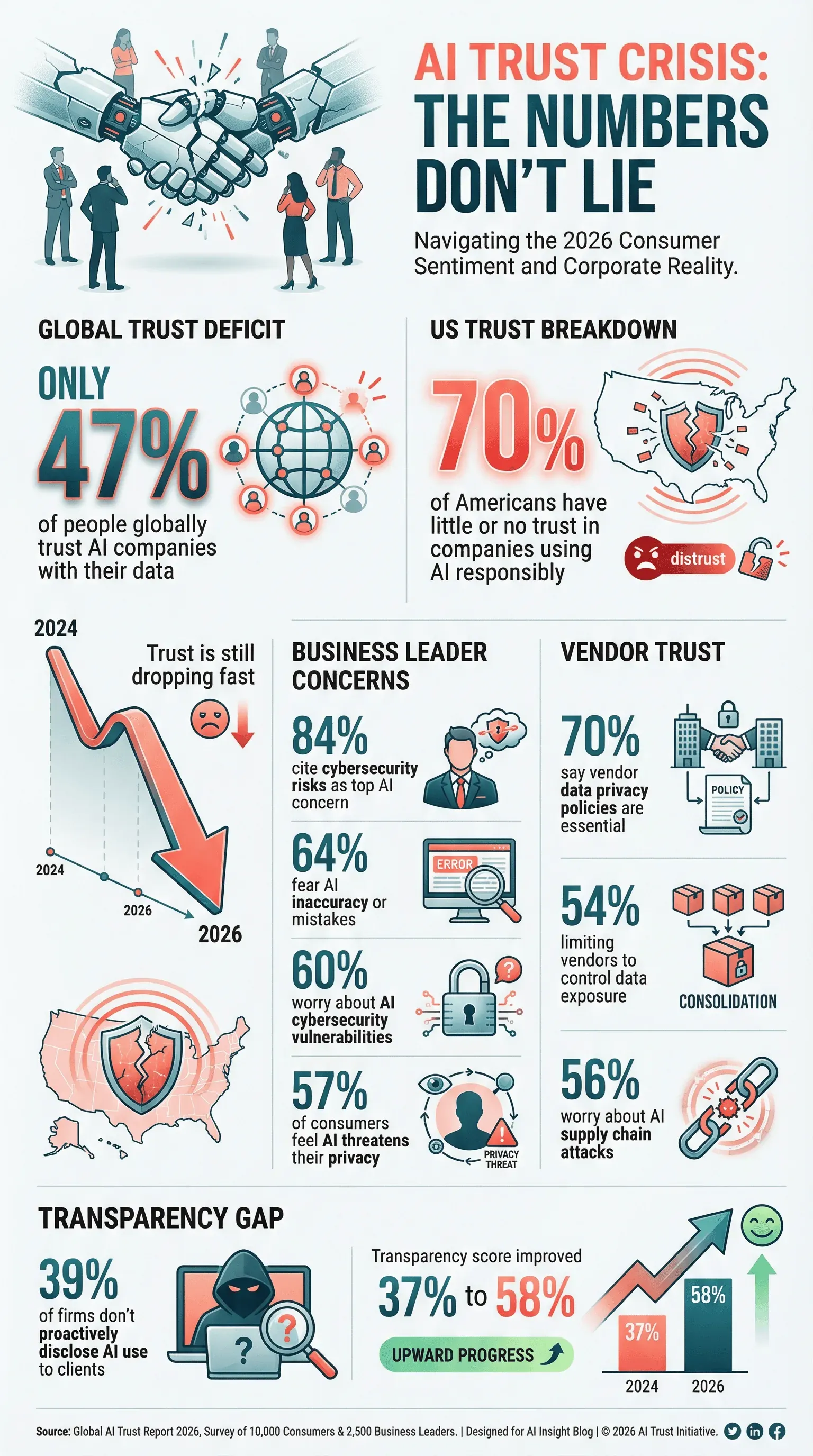

- 信任偏低: 全球僅 47% 的人信任 AI 公司處理其資料;在美國,70% 的人對企業負責任地使用 AI 幾乎沒有信任或完全不信任()。

- AI 是網安投資首選: PwC 針對 3,887 位主管進行的 2026 Global Digital Trust Insights 調查發現,**AI 投資(36%)**是未來 12 個月最優先的資安投資項目,領先雲端安全(34%)、網路安全(28%)與資料保護(26%);另外,60% 的組織也因地緣政治波動而提高整體資安投資()。

- 供應商審查趨嚴: 70% 的組織表示,在評估 AI 與科技合作夥伴時,供應商的資料隱私政策至關重要()。

- AI 威脅讓高層焦慮: 84% 的商業領袖把資安風險列為採用 AI 時最擔心的問題()。

- 監管持續升溫: 美國聯邦機構在 2024 年發布 59 項與 AI 相關的規範,是 2023 年的兩倍多()。

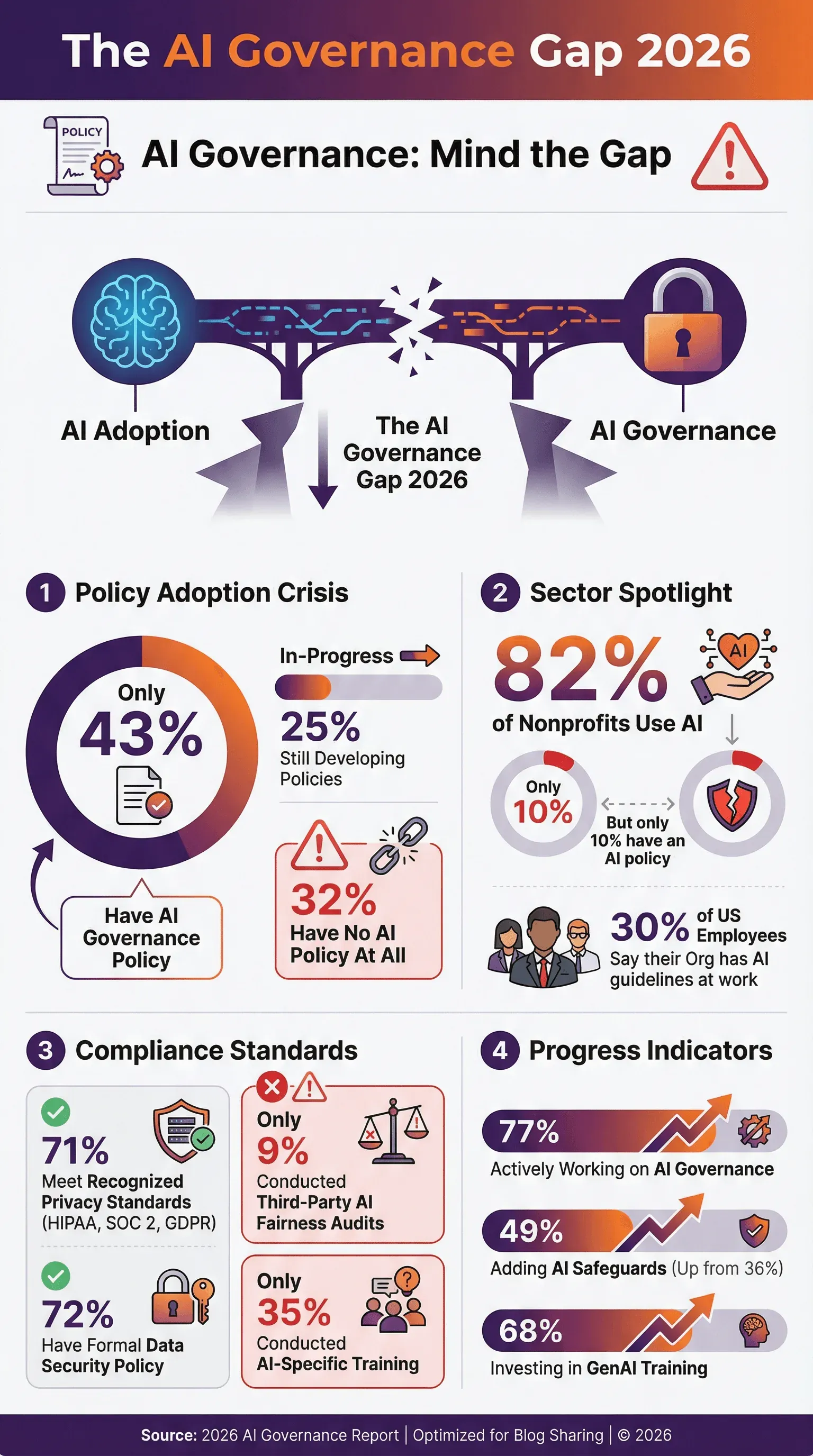

- 正式政策仍落後: 只有 43% 的企業已建立 AI 治理政策,但 77% 正積極推動中(、)。

- AI 驅動的網攻已成常態: 87% 的組織在過去一年遭遇過 AI 驅動的網路攻擊()。

這些數字不只是談資——它們是對所有負責資料、合規或數位轉型的人發出的警訊。

為什麼 AI 資料隱私比以往更重要

AI 不只是另一項 IT 升級——它正在重塑組織蒐集、處理與運用資料的方式。與傳統軟體不同,AI 系統往往會從龐大且雜亂的資料集中學習,內容可能從客戶電子郵件一路到醫療紀錄。更麻煩的是:AI 模型有時會把資訊「記住」,並以沒人預料到的方式把它吐出來,進而暴露原本不該見光的私人資料()。

這個規模大得驚人。單一 AI 模型可能處理數百萬筆紀錄,或從整個網路抓取資料——有時甚至沒有明確同意。這意味著保護這些資料的風險與代價都比以往更高。再加上 AI 能在幾秒內做決策(例如:核貸、篩選求職者),任何偏誤或錯誤都可能被加速放大,導致隱私侵害,甚至牽涉到公民權益問題。

如果您心想:「我們已經有隱私政策了,所以沒問題吧?」那可得再想想。現實是,AI 帶來了新的風險——像是資料投毒、模型反推與對抗式攻擊——這些都不是傳統防護機制原本就設計來應對的。而一旦發生 AI 隱私失誤,品牌聲譽的代價非常慘烈:客戶會流失、監管機關會開罰,品牌可能得花上好幾年才能恢復。到了 2026 年,AI 資料隱私不只是合規問題,而是生存問題。

AI 資料隱私統計:採用、疑慮與合規

AI 採用幾乎無所不在

老實說:AI 已經不再是「新興科技」。它已經是主流。到了 2024 年,78% 的組織正在使用 AI,較前一年的 55% 明顯上升()。在某些領域,例如法律與金融,採用率甚至更高——2025 年有 42% 的律師事務所在使用 AI 工具,幾乎是前一年的兩倍()。這波使用量爆發代表被蒐集、分析,甚至有時被暴露的資料都更多了。

隱私疑慮正在升高

權力越大,責任越大——焦慮也越多。全球 57% 的消費者現在認為 AI 對其隱私構成重大威脅()。在美國,Pew Research 於 2026 年 3 月的調查發現,47% 的成年人對國家能否妥善監管 AI 沒有太多信任或完全不信任,而 一半美國成年人表示,AI 在日常生活中的使用增加讓他們更擔心而不是更興奮(僅 10% 表示更興奮)()。

權力越大,責任越大——焦慮也越多。全球 57% 的消費者現在認為 AI 對其隱私構成重大威脅()。在美國,Pew Research 於 2026 年 3 月的調查發現,47% 的成年人對國家能否妥善監管 AI 沒有太多信任或完全不信任,而 一半美國成年人表示,AI 在日常生活中的使用增加讓他們更擔心而不是更興奮(僅 10% 表示更興奮)()。

就連商界領袖也很擔心:64% 擔心 AI 的不準確性或潛在錯誤,60% 特別指出 AI 相關的資安漏洞是重大疑慮()。

合規:一個持續移動的目標

各組織正努力追趕 GDPR、CCPA、HIPAA 與 SOC 2 等規範,但 AI 往往會帶來新的變數。71% 的組織表示他們符合公認的資料隱私標準(),72% 也有正式的資料安全政策。不過,重點在於:不到一半的組織擁有專門的 AI 治理或倫理政策。只有 43% 的組織已建立 AI 治理政策,另有 25% 還在制定中(、)。剩下的?等於是在盲飛。

AI 資料隱私政策採用情況

正式的 AI 資料隱私政策正迅速從「加分項」變成「必要項」。但數據顯示,仍有明顯落差:

- 只有 43% 的企業有 AI 治理政策,另有 25% 正在進行中()。

- 在美國,只有 30% 的員工表示其組織對工作中使用 AI 有指引或政策()。

- 在非營利組織中,82% 有使用 AI,但只有 10% 擁有 AI 政策()。

- 好消息是:77% 的組織正在積極推動 AI 治理措施,而在重度 AI 使用者中,這個比例接近 90%()。

率先行動的企業,已經開始把政策更新為包含禁止使用 AI 的條款、人工審核要求,以及對公平性與透明度的承諾。如果您的組織還沒開始,現在就是時候——在資料外洩或新法規逼您行動之前。

AI 資料隱私稽核與認證

政策很重要,但真正能證明您言行一致的,是稽核與認證。

- 71% 的公司表示他們符合 HIPAA、SOC 2 或 GDPR 等公認標準()。

- 51% 要求供應商在健康資料方面符合 HIPAA,45% 要求端對端加密()。

- 只有 9% 的組織做過聚焦 AI 公平性或偏誤的第三方稽核——但隨著法規跟上,這個數字預期會持續上升()。

SOC 2、ISO 27001 與 HITRUST 等認證,正成為市場競爭差異化的重要標誌。若您是供應商,客戶很可能要求您提出證明;如果您是採購方,務必確認合作夥伴夠格。

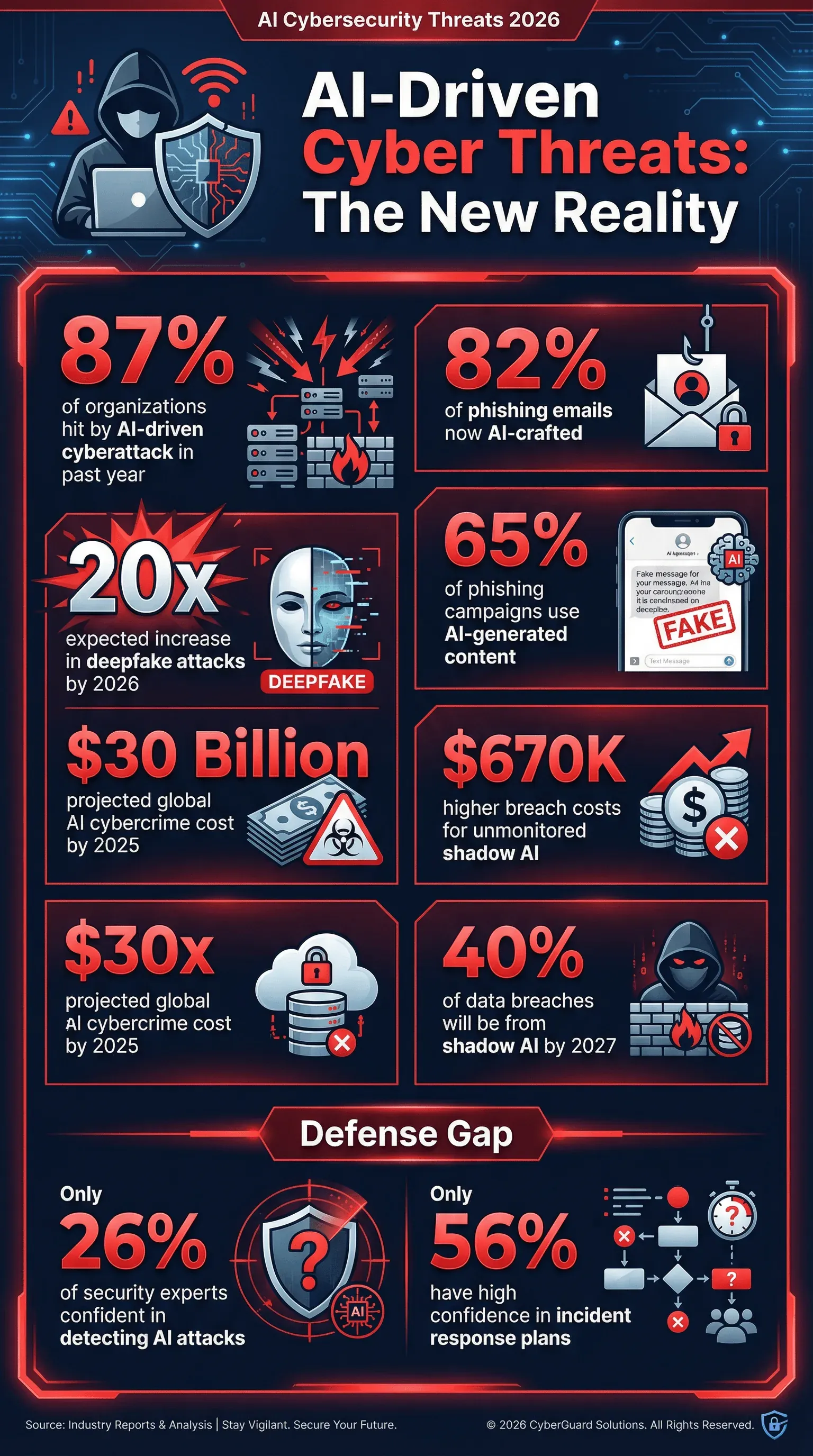

AI 網路安全:威脅、事件與應對

來談談伺服器房裡那頭大象:AI 不只是網路攻擊的目標,它也是攻擊者的工具。說實話,數字有點嚇人。

- 87% 的組織在過去一年遭遇過 AI 驅動的網路攻擊()。

- 65% 的釣魚攻擊活動現在會使用 AI 生成內容來模仿可信溝通()。

- 估計 82% 的釣魚郵件是借助 AI 製作的()。

- 深偽攻擊預計到 2026 年將增加 20 倍()。

- 影子 AI(員工未授權使用 AI)是快速升溫的風險——Gartner 預測到 2027 年,40% 的資料外洩將歸因於 AI 或「影子 AI」系統的濫用()。

還有一個讓 CISO 晚上睡不好的統計:只有 26% 的資安專家對自己偵測 AI 驅動攻擊的能力有高度信心()。這就像跟世界級魔術師玩捉迷藏。

AI 驅動的網路攻擊:數據顯示什麼

- 87% 的組織在過去 12 個月內遇到 AI 增強型攻擊()。

- 釣魚更聰明了: 到 2025 年底,超過 82% 的釣魚郵件是由 AI 製作()。

- 深偽正在爆發: 深偽音訊/影片攻擊預計到 2026 年會增加 20 倍。

- 影子 AI 風險高: 到 2027 年,40% 的資料外洩將源於 AI 或「影子 AI」的濫用()。

- 影子 AI 也會拉高外洩成本: 涉及影子 AI 的資料外洩平均成本為 463 萬美元,比全球平均高出約 67 萬美元;而且這類事件暴露客戶個資(PII)的比例特別高(65%,全球平均為 53%)()。

- 全球成本: AI 賦能的網路犯罪預計到 2025 年將達到 300 億美元()。

- 存取控制缺失: 在遭受 AI 相關外洩的組織中,97% 表示沒有適當的 AI 存取控制,而且 63% 不是沒有 AI 治理政策,就是還在草擬中()。

如果您還沒有用 AI 生成郵件做釣魚演練,或拿深偽攻擊來測試防禦,那您其實是在賭運氣。

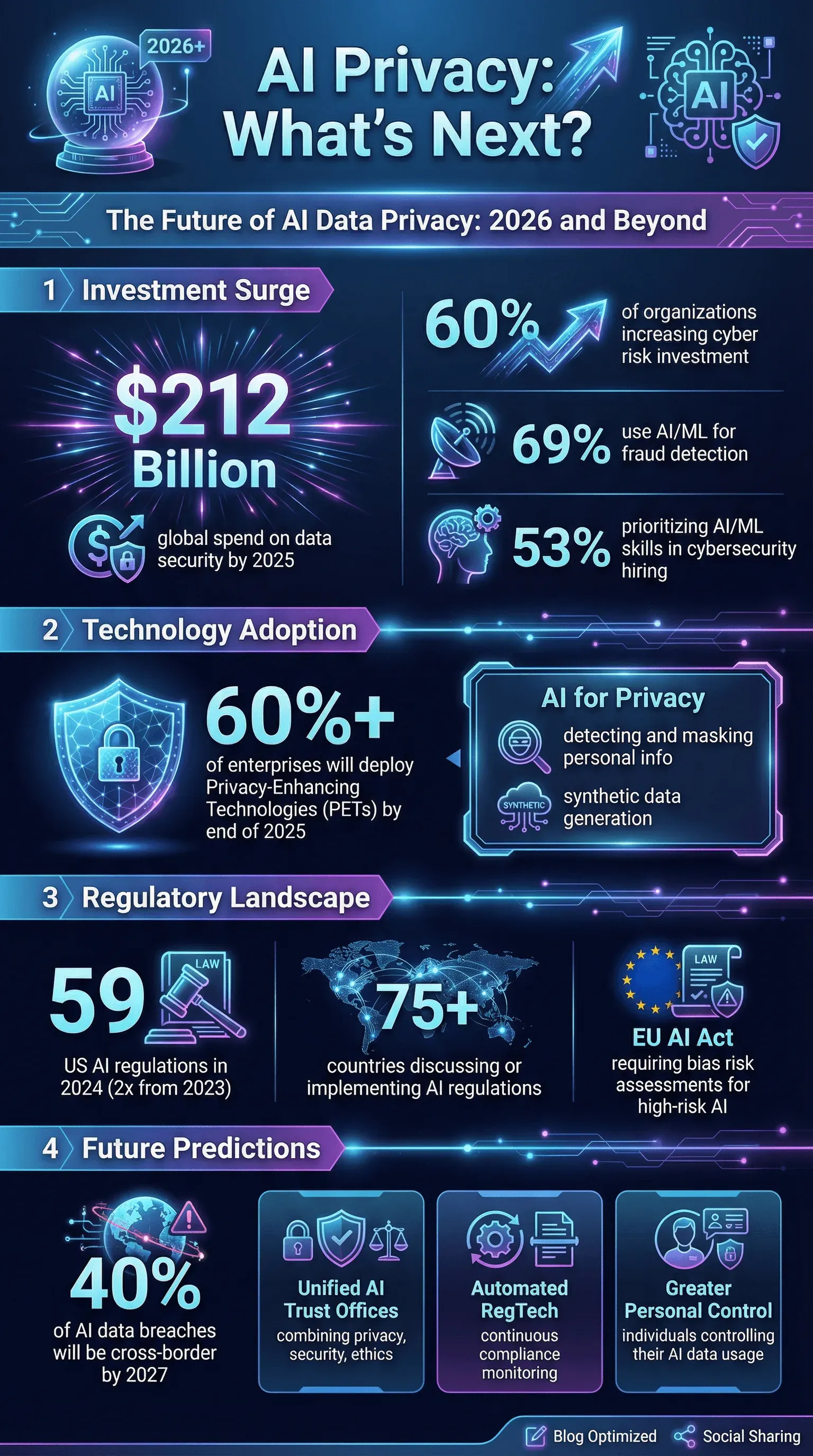

組織在 AI 網路安全上的投資

好消息是?各組織在 AI 資安上的投資比以往更高:

- 60% 的組織正在增加資安風險緩解投資,其中 AI 是主要驅動因素()。

- 69% 使用 AI 或機器學習來進行詐欺偵測與預防()。

- 53% 在資安招募中優先尋找 AI 與 ML 技能()。

- 全球資料安全與風險管理支出預計到 2025 年將達 2,120 億美元()。

但仍然有落差:將自身 AI 事件應變評為「非常好」的組織比例,從 2024 年的 28% 降到 2025 年的 18%,即使 AI 採用還在加速()。某些 2024 調查引用的 56% 信心數字,實際上高估了真實準備度。

AI 資料治理:訓練、監督與偏誤緩解

就算您擁有全世界最好的技術,如果人員與流程跟不上,風險依然存在。

- 只有 35% 的組織針對團隊進行與隱私、安全或倫理相關的 AI 專項訓練()。

- 68% 的公司會投資生成式 AI 員工訓練()。

- 30% 把人工監督當成 AI 防護措施的一部分()。

- 只有 9% 使用獨立稽核來檢查 AI 公平性()。

- 49% 正在新增 AI 治理防護措施,較前一年 36% 上升。

偏誤也是重要的隱私議題。若 AI 系統依照種族、性別或其他屬性對個人資料作出不同處理,可能造成不平等的隱私傷害,甚至引發法律問題。46% 的高階主管表示,讓 AI 以負責任的方式運作——包括公平性——是其 AI 投資的首要目標之一()。但對多數組織而言,衡量與降低偏誤仍在進行中。

AI 偏誤與公平性:對隱私的影響

- 涉及偏誤或安全問題的 AI 相關事件每年都在快速增加()。

- 一些公司在進行偏誤緩解後,求職者推薦中的性別差距降低了 25%。

- 監管壓力也在升高:歐盟的 GDPR 與即將上路的 AI Act,將要求對「高風險」AI 系統進行偏誤風險評估。

如果您沒有測試 AI 的偏誤,不只是可能造成公關災難——還可能面臨訴訟與商機流失。

供應商與生態系風險:整併與第三方暴露

沒有任何公司是孤島。大多數企業都依賴供應商、雲端服務商與合作夥伴網絡——而這些都可能帶來隱私風險。

- 54% 的公司正在限制供應商數量,以控制成本並降低資料暴露風險()。

- 70% 的公司在篩選科技供應商時,將資料隱私政策視為必要條件。

- 56% 擔心 AI 驅動的供應鏈攻擊()。

趨勢很明確:整併供應商、要求更強的隱私控制,並把合作夥伴視為您自身安全邊界的延伸。

監管與客戶壓力:AI 資料隱私中的透明與揭露

監管機關與客戶都在加壓。2024 年,美國出現 59 項與 AI 相關的監管行動,是前一年的兩倍多。全球至少有 75 個國家已討論或實施 AI 規範()。

- 透明化已成常態: 客戶期待您揭露 AI 的使用情況,但 39% 的公司坦承他們不會主動告知客戶自己使用了 AI()。

- 稽核準備是必須的: 請準備好出示合規證據——HIPAA、SOC 2、AI 工具清單,以及資料處理控管。

- 基礎模型開發者的透明度其實在下降。 Stanford 的 Foundation Model Transparency Index 在 100 分制上,平均分數從 2024 年的 58 分降到 2025 年的 40 分;多數前沿實驗室對訓練資料、算力與風險的揭露,比一年前更少()。

如果您還沒準備好接受稽核,或面對一份嚴格的客戶問卷,那您就還沒準備好迎接 2026 年。

AI 資料隱私的未來:預測與新興趨勢

展望未來,以下是我看到的走向(也是專家們的看法):

- 隱私將成為競爭優勢: 能證明其 AI 安全、重視隱私且合乎倫理的公司,將贏得客戶青睞()。

- 治理整合: 預期會出現把隱私、安全與倫理整合在一起的「AI Trust」辦公室。

- 隱私增強技術(PETs): 超過 60% 的企業計畫在 2025 年底前部署 PETs()。

- 自動化合規: AI 的 RegTech 將變得不可或缺,持續監控 AI 系統合規問題的工具將成為標配。

- 跨境資料挑戰: 到 2027 年,40% 的 AI 相關資料外洩將來自跨境資料濫用()。

- 個人控制權更大: 未來會有更多工具讓個人控制自己的資料在 AI 中如何被使用。

- AI 用於保護隱私: AI 也會被用來偵測與遮蔽個資、產生合成資料等。

- 事件應變與韌性: 組織將從只重預防轉向重視韌性,包括為 AI 相關事件購買保險,以及演練資料投毒或模型損毀後的復原。

身為一個對自動化與 AI 著迷、同時對資料隱私抱有健康程度焦慮的人,我相信未來十年的贏家,會是那些把隱私與安全當作核心功能,而不是事後補丁的人。

重點整理:2026 年 AI 資料隱私統計對您的組織意味著什麼

最後我們用一些可執行的步驟收尾,因為沒有人想成為明年新聞裡的警世案例:

- 把 AI 資料隱私納入核心策略。 不要事後硬補,而是從一開始就內建。

- 進行完整的 AI 風險評估。 搞清楚您的 AI 系統、資料流與風險點。

- 投資 AI 專屬的訓練與治理。 不要讓團隊成為最弱的一環。

- 從 AI 角度強化技術防線。 用 AI 對抗 AI——部署進階監控與偵測工具。

- 加倍投入供應商管理。 整併、審查,並要求合規證明。

- 擁抱透明。 在客戶與使用者之前,先告訴他們您何時、如何使用 AI。

- 導入隱私增強技術。 盡可能對資料去識別化、加密並最小化使用。

- 為最糟情況做準備。 建立 AI 事件應變計畫,並定期演練。

- 持續跟進法規與標準。 監管環境變化很快,別措手不及。

- 把信任當成北極星。 在 2026 年及更遠的未來,信任就是您最有價值的資產。

可引用來源與延伸閱讀

想深入研究,或需要下一場簡報的數據嗎?以下是我整理這篇文章時參考的一些最佳資源:

- )

若想了解更多關於 AI、自動化與資料隱私的內容,歡迎閱讀 ,或深入參考我們關於 與 的指南。