網路上充斥著各式各樣的資料;如果您在商務、科技領域,甚至只是單純對某件事感到好奇,大概都曾希望能大量從網站擷取資訊——而不是整個下午都在複製貼上。關鍵是:到了 2025 年,幾乎一半的網路流量都來自爬取與抓取網頁資料的機器人,而超過70% 的數位企業仰賴公開網頁資料來做市場情報與營運決策()。但隨著網頁資料的需求暴增,真正把資料抓下來的過程卻可能有點惱人——尤其是現在這些由 JavaScript 驅動的動態網站。

這就是 JavaScript 派上用場的地方。作為網路的語言,JavaScript 天生就很擅長處理那些讓傳統爬蟲卡關的動態互動頁面。不論您是想自動化研究的開發者、想建立名單的業務,還是只是喜歡動手折騰的人,這份指南都會帶您從零開始了解如何打造一個 JavaScript 網頁爬蟲——從基礎概念到進階技巧,甚至也會示範如何用像 這類 AI 工具,完全跳過寫程式。

JavaScript 爬蟲基礎:什麼是使用 JavaScript 的網頁爬取?

先從基礎說起。網頁爬取是指自動從網站擷取資訊的過程。您可以把它想像成有一位超高效率的助理,能拜訪數百個頁面、複製您需要的資料,並整理成乾淨的試算表——而且完全不會抱怨手腕痠痛。

JavaScript 爬蟲,就是用 JavaScript 建立的網頁爬蟲。JavaScript 爬蟲主要有兩種執行方式:

- 在瀏覽器中: 直接在瀏覽器主控台執行腳本,或使用瀏覽器擴充功能,從您正在瀏覽的頁面抓取資料。

- 伺服器端(Node.js): 使用瀏覽器外的 JavaScript(透過 Node.js),抓取網頁、解析內容,並以程式化方式擷取資料。

這對商務使用者為什麼重要?因為網頁爬取可以支援從開發名單(從名錄中擷取聯絡人)、到價格監控(追蹤競爭對手)、再到市場研究(蒐集評論、新聞或趨勢)等各種用途。事實上,單在電商領域,48% 的網頁爬取使用者就集中在這個產業()。只要您在瀏覽器裡看得到,JavaScript 爬蟲大多就有機會幫您抓下來。

為什麼要用 JavaScript 做網頁爬取?現代網站的關鍵優勢

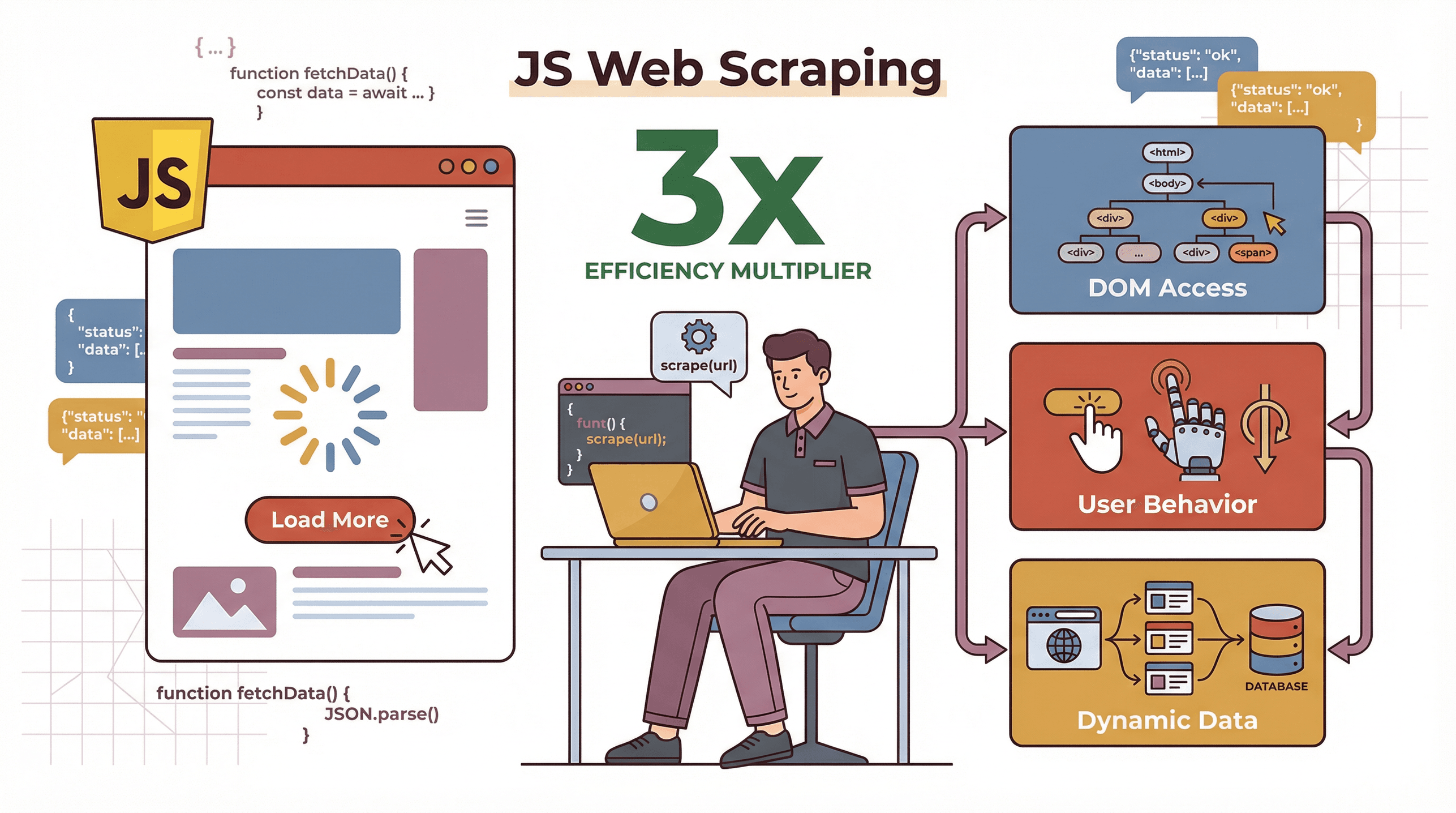

那麼,為什麼要拿 JavaScript 來做爬取,尤其當資料科學圈總是更愛 Python 呢?秘密就在於:現代網站本來就是由 JavaScript 驅動的。它們會動態載入內容、在頁面載入後再抓取資料,而且常常還需要使用者互動(像是點「載入更多」或捲動頁面)。JavaScript 爬蟲可以:

那麼,為什麼要拿 JavaScript 來做爬取,尤其當資料科學圈總是更愛 Python 呢?秘密就在於:現代網站本來就是由 JavaScript 驅動的。它們會動態載入內容、在頁面載入後再抓取資料,而且常常還需要使用者互動(像是點「載入更多」或捲動頁面)。JavaScript 爬蟲可以:

- 處理動態內容: 因為 JavaScript 就是瀏覽器裡執行的語言,所以它能看見並互動那些只有腳本執行後才出現的內容。

- 模擬真實使用者行為: 像 Puppeteer 這類工具可以自動點擊、捲動,甚至登入,運作方式就像真人一樣。

- 原生操作 DOM: JavaScript 能直接存取並操作頁面結構,讓您更容易精準擷取需要的內容。

JavaScript 和其他語言相比如何?下面是簡單比較:

| 因素 | JavaScript(Node.js) | Python | PHP |

|---|---|---|---|

| 動態內容 | 表現出色——可原生在瀏覽器中執行,很適合 JS 密集型網站 | 動態內容通常需要額外工具(Selenium/Playwright) | 有限 |

| 速度/並行能力 | 很高——非同步模型,可同時抓取多個頁面 | 不錯,但並行通常需要 asyncio/Scrapy | 較慢,也較少見 |

| 易用性 | 中等——網頁開發者會很順手,但非同步對初學者可能有點卡 | 對初學者較友善,教學資源很多 | 基本,可彈性較低 |

| 瀏覽器自動化 | 一級支援(Puppeteer、Playwright) | 不錯(Selenium、Playwright) | 少見 |

| 最適合 | 動態、互動式或單頁應用網站;網頁開發流程 | 資料分析、靜態網站、快速腳本 | 簡單靜態網站 |

如果您的目標網站是單頁應用程式,或是在捲動、點擊後才載入資料,那 JavaScript 往往就是最合適的工具()。

建立您的第一個 JavaScript 爬蟲:工具與環境設定

準備動手了嗎?以下是建立基本 JavaScript 爬取環境的方法——不需要框架。

-

安裝 Node.js

從 下載並安裝 Node.js。這樣就能在瀏覽器外執行 JavaScript。 -

初始化專案

打開終端機並執行:1mkdir my-scraper 2cd my-scraper 3npm init -y -

安裝必要函式庫

您會需要:- 或

node-fetch用於 HTTP 請求 - 用於解析 HTML(可以把它想成伺服器端的 jQuery)

1npm install axios cheerio - 或

-

檢查您的目標網站

打開 Chrome DevTools(右鍵 > 檢查),找出包含資料的 HTML 元素。記下它們的 class、ID 或標籤。

以下是一個簡單的入門腳本:

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapePage(url) {

4 try {

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const pageTitle = $('head > title').text();

8 console.log("頁面標題:", pageTitle);

9 } catch (err) {

10 console.error("爬取失敗:", err);

11 }

12}

13scrapePage('https://example.com');用 node scrape.js 執行後,您就會看到頁面標題被印出來。幾行程式碼就能做到這樣,已經很不錯了!

建立基礎 JavaScript 網頁爬蟲:逐步實作教學

接著來做點更實用的東西。假設您想從 抓取書名和價格,這是一個經典練習網站。

步驟 1:檢查頁面

每本書都放在 <article class="product_pod"> 裡。書名在 <h3><a title="Book Title"></a></h3>,價格則在 <p class="price_color">。

步驟 2:撰寫爬蟲

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapeBooks() {

4 const url = 'http://books.toscrape.com/';

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const books = [];

8 $('article.product_pod').each((i, elem) => {

9 const title = $(elem).find('h3 a').attr('title');

10 const price = $(elem).find('.price_color').text();

11 books.push({ title, price });

12 });

13 console.log(books);

14}

15scrapeBooks();這段程式會先抓取頁面、解析 HTML,接著遍歷每本書並擷取書名與價格。輸出結果會是一個整理好的書籍物件陣列:

1[

2 { "title": "A Light in the Attic", "price": "£51.77" },

3 { "title": "Tipping the Velvet", "price": "£53.74" }

4]步驟 3:擴充分頁處理

想抓多個頁面嗎?找出「下一頁」連結並迴圈切換頁面,每次更新 URL。只要再多寫一點程式,就能把整個網站都抓下來。

更進一步:用 JavaScript 處理動態內容與使用者互動

接下來是有趣(有時也最令人頭痛)的部分:動態內容。很多現代網站不會在初始 HTML 中直接顯示所有資料,而是等頁面載入後再用 JavaScript 載入,或需要您按按鈕、捲動頁面才能看到更多內容。

Cheerio 和 Axios 看不到這些內容——它們只能取得原始 HTML。若要爬取動態網站,您需要像 這樣的無頭瀏覽器。

使用 Puppeteer 進行進階 JavaScript 網頁爬取

Puppeteer 可以讓您用程式控制 Chrome(或 Chromium)。您可以:

- 開啟頁面

- 等待元素載入

- 點按鈕、填表單、捲動頁面

- 在所有腳本執行完後擷取內容

以下是一個簡單的 Puppeteer 範例:

1const puppeteer = require('puppeteer');

2(async () => {

3 const browser = await puppeteer.launch();

4 const page = await browser.newPage();

5 await page.goto('https://example.com', { waitUntil: 'networkidle0' });

6 await page.waitForSelector('.dynamic-content');

7 const data = await page.evaluate(() => {

8 return Array.from(document.querySelectorAll('.dynamic-content'))

9 .map(el => el.textContent.trim());

10 });

11 console.log(data);

12 await browser.close();

13})();您甚至可以自動登入、點擊「載入更多」按鈕,或透過程式化捲動頁面並等待新內容出現,來處理無限捲動()。

Thunderbit:讓 JavaScript 爬取更簡單、更強大

老實說:從零開始寫爬蟲很強大,但也很耗時間、需要技術能力,還得持續維護。這就是我這麼喜歡 的原因——這款 AI 驅動的 Chrome 擴充功能,能把網頁爬取變成兩次點擊就能完成的事。

Thunderbit 是為商務使用者打造的——不需要寫程式。它的運作方式如下:

- AI 建議欄位: 按一下按鈕,Thunderbit 的 AI 就會掃描頁面,建議最適合擷取的欄位(例如「產品名稱」、「價格」、「電子郵件」等等)。

- 兩步驟爬取: 檢視建議欄位後按一下「爬取」,Thunderbit 就會抓取所有資料,並自動處理分頁與子頁面。

- 子頁面與分頁處理: 需要更多細節嗎?Thunderbit 可以追蹤連結到子頁面(例如產品詳情或個人檔案),並把資料合併到您的表格中。

- 雲端或瀏覽器模式: 可在瀏覽器中爬取(很適合登入後頁面),或使用 Thunderbit 雲端以提升速度(一次最多 50 個頁面)。

- 免費且結構化匯出: 可將資料匯出到 Excel、Google Sheets、Airtable、Notion、CSV 或 JSON——不論抓多少,永遠免費。

Thunderbit 實戰:從資料擷取到匯出

假設您想從商業名錄中擷取聯絡資訊:

- 安裝 Thunderbit()。

- 打開名錄頁面。

- 點擊「AI 建議欄位」。 Thunderbit 的 AI 會建議像「姓名」、「電話」、「公司」這樣的欄位。

- 點擊「爬取」。 Thunderbit 會收集所有資料,即使跨越多個頁面也沒問題。

- 匯出到 Sheets 或 Excel。 完成。

原本可能要花數小時,甚至得找工程師處理的事情,現在只要幾分鐘就能完成。而且因為 Thunderbit 使用 AI,即使網站版面改變也能更有韌性——不必每次網站更新就讓腳本壞掉()。

傳統 JavaScript 爬取和 Thunderbit 的比較如下:

| 比較項目 | 手動 JS 爬蟲 | 進階 JS(Puppeteer) | Thunderbit AI 爬蟲 |

|---|---|---|---|

| 所需技能 | 寫程式 | 進階寫程式 | 不需要(點選即可) |

| 動態內容 | 有限 | 很好 | 內建 |

| 設定時間 | 每個網站數小時 | 幾小時到數天 | 幾秒到幾分鐘 |

| 維護成本 | 高 | 高 | 低(AI 自動適應) |

| 匯出選項 | 自訂程式 | 自訂程式 | 一鍵匯出到 Excel/Sheets 等 |

| 成本 | 免費(但很耗時) | 免費(但耗硬體與時間) | 免費方案,之後每月 15 美元起 |

進階技巧:使用 JavaScript 函式庫進行複雜網頁爬取

有時您需要做得更進一步——像是爬取登入後的資料、處理無限捲動,或避開反爬機制。

有時您需要做得更進一步——像是爬取登入後的資料、處理無限捲動,或避開反爬機制。

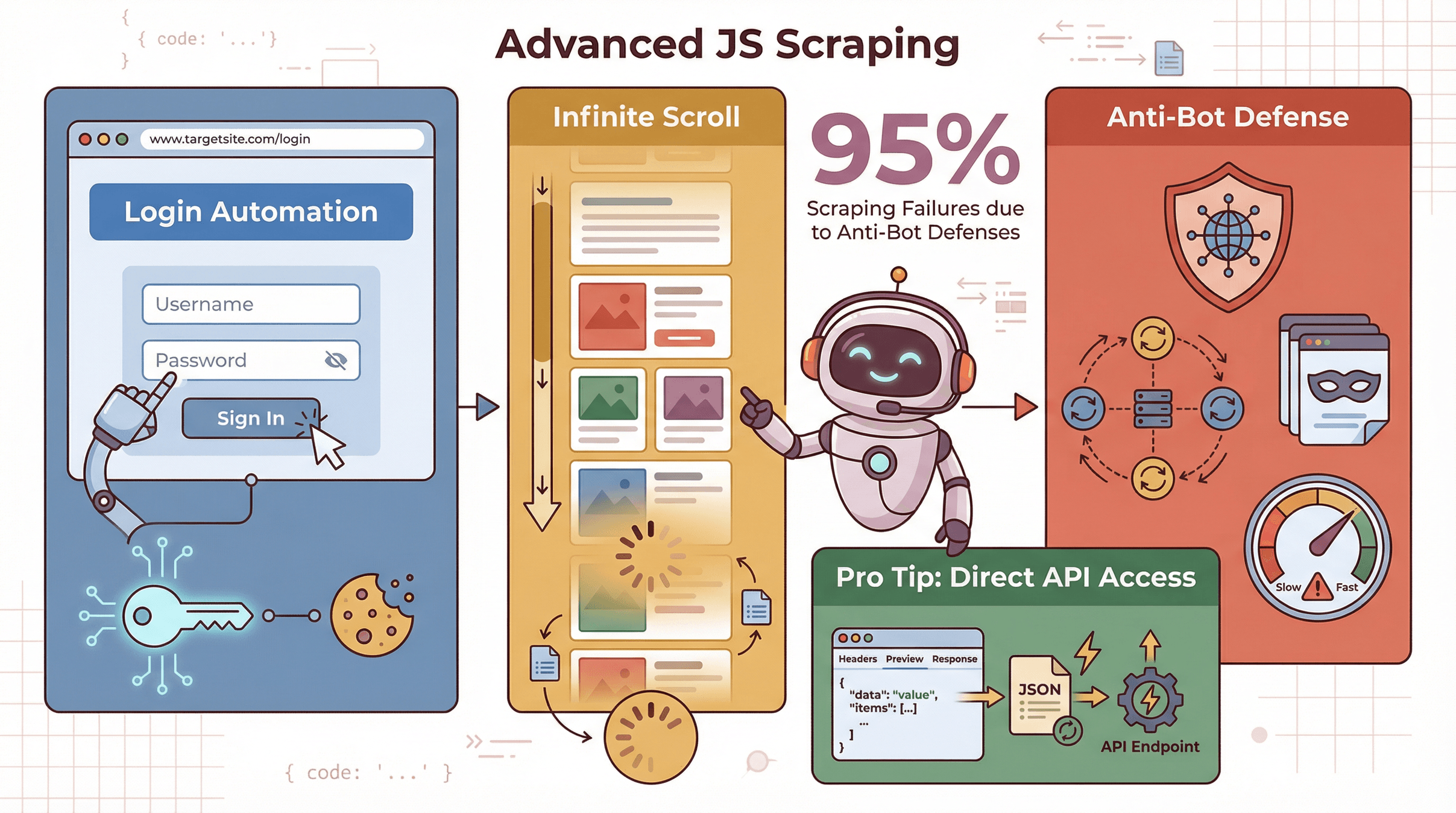

- 登入/Session: 使用 Puppeteer 時,您可以透過填表單與點按鈕自動登入,然後以已驗證使用者的身分抓取資料。

- 無限捲動: 程式化捲動頁面、等待新內容、重複執行直到所有資料載入完成()。

- 反爬措施: 使用代理伺服器、輪換 user agent,並降低請求頻率,以避免被封鎖。超過95% 的爬取失敗都與反機器人防禦有關()。

專業建議: 有時候,您甚至可以直接找到網站隱藏的 API 端點,完全不必開瀏覽器(請在 DevTools 的 Network 分頁查看)。如果能直接取得 JSON 資料,您的爬蟲速度會快非常多。

如何最佳化與維護您的 JavaScript 網頁爬蟲

打造爬蟲只是第一步,讓它穩定運作才是另一半。

- 非同步處理: 使用 async/await 並平行抓取頁面(但不要對伺服器造成過大負載)。

- 批次處理: 把資料分批處理,避免記憶體問題。

- 錯誤處理: 捕捉錯誤、重試失敗請求,並記錄問題以便除錯。

- 分頁: 偵測「下一頁」連結或按鈕,並在各頁之間迴圈切換。

- 選擇器韌性: 使用獨特的 ID 或 class;避免脆弱的選擇器,否則網站版面一改就壞掉。

- 監控: 如果您的爬蟲開始回傳空資料或錯誤,設定提醒。

最佳做法: 爬取工作從來不是「設定一次就放著不管」。請預留定期更新與監控機制()。

比較 JavaScript 爬取方案:傳統做法 vs. Thunderbit

以下是給商務使用者的快速比較:

| 做法 | 產生價值所需時間 | 所需技能 | 可處理動態內容 | 維護成本 | 匯出選項 | 擴展性 |

|---|---|---|---|---|---|---|

| 手動 JS(Cheerio) | 慢 | 寫程式 | 否 | 高 | 自己寫程式匯出 | 適合靜態網站 |

| 進階 JS(Puppeteer) | 中等 | 寫程式+ | 是 | 高 | 自己寫程式匯出 | 每頁較慢 |

| Thunderbit | 快 | 不需要 | 是(AI 驅動) | 低 | 一鍵匯出到 Sheets/CSV | 雲端或瀏覽器皆可 |

對大多數商務使用者來說,Thunderbit 是把「我需要這些資料」變成「這是我的試算表」最快的方法。

結論與重點摘要

在今天這個資料驅動的世界裡,打造 JavaScript 網頁爬蟲是一項超能力。以下是我學到的重點,也是我最推薦的做法:

- 先從簡單開始: 靜態網站用 Cheerio 和 Axios 就夠了。

- 需要時再升級: 動態、互動式或需要登入的網站,改用 Puppeteer。

- 用 AI 工具省時間: 對大多數商務需求來說, 能讓您跳過寫程式,在幾分鐘內拿到結果。

- 預先規劃維護: 網站會變,您的爬蟲也要能跟著調整。

- 永遠以倫理方式爬取: 尊重網站條款、避免伺服器過載,並負責任地使用資料。

如果您想試試看不那麼麻煩的爬取方式,歡迎先,親自看看它有多簡單。如果您想更深入了解,也可以到 看看更多指南、技巧與真實案例。

祝您爬取順利,也願您的選擇器永遠獨一無二!

常見問題

1. 什麼是 JavaScript 網頁爬蟲?

JavaScript 網頁爬蟲是用 JavaScript 撰寫的程式(或腳本),可自動從網站擷取資料。它可以在瀏覽器中執行,也可以在伺服器端(透過 Node.js)執行,特別擅長處理動態、JavaScript 密集型網站。

2. 為什麼做網頁爬取時要選 JavaScript,而不是 Python?

JavaScript 是網路的語言,因此特別適合爬取那些動態載入內容或需要使用者互動的網站。Python 很適合靜態網站與資料分析,但處理動態內容通常需要額外工具。

3. 建立 JavaScript 爬蟲需要哪些工具?

靜態網站:Node.js、Axios(或 fetch)與 Cheerio。動態網站:再加入 Puppeteer 或 Playwright 進行無頭瀏覽器自動化。如果想免寫程式爬取,您可以試試 。

4. Thunderbit 如何簡化網頁爬取?

Thunderbit 會用 AI 自動辨識並擷取任何網站的資料。只要按一下「AI 建議欄位」,再按「爬取」,然後匯出資料,就完成了——完全不需要寫程式或手動處理選擇器。

5. 網頁爬取合法且合乎倫理嗎?

只要負責任地進行,網頁爬取是合法的——只抓取公開可得的資料、尊重網站條款,並且不要讓伺服器過載。避免未經同意爬取個人資料,並且務必以合乎倫理的方式使用資料。

想看 JavaScript 爬取的實際操作嗎?可以到 Thunderbit 的 看教學,或到 探索更多內容。

延伸閱讀