有句商業圈常聽的話:「數據就是新石油。」但老實說,如果你還在用土法煉鋼、手動複製貼上網站資料,那根本就像拿小湯匙在油田裡挖油。在這個數據掛帥的時代,團隊平均每天要花 只為了找資料,而一般上班族一週下來要做超過 的重複動作。難怪大家都覺得被這些瑣碎的手動工作壓得喘不過氣。

這也是為什麼學會用 Python 來抓網站資料,對銷售、營運或研究團隊來說,真的能徹底翻轉效率。Python 的網頁爬蟲工具,能把原本超花時間的重複工作,濃縮成幾行程式碼——或者,如果你跟我一樣不想寫程式,也可以直接用 這種 AI 工具,點幾下就能搞定。不管你是數據新手還是老司機,這篇文章都會帶你了解為什麼、怎麼用 Python 做網頁爬蟲,以及 Thunderbit 怎麼讓這一切變得超簡單。

為什麼選 Python 來抓網站資料?

說到網頁爬蟲,Python 幾乎是大家的首選。它不只是熱門,更像是那種會帶零食、會揪團、還會照顧大家的好夥伴。

Python 的優勢有哪些?

- 學習門檻低、語法超直覺: Python 的語法很親民,寫個抓資料的小腳本,完全不用什麼電腦大神背景。

- 函式庫超多超強大: Python 有一堆厲害的函式庫,像 、、、,不管是解析靜態 HTML 還是自動化瀏覽器操作,通通有解。

- 社群活躍、文件齊全: 遇到問題,Stack Overflow 幾乎都能找到答案。Python 的爬蟲函式庫說明超詳細,還有一堆人分享經驗。

- 彈性高、整合容易: Python 跟其他工具搭配起來超順。你可以結合 這種 AI 平台,讓資料擷取更有效率,也能自動化、排程或進一步分析。

跟 JavaScript、R 這些語言比起來,Python 不只學起來比較輕鬆,對網頁爬蟲的支援也更完整。就像業界專家說的:「Python 就是網頁爬蟲界的瑞士刀,靈活又可靠,什麼都能搞定。」

基本流程:Python 網頁爬蟲怎麼做?

來看看 Python 網頁爬蟲的基本步驟。不管你是抓單一頁面還是整個網站,流程大致上都差不多:

| 步驟 | 執行內容 | Python 函式庫範例 |

|---|---|---|

| 1. 發送網頁請求 | 取得目標頁面的 HTML | requests.get() |

| 2. 解析 HTML | 分析網頁結構 | BeautifulSoup() |

| 3. 擷取資料 | 抓取所需資訊(如標題、價格等) | soup.find_all() |

| 4. 儲存/匯出資料 | 將結果存成 CSV、Excel 或資料庫 | csv、pandas 或 openpyxl |

看起來是不是很簡單?實際操作時,還會遇到分頁、動態內容、或網站常常改版這些麻煩。這時 Thunderbit 這類工具就超好用,直接提供「兩步抓取」和 AI 欄位自動辨識,流程變得超輕鬆。

Python 網頁爬蟲必備函式庫

Python 生態系有各種適合不同情境的爬蟲函式庫,這邊幫你快速介紹幾個主力工具:

BeautifulSoup:解析 HTML 的好幫手

是新手的好朋友,超適合解析靜態 HTML,輕鬆抓資料。

- 優點: 簡單好上手,適合小型專案。

- 限制: 不適合大量分頁或需要處理 JavaScript 的網站。

- 適用情境: 從靜態電商頁面抓商品清單。

Scrapy:大規模爬蟲框架

適合需要大量抓、多頁面爬行的進階用戶,是功能超完整的爬蟲框架。

- 優點: 速度快、可擴充,支援分頁、子頁面等複雜流程。

- 限制: 學習曲線比較高,要花點時間設定。

- 適用情境: 抓大型電商網站的所有分類和商品。

Selenium:處理動態內容與互動

適合需要模擬用戶操作(像登入、點擊)的動態網站。

- 優點: 可以自動操作瀏覽器,處理 JavaScript 動態內容。

- 限制: 執行速度比較慢,吃資源。

- 適用情境: 抓需要登入或互動式儀表板的資料。

Requests:基礎網頁請求

是發送 HTTP 請求的基礎工具,常跟 BeautifulSoup 搭配。

- 優點: 超簡單,支援 cookies 跟 session。

- 限制: 沒辦法處理 JavaScript。

- 適用情境: 下載 HTML 給 BeautifulSoup 解析。

讓流程更快:Thunderbit 結合 Python 的高效抓取

偷偷說,其實我自己也不是每次都想寫程式抓資料。這時 就是救星——它是一款 Chrome 擴充功能,讓 AI 幫你無痛抓網頁資料,完全不用寫程式。

Thunderbit 專為商務用戶設計,追求快速成果。像是 AI 欄位建議、子頁面抓取、即時匯出到 Excel 或 Google Sheets 等功能,等於把 Python 腳本和數據分析師合體。

Thunderbit 兩步抓取 vs. 傳統 Python 手動寫程式

來比較一下傳統 Python 流程和 Thunderbit 的差異:

| 任務 | Python 腳本流程 | Thunderbit 人工智慧網頁爬蟲流程 |

|---|---|---|

| 環境安裝 | 安裝 Python、pip、函式庫 | 安裝 Chrome 擴充功能 |

| 分析網頁結構 | 用瀏覽器開發者工具、寫選擇器 | 點擊「AI 欄位建議」 |

| 撰寫擷取程式 | 撰寫並除錯 Python 程式碼 | 點擊「開始抓取」 |

| 處理分頁 | 寫迴圈、管理多個網址 | UI 介面啟用「分頁抓取」 |

| 匯出資料 | 用程式寫入 CSV/Excel | 點擊「匯出到 Sheets/Excel/Notion/Airtable」 |

| 維護更新 | 網站改版需手動調整程式 | AI 自動適應網站變動 |

用 Thunderbit,幾乎所有網站都能兩步完成資料抓取——不用寫程式、不用套模板、不用煩惱維護。如果有更進階需求,也能用 Python 進一步自動化、排程或處理 Thunderbit 匯出的資料。

Thunderbit 與 Python 腳本整合應用

進階一點,你也可以用 Python 控制或排程 Thunderbit 的抓取任務。例如:

- 定時啟動 Thunderbit(像每天自動比價)

- 用 pandas 或 scikit-learn 處理、清理匯出資料

- 把 Thunderbit 抓到的資料跟其他來源整合分析或做機器學習

這種混合玩法,結合了 Thunderbit 的速度與簡單,還有 Python 的彈性和自動化能力。

實作教學:用 Python 抓網站資料

準備動手了嗎?以下是新手也能輕鬆上手的 Python 網頁爬蟲步驟:

步驟 1:建立 Python 執行環境

先確認你有安裝 Python。建議用 或 來管理環境。

1# 如果還沒安裝 pip

2python -m ensurepip --upgrade

3# 建立虛擬環境(推薦)

4python -m venv myenv

5source myenv/bin/activate # Windows 用:myenv\Scripts\activate

6# 安裝需要的函式庫

7pip install requests beautifulsoup4 pandas步驟 2:下載網頁內容

用 Requests 下載目標頁面的 HTML。

1import requests

2url = 'https://example.com/products'

3response = requests.get(url)

4if response.status_code == 200:

5 html = response.text

6else:

7 print("無法取得網頁:", response.status_code)小技巧: 如果遇到 403 或 404,檢查網站是不是擋爬蟲,或要不要加 headers/cookies。

步驟 3:解析 HTML 並擷取資料

用 BeautifulSoup 解析 HTML,抓出你要的內容。

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html, 'html.parser')

3products = soup.find_all('div', class_='product-item')

4data = []

5for product in products:

6 name = product.find('h2').get_text(strip=True)

7 price = product.find('span', class_='price').get_text(strip=True)

8 data.append({'name': name, 'price': price})提醒: 用瀏覽器的「檢查元素」功能找對 HTML 標籤和 class。

步驟 4:儲存與匯出資料

把結果匯出成 CSV,方便後續分析或分享。

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv('products.csv', index=False)如果用 Thunderbit,只要點「匯出到 Google Sheets」或「下載 CSV」就搞定,完全不用寫程式。

進階應用:自動化與規模化 Python + Thunderbit 網頁爬蟲

學會基本流程後,你可以進一步自動化、規模化抓取任務:

- 處理分頁: Python 用迴圈跑頁碼或「下一頁」連結,Thunderbit 則直接啟用分頁功能,AI 自動處理。

- 抓取子頁面: Python 需寫程式跟連結,Thunderbit 可自動深入子頁面擴充資料。

- 排程抓取: Python 可用

schedule函式庫,Thunderbit 內建排程功能,定時自動執行(像每天比價)。 - 整合多來源資料: 合併多個網站的資料,做更深入的競品分析或市場研究。

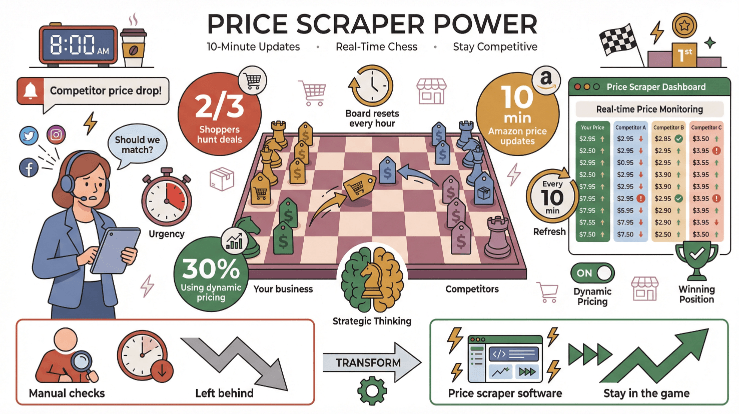

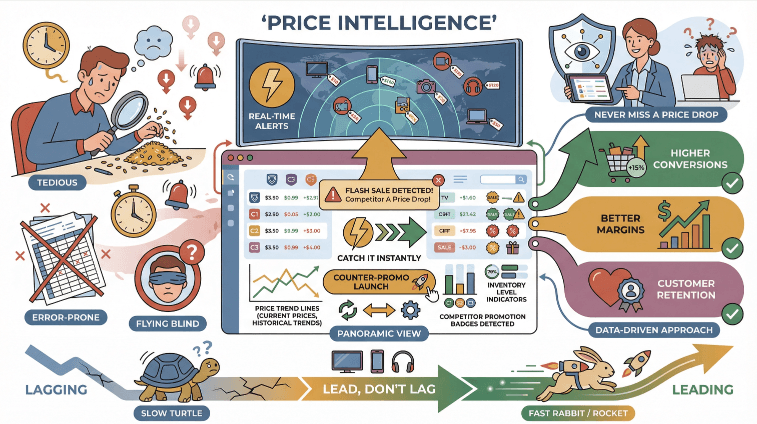

實際案例: 某電商團隊用 Thunderbit 監控 10 個競爭對手價格,每天自動抓取並匯出到 Google Sheets,分析效率提升 ,再也不用熬夜整理表格。

數據倫理與隱私:用 Python 合法合規抓取

有強大抓取能力,也要有相對的責任感。這裡幫你整理幾個合規建議:

- 遵守 robots.txt 和網站條款: 先確認網站有沒有開放爬蟲,有疑慮就主動問。

- 控制請求頻率: 不要對伺服器造成負擔,適當設置間隔。

- 避免抓個資: 沒經過同意不要抓敏感或私人資料,記得遵守 GDPR 等隱私法規。

- 標明爬蟲身份: 設定 user-agent,讓網站知道你的用途。

- 尊重刪除請求: 如果有人要求移除資料,記得及時處理。

Thunderbit 也幫用戶顧好合規,像是自動限速、支援登入後抓取、還有資料清理等功能。更多細節可以參考 。

從原始數據到洞察:用抓取資料做分析與機器學習

抓到資料只是第一步。結合 Python 跟 Thunderbit,你可以:

- 清理與格式化資料: 用 pandas 去除重複、修正錯字、統一格式。

- 趨勢分析: 追蹤競品價格、分析評論情緒、掌握市場動態。

- 建立機器學習模型: 用 scikit-learn 做情緒分析、價格預測、客群分群等。

- 自動化報表: 根據即時網路數據產生儀表板或自動通知。

範例: 某產品團隊抓了上千則用戶評論,用 Python 清理資料,再用 Thunderbit AI 標註情緒,最後得到產品優化和行銷決策的關鍵洞察。

結論與重點整理

重點回顧:

- Python 是網頁爬蟲的理想語言,簡單易學、函式庫強大、社群活躍。

- Thunderbit 讓人人都能輕鬆抓資料,AI 無程式碼工具自動辨識欄位、支援子頁面。

- 結合 Python 與 Thunderbit,實現高階自動化——可排程、處理資料、整合商業流程。

- 務必合規抓取: 尊重網站政策、隱私法規與道德規範。

- 讓原始數據變黃金: 用抓取資料做分析、報表或機器學習。

想提升數據力?不妨試試用 Python 抓網站資料,或直接體驗 。更多教學與技巧,歡迎來 逛逛。

常見問題

1. 用 Python 抓網站資料是否合法?

只要遵守網站服務條款、robots.txt 和資料隱私法規,網頁爬蟲是合法的。千萬不要未經同意抓個人或敏感資料。

2. 不會寫程式,怎麼最簡單抓網站資料?

提供無程式碼、AI 驅動的 Chrome 擴充功能,兩步就能從任何網站抓資料,完全不用寫程式。

3. 動態網站該用哪個 Python 函式庫?

遇到需要 JavaScript 或互動的網站,建議用 。靜態頁面則用 和 就很夠用。

4. 如何自動化網頁爬蟲任務?

Python 可以用 cron job 或 schedule 函式庫排程,Thunderbit 也內建定時抓取功能。

5. 網站改版怎麼辦?

傳統 Python 腳本遇到網站改版很容易失效,Thunderbit 的 AI 會自動適應,大幅減少維護麻煩。如果用 Python,得自己手動調整選擇器或解析邏輯。

祝你抓得順利,數據乾淨、結構清楚、隨時可用!

延伸閱讀