老實說,第一次嘗試從大型網站抓出每個 URL 時,我還想著:「這能有多難?」幾個小時後,我還在一頁一頁地點、把連結複製貼到試算表裡,開始懷疑自己的人生選擇。如果你也曾試著要找出網站上的所有頁面——不管是為了內容盤點、名單開發,還是競品研究——你一定懂那種痛。這件事既瑣碎、又容易出錯,說白了,就是在浪費你的時間和能力。

但好消息是:你不用再用那種最費力的方法了。像 這類 AI 驅動的工具,正在為商務使用者改寫規則,讓你能在幾分鐘內、而不是幾天內,找出某個網域下的所有 URL。事實上,採用 AI 驅動網頁爬蟲工具的公司,在資料收集工作上可節省 ,有些甚至比手動方式少花 。這不只是統計數字——而是把你人生中的好幾個小時,甚至好幾天,還給你。

所以,我們來深入看看,為什麼找出網站上的所有頁面這麼難、為什麼像 GPT 或 Claude 這類通用 AI 模型其實幫不上太多忙,以及像 Thunderbit 這種專門化 AI agent 如何讓這件事變得輕鬆。是的,我也會一步一步帶你走過如何提取你需要的每個 URL,即使你完全不會寫程式。

為什麼找出某個網域下的所有 URL 這麼困難

說穿了,網站本來就不是設計來給你一份整齊列出的所有頁面清單。它們是為訪客設計的,不是為了要讓人一次找出網站上的所有頁面。原因如下:

- 手動複製貼上大亂鬥: 一個一個點擊每個選單、清單和目錄,逐條複製 URL,這根本是腕隧道症候群的製造機(而且還會漏掉一半頁面)。

- 分頁與無限捲動: 很多網站會把內容拆成多頁,或是你往下捲時才載入更多結果。只要漏按一次「下一頁」或沒捲得夠遠,就會整段漏掉。

- 頁面結構不一致: 有些頁面的連結格式是這樣,其他頁面卻用完全不同的版型。要全部追蹤起來,簡直是惡夢。

- 隱藏頁面或孤兒頁面: 不是每個頁面都會從主導覽列連到。有些藏得很深,只能透過網站地圖或站內搜尋找到。

- 人為錯誤: 你要複製的頁面越多,就越容易出錯——重複 URL、打錯字,或乾脆漏掉某些頁面。

如果你面對的是有幾百、幾千頁的網站呢?那更別想了。手動擷取根本無法擴展。就像某個資料團隊說的,只要不是最簡單的情況,。

「找出網站上的所有頁面」到底是什麼意思?

在進入解法之前,先把我們真正要找的是什麼講清楚。

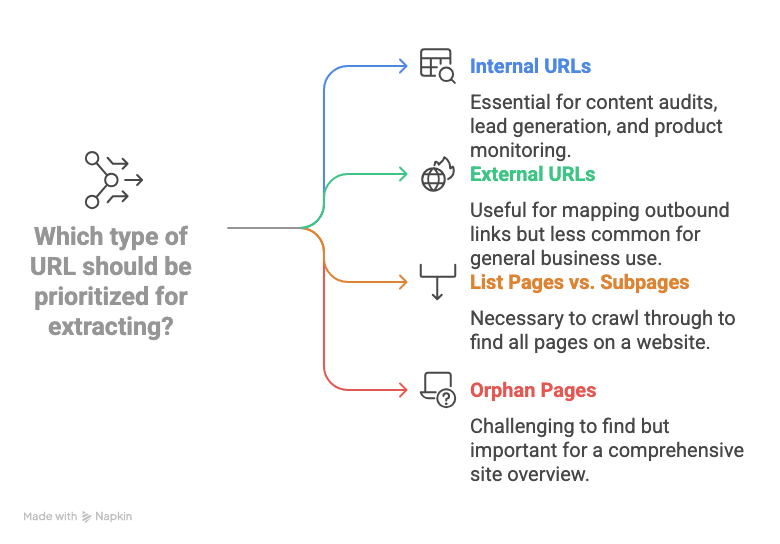

- 站內 URL: 指的是連到同一網域內頁面的連結(例如 /about-us 或 /products/widget-123)。對大多數商務用途——像內容盤點、名單開發、產品監控——站內 URL 才是主要目標。

- 站外 URL: 指向其他網站的連結。通常只有在你要整理外部連結時才需要。

- 列表頁 vs. 子頁: 很多網站都有「樞紐頁」或「列表頁」(像分類頁、部落格彙整頁、目錄頁),這些頁面會連到更詳細的頁面(例如產品頁或個人檔案頁)。如果你真的要找出網站上的所有頁面,就得一路爬過這些列表,抓出它們連到的每個子頁。

- 孤兒頁: 這些頁面沒有從明顯的地方連過去。有時可以透過網站地圖或站內搜尋找到,但很容易被漏掉。

所以,當我們說要找出某個網域下的所有 URL,意思就是:把每個站內頁面的 URL 都抓出來,從首頁一路到最深層的產品頁或文章頁,最好還能整理成可直接使用的格式(例如試算表)。

找出某個網域下所有 URL 的傳統方法

老派做法有幾種,但每一種都有自己的麻煩:

手動複製貼上與瀏覽器工具

這就是「蠻力」做法:把每個連結都點過一遍、複製每個 URL、貼到試算表裡,然後祈禱自己沒漏掉任何東西。有些人會用瀏覽器擴充功能抓取目前頁面的所有連結,但你還是得對每個頁面重複一次,而且分頁或隱藏區塊還是得自己處理。五頁的網站還行,規模一大就不行了。

使用站內搜尋與網站地圖

- Google 的 site: 搜尋: 在 Google 輸入 site:yourdomain.com,就會看到一堆已索引頁面。但 Google 只會顯示它已收錄的內容(通常上限大約 1,000 筆),所以你會漏掉新頁面、隱藏頁面或品質較低的頁面。也承認,這不是完整解法。

- XML 網站地圖: 很多網站都有 /sitemap.xml,會列出重要 URL。很好——前提是網站地圖有更新,而且包含所有頁面。但不是每個網站都有,有些還會拆成多個檔案。孤兒頁通常也不會被收進去。

技術型爬蟲與腳本

- SEO 工具(像 Screaming Frog): 這些工具會像搜尋引擎一樣爬網站,然後列出一串 URL。很強大,但需要設定、配置,有時候大站還得付費授權。

- Python 腳本(像 Scrapy): 開發者可以寫腳本來爬取並提取 URL。但老實說,如果你不熟程式,這基本上就不用想了。再加上網站版型一改,腳本就容易壞,你永遠都在追著修。

結論: 對多數商務使用者來說,傳統方法不是太手動、就是不完整、要不就是太技術門檻高。難怪這麼多人做到一半就放棄。

為什麼通用 AI 模型無法完整自動化 URL 提取

你可能會想:「那我直接叫 ChatGPT 或 Claude 幫我找出網站上所有頁面不就好了?」要是這麼簡單就好了。現實是:

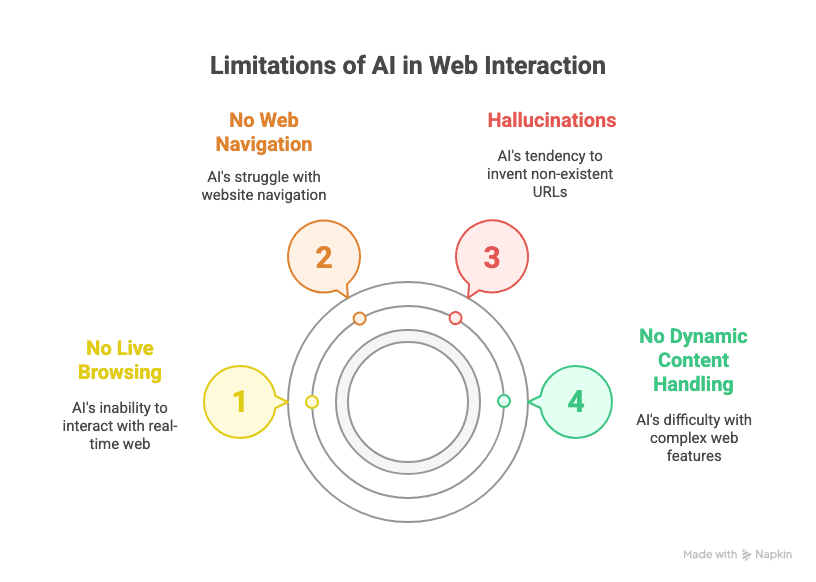

- 無法即時瀏覽: 像 GPT 或 Claude 這類通用 AI 模型,實際上不能即時瀏覽網頁。它們看不到網站當下的狀態,只能依賴訓練資料,或你貼給它們的內容。

- 不會網頁導航: 就算開啟外掛或瀏覽功能,LLM 也不知道怎麼點「下一頁」、處理無限捲動,或系統性地追蹤網站上的每個連結。

- 幻覺: 你叫通用 AI 列出某個網域的所有 URL,它常常會編出一些看起來合理、但實際不存在的連結。(我看過它替根本沒有 /about-us 頁面的網站硬生生生出這種頁面。)

- 無法處理動態內容: 需要 JavaScript 載入內容、登入才能看,或導覽結構很複雜的網站,對一般 LLM 來說幾乎是碰不到的。

就像 說的:「如果你想抓取數百或數千個頁面……單靠 ChatGPT 是不夠的。」你需要的是專門為這件事打造的工具。

垂直型 AI Agent 才是未來(這為什麼重要)

這裡就輪到我在 SaaS 和自動化領域的經驗登場了:垂直型 AI agent——也就是專為特定領域打造的 AI 工具,例如網頁資料提取——才是商務工作能穩定、可擴展完成的唯一方式。為什麼?

- 通用型 LLM 很適合寫作或搜尋,但它們容易出現「幻覺」,也無法處理企業所需要的多步驟、可重複工作流程,而且穩定性不足。

- 企業級 SaaS 工具需要自動化大量重複、結構化的任務。 這正是垂直型 AI agent 的強項——它們就是為了做好一件事而生,而且錯誤率低。

- 各行各業都有例子: 用於網頁資料提取的 Thunderbit、用於軟體開發的 Devin AI、用於銷售自動化的 Alta、教育領域的 Infinity Learn IL VISTA、HR 領域的 Rippling、法律領域的 Harvey……還有很多。

簡單說:如果你想可靠地找出網站上的所有頁面,你需要的是專門為這項工作打造的垂直型 AI agent,而不是通用聊天機器人。

認識 Thunderbit:人人都能用的 AI 驅動 URL 提取工具

這時候就輪到 上場了。作為一款 AI 網頁爬蟲 Chrome 擴充功能,Thunderbit 是為商務使用者設計的——不用寫程式、不需要技術設定,只要結果。它特別之處在於:

- 自然語言介面: 只要描述你要什麼(「列出這個網站上的所有頁面 URL」),Thunderbit 的 AI 就會判斷該怎麼提取。

- AI 建議欄位: Thunderbit 會掃描頁面,自動建議欄位名稱(像「頁面 URL」)——不用再折騰 CSS selector 或 XPath。

- 處理分頁與無限捲動: Thunderbit 可以自動點「下一頁」或往下捲動,讓你不會漏掉任何頁面。

- 子頁導覽: 需要往更深層找嗎?Thunderbit 也可以追蹤連結進子頁,從那裡擷取資料。

- 結構化匯出: 你可以把結果一鍵免費匯出到 Google Sheets、Excel、Notion、Airtable 或 CSV。

- 不需要寫程式: 只要你會瀏覽網站,就會用 Thunderbit。就是這麼簡單。

而且因為 Thunderbit 是垂直型 AI agent,它在穩定性與可重複性上都有設計過,非常適合需要一再自動化同樣任務的商務使用者。

逐步教學:如何用 Thunderbit 找出某個網域下的所有 URL

準備好看看怎麼運作了嗎?下面是一個不需要技術背景的操作流程,教你提取所需的每個 URL。

1. 安裝 Thunderbit Chrome 擴充功能

第一步:。它支援 Chrome、Edge、Brave 和其他 Chromium 瀏覽器。安裝後把它釘選到工具列,方便快速使用。

2. 打開你的目標列表或目錄頁

前往你想要提取 URL 的網站。可以是首頁、網站地圖、目錄頁,或任何會連到你關注頁面的列表頁。

3. 啟動 Thunderbit 並設定欄位

點擊 Thunderbit 圖示打開擴充功能,建立一個新的爬蟲範本。接下來就是魔法發生的地方:

- 點選 「AI 建議欄位」。Thunderbit 的 AI 會掃描頁面並建議欄位——找看看有沒有標示為「頁面 URL」、「連結」或類似名稱的欄位。

- 如果你沒看到完全符合的欄位,只要新增一個名為「頁面 URL」的欄位(或任何你覺得合理的名稱)即可。Thunderbit 的 AI 訓練過能辨識這些詞彙,並把它們對應到正確資料。

4. 啟用分頁或捲動功能(如果需要)

如果你的目標頁面有多頁內容(例如「第 1、2、3 頁…」或「載入更多」按鈕),就在 Thunderbit 裡啟用分頁:

- 若網站有「下一頁」按鈕,切換到 「點擊分頁」 模式;若網站會在你捲動時自動載入更多內容,則選 「無限捲動」。

- Thunderbit 會提示你選取「下一頁」按鈕或捲動區域——你只要點一下,它會幫你處理剩下的事。

5. 開始爬取並檢查結果

按下 「爬取」 按鈕。Thunderbit 會自動爬過所有頁面,把找到的每個 URL 都收集起來。結果會直接以表格形式顯示在擴充功能裡。對大網站來說,這可能需要幾分鐘,但還是比手動處理快太多了。

6. 匯出你的 URL 清單

爬取完成後,點擊 匯出。你可以直接把資料送到:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

匯出是免費的,而且會保留所有格式。不用再為複製貼上頭痛了。

Thunderbit 與其他 URL 提取方案比較

| 方法 | 使用難易度 | 準確度與涵蓋率 | 可擴展性 | 匯出選項 |

|---|---|---|---|---|

| 手動複製貼上 | 很痛苦 | 低(很容易漏) | 沒有 | 手動(Excel 等) |

| 瀏覽器連結提取器 | 單頁還行 | 中等 | 很差 | 手動 |

Google site: 搜尋 | 簡單 | 中等(不完整) | 上限約 1,000 筆 | 手動 |

| XML 網站地圖 | 簡單(如果有的話) | 不錯(如果有更新) | 不錯 | 手動/腳本 |

| SEO 工具(Screaming Frog) | 需要技術 | 高 | 高(付費) | CSV、Excel |

| Python 腳本(Scrapy 等) | 非常需要技術 | 高 | 高 | 自訂 |

| Thunderbit | 非常簡單 | 非常高 | 高 | Google Sheets、CSV 等 |

Thunderbit 兼具專業爬蟲的準確度與規模,以及瀏覽器擴充功能的易用性。不用寫程式、不用設定,直接拿結果。

加碼:用 Thunderbit 擷取的不只 URL

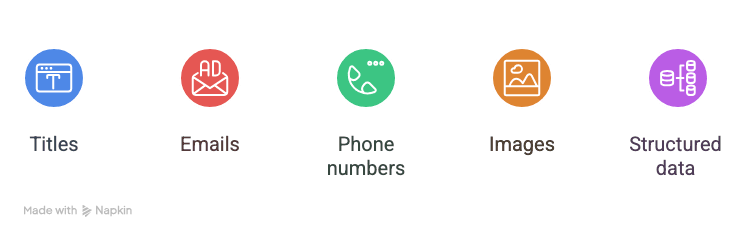

接下來才是更有趣的部分。Thunderbit 不只可以抓 URL,你還能提取:

- 標題

- 電子郵件

- 電話號碼

- 圖片

- 頁面上的任何結構化資料

例如,如果你在建立潛在客戶名單,Thunderbit 可以一次抓下每個目錄項目的個人檔案 URL、姓名、電子郵件和電話號碼。若你在盤點產品,也可以抓取產品 URL、名稱、價格和庫存狀態。Thunderbit 甚至支援 ,所以它可以點進每個連結,再從裡面提取詳細資訊。

而且沒錯,Thunderbit 的電子郵件和電話提取器完全免費。這對銷售與行銷團隊來說非常有幫助。

重點整理:如何用 AI 找出網站上的所有頁面

我們來總結一下:

- 手動或通用工具要抓出某個網域下的所有 URL 很困難。

- 像 GPT 這類通用 AI 模型無法處理網頁導覽、分頁或動態內容。

- 像 Thunderbit 這類垂直型 AI agent 是為網頁資料提取而生——穩定、可重複,而且商務使用者上手很容易。

- Thunderbit 讓流程變得很簡單:安裝擴充功能、用 AI 建議欄位、啟用分頁、爬取、匯出。免程式碼、免折騰。

- 你提取的不只 URL: 標題、電子郵件、電話號碼など——非常適合名單開發、盤點或研究。

如果你已經厭倦了複製貼上連結,或是跟技術型爬蟲纏鬥,。它有免費方案,你可以親自看看能幫你省下多少時間(以及多少精神)。

如果你也想了解 Thunderbit 還能怎麼幫你——像是 、、或 ——可以到 看更多指南與技巧。

準備好把自己從手動蒐集資料中解放出來了嗎? 網頁資料提取的未來就是垂直型 AI agent——而 Thunderbit 正在領先這股潮流。試試看,讓你下一次的盤點、名單開發或研究專案,成為目前最輕鬆的一次。

延伸閱讀

P.S. 如果你哪天又想手動複製貼上 1,000 個 URL,請記得:現在已經有 AI 可以幫你做這件事了。你的手腕(還有你的老闆)都會感謝你。