網路世界的發展速度,真的快到讓人傻眼——我早上喝咖啡的手速都追不上它,而且我可不是慢郎中。來到 2026 年,網頁資料擷取早就不再是技術宅的專利,而是銷售開發、電商價格監控、市場調查,甚至房地產分析的必備神器。根據,選對網頁爬蟲函式庫或工具,真的能讓你從手動整理的地獄解脫,輕鬆獲得滿滿洞察,還能在競爭對手還在吃午餐時就把事情搞定!

有趣的是,2026 年的網頁爬蟲函式庫選擇超級多元,從零程式碼的 AI Chrome 擴充,到專業開發者愛用的框架通通有。不管你是只想把名單丟進 Excel 的業務、要追蹤 500 個商品的營運主管,還是想打造自訂爬蟲的 Python 達人,都能找到最適合你的工具。身為 SaaS 跟自動化圈的老屁股(也熬過不少夜),我幫大家整理出今年最值得認識的十大網頁爬蟲函式庫,還會教你怎麼挑到最能幫你省時省力的那一款。

2026 年強大網頁爬蟲函式庫的關鍵特點

在進入排行榜之前,先來聊聊選網頁爬蟲函式庫時,哪些特點最重要。以我的經驗,2026 年最受歡迎的工具通常有這幾個重點:

- 易用性: 非工程師能不能幾分鐘就上手?還是得精通 Python 才能搞定?

- 動態內容處理: 能不能抓現代、JavaScript 為主的網站?還是遇到動態頁面就 GG?

- 語言與平台支援: 有沒有支援你熟悉的語言(像 Python、JavaScript、Java),甚至能不能直接在瀏覽器操作?

- 可擴展性: 能不能輕鬆處理數百、數千頁資料?

- 整合與匯出: 能不能直接對接 Excel、Google Sheets、Notion 或你的資料流程?

- AI 與自動化: 2026 年,能用自然語言下指令、完全不用寫程式的 AI 工具超夯,特別適合不想碰程式碼的商務用戶。

現實就是,商務團隊最在意速度、準確度,還有極簡設定。你花在修爬蟲、寫程式的時間越少,行動就越快。隨著 AI 跟瀏覽器自動化普及,現在連沒技術底的人也能輕鬆抓到以前只有工程師才搞得定的資料(參考 )。

重點來了,直接進入主題。

2026 年十大強大網頁爬蟲函式庫推薦

- :瀏覽器內零程式碼、AI 驅動的網頁爬蟲

- :Python 環境下超好用的 HTML 解析與資料清理

- :大規模、高速爬取與資料管道的專業框架

- :瀏覽器自動化,專門對付動態、JavaScript 網站

- :Python 下超快的 XML/HTML 解析

- :Python 版 jQuery 選擇器,快速選 HTML 元素

- :Python 一站式 HTTP、HTML 解析與 JS 渲染

- :Python 自動化表單與簡易瀏覽器操作

- :Node.js 控制無頭 Chrome,專攻互動性強的網站

- :Java 環境下超強的 HTML 解析工具

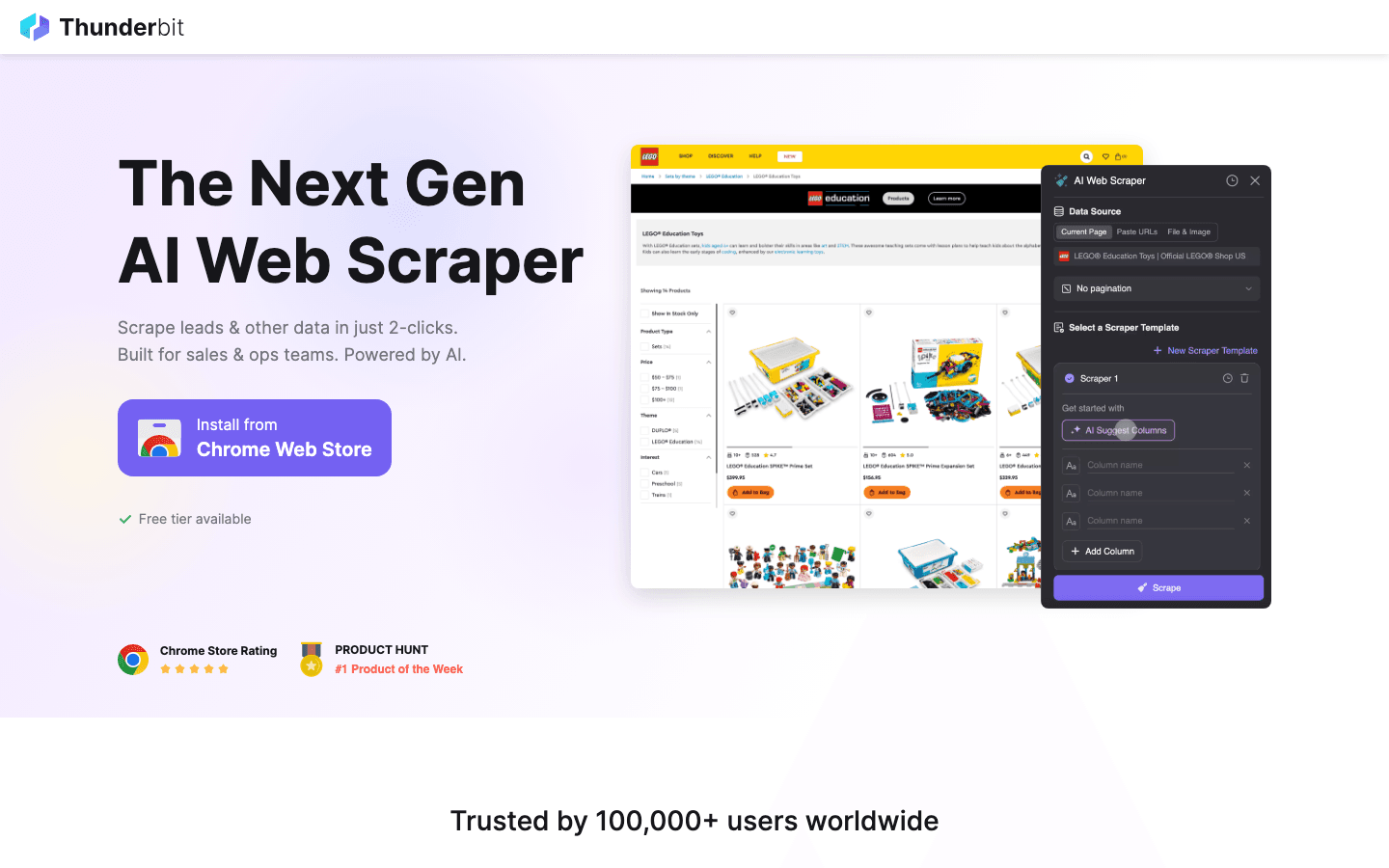

1. Thunderbit

是我最推薦給想「完全不用寫程式就能抓資料」的朋友。這款只要用自然語言描述需求(像「抓下這頁所有商品名稱、價格和圖片」),AI 就會自動判斷欄位並完成設定。完全不用模板、不用繁瑣步驟,只要點「AI 建議欄位」,微調一下就能「開始抓取」。

Thunderbit 2026 年亮點:

- 零程式碼、自然語言介面: 不管你是業務、營運、行銷還是房仲都能輕鬆上手,完全不用懂 Python。

- AI 建議欄位: AI 會自動分析頁面,推薦最適合擷取的欄位。

- 子頁面抓取: 需要更細的資料?Thunderbit 可自動進入每個子頁(像商品或個人頁),自動補齊表格內容(參考 )。

- 熱門網站一鍵模板: Amazon、Zillow、Shopify 等主流網站,直接一鍵抓取。

- 支援 Excel、Google Sheets、Notion、Airtable 匯出: 資料直接送到團隊常用平台。

- 支援 34 種語言: 全球團隊都適用。

- 雲端或瀏覽器模式: 公開網站用雲端超快,需登入的頁面用瀏覽器模式。

Thunderbit 已經有全球超過三萬用戶信賴,免費方案可抓 6 頁(試用加碼可到 10 頁)。想體驗現代網頁爬蟲的威力,從這裡開始最適合。

2. Beautiful Soup

是 Python 資料科學家和分析師的經典愛用函式庫,專門解析雜亂無章的 HTML。如果你遇過標籤亂七八糟、格式奇怪的網頁,Beautiful Soup 絕對是你的救星。

Beautiful Soup 優勢:

- 處理不規則 HTML: 特別適合清理、擷取「醜」網頁的資料(參考 )。

- 學習門檻低: Python 新手也能快速上手。

- 彈性高: 可與 Requests 等 HTTP 函式庫搭配,結合 lxml 提升速度。

- 常見應用: 快速資料擷取、網頁資料清理、小型自動化腳本。

如果你主要處理靜態頁面或需要整理雜亂標記,Beautiful Soup 是穩健的選擇。

3. Scrapy

是 Python 世界的重量級網頁爬蟲框架,適合需要大規模爬取、串接資料管道的專業需求。如果你要抓數千頁、跟連結、批次處理資料,Scrapy 絕對是首選。

Scrapy 強項:

- 高度模組化: 可自訂複雜的爬蟲、資料管道與中介軟體(參考 )。

- 適合大型專案: 市場調查、競品分析或多站點資料擷取都很適合。

- 非同步高效能: 速度快、效率高。

- 社群資源豐富: 有大量外掛、教學與支援。

Scrapy 學習曲線比較高,但面對大型專案時威力十足。

4. Selenium

是瀏覽器自動化的首選工具,廣泛用於網頁測試,也能抓取需要登入、點擊、處理彈窗的網站。遇到 JavaScript 為主、互動性高的頁面,Selenium 能模擬真實用戶操作(參考 )。

Selenium 優點:

- 自動化真實瀏覽器: 支援 Chrome、Firefox、Safari、Edge 等主流瀏覽器。

- 處理登入、彈窗與用戶操作: 適合需要驗證或多步驟流程的網站。

- 多語言支援: Python、Java、C# 等。

- 最適合: 對抗封鎖簡單爬蟲的網站,或需模擬真實用戶行為時。

雖然比 HTTP 類函式庫重,但有時候就是需要「真」瀏覽器。

5. lxml

是 Python 下效能超高的 XML/HTML 解析器。如果你追求速度(像要處理成千上萬的大型文件),lxml 幾乎沒對手(參考 )。

lxml 特色:

- 極速解析: 對大型檔案表現超好,效能領先多數 Python 解析器。

- 穩定可靠: 同時支援 XML 與 HTML,能與其他工具整合。

- 適合: 處理大數據集,與 Beautiful Soup 或 Scrapy 搭配更強大。

大規模爬取或需處理巨量檔案時,lxml 是必備利器。

6. PyQuery

把 jQuery 的選擇器語法帶進 Python。如果你習慣用 jQuery 的 $('.class') 選元素,PyQuery 讓你在 Python 腳本裡也能輕鬆做到(參考 )。

PyQuery 亮點:

- jQuery 風格選擇器: 前端開發者用起來超直覺。

- 簡潔易讀的程式碼: 複雜選取也能簡單實現。

- 與 lxml 整合: 底層效能佳。

- 適合: 想用 jQuery 方式快速處理 HTML 的 Python 專案。

是從網頁開發轉向資料擷取的好橋樑。

7. Requests-HTML

是結合 Requests(HTTP)與內建 HTML 解析、甚至支援 JavaScript 渲染的 Python 函式庫。

Requests-HTML 優勢:

- 一站式解決: 抓頁面、解析 HTML、渲染 JS 一次搞定。

- 新手友善: 適合小型或中型爬蟲專案。

- 適合: 快速腳本、含部分動態內容的網站、追求簡單的用戶。

剛入門或需要靈活工具的小型專案,Requests-HTML 很適合。

8. MechanicalSoup

是專為自動化表單與簡易瀏覽器互動設計的 Python 函式庫。它基於 Beautiful Soup 跟 Requests,讓你輕鬆登入、填表、執行基本流程(參考 )。

MechanicalSoup 好處:

- 自動化表單與登入: 適合抓取需驗證的資料。

- 簡單 API: 新手也能快速上手。

- 適合: 重複性瀏覽器任務、簡單流程、不需完整瀏覽器自動化時。

雖然不如 Selenium 強大,但對基本需求來說輕巧又好用。

9. Puppeteer

是 Node.js 控制無頭 Chrome/Chromium 的利器,特別適合抓 JavaScript 為主、互動性高的網站(參考 )。

Puppeteer 強項:

- 完整瀏覽器自動化: 點擊、捲動、填表單、互動都難不倒。

- 處理動態內容: 專攻 JS 動態載入的網站。

- 適合: 電商、社群媒體或傳統爬蟲無法應付的網站。

JavaScript 開發者或需要抓「現代網頁」時,Puppeteer 必不可少。

10. Jsoup

是 Java 世界的 HTML 解析標竿,堪稱 Java 版的 Beautiful Soup(參考 )。

Java 團隊愛用 Jsoup 的原因:

- 簡單強大的 API: 幾行程式碼就能擷取、處理資料。

- 處理雜亂 HTML: 連格式不佳的頁面也能輕鬆解析。

- 適合: Java 應用程式或後端流程整合爬蟲需求。

如果你的技術棧是 Java,Jsoup 絕對是首選。

網頁爬蟲函式庫比較表

以下是這 10 款函式庫的快速對照:

| 函式庫 | 語言 | 易用性 | 動態內容支援 | AI/零程式碼 | 典型應用情境 | 最適合對象 |

|---|---|---|---|---|---|---|

| Thunderbit | Chrome 擴充 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | 是 | 銷售、營運、研究、房地產 | 非工程師、商務用戶 |

| Beautiful Soup | Python | ⭐⭐⭐⭐ | ⭐ | 否 | HTML 解析、資料清理 | Python 新手、分析師 |

| Scrapy | Python | ⭐⭐⭐ | ⭐⭐ | 否 | 大規模爬取、資料管道 | 開發者、大數據專案 |

| Selenium | 多語言 | ⭐⭐ | ⭐⭐⭐⭐⭐ | 否 | 瀏覽器自動化、登入 | 測試、動態網站爬取 |

| lxml | Python | ⭐⭐⭐ | ⭐ | 否 | 快速解析、大型檔案 | 進階用戶、大型資料集 |

| PyQuery | Python | ⭐⭐⭐⭐ | ⭐ | 否 | jQuery 風格選取 | 前端開發、簡潔腳本 |

| Requests-HTML | Python | ⭐⭐⭐⭐ | ⭐⭐ | 否 | 快速腳本、JS 渲染 | 新手、小型專案 |

| MechanicalSoup | Python | ⭐⭐⭐⭐ | ⭐⭐ | 否 | 表單自動化、登入 | 簡單瀏覽器任務 |

| Puppeteer | Node.js | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | 否 | JS 動態網站、自動化 | JS 開發者、動態網頁爬取 |

| Jsoup | Java | ⭐⭐⭐⭐ | ⭐ | 否 | Java 環境 HTML 解析 | Java 團隊、後端流程 |

如何為你的企業選擇合適的網頁爬蟲函式庫

那到底該怎麼選?根據多年實戰經驗和無數次深夜除錯,我的建議如下:

- 非工程師或商務用戶: 直接選 Thunderbit。AI/零程式碼設計,幾分鐘就能出成果。只想把資料匯出 Excel 或 Sheets,千萬別自找麻煩。

- Python 開發者: 小型專案選 Beautiful Soup、Requests-HTML,大型專案選 Scrapy,搭配 lxml 或 PyQuery 更強大。

- 需要處理登入或動態內容? Selenium(多語言)或 Puppeteer(Node.js)最合適。

- Java 團隊: Jsoup 是整合爬蟲到 Java 應用的首選。

- 需要自動化表單或簡單流程? MechanicalSoup 輕巧易用。

選擇時的關鍵考量:

- 技術能力: Thunderbit 這類零程式碼工具最適合非技術團隊。開發者則可選擇程式庫彈性更高。

- 資料複雜度: 靜態頁面選 Beautiful Soup 或 Jsoup,動態 JS 網站選 Selenium 或 Puppeteer。

- 規模需求: Scrapy、lxml 適合大規模、高速任務。

- 整合性: Thunderbit 可直接匯出 Sheets、Notion、Airtable,商務流程省時又方便。

想了解更多選擇建議,可以參考 。

結語:用對工具,解鎖網路資料新價值

2026 年的網頁爬蟲早就不是工程師或資料科學家的專利。隨著 AI 跟零程式碼工具普及,無論是銷售、研究還是營運團隊,都能輕鬆挖掘網路資料寶藏。選對網頁爬蟲函式庫,不只每年幫你省下數百小時(參考 ),還能提升準確度,讓企業競爭力大大升級。

我的建議?先釐清你的需求——速度、規模、技術熟悉度——多試幾種工具。Thunderbit 免費方案很適合新手入門,想深入研究也有 Beautiful Soup、Scrapy 等開源函式庫可以玩。

想學更多?歡迎逛逛 找更多教學,或訂閱我們的 看實戰影片。

祝你抓資料順利,資料永遠乾淨、結構化、隨時可用!

常見問題

1. 2026 年對非工程師來說最簡單的網頁爬蟲函式庫是什麼?

是非工程師的首選。它的 AI Chrome 擴充讓用戶能用自然語言指令抓取資料,完全不需寫程式。

2. 哪個函式庫最適合抓取 JavaScript 為主或動態網站?

(Node.js)與 (多語言)最適合抓取動態、JS 渲染的網站。它們能自動化真實瀏覽器,處理複雜互動。

3. Beautiful Soup 與 Scrapy 有什麼不同?

適合解析單一頁面或小型專案,特別是雜亂 HTML。 則是建構大規模爬蟲與處理大量資料的完整框架。

4. 可以直接把抓到的資料匯出到 Google Sheets 或 Notion 嗎?

可以—— 支援直接匯出到 Google Sheets、Notion、Airtable 與 Excel。大多數程式庫則需自行撰寫匯出邏輯。

5. 如何為我的企業選擇合適的網頁爬蟲函式庫?

請考量你的技術能力、目標網站的複雜度、資料量與整合需求。像 Thunderbit 這類零程式碼工具最適合商務團隊,開發者則可選擇 Scrapy、Beautiful Soup 或 Puppeteer 等程式庫以獲得更高彈性。

延伸閱讀