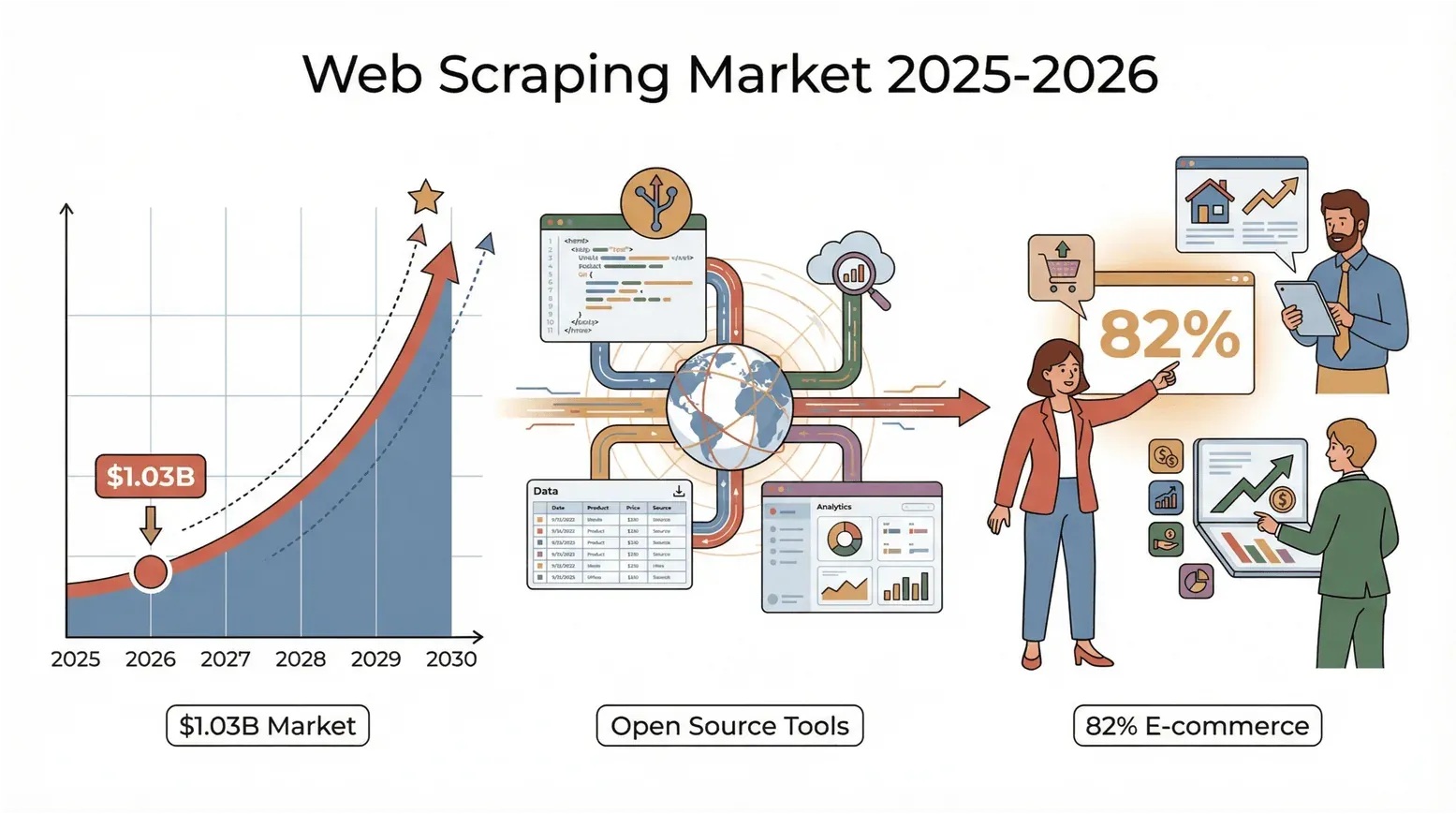

網路上的資料多到滿出來,而到了 2026 年,把這些雜訊轉成洞察的競爭,比以往任何時候都更激烈。無論您從事銷售、電子商務、不動產,還是只是像我一樣熱愛資料的數據控,您大概早就發現,過去那套「複製貼上」的做法已經不夠用了。這裡有個驚人的數字:根據 Mordor Intelligence(並被 引用),全球網頁爬蟲市場在 2025 年達到 ,並預計到 2030 年幾乎翻倍。

而且這不只是科技巨頭的事——82% 的電子商務公司以及超過三分之一的投資機構都在抓取網頁,用於開發潛在客戶、定價與市場研究()。結論很簡單:如果您還沒使用網頁爬蟲工具,您可能正把金錢與洞察留在桌上。

但好消息是:開源網頁爬蟲工具比以往更強大、更容易取得,也更由社群驅動。無論您是 Python 高手、JavaScript 狂熱者,還是只想輕鬆拿到資料的商務使用者,總有一款工具適合您。我在 SaaS 與自動化領域耕耘多年,也一路看著這個生態系演進。所以,讓我們一起深入了解您在 2026 年應該關注的 5 款最佳開源網頁爬蟲工具,以及如何挑選最符合您需求的那一款。

為什麼要選擇開源網頁爬蟲工具?

開源網頁爬蟲工具就像資料世界裡的瑞士刀。它們成本效益高(沒有授權費)、彈性強(幾乎都能客製化),而且透明(您可以清楚看見它如何運作)。但真正厲害的地方在於社群。開源工具背後有成千上萬的開發者與使用者分享外掛、教學和修補方式,讓您不必獨自摸索()。

和商業工具相比,開源方案讓您真正掌握主導權。您不會被供應商的產品藍圖或定價綁住,網站一有變動,也能自行調整爬蟲。此外,許多商業爬蟲服務其實就是建立在這些開源引擎之上——那為什麼不直接從源頭開始?

我們如何挑選最佳開源網頁爬蟲工具

面對這麼多選項,我主要依據以下幾個關鍵標準:

- 易用性: 非工程師能否快速上手?有沒有視覺化或 AI 驅動的選項?

- 可擴展性: 這個工具能處理大型專案,還是只適合一次性任務?

- 語言與平台支援: Python、JavaScript、瀏覽器、桌面端——是否能涵蓋不同技術棧?

- 社群與維護: 是否持續更新?有沒有論壇、文件與外掛?

- 獨特功能: AI 欄位偵測、子頁面抓取、排程、雲端支援等等。

我也把真實世界的回饋與商務使用場景納入考量——因為最好的工具,永遠是那個真的能解決您問題的工具。

值得探索的 5 大最佳開源網頁爬蟲工具

接下來進入重點。以下是我精選的名單,從 AI 驅動的簡單工具到開發者級的強大框架都有。

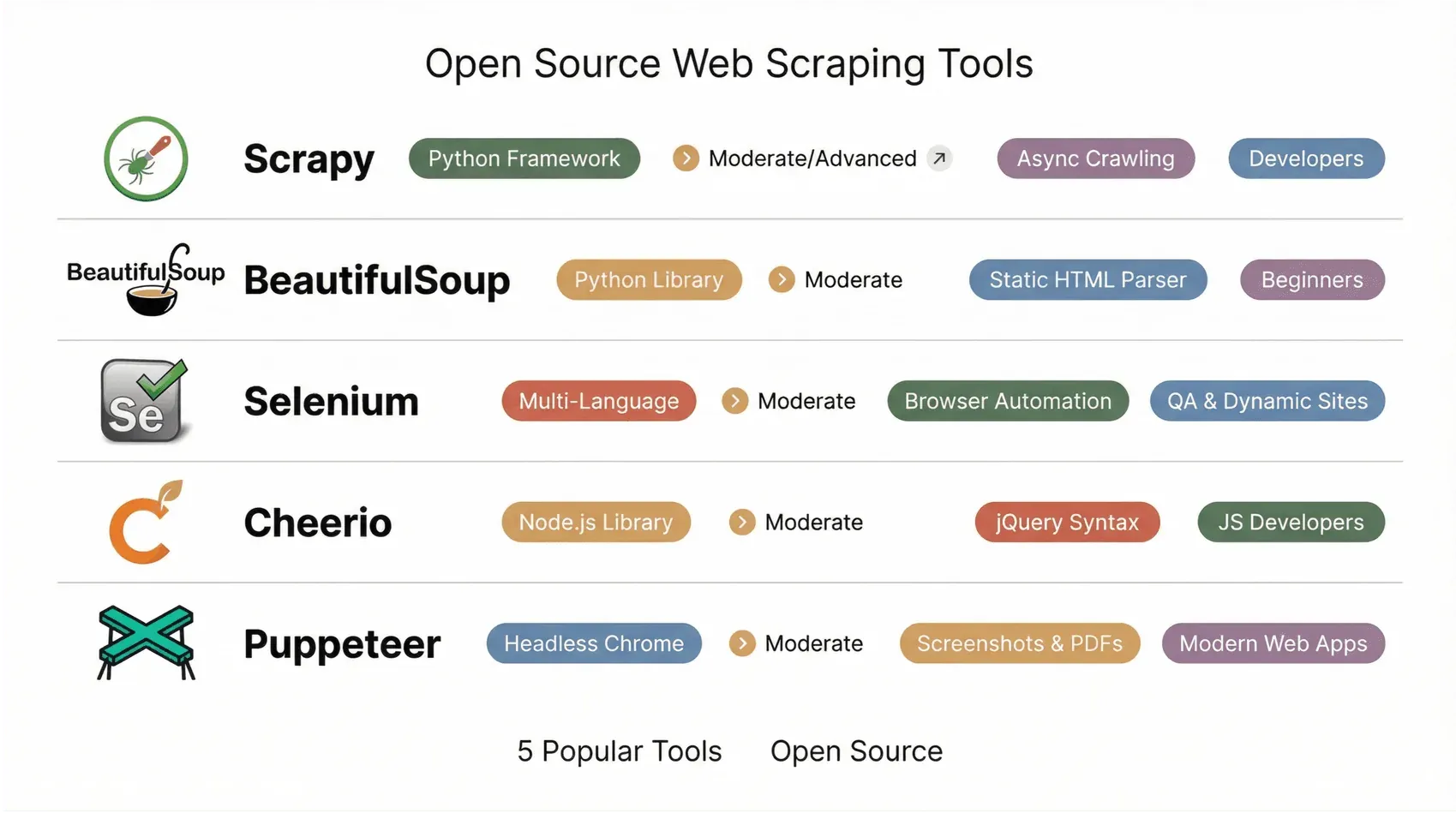

1. Scrapy

是 Python 開發者的夢幻工具。它是一個經得起實戰考驗的框架,可用來打造可擴展、可客製化的爬蟲與資料管線。您只要用 Python 定義「spiders」,Scrapy 就會負責排隊、節流,並將結果輸出成 JSON、CSV 或 XML。隨著 2.14 版(2025 年 10 月)與 2.14.1 修補版(2026 年 1 月)發布,Scrapy 大量的 Twisted-Deferred 內部架構已改寫為原生 asyncio 協程,並加入新的 AsyncCrawlerProcess 入口,能更順暢地融入現代 Python 非同步生態系;而 asyncio reactor 也已成為新建專案的預設值。提醒一下:Scrapy 2.14 以上需要 Python 3.10 或更新版本。

它的外掛生態系非常龐大,涵蓋代理、Cookie,甚至可將無頭瀏覽器整合進來處理動態網站。對於抓取整個電商目錄或大規模彙整新聞的團隊來說,Scrapy 往往是首選。對非工程師而言,它的學習曲線偏陡,但如果您要的是強大與彈性,Scrapy 絕對能交出成績()。

2. Beautiful Soup

是經典的 Python 函式庫,適合快速又直接地解析 HTML。它因為學習曲線平緩、解析器也很寬容而深受新手與專業人士喜愛(即使是最凌亂的 HTML 也能處理)。您先抓取頁面(通常搭配 requests),再載入 Beautiful Soup,然後用簡單的方法找出並提取元素。

它非常適合小型專案、原型驗證與教學用途。缺點是什麼?Beautiful Soup 不能執行 JavaScript,所以只能處理靜態 HTML。若是動態網站,您需要搭配 Selenium 或 requests_html 之類的工具使用()。

3. Selenium

是最早一代的瀏覽器自動化工具。它原本是為測試而生,如今已成為抓取動態、JavaScript 密集網站的熱門選擇。Selenium 會啟動真實瀏覽器(Chrome、Firefox 等),並模擬使用者行為——點擊、捲動、登入,幾乎無所不能。只要人看得到的畫面,Selenium 通常都能抓。

它支援多種語言(Python、Java、JS、C#),非常適合抓取登入後的內容或互動式流程。Selenium 4 也持續整合 ,這是一種雙向通訊協定,能讓您的腳本訂閱瀏覽器事件(網路請求、主控台日誌、DOM 變動)並攔截網路呼叫——這些功能過去往往讓 Puppeteer 或 Playwright 成為更容易用來抓取的選擇。4.40 版(2026 年 1 月)與 4.41 版(2026 年 2 月)也把 BiDi 支援擴展到 Python、Java、.NET 與 Ruby 綁定。缺點仍然存在:Selenium 比純 HTTP 爬蟲慢、重,而且管理瀏覽器驅動程式仍然很麻煩。不過,對於棘手網站——以及已經把 Selenium 標準化用於測試自動化的團隊——它在 2026 年仍是一個可信賴的抓取選項()。

4. Cheerio

就像 Node.js 世界裡的 jQuery。它讓您能用熟悉、類似 jQuery 的語法在伺服器端解析 HTML。它速度飛快,非常適合靜態頁面——只要把 HTML 抓下來(可用 Axios 或 Fetch),載入 Cheerio,再用選擇器抓出您需要的內容即可。

Cheerio 不會執行 JavaScript,因此最適合靜態內容。不過它和其他 Node.js 工具整合得非常漂亮,是想全程使用 JavaScript 的開發者最愛之一()。

5. Puppeteer

是一個用來以無頭模式控制 Chrome 或 Chromium 的 Node.js 函式庫。它是抓取現代網頁應用與單頁應用的熱門選擇,因為這類網站需要真正的瀏覽器渲染:截圖、PDF 產生、網路攔截,全都透過乾淨的 async/await API 完成。Google 的 Chrome 團隊至今仍持續維護 Puppeteer,並讓它與每個新的 Chrome 版本及 DevTools Protocol 更新保持同步。

到了 2026 年,有一點背景值得知道:Puppeteer 的發版節奏已更偏向 Chrome 相容性與相依套件更新,而非新增重大能力;而打造出 Puppeteer 最雄心勃勃功能的原始團隊,後來在 Microsoft 開發了 。如果您已經投入 Puppeteer 生態,且只需要 Chrome 自動化,它仍然是一個穩定選擇。如果您是從零開始,並且想要跨瀏覽器支援、內建測試執行器、自動等待定位器與追蹤檢視器,那麼 2026 年大多數團隊會先想到 Playwright(, )。

快速比較表:最佳開源網頁爬蟲工具

| 工具 | 易用性 | 平台/語言 | 動態內容 | 最適合 | 獨特優勢 |

|---|---|---|---|---|---|

| Scrapy | 中等/進階(程式碼) | Python 框架 | 部分支援 | 開發者、資料科學家 | 非同步抓取、外掛、生態龐大 |

| BeautifulSoup | 中等(簡單程式碼) | Python 函式庫 | 不支援 | 新手、快速解析 | 解析器寬容、非常適合靜態 HTML |

| Selenium | 中等(撰寫腳本) | 多語言 | 支援 | QA、動態網站抓取 | 真實瀏覽器自動化、可處理登入與使用者事件 |

| Cheerio | 中等(JS 程式碼) | Node.js 函式庫 | 不支援 | JS 開發者、靜態頁面 | jQuery 語法、HTML 解析速度快 |

| Puppeteer | 中等(JS 程式碼) | Node.js(無頭 Chrome) | 支援 | 開發者、現代網頁應用 | 截圖、PDF、單頁應用抓取、async/await API |

如何根據需求挑選合適的開源網頁爬蟲工具

這是我整理出的選擇指南:

- 技術能力: 不會寫程式?從 Thunderbit、Octoparse、ParseHub 或 WebHarvy 開始。開發者?可考慮 Scrapy、Cheerio、Puppeteer 或 Apify。

- 專案規模: 一次性或小型任務?Beautiful Soup、Cheerio、WebHarvy 都很合適。大型或持續性任務?Scrapy、Apify、Thunderbit(搭配排程)。

- 資料類型: 靜態 HTML?用 Cheerio、Beautiful Soup 或 WebHarvy。動態/JavaScript 密集網站?Puppeteer、Selenium、Thunderbit、Octoparse 更合適。

- 整合需求: 需要匯出到 Sheets、Notion 或資料庫?Thunderbit 與 Octoparse 都很方便。需要 API 或自訂管線?Scrapy 與 Apify 會是您的好朋友。

- 社群與支援: 找找看是否有活躍論壇、近期更新,以及大量教學。Scrapy、Cheerio 與 Selenium 的社群都非常龐大;Thunderbit 與 Octoparse 的使用者基礎也在成長,且有不少指南。

不妨先拿幾款工具做一個小專案試試,看哪個最符合您的工作流程與使用習慣。也別害怕混搭:有時候最快的解法,是先用視覺化工具快速抓一波,再用程式化框架進行更深層的爬取。

開源爬蟲中的社群與持續支援價值

開源最大的優勢之一,就是社群。活躍的論壇、GitHub 倉庫與 Stack Overflow 標籤,代表您從來不孤單。若您遇到卡關,多半已經有人解決過,或至少願意幫您一把。由社群驅動的工具通常更新更頻繁,也會持續加入新功能,您還能找到大量教學、外掛與最佳實務()。

因此,對 Thunderbit 與 Octoparse 這類視覺化工具來說,使用者論壇與範本分享就是一座金礦。對開發者工具而言,GitHub issues 與 Discord/Slack 社群則是魔法發生的地方。當您選擇開源工具時,您其實是在加入一個全球性的解題者網路——這無價。

Thunderbit:更簡單、人人都能上手的免程式網頁爬蟲解決方案

沒錯,開源很棒——但有時候,您其實不想為了拿到可用資料,就去建構、調校還要日常維護一個爬蟲。而且不是每個抓取需求都能靠開源程式碼解決——這就是 Thunderbit 發揮得很好的地方。如果您讀到這裡,心裡想的是:「這些工具很強,但我只是想拿到資料,不想自己建或維護爬蟲。」那 Thunderbit 就是很自然的下一步。

是一款 AI 驅動的 Chrome 擴充功能,專為比起基礎架構更在意成果的商務使用者打造。您不需要寫選擇器或腳本,只要先點一下 AI Suggest Fields。AI 會理解頁面結構、提出欄位,您再按第二下就能開始抓取。分頁、子頁面與清單到明細的工作流程也都會幫您處理好。

Thunderbit 最大的優勢之一,是它如何橋接人類意圖與結構化資料。您可以用自然語言描述想要什麼(例如「收集產品名稱、價格與評分」),Thunderbit 就會把它轉成乾淨的表格。子頁面抓取讓您可以自動造訪明細頁,輕鬆取得更豐富的資料。內建匯出到 Excel、Google Sheets、Notion 與 Airtable,讓您的資料能立即派上用場。

Thunderbit 特別受到銷售、行銷、電子商務與不動產團隊歡迎,因為他們需要可靠資料,但不想維護開源資料管線。它支援數十種語言,在動態網站上表現良好,還提供相當慷慨的免費方案方便開始使用。雖然它不是開源工具,但與開源工具非常互補——您可以把它視為在沒有工程負擔的情況下,快速驗證想法或處理重複性商務抓取需求的最快方式。

結論:用最佳開源工具解鎖網路資料

網頁爬蟲早已不再只是寫程式的人或大公司專屬。借助今天的開源工具,任何人都能把網路轉換成結構化、可執行的資料——無論您是在建立潛在客戶名單、監控價格,還是為下一個 AI 專案供應養分。關鍵在於讓工具對應需求:想要速度與簡單性,就選 AI 驅動與視覺化工具;想要力量與規模,就選程式化框架。

那接下來呢?從這份清單挑一款工具,拿真實任務試試看,親自體驗能省下多少時間與力氣。如果您想快速看到成果, 就能感受網頁爬蟲到底可以多簡單。網路就是您的寶庫,去把那些資料珍珠撈回來吧。

若您想看更多深入解析與教學,歡迎前往 。祝您抓取順利!

常見問題

1. 與商業工具相比,開源網頁爬蟲工具最大的優勢是什麼?

開源工具成本效益高、彈性強,並且有活躍社群支援。您可以自行客製化、避免被供應商綁定,還能享受集體知識與頻繁更新的好處。

2. 哪一款開源工具最適合沒有技術背景的商務使用者?

Thunderbit、Octoparse、ParseHub 與 WebHarvy 都很適合不寫程式的人。Thunderbit 的 AI 驅動、兩步驟流程與直接匯出選項尤其突出。

3. 開源工具能處理動態、JavaScript 很重的網站嗎?

可以!像 Thunderbit、Selenium、Puppeteer、Octoparse 和 ParseHub 都能透過真實或無頭瀏覽器渲染頁面來抓取動態內容。

4. 我怎麼知道一個工具是否持續維護與支援?

查看 GitHub 上最近的提交、開啟中的 issues 與貢獻者活躍度。也可以找找看是否有活躍論壇、近期部落格文章,以及大量使用者貢獻的外掛或範本。

5. 如果我是新手,開始做網頁爬蟲最好的方式是什麼?

先從 Thunderbit 或 Octoparse 這類視覺化或 AI 驅動工具開始。試著抓取一小筆資料,匯出到 Excel 或 Sheets,邊做邊學。熟悉之後,再探索程式化工具,應對更進階的專案。

想看 Thunderbit 實際運作嗎? ,加入 30,000+ 名把網路變成資料的使用者——完全不用寫程式。

延伸閱讀