每天大約有 200 萬到 300 萬篇新聞文章在網路上發布。要把這些資料整理成結構化格式——標題、日期、來源、完整文章內容——說真的,跟不看說明書自己組家具差不多痛苦。

我在 投入多年時間開發與測試自動化工具。到了 2026 年,新聞爬取的整體情況可以說是機會很多,但挫折也不少。Google 早在 2011 年就關閉了官方 News API,新聞網站也紛紛加強反機器人措施(Cloudflare、CAPTCHA、JavaScript 渲染障礙),版面還變動得很頻繁,讓爬蟲星期一能跑、星期三就壞掉也不奇怪。與此同時,從公關、業務到學術研究與 AI 工程團隊,對結構化新聞資料的需求卻比以前更高。

所以我決定測試 15 款新聞爬取工具,涵蓋 API、無程式碼平台與開源函式庫。目標很單純:幫您整理出一份在價格、維護成本、乾淨文字擷取與實際使用情境上都經過標準化比較的清單,這是其他指南通常不會提供的。

2026 年,什麼樣的新聞爬蟲才算脫穎而出?

大多數「最佳新聞爬蟲」文章根本沒有好好說評估標準,所以這裡先講清楚我實際拿來測試的項目。大多數「最佳新聞爬蟲」文章只是列功能,然後就草草帶過。不過在開發爬取基礎設施多年後,我學到一件事:商業使用者在意的標準其實很具體,而且常常被忽略。

以下是我使用的評估框架:

| 標準 | 我的評估重點 |

|---|---|

| 方案類型 | API、無程式碼瀏覽器工具,或開源函式庫 |

| 反機器人處理 | 代理輪換、CAPTCHA 解決、無頭瀏覽器支援 |

| 乾淨文字擷取 | 能否移除廣告/側欄/導覽,只保留文章正文? |

| 中繼資料輸出 | 作者、日期、圖片、來源 URL、分類 |

| 匯出格式 | CSV、JSON、Google Sheets、Airtable、Notion 等 |

| 分頁/批次支援 | 能否處理多頁結果與批次 URL? |

| 維護成本 | 網站版面變動時會不會壞?AI 自適應 vs. 選擇器式 |

| 每 1K 結果標準化成本 | 以相同口徑比較價格(含免費方案) |

| 最適用情境 | 公關監測、潛在客戶開發、學術研究、LLM 流程等 |

其中有兩個標準需要多講一點背景。每 1K 結果標準化成本很重要,因為每家供應商的報價方式都不同——有的是按點數、有的是按請求、有的是按搜尋、有的是按列。不做標準化,您根本是在拿蘋果比潛水艇。另一個是 維護成本,這是我從使用者那裡聽到最多的痛點。各種論壇裡的抱怨都一樣:『新聞網站超愛在每週二把我的爬蟲弄壞。』我把每個工具都用三階段來評分:

- 🟢 低維護: AI 自適應或全託管 API——版面變動不會把流程弄壞

- 🟡 中維護: 能處理反機器人,但擷取邏輯仍可能失效

- 🔴 高維護: 選擇器式——網站一變,就得手動修

哪款新聞爬蟲最適合您的角色?決策矩陣

爬蟲推薦幾乎總是把每個讀者都當成同一種人,而這正是問題所在。追蹤品牌提及的公關經理,需求和建立 RAG 流程的 Python 開發者完全不同。所以在進入完整清單前,先看一個快速框架:

| 使用情境 | 最佳方式 | 推薦工具 |

|---|---|---|

| 每日新聞簡報(非技術) | 無程式碼瀏覽器工具或 RSS | Thunderbit、Octoparse、ParseHub |

| 大規模公關/媒體監測 | 具警示功能的 News API | Newscatcher、Webz.io、Newsdata.io |

| 從新聞中擷取業務名單 | 具子頁面增強的 AI 爬蟲 | Thunderbit(子頁面爬取+Email/電話擷取)、Apify |

| 學術研究/語料庫建置 | 開源函式庫 | Newspaper4k |

| LLM 流程/RAG 輸入 | 轉為 Markdown 的 API | Thunderbit API、ScraperAPI |

| 競爭情報/價格監控 | 排程爬取 | Thunderbit(排程爬蟲)、Bright Data |

已經知道自己屬於哪一類了嗎?可以直接往下跳。不然,下面的完整分析會很有幫助。

15 款最佳新聞爬蟲一覽

以下是總表——價格已換算為最低付費方案下每 1,000 筆結果的成本,維護等級則依三階段評分。

| 工具 | 類型 | 免費方案 | 每 1K 結果成本(估) | 反機器人 | 乾淨文字 | 維護 | 最適用情境 |

|---|---|---|---|---|---|---|---|

| Thunderbit | 無程式碼 AI(Chrome 擴充功能+雲端) | 每月 6 頁免費 | 約 $3–$15 | 強(瀏覽器+雲端模式) | 是(AI+子頁面) | 🟢 低 | 商業團隊、名單開發、日常監控 |

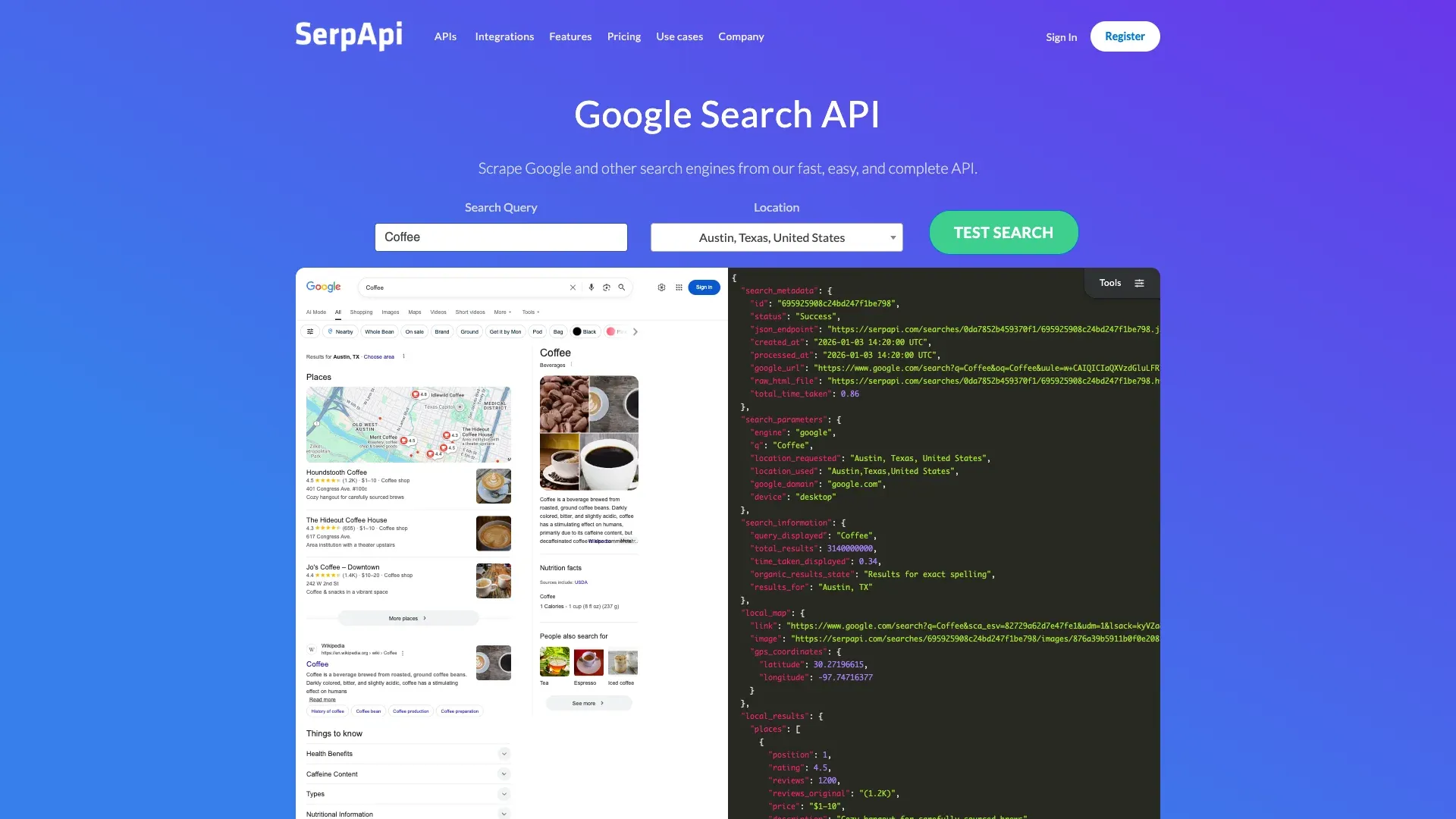

| SerpApi | API | 每月 250 次搜尋 | 約 $15 | 強(專為 SERP) | 否(只有摘要) | 🟢 低 | Google News SERP 儀表板 |

| ScraperAPI | API | 每月 1,000 點數 | 約 $1–$5 | 強(代理+JS 渲染) | 否(原始 HTML) | 🟡 中 | 想要反機器人基礎設施的開發者 |

| Newsdata.io | News API | 每日 200 次請求 | 約 $5–$15 | 不適用(託管 API) | 部分(進階版) | 🟢 低 | 結構化新聞中繼資料 |

| Apify | 雲端平台 | $5 免費點數 | 約 $1–$6 | 強 | 依 actor 而異 | 🟡 中 | 客製化雲端流程 |

| Oxylabs | 企業級 API | 2,000 結果試用 | 約 $0.50–$2 | 非常強 | 部分 | 🟢 低 | 企業級 SERP+網頁資料 |

| ScrapingBee | API | 試用點數 | 約 $2–$5 | 強(Headless Chrome) | 部分(基礎) | 🟡 中 | JS 很重的新聞網站 |

| Scrapingdog | SERP API | 1,000 點數 | 約 $0.10–$0.50 | 強 | 否(SERP 資料) | 🟢 低 | 預算型 SERP 監測 |

| Bright Data | 企業級平台 | 1,000 次請求試用 | 約 $0.30–$0.50 | 非常強 | 是(News Scraper) | 🟢 低 | 大規模企業級新聞資料 |

| Octoparse | 無程式碼桌面版+雲端 | 有限制的免費方案 | 約 $5–$10(攤提後) | 強 | 是(搭配範本) | 🟡 中 | 視覺化無程式碼爬取 |

| ParseHub | 無程式碼桌面版 | 5 個專案,每次執行 200 頁 | 約 $5–$12(攤提後) | 中等 | 是(搭配設定) | 🔴 高 | 初學者、小型專案 |

| Newscatcher | News API | 無公開免費方案 | 客製化(企業級) | 不適用(託管 API) | 是(NLP 增強) | 🟢 低 | 公關/媒體監測 |

| Webz.io | 新聞資料平台 | 無自助式免費方案 | 客製化(企業級) | 不適用(託管 feed) | 是(全文+中繼資料) | 🟢 低 | 歷史資料庫、LLM 訓練 |

| Newspaper4k | 開源 Python | 免費 | $0(另加伺服器成本) | 無 | 是(專為此用途設計) | 🔴 高 | 開發者、語料庫建置 |

| HasData | SERP API | 免費點數 | 約 $0.25–$0.60 | 強 | 否(SERP 資料) | 🟢 低 | 預算型新聞 SERP 端點 |

快速結論:Scrapingdog 和 HasData 是每次請求成本最低的 API 選項。Thunderbit 和 Newspaper4k 在乾淨文章文字上領先,只是方式完全不同。Bright Data 和 Oxylabs 佔據企業級市場。怕維護麻煩?那就挑 🟢 工具。

1. Thunderbit — 最適合商業團隊的無程式碼 AI 新聞爬蟲

是我和團隊專門為了解決『我需要這個網站的資料,而且我不想寫程式或維護選擇器』這個問題所打造的工具。用來爬新聞時,流程簡單到不能再簡單:打開新聞頁面,點 AI Suggest Fields,檢視 Thunderbit 建議的欄位(標題、日期、來源、URL、摘要——它會讀取頁面結構並判斷有哪些資料),然後按 Scrape。

是我和團隊專門為了解決『我需要這個網站的資料,而且我不想寫程式或維護選擇器』這個問題所打造的工具。用來爬新聞時,流程簡單到不能再簡單:打開新聞頁面,點 AI Suggest Fields,檢視 Thunderbit 建議的欄位(標題、日期、來源、URL、摘要——它會讀取頁面結構並判斷有哪些資料),然後按 Scrape。

有幾項功能讓 Thunderbit 對新聞特別強:

- AI 自適應擷取: 不需要撰寫或維護 CSS 選擇器。AI 每次都會重新讀取當前頁面版型,這表示新聞網站重新設計時(它們真的常這樣),您的爬蟲也不會壞。

- 子頁面爬取: 在爬完文章連結清單後,您可以點 Scrape Subpages,逐篇造訪文章並擷取完整正文、作者、發布日期與圖片。這就是取得乾淨文章內容、而不只是標題的方法。

- Field AI Prompt: 您可以逐欄指示 AI,例如『只擷取主要文章正文,排除導覽與廣告』,或『把這篇文章的情緒分類為正面、中性或負面』。這在無程式碼工具中很少見,對新聞分析非常實用。

- Browser Scraping vs. Cloud Scraping: 瀏覽器模式使用您自己的登入工作階段(對會擋雲端 IP 的網站很有幫助),雲端模式則可一次處理最多 50 頁,速度更快。

- Scheduled Scraper: 可用自然語言時間間隔設定每日或每週爬取,對持續性的新聞監測很方便。

- 到處都能匯出: Excel、CSV、Google Sheets、Airtable、Notion——全都支援。

價格與限制

Thunderbit 提供免費方案(每月 6 頁)與 10 頁試用。付費方案起價約為 ,可獲得 500 點數(1 點數 = 1 列)。Chrome 擴充功能是瀏覽器模式的必要條件。AI 功能會消耗點數,因此若大量處理數千篇文章,就需要付費方案——但對多數每天監測或每週研究的商業團隊來說,成本都很合理。

維護: 🟢 低。AI 每次都會重新讀取頁面。

最適合: 想要每日新聞資料、但不想建立或維護爬蟲的非技術銷售、公關與營運團隊。

若想深入了解 Thunderbit 如何處理,可以看看我們的指南。

2. SerpApi — 最適合結構化 Google News SERP 資料

是一個專門處理 SERP 的 API,會從 Google News 結果回傳結構化 JSON。如果您的需求是『給我某個關鍵字的 Google News 前幾名結果,要結構化、可以直接丟到儀表板』,SerpApi 很適合。它會回傳標題、來源、日期、摘要與縮圖——但不會回傳完整文章內容。若要拿到實際文章正文,還需要另外一步(或另一個工具)。

是一個專門處理 SERP 的 API,會從 Google News 結果回傳結構化 JSON。如果您的需求是『給我某個關鍵字的 Google News 前幾名結果,要結構化、可以直接丟到儀表板』,SerpApi 很適合。它會回傳標題、來源、日期、摘要與縮圖——但不會回傳完整文章內容。若要拿到實際文章正文,還需要另外一步(或另一個工具)。

主要功能:

- 從 Google News SERP 輸出結構化 JSON

- 反偵測由他們處理(專為 SERP 設計)

- 支援多種 Google News 在地版本與語言

價格: 每月 250 次搜尋的免費方案。付費方案從每月 $75/5,000 次搜尋開始——大約每 1,000 筆結果 $15。

限制: 只回傳摘要。如果您需要完整文章內容,SerpApi 只是第一步,不是整條流程。

維護: 🟢 低(託管 API,由他們處理 Google 的變動)。

最適合: 建立新聞監測儀表板,或把 SERP 資料送進分析工具的開發者。

3. ScraperAPI — 具代理輪換的最佳平價爬取 API

是一個通用爬取 API,並非專為新聞設計,但抓新聞頁面很有效。它的核心價值是代理輪換、JavaScript 渲染與 CAPTCHA 處理——也就是原本得自己建立的反機器人基礎設施。

是一個通用爬取 API,並非專為新聞設計,但抓新聞頁面很有效。它的核心價值是代理輪換、JavaScript 渲染與 CAPTCHA 處理——也就是原本得自己建立的反機器人基礎設施。

主要功能:

- 具住宅與資料中心 IP 的代理輪換

- 針對動態新聞網站的 JavaScript 渲染

- CAPTCHA 處理

- 回傳原始 HTML——文章內容要自己解析

價格: 每月 1,000 點數的免費方案(另有試用點數)。JS 渲染每次請求會消耗更多點數。付費方案從每月 $49 起。標準化成本大約是每 1,000 次請求 $1–$5,視 JS 使用量而定。

限制: 沒有內建文章解析。您拿到的是 HTML,不是乾淨文字。可以搭配 Newspaper4k 或自己的解析器做文章擷取。

維護: 🟡 中等(反機器人由它處理,但擷取邏輯要您自己維護)。

最適合: 想要反機器人基礎設施、但不想自己建代理網路的開發者。

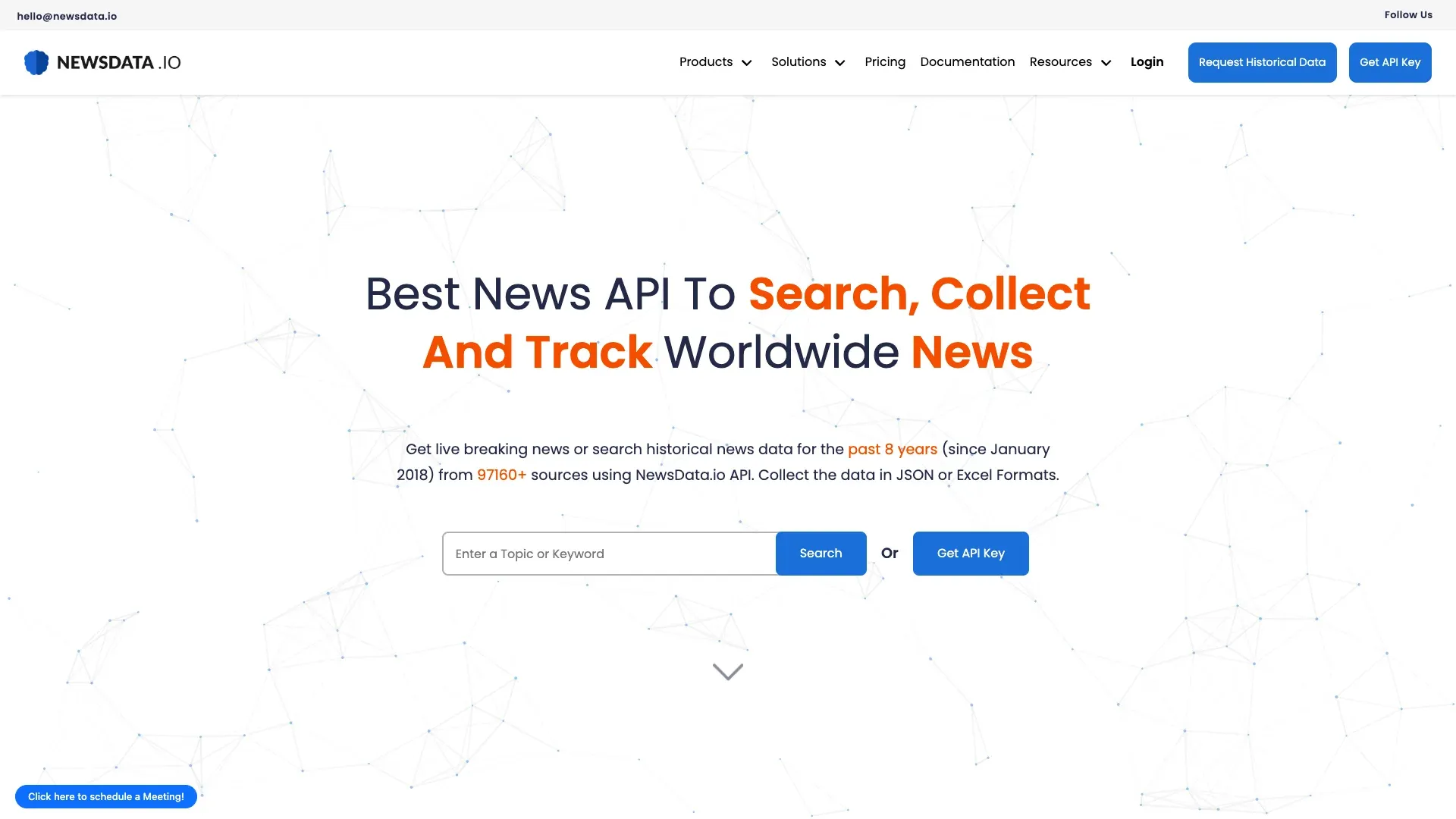

4. Newsdata.io — 結構化中繼資料的專用新聞 API

是一個專為新聞打造的 API,涵蓋 。它回傳結構化資料——標題、描述、來源、日期、分類、情緒——在進階方案還能取得完整文章內容。

是一個專為新聞打造的 API,涵蓋 。它回傳結構化資料——標題、描述、來源、日期、分類、情緒——在進階方案還能取得完整文章內容。

主要功能:

- 可依關鍵字、分類、語言、國家查詢

- 內建情緒分析

- 歷史新聞檔案(付費方案)

- 不需自行管理爬取基礎設施

價格: 每日 200 次請求的免費方案,但欄位有限。付費方案可解鎖完整內容與歷史資料。每 1,000 筆結果成本依方案而定,大約落在 $5–$15。

限制: 只涵蓋它自己索引的來源——您不能隨便丟一個 URL 說『幫我爬這個』。如果某個利基出版品不在索引裡,就找不到。

維護: 🟢 低(全託管新聞 API)。

最適合: 需要結構化新聞中繼資料、又不想管理任何爬取基礎設施的團隊。

5. Apify — 客製化新聞爬取流程的最佳雲端平台

是一個以 actor 為核心的雲端平台,提供 Google News、特定出版品與通用文章擷取的預建爬蟲。它正好位在無程式碼與完整客製開發之間的甜蜜點。

是一個以 actor 為核心的雲端平台,提供 Google News、特定出版品與通用文章擷取的預建爬蟲。它正好位在無程式碼與完整客製開發之間的甜蜜點。

主要功能:

- Google News、文章擷取等預建 actors

- 支援 JavaScript 渲染與無頭瀏覽器執行

- 可在雲端執行並排程

- 匯出到 JSON、CSV、Excel、XML 等

價格: 免費方案含 。付費方案為每月 $49、$499 與 $999。每 1,000 筆結果成本依 actor 而異——新聞爬取 actor 大約 $1–$6。

限制: 預建 actors 由社群維護,新聞網站一變就可能壞掉。比純無程式碼工具需要更多設定。

維護: 🟡 中等(網站變動時 actors 可能需要更新)。

最適合: 想要雲端執行、且願意挑選與設定市集 actors 的團隊。

6. Oxylabs — 最佳企業級爬取基礎設施

是一項企業級爬取服務,擁有 1 億以上代理池、CAPTCHA 解決與瀏覽器渲染。他們的 SERP Scraper API 可處理具地理定位的 Google News 結果,而 Web Scraper API 則可用於任意新聞頁面。

是一項企業級爬取服務,擁有 1 億以上代理池、CAPTCHA 解決與瀏覽器渲染。他們的 SERP Scraper API 可處理具地理定位的 Google News 結果,而 Web Scraper API 則可用於任意新聞頁面。

主要功能:

- 大規模代理基礎設施,支援地理定位

- 用於 Google News 的 SERP Scraper API

- 用於任意 URL 的 Web Scraper API

- JSON/CSV 輸出,大量並行請求

價格: SERP 資料從每月 $49 起。高流量使用提供企業客製報價。免費試用最多 2,000 筆結果。

限制: 對小團隊來說偏貴,主要是為大規模營運設計。

維護: 🟢 低(全託管企業級 API)。

最適合: 需要大量、具地理定位且可靠度高的新聞資料的公司。

7. ScrapingBee — 最適合 JavaScript 很重的新聞網站

是一個專注於 JavaScript 渲染的爬取 API,而且會真實執行瀏覽器。如果您要抓的新聞網站透過客戶端 JS 載入內容(現代網站很多都這樣),ScrapingBee 表現不錯。

是一個專注於 JavaScript 渲染的爬取 API,而且會真實執行瀏覽器。如果您要抓的新聞網站透過客戶端 JS 載入內容(現代網站很多都這樣),ScrapingBee 表現不錯。

主要功能:

- 具代理輪換的 Headless Chrome

- CAPTCHA 處理

- 部分頁面提供基礎的「Article Extraction」功能

- 可回傳原始 HTML、JSON 或類 Markdown 輸出

價格: 方案從 起。以點數計費,JS 渲染會更貴。有試用點數。

限制: 跟 AI 驅動的替代方案相比,文章擷取功能比較基礎。主要還是回傳 HTML——多數流程仍需要自行解析。

維護: 🟡 中等(反機器人由它處理,但擷取需要使用者設定)。

最適合: 想取得已渲染 HTML、又不想管理無頭瀏覽器的 JS-heavy 新聞網站爬取開發者。

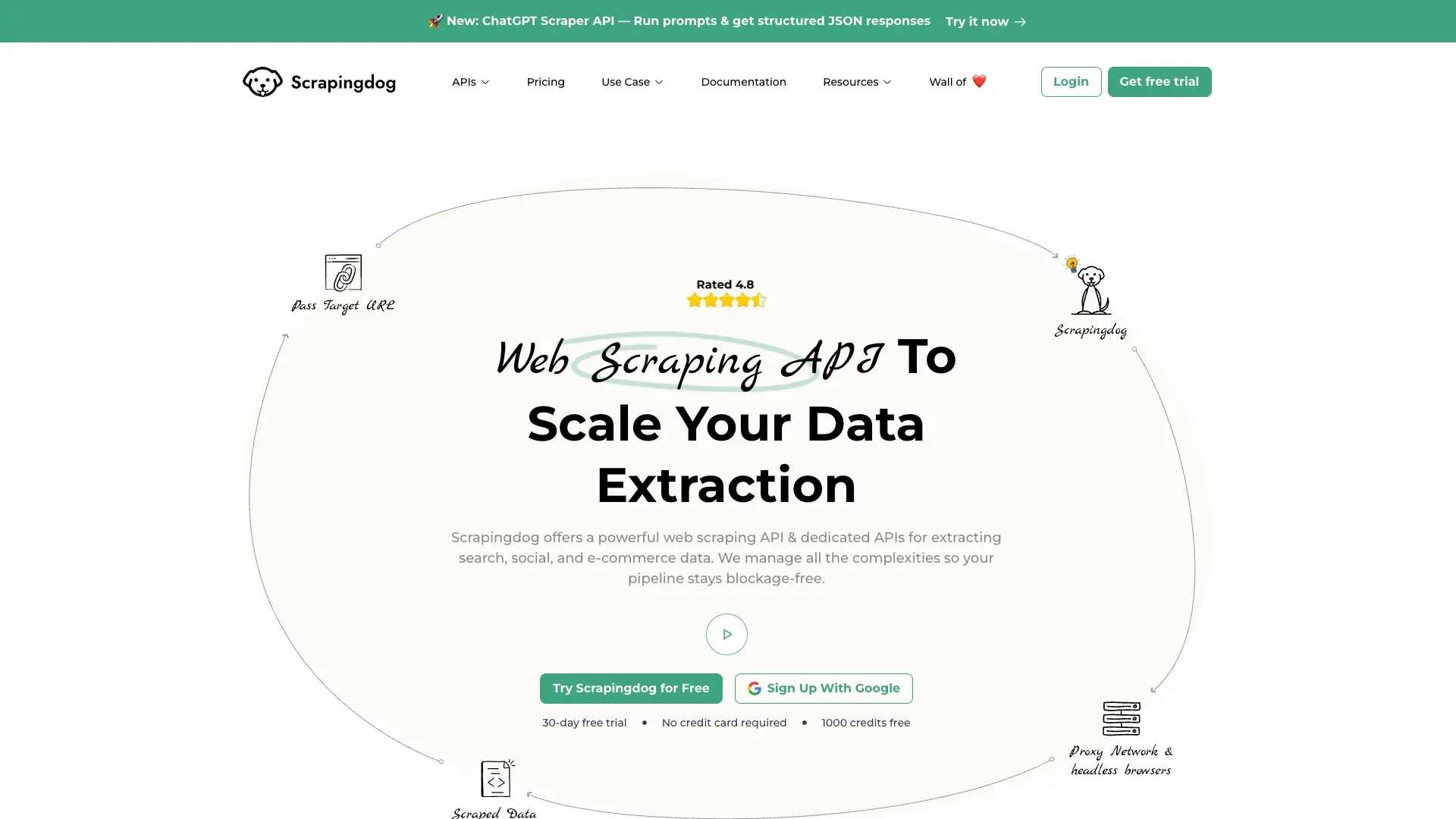

8. Scrapingdog — 最適合新聞的平價 SERP API

是一個預算型 SERP API,提供專門的 Google News 端點。回應速度快(測試中每次請求大約 2 秒),而且在 API 選項裡,價格是這份清單最有競爭力的。

是一個預算型 SERP API,提供專門的 Google News 端點。回應速度快(測試中每次請求大約 2 秒),而且在 API 選項裡,價格是這份清單最有競爭力的。

主要功能:

- 專用 Google News 端點

- 結構化 JSON 輸出(標題、來源、日期、摘要)

- 回應速度快

價格: 每月 $40 可得 400,000 次請求——大約每 1,000 筆結果 $0.10,便宜得驚人。免費方案有 1,000 點數。

限制: 只回傳 SERP 資料(標題、摘要),不會提供完整文章內容。和 SerpApi 一樣有這個取捨,但價格只有一小部分。

維護: 🟢 低(託管 SERP API)。

最適合: 預算有限、但需要大規模 Google News SERP 資料的開發者。

9. Bright Data — 最適合大規模企業新聞資料

是企業級重量級選手。他們的平台包含專用的 News Scraper 產品、龐大代理基礎設施、CAPTCHA 解決、瀏覽器渲染,以及往 S3、Snowflake 等目的地的下游傳送。

是企業級重量級選手。他們的平台包含專用的 News Scraper 產品、龐大代理基礎設施、CAPTCHA 解決、瀏覽器渲染,以及往 S3、Snowflake 等目的地的下游傳送。

主要功能:

- 專用 News Scraper 產品

- 預建資料集與即時蒐集

- 自動代理管理與 CAPTCHA 解決

- 排程蒐集與警示

- 匯出到 JSON、CSV、NDJSON、S3、Snowflake、GCS、Azure、SFTP

價格: 採用即用即付時,約從 起。另有企業客製方案。提供 1,000 次請求免費試用。

限制: 價格結構複雜,且有最低承諾量,主要是為企業預算設計。

維護: 🟢 低(企業代管,可靠度高)。

最適合: 需要高流量、可靠新聞資料管線的大型組織。

10. Octoparse — 最佳視覺化無程式碼新聞頁面爬蟲

Octoparse 是一款桌面應用程式,採用視覺化點擊式流程建構器。它有常見新聞網站的預建範本,能處理分頁與無限捲動,並提供可排程的雲端執行。

Octoparse 是一款桌面應用程式,採用視覺化點擊式流程建構器。它有常見新聞網站的預建範本,能處理分頁與無限捲動,並提供可排程的雲端執行。

主要功能:

- 視覺化點擊式流程建構器

- 預建新聞網站範本

- 可排程的雲端執行

- IP 輪換與自動 CAPTCHA 解決

- 可匯出到 Excel、CSV、JSON、資料庫、Google Sheets

價格: 免費方案含 10 個任務與每月 50K 匯出。付費方案從約每月 $89 起。

限制: 選擇器式擷取代表新聞網站版面一更新,爬蟲就可能壞掉。需要手動修正——而新聞網站真的很常更新版面。

維護: 🟡 中等(範本有幫助,但選擇器仍可能失效)。

最適合: 想要視覺化無程式碼建構器、且不介意偶爾維護範本的使用者。

11. ParseHub — 初學者最好的免費無程式碼選擇

ParseHub 是一款視覺化點擊式爬蟲,免費方案相當慷慨。它可處理 JavaScript 渲染內容,對一次性研究專案或小規模新聞擷取很有用。

ParseHub 是一款視覺化點擊式爬蟲,免費方案相當慷慨。它可處理 JavaScript 渲染內容,對一次性研究專案或小規模新聞擷取很有用。

主要功能:

- 視覺化元素選取(無需程式)

- 可處理 JavaScript 渲染頁面

- 匯出到 CSV/JSON

- 免費方案:5 個專案、每次執行 200 頁

價格: 免費方案為 5 個專案與每次執行 200 頁。付費方案從每月 $189 起。

限制: 基於 CSS 選擇器,因此版面一變,爬蟲就常常失效。擴展性有限,也比 API 工具慢。Reddit 與論壇上的使用者一再提到學習曲線與脆弱性。

維護: 🔴 高(選擇器常失效,沒有 AI 自適應)。

最適合: 做小型、一次性的新聞研究專案,且想要免費起步的初學者。

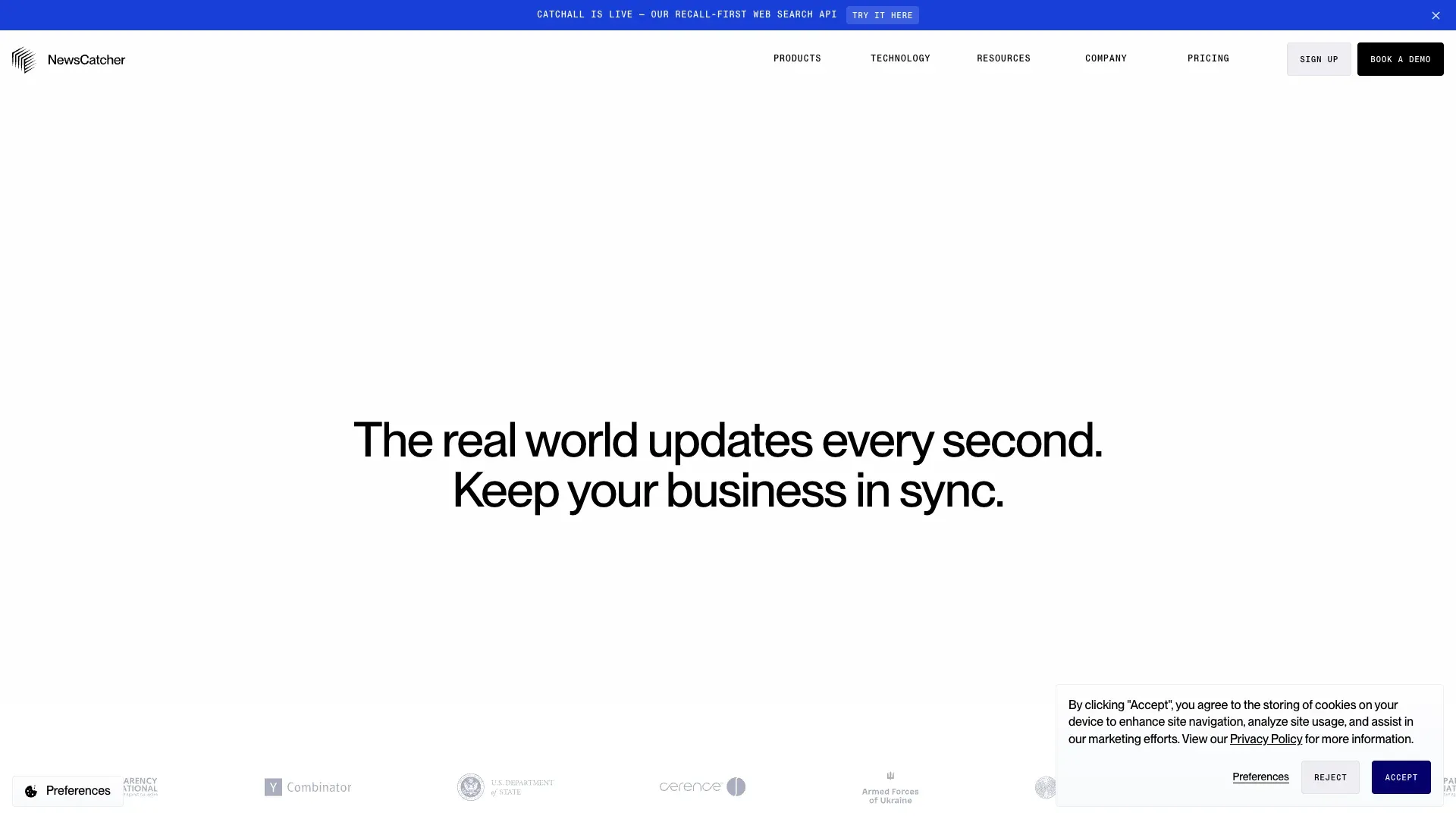

12. Newscatcher — 最適合公關與媒體監測的新聞 API

是一個專用新聞彙整 API,涵蓋 。它專為媒體監測、公關追蹤與趨勢分析打造,帶有情緒、摘要、實體擷取等 NLP 增強欄位。

是一個專用新聞彙整 API,涵蓋 。它專為媒體監測、公關追蹤與趨勢分析打造,帶有情緒、摘要、實體擷取等 NLP 增強欄位。

主要功能:

- 70,000+ 來源覆蓋

- NLP 增強:情緒、摘要、實體擷取、去重、聚類

- 可按關鍵字、主題、來源、語言、國家查詢

- 可存取歷史檔案

價格: 企業級價格(客製報價)。沒有公開免費方案可供測試,但可依需求申請試用。

限制: 企業導向價格對小團隊來說可能太高。沒有自助式免費方案。

維護: 🟢 低(全託管 API)。

最適合: 中大型公司的公關與媒體監測團隊。

13. Webz.io — 最適合歷史新聞檔案與 LLM 訓練資料

是一個新聞資料平台,擁有龐大的歷史檔案——數十億篇文章,時間可回溯多年。它同時提供即時 feed 與歷史資料存取,並以結構化 JSON 輸出,包含完整文章文字、中繼資料與各種增強欄位。

是一個新聞資料平台,擁有龐大的歷史檔案——數十億篇文章,時間可回溯多年。它同時提供即時 feed 與歷史資料存取,並以結構化 JSON 輸出,包含完整文章文字、中繼資料與各種增強欄位。

主要功能:

- 歷史檔案中有數十億篇文章

- 即時 feed 與歷史資料存取

- 具結構化中繼資料的完整文章文字

- 深受 AI/ML 團隊用於訓練資料集與 RAG 流程

價格: 企業/客製化定價(依資料量計算)。新聞沒有自助式免費方案。

限制: 不適合一般使用者。只提供企業級價格。

維護: 🟢 低(全託管資料 feed)。

最適合: 建立訓練資料集的 AI/ML 團隊,以及需要深度歷史新聞檔案的企業團隊。

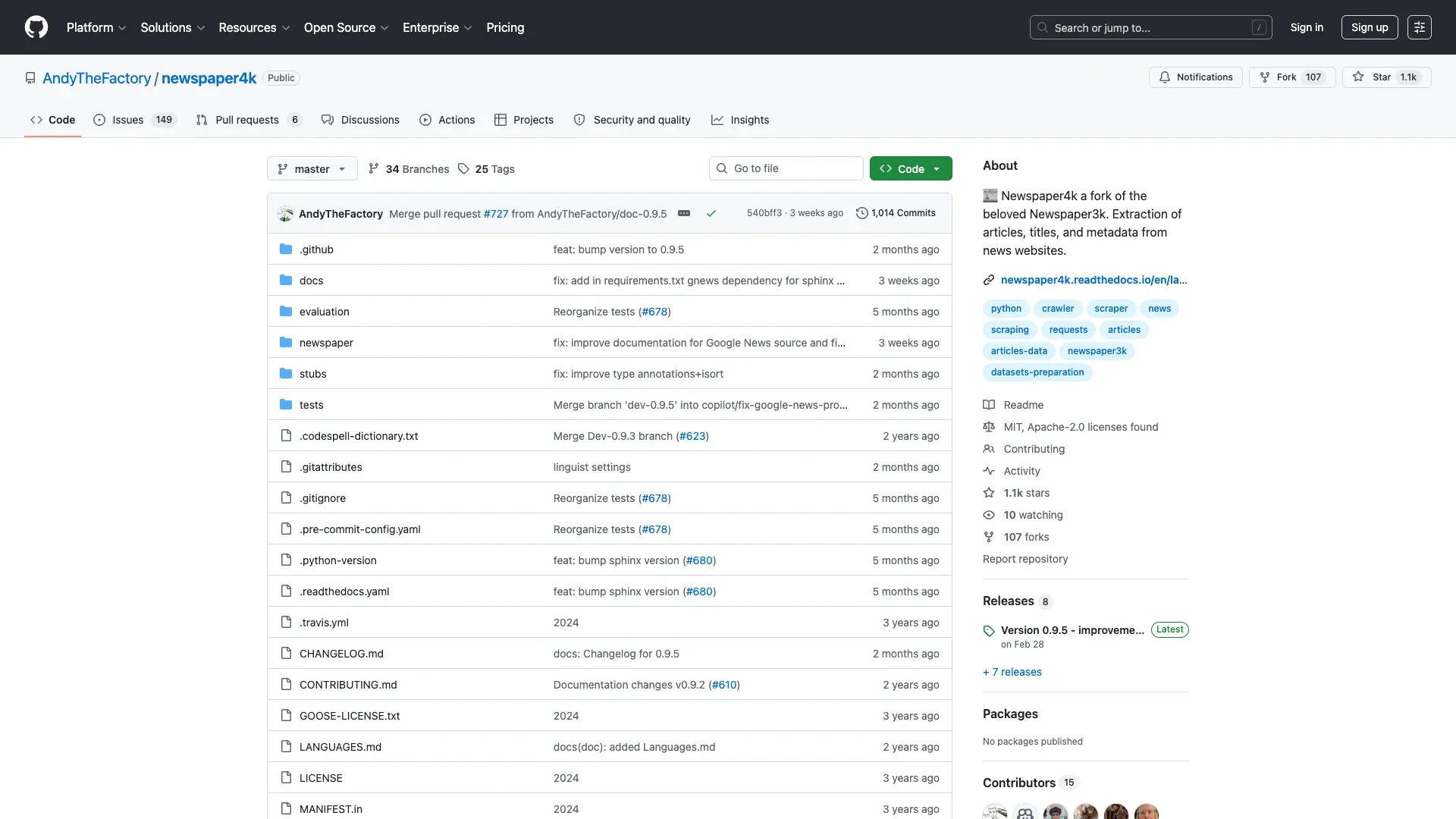

14. Newspaper4k — 文章擷取最好的開源函式庫

是一個 Python 函式庫(Newspaper3k 的後繼者),專門用來擷取乾淨的文章內容。它會去除廣告、側欄與導覽,只回傳文章本體:標題、正文、作者、發布日期、圖片、關鍵字與摘要。

是一個 Python 函式庫(Newspaper3k 的後繼者),專門用來擷取乾淨的文章內容。它會去除廣告、側欄與導覽,只回傳文章本體:標題、正文、作者、發布日期、圖片、關鍵字與摘要。

主要功能:

- 擷取乾淨的文章正文,去除雜訊

- 回傳標題、作者、發布日期、圖片、關鍵字、摘要

- 完全免費且開源

- 對靜態 HTML 頁面來說輕量又快速

價格: 免費。但您需要自己準備伺服器、代理基礎設施與開發時間。

限制: 沒有內建反機器人處理。對高度動態/JS 渲染的新聞網站會失效。需要 Python 知識,且若要做超出基本擷取的事,還得建立客製化流程。當網站 HTML 結構改變時,就得自己修。

維護: 🔴 高(網站 HTML 一變就壞,需要手動修正)。

最適合: 想要對文章解析有最大控制權的 Python 開發者,適合建置客製化新聞擷取流程。

15. HasData — 具新聞端點的最佳平價 SERP API

是一個 SERP API,提供專用的 Google News 端點。它會以具競爭力的價格回傳結構化 JSON 新聞結果。

是一個 SERP API,提供專用的 Google News 端點。它會以具競爭力的價格回傳結構化 JSON 新聞結果。

主要功能:

- 專用 Google News 端點

- 結構化 JSON 輸出

- 每次請求回應時間約 3–4 秒

- 提供免費點數供測試

價格: 從 起(每次新聞請求 5 點數=40,000 次請求)。大約每 1,000 筆結果 $0.25–$0.60。

限制: 只回傳 SERP 資料(標題、摘要),不包含完整文章內容。

維護: 🟢 低(託管 SERP API)。

最適合: 想要 Google News SERP 資料、但不想付 SerpApi 價格的預算型團隊。

值得注意的模式

把這 15 款工具都看過一輪後,有幾個模式特別明顯。

SERP API(SerpApi、Scrapingdog、HasData)非常適合結構化標題資料,但當您需要完整文章內容時就會卡住。專用新聞 API(Newsdata.io、Newscatcher、Webz.io)很漂亮地解決了中繼資料問題,但無法爬任意 URL。無程式碼工具(Thunderbit、Octoparse、ParseHub)讓您可以靈活爬任何頁面——只是維護難度差很多。而 Newspaper4k 則能提供最乾淨的文章擷取,前提是您願意自己建立並維護整條流程。

API vs. 無程式碼 vs. 開源:每 1,000 篇文章的真實成本

沒有人把這個比較跨所有類別做標準化。以下是計算結果:

| 方法 | 設定時間 | 每 1K 篇文章成本 | 維護 | 最適合 |

|---|---|---|---|---|

| 開源(Newspaper4k) | 數小時到數天 | $0(但有伺服器+開發時間) | 🔴 高 | 有客製需求的開發者 |

| News API(Newsdata.io、Newscatcher、Webz.io) | 數分鐘 | $5–$50+ | 🟢 低 | 結構化資料、歷史檔案 |

| 爬取 API(ScraperAPI、ScrapingBee、Oxylabs) | 30 分鐘 | $1–$5 | 🟡 中 | 想要反機器人處理的開發者 |

| 無程式碼 AI(Thunderbit、Octoparse、ParseHub) | 2 分鐘 | $3–$15 | 🟢–🟡 | 商業使用者、非技術團隊 |

所謂『免費』的開源工具,真正的隱藏成本其實是開發者時間。一位資深開發者每個月花 4 小時修壞掉的 Newspaper4k 流程?那不是免費,那很貴。

另一方面,像 Webz.io 和 Newscatcher 這種企業級 API 雖然維護負擔低,但價格只有在大規模使用時才比較合理。

對我接觸的大多數商業團隊來說,最理想的落點不是無程式碼 AI 工具(像 Thunderbit),就是專用新聞 API——前者適合彈性、臨時性的爬取,後者適合結構化、持續性的監測。

維護問題:為什麼大多數新聞爬蟲都會壞掉(以及哪些不會)

這值得獨立一節來說。

這是我在論壇、客服單和使用者對話中看到的第一大抱怨。新聞網站一直在改版——有時甚至每週都改。基於 CSS 選擇器或 XPath 建立的爬蟲,今天可能完美運作,明天就只會吐出垃圾。

以下是這 15 款工具在維護光譜上的表現:

| 維護等級 | 工具 | 網站變動時會發生什麼事 |

|---|---|---|

| 🟢 低(AI 自適應或託管 API) | Thunderbit、SerpApi、Newsdata.io、Newscatcher、Webz.io、Scrapingdog、HasData、Oxylabs、Bright Data | AI 會重新讀取頁面,或由 API 供應商處理。您完全不用動。 |

| 🟡 中(範本+代理) | ScraperAPI、ScrapingBee、Apify、Octoparse | 反機器人已處理,但您的擷取邏輯或 actor/範本可能需要更新。 |

| 🔴 高(選擇器式) | ParseHub、Newspaper4k | 網站一變,爬蟲就壞。您必須手動修正選擇器或解析規則。 |

Thunderbit 的做法特別值得一提:因為 AI 每次執行爬取時都會重新讀取目前頁面結構,所以不需要維護寫死的選擇器。我看過我們的使用者連續幾個月爬取同一批新聞來源,即使那些網站已經改版,設定也完全不用更新。當您在做每日新聞簡報或每週競品報告時,這種可靠性就很重要。

乾淨文章文字:哪些新聞爬蟲真的會去除雜訊?

『資料是有了,但裡面全是廣告、導覽選單和側欄垃圾。』這大概是我看到和新聞爬取相關的客服問題裡,五個就有三個會出現的抱怨。

以下是誠實版分析:

| 乾淨文字能力 | 工具 |

|---|---|

| 開箱即得乾淨文章文字 | Newspaper4k、Thunderbit(搭配子頁面爬取+Field AI Prompt)、Newsdata.io(進階版)、Webz.io、Bright Data(News Scraper)、Newscatcher |

| 只回傳標題/摘要(沒有全文) | SerpApi、Scrapingdog、HasData、Oxylabs(SERP 模式) |

| 回傳原始 HTML(需自行解析) | ScraperAPI、ScrapingBee |

| 依設定而異 | Apify、Octoparse、ParseHub |

Newspaper4k 是去除一般新聞頁雜訊的黃金標準——它就是為這件事而生。但它需要 Python,而且在 JS 很重的網站上會失效。

Thunderbit 的 Field AI Prompt 則是無程式碼版本的對應方案:您可以逐欄指示 AI『只擷取主要文章正文,排除導覽與廣告』,而且在擷取過程中還能順手標記、分類或摘要文字。對需要乾淨文章文字、但又不想寫程式的團隊來說,這是我找到最實用的選項。

如果您想了解 AI 驅動的擷取和傳統方法有什麼差別,我們關於的文章有更深入的說明。

負責任地爬新聞:法律與倫理基本原則

我找到的競品文章裡沒有一篇談到這點——這是一個很值得補上的缺口,尤其是對企業讀者而言。

robots.txt: 一定要先確認。很多大型新聞網站都明確禁止爬取某些路徑。負責任的工具(包括 Thunderbit)允許基於瀏覽器的爬取,並尊重工作階段脈絡,但在跑大規模任務前,您還是應該先查看網站的 robots.txt。

服務條款: 抓取內部研究所需的中繼資料(標題、日期、URL)與重新發布完整受版權保護的文章,兩者風險差很多。前者通常風險較低;後者則可能帶來實際法律風險。近期像 和 這類案件,都顯示法律環境仍在變化中。

最佳做法: 優先使用官方 API(Google News RSS、Newsdata.io、Newscatcher)。合理快取。限制請求速率。絕不要繞過付費牆。這份清單中的幾個工具——包括 Thunderbit、ScraperAPI 與 Bright Data——都提供內建限速或符合倫理的爬取功能,幫助您站在界線內。

本文僅供資訊參考,不構成法律建議。如果您要進行企業級大規模爬取,請諮詢法務團隊。

Thunderbit 在您的新聞爬取流程中扮演什麼角色

因為這個團隊就是我打造 Thunderbit 的,所以我比誰都更清楚它在新聞爬取上的強項與限制。實際流程大概如下。

一般商業使用者的工作流程會是這樣:

- 在 Chrome 中打開新聞頁面(Google News 結果、出版品首頁、主題搜尋頁)。

- 點 Thunderbit 擴充功能,再按 AI Suggest Fields。Thunderbit 會讀取頁面並提出欄位——標題、日期、來源、URL、摘要、圖片等。

- 必要時調整欄位。 想要情緒分類?新增一個欄位,並加上 Field AI Prompt,例如『將情緒分類為正面、中性或負面』。只想抓特定分類的文章?加一個篩選提示。

- 點 Scrape。 選擇 Browser 模式(使用您的工作階段,適合會擋雲端 IP 的網站)或 Cloud 模式(更快,可一次處理最多 50 頁)。

- 使用 Scrape Subpages 逐一造訪每個文章 URL,擷取完整正文、作者、發布日期與圖片。

- 匯出 到 Excel、CSV、、Airtable 或 Notion。

如果是持續監測,Scheduled Scraper 讓您可以用自然語言時間間隔設定每日或每週執行(例如『每個工作日早上 8 點』)。而且因為 Thunderbit 支援 ,做國際新聞監測也很直接。

Thunderbit 比較不適合的情境:每月要以最低單位成本爬取數百萬篇文章——在那種情況下,像 Bright Data 或 Webz.io 這類企業 API 會更划算。若您需要把深度 NLP 增強(實體擷取、聚類、去重)直接內建在 API 回應裡,Newscatcher 就是專門為此打造。

您可以透過 免費試用 Thunderbit——不需要信用卡。

如何選擇最適合的新聞爬蟲

我把 15 款工具測完後,整理出的快速備忘如下:

- 不懂技術、又想每天拿到新聞資料的商業使用者? 先從 Thunderbit 開始。兩步完成、無需程式碼,AI 會處理版面變動。

- 正在建立監測流程的開發者? 用 SerpApi 或 Scrapingdog 取得 SERP 資料。若要原始 HTML 與反機器人處理,選 ScraperAPI 或 ScrapingBee。

- 需要大規模且可靠性的企業團隊? Bright Data 或 Oxylabs。

- 追蹤數千個來源中的品牌提及的公關團隊? Newscatcher 或 Newsdata.io。

- 建立文字語料庫的研究者? Newspaper4k(如果您會 Python)或 Thunderbit 的子頁面爬取(如果不會)。

- 為 RAG 流程供料的 AI 工程師? Thunderbit API 或 Webz.io,用來取得乾淨、結構化的文章文字。

- 預算很緊? API 選 Scrapingdog、無程式碼選 Thunderbit 免費方案、開源選 Newspaper4k。

合適的工具取決於您能接受多少維護、預算以及技術能力。不確定嗎?先從免費方案開始——這些工具大多都有——看看哪種流程最符合您的實際需求。

若想看更多選項與比較,我們整理的會涵蓋更廣的版圖。如果您在正式採用工具前,想先了解,那篇指南是很好的起點。

結論

2026 年的新聞爬取其實已經是個可解的問題——只要選對工具,資料就會流動。那種一體適用的推薦時代已經過去。SERP API 很適合標題,但不會給您文章全文。專用新聞 API 對結構化中繼資料非常好,但無法爬任意 URL。像 Thunderbit 這類無程式碼 AI 工具提供彈性與低維護成本,而開源函式庫則讓您擁有控制權,只是得拿週末來換。

我最誠實的建議是:先決定您需要的是標題、完整文章文字,還是增強型中繼資料——接著再對照您能承受的維護等級與預算。如果您想看看現代、具 AI 自適應能力的新聞爬取長什麼樣子,而且完全不用寫一行程式碼,請。我想您會驚訝於幾次點擊就能完成多少事。

祝您爬取順利——也願您的文章文字永遠乾淨、選擇器永不失效,而匯出永遠準確落在正確的試算表裡。

常見問題

1. 對非技術使用者來說,哪種新聞爬蟲最好?

Thunderbit 是非技術使用者的最佳選擇。它的 AI 驅動、兩步驟流程不需要程式碼或 CSS 選擇器。AI 會自動讀取頁面結構、建議擷取欄位,並在版面改變時自動適應——所以您不需要維護任何東西。它也能直接匯出到 Google Sheets、Airtable 與 Notion。

2. 我可以從新聞爬蟲拿到完整文章文字,還是只有標題?

這取決於工具。像 SerpApi、Scrapingdog 與 HasData 這類 SERP API 只會回傳標題與摘要。像 Newsdata.io 與 Webz.io 這類專用新聞 API,在進階方案中會回傳完整文字。像 Thunderbit 這類無程式碼工具可以透過子頁面爬取取得完整文章文字,而 Newspaper4k 則是專為 Python 中的乾淨文章擷取而設。正式採用前,務必先確認工具回傳的是原始 HTML、摘要,還是乾淨的文章正文。

3. 網站版面改變時,新聞爬蟲會壞掉嗎?

基於選擇器的工具(ParseHub、Octoparse、Newspaper4k、客製化 Scrapy 流程)在新聞網站更新版面時常常失效——而且新聞網站更新很頻繁。像 Thunderbit 這類 AI 自適應工具每次都會重新讀取頁面結構,所以版面變動不會破壞流程。託管 API(SerpApi、Newsdata.io、Newscatcher)則由供應商負責處理變動。如果您很在意維護,請優先選擇比較表裡標為 🟢 低 的工具。

4. 大規模爬新聞,最便宜的方法是什麼?

若是 API 型爬取,Scrapingdog 提供最低的每次請求成本(起價約每 1,000 筆結果 $0.10)。若是無程式碼爬取,Thunderbit 的免費方案可涵蓋小型專案,而付費方案從每月約 $9 起。若是開源,Newspaper4k 是免費的——但要把開發者時間與伺服器成本算進去,這些很快就會累積。

5. 爬新聞網站合法嗎?

爬取公開可存取的資料作內部研究,通常風險較低;但重新發布完整受版權保護的文章,可能會有法律風險。開始爬之前,請務必查看網站的 robots.txt 與服務條款。若有官方 API,應優先使用,並遵守速率限制,絕不要繞過付費牆。近期像 hiQ v. LinkedIn 與 Meta v. Bright Data 的案例都顯示法律環境仍在演變。若是企業級規模的爬取,請諮詢法務團隊。

進一步了解