讓我告訴你一個秘密:我以前一直以為網頁爬蟲只屬於穿連帽外套的駭客,或是螢幕比常識還多的資料科學家。但現在,從網站擷取資料在商業世界裡已經跟買早咖啡一樣稀鬆平常——幸好,它不需要你懂 Python,也不用在中午前灌下三杯濃縮咖啡。事實上,隨著人工智慧網頁爬蟲工具興起,連把「HTML」當成 Subway 新三明治的人,也能從茫茫網海中抓出結構化資料。

如果你曾經把產品資訊、銷售名單或價格表一列一列複製貼到試算表裡,那你並不孤單。近 現在都在用網頁爬蟲做市場洞察與競爭對手追蹤。而且,網頁爬蟲軟體市場預計到 2032 年將達到 ;這很明顯地說明一件事:網頁資料擷取早已不是科技菁英的專利。無論你是業務、行銷人,或只是想擺脫手動輸入資料的人,這篇指南都適合你。我會帶你了解基礎概念,比較傳統與 AI 驅動的方法,並示範如何開始——不用連帽外套也行。

網頁爬蟲基礎:從網站抓資料是什麼意思?

先從最簡單的說起。網頁爬蟲就是一種工具(或程式、或 Chrome 擴充功能),能自動從網站收集資料。你可以把它想像成一位超快的實習生,而且完全不抱怨重複性工作。你不用逐列複製貼上,它幾秒鐘就能完成,而且還不會跟你要咖啡休息時間。

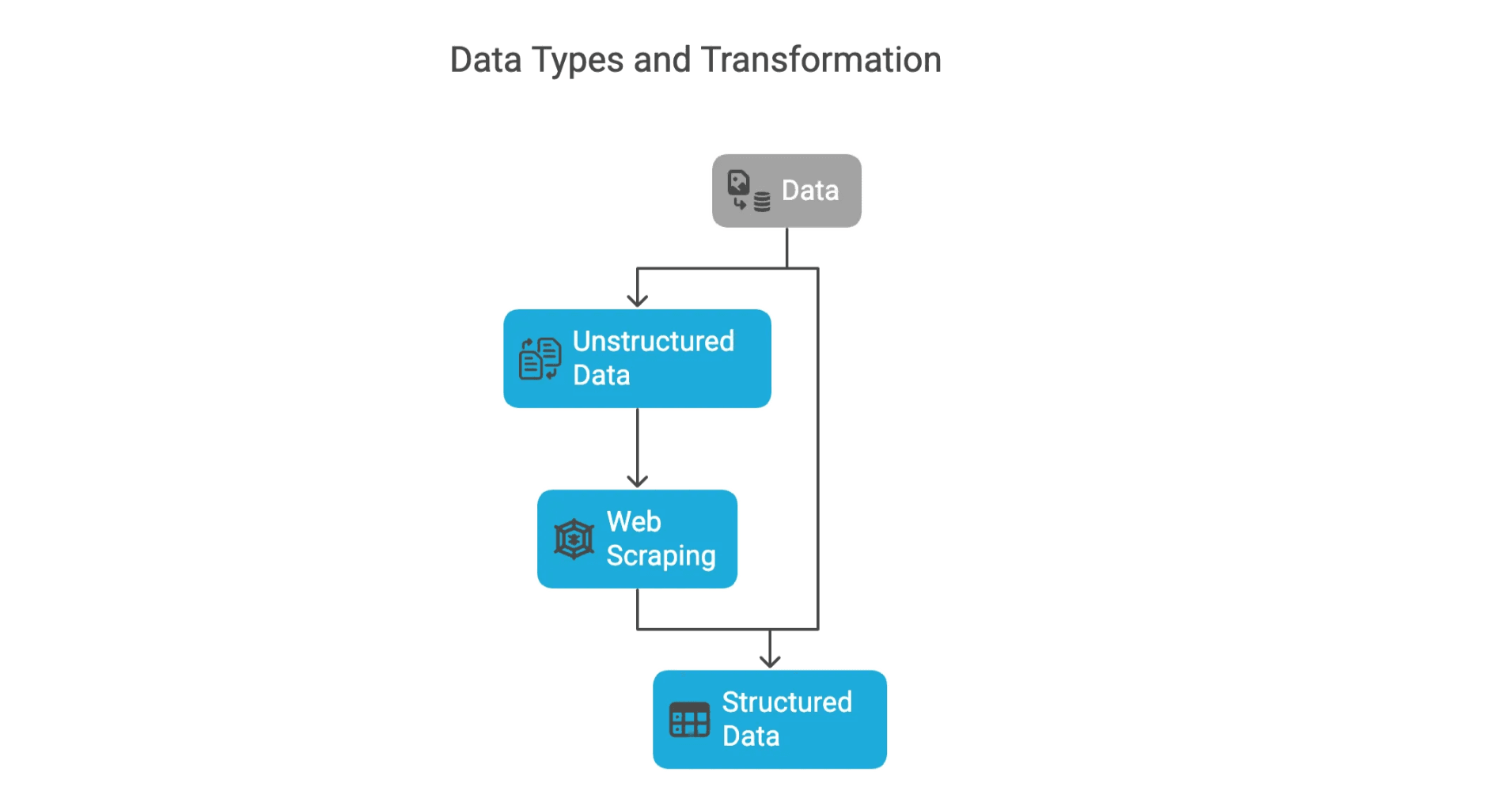

你通常會遇到兩種主要資料型態:

- 結構化資料: 就是整齊、可以直接拿去試算表用的內容,例如產品名稱、價格或電子郵件名單。它有清楚分類、標示,也很容易分析。

- 非結構化資料: 這就是大西部世界——部落格文章、評論、圖片,或任何沒辦法整齊放進列與欄的內容。多數網頁爬蟲專案的目的,是把非結構化資料轉成結構化資料,讓它真正能被使用。

如果你曾經把網站上的表格複製到 Excel,恭喜你——你已經做過手動網頁爬蟲了。現在想像一下,這件事要做 10,000 個頁面。真的別這麼做,這就是網頁爬蟲該派上用場的地方。

為什麼要從網站抓資料?關鍵商業效益是什麼?

那麼,為什麼一開始就要費心抓資料?簡單說:商業靠資料運作,而網路就是全世界最大的資料庫。 無論你在銷售、行銷、電子商務或房地產領域,網頁資料擷取都能讓你明顯領先。

以下是一些最常見的商業應用:

| 應用情境 | 說明 | ROI/效益範例 |

|---|---|---|

| 名單開發 | 從目錄或社群網站蒐集聯絡資訊、電子郵件或公司名單 | 銷售團隊省下數小時,並找到更多合格潛在客戶 |

| 價格監控 | 即時追蹤競爭對手價格、庫存狀況或促銷活動 | 零售商可動態調整價格,銷售額提升 4% |

| 市場研究 | 彙整評論、新聞或社群聲量來找出趨勢 | 行銷人員可根據即時消費者洞察調整活動 |

| 競爭對手分析 | 監控競品商品目錄、新品發布或內容更新 | 企業能更快因應市場變化 |

| 房地產情報 | 抓取房源資訊、價格與可售狀態 | 房仲與投資人可比市場更早發現機會 |

事實上,英國與歐洲有 正在使用由競爭對手價格爬取驅動的動態定價策略。像 John Lewis 和 ASOS 這類公司,也因為善用網頁資料做更聰明的決策而看到可觀的銷售成長。

傳統網頁爬蟲工具:它們怎麼運作?

讓我們回到 AI 尚未大展身手之前,那種「傳統」的資料擷取方式。傳統網頁爬蟲通常是程式碼(多半用 Python 撰寫)或瀏覽器擴充功能,依照一套規則去抓你要的資料。

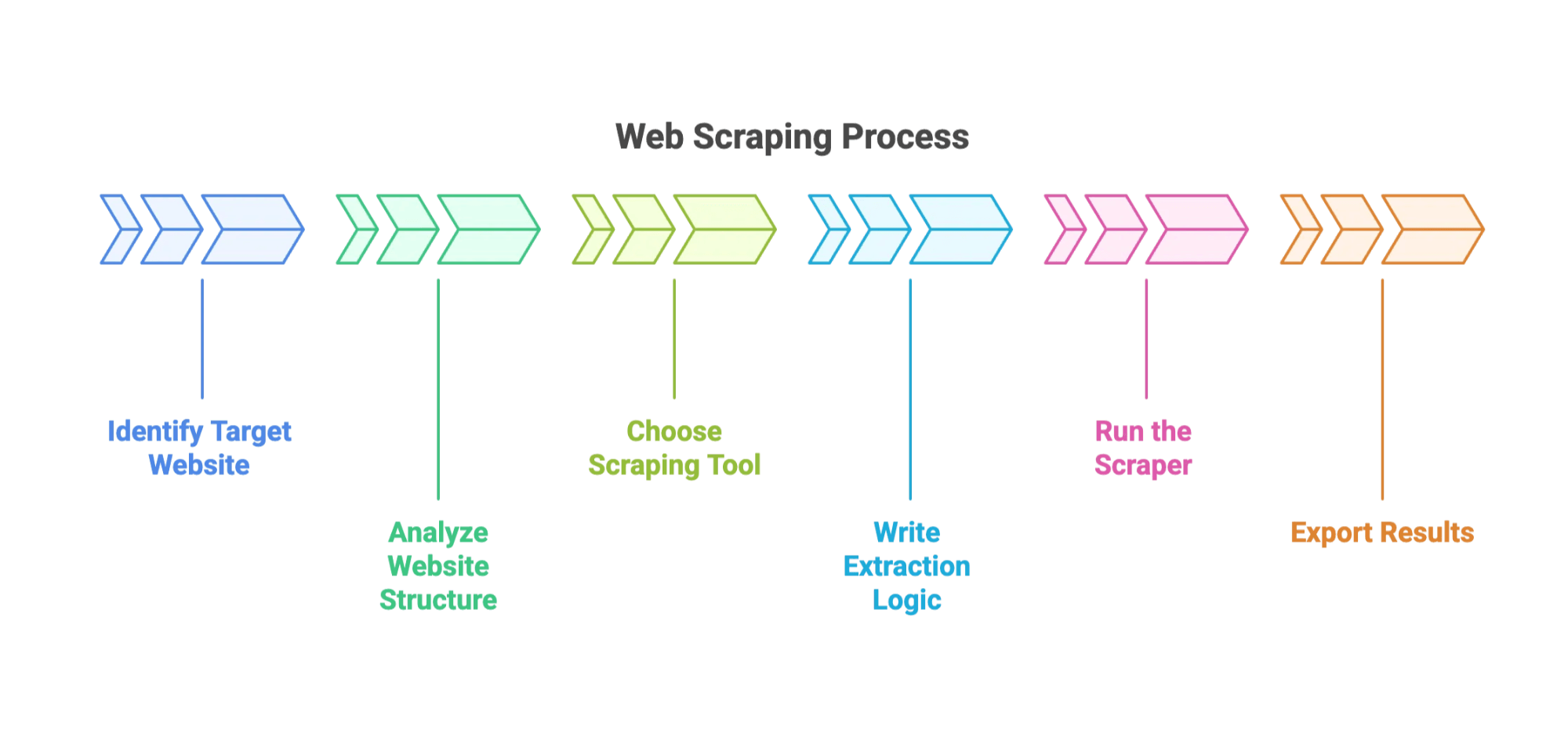

流程通常如下:

- 確認目標網站與資料欄位。

- 分析網站結構。(也就是用瀏覽器的開發者工具研究 HTML。這有點像數位考古。)

- 選擇工具: 常見選項包括 、 或瀏覽器外掛。

- 撰寫擷取邏輯: 告訴工具要怎麼找到資料——通常是指定 CSS selector 或 XPath。

- 執行爬蟲: 看著它跨頁收集資料。

- 匯出結果: 通常會輸出成 CSV、JSON,或直接匯入 Excel。

逐步教學:用傳統網頁爬蟲擷取資料

假設你想從某個電商網站抓產品列表。下面是一個適合初學者的流程:

- 步驟 1: 安裝 Python 和 BeautifulSoup 函式庫。

- 步驟 2: 用瀏覽器檢查產品頁面,找出包含產品名稱與價格的 HTML 標籤。

- 步驟 3: 寫一段簡短程式,抓取頁面、解析 HTML,並擷取相關欄位。

- 步驟 4: 透過迴圈處理多個頁面(包含分頁)。

- 步驟 5: 將資料匯出成 CSV 檔。

聽起來很直接,但相信我——你的第一個程式通常至少會壞一次。(我第一次嘗試時,因為把 class 名稱拼錯,結果抓到 500 列「None」。糗大了。)

傳統網頁爬蟲方案的常見挑戰

問題來了,這裡就開始變棘手:

- 網站變動: 就算網站版面只有一點點調整,也可能讓爬蟲失效。每週都有 因為版面變更而壞掉。

- 反機器人措施: CAPTCHA、IP 封鎖和速率限制都可能讓你立刻卡關。你需要處理代理伺服器、延遲,有時甚至得解 CAPTCHA。

- 需要技術能力: 你得懂一些程式設計和 HTML/CSS。

- 維護成本高: 爬蟲需要持續照顧與更新。

- 資料雜亂: 你還得花時間清理不一致的格式、缺漏值或奇怪的編碼。

對初學者來說,這就像在食譜一直改版、烤箱還偶爾把你鎖在外面的情況下做蛋糕。

AI 網頁爬蟲登場:讓資料擷取更普及

接下來是最有趣的部分。AI 網頁爬蟲正在改變遊戲規則。你不必寫程式,也不用研究 selector,只要用白話告訴工具你要什麼,剩下的交給 AI。

Thunderbit(沒錯,就是我們!)就是這類新工具的絕佳例子。透過 ,你可以用自然語言從任何網站擷取結構化資料——完全不需要寫程式。無論你在銷售、行銷還是電子商務領域,都能在幾分鐘內完成資料蒐集,而不是好幾天。

Thunderbit AI 網頁爬蟲:它如何簡化資料擷取

讓我帶你看看 Thunderbit 怎麼讓事情變簡單:

- AI 建議欄位: 只要點一下「AI 建議欄位」,Thunderbit 就會讀取網站、推薦欄位名稱,甚至建議每個欄位的擷取方式。

- 子頁面爬取: 想要更多細節?Thunderbit 可以自動造訪每個子頁面(像是單一產品頁)並豐富你的資料表。

- 即用型範本: 對 Amazon 或 Zillow 這類熱門網站,可以直接使用預建範本,不用任何設定。

- 免費資料匯出: 將資料匯出到 Excel、Google 試算表、Airtable 或 Notion。也能下載成 CSV 或 JSON,沒有隱藏費用。

- 排程爬取: 設定定期擷取,讓資料保持最新,非常適合價格監控或名單更新。

- AI 自動填表: 讓 AI 幫你填線上表單(對,連那種 10 頁的供應商入職表都行)。

- 電子郵件、電話與圖片提取器: 一鍵抓取聯絡資訊或圖片。

而且最棒的是?你完全不需要懂任何程式碼。Thunderbit 的 Chrome 擴充功能可在 取得,你也可以在我們的 了解更多。

傳統方案 vs. AI 網頁爬蟲方案比較

看看這兩種方法的差異:

| 面向 | 傳統網頁爬蟲 | AI 網頁爬蟲(Thunderbit) |

|---|---|---|

| 易用性 | 需要寫程式或複雜設定 | 無程式碼、自然語言介面 |

| 適應性 | 網站一變就容易壞 | AI 可自動適應版面變動 |

| 維護成本 | 高,需頻繁更新 | 低,AI 處理大多數變更 |

| 技術門檻 | 需要程式與 HTML 知識 | 為商務使用者設計 |

| 設定速度 | 幾小時到幾天 | 幾分鐘 |

| 資料處理 | 需要手動清理 | AI 自動清理並結構化資料 |

| 成本 | 免費(開源),但耗時高 | 方案實惠,提供免費匯出選項 |

對大多數商務使用者,尤其是初學者來說,像 Thunderbit 這樣的 AI 網頁爬蟲在速度、簡單性與穩定性上都明顯勝出。傳統工具仍然適合高度客製化或大規模專案——但就 95% 的使用情境而言,AI 才是更好的選擇。

逐步指南:初學者如何從網站抓資料

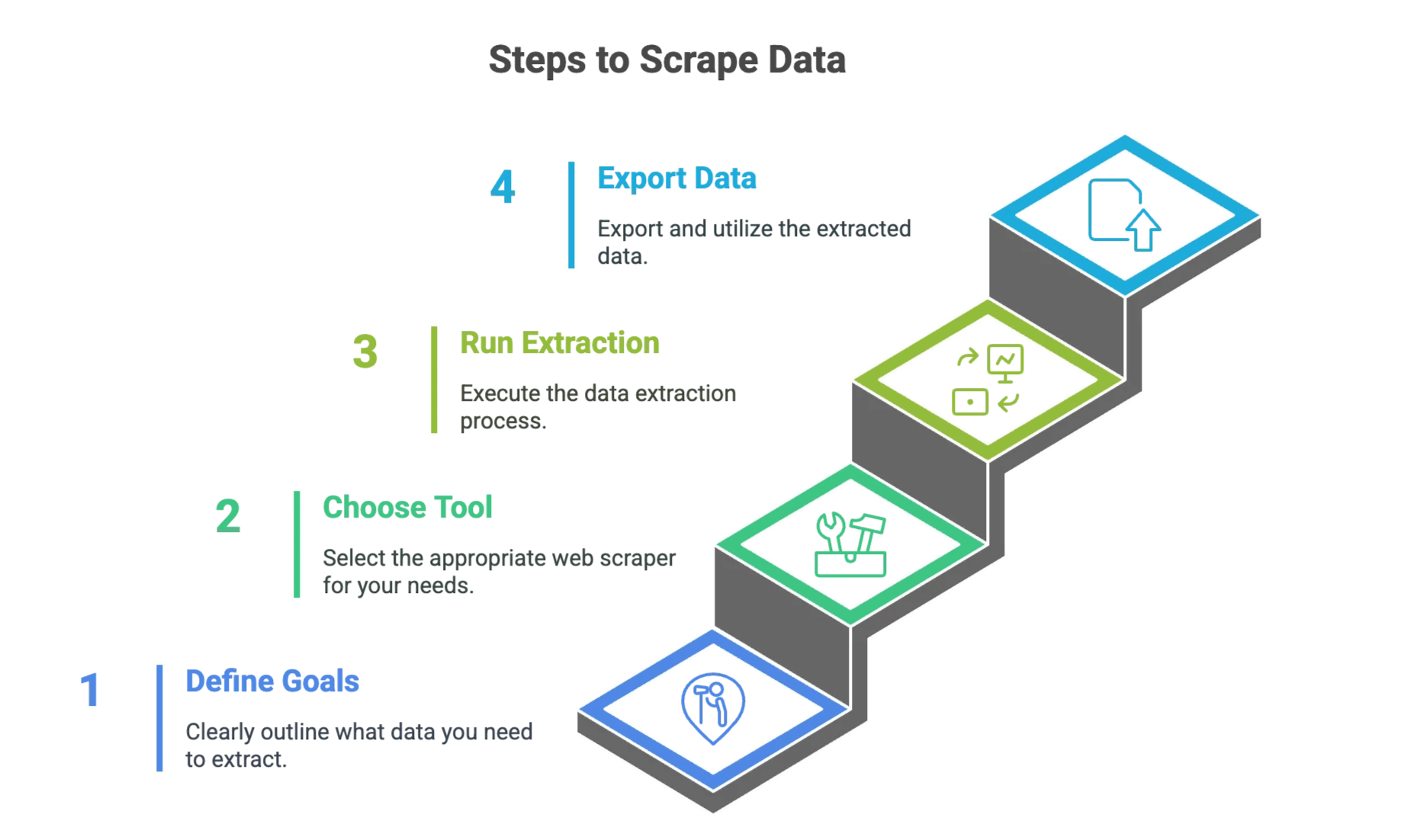

步驟 1:定義你的資料擷取目標

開始之前,先把需求想清楚。問自己:

- 我想抓哪些網站?

- 哪些資料欄位最重要?(例如產品名稱、價格、電子郵件、電話)

- 我需要這些資料多久一次?(一次性還是定期?)

列一份清單。舉例來說:「我想從 的前 5 頁收集產品名稱、價格與評分。」

步驟 2:選擇合適的網頁爬蟲工具

這裡有個快速判斷方式:

- 你熟悉程式碼,而且想要完全控制? 試試 BeautifulSoup 或 Scrapy 這類傳統工具。

- 你想要速度快、容易上手,而且不用寫程式? 選擇像 這樣的 AI 網頁爬蟲。

如果你不確定,先從 AI 開始。之後再深入也不遲。

步驟 3:設定並執行你的資料擷取

傳統作法

- 安裝工具: 設定 Python 與必要的函式庫。

- 檢查網站: 使用瀏覽器 DevTools 找出 HTML 結構。

- 撰寫程式: 定義如何定位並擷取每個資料欄位。

- 先測試單一頁面: 確認抓到的是正確資料。

- 擴大範圍: 加入分頁或迴圈,涵蓋更多頁面。

- 匯出資料: 儲存為 CSV 或 JSON。

AI 作法(Thunderbit)

- 安裝 Thunderbit Chrome 擴充功能: 。

- 開啟目標網站: 前往你想抓取的頁面。

- 點擊「AI 建議欄位」: Thunderbit 會讀取頁面並建議欄位。

- 檢查預覽: 確認資料是否正確,必要時調整欄位。

- 點擊「爬取」: Thunderbit 會幫你收集資料。

- 匯出資料: 下載到 Excel、Google 試算表、Airtable 或 Notion。

想看視覺化教學,可以到我們的 看看。

步驟 4:匯出並運用你的資料

拿到資料之後:

- 匯出到你習慣的工具: Excel、Google 試算表、Airtable、Notion、CSV 或 JSON。

- 整合到工作流程: 可用於業務開發、價格分析、市場研究,或任何你的業務需要。

- 清理並驗證: 即使有 AI,還是建議抽樣檢查資料準確性。

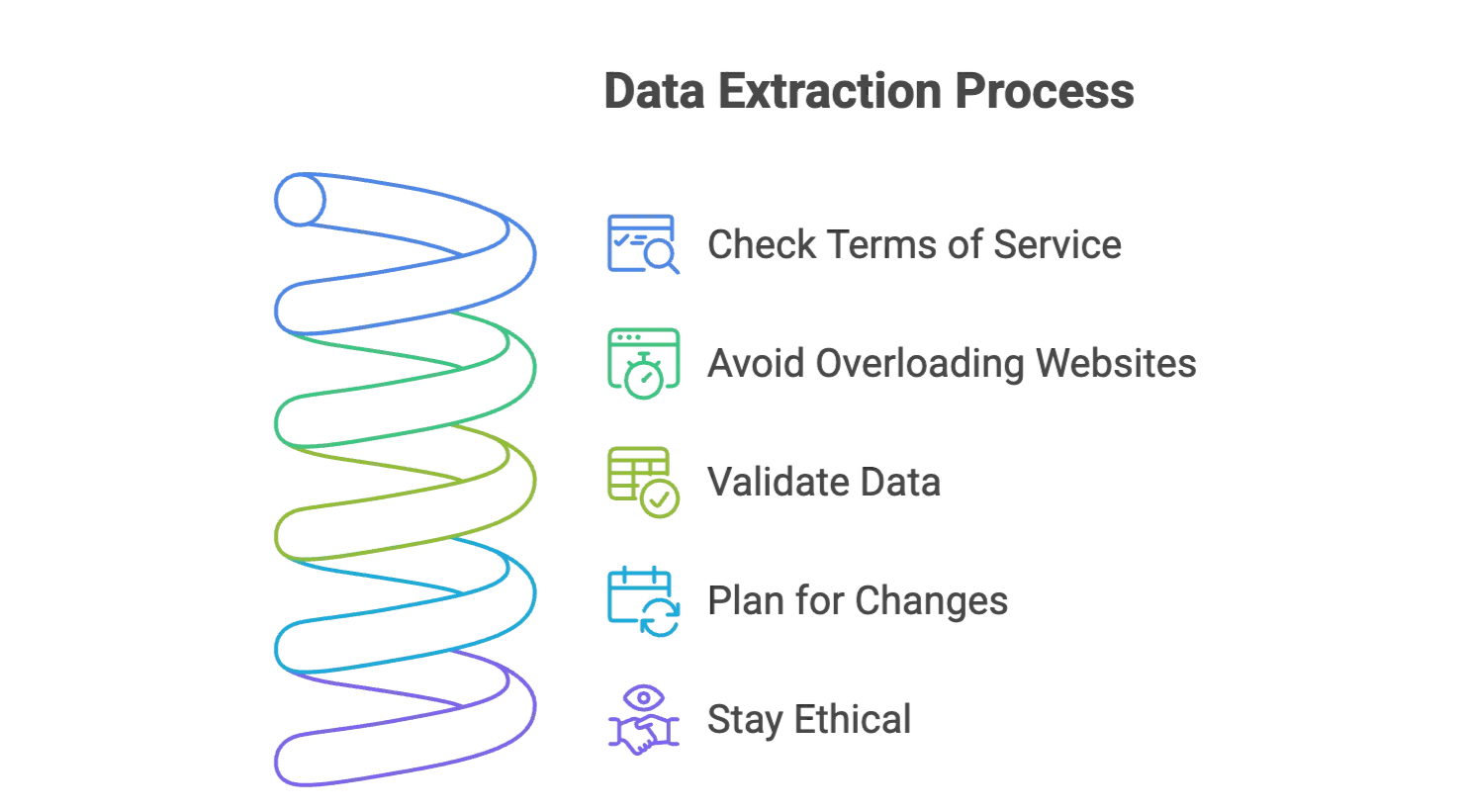

成功擷取資料的技巧:避開常見陷阱

- 確認網站服務條款: 確定你被允許抓取這些資料。請只使用公開資訊,避免敏感個資。

- 不要對網站造成過大負載: 在請求之間加入延遲(傳統工具),或讓 Thunderbit 幫你處理。

- 驗證你的資料: 永遠抽樣檢查結果是否正確。

- 預先考慮變動: 網站常常更新。像 Thunderbit 這樣的 AI 爬蟲會自動適應,但仍建議留意重大變更。

- 保持道德: 只抓你需要的資料,如果將資料用於報告或出版品,也應適當標註來源。

想了解更多技巧,請參考我們的 和 。

結論與重點整理

網頁爬蟲已經走了很長一段路——從手寫程式碼的年代,到今天 AI 驅動、適合初學者的工具。主要差異是什麼?

- 傳統爬蟲 提供更多控制權,但需要寫程式、維護與耐心。

- AI 網頁爬蟲,像 ,讓每個人都能輕鬆擷取資料,具備自然語言指令、即時預覽,以及子頁面與排程爬取等強大功能。

如果你剛接觸網頁爬蟲,不用被嚇到。現在的工具比以往都更容易上手,而且商業價值無可否認。無論你是想開發名單、監控價格,還是只是想停止手動複製貼上,AI 網頁爬蟲都會成為你的新好幫手。

所以,下次當你盯著一大堆網頁資料發愁時,請記得:你不需要電腦科學博士學位,甚至不需要連帽外套。你只需要一個清楚的目標、合適的工具,還有一杯好咖啡。

準備好親自試試了嗎?,看看網頁資料擷取可以多簡單。

想了解更多?歡迎前往 深入閱讀如何抓取 Amazon、Google、PDF 等內容。祝你爬取順利!

常見問題

Q1:網頁爬蟲合法嗎? A:是的,在許多國家,抓取公開資料通常是合法的。不過,還是要確認網站的服務條款,並避免抓取敏感或個人資料。

Q2:我可以抓取需要登入的網站嗎? A:可以,但會更複雜,而且可能違反網站政策。你需要處理 session 或使用具驗證功能的爬蟲工具,同時也要注意相關法律風險。

Q3:如何抓取 JavaScript 很重的網站資料? A:使用支援動態渲染的工具,例如 headless browser,或能模擬真人操作並解析 JavaScript 渲染內容的 AI 爬蟲。

Q4:避免被封鎖的最佳做法是什麼? A:使用速率限制、隨機延遲、輪換 user-agent,並避免過於激進地抓取。AI 型爬蟲通常會自動處理這些策略。

延伸閱讀

-

概覽法律指引、產業統計與道德最佳實踐。

-

趨勢、市場成長,以及 AI 在網頁資料擷取中的角色(2024–2025)。

-

了解如何解讀 robots.txt 檔案,以引導符合道德與法律規範的爬取方式。