每一款 AI 網頁爬蟲在產品導覽裡看起來都很厲害。直到你把它丟到一個有 Cloudflare 保護的真實網站,它回傳一個驗證頁,還自信滿滿地告訴你它找到了 47 筆商品列表。

過去幾個月,我一直在為 Thunderbit 團隊評估各種爬蟲工具。我看到社群裡最常見、也最讓人頭痛的問題,就是 demo 表現和正式上線後的穩定性之間,總有一道巨大鴻溝。一位 Reddit 使用者把這件事總結得非常到位:[「什麼工具能在正式環境撐住,什麼工具只是 demo 時能用、兩週後就陣亡?」](https://www.reddit.com/r/WebScrapingInsider/comments/1s4wwwq/how_to_bypass_cloudflare_in_2026/) 只看 web scraping 類別,Capterra 上就列出了[31 款產品](https://www.capterra.com/web-scraping-software/),再加上數十種 Chrome 擴充功能、API 供應商和 actor 市集,選擇過多的悖論確實存在。所以我實測了其中 12 款。

這篇文章會根據正式環境的標準來評估 12 款 AI 網頁爬蟲工具:反機器人處理、擴充性、結構化輸出品質、成本效率、動態網站支援,以及開發者彈性。沒有功能清單式的比較,也沒有行銷截圖。只有 demo 結束後真正能不能用的結果。

為什麼大多數 AI 網頁爬蟲在 Demo 之後就不行了

這個模式其實很可預測。某款工具的行銷網站展示它如何從一個簡單的商品列表頁抓出乾淨的欄位。你安裝後,把它拿去跑一個有防護的電商網站,結果只會得到以下幾種狀況:

- 回傳

200 OK,但內容是一個 Cloudflare 驗證頁,而不是真實資料 - 前 5 頁結果都很乾淨,之後就悄悄失敗,或產生幻覺列資料

- 今天還能完美擷取,網站版面稍微一改,下週選擇器就壞掉

這些都不是邊緣案例,而是常態。

有位實務使用者在 Reddit 上[這樣說](https://www.reddit.com/r/WebScrapingInsider/comments/1smwz9c/how_many_of_you_are_actually_doing_web_scraping/):「爬蟲回傳 200,但裡面是一個 Cloudflare 驗證頁,你的 agent 嘗試推理它、還把內容幻覺出來,而你根本不知道為什麼。」

問題的根源在架構。大多數 demo 展示的是在乾淨公開頁面上的 解析層,但真正的工作常常死在 擷取層。正式網站會加入機器人防護、動態渲染、巢狀詳情頁、無限捲動、登入狀態、地區差異,以及持續變動的版面。

一個工具在產品導覽裡可能很漂亮,但一旦遇到真正的客戶工作流程,還是可能立刻崩潰。

因此,這篇文章不是用功能清單來看每款工具,而是用「是否能上正式環境」的角度來評估。我的六項標準如下:

| 標準 | 為什麼重要 |

|---|---|

| 反機器人 / CAPTCHA 處理 | 受保護網站在擷取品質之前就先失敗了 |

| 超越 demo 的擴充性 | 批次工作與平行執行會揭露營運極限 |

| 結構化輸出品質 | 使用者要的是乾淨的 JSON/CSV,不是還得手動清理的原始 HTML |

| Token / 成本效率 | AI 擷取的成本可能比爬取本身還高 |

| 動態 / JS 密集網站支援 | 現代頁面需要渲染後的 DOM,不是靜態 HTML |

| 無程式碼 vs. API 彈性 | 銷售團隊與資料工程師的需求不同 |

如果您想快速了解過去兩年 web scraping 市場發生了什麼變化,這場 Browserless 的演講很適合當作工具比較前的背景鋪陳。

AI 在爬取流程裡到底幫得上什麼忙,哪些地方幫不上

這個市場長期流傳一個迷思:所謂「AI 網頁爬蟲」就是 AI 能從頭到尾包辦一切。社群的共識其實很清楚:[先爬蟲,後 LLM](https://www.reddit.com/r/webscraping/comments/1mymxs6/tried_ai_for_realworld_scraping_its_basically/)。有位使用者說得很直白:「你是用 AI 讀一張網頁截圖,不是用 AI 來寫爬蟲本身。」

爬取流程可以分成三個不同層次,而 AI 在各層的價值差異非常大:

爬取與擷取:基礎設施層

這一層處理的是請求本身:代理伺服器、無頭瀏覽器、會話管理、CAPTCHA 破解、重試機制。AI 在這裡幾乎幫不上什麼實質忙。您仍然需要代理池、瀏覽器指紋,以及解除封鎖的基礎設施。這也是大多數工具在正式環境裡最先失敗的地方。

解析與擷取:AI 最擅長的地方

一旦拿到乾淨的頁面內容,AI 就很擅長把非結構化 HTML 轉成結構化欄位。以 schema 為基礎的擷取、彈性的欄位偵測,以及不用脆弱 XPath 選擇器就能處理版面差異,正是 AI 在爬蟲中的強項。

後處理:標記、翻譯、分類

擷取完成後,AI 可以進一步把產品分類、翻譯文字、統一電話格式,或摘要描述。這些都很適合 AI,但前提是擷取出來的資料本身就必須正確。

以下是 12 款工具在這三層的分布情況:

| 工具 | 爬取/擷取 | 解析/擷取 | 後處理 | 最佳描述 |

|---|---|---|---|---|

| Thunderbit | 強 | 強 | 強 | 全棧無程式碼 AI 爬蟲 |

| Octoparse | 強 | 中 | 低 | 以規則為主的視覺化爬蟲,搭配雲端基礎設施 |

| Browse AI | 中 | 中 | 中 | 以監控為核心的雲端機器人平台 |

| Firecrawl | 中 | 強 | 低-中 | 給開發者用的擷取 API |

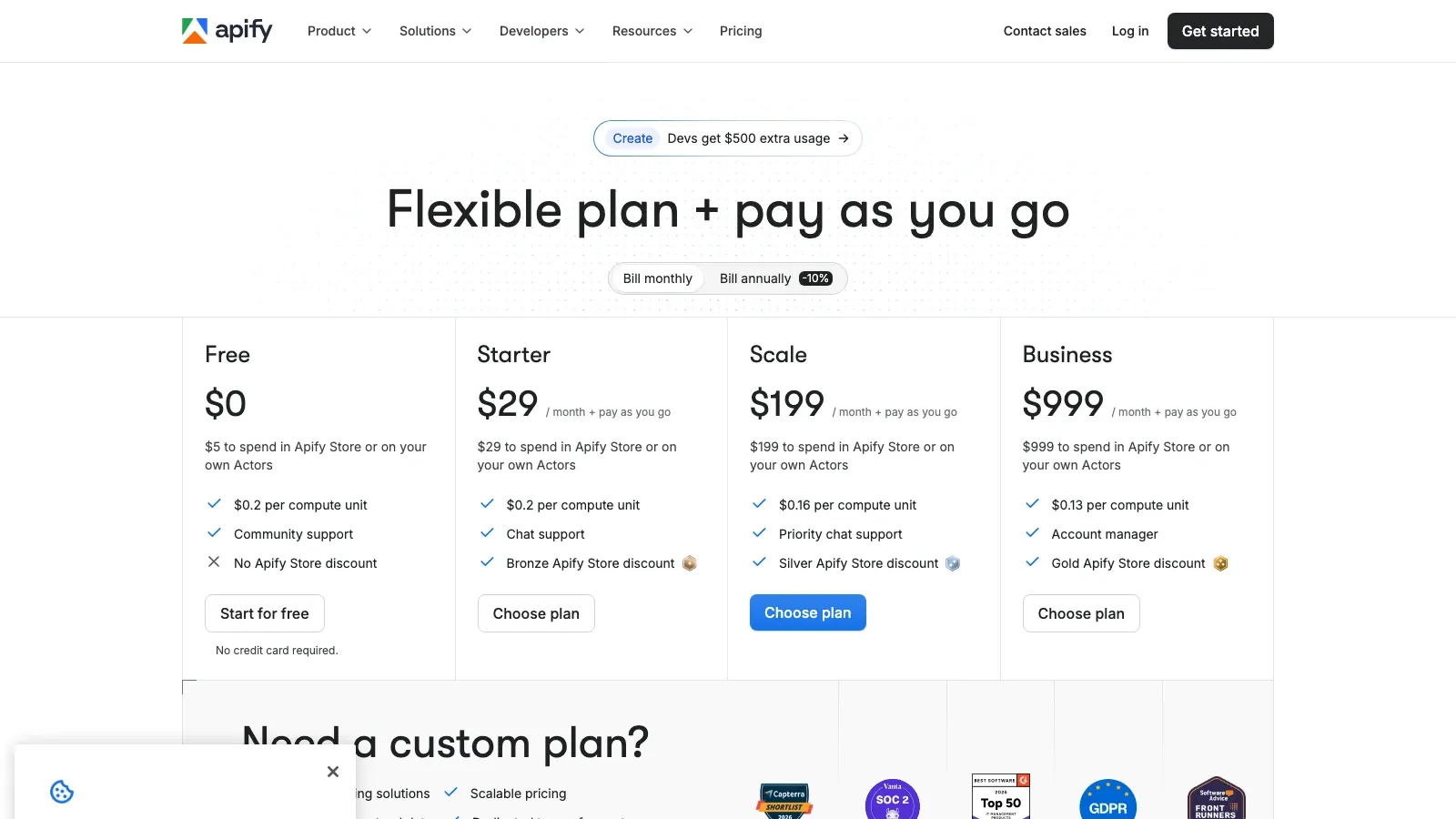

| Apify | 強 | 中-強 | 中 | actor 市集與工作流程編排 |

| Gumloop | 中 | 中 | 強 | 帶有爬蟲節點的工作流程自動化 |

| Bright Data | 很強 | 中 | 低-中 | 企業級基礎設施堆疊 |

| Bardeen | 中 | 中 | 強 | 用於 GTM 工作流程的瀏覽器自動化 |

| Diffbot | 低-中 | 非常強 | 中 | 預訓練擷取加知識圖譜 |

| ScrapingBee | 強 | 低-中 | 低 | 擷取與解除封鎖 API |

| Instant Data Scraper | 低 | 中(簡單頁面) | 低 | 以規則判斷的瀏覽器端快速爬蟲 |

| ParseHub | 中 | 中 | 低 | 用於複雜互動的桌面視覺化爬蟲 |

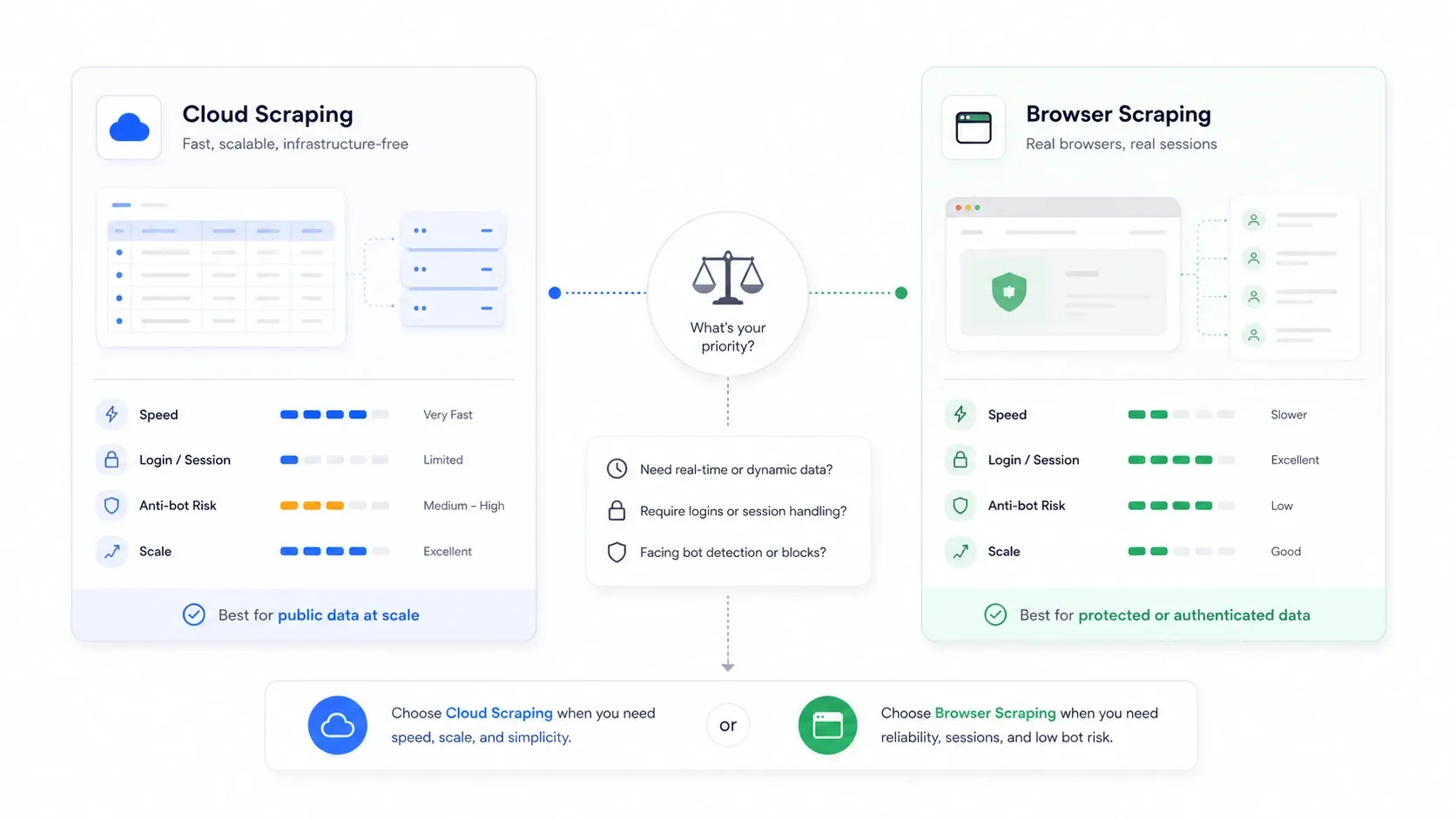

雲端爬取 vs. 瀏覽器爬取:沒人說清楚的選擇

這是多數總整理文章完全忽略的架構決策,而且往往比您選哪一款工具還重要。

雲端爬取是由遠端伺服器代您擷取頁面。瀏覽器爬取則是在您自己的瀏覽器工作階段中進行擷取,使用您的 cookies、您的 IP,以及您已登入的狀態。

| 情境 | 較適合的模式 | 原因 |

|---|---|---|

| 公開電商與列表網站,且規模較大 | 雲端 | 平行化更快,也不受本機效能瓶頸限制 |

| 需要登入或驗證的網站 | 瀏覽器 | 可直接重用您真實的工作階段 cookies |

| 對資料中心 IP 特別敏感的網站 | 瀏覽器 | 看起來像一般使用者流量 |

| 大型、重複性的監控工作 | 雲端 | 更容易排程與持續執行 |

| 一次性、脆弱、又很怕反機器人機制的任務 | 瀏覽器 | 更容易看清網站實際渲染了什麼 |

這在經濟面上也很重要。Apify 的《2026 Web Scraping 現況報告》指出,[65.8% 的從業者提高了代理伺服器使用量](https://blog.apify.com/web-scraping-report-2026/),而且[62% 以上](https://blog.apify.com/web-scraping-report-2026/) 回報基礎設施支出增加。反機器人不只是技術問題,也是預算問題。

大多數工具只提供其中一種模式。以下是整理:

| 工具 | 雲端 | 瀏覽器 | 兩者皆有 |

|---|---|---|---|

| Thunderbit | ✅ | ✅ | ✅ |

| Octoparse | ✅ | ✅(本機) | ✅ |

| Browse AI | ✅ | 僅設定 | — |

| Firecrawl | ✅ | 互動式 API | — |

| Apify | ✅ | ✅(透過 actors) | ✅ |

| Gumloop | ✅ | ✅(Web Agent) | ✅ |

| Bright Data | ✅ | ✅ | ✅ |

| Bardeen | 受限(公開頁面) | ✅ | 部分 |

| Diffbot | ✅ | — | — |

| ScrapingBee | ✅ | — | — |

| Instant Data Scraper | — | ✅ | — |

| ParseHub | ✅(付費) | ✅(桌面版) | ✅ |

12 款 AI 網頁爬蟲一覽

以下是 12 款工具的完整比較:

| 工具 | 最適合 | 免費方案 | 雲端/瀏覽器 | API 存取 | 排程爬取 | 反機器人處理 |

|---|---|---|---|---|---|---|

| Thunderbit | 非技術團隊 | ✅(6 頁) | 兩者皆有 | ✅ | ✅ | 強 |

| Octoparse | 大量範本式爬取 | ✅(受限) | 兩者皆有 | ✅ | ✅ | 中強 |

| Browse AI | 監控變化 | ✅(受限) | 主要為雲端 | ✅ | ✅ | 中 |

| Firecrawl | 開發者擷取流程 | ✅(每月 1,000 credits) | 雲端加瀏覽器 API | ✅ | 否 | 中 |

| Apify | 開發團隊加市集 | ✅($5 免費額度) | 兩者皆有 | ✅ | ✅ | 加強後很強 |

| Gumloop | 工作流程自動化 | ✅(每月 5,000 credits) | 兩者皆有 | ✅ | ✅ | 中等 |

| Bright Data | 企業資料存取 | 試用 / credits | 兩者皆有 | ✅ | 外部整合 | 非常強 |

| Bardeen | 銷售與營運瀏覽器自動化 | ✅(100 credits) | 以瀏覽器為先 | 受限 | ✅ | 中低 |

| Diffbot | 結構化擷取 API | ✅(10,000 credits) | 雲端 | ✅ | 否 | 擷取端低 / 解析端高 |

| ScrapingBee | 開發者擷取與解除封鎖 | ✅(1,000 credits) | 雲端 | ✅ | 否 | 強 |

| Instant Data Scraper | 免費一次性爬取 | ✅(完全免費) | 僅瀏覽器 | 否 | 否 | 低 |

| ParseHub | 複雜視覺流程 | ✅(5 個專案) | 桌面加雲端 | ✅ | ✅(付費) | 中 |

1. Thunderbit

是我們為非技術團隊打造的 AI 網頁爬蟲,專門解決「不寫程式、不管基礎設施,也能拿到正式可用資料」這個需求。核心流程真的只要兩步:AI Suggest Fields 先讀取頁面並提議欄位,接著 Scrape 就會在雲端或瀏覽器模式中執行擷取。

它和其他無程式碼爬蟲最大的不同,在於架構。Thunderbit 把雲端基礎設施、代理輪替、反機器人處理、JavaScript 渲染這些爬取問題,和讀取 HTML 並輸出結構化欄位的 AI 擷取分開處理。這正好符合專家推薦的「先爬蟲,後 LLM」模式,而且包裝成銷售人員與營運經理真的能用的 Chrome 擴充功能流程。

主要優勢

- 同一個介面同時支援雲端與瀏覽器爬取。 可依照目標網站是公開頁面還是需要登入工作階段,在兩種模式間切換。雲端模式可同時處理最多 50 個頁面。

- AI 每次都會重新讀取頁面結構。 不需要維護 XPath。當網站版面更新時,Thunderbit 會在下一次執行時自動適應。

- 子頁面爬取。 AI 會自動造訪連結的詳情頁,並在不需手動設定的情況下補強主要資料表。

- 欄位 AI 提示詞。 可在擷取過程中進行自訂標記、翻譯與分類,而不是另外再做一個後處理步驟。

- 可免費匯出到 Google Sheets、Excel、Airtable 與 Notion。

- 即時爬蟲範本支援 Amazon、Zillow、LinkedIn 等熱門網站。

- 自然語言排程。 只要輸入「每週一上午 9 點爬一次」,系統就會轉成循環排程。

- 開放 API 提供 Distill 與 Extract 端點,可批次處理最多 100 個 URL,且並行數從免費方案的 2 提升到 Pro 1 的 50。

可再改進的地方

- 免費方案刻意設得比較小。

- 無程式碼體驗以 Chrome 擴充功能為中心。想做純 API 工作流程的開發者,仍需另外使用 Open API。

- 如果您的主要需求是純代理基礎設施,而不是擷取,這不是最適合的工具。

價格

提供免費方案。無程式碼方案起價為 年繳每月 9 美元,或 Starter 的 月繳每月 15 美元。API 價格另計:一次性免費 600 單位,之後 Starter API 為 年繳每月 16 美元,Pro 1 API 為 年繳每月 40 美元。請參考[Thunderbit 定價](https://thunderbit.com/pricing) 與[API 定價](https://thunderbit.com/api-pricing)。

最適合: 需要結構化網頁資料,但沒有工程支援的銷售、電商與營運團隊。

2. Octoparse

是一款用於 web scraping 的視覺化流程建構工具,內建大量預製範本。它存在的時間夠久,因此雲端基礎設施相當成熟,對於結構清楚、可預測的網站,也能很好地處理分頁。

主要優勢

- 針對熱門網站提供大量預製爬蟲範本

- 可在雲端擷取並定時執行

- 提供 IP 輪替與 CAPTCHA 破解等付費附加功能

- 高階方案支援 API 存取

可再改進的地方

- AI 能力比起原生 LLM 的工具來得弱。欄位建議仍較依賴範本,而不是自適應讀取。

- 複雜或不尋常的版面,需要在視覺化編輯器裡大量手動調整。

- 一旦需要條件邏輯或反封鎖的替代方案,學習曲線會明顯變陡。

價格

提供永久免費方案。官方說明中心目前顯示 Standard 年繳每月 75 美元起、Professional 年繳每月 208 美元起,但部分在地化頁面與升級路徑顯示更高的月費等價方案。重點是,Octoparse 現在的定價結合了訂閱方案與住宅代理、CAPTCHA 破解等付費附加功能。

最適合: 需要以中等規模爬取結構化、適合範本化的網站的分析與營運團隊。

3. Browse AI

是一個雲端無程式碼平台,主要用來長期監控網站變化,例如競品價格、庫存狀態與內容更新。爬取只是產品的一部分,真正的差異化在於持續監控與警示系統。

主要優勢

- 內建變更偵測與通知

- 無程式碼機器人錄製器,點選即可設定

- 內建熱門網站範本

- 高階方案提供進階代理支援

可再改進的地方

- 基於 credits 的計價,在大規模監控詳情頁時會很快變貴

- 跟 API 優先工具相比,較不適合一次性的大規模擷取

- 反機器人處理屬於中等;某些網站仍需要進階代理或替代方案

價格

提供免費帳號。付費方案大約從 年繳每月 19 美元 的 Starter 開始,之上還有更高的 credits 與監控層級。

最適合: 需要持續監控競品價格、內容變化或庫存狀態的團隊,而不是一次性大量擷取。

4. Firecrawl

是一個以開發者為優先的 API,可將網頁轉成乾淨的 Markdown 或結構化 JSON。它主要位在擷取層,對於建立 RAG 流程、或把網頁內容餵給 LLM 的團隊來說非常好用。

主要優勢

- Markdown 輸出品質很高,適合後續 LLM 工作流程

- 乾淨的 API,包含 scrape、crawl、map、search、extract 與 browser actions

- 支援批次處理

- 並行數從免費方案的 2 提升到 Growth 的 100

可再改進的地方

- 沒有無程式碼介面,需要開發能力

- 內建代理與反機器人支援確實存在,但 Firecrawl 並不是以專門解除封鎖供應商的定位來設計

- 沒有原生排程器處理定期任務

- 對於只想拿到資料表格的非開發者來說,不一定划算

價格

免費方案包含 每月 1,000 credits。付費方案從 年繳每月 16 美元 的 Hobby 起跳,並隨著 credits、並行數與瀏覽器使用量增加而擴充。瀏覽器工作階段會另外以 credits 計費。

最適合: 建立 LLM 流程、RAG 系統或自訂擷取工作流程的開發者,需要從網頁拿到乾淨的 Markdown 或 JSON。

5. Apify

是一個擁有預製爬蟲 actor 市集的平台,也提供建立自訂爬蟲的工具。您可以把它想成一個編排層:挑選或建立某個特定網站的專用爬蟲,然後透過統一的 API 去排程與管理。

主要優勢

- 巨大的 actor 市集,社群已為數百個網站做出爬蟲

- 開發者可用的強大 API 與 SDK

- 內建代理管理與排程

- 可與許多下游工具整合

可再改進的地方

- 一旦離開市集、需要自訂邏輯時,「無程式碼」只算部分成立

- actor 的可靠度取決於社群維護情況

- 價格可能快速上升,因為運算、actor 成本與代理費用會疊加

價格

免費方案包含 每月 5 美元平台 credits。付費方案從 每月 39 美元 的 Starter 開始,更高階方案則偏向擴充型使用。

最適合: 希望用可重複、可排程的爬取流程,並搭配大型預製方案生態系的開發團隊。

6. Gumloop

是一個無程式碼工作流程自動化平台,內含 web scraping 節點。真正的價值不只是爬取本身,而是能把擷取與 LLM、Google Sheets、CRM 和其他工具串成一個視覺化畫布。

主要優勢

- 視覺化拖放式工作流程建構器

- 可把爬取與 LLM 及下游商務工具整合在同一流程中

- 目前公開標示免費方案為 每月 5,000 credits

- 可用時間排程建立重複工作流程

- 基本爬取與互動式 Web Agent 模式可涵蓋簡單與較豐富的流程

可再改進的地方

- 爬取引擎的穩定性不如專門的 AI 網頁爬蟲工具

- 與專門供應商相比,反機器人與代理深度較有限

- 免費方案的並行與觸發限制較緊

- 若把它當成大量爬取的主要工具,並不理想

價格

提供免費方案。Gumloop 在 2025 年底把原本的 Solo 與 Team 架構整併為 Pro 方案,之後的公開說法也更聚焦於更寬鬆的免費 credits 與整合式付費層級,而不是以爬蟲為核心的定價。

最適合: 想把爬取放進更大自動化流程中的團隊:先爬、再分析,最後送進商務工具。

如果您想在看完後面的清單之前,先感受一下 AI 原生的擷取流程實際怎麼運作,這個 Thunderbit 教學是最貼近非技術團隊的產品示範。

7. Bright Data

是這份名單裡最具企業級規格的基礎設施堆疊。如果您的問題是「不管我怎麼試,就是無法突破這個網站的機器人防護」,Bright Data 可能就是答案,但它也伴隨著相應的企業複雜度與價格。

主要優勢

- 業界領先的代理網路,涵蓋住宅、資料中心與行動 IP

- Web Unlocker 可處理反機器人與 CAPTCHA 繞過

- 內建解除封鎖的 Scraping Browser

- 可購買預先收集的資料集

- 透過 API 與 SDK 提供完整程式化控制

可再改進的地方

- 並非為非技術使用者而設計

- 定價反映其企業級定位

- AI 擷取並不是購買這個平台的主要原因

價格

Browser API 採用 每 GB 8 美元起的隨用隨付,更大的月度承諾則會有更低的每 GB 費率。Bright Data 的其他產品,例如 Unlocker、Scraper APIs、資料集與代理池,則各有不同的計價單位。

最適合: 需要大規模爬取高防護網站,且有技術團隊可以管理基礎設施的企業資料團隊。

8. Bardeen

是一款瀏覽器自動化工具,重點放在點擊、表單填寫,以及搭配 AI 資料擷取的爬取能力。更準確地說,它比較像是一個 GTM 工作流程工具,剛好也能爬資料,而不是一個剛好做 GTM 的爬蟲工具。

主要優勢

- 直覺式 playbook 自動化,把爬取當成其中一步

- Bardeen 團隊維護熱門網站的官方爬蟲

- 與 CRM、Google Sheets、Slack 和其他商務工具整合能力強

- 很適合名單爬取、資料補強與 CRM 匯出流程

可再改進的地方

- 以瀏覽器為先的架構,限制了高流量的無人值守爬取

- 雲端爬取只支援公開頁面,不支援有門檻的頁面

- 反機器人處理大多只取決於您當下瀏覽器工作階段能提供什麼

- AI 擷取在複雜或非標準版面上容易失準

價格

免費方案包含 每月 100 credits。公開支援文件提到舊版 每月 15 美元 Pro 價格仍適用於既有使用者,而目前 Bardeen 的商業方案則更偏向企業與工作流程導向,而非傳統低價爬蟲定價。

最適合: 需要把爬取作為更大瀏覽器自動化流程一部分的銷售與營運團隊。

9. Diffbot

使用電腦視覺與 NLP 來像人一樣閱讀網頁,並輸出文章、產品、討論與組織的結構化資料。如果您的頁面類型符合它的預訓練模型,它會是目前最優質的擷取 API 之一。

主要優勢

- 針對文章、產品、討論等提供預訓練擷取模型

- Knowledge Graph 內含數十億實體,可用於資料補強

- 在支援的頁面類型上,結構化輸出品質很高

- 開發者 API 清楚,且有公開的速率限制

可再改進的地方

- 沒有無程式碼介面

- 沒有內建爬取、代理管理或反機器人處理

- 對小型團隊來說價格偏高

- 對非標準頁面類型的彈性不如 schema prompt 型擷取器

價格

免費方案包含 10,000 credits。Startup 為 每月 299 美元、提供 250,000 credits;Plus 則是 每月 899 美元、提供 1,000,000 credits。

最適合: 需要高精準度結構化擷取、頁面類型又屬標準格式,且願意把擷取工作另行處理的開發團隊。

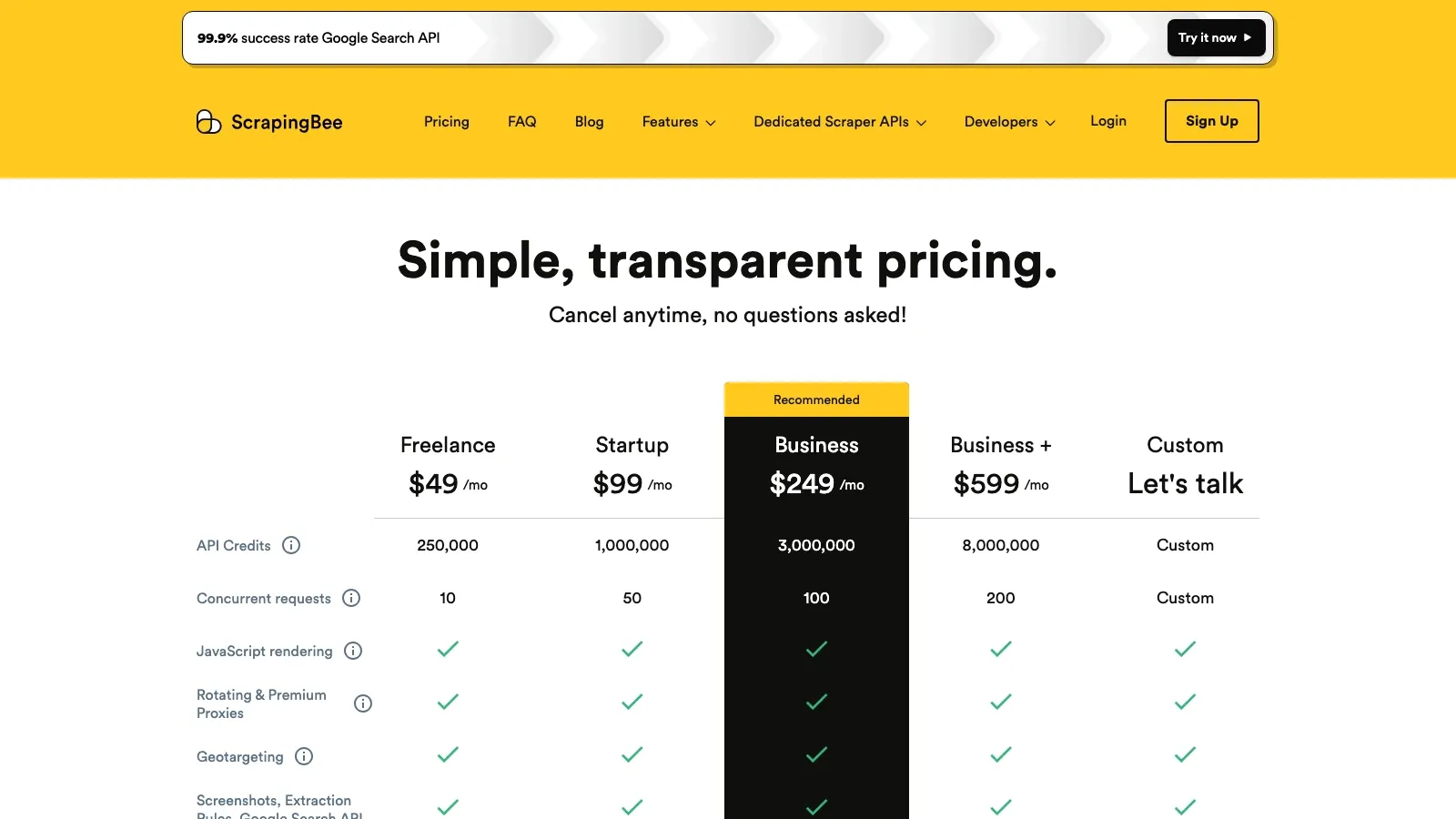

10. ScrapingBee

是一個專注於擷取與解除封鎖層的 web scraping API。您只要送出 URL,它就會處理代理、無頭瀏覽器渲染與反機器人防禦,並回傳 HTML,或選擇性地回傳已擷取的資料。

主要優勢

- 內建代理輪替與反機器人處理

- 支援 JavaScript 渲染

- 簡潔的 REST API

- 提供 Google Search scraping 端點

- 依方案公開並行數

可再改進的地方

- AI 擷取功能較有限

- 沒有無程式碼介面

- 沒有內建排程或監控

- 回傳

200但內容是封鎖頁,有時仍會被算成成功請求

價格

免費方案包含 1,000 API credits。付費方案從 每月 49 美元 起跳,並隨著並行數與請求量增加而擴充。

最適合: 主要需要在反機器人防護後穩定取得頁面,並準備用自己寫的程式或其他工具完成擷取的開發者。

11. Instant Data Scraper

是一款免費的 Chrome 擴充功能,擁有超過 100 萬使用者,可以自動偵測頁面上的資料模式,並讓您匯出成 CSV 或 Excel。它沒有 LLM 意義上的 AI 欄位建議,而是用啟發式模式偵測。

主要優勢

- 完全免費,不需要帳號

- 很多列表頁與表格頁都能一鍵偵測資料

- 某些網站可處理分頁

- 進入門檻極低

- 目前仍持續維護,2026 年也有 Chrome Web Store 更新

可再改進的地方

- 沒有 AI 驅動的欄位建議或資料標記

- 沒有雲端爬取、排程或 API

- 遇到複雜版面、動態內容與 JS 密集網站時表現較差

- 除了瀏覽器本身能讀到的內容外,沒有額外的反機器人處理

- 匯出僅限 CSV 和 Excel

價格

免費。永久免費。

最適合: 任何只需要快速、一次性爬取簡單列表頁,且不想建立帳號或付費的人。

12. ParseHub

是一款桌面應用程式,提供視覺化、點選式介面來建立爬取專案。它可以處理複雜巢狀資料、AJAX 載入內容、無限捲動,以及簡單擴充功能常常漏掉的下拉選單互動。

主要優勢

- 用視覺化選擇器定義擷取規則

- 可處理巢狀資料、下拉選單、無限捲動與 AJAX 內容

- 免費方案最多支援 5 個專案

- 可匯出 JSON、CSV 與 Excel

- 付費方案支援雲端排程與 IP 輪替

可再改進的地方

- 只能用桌面流程,沒有瀏覽器擴充功能的便利性

- 執行速度比雲端原生工具慢

- 因為沒有 AI 重新讀取層,網站版面變動時專案容易失效

- AI 能力有限,整體仍有較舊式視覺爬蟲的感覺

價格

提供免費方案,包含 5 個專案與每次執行 200 頁。付費方案從 每月 189 美元 起跳,包含排程、IP 輪替與更高的限制。

最適合: 需要爬取複雜互動網站,且願意花時間建立視覺化流程的非技術使用者。

如何在 5 個步驟內開始使用 AI 網頁爬蟲

這份清單中的每一款工具都有不同的上手流程。我會以 Thunderbit 當作具體範例,因為它最符合「我只想讓它在真實頁面上正常運作」這個搜尋意圖。

步驟 1:安裝並前往頁面

安裝[Thunderbit Chrome Extension](https://chromewebstore.google.com/detail/thunderbit-ai-web-scraper/hbkblmodhbmcakopmmfbaopfckopccgp),然後前往您想爬取的頁面:商品列表、目錄,或房地產入口網站。

步驟 2:讓 AI 建議資料欄位

點選 AI Suggest Fields。AI 會讀取目前頁面,並提議欄位名稱與資料類型。在商品頁上,它可能會建議產品名稱、價格、評分、圖片網址與描述。

步驟 3:用 AI 提示詞自訂欄位

如果預設欄位不完全符合需求,可以調整欄位。新增欄位 AI 提示詞,做自訂轉換,例如「將描述翻譯成西班牙文」、「分類為電子產品、居家或時尚」,或「只擷取數字價格」。

步驟 4:選擇雲端或瀏覽器模式並開始爬取

公開網站可選雲端爬取,需要登入或防護很強的目標則選瀏覽器爬取。接著點 Scrape。

步驟 5:把資料匯出到任何地方

將結果匯出到 Google Sheets、Excel、Airtable 或 Notion。匯出是免費的。

如果網站版面改了怎麼辦?

這正是 AI 原生擷取器相對於規則式工具的關鍵正式環境優勢。ParseHub 與較舊的 Octoparse 流程等傳統爬蟲,依賴 XPath 選擇器或 CSS 路徑。當網站更新 HTML 結構時,這些選擇器就會失效,您又得回頭手動重新設定。

像 Thunderbit 這類 AI 驅動的擷取器會在每次執行時重新讀取頁面結構。也就是說,不需要維護 XPath,也不必使用脆弱的選擇器。AI 會在下一次執行時自動適應版面變化。

排程爬取與 API 存取:很少人會寫,但真正重要的進階功能

一次性爬取適合研究用途。像價格監控、名單更新與庫存追蹤這類正式使用情境,則需要重複擷取與程式化存取。這些功能正是玩具與工具的分水嶺。

排程支援

| 工具 | 原生排程 | 備註 |

|---|---|---|

| Thunderbit | ✅ | 自然語言設定 |

| Octoparse | ✅ | 雲端排程執行 |

| Browse AI | ✅ | 核心產品功能 |

| Firecrawl | ❌ | 需外部 cron |

| Apify | ✅ | 完整 cron 表達式 |

| Gumloop | ✅ | 以時間為基礎的工作流程觸發 |

| Bright Data | 外部整合 | 通常由客戶系統編排 |

| Bardeen | ✅ | playbook 排程 |

| Diffbot | ❌ | API 優先,需外部編排 |

| ScrapingBee | ❌ | 只有 API |

| Instant Data Scraper | ❌ | 手動瀏覽器工具 |

| ParseHub | ✅(付費) | 高階功能 |

開發者 API 比較

| 工具 | 並行或速率訊號 | 計價模式 |

|---|---|---|

| Thunderbit | 2 → 50 並行 | 基於 credits |

| Firecrawl | 2 → 100 並行 | 基於 credits |

| Apify | 依方案而定 | 運算單位 |

| Gumloop | 依方案限制的工作流程並行 | 基於 credits |

| Diffbot | 每分鐘 5 次 → 每秒 25 次 | 基於 credits |

| ScrapingBee | 10 → 200 並行 | API credits |

| Bright Data | Browser API 標示可無限並行請求 | 以 GB 計費 |

如果您的使用情境更偏技術導向,而且您正猶豫要承擔多少基礎設施,這個 Firecrawl 教學會是上面產品比較的好補充。

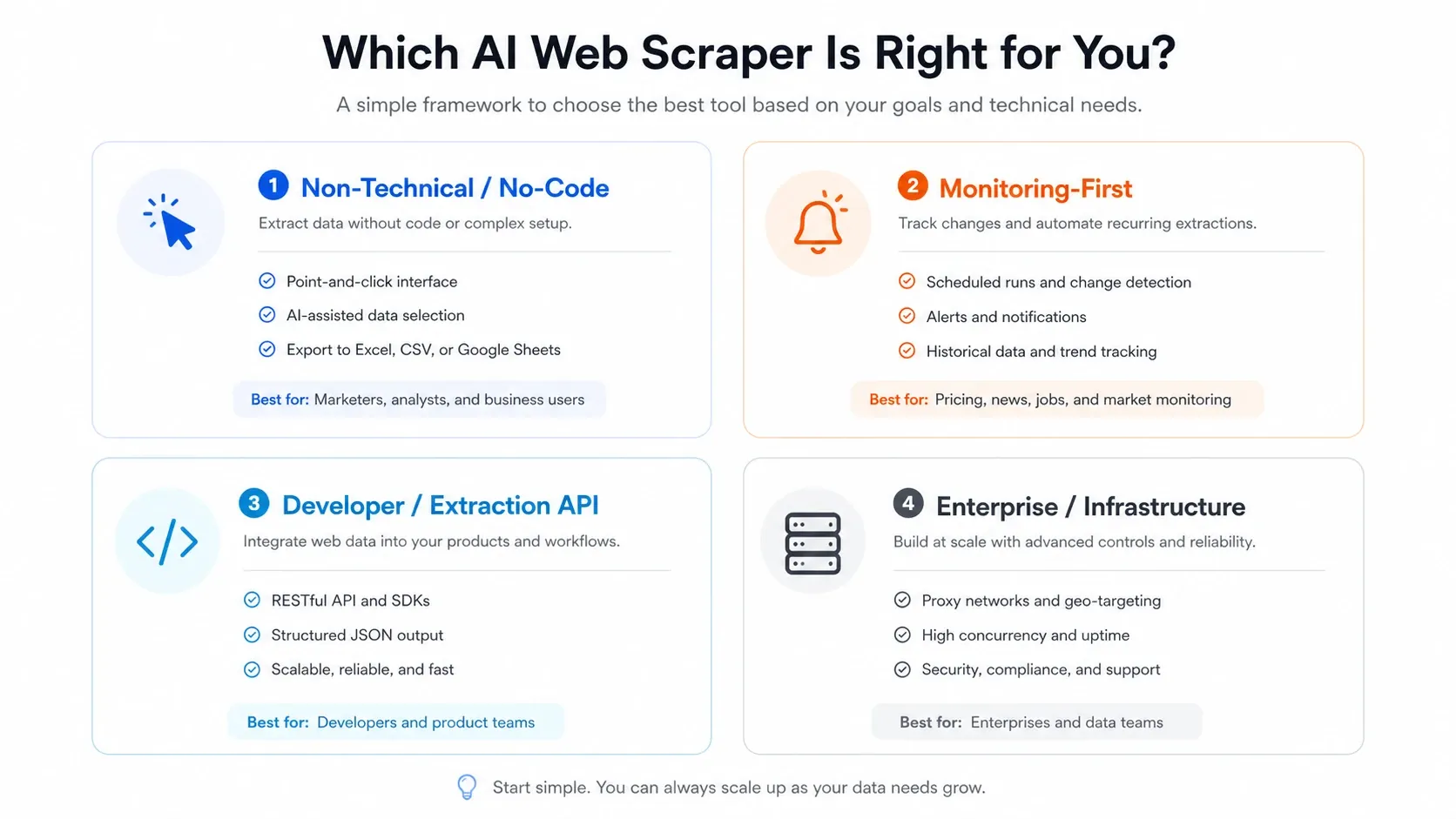

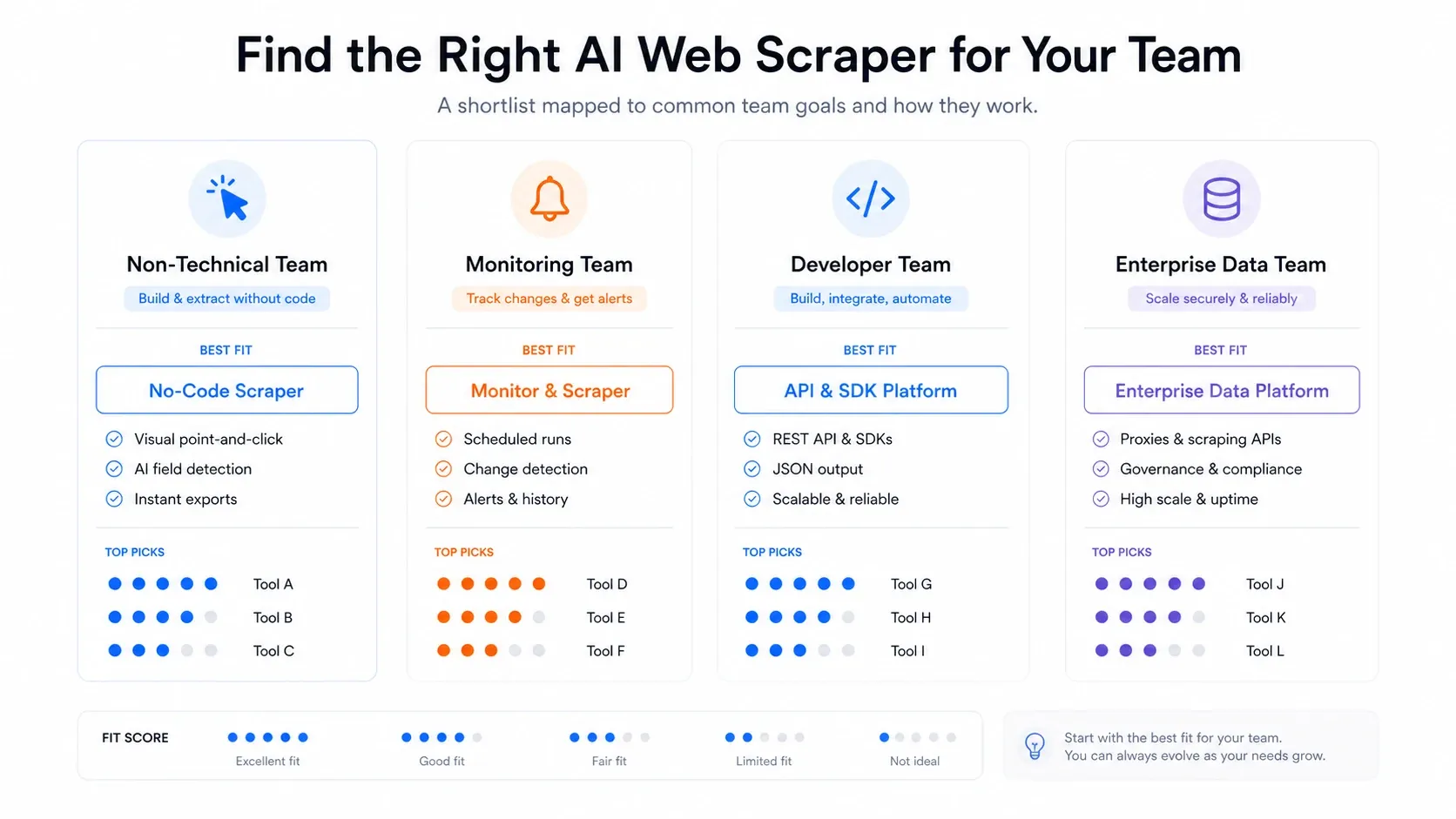

如何選擇最適合的 AI 網頁爬蟲

測試完這 12 款工具之後,我會這樣判斷:

- 非技術團隊,而且要快速拿資料: 先從 Thunderbit 開始。兩步驟流程、免費匯出,以及瀏覽器/雲端切換,已能涵蓋大多數商務爬取需求,不需要工程支援。

- 需要持續監控與警示: Browse AI 是為這件事量身打造的。它不是最強的一次性擷取器,但變更偵測是第一級功能。

- 正在建立 LLM 流程的開發者: 想要 Markdown 或 JSON 擷取可用 Firecrawl;想要預訓練的結構化擷取可用 Diffbot。如果在擷取層也需要嚴格的反機器人處理,再搭配 ScrapingBee 或 Bright Data。

- 需要預製爬蟲市集: Apify 擁有最大的 actor 生態系。不過 actor 壞掉時,請準備好維護工作。

- 企業規模、而且目標網站防護很強: Bright Data。沒有其他工具能在代理基礎設施上與它匹配,但預算與技術人力也要跟上。

- 想把爬取當成更大自動化流程的一部分: Gumloop 或 Bardeen,取決於您是要自動化工作流程,還是以瀏覽器為基礎的 GTM 任務。

- 只需要快速的免費爬取: Instant Data Scraper。零設定、零成本、零複雜度,但也沒有排程、沒有 AI、沒有雲端。

- 帶有下拉選單與 AJAX 的複雜互動網站: ParseHub 仍然比多數擴充功能更能處理,但維護成本確實存在。

結論

2026 年的 AI 網頁爬蟲市場競爭非常擁擠,許多工具在 demo 中看起來很驚艷,實際正式上線卻讓人失望。「行銷截圖能用」與「能在凌晨 3 點、按排程、穩定跑在受防護的電商網站上」之間的差距,正是大多數買家浪費時間與金錢的地方。

這次評估 12 款工具後,最重要的洞察很簡單:擷取層仍然是最難的部分。 AI 在擷取與後處理上很強,但它無法取代代理基礎設施、反機器人處理或會話管理。最好的工具要嘛同時解決兩層問題,例如 Thunderbit 與 Bright Data;要嘛清楚說明自己只處理哪一層,例如 Firecrawl 負責擷取、ScrapingBee 負責抓取。

如果您想在不寫程式的情況下,看看一款可正式上線的 AI 網頁爬蟲長什麼樣子,[不妨試試 Thunderbit](https://thunderbit.com/)。免費方案已足夠讓您在真實頁面上測試完整流程。如果您的需求更偏開發者導向,那就把一個擷取 API 和一個專門的抓取服務搭配起來,免得期待一個工具包辦所有事情,最後卻徒增挫折。

常見問題

為什麼大多數 AI 網頁爬蟲在 demo 很順,到了真實網站卻常常失敗?

Demo 通常只會展示在乾淨、沒有防護的頁面上進行擷取。真實網站會加入 Cloudflare 保護、動態 JavaScript 渲染、分頁、登入需求,以及經常變動的版面。大多數工具在解析與擷取層做得不錯,但缺乏足夠穩健的擷取層基礎設施。

雲端爬取和瀏覽器爬取有什麼差別?我什麼時候該用哪一種?

雲端爬取使用遠端伺服器擷取頁面,因此速度更快、可平行化、也更容易擴充。瀏覽器爬取則在您自己的瀏覽器工作階段中執行,更適合已登入網站或反機器人檢測較強的網站。Thunderbit 是少數能在同一介面提供兩種模式的工具之一。

我可以用 AI 網頁爬蟲做價格監控這類重複任務嗎?

可以,但前提是工具支援排程爬取。Thunderbit、Octoparse、Browse AI、Apify、Gumloop、Bardeen,以及 ParseHub 的付費方案,都提供排程功能。

如果我不會寫程式,哪一款 AI 網頁爬蟲最好?

Thunderbit 對非技術使用者來說,是最快拿到可用資料的方式。Instant Data Scraper 完全免費,但只適合簡單頁面。Browse AI 與 Octoparse 提供視覺化介面,但需要較多設定。ParseHub 很適合複雜互動網站,但學習曲線較陡。

生產等級的 AI 網頁爬蟲到底要花多少錢?

價格區間很大。Instant Data Scraper 免費。Thunderbit、Firecrawl 與 Browse AI 都有免費入門方案與低價付費方案。Octoparse、ParseHub、ScrapingBee 這類中階工具,月費大約落在 49 到 189 美元之間。Bright Data 與 Diffbot 這類企業級方案的起價則高得多。