ผมต้องไล่ตามแหล่งข่าวเกิน 200 เว็บเพื่อหา “บทความที่กำลังมาแรง” แล้วต้องทำมือทั้งหมดเลยเหรอ? บอกตรง ๆ นี่แทบกลายเป็นงานฟูลไทม์ไปแล้ว แถมสแครปเปอร์สายเดิม ๆ ก็พังทุกครั้งที่เว็บขยับเลย์เอาต์นิดเดียว

พอได้ลอง AI article scrapers คือคนละเรื่องเลย คลิกครั้งเดียวก็ได้ข้อมูลที่สะอาดเป็นระเบียบ ไม่ต้องไปยุ่งกับ CSS selectors ให้ปวดหัว ความต่างคือชัดแบบคนละจักรวาล

ถ้าคุณเป็นนักข่าว สาย SEO หรือนักวิจัยที่ต้องดึงบทความจำนวนมาก การเทียบรอบนี้จะช่วยลดเวลาลองผิดลองถูกได้เยอะมาก ผมลองทั้งสแครปเปอร์ no-code แบบดั้งเดิมและแบบขับเคลื่อนด้วย AI — แล้วนี่คือสิ่งที่ “ใช้ได้จริง” ในชีวิตจริง

TL;DR

| ข้อดี | ข้อเสีย | เหมาะกับใคร | |

|---|---|---|---|

| AI Article Scraper | - สแครปได้หลายเว็บไซต์ด้วยความแม่นยำสูง - ตัดส่วนรบกวนออกให้อัตโนมัติ - ปรับตัวตามการเปลี่ยนโครงสร้างเว็บได้ - รองรับคอนเทนต์แบบไดนามิกที่โหลดระหว่างทาง - ต้นทุนการทำความสะอาดข้อมูลต่ำ | - ใช้ทรัพยากรประมวลผลสูงกว่า - ใช้เวลาประมวลผลนานกว่า - บางหน้าต้องช่วยปรับด้วยมือ - อาจกระตุ้นระบบกันสแครปของเว็บ | - สแครปเว็บที่ซับซ้อนหรือไดนามิก (เช่น พอร์ทัลข่าว โซเชียลมีเดีย) - เก็บข้อมูลปริมาณมาก |

| Traditional No-code Article Scraper | - ทำงานเร็ว - ต้นทุนต่ำกว่า - ใช้ทรัพยากรเซิร์ฟเวอร์/เครื่องน้อย - ควบคุมขั้นตอนได้ละเอียด | - ต้องคอยบำรุงรักษาบ่อยเมื่อเว็บเปลี่ยนโครงสร้าง - สแครปหลายเว็บพร้อมกันได้ยาก - รับมือคอนเทนต์ไดนามิกไม่ดี - ต้นทุนทำความสะอาดข้อมูลสูง | - สแครปหน้าเว็บแบบสแตติกที่โครงสร้างง่าย ๆ จำนวนมากแบบเร่งด่วน - เครื่อง/งบจำกัด |

Article Scraper คืออะไร? แล้วทำไม AI Article Scraper ถึงสำคัญ?

คือ ประเภทหนึ่งที่เอาไว้ “ค้นหา + ดึงข้อมูล” จากเว็บข่าว ไม่ว่าจะเป็นชื่อเรื่อง ผู้เขียน วันที่เผยแพร่ เนื้อหา คีย์เวิร์ด รูปภาพ หรือวิดีโอ แล้วจัดให้อยู่ในรูปแบบที่เอาไปใช้ต่อได้ทันที เช่น JSON, CSV หรือ Excel

ฝั่ง ส่วนใหญ่จะพึ่ง เพื่อดึงคอนเทนต์ตามโครงสร้าง ของหน้าเว็บ ซึ่งวิธีนี้มีข้อจำกัดหลัก ๆ ที่เจอบ่อยมาก:

- ใช้ข้ามเว็บไม่ค่อยเวิร์ก: เว็บแต่ละเจ้าหน้าตา/โครงสร้างไม่เหมือนกัน ต้องตั้ง แยกเป็นรายเว็บ และพอเว็บปรับโครงสร้างนิดเดียวก็รวน ต้องตามแก้ตลอด

- คอนเทนต์ไดนามิกเอาไม่อยู่: หลายเว็บโหลดข้อมูลด้วย AJAX หรือ JavaScript ทำให้ ดึงตรง ๆ ไม่ค่อยได้

- ต่อยอดการประมวลผลได้น้อย: สิ่งที่ได้มามักเป็นเศษ ๆ ของ แล้วเรายังต้องมานั่งล้างข้อมูล จัดรูปแบบ ทำความเข้าใจความหมาย หรือทำ sentiment เพิ่มเอง

แล้วตอนนี้ก็เข้าสู่ยุคของ

แล้วตอนนี้ก็เข้าสู่ยุคของ

-

เทคโนโลยีนี้ใช้ LLM เพื่อ “อ่านและเข้าใจ” หน้าเว็บ เลยทำอะไรได้มากกว่าเดิม เช่น:

- รู้จำแบบฉลาด ๆ: แยกชื่อเรื่อง ผู้เขียน สรุป และเนื้อหาหลักได้เป็นชิ้นเป็นอัน

- ตัดสิ่งรบกวนให้อัตโนมัติ: แยกเนื้อหาหลักออกจากเมนู โฆษณา และบทความแนะนำ ทำให้ข้อมูลสะอาดและสแครปได้ลื่นกว่า

- ปรับตัวตามเว็บที่เปลี่ยน: ต่อให้โครงสร้างหรือสไตล์เปลี่ยน AI ก็ยังไปต่อได้ เพราะอิงความหมาย + สัญญาณจากภาพ ไม่ได้ยึดแค่ตำแหน่งใน DOM

- ใช้ข้ามเว็บได้จริง: ต่างจาก ที่ต้องจูนทีละเว็บ AI scrapers มักเอาไปใช้กับหลายเว็บได้ โดยแทบไม่ต้องปรับมือเยอะ

- ผสาน NLP และ Deep Learning: เลยต่อยอดได้อีก เช่น แปลภาษา สรุปความ และวิเคราะห์อารมณ์

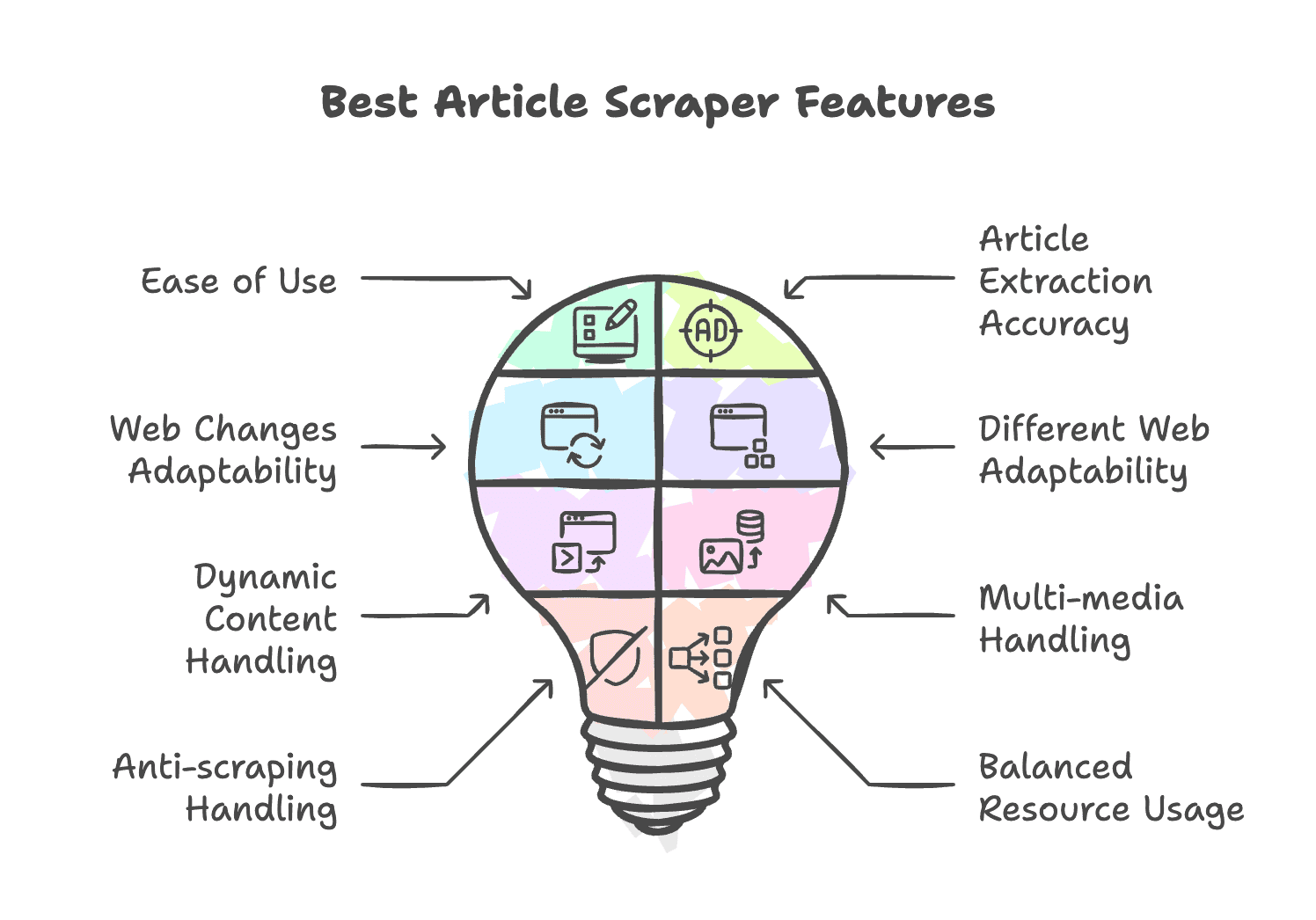

อะไรคือคุณสมบัติของ Article Scraper ที่ดีที่สุดในปี 2026?

เครื่องมือที่ดีควรบาลานซ์ให้ลงตัวระหว่างประสิทธิภาพ ต้นทุน ความง่ายในการใช้งาน ความยืดหยุ่น และการขยายสเกล นี่คือเกณฑ์ที่ผมมองว่าเป็น “ของจริง” สำหรับเลือก article scraper ในปี 2026:

- ใช้งานง่าย: UI เข้าใจง่าย ไม่ต้องเขียนโค้ด

- ความแม่นยำในการดึงบทความ: ดึงเฉพาะข้อมูลที่เกี่ยวข้อง ไม่ลากโฆษณาหรือเมนูมาปน

- ปรับตัวเมื่อเว็บเปลี่ยน: โครงสร้าง/สไตล์เปลี่ยนก็ยังทำงานได้ ลดภาระดูแล

- ใช้ได้กับเว็บหลากหลาย: ไม่ล็อกกับแพตเทิร์นโครงสร้างแบบเดียว

- รองรับคอนเทนต์ไดนามิก: ทำงานกับหน้า JavaScript/AJAX ได้

- รองรับมัลติมีเดีย: รู้จำรูป วิดีโอ และเสียง

- รับมือระบบกันสแครป: เช่น IP rotation, แก้ CAPTCHA และ proxy

- ใช้ทรัพยากรอย่างเหมาะสม: ไม่กินแรม/คอมพิวต์เกินจำเป็น

สรุปเครื่องมือ Article & News Scraper ที่น่าสนใจแบบเร็ว ๆ

| เครื่องมือ | จุดเด่น | เหมาะกับใคร | ราคา |

|---|---|---|---|

| Thunderbit | สแครปด้วย AI; เทมเพลตสำเร็จรูป; รองรับสแครป pdf/รูป/เอกสาร; ความสามารถประมวลผลข้อมูลขั้นสูง | ผู้ใช้ไม่สายเทคนิคที่ต้องสแครปหลายเว็บเฉพาะทาง | ทดลองใช้ฟรี 7 วัน เริ่ม $9/เดือน (รายปี) |

| WebScraper.io | ส่วนขยายเบราว์เซอร์; รองรับคอนเทนต์ไดนามิก; ไม่มีการเชื่อม proxy ในตัว | ผู้ใช้ที่ไม่ได้เจอหน้าเว็บซับซ้อนหรือไม่ต้องการฟีเจอร์ขั้นสูง | ทดลองใช้ฟรี 7 วัน เริ่ม $40/เดือน (รายปี) |

| Browse.ai | no-code web scraper และมอนิเตอร์; มี robots สำเร็จรูป; virtual browser; รองรับหลายวิธีทำ pagination; อินทิเกรตได้ดี | องค์กรที่ต้องสแครปเว็บซับซ้อนในสเกลใหญ่ | $19/เดือน (รายปี) |

| Octoparse | no-code ที่อิง CSS selector; ตรวจจับและสร้างเวิร์กโฟลว์อัตโนมัติ; มีเทมเพลตสแครปบทความ; virtual browser; มีระบบรับมือ anti-scraping | ธุรกิจที่ต้องสแครปเว็บซับซ้อน | เริ่ม $99/เดือน (รายปี) |

| Bardeen | ระบบออโตเมชันเว็บครบเครื่อง; เทมเพลตสำเร็จรูป; no-code scraper; เชื่อมกับเครื่องมือทำงานได้ลื่น | ทีม GTM ที่อยากฝังการสแครปเข้ากับเวิร์กโฟลว์เดิม | ทดลองใช้ฟรี 7 วัน เริ่ม $99/เดือน (รายปี) |

| PandaExtract | UI ใช้ง่าย; ตรวจจับและติดป้ายข้อมูลอัตโนมัติ | ผู้ใช้ที่อยากดึงข้อมูลแบบคลิกเดียว ไม่อยากตั้งค่าซับซ้อน | $49 แบบซื้อขาด |

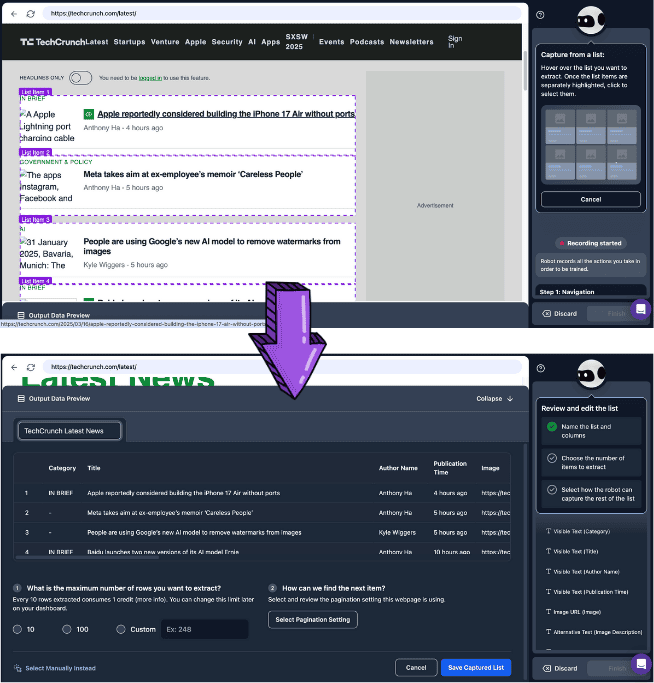

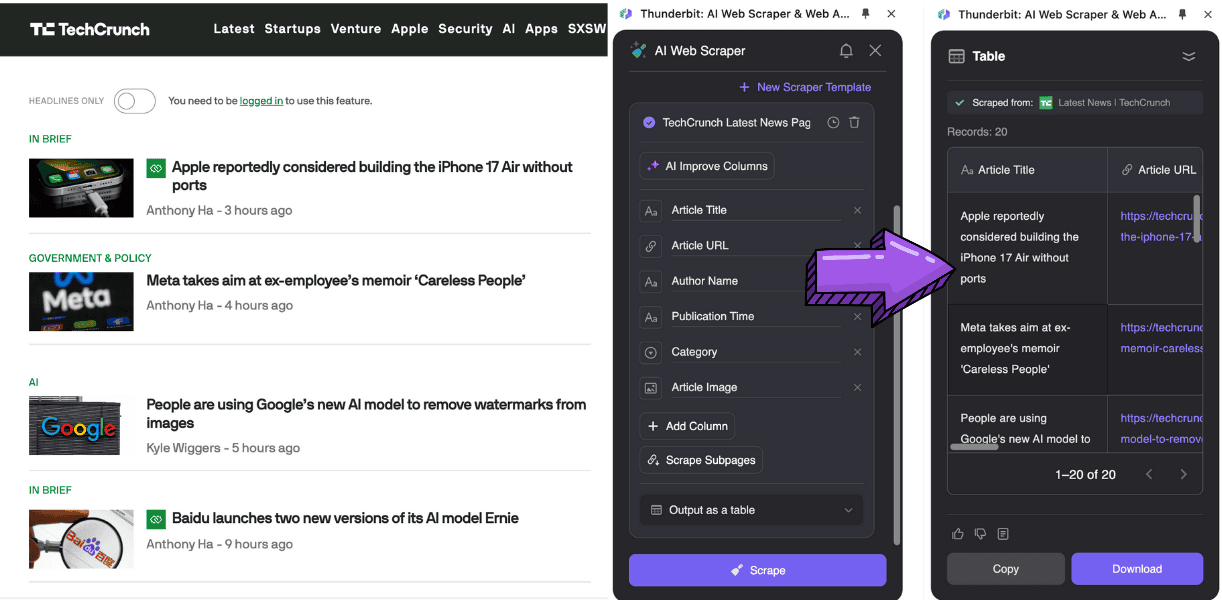

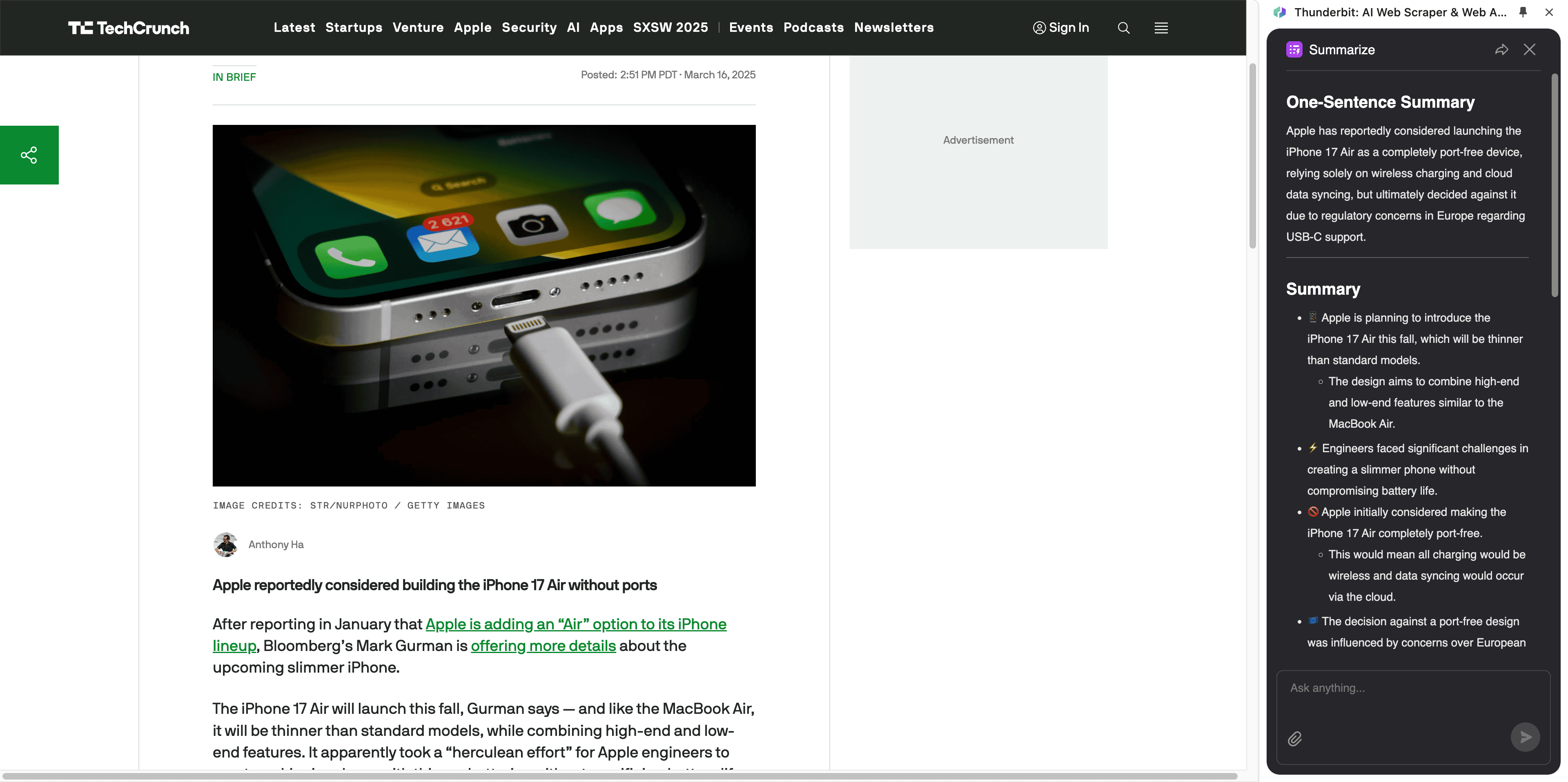

AI Article Scraper ที่ทรงพลังที่สุดสำหรับผู้ใช้สายธุรกิจ

- ข้อดี:

- สั่ง AI ด้วยภาษาคนให้รู้จำและวิเคราะห์ข้อมูลบนเว็บได้เลย ไม่ต้องมานั่งตั้ง CSS selectors

- มี AI ช่วยต่อยอดการวิเคราะห์ เช่น แปลงฟอร์แมต จัดหมวดหมู่ แปลภาษา และติดแท็ก

- มี สำหรับสแครปรายการบทความและเนื้อหาแบบคลิกเดียว

- ข้อเสีย:

- ตอนนี้ใช้งานได้ในรูปแบบ เท่านั้น

- ไม่เหมาะกับงานสแครปข้อมูลขนาดใหญ่มาก ๆ

- ถ้าสแครปหลายหน้าจะช้ากว่า แต่สามารถปล่อยรันเบื้องหลังเพื่อให้ได้ผลลัพธ์ไวขึ้น

AI Article Scraper สำหรับงานระดับองค์กร

Browse.ai

- ข้อดี:

- เป็น no-code สำหรับสแครปและมอนิเตอร์บทความ

- รองรับการทำงานผ่าน virtual browser เพื่อลดโอกาสโดนบล็อก

- มี robots สำเร็จรูปเยอะมาก สแครปแบบคลิกเดียวจาก , , และอื่น ๆ

- อินทิเกรตกับแพลตฟอร์มอย่าง และ ได้ลึก เพื่อทำงานต่อเป็นระบบ

- ข้อเสีย:

- ถ้าจะใช้ deep extract ต้องสร้าง 2 robots ทำให้ขั้นตอนดูซับซ้อนขึ้น

- CSS selectors ยังไม่แม่นพอสำหรับเว็บเฉพาะทางบางประเภท

- ราคาสูง เหมาะกับงานสแครปต่อเนื่องในสเกลใหญ่

No-Code Scraper สำหรับดึงข้อมูลปริมาณไม่มาก

PandaExtract

- ข้อดี:

- อินเทอร์เฟซเป็นมิตร ตรวจจับรายการบทความและหน้ารายละเอียดได้อัตโนมัติ

- ดึงได้ทั้งลิสต์ รายละเอียด อีเมล และรูป เหมาะกับงานสแครปข้อมูลเชิงโครงสร้างขนาดเล็ก

- จ่ายครั้งเดียว ใช้ได้ตลอดชีพ

- ข้อเสีย:

- เป็นส่วนขยายเบราว์เซอร์เท่านั้น รันบนคลาวด์ไม่ได้

- เวอร์ชันฟรีรองรับแค่คัดลอก ไม่รองรับส่งออกเป็น CSV/JSON ฯลฯ

Article Scraper สำหรับองค์กรที่พร้อมใช้ทันที

Octoparse

- ข้อดี:

- no-code ที่มี auto-detect ช่วยรู้จำโครงสร้างเว็บและสร้างเวิร์กโฟลว์สแครปให้

- มีเทมเพลตสแครปบทความสำเร็จรูปจำนวนมาก เปิดใช้ได้เลย

- ใช้ virtual browser พร้อม IP rotation, โซลูชัน CAPTCHA และ proxy เพื่อผ่านระบบกันสแครป

- ข้อเสีย:

- auto-detect ยังยึดตรรกะ CSS selector เป็นหลัก ความแม่นยำอยู่ระดับกลาง

- ฟีเจอร์ขั้นสูงต้องใช้เวลาเรียนรู้และต้องมีทักษะพอสมควร

- ถ้าสแครปสเกลใหญ่ ค่าใช้จ่ายสูง

ระบบออโตเมชันที่ครบที่สุดสำหรับทีม GTM

Bardeen

- ข้อดี:

- no-code article scraper ที่ใช้ LLM ทำออโตเมชันแบบคลิกเดียว

- เชื่อมต่อได้มากกว่า 100 แอป เช่น , , และ

- มีเครื่องมือออโตเมชันเว็บที่แรงสำหรับทำ AI analysis หลังสแครปข้อมูล

- เหมาะกับการฝังการสแครปเข้าเวิร์กโฟลว์เดิมของทีม

- ข้อเสีย:

- พึ่งพา playbooks สำเร็จรูปเยอะ เวิร์กโฟลว์แบบกำหนดเองต้องลองปรับไปเรื่อย ๆ

- แม้เป็น no-code แต่ถ้าตั้งค่าออโตเมชันซับซ้อน ผู้ใช้ไม่สายเทคนิคอาจต้องใช้เวลาเรียนรู้

- การตั้งค่า extract หน้าย่อยค่อนข้างจุกจิก

- ราคาแรงมาก

Article Scraper แบบเบา ๆ สำหรับดึงข้อมูลทันที

Webscraper.io

- ข้อดี:

- no-code แบบ point-and-click ใช้งานง่าย

- รองรับการโหลดคอนเทนต์แบบไดนามิก

- ทำงานบนคลาวด์ได้

- เชื่อมกับ , , และ ได้

- ข้อเสีย:

- ไม่มีเทมเพลตสำเร็จรูป ต้องสร้าง sitemap เอง

- คนที่ไม่คุ้น CSS selectors จะต้องใช้เวลาทำความเข้าใจ

- ตั้งค่า pagination และการดึงข้อมูลจากหน้าย่อยค่อนข้างซับซ้อน

- เวอร์ชันคลาวด์ราคาแพง

ทางเลือกขั้นสูงสำหรับสายวิศวกร

ถ้าคุณมีพื้นฐานเทคนิค ยังมี ให้เลือก ซึ่งโดยมากจะได้ข้อดีประมาณนี้:

- ยืดหยุ่น: เรียก API ตรงเพื่อสแครปแบบคัสตอม รองรับการเรนเดอร์แบบไดนามิกและ IP rotation

- ขยายสเกลได้: ต่อเข้ากับ data pipeline ขององค์กร รองรับงานถี่และปริมาณมาก

- ดูแลง่าย: ไม่ต้องมานั่งบริหาร proxy pool หรือวางกลยุทธ์กันบล็อกเอง ลดภาระงานปฏิบัติการ

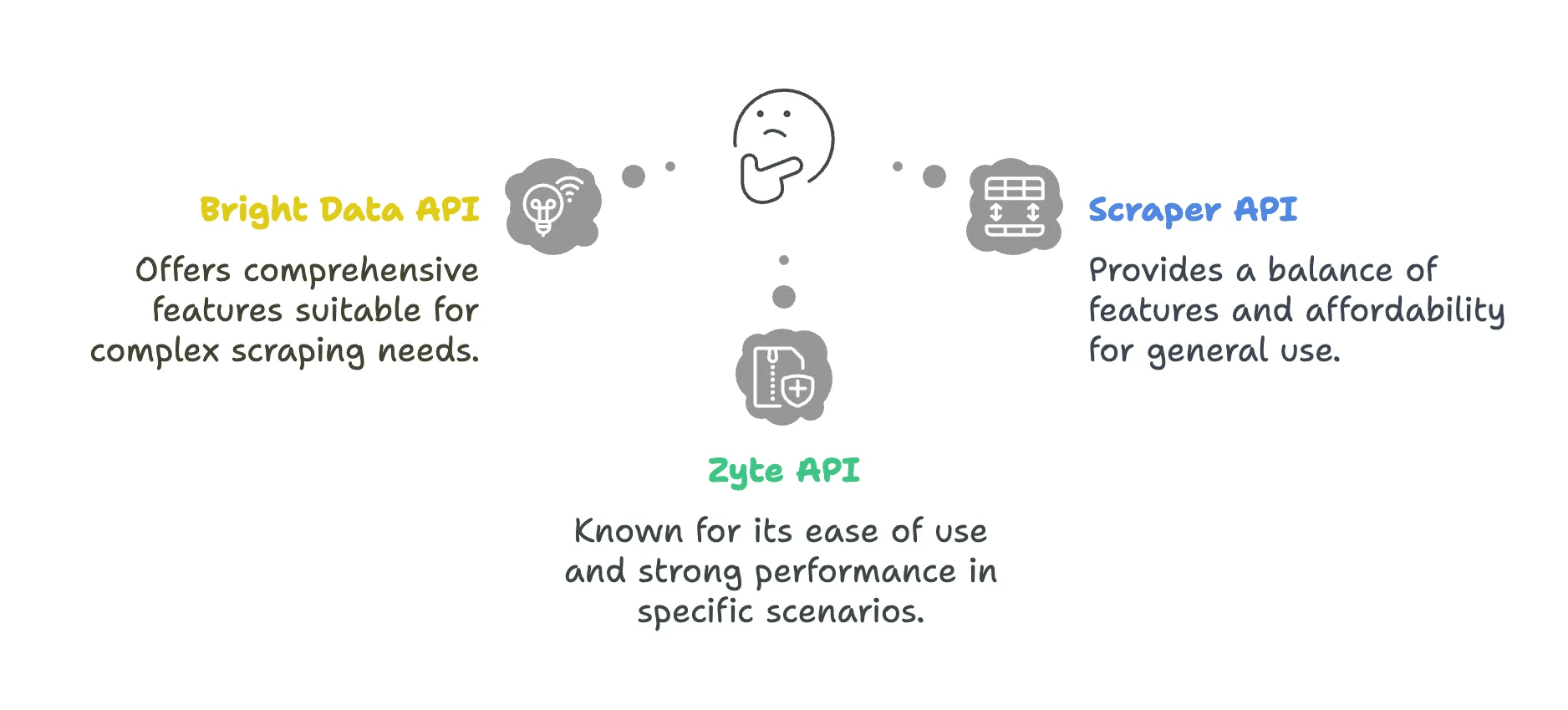

ภาพรวม API ที่น่าสนใจ

| API | ข้อดี | ข้อเสีย |

|---|---|---|

| Bright Data API | - เครือข่าย proxy ขนาดใหญ่ (72M+ IP ครอบคลุม 195 ประเทศ) - ทำ geo-targeting ได้ละเอียดถึงระดับเมือง/ZIP - มี Proxy Manager แข็งแรงสำหรับ IP rotation | - เวลาตอบสนองช้ากว่า (เฉลี่ย 22.08 วินาที) - ราคาสูง ไม่เหมาะกับทีมเล็ก - ตั้งค่าค่อนข้างยาก ต้องมีช่วงเรียนรู้ |

| ScraperAPI | - เริ่มต้นได้ถูกกว่า ($49) - มี Autoparse ช่วยดึงข้อมูลอัตโนมัติ - มี Web UI player สำหรับทดสอบ | - มักคิดเงินแม้คำขอถูกบล็อก - ความสามารถเรนเดอร์ JavaScript จำกัด - ค่าใช้จ่ายอาจพุ่งเมื่อใช้พารามิเตอร์พรีเมียม |

| Zyte API | - มีความสามารถ parsing ด้วย AI - ไม่คิดเงินสำหรับคำขอที่ล้มเหลว | - ค่าเริ่มต้นสูง (~$450/เดือน) - เครดิตไม่ยกยอดไปเดือนถัดไป |

- Bright Data Web Scraper API

- ข้อดี:

- ครอบคลุม 195 ประเทศด้วย residential IP มากกว่า 72M รองรับ IP rotation อัตโนมัติและจำลองตำแหน่ง เหมาะกับเว็บที่กันสแครปเข้ม (เช่น , )

- รองรับการโหลดคอนเทนต์แบบไดนามิกด้วย JavaScript และการเก็บ snapshot หน้าเว็บ

- ข้อเสีย:

- ราคาแพง (คิดตาม request และ bandwidth) งานเล็ก ๆ ไม่ค่อยคุ้ม

- ข้อดี:

- Scraper API

- ข้อดี:

- มี proxy ทั่วโลก 40M สลับ data center/residential IP อัตโนมัติ ผ่านการตรวจ Cloudflare ได้ และเชื่อมโซลูชัน CAPTCHA ภายนอก (เช่น )

- มี structured endpoints และ asynchronous scrapers ช่วยให้สแครปได้เร็วขึ้น

- ข้อเสีย:

- เรนเดอร์หน้าไดนามิกมีค่าใช้จ่ายเพิ่ม และรองรับเว็บ AJAX ซับซ้อนได้จำกัด

- ข้อดี:

- Zyte API

- ข้อดี:

- ดึงข้อมูลเว็บอัตโนมัติด้วย AI ไม่ต้องพัฒนา/ดูแลกฎการดึงข้อมูลแยกตามเว็บ

- ราคาแบบจ่ายตามการใช้งาน ยืดหยุ่น

- ข้อเสีย:

- ฟีเจอร์ขั้นสูง (เช่น session handling, scriptable browser) ต้องใช้เวลาเรียนรู้

- ข้อดี:

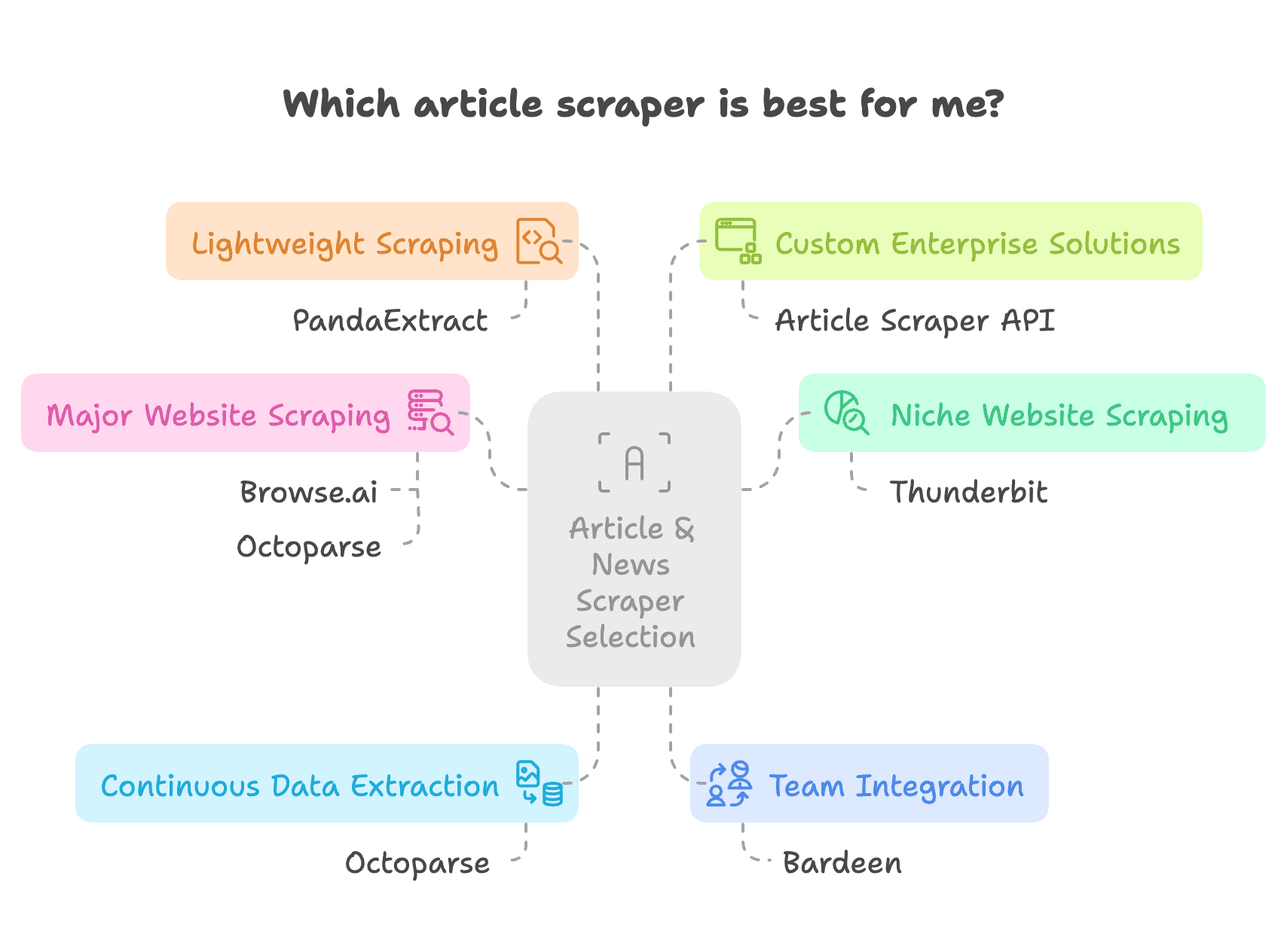

จะเลือก Article & News Scraper อย่างไรดี?

ตอนเลือกเครื่องมือสแครปบทความ/ข่าว ให้ยึดจากโจทย์ธุรกิจ พื้นฐานเทคนิคของทีม และงบประมาณเป็นหลัก

- ถ้าคุณต้องสแครปเว็บเฉพาะทางหลายแห่ง แต่ไม่อยากสร้างสแครปเปอร์แยกทีละหน้า และมีงบ คือคำตอบที่เหมาะที่สุด เพราะไม่ต้องพึ่ง แต่ใช้ AI วิเคราะห์โครงสร้างเว็บ และยังทำ AI analysis ต่อหลังสแครปได้ สำหรับ Thunderbit AI ทุกเว็บ “หน้าตาคล้ายกัน” เลยดึงบทความได้แม่น

- ถ้าจะสแครปข่าว/บทความจากเว็บใหญ่ ๆ อย่าง หรือ ควรเลือกเครื่องมือที่กันบล็อกได้แข็งและมีเทมเพลตพร้อมใช้ เช่น Browse.ai หรือ Octoparse แต่ถ้าพูดถึงความคล่องตัว Chrome Extension อย่าง ก็เด่นมาก เพราะ กระบวนการสแครปจะคล้ายการเปิดเว็บแล้วคัดลอกแบบผู้ใช้จริง ทำให้ใช้ข้อมูลล็อกอินได้โดยไม่ต้องตั้งค่าเยอะ

- ถ้าต้องสแครปต่อเนื่องสเกลใหญ่ เครื่องมือที่มีระบบตั้งเวลา (scheduling) อย่าง Octoparse จะเหมาะกว่า

- ถ้าใช้เป็นทีมและอยากเชื่อมเข้ากับเวิร์กโฟลว์เดิมแบบลื่น ๆ Bardeen จะเหมาะ เพราะเป็นสายออโตเมชันมากกว่าสแครปบทความอย่างเดียว

- ถ้าอยากได้เครื่องมือเบา ๆ ดึงข้อมูลนิดหน่อยแบบไม่ต้องเรียนรู้อะไรเยอะ เลือก point-and-click อย่าง PandaExtract

- ถ้าคุณมีพื้นฐานเทคนิค หรือกำลังทำระบบสแครปบทความระดับองค์กร ให้พิจารณาเครื่องมือ API หรือทำสแครปเปอร์เองควบคู่กับ

สรุป

บทความนี้เล่าทั้งแนวคิดและสถานการณ์ใช้งานของเครื่องมือสแครปบทความ/ข่าว โดย มักยึด เป็นหลัก เลยต้องมีพื้นฐาน และ พอสมควร โดยเฉพาะงานที่ซับซ้อน

ส่วน รุ่นใหม่จะพึ่ง “ความเข้าใจเชิงความหมาย” และการรู้จำจากภาพของ AI เป็นหลัก ทำให้เหนือกว่า ในเรื่องการปรับตัวเมื่อเว็บเปลี่ยน การใช้ข้ามเว็บ การรับมือคอนเทนต์ไดนามิก รวมถึงการล้างข้อมูลและทำ analysis ต่อหลังสแครป

นอกจากนี้ยังรวมเครื่องมือสแครปบทความ/ข่าว 6 ตัว และเครื่องมือ API สำหรับนักพัฒนา พร้อมเทียบข้อดีข้อเสีย ขนาดงานที่เหมาะ คุณสมบัติของเว็บ และกลุ่มผู้ใช้เป้าหมาย สรุปคือ ถ้าจะทำ article & news scraping ให้เลือกโซลูชันที่ตอบโจทย์ธุรกิจ และบาลานซ์ “ประสิทธิภาพ vs ต้นทุน” ให้พอดี

FAQs

1. AI article scraper คืออะไร และทำงานอย่างไร?

- ใช้ AI วิเคราะห์หน้าเว็บและดึงคอนเทนต์ โดยไม่ต้องตั้ง CSS selectors

- ระบุชื่อเรื่อง ผู้เขียน วันที่เผยแพร่ และเนื้อหาหลักได้แม่นยำ

- ตัดโฆษณา เมนูนำทาง และองค์ประกอบที่ไม่เกี่ยวข้องออกอัตโนมัติ

- ปรับตัวตามการเปลี่ยนโครงสร้างเว็บ และใช้ได้กับหลายเว็บไซต์

2. ใช้ AI-powered article scraper ดีกว่าแบบดั้งเดิมอย่างไร?

- ใช้เครื่องมือเดียวสแครปได้หลายเว็บไซต์

- รองรับคอนเทนต์ไดนามิก รวมถึงหน้า JavaScript และ AJAX

- ตั้งค่าน้อยกว่าและดูแลง่ายกว่า scrapers ที่อิง CSS

- มีฟีเจอร์ต่อยอด เช่น สรุปความ แปลภาษา และวิเคราะห์อารมณ์

3. ใช้ Thunderbit ทำ AI article scraping ได้ไหมถ้าไม่เขียนโค้ด?

- ได้ Thunderbit ออกแบบมาสำหรับผู้ใช้ไม่สายเทคนิค ด้วยอินเทอร์เฟซแบบ no-code

- ใช้ AI ตรวจจับและดึงเนื้อหาบทความให้อัตโนมัติ

- มีเทมเพลตสำเร็จรูป ช่วยสแครปได้เร็วและมีประสิทธิภาพ

- ส่งออกข้อมูลได้หลายรูปแบบ เช่น CSV, JSON และ Google Sheets

อ่านเพิ่มเติม: