Представь себе такую картину: понедельник, 8:30 утра, а ты смотришь в таблицу и вручную копируешь названия компаний, email-адреса и телефоны с десятка разных сайтов. И ты не одинок: по данным исследований, более просто на перенос данных из одного места в другое. Я и сам через это проходил, и, честно говоря, это далеко не самый вдохновляющий способ начать неделю. Для отделов продаж всё ещё жёстче: , а более 20% называют это своей главной проблемой в CRM.

Мир крутится на данных, но способы их сбора очень долго оставались на уровне каменного века — до сегодняшнего дня. Благодаря современным инструментам извлечения данных, таким как веб-скраперы и решения на базе ИИ, мы наконец-то выходим из бесконечного copy-paste. В этом гайде я расскажу, что такое извлечение данных на самом деле, почему это важно и как с его помощью превратить часы рутинной работы в минуты полезных инсайтов. Неважно, работаешь ли ты в продажах, e-commerce или операциях — это твой шанс работать умнее, а не больше.

Разберёмся с термином: что такое извлечение данных и зачем оно нужно?

Давай без сложных терминов. Извлечение данных — это по сути аккуратное копирование полезной информации из разных источников и сбор её в единый структурированный список. Представь, что ты собираешь яблоки из разных садов и складываешь лучшие в одну корзину — вот так это и работает.

Если говорить формально, это процесс получения или вытягивания данных из разных источников с последующим преобразованием их в удобный формат для анализа, отчётности или хранения (). Цель простая: вывести разрозненные данные из изолированных хранилищ и собрать их в одном месте, где с ними действительно можно работать.

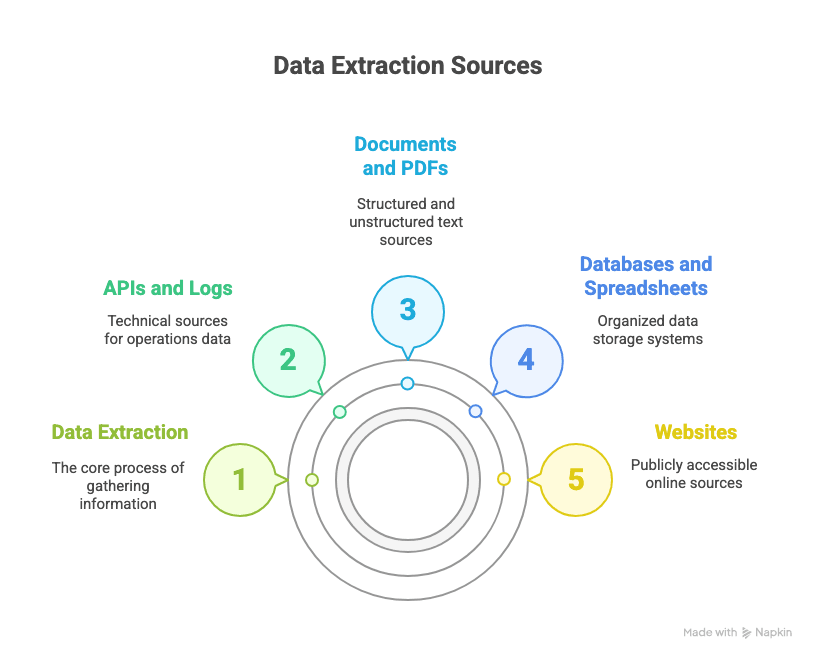

Где происходит извлечение данных?

- Сайты: например, публичные каталоги, карточки товаров или сайты с отзывами.

- Базы данных и таблицы: CRM, ERP или бесконечный Excel-файл.

- Документы и PDF: счета, отчёты, договоры.

- API и журналы событий: для более технических задач — настоящий кладезь операционных данных.

Будь то структурированные данные (например, аккуратные строки в базе) или неструктурированные (например, хаотичный поток постов в соцсетях), извлечение данных — это первый шаг к тому, чтобы во всём этом разобраться. По сути, это «copy-paste на стероидах»: быстрее, точнее и гораздо меньше выматывает.

Почему извлечение данных важно для современного бизнеса

Давай без иллюзий: время — это деньги. Каждый час, который твоя команда тратит на ручную возню с данными, — это час, не потраченный на продажи, стратегию или работу с клиентами. Более того, . Триллион. Да, с буквой «T». Больно.

Но дело не только в экономии времени — речь ещё и о новых возможностях. Вот какую ценность даёт автоматизированное извлечение данных:

| Сценарий | Кому полезно | Как это выглядит |

|---|---|---|

| Генерация лидов | Отделы продаж | Сбор контактной информации из каталогов, LinkedIn или сайтов компаний в готовый список |

| Мониторинг цен и остатков | Ecommerce-команды | Отслеживание цен конкурентов или уровня запасов по сотням SKU без ручных проверок |

| Исследование рынка | Аналитики / маркетинг | Сбор отзывов, постов в соцсетях или характеристик товаров для конкурентного анализа |

| Управление поставщиками | Закупки | Автоматическое отслеживание каталогов поставщиков и обновлений цен |

| Обогащение данных | Все | Добавление дополнительной информации (email, телефоны, адреса), чтобы усилить CRM или базу данных |

И не забывай про точность: при ручном вводе данных ошибка составляет около . Звучит не страшно, пока не масштабируешь это на тысячи строк — и вот уже отдел продаж звонит не туда, а в дашборде цен ошибка на сотни долларов.

Инструменты автоматического извлечения данных не просто экономят время — они помогают избегать дорогих ошибок и принимать более быстрые и качественные решения. Неудивительно, что почти .

Реальные сложности извлечения данных

Если извлечение данных такое полезное, почему же все не используют его уже давно? Потому что старые способы… скажем так, очень закаляли характер.

Вот что обычно шло не так:

- Ручной copy-paste медленный и ошибкоопасный. Даже самый усердный сотрудник начнёт ошибаться после 50-й строки. И, честно говоря, никто не мечтает провести карьеру в роли ниндзя copy-paste.

- Скрипты постоянно ломаются. Технически подкованные специалисты могут писать свои web scraping-скрипты, но сайты любят менять структуру. Один небольшой редизайн — и твой скрипт уже не работает ().

- Каждый сайт устроен по-своему. То, что работает на одном сайте, не сработает на другом. Где-то сложная пагинация, где-то данные спрятаны за кнопками или логином.

- Антибот-защита. Сайты используют CAPTCHA, банят IP и применяют другие методы, чтобы не пустить скраперы ().

- Юридические и комплаенс-риски. Не каждый сайт хочет, чтобы ты забирал его данные, а законы о конфиденциальности вроде GDPR требуют осторожности.

И, пожалуй, самая большая проблема — это разрыв в коммуникации между бизнес-пользователями без технического бэкграунда и ИТ-командами. Я видел, как менеджеры по продажам пытались объяснить разработчику, что именно им нужно, а в итоге получали скрипт, который почти работал — до следующего обновления сайта.

Как работает извлечение данных: от ручного процесса к автоматизации

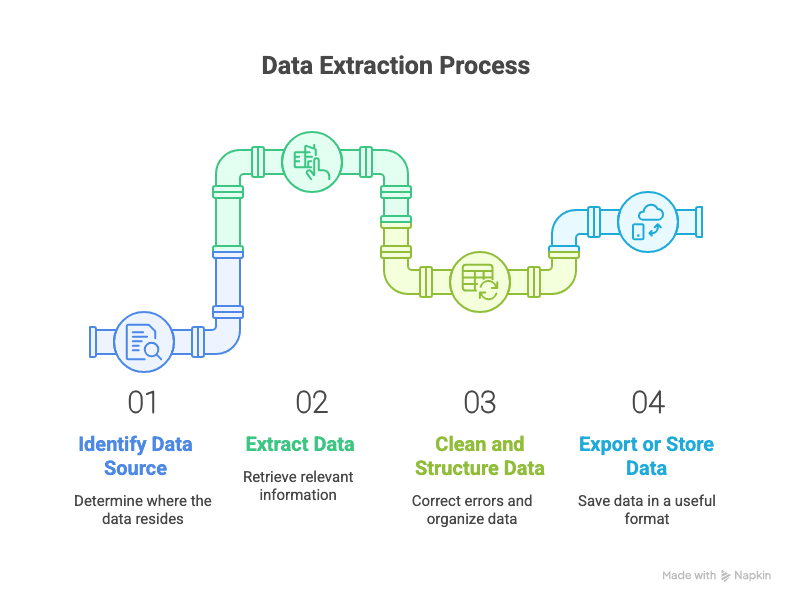

Так как же вообще извлекают данные? Ручным способом или с помощью современных ИИ-инструментов — шаги на удивление похожи:

- Определить источник данных. Где находится информация? (сайт, PDF, база данных и т. д.)

- Извлечь данные. Забрать нужные фрагменты — через копирование, скрипт или специальный инструмент.

- Очистить и структурировать данные. Исправить опечатки, привести форматы к единому виду, удалить дубликаты.

- Экспортировать или сохранить данные. Перенести их в удобное место — Excel, Google Sheets, базу данных и т. д.

Сравним основные подходы:

| Подход | Плюсы | Минусы |

|---|---|---|

| Ручной copy-paste | Под силу каждому | Медленно, много ошибок, не масштабируется |

| Скрейперы на коде | Гибкие, мощные | Требуют программирования, легко ломаются, требуют поддержки |

| No-code / AI web scrapers | Быстрые, удобные, адаптируются к изменениям | Иногда менее гибкие для нестандартных случаев |

Современные инструменты, особенно на базе ИИ, превратили этот процесс в автоматизированный конвейер. Ты просто задаёшь, что нужно получить, а остальное инструмент делает сам — без кода.

Инструменты для извлечения данных: веб-скрейперы, API и не только

На рынке полно инструментов для извлечения данных, но большинство из них можно свести к нескольким категориям:

- Инструменты для веб-скрапинга: основной рабочий вариант для бизнеса. Они собирают данные с сайтов — по сути, это усиленные браузерные расширения или облачные сервисы.

- API и интеграции: если у сайта есть API, используй его. API даёт чистые, структурированные данные и реже ломается.

- Пакетная обработка и ETL-инструменты: подходят для переноса больших объёмов данных между базами или файлами; чаще используются в ИТ и аналитике.

- RPA (Robotic Process Automation): боты, которые имитируют клики и нажатия клавиш. Отлично для устаревших систем, но бывают капризными.

- Ручные инструменты: web import в Excel, функции Google Sheets или браузерные дополнения. Подходят для небольших задач, но не для масштабирования.

Инструменты Web Scraper: делают сбор данных доступным

Веб-скрейперы — это то, что чаще всего выбирают бизнес-пользователи. Они автоматизируют сбор данных с сайтов и превращают часы кликов в минуты результата.

Традиционные web scrapers требуют вручную указывать поля или прописывать правила, что именно извлекать. Если сайт меняется, приходится начинать почти с нуля.

AI web scrapers вроде Thunderbit идут дальше. Ты просто описываешь, что тебе нужно — «собери названия и цены всех товаров с этой страницы» — а ИИ сам разбирается с остальным. Никакой борьбы с HTML или XPath.

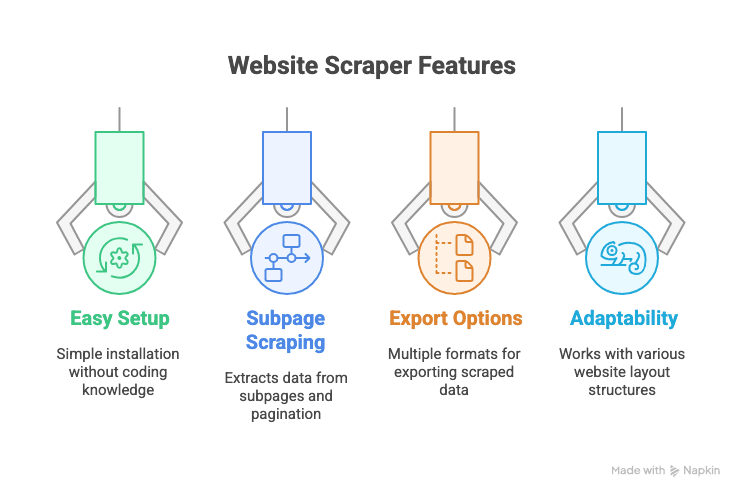

На что стоит смотреть при выборе:

- Простая настройка без кода

- Извлечение с подстраниц и пагинации

- Несколько вариантов экспорта (Excel, Google Sheets, Notion и т. д.)

- Умение адаптироваться к разным макетам сайтов

Thunderbit: извлечение данных на базе ИИ для всех

Я много лет строил SaaS- и automation-инструменты и на практике видел, где большинство решений для извлечения данных не дотягивают: они либо слишком сложные, либо слишком жёсткие, либо слишком медленно адаптируются к реальным бизнес-задачам.

Именно поэтому мы создали — AI web scraper, разработанный специально для бизнес-пользователей без технического бэкграунда. Наша цель? Сделать извлечение данных таким же простым, как заказ еды на дом.

Вот что отличает Thunderbit:

- AI Suggest Fields: просто нажми «AI Suggest Fields», и Thunderbit сам прочитает страницу, предложит самые релевантные столбцы и даже сгенерирует кастомные подсказки для каждого поля. Больше не нужно гадать, какой селектор использовать.

- Извлечение с подстраниц: нужны детали с каждой карточки товара или профиля? Thunderbit автоматически зайдёт на каждую подстраницу и обогатит твою таблицу.

- Поддержка пагинации: будь то кнопка «Next» или бесконечная прокрутка, Thunderbit справится — ты получишь все данные, а не только первую страницу.

- Простой экспорт: отправляй данные напрямую в Excel, Google Sheets, Notion или Airtable. Скачивай в CSV или JSON — как удобно твоему процессу.

- No-code и удобный интерфейс: если ты умеешь пользоваться браузером, ты уже умеешь пользоваться Thunderbit. Технические знания не нужны.

- Облачный или браузерный режим: выбирай, что лучше подходит под задачу — Thunderbit может работать в облаке для скорости или в браузере для сайтов с логином.

И да, мы сделали сервис доступным. На бесплатном тарифе можно извлечь до 6 страниц, а платные планы начинаются всего от $15 в месяц за 500 кредитов. Для большинства небольших команд этого более чем достаточно, чтобы стартовать.

Заинтересовались? Скачайте расширение Thunderbit для Chrome и попробуйте сами.

Thunderbit в действии: реальные сценарии использования

Давай перейдём к практике. Вот как команды используют Thunderbit каждый день:

Продажи: сбор лидов за считаные минуты

Представь, что ты менеджер по продажам и тебе нужно собрать список потенциальных клиентов из отраслевого каталога. Вместо того чтобы часами копировать имена, email и телефоны, ты:

- Открываешь каталог в Chrome.

- Нажимаешь «AI Suggest Fields» в Thunderbit.

- Проверяешь предложенные столбцы (Имя, Email, Телефон, Компания).

- Нажимаешь «Scrape».

- Экспортируешь результат в Google Sheets и начинаешь outreach.

Один из пользователей сказал нам: «Я собрал 200 лидов меньше чем за 10 минут. Раньше на это уходила половина дня!»

Ecommerce: мониторинг цен конкурентов

Менеджерам в e-commerce нужно постоянно следить за ценами конкурентов. С Thunderbit ты можешь:

- Открыть страницу товара конкурента.

- Использовать готовый шаблон или дать ИИ определить поля (Название товара, Цена, Наличие).

- Настроить регулярный сбор данных, чтобы проверять цены каждый день.

- Получать уведомления при изменении цен — без ручных проверок.

Операции: отслеживание каталогов поставщиков

Операционным командам часто нужно держать каталоги поставщиков в актуальном состоянии. Thunderbit помогает:

- Извлекать списки товаров с сайтов поставщиков.

- Экспортировать данные в Airtable или Notion для учёта запасов.

- Настраивать регулярные обновления, чтобы всегда работать с актуальной информацией.

На что смотреть при выборе инструментов для извлечения данных

Не все инструменты для извлечения данных одинаково полезны. Вот что я советую проверять:

- Простота использования: смогут ли начать работу пользователи без технического опыта?

- Поддержка нескольких источников данных: сайты, PDF, изображения, API и т. д.

- Структурированный вывод: аккуратные таблицы, а не хаотичный текстовый дамп.

- Автоматизация и расписание: настроил и забыл — пусть инструмент работает сам.

- Интеграция с бизнес-инструментами: экспорт в Excel, Google Sheets, Notion, Airtable или CRM.

- Масштабируемость: справится ли он с тысячами записей или только с несколькими?

- Точность и надёжность: умеет ли он ловить ошибки и адаптироваться к изменениям?

- Извлечение с подстраниц и пагинации: чтобы не терялись скрытые детали.

- ИИ-помощь: инструмент должен помогать вам, а не наоборот.

И не недооценивай хорошую поддержку и документацию: когда что-то пойдёт не так, помощь нужна быстро.

Лучшие практики для эффективного извлечения и анализа данных

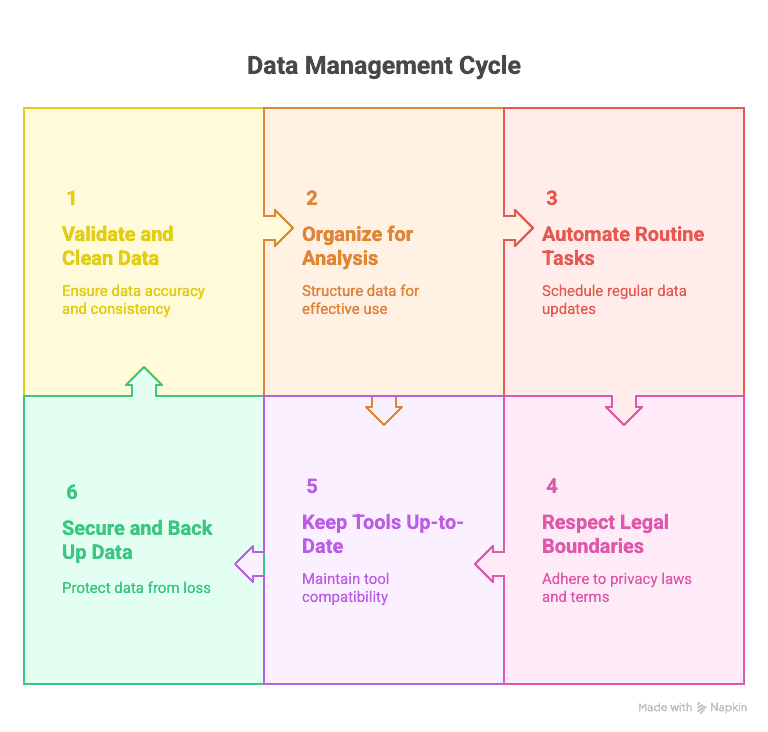

Правильный инструмент — это только половина дела. Вот как выжать максимум из работы с данными:

- Проверяй и очищай данные: всегда ищи ошибки, дубликаты и проблемы с форматами. Что загрузил — то и получил.

- Структурируй для анализа: используй понятные заголовки и единые форматы. Сразу думай, как будешь использовать данные дальше.

- Автоматизируй рутину: настрой регулярный сбор, чтобы данные всегда были свежими.

- Соблюдай юридические и приватные ограничения: перед сбором данных всегда проверяй правила сайта и требования законов о конфиденциальности.

- Обновляй инструменты: сайты меняются — убедись, что твои инструменты успевают за ними.

- Защищай и резервируй данные: не потеряй с трудом добытые инсайты из-за сбоя диска.

Короткий чек-лист после каждого скрейпа: выборочно проверь несколько строк, удали дубликаты, загрузи данные в инструмент анализа и поставь напоминание о следующем обновлении.

Как раскрыть весь потенциал извлечения данных для твоего бизнеса

Подведём итог. Извлечение данных — это не просто модный термин, а практичный и действительно меняющий правила игры инструмент для всех, кто работает с информацией. Неважно, ищешь ли ты лиды, отслеживаешь цены или просто пытаешься навести порядок в данных — правильный инструмент для извлечения может превратить часы рутины в минуты полезных выводов.

И вот моё личное мнение: будущее — за вертикальными AI-агентами. Это инструменты, которые заточены под решение конкретных бизнес-задач, а не просто универсальные чат-боты. Почему? Потому что бизнесу нужны надёжность, повторяемость и масштабируемый результат. Общие AI-агенты отлично подходят для брейншторма или ответов на вопросы, но когда нужно автоматизировать повторяющиеся и критически важные процессы, нужен инструмент, созданный именно под твою работу.

Именно это мы и строим в . Наша миссия — сделать извлечение данных доступным каждому: без кода, без головной боли, только результат. Если ты готов оставить ручной ввод данных в прошлом, попробуй Thunderbit и посмотри, сколько ещё ты сможешь успеть.

Хочешь копнуть глубже? Посмотри другие материалы в , например и .

Работай умнее, а не больше. Инсайты уже есть — теперь у тебя есть инструменты, чтобы быстро их получить и использовать.

P.S. Если тебе когда-нибудь начнёт сниться copy-paste данных, вероятно, пора всё автоматизировать. Или хотя бы устроить себе отпуск. В любом случае, Thunderbit тебя подстрахует.

FAQ

1. Что такое Thunderbit?

Thunderbit — это AI-powered расширение для Chrome, которое позволяет любому извлекать данные с сайтов без программирования. Идеально подходит для команд продаж, маркетинга, e-commerce и операционных задач.

2. Чем он отличается от традиционных скрейперов?

- ИИ автоматически определяет поля

- Поддерживает подстраницы и пагинацию

- Не требует настройки и кода

- Экспортирует данные в Sheets, Excel, Notion и другие сервисы

3. Умеет ли он работать с логинами, PDF и динамическими страницами?

Да.

- Browser Mode: для логинов, PDF и интерактивных страниц

- Cloud Mode: быстрый сбор данных с публичных сайтов

Также поддерживает суммаризацию текста и перевод.