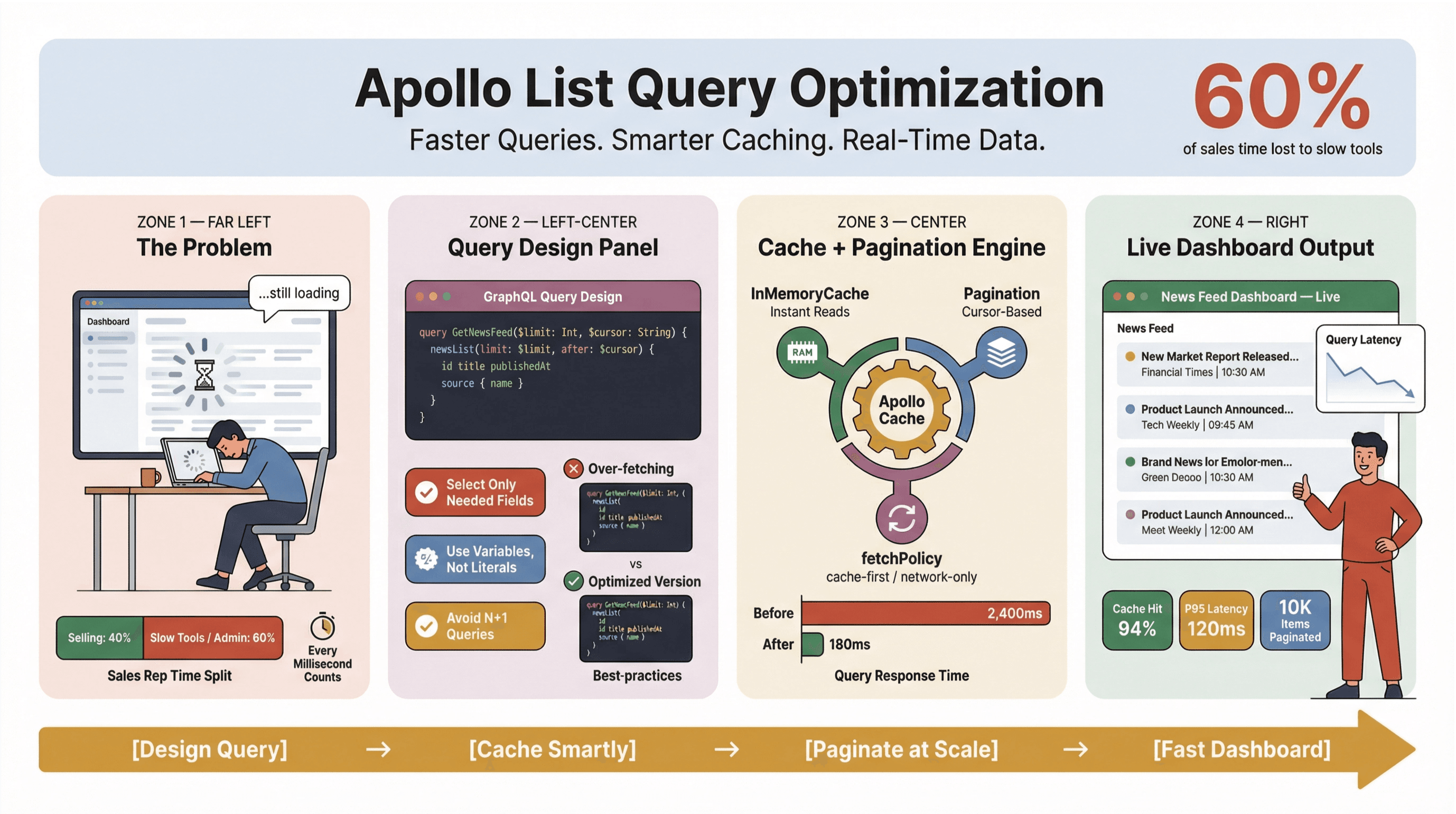

Оптимизация запросов к списки apollo в Apollo — это не какая-то там «технастройка для галочки», а реально жизненно важный скилл для всех, кто живёт на данных из новостей в реальном времени, автоматизированном извлечении новостей или на скоростных процессах продаж и ops. Я не раз видел, как один «тупящий» запрос списка превращает красивый дашборд в 병목: сейлзы смотрят на бесконечные спиннеры, а операционные команды в панике придумывают обходняки в таблицах. В мире, где , важна каждая миллисекунда.

Как сделать так, чтобы запросы списки apollo в Apollo Client летали, не падали и нормально скейлились — особенно если ты парсишь новости, трекаешь лидов или кормишь критичные дашборды? В этом гайде я собрал лучшие практики, которые выработал (иногда — через боль): от проектирования запросов до кэширования, пагинации и даже интеграции no-code инструментов вроде для автоматизации рутинного извлечения новостей. Неважно, кто ты — разработчик, продакт или тот самый человек, которого все тегают, когда дашборд «лагает», — это твой практичный план, как ускорить списки в Apollo GraphQL. И да, если у тебя в голове крутится apollp ai — ниже тоже будет, где это может пригодиться.

Зачем оптимизировать запросы списков Apollo? (apollo client list performance, optimize apollo list queries)

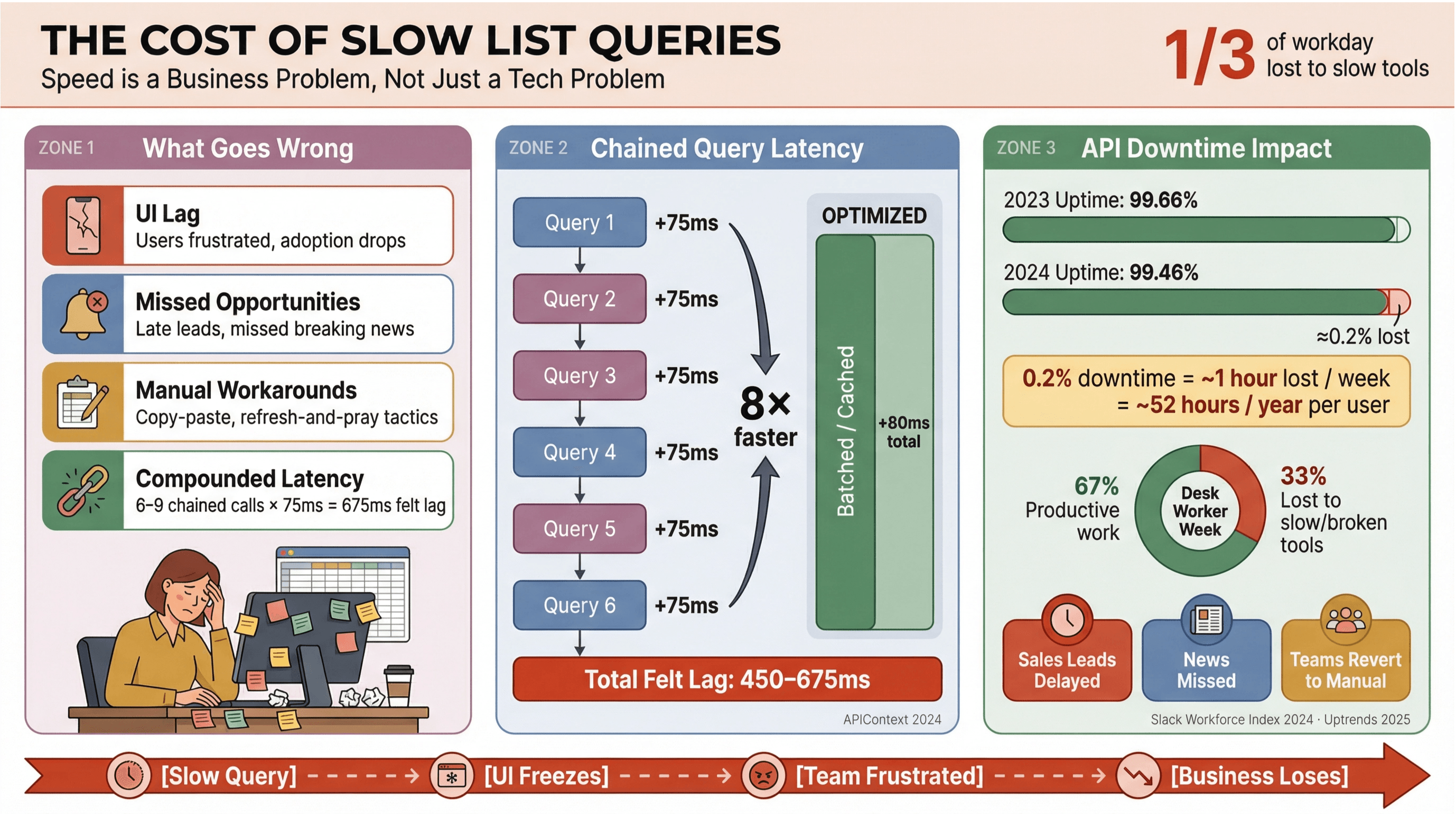

Давай по‑честному: никто не хочет ждать, пока прогрузятся заголовки новостей или список лидов. В бизнесе — особенно там, где важны и real-time данные — медленные запросы списков в Apollo не просто бесят. Они реально стоят денег, тормозят решения и возвращают людей к ручному труду. По данным , офисные сотрудники тратят примерно треть рабочего дня на низкоценные задачи — часто потому что инструменты медленные или разрозненные.

Вот что обычно происходит, когда запросы списков не оптимизированы:

- Лаги интерфейса: задержки раздражают пользователей и режут вовлечённость.

- Упущенные возможности: в продажах или мониторинге новостей даже пара секунд может стоить «горячего» лида или важного инфоповода.

- Ручные костыли: команды возвращаются к копипасту, Excel/Google Sheets или стратегии «обнови и молись».

- Накопленная задержка: каждый медленный API-вызов суммируется — если процесс запускает 6–9 зависимых запросов, даже 75 мс на вызов превращаются в 450–675 мс ощутимой задержки ().

И это не только про скорость. : средний аптайм упал с 99,66% до 99,46% всего за год — а это почти час потерянной продуктивности в неделю для приложений, которые активно гоняют списки. Если твой бизнес завязан на новости в реальном времени, такой риск — вообще не вариант.

Выбор правильной структуры данных и полей (apollo graphql list best practices)

Одна из самых частых ошибок, которую я вижу (и да, я сам так косячил), — относиться к запросу списка как к запросу деталей. В GraphQL ты можешь забирать ровно то, что нужно — так и делай. Overfetching — главный враг перформанса, особенно в инструментах парсинга новостей и real-time дашбордах.

Подбираем поля под автоматизированное извлечение новостей

Представь, что ты собираешь новостную ленту. Нужен ли тебе в запросе списка полный текст статьи, все теги, комменты и биографии авторов? Скорее всего, нет. Сравни:

Эффективный запрос списка:

1query NewsFeed($after: String, $first: Int) {

2 newsFeed(after: $after, first: $first) {

3 edges {

4 cursor

5 node {

6 id

7 title

8 url

9 sourceName

10 publishedAt

11 }

12 }

13 pageInfo { endCursor hasNextPage }

14 }

15}Неэффективный запрос списка (так делать не стоит):

1query NewsFeedTooHeavy($after: String, $first: Int) {

2 newsFeed(after: $after, first: $first) {

3 edges {

4 node {

5 id title url publishedAt

6 fullText

7 summary

8 entities { ... }

9 relatedArticles { ... }

10 }

11 }

12 }

13}Первый запрос — лёгкий и быстрый: идеально для сортировки, фильтров и отрисовки строк. Второй — «детализация под видом списка»: тянет огромные объёмы данных и замедляет всё вокруг (, ).

Совет: используй двухуровневый подход — в списке запрашивай только «лёгкие» поля, а тяжёлые детали (полный текст, NLP-обогащение и т. п.) подгружай, когда пользователь открывает элемент или хотя бы наводит на него.

Используем кэш Apollo Client для ускорения запросов (apollo client list performance)

Кэш Apollo Client — твой скрытый бустер для быстрых списков. Если настроить по уму, он позволяет:

- Мгновенно отдавать повторяющиеся запросы (без походов в сеть)

- Снижать нагрузку на сервер и стоимость API

- Делать навигацию назад/вперёд и смену фильтров плавной

Но кэш — не магия: нужна настройка и дисциплина.

Настраиваем эффективные политики кэширования

Apollo поддерживает несколько :

| Policy | Что делает | Лучший сценарий для новостных списков |

|---|---|---|

| cache-first | Читает из кэша, идёт в сеть только если данных нет | Повторный просмотр списков, смена фильтров, назад/вперёд |

| network-only | Всегда запрашивает из сети | Ручное обновление, «самые свежие заголовки» |

| cache-and-network | Сначала отдаёт кэш, затем обновляет ответом из сети | Быстрый первый рендер + фоновое обновление (идеально для лент) |

| no-cache | Всегда запрашивает и не сохраняет в кэш | Разовые чувствительные запросы (для списков редко) |

Для новостей в реальном времени мне больше всего заходит cache-and-network: юзер сразу видит результат, а потом данные тихо обновляются в фоне. Только следи за «миганием» UI, если при обновлении меняется порядок элементов ().

Подсказки по настройке кэша:

- Используй стабильные идентификаторы (

idили_id) для нормализации (). - Настрой размер кэша и сборку мусора для больших списков ().

- Не складывай огромные ненормализованные «куски» под

ROOT_QUERY— это может подвесить приложение ().

Пагинация и ограничение количества элементов (apollo graphql list best practices)

Если ты пытаешься загрузить сотни или тысячи новостей/лидов за раз — ты сам себе создаёшь проблему. Пагинация — это не только про UX, но и про перформанс.

Apollo поддерживает как , так и пагинацию. Сравнение:

| Тип пагинации | Плюсы | Минусы | Лучше всего подходит для |

|---|---|---|---|

| Offset-based | Просто и быстро внедряется | Возможны пропуски/дубли при изменении данных | Небольшие или «неподвижные» списки |

| Cursor-based | Стабильно при изменениях данных | Чуть сложнее в реализации | Новостные ленты, большие списки |

Для большинства новостных лент и списков лидов в real-time cursor-based пагинация — топовый выбор. Она держит консистентность, даже когда новые элементы прилетают, а старые исчезают ().

Советы по пагинации в Apollo:

- Настрой

keyArgs, чтобы контролировать ключи кэша для пагинируемых полей (). - Реализуй

merge, чтобы страницы корректно склеивались в кэше. - Используй

fetchMore, чтобы подгружать новые страницы, не затирая предыдущие результаты.

Практичные паттерны пагинации для инструментов парсинга новостей

Типичный интерфейс новостного скрейпинга:

- Показывает последние 20–50 заголовков (только лёгкие поля)

- Подгружает дальше по скроллу или по кнопке «следующая страница»

- Детали запрашивает только по необходимости

Так UI остаётся быстрым, API — довольным, а пользователи — продуктивными.

Интеграция Thunderbit для автоматизированного извлечения новостей

Теперь к самому вкусному: откуда вообще берутся структурированные новостные данные? Тут и выручает .

Thunderbit — это no-code AI Web Scraper в формате Chrome-расширения, который умеет вытаскивать заголовки новостей, URL, источники, авторов, даты публикации, короткие выжимки и изображения почти с любого сайта — без кодинга. Я видел, как команды через Thunderbit автоматизируют весь пайплайн извлечения новостей: превращают неструктурированные страницы в чистые структурированные данные, которые можно напрямую отправлять в базу или GraphQL API. Если тебе близка идея apollp ai как «умного слоя» поверх данных — вот это как раз про такой подход: AI помогает быстрее получить нормальные поля, а дальше Apollo уже раздаёт их в продукт.

Как связать Thunderbit и Apollo для новостей в реальном времени

Вот сценарий, который мне особенно нравится для команд продаж и ops, которым нужны актуальные новости (и да, это отлично ложится на миссии apollo по ускорению процессов):

- Слой извлечения: используй шаблон Thunderbit , чтобы по расписанию собирать структурированные данные с нужных сайтов.

- Слой хранения: сохраняй данные в базе, оптимизированной под быстрые выборки.

- Слой GraphQL: отдавай через API поле списка

newsFeedи поле деталейnewsArticle(id). - Клиентский слой: в Apollo Client запрашивай список (лёгкие поля + пагинация), а детали — только по необходимости.

Такой конвейер «собрали → сохранили → запросили» означает, что Apollo всегда работает со свежими и структурированными данными — без ручного копирования и хрупких скриптов.

Бонус: Thunderbit может обогащать списки дополнительными полями (например, тональностью или категорией) благодаря AI-подсказкам полей — и твоя лента становится ещё умнее.

Пошаговый план: оптимизация запросов списков в Apollo

Готов внедрять? Вот мой проверенный чек‑лист оптимизации запросов списки apollo в Apollo:

-

Упрости запросы

- Запрашивай только то, что нужно для отображения списка (заголовок, URL, время и т. п.).

- Тяжёлые поля (полный текст, изображения, обогащение) вынеси в запросы деталей.

-

Добавь пагинацию

- Для больших или динамичных списков используй cursor-based пагинацию.

- Настрой

keyArgsиmerge, чтобы кэш работал корректно.

-

Используй кэш Apollo

- Нормализуй сущности по стабильным ID.

- Выбери подходящую fetch policy (

cache-and-networkотлично подходит для новостей). - Подстрой размер кэша и сборку мусора под твой объём данных.

-

Подключи автоматизированное извлечение

- Автоматизируй парсинг новостей через Thunderbit, чтобы данные всегда были актуальными.

- Экспортируй структурированные данные напрямую в базу или таблицу.

-

Мониторь и устраняй проблемы

- Используй , чтобы анализировать запросы, кэш и производительность.

- Следи за большими записями в кэш, избытком watched queries и «дёрганьем» UI.

- Отслеживай p95/p99 задержки и ошибки (, ).

Мониторинг и диагностика производительности запросов

Devtools от Apollo тут реально спасают. С ними можно:

- Смотреть активные запросы и состояние кэша

- Находить дублирующиеся запросы или слишком много «наблюдателей»

- Выявлять большие кэш‑объекты или проблемы нормализации

Если видишь лаги UI или медленные обновления, проверь:

- Слишком «тяжёлые» запросы списков (урежь поля)

- Плохую нормализацию кэша (почини ID)

- Ошибки слияния страниц (перепроверь

keyArgsиmerge)

И не забывай про tail latency — не только средние значения важны; настоящая боль пользователей обычно прячется в «хвостах».

Сравнение: классический скрейпинг vs AI-подход к извлечению новостей

Раньше сбор новостных данных означал кастомные скрипты, headless-браузеры и надежду, что верстка сайта не поменяется ночью. Сегодня с AI-инструментами вроде Thunderbit можно автоматизировать процесс целиком — без кода и без лишней нервотрёпки.

| Подход | Сильные стороны | Ограничения для бизнес-пользователей |

|---|---|---|

| Скриптовый скрейпинг | Максимальная гибкость, дёшево на масштабе | Высокая поддержка, нужен инженерный ресурс |

| Управляемые платформы скрейпинга | Быстрый старт, антибот-защита на стороне сервиса | Всё равно нужна настройка, стоимость растёт с объёмом |

| AI-извлечение (Thunderbit) | Справляется со «грязной» разметкой, без кода | Нужен контроль качества, интеграция со схемой |

| No-code визуальные скрейперы | Доступно неинженерам | Ломается при изменениях UI, ограничено по масштабу |

| Прокси/антиблок-инфраструктура | Обходит блокировки, поддерживает высокий поток | Всё равно нужна логика извлечения, риски комплаенса |

Юридическая ремарка: сбор публичных данных обычно законен, но всегда соблюдай условия использования и лимиты запросов ().

Главное: лучшие практики для списков в Apollo GraphQL

Подведём итоги:

- Ставь во главу угла скорость и понятность: облегчайте запросы списков, добавляйте пагинацию и активно используйте кэш.

- Структура решает: запрашивай только необходимое, тяжёлые поля переноси в запросы деталей.

- Кэш — твой союзник: нормализация и fetch policies Apollo позволяют отдавать данные почти мгновенно.

- Автоматизируй извлечение: инструменты вроде делают парсинг новостей и обогащение списков доступными каждому.

- Наблюдай и улучшай: Devtools и метрики помогают заранее находить узкие места.

Для команд продаж, ops и новостей это означает меньше ожидания, больше действий — и гораздо меньше сообщений в Slack в стиле «почему всё так медленно?».

Заключение: что делать дальше, чтобы ускорить списки Apollo

Если у тебя до сих пор тяжёлые запросы списки apollo без пагинации или с «недружелюбным» кэшем — самое время сделать аудит и подтюнить. Начни с малого: урежь поля, добавь пагинацию, настрой кэш. Потом переходи на следующий уровень — подключай инструменты автоматизированного извлечения вроде , чтобы данные оставались свежими и пригодными для действий.

Хочешь глубже? Загляни в , почитай или присоединяйся к — там много практики и разборов. А если ты готов автоматизировать извлечение новостей, попробуй шаблон Thunderbit — он реально меняет правила игры для тех, кому нужны данные в реальном времени без головняка.

Удачных запросов — и пусть твои списки грузятся быстрее, чем успевает остыть кофе.

FAQs

1. Почему запросы списков Apollo замедляются в дашбордах продаж или новостей в реальном времени?

Списки начинают лагать, когда запросы тянут слишком много данных, нет пагинации или кэш настроен криво. В сценариях с частыми обновлениями (например, мониторинг новостей) даже небольшие задержки накапливаются, вызывая лаги интерфейса и падение продуктивности.

2. Как лучше структурировать запросы списков Apollo для автоматизированного извлечения новостей?

Запрашивай только поля, нужные для отображения списка (например, заголовок, URL, время публикации). Тяжёлые поля (полный текст статьи, изображения) вынеси в запросы деталей и обязательно используй пагинацию, чтобы ответы оставались компактными и быстрыми.

3. Как кэш Apollo Client ускоряет работу со списками?

Кэш Apollo хранит уже полученные данные и позволяет мгновенно отвечать на повторные запросы. Правильная нормализация и fetch policies (например, cache-and-network) заметно ускоряют списки и снижают нагрузку на сервер.

4. Чем Thunderbit полезен для парсинга новостей и интеграции с Apollo?

Thunderbit — это no-code AI Web Scraper, который извлекает структурированные новостные данные с любого сайта. Его можно использовать для автоматизации сбора новостей, а затем передавать данные в базу или GraphQL API для работы через Apollo Client.

5. Какие инструменты помогут мониторить и отлаживать производительность запросов списков Apollo?

позволяют в реальном времени смотреть запросы, состояние кэша и производительность. Добавь наблюдаемость (например, New Relic или Uptrends), чтобы отслеживать задержки и ошибки, и улучшай дизайн запросов итеративно.

Хочешь больше советов по веб-скрейпингу, автоматизации и потокам данных в реальном времени? Загляни в — там есть разборы, туториалы и свежие материалы про AI‑продуктивность.

Узнать больше