Скажу честно: в первый раз, когда я попытался вытащить все URL с большого сайта, я подумал: «Ну что тут может быть сложного?» Несколько часов спустя я всё ещё переходил по бесконечным страницам, копировал ссылки в таблицу и всерьёз задумывался о своих жизненных решениях. Если вы когда-либо пытались найти все страницы на сайте — для аудита контента, списка лидов или анализа конкурентов — вы знаете, насколько это мучительно. Это нудно, легко ошибиться и, откровенно говоря, пустая трата вашего времени и таланта.

Но есть и хорошая новость: больше не нужно делать это вручную. Инструменты на базе ИИ, такие как , меняют правила игры для бизнес-пользователей и позволяют найти все URL на домене за минуты, а не за дни. Более того, компании, использующие AI-инструменты для web scraping, сообщают о на задачах сбора данных, а некоторые отмечают до по сравнению с ручными методами. Это не просто цифра — это часы, а то и дни, которые возвращаются вам.

Давайте разберёмся, почему найти все страницы на сайте так сложно, почему универсальные ИИ-модели вроде GPT или Claude не могут по-настоящему помочь и как специализированные ИИ-агенты — например, Thunderbit — превращают этот процесс в простую задачу. И да, я покажу вам точные шаги, как извлечь каждый нужный URL, даже если вы не программист.

Почему найти все URL на домене так сложно

Давайте признаем: сайты не создают для вас аккуратный список всех своих страниц. Они сделаны для посетителей, а не для тех, кто пытается найти все страницы на сайте разом. Вот почему эта задача так раздражает:

- Безумие ручного копирования: переходить по каждому меню, списку и каталогу, копируя URL по одному, — прямой путь к туннельному синдрому запястья и пропущенной половине страниц.

- Пагинация и бесконечная прокрутка: многие сайты разбивают контент на несколько страниц или подгружают результаты по мере прокрутки. Пропустили кнопку «Далее» или не доскроллили — и потеряли целые разделы.

- Непоследовательная структура страниц: одни страницы оформляют ссылки одним способом, другие — совсем иначе. Следить за всем этим — кошмар.

- Скрытые или осиротевшие страницы: не каждая страница доступна из главной навигации. Некоторые глубоко спрятаны и открываются только через sitemap или внутренний поиск.

- Человеческий фактор: чем больше страниц нужно копировать, тем выше шанс ошибиться — продублировать URL, опечататься или просто что-то пропустить.

А если речь о сайте с сотнями или тысячами страниц? Можете забыть о ручном подходе. Он просто не масштабируется. Как сказали бы многие data team, если задача выходит за рамки совсем простых случаев, .

Что значит «найти все страницы на сайте»?

Прежде чем переходить к решениям, давайте уточним, что именно мы имеем в виду.

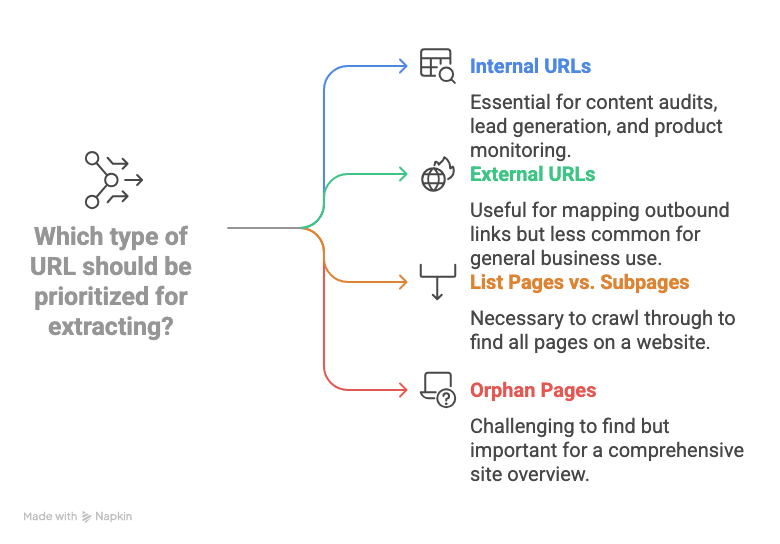

- Внутренние URL: это ссылки на страницы внутри того же домена (например, /about-us или /products/widget-123). Для большинства бизнес-задач — аудита контента, генерации лидов, мониторинга продуктов — именно внутренние URL и нужны.

- Внешние URL: ссылки на другие сайты. Обычно они не нужны, если только вы не строите карту исходящих ссылок.

- Страницы-списки и подстраницы: у многих сайтов есть «хабы» или страницы-списки — например, категории, архивы блога, каталоги, — которые ведут на детальные страницы, например карточки товаров или профили. Чтобы по-настоящему найти все страницы на сайте, нужно пройтись по этим спискам и собрать все связанные с ними подстраницы.

- Осиротевшие страницы: это страницы, на которые нет явных ссылок. Иногда их можно найти через sitemap или внутренний поиск, но их легко упустить.

Так что, когда мы говорим о том, чтобы найти все URL на домене, мы имеем в виду: собрать каждый внутренний URL — от главной страницы до самой глубокой карточки товара или статьи — желательно в удобном для работы формате, например в таблице.

Традиционные способы найти все URL на домене

Есть несколько старых способов справиться с этой задачей, но у каждого свои проблемы:

Ручное копирование и инструменты браузера

Это подход в лоб: нажимать каждую ссылку, копировать каждый URL, вставлять его в таблицу и надеяться, что вы ничего не пропустили. Некоторые используют расширения браузера, чтобы собрать все ссылки с текущей страницы, но затем всё равно приходится повторять это для каждой страницы, а с пагинацией или скрытыми секциями вы остаетесь один на один. Для сайта из пяти страниц это ещё терпимо, но для чего-то большего — уже нет.

Использование поиска по сайту и sitemap

- Поиск Google с оператором site: введите site:yourdomain.com в Google, и вы увидите множество проиндексированных страниц. Но Google показывает только то, что уже проиндексировал (часто с ограничением примерно в 1 000 результатов), поэтому вы пропустите новые, скрытые или некачественные страницы. прямо признаётся, что это не полноценное решение.

- XML sitemap: у многих сайтов есть /sitemap.xml со списком важных URL. Отлично — если sitemap актуален и включает все страницы. Но он есть не у всех, а иногда sitemap разбит на несколько файлов. Осиротевшие страницы часто туда не попадают.

Технические краулеры и скрипты

- SEO-инструменты (например, Screaming Frog): они обходят сайт как поисковая система и выдают список URL. Инструменты мощные, но требуют настройки, конфигурации и иногда платной лицензии для больших сайтов.

- Python-скрипты (например, Scrapy): разработчики могут написать скрипт для обхода и извлечения URL. Но давайте честно: если вы не уверенно пишете код, этот вариант не для вас. К тому же скрипты ломаются при изменении структуры сайта, так что за ними постоянно приходится догонять.

Итог: традиционные методы либо слишком ручные, либо неполные, либо слишком технические для большинства бизнес-пользователей. Не случайно многие бросают это на полпути.

Почему универсальные ИИ-модели не могут полностью автоматизировать извлечение URL

Возможно, вы думаете: «Разве я не могу просто попросить ChatGPT или Claude найти мне все страницы на сайте?» Хотелось бы, чтобы всё было так просто. Но реальность другая:

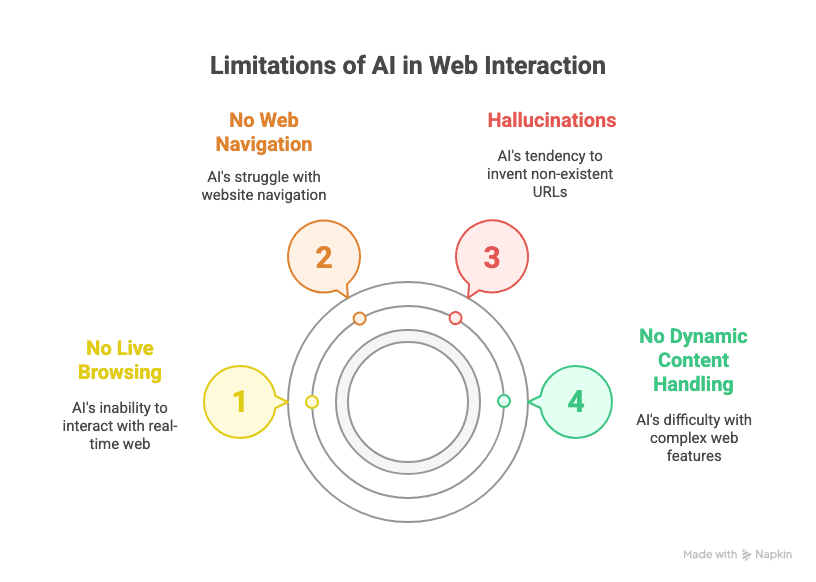

- Нет живого просмотра веба: универсальные ИИ-модели вроде GPT или Claude не могут по-настоящему просматривать интернет в реальном времени. Они не «видят» актуальное состояние сайта — только свои обучающие данные или текст, который вы вставите.

- Нет навигации по вебу: даже с плагинами или включённым browsing LLM не понимают, как нажимать «Далее», обрабатывать бесконечную прокрутку или системно переходить по всем ссылкам на сайте.

- Галлюцинации: попросите универсальный ИИ выдать все URL на домене — и он часто начнёт выдумывать ссылки, которые звучат правдоподобно, но на самом деле не существуют. (Я видел, как он придумывал /about-us для сайтов, у которых такой страницы никогда не было.)

- Не умеет работать с динамическим контентом: сайты, которые загружают контент через JavaScript, требуют входа в систему или используют сложную навигацию, для обычных LLM практически недоступны.

Как пишет : «Если вам нужно собирать страницы сотнями или тысячами… одного ChatGPT недостаточно». Нужен инструмент, созданный именно для этой задачи.

Вертикальные ИИ-агенты — это будущее, и вот почему это важно

Здесь пригодится мой опыт в SaaS и автоматизации: вертикальные ИИ-агенты — ИИ-инструменты, созданные для конкретной области, например для извлечения веб-данных, — это единственный способ получить надёжный и масштабируемый результат в бизнес-задачах. Почему?

- Универсальные LLM отлично подходят для текста или поиска, но они склонны к галлюцинациям и не справляются с многошаговыми повторяемыми процессами с той стабильностью, которая нужна бизнесу.

- Корпоративным SaaS-инструментам нужно автоматизировать массу повторяющихся структурированных задач. Именно здесь вертикальные ИИ-агенты проявляют себя лучше всего — они созданы, чтобы делать одну работу и делать её хорошо, с минимумом ошибок.

- Таких примеров уже много в разных отраслях: Thunderbit для извлечения веб-данных, Devin AI для разработки ПО, Alta для автоматизации продаж, IL VISTA от Infinity Learn для образования, Rippling для HR, Harvey для юридической сферы… список можно продолжать.

Проще говоря: если вам нужно надёжно найти все страницы на сайте, вам нужен вертикальный ИИ-агент, созданный для этой работы, а не универсальный чат-бот.

Знакомьтесь: Thunderbit — извлечение URL с помощью ИИ для всех

Здесь на сцену выходит . Как расширение Chrome для AI web scraper, Thunderbit создан для бизнес-пользователей — без кода, без технической настройки, только результат. Вот чем он отличается:

- Интерфейс на естественном языке: просто опишите, что вам нужно («Список всех URL страниц на этом сайте»), и ИИ Thunderbit сам поймёт, как это извлечь.

- AI Suggest Fields: Thunderbit сканирует страницу и автоматически предлагает названия столбцов (например, «URL страницы») — не нужно возиться с CSS-селекторами или XPath.

- Работа с пагинацией и бесконечной прокруткой: Thunderbit может автоматически нажимать «Далее» или прокручивать страницу вниз, чтобы вы не пропустили ни одной страницы.

- Переход на подстраницы: нужно углубиться дальше? Thunderbit может переходить по ссылкам на подстраницы и извлекать данные уже оттуда.

- Структурированный экспорт: выгружайте результаты напрямую в Google Sheets, Excel, Notion, Airtable или CSV — бесплатно и в один клик.

- Код не нужен: если вы умеете пользоваться сайтом, вы сможете использовать Thunderbit. Всё просто.

А поскольку Thunderbit — это вертикальный ИИ-агент, он создан для стабильной и повторяемой работы, что идеально подходит бизнес-пользователям, которым нужно автоматизировать одни и те же задачи снова и снова.

Пошагово: как найти все URL на домене с помощью Thunderbit

Готовы посмотреть, как это работает? Ниже — несложный пошаговый разбор, как извлечь каждый нужный URL.

1. Установите расширение Thunderbit для Chrome

Начнём с самого начала: . Оно работает в Chrome, Edge, Brave и других браузерах на Chromium. Закрепите его на панели инструментов для быстрого доступа.

2. Откройте целевую страницу со списком или каталогом

Перейдите на сайт, с которого хотите извлечь URL. Это может быть главная страница, sitemap, каталог или любая страница-список, ведущая на нужные вам страницы.

3. Запустите Thunderbit и настройте поля

Нажмите на иконку Thunderbit, чтобы открыть расширение. Создайте новый шаблон скрейпера. Здесь и начинается магия:

- Нажмите «AI Suggest Fields». ИИ Thunderbit просканирует страницу и предложит столбцы — ищите тот, что называется «URL страницы», «Ссылка» или похожим образом.

- Если точного поля нет, просто добавьте столбец с названием «URL страницы» (или любым удобным вам названием). ИИ Thunderbit обучен распознавать такие термины и сопоставит их с нужными данными.

4. Включите пагинацию или прокрутку, если это нужно

Если на целевой странице есть несколько страниц (например, «Страница 1, 2, 3…» или кнопка «Показать ещё»), включите в Thunderbit пагинацию:

- Переключитесь в режим «Click Pagination» для сайтов с кнопкой «Далее» или в режим «Infinite Scroll» для страниц, где результаты подгружаются по мере прокрутки.

- Thunderbit предложит выбрать кнопку «Далее» или область прокрутки — просто кликните по ней, и остальное ИИ сделает сам.

5. Запустите извлечение и проверьте результаты

Нажмите кнопку «Scrape». Thunderbit обойдёт все страницы и соберёт каждый найденный URL. Результаты появятся в таблице прямо в расширении. Для больших сайтов это может занять несколько минут, но всё равно намного быстрее, чем делать это вручную.

6. Экспортируйте список URL

Когда извлечение завершится, нажмите Export. Вы сможете отправить данные напрямую в:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

Экспорт бесплатный и сохраняет всё форматирование. Больше никаких мучений с копированием и вставкой.

Сравнение Thunderbit с другими решениями для извлечения URL

| Метод | Удобство использования | Точность и охват | Масштабируемость | Варианты экспорта |

|---|---|---|---|---|

| Ручное копирование | Мучительно | Низкая (легко что-то пропустить) | Нет | Вручную (Excel и т. д.) |

| Браузерные извлекатели ссылок | Подходит для 1 страницы | Средняя | Плохо | Вручную |

Поиск Google site: | Просто | Средняя (неполная) | Ограничено ~1 000 | Вручную |

| XML sitemap | Просто, если он есть | Хорошая, если актуален | Хорошая | Вручную/скрипт |

| SEO-инструменты (Screaming Frog) | Технически | Высокая | Высокая (платно) | CSV, Excel |

| Python-скрипты (Scrapy и т. д.) | Очень технически | Высокая | Высокая | На заказ |

| Thunderbit | Очень просто | Очень высокая | Высокая | Google Sheets, CSV и т. д. |

Thunderbit даёт вам точность и масштаб профессионального краулера в сочетании с простотой браузерного расширения. Никакого кода, никакой настройки — только результат.

Бонус: с Thunderbit можно извлекать не только URL

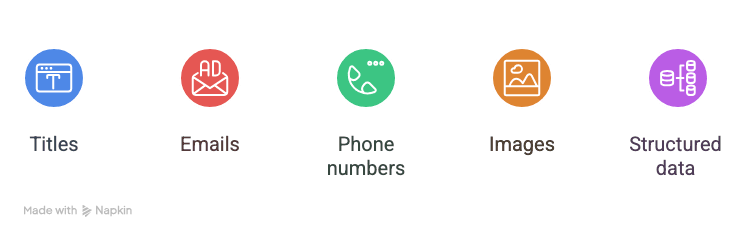

А вот здесь начинается самое интересное. Thunderbit подходит не только для URL — с его помощью можно извлекать:

- Заголовки

- Номера телефонов

- Изображения

- Любые структурированные данные на странице

Например, если вы собираете список лидов, Thunderbit может забрать URL профиля, имя, email и номер телефона из каждой записи каталога — всё за один проход. Если вы проводите аудит товаров, можно извлечь URL товара, название, цену и статус наличия. Thunderbit даже поддерживает , так что он может переходить по каждой ссылке и вытаскивать детали уже оттуда.

И да, извлекатели email и телефонов в Thunderbit совершенно бесплатны. Для команд продаж и маркетинга это очень важно.

Главное: как найти все страницы на сайте с помощью ИИ

Подведём итог:

- Извлекать все URL с домена вручную или с помощью универсальных инструментов сложно.

- Универсальные ИИ-модели вроде GPT не умеют работать с навигацией, пагинацией и динамическим контентом.

- Вертикальные ИИ-агенты вроде Thunderbit созданы специально для web data extraction — они стабильны, повторяемы и удобны для бизнес-пользователей.

- Thunderbit всё упрощает: установите расширение, используйте ИИ для подбора полей, включите пагинацию, запустите извлечение и экспортируйте данные. Никакого кода, никаких мучений.

- Вы можете извлекать не только URL: заголовки, email, телефоны и многое другое — идеально для лидогенерации, аудита или исследований.

Если вы устали копировать ссылки вручную или бороться с техническими краулерами, . Есть бесплатный тариф, так что вы сами увидите, сколько времени — и нервов — он сэкономит.

А если хотите узнать, чем ещё Thunderbit может помочь — например, , или — загляните в за новыми гайдами и советами.

Готовы вернуть себе время, которое уходит на ручной сбор данных? Будущее извлечения веб-данных — за вертикальными ИИ-агентами, и Thunderbit уже задаёт темп. Попробуйте, и пусть ваш следующий аудит, список лидов или исследовательский проект станет самым простым из всех.

Читать далее

P.S. Если вам когда-нибудь захочется вручную копировать 1 000 URL, просто вспомните: теперь для этого есть ИИ. Ваши запястья — да и ваш начальник — скажут вам спасибо.