Почти половина всего интернет-трафика сегодня — это боты. И львиная доля из них в промышленных масштабах собирает ссылки, данные и URL. Если ты до сих пор делаешь это руками — ты уже в роли догоняющего.

Я прогнал через тест 12 инструментов для извлечения ссылок — от AI-расширений для Chrome до Python-библиотек — чтобы понять, какие реально спасают, когда нужно быстро собрать тысячи URL.

Вот к каким выводам я пришёл.

Зачем вообще нужны экстракторы ссылок

Давай по-честному: веб забит данными под завязку, а компании наперегонки пытаются превратить этот хаос в понятные действия и решения. и стали критически важными для команд, которым нужно:

- Генерировать лиды: отдел продаж может за считанные минуты собрать ссылки на профили компаний из каталогов или LinkedIn, а затем передать эти URL в инструменты, которые вытянут контакты. Без бесконечного «клик-клик-клик».

- Собирать контент и усиливать SEO: маркетологи могут выгрузить все URL статей из блога, мониторить бэклинки конкурентов или проверять структуру сайта на битые ссылки.

- Следить за конкурентами и проводить исследование рынка: операционные команды могут автоматически собирать ссылки на новые продукты, страницы с ценами или пресс-релизы — и держать руку на пульсе без лишней рутины.

- Автоматизировать процессы и экономить время: современные сборщики ссылок умеют работать с пакетами URL, обходить подстраницы и выгружать данные в структурированном виде (CSV, Excel, Google Sheets, Notion — что угодно). Это значит: конец марафонам копипаста и разбору грязных текстовых файлов.

Учитывая, что , ручной подход — вообще не вариант. Правильный экстрактор ссылок — это как «прокачанный» ассистент: не устаёт, не теряет ссылки и не просит паузу на кофе.

Как мы выбирали лучшие экстракторы ссылок

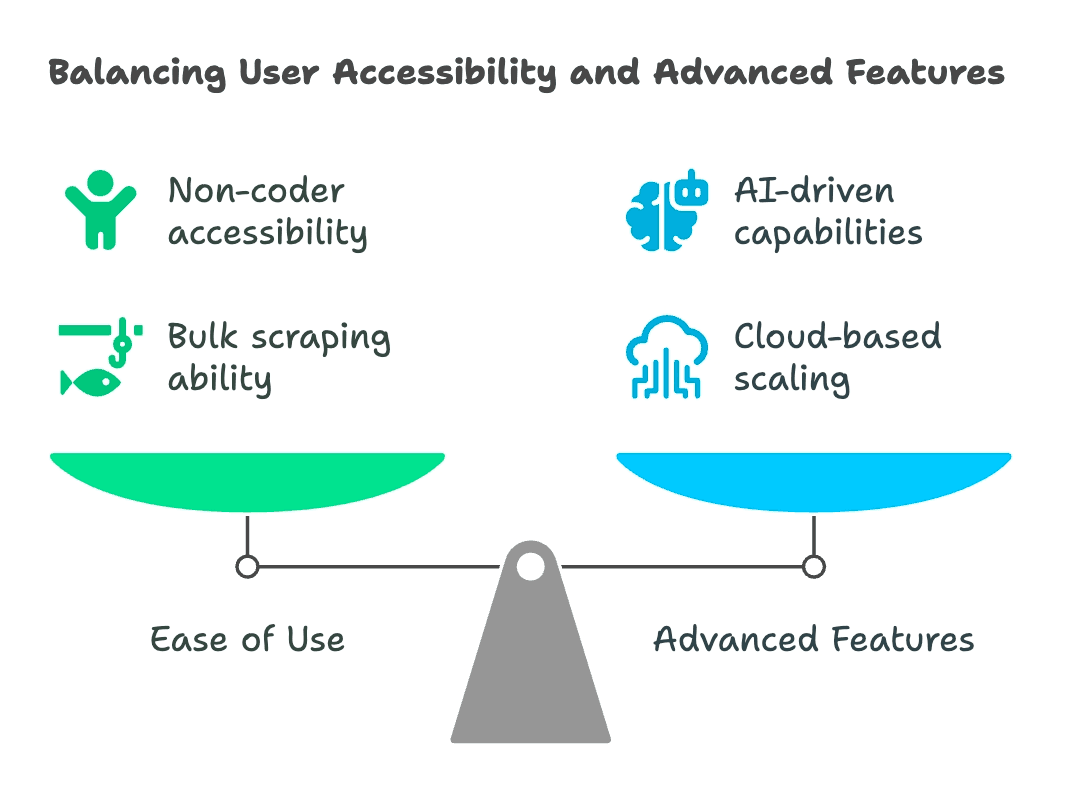

Инструментов — море, и выбор иногда ощущается как спид-дейтинг на техконфе: все обещают быть «тем самым», но реально вывозят единицы. Вот по каким критериям я собрал топ-12:

- Простота: сможет ли человек без навыков программирования пользоваться инструментом без «докторской по regex»? No-code и low-code решения получали дополнительные баллы.

- Пакетная обработка и многоуровневый сбор: тянет ли он сотни URL за раз? Умеет ли обходить подстраницы и автоматически переходить по ссылкам?

- Экспорт и интеграции: есть ли выгрузка в CSV, Excel, Google Sheets, Notion, Airtable или через API? Чем меньше ручной возни — тем лучше.

- Для кого инструмент и насколько он гибкий: подходит ли он бизнес-пользователям, аналитикам или разработчикам? Одни решения «на все случаи», другие — строго под конкретные задачи.

- Продвинутые возможности: AI-распознавание, расписание, масштабирование в облаке, очистка данных и шаблоны под популярные сайты.

- Цена и масштабируемость: бесплатные тарифы, оплата по факту использования или enterprise? Я смотрел, что именно ты получаешь за свои деньги.

Я включил и расширения для браузера, и корпоративные платформы — так что подходящий вариант найдётся и для соло-фаундера, и для data-команды из Fortune 500.

Thunderbit: самый умный экстрактор ссылок для бизнес-пользователей

Начнём с лидера. — мой основной выбор для извлечения ссылок (и не только потому, что я участвовал в его создании). Thunderbit — это , сделанное для бизнес-пользователей, которым нужен быстрый результат.

Чем Thunderbit цепляет? Это как AI-стажёр, который реально понимает задачу. Ты просто описываешь, что нужно, обычными словами («Собери все ссылки на товары и цены с этой страницы»), а дальше AI делает остальное. Никаких селекторов и скриптов.

И это ещё не всё:

- Поддержка списков URL: вставь один адрес или список из сотен — Thunderbit обработает всё за один запуск.

- Переходы по подстраницам: нужно собрать ссылки со страницы-списка, а затем зайти на каждую карточку и вытащить дополнительные URL? Многоуровневая логика Thunderbit справится.

- Структурированный экспорт: после извлечения ссылок можно переименовать поля, разнести по категориям и выгрузить напрямую в Google Sheets, Notion, Airtable, Excel или CSV. Никакой боли с постобработкой.

Thunderbit доверяют более 30 000 пользователей по всему миру — от отделов продаж до риэлторов и небольших e-commerce проектов. И да, есть (до 6 страниц, или до 10 с пробным бустом), так что можно спокойно протестировать без риска.

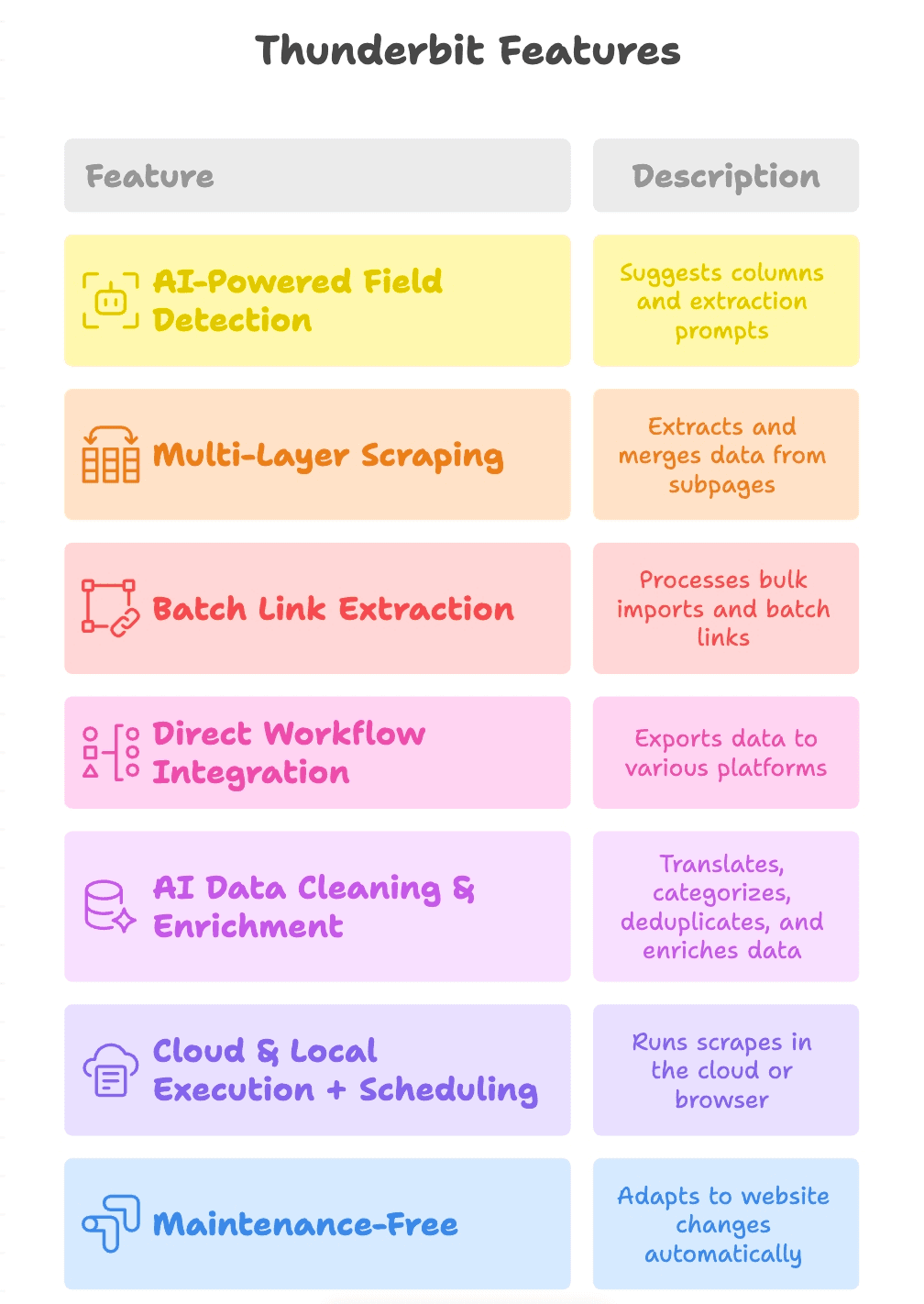

Ключевые фишки Thunderbit

Разберём, что именно делает Thunderbit особенным:

- AI-определение полей: нажми “AI Suggest Fields” — Thunderbit анализирует страницу, предлагает колонки (например, “Product Link”, “PDF URL”, “Contact Email”) и даже формирует подсказки для извлечения по каждому полю.

- Многоуровневый сбор: Thunderbit может переходить по ссылкам с основной страницы на подстраницы (карточки товаров, скачивание PDF), вытягивать дополнительные ссылки и объединять всё в одну таблицу.

- Пакетное извлечение ссылок: одна страница или тысяча — Thunderbit спокойно обрабатывает массовый импорт и батч-извлечение.

- Интеграция в рабочие процессы: выгружай результаты в Google Sheets, Notion, Airtable или скачивай CSV/Excel — данные оказываются там, где они реально нужны команде.

- AI-очистка и обогащение данных: Thunderbit умеет переводить, классифицировать, удалять дубликаты и даже обогащать данные прямо во время сбора — на выходе не «сырой дамп», а готовый к работе набор.

- Облако и локальный запуск + расписание: запускай сбор в облаке для скорости или в браузере для сайтов с авторизацией. Настраивай регулярные задания, чтобы данные всегда были свежими.

- Без обслуживания: AI подстраивается под изменения на сайте — меньше времени на починку парсеров, больше — на результат.

Octoparse: no-code сборщик ссылок для всех

— классика мира no-code парсинга. Это десктопное приложение (Windows/Mac) с визуальным интерфейсом «наведи и кликни». Открываешь страницу, выбираешь нужные ссылки — Octoparse сам понимает, что делать дальше.

- Отлично для новичков: код не нужен — кликнул, извлёк, готово.

- Пагинация и динамический контент: умеет нажимать “Next”, скроллить и даже логиниться на сайтах.

- Облачный сбор и расписание: на платных тарифах можно запускать задачи в облаке и ставить их по расписанию.

- Варианты экспорта: выгрузка в CSV, Excel, JSON или отправка в базы данных.

Бесплатный план щедрый для небольших задач (до 10 задач и 50 000 строк/месяц), но активным пользователям понадобится платный тариф (примерно от $75/мес.).

Apify: гибкий экстрактор URL под кастомные сценарии

— швейцарский нож веб-скрейпинга. Есть маркетплейс готовых “actors” (скрейперов), а также возможность писать свои сценарии на JavaScript или Python.

- Готовые решения и кастомизация: бери акторы сообщества для типовых задач или собирай свои под нестандартные процессы.

- Пакетный и плановый сбор: ставь URL в очередь, запускай параллельно и планируй регулярные сборы.

- API-first: экспорт в JSON, CSV, Excel или Google Sheets и интеграция в твой пайплайн.

- Оплата по использованию: ежемесячные бесплатные кредиты, дальше — тарификация по факту.

Apify отлично подходит полу-техническим командам и разработчикам, которым важны гибкость и масштаб.

Bright Data URL Scraper: корпоративный уровень для сбора ссылок

ориентирован на компании, которым нужен сбор данных в больших объёмах. В их Data Collector есть готовый URL Scraper для высоконагруженных задач.

- Огромные масштабы: тысячи и миллионы страниц, плюс мощная прокси-инфраструктура для обхода блокировок.

- Готовые шаблоны: скрейперы под e-commerce, соцсети, недвижимость и многое другое.

- Enterprise-возможности: инструменты комплаенса, экспертная поддержка и продвинутая антиблокировка.

- Цена: примерно от $350 за 100 000 загрузок страниц — явно для крупного бизнеса.

Для стартапа это может быть перебор. Но для критичных задач и больших объёмов Bright Data — настоящая тяжёлая артиллерия.

WebHarvy: визуальный экстрактор ссылок «кликнул — получил»

— десктопное приложение (Windows), которое позволяет собирать ссылки, просто кликая по ним во встроенном браузере.

- Максимально просто: кликаешь по ссылке — WebHarvy подсвечивает все похожие элементы для извлечения.

- Поддержка регулярных выражений: встроенные шаблоны для типовых задач, без программирования.

- Экспорт в Excel, CSV, JSON, XML, SQL: удобно для бизнес-пользователей и привычных форматов.

- Разовая лицензия: платишь один раз — пользуешься постоянно.

Отличный вариант для малого бизнеса, исследователей и всех, кому нужен быстрый способ получить ссылки без кода.

Web Scraper (расширение Chrome): быстрый сбор ссылок прямо в браузере

— бесплатный open-source инструмент, который превращает браузер в скрейпер.

- Настройка sitemap: задаёшь, как переходить по страницам и что извлекать.

- Пагинация и многоуровневый обход: категории, подкатегории, карточки — всё можно обойти.

- Экспорт в CSV/XLSX: скачивание данных прямо из браузера.

- Шаблоны сообщества: много готовых sitemap для популярных сайтов.

Идеально для быстрых разовых задач, студентов и небольших команд с ограниченным бюджетом.

ScraperAPI: масштабируемый сбор ссылок для разработчиков

— выбор разработчиков, которым нужно массово получать страницы без головной боли с прокси, блокировками и CAPTCHA.

- Работа через API: отправляешь URL — получаешь HTML или данные.

- Масштаб и антибот-защита: ротация прокси, рендеринг JS и решение CAPTCHA встроены.

- Интеграция в твой код: подходит для Python, Node.js и любого языка.

- Цена: есть бесплатный уровень (~1000 запросов), дальше — оплата по тарифам.

Отлично для кастомных краулеров и случаев, когда важны стабильность и скорость на больших объёмах.

ParseHub: визуальный сборщик ссылок с продвинутым выбором элементов

— десктопное приложение (Windows, Mac, Linux) для визуальной сборки проектов парсинга.

- Продвинутый выбор и навигация: клики, циклы, условия — можно вытягивать ссылки даже из динамических или скрытых элементов.

- Работа с вложенными страницами: обход категорий, затем карточек, затем извлечение дополнительных ссылок.

- Экспорт в CSV, Excel, JSON: облачные запуски и API доступны на платных тарифах.

- Бесплатный план: 5 проектов, до 200 страниц за запуск.

ParseHub любят маркетологи и исследователи, которым нужна мощь без кода.

Scrapy: Python-экстрактор ссылок для разработчиков

— золотой стандарт для Python-разработчиков, которым нужен полный контроль.

- Подход «сначала код»: пишешь собственных пауков (spiders) для обхода и извлечения ссылок в любом масштабе.

- Распределённый обход: эффективно, асинхронно и очень гибко.

- Экспорт в CSV, JSON, XML или базу данных: формат вывода полностью под твоим контролем.

- Open-source и бесплатно: но окружение и инфраструктуру придётся поддерживать самостоятельно.

Если ты уверенно чувствуешь себя в Python, Scrapy — один из самых мощных вариантов.

Diffbot: AI-сборщик ссылок для структурированных данных

— «AI-мозг» веб-скрейпинга. Он анализирует страницы и возвращает структурированные данные (включая ссылки) без ручной настройки.

- Автоматическое распознавание контента: даёшь URL — получаешь структурированный ответ (статьи, товары, ссылки и т. д.).

- Crawlbot и Knowledge Graph: можно обходить целые сайты или работать с их огромным веб-индексом.

- Работа через API: интеграция с BI-инструментами и пайплайнами.

- Enterprise-цены: примерно от $299/мес., но качество соответствует.

Лучше всего подходит компаниям, которым нужны чистые структурированные данные без поддержки собственных скрейперов.

Cheerio: лёгкий сборщик ссылок для Node.js

— быстрый HTML-парсер для Node.js с синтаксисом в стиле jQuery.

- Очень быстрый: разбирает HTML за миллисекунды.

- Знакомый синтаксис: если знаешь jQuery — Cheerio зайдёт сразу.

- Идеален для статических страниц: JS не рендерит, зато отлично подходит для серверного HTML.

- Open-source и бесплатно: обычно используют вместе с axios или fetch.

Хороший выбор для разработчиков, которым нужны скорость и простота в кастомных скриптах.

Puppeteer: автоматизация браузера для сложного сбора ссылок

— библиотека Node.js для управления Chrome в headless-режиме.

- Полная автоматизация браузера: загрузка страниц, клики, скролл — как у реального пользователя.

- Динамика и логины: идеально для сайтов на тяжёлом JavaScript или сложных сценариев.

- Тонкая настройка: ожидание элементов, скриншоты, перехват сетевых запросов.

- Open-source и бесплатно: но ресурсоёмко и обычно медленнее лёгких парсеров.

Используй Puppeteer, когда нужно вытянуть ссылки с сайтов, которые плохо поддаются базовым скрейперам.

Сравнение на одном экране: какой экстрактор ссылок подойдёт вам?

Ниже — быстрый обзор всех 12 инструментов:

| Инструмент | Лучше всего подходит для | Пакетная обработка и подстраницы | Варианты экспорта данных | Цена |

|---|---|---|---|---|

| Thunderbit | Бизнес-пользователи без кода | Да (AI, многоуровневый сбор) | Excel, CSV, Sheets, Notion, Airtable | Бесплатный пробный период, от ~$9/мес. |

| Octoparse | No-code пользователи, аналитики | Да | CSV, Excel, JSON, облачное хранилище | Есть бесплатный план, ~$75/мес. |

| Apify | Полу-технические команды, разработчики | Да | CSV, JSON, Sheets через API | Бесплатные кредиты, оплата по использованию |

| Bright Data | Enterprise | Да (большие объёмы) | CSV, JSON, NDJSON через API | ~$350/100k страниц |

| WebHarvy | Пользователи без кода, десктоп | Да | Excel, CSV, JSON, XML, SQL | Платная лицензия |

| Web Scraper Extension | Всем, быстро/бесплатно | Да | CSV, XLSX | Бесплатно, open-source |

| ScraperAPI | Разработчики, API | Да | JSON (HTML через API) | Бесплатно 1k запросов, далее платные уровни |

| ParseHub | Пользователи без кода, продвинутые задачи | Да | CSV, Excel, JSON, API | Бесплатно 5 проектов, далее платно |

| Scrapy | Разработчики, Python | Да | CSV, JSON, XML, БД | Бесплатно, open-source |

| Diffbot | Enterprise, AI | Да (AI-обход) | JSON (структурированные данные через API) | ~$299/мес.+ |

| Cheerio | Разработчики, Node.js | Да (кастомный код) | Кастомно (JSON и т. п.) | Бесплатно, open-source |

| Puppeteer | Разработчики, сложные сайты | Да (полная автоматизация) | Кастомно (скриптовый вывод) | Бесплатно, open-source |

Как выбрать подходящий сборщик ссылок для бизнеса

Как не промахнуться с выбором? Вот моя шпаргалка:

- Не хочешь кодить? Начни с Thunderbit, Octoparse, ParseHub, WebHarvy или расширения Web Scraper.

- Нужны кастомные сценарии? Apify, ScraperAPI или Cheerio отлично зайдут разработчикам.

- Нужен enterprise-масштаб? Bright Data или Diffbot сделаны именно под это.

- Ты разработчик на Python или Node.js? Scrapy (Python) или Cheerio/Puppeteer (Node.js) дадут полный контроль.

- Нужен прямой экспорт в Sheets/Notion? Thunderbit — самый удобный вариант.

Сопоставь инструмент со своим уровнем технической подготовки, объёмом данных и требованиями к интеграциям. У большинства есть бесплатные пробные периоды — так что тестировать не только можно, но и нужно.

Уникальная ценность Thunderbit для извлечения ссылок в 2026

Вернёмся к тому, что делает Thunderbit реально особенным:

- Простота на базе AI: формулируешь задачу обычным языком — AI Thunderbit делает остальное.

- Многоуровневый сбор: вытягивай ссылки с основных страниц, переходи на подстраницы и собирай дополнительные URL — в одном процессе.

- Массовый импорт и пакетная обработка: вставляй сотни URL, извлекай ссылки оптом и сразу получай структурированный результат.

- Интеграция в процессы: экспорт напрямую в Google Sheets, Notion, Airtable или скачивание CSV/Excel.

- Ноль обслуживания: AI адаптируется к изменениям сайтов — не придётся постоянно чинить сломанные скрейперы.

Thunderbit закрывает разрыв между «просто собрать данные» и «получить данные, которые реально можно использовать». Это тот инструмент, которого мне не хватало несколько лет назад, когда я тонул в ручной рутине.

Итог: собирайте ссылки умнее и ускоряйте работу

Веб-данные — топливо для роста бизнеса, а правильный экстрактор ссылок — твой двигатель. Собираешь лид-листы, мониторишь конкурентов или автоматизируешь исследования — в этом списке найдётся инструмент под твои задачи и навыки.

Если хочешь увидеть, как выглядит современное извлечение ссылок, . Скорее всего, удивишься, сколько можно сделать буквально за пару кликов. А если Thunderbit тебе не зайдёт, протестируй несколько альтернатив из списка — сейчас реально лучшее время, чтобы автоматизировать скучную рутину и сфокусироваться на важном.

Удачного скрейпинга — пусть твои ссылки всегда будут чистыми, структурированными и готовыми к работе. А если хочется глубже нырнуть в тему, загляни в — там ещё больше гайдов и практичных советов.

FAQ

1. Почему экстракторы ссылок так важны?

Почти половина интернет-трафика приходится на ботов, а бизнес всё активнее собирает данные из сети. Экстракторы ссылок помогают превратить веб-хаос в практические инсайты: автоматизируют лидогенерацию, сбор контента, SEO-аудиты и мониторинг конкурентов, экономя огромное количество времени и усилий.

2. Чем Thunderbit отличается от других экстракторов ссылок?

Thunderbit упрощает сбор данных с помощью AI: ты описываешь цель обычными словами, а инструмент делает остальное. Он поддерживает массовый ввод URL, многоуровневый сбор, умное определение полей и удобный экспорт в Google Sheets и Notion. Это отличный вариант для бизнес-пользователей без технических навыков, которым нужен мощный результат без лишней сложности.

3. Есть ли инструменты для разработчиков и кастомных сценариев?

Да. Apify, ScraperAPI, Cheerio, Puppeteer и Scrapy ориентированы на разработчиков: дают скриптинг, интеграцию через API и гибкость для сложных задач, больших объёмов и продвинутой автоматизации.

4. Какие инструменты лучше всего подойдут тем, кто не умеет программировать?

Thunderbit, Octoparse, ParseHub, WebHarvy и расширение Web Scraper для Chrome — лучшие варианты для нетехнических пользователей. У них визуальные интерфейсы, готовые шаблоны и AI-функции, которые делают извлечение ссылок доступным практически каждому.

5. Как выбрать правильный экстрактор ссылок под мои задачи?

Оцени свой уровень технических навыков, объём данных и требования к экспорту. Пользователям без кода подойдут Thunderbit или Octoparse, разработчикам — Scrapy или Puppeteer. Для enterprise-задач с большими объёмами стоит смотреть в сторону Bright Data или Diffbot. И всегда начинай с бесплатного пробного периода, чтобы понять, что подходит лучше всего.