В прошлом квартале наша операционная команда тратила по 40 часов в неделю на ручное копирование данных о конкурентах в таблицы. В этом квартале это занимает 20 минут.

В чём разница? В автоматизированных инструментах для веб-скрейпинга. Они прошли путь от решений только для разработчиков до инструментов, которые любой менеджер по продажам или маркетолог может настроить за обедом.

Я много лет создаю SaaS и инструменты автоматизации (и да, я соосновал ). Поколение инструментов 2026 года — самое сильное на сегодня: нативные для AI, самовосстанавливающиеся и действительно удобные для людей без технического бэкграунда.

Ниже — 10 инструментов, которые я лично протестировал и сравнил по сценариям использования и уровню подготовки.

Почему автоматизированные инструменты для веб-скрейпинга важны для бизнеса

Давайте честно: времена, когда данные с сайтов копировали и вставляли вручную, давно прошли (если, конечно, вам не нравятся повторяющиеся травмы и экзистенциальная тоска). Автоматизированные инструменты для веб-скрейпинга стали критически важными для бизнеса любого масштаба. Более того, , а веб-скрейпинг — ключевая часть этой стратегии.

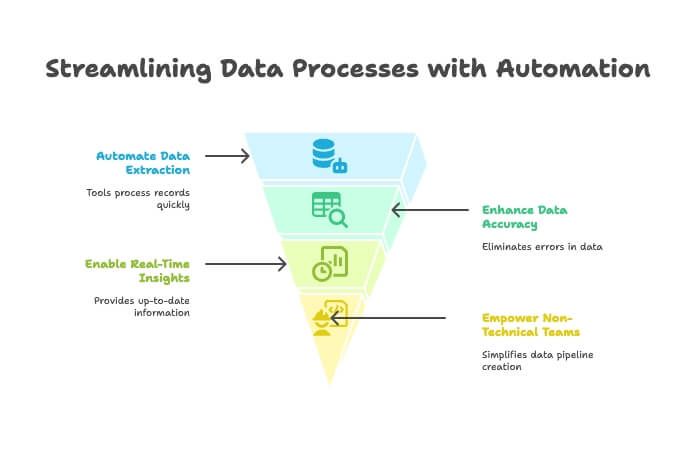

Вот почему эти инструменты так ценны:

- Экономят время и сокращают ручную работу: автоматизированные скрейперы обрабатывают тысячи записей за минуты, освобождая команду для задач с большей ценностью. Один пользователь сообщил, что сэкономил «сотни часов» благодаря автоматизации сбора данных ().

- Повышают точность данных: никаких опечаток и пропущенных строк. Автоматическое извлечение даёт более чистые и надёжные данные.

- Помогают быстрее принимать решения: благодаря потокам данных в реальном времени можно отслеживать конкурентов, цены или собирать списки лидов, не дожидаясь ежемесячного отчёта стажёра.

- Открывают доступ для нетехнических команд: благодаря no-code и AI-инструментам даже те, кто считает, что «XPath» — это поза из йоги, теперь могут строить конвейеры данных из веба ().

Неудивительно, что , а почти 80% говорят, что их организация не смогла бы эффективно работать без них. В 2026 году, если вы не автоматизируете сбор данных, вы, скорее всего, оставляете деньги — и инсайты — на столе.

Как мы выбирали лучшие автоматизированные инструменты для веб-скрейпинга

Поскольку рынок софта для веб-скрейпинга, по прогнозам, , выбрать подходящий инструмент — это почти как искать обувь в магазине с 10 000 вариантов. Вот как я сузил список:

- Простота использования: сможет ли не-разработчик быстро начать работу? Насколько крутая кривая обучения?

- AI-возможности: использует ли инструмент AI для автоматического определения полей, работы с динамическими сайтами или позволяет описать задачу простым языком?

- Экспорт и интеграции данных: насколько легко выгрузить данные в Excel, Google Sheets, Airtable, Notion или вашу CRM?

- Цена: есть ли бесплатный пробный период? Подходят ли платные тарифы для частных пользователей и небольших команд, или они доступны только enterprise-клиентам?

- Масштабируемость: справляется ли инструмент и с разовыми небольшими задачами, и с крупными, запланированными извлечениями?

- Целевая аудитория: создан ли он для бизнес-пользователей, разработчиков или для тех и других?

- Уникальные сильные стороны: чем этот инструмент выделяется среди остальных?

Я включил инструменты для любого уровня — от «мне просто нужна таблица» до «я хочу обойти весь интернет». Давайте перейдём к списку.

1. Thunderbit: AI-инструмент для веб-скрейпинга для всех

Начну с инструмента, который знаю лучше всего, — потому что мы с командой создавали его именно для тех проблем, с которыми бизнес-пользователи сталкиваются уже много лет. — это не типичный скрейпер в духе «перетащи и отпусти» или «настрой свой селектор вручную». Это AI-ассистент для работы с данными: вы описываете, что вам нужно, а он делает всю тяжёлую работу — без кода, без возни с XPath, без слёз.

Почему Thunderbit возглавляет список

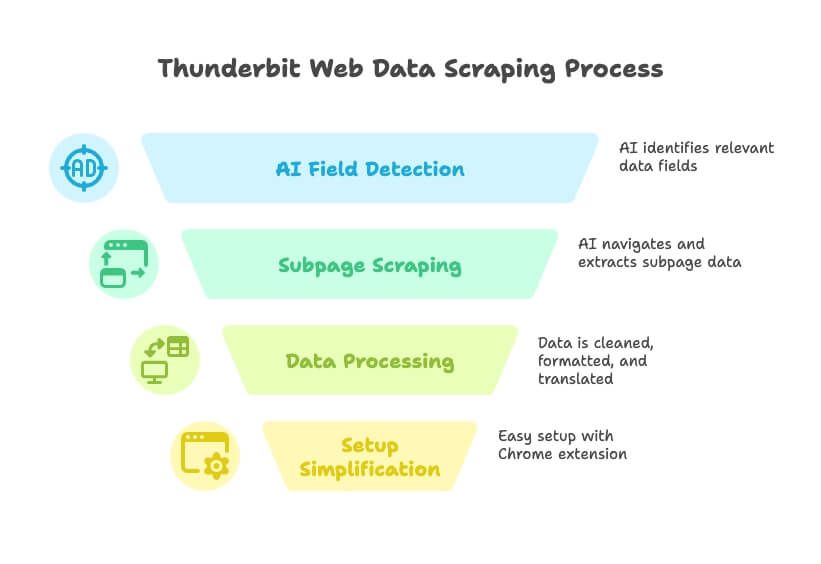

Thunderbit — самое близкое из того, что я видел, к идее «превратить любой сайт в базу данных». Вот как это работает:

- Основан на естественном языке: просто скажите Thunderbit, какие данные вам нужны («Нужны все названия компаний, email и телефоны из этого каталога»), и AI автоматически определит нужные поля.

- AI предложит поля: одним кликом Thunderbit анализирует страницу и предлагает лучшие столбцы для извлечения — больше никакого угадывания и проб и ошибок.

- Скрейпинг подстраниц и многоуровневый сбор: нужны детали со страницы каждой карточки? Thunderbit может переходить по ссылкам, собирать дополнительную информацию и добавлять её в таблицу.

- Очистка, перевод и классификация данных: Thunderbit не просто забирает сырые данные — он может очищать их, форматировать, переводить и даже классифицировать поля прямо в процессе сбора.

- Без мучений с настройкой: установите , нажмите «AI Suggest Fields», и вы начнёте скрейпинг меньше чем через минуту.

- Бесплатный пробный период и низкая цена: щедрый бесплатный тариф (до 6 страниц бесплатно), а платные планы начинаются всего с $9 в месяц. Это меньше, чем я трачу на кофе за неделю.

Thunderbit создан для отделов продаж, маркетинга и операций, которым нужны данные быстро. Без кода, без плагинов, без обучения. Это как если бы у вас был стажёр по данным, который действительно слушает и никогда не жалуется.

Выдающиеся возможности Thunderbit

- Скрейпинг на базе AI: AI понимает структуру страницы, адаптируется к изменениям макета и даже автоматически справляется с пагинацией и подстраницами ().

- Мгновенный экспорт данных: отправляйте результаты напрямую в Excel, Google Sheets, Airtable, Notion или скачивайте как CSV/JSON.

- Запуск в облаке или локально: запускайте задачи в облаке для скорости и масштаба либо в браузере, если нужно использовать свою авторизацию/сессию.

- Плановый скрейпинг: настройте повторяющиеся задачи, чтобы данные всегда были актуальны — идеально для мониторинга цен или регулярного обновления лидов.

- Не требует обслуживания: AI Thunderbit адаптируется к изменениям сайта, поэтому вы тратите меньше времени на исправление сломанных скрейперов ().

Кому подойдёт? Всем, кто хочет перейти от «Мне нужны эти данные» к «Вот ваша таблица» за считаные минуты — особенно нетехническим пользователям. С и рейтингом 4,9★ Thunderbit быстро становится выбором номер один для бизнес-команд, которым нужны результаты, а не головная боль.

Хотите увидеть его в деле? Загляните на или посмотрите другие .

2. Clay: автоматическое обогащение данных в сочетании с веб-скрейпингом

Clay — это как швейцарский нож для growth-команд. Это не просто веб-скрейпер, а автоматизированная таблица, которая подключается к более чем 50 источникам данных в реальном времени (например, Apollo, LinkedIn, Crunchbase) и использует встроенный AI, чтобы обогащать лиды, писать письма для outreach и оценивать потенциальных клиентов.

- Автоматизация рабочих процессов: каждая строка — это лид, каждый столбец может либо подгружать данные, либо запускать действие. Хотите собрать список компаний, обогатить его профилями LinkedIn и отправить персонализированное письмо? Clay всё это умеет.

- Интеграция с AI: использует GPT-4 для написания ледоколов, кратких биографий и многого другого.

- Интеграции: нативно подключается к HubSpot, Salesforce, Gmail, Slack и другим сервисам.

- Цена: профессиональный тариф начинается примерно с $99 в месяц; для лёгкого использования есть бесплатный пробный период.

Лучше всего подходит для: outbound-продаж, growth-хакеров и маркетологов, которым нужно строить собственные пайплайны лидов, объединяя скрейпинг, обогащение и outreach в одном месте. Инструмент мощный, но новичкам в автоматизации придётся освоить довольно крутую кривую обучения ().

3. Bardeen: браузерный инструмент для веб-скрейпинга и автоматизации рабочих процессов

Bardeen — это как браузерный робот, который может собирать данные и автоматизировать повторяющиеся веб-задачи — и всё это прямо из расширения Chrome.

- No-code автоматизация: более 500 «playbooks» для скрейпинга, заполнения форм, переноса данных между приложениями и многого другого.

- AI Command Builder: опишите задачу простым английским, и Bardeen соберёт рабочий процесс.

- Интеграции: работает с Notion, Trello, Slack, Salesforce и более чем 100 другими приложениями.

- Цена: бесплатно для лёгкого использования (100 automation credits в месяц), платные планы для команд начинаются с $99 в месяц.

Лучше всего подходит для: power users и go-to-market-команд, которые хотят автоматизировать скрейпинг и последующие действия в нескольких приложениях. Гибкости много, но новичкам кривая обучения может показаться довольно крутой ().

4. Bright Data: автоматизированные инструменты для веб-скрейпинга enterprise-уровня

Bright Data (ранее Luminati) — это тяжёлая техника веб-скрейпинга: глобальные прокси-сети, продвинутые API и возможность обходить тысячи страниц в день.

- Масштаб enterprise-уровня: более 100 миллионов IP, Web Scraper IDE, Web Unlocker для обхода антибот-защиты.

- Настраиваемость: можно строить сложные, масштабные извлечения с высокой надёжностью.

- Цена: Web Scraper IDE начинается с $499 в месяц; доступны и более маленькие пакеты micro.

Лучше всего подходит для: крупных компаний, дата-агрегаторов и продвинутых пользователей, которым нужны надёжные и масштабируемые решения. Если вы ежедневно обходите тысячи страниц и вам нужно избегать блокировок IP, Bright Data создан именно для вас ().

5. Octoparse: визуальный инструмент для веб-скрейпинга для пользователей среднего уровня

Octoparse — популярный no-code инструмент с визуальным интерфейсом point-and-click — идеально подходит тем, кто хочет мощь без программирования.

- Интерфейс drag-and-drop: кликайте по элементам, чтобы задать, что извлекать, работайте с логинами, пагинацией и многим другим.

- Шаблоны: более 500 готовых шаблонов для популярных сайтов (Amazon, Twitter и т. д.).

- Облачный скрейпинг: запускайте задачи на серверах Octoparse, планируйте извлечение и используйте ротацию IP.

- Цена: есть бесплатный тариф с ограничениями; платные планы начинаются с $119 в месяц.

Лучше всего подходит для: пользователей без навыков программирования и аналитиков данных, которым нужен мощный скрейпер без написания кода. Отлично подходит для мониторинга цен, карточек товаров и исследовательских проектов ().

6. : платформа для сбора данных для бизнеса

— один из ветеранов веб-скрейпинга, который со временем превратился в полноценную платформу для извлечения данных.

- Извлечение point-and-click: работает с логинами, выпадающими списками и интерактивными элементами.

- Облачная архитектура: обрабатывает тысячи URL одновременно, позволяет планировать извлечение и пользоваться API.

- Фокус на enterprise: используется для мониторинга цен, маркетинговых исследований и построения датасетов для машинного обучения.

- Цена: стартовый тариф — $199 в месяц, Standard — $599 в месяц, Advanced — $1 099 в месяц.

Лучше всего подходит для: компаний среднего и крупного размера и data-команд, которым нужны надёжные и поддерживаемые решения для крупных задач. Для хобби-проектов, вероятно, это избыточно, но для задач бизнес-масштаба — настоящий мощный инструмент ().

7. Parsehub: гибкий инструмент веб-скрейпинга с визуальным редактором

Parsehub — это десктопное приложение (Windows, Mac, Linux), которое позволяет собирать скрейперы, кликая по интерфейсу сайта.

- Визуальный workflow: выбирайте элементы, настраивайте правила извлечения и работайте с логинами, выпадающими списками и бесконечной прокруткой.

- Облачные функции: запускайте скрейпинг в облаке, планируйте задачи и используйте доступ через API.

- Цена: бесплатный тариф для небольших задач; платные планы начинаются с $149 в месяц.

Лучше всего подходит для: исследователей, малого бизнеса или частных пользователей, которым нужен больший контроль, чем даёт браузерное расширение, но которые ещё не готовы писать собственный скрейпер ().

8. Common Crawl: открытые веб-данные для AI и исследований

Common Crawl — это не инструмент в привычном смысле, а огромный открытый датасет данных веб-краулинга, который обновляется ежемесячно.

- Масштаб: около 400 ТБ веб-данных, охватывающих миллиарды веб-страниц.

- Бесплатно и открыто: не нужно запускать свой собственный краулер.

- Требуются технические навыки: понадобятся big data-инструменты и определённый инженерный опыт, чтобы фильтровать и парсить данные.

Лучше всего подходит для: data scientist’ов и инженеров, создающих AI-модели или проводящих масштабные исследования. Если вам нужен общий веб-текст или долгосрочные архивы, это настоящая золотая жила ().

9. Crawly: лёгкий автоматизированный инструмент веб-скрейпинга для стартапов

Crawly (от Diffbot) — это облачный AI-краулер, который может собирать данные с миллионов сайтов и возвращать структурированные результаты — без правил парсинга.

- Извлечение с помощью AI: использует компьютерное зрение и NLP для определения и извлечения контента.

- Доступ через API: делайте запросы к собранным данным и интегрируйте их с аналитикой или базами данных.

- Цена: enterprise-уровень; стоимость уточняйте отдельно.

Лучше всего подходит для: стартапов и команд с определённой технической подготовкой, которым нужно крупномасштабное интеллектуальное извлечение веб-данных без создания собственных скрейперов ().

10. Apify: удобный для разработчиков инструмент веб-скрейпинга с маркетплейсом

Apify — это облачная платформа, где можно создавать собственные скрейперы («Actors») или использовать библиотеку готовых скрейперов от сообщества.

- Гибкость для разработчиков: поддерживает скрейпинг на JavaScript/Python, headless Chrome, управление прокси и планирование.

- Маркетплейс: обширная библиотека готовых скрейперов для популярных сайтов.

- Цена: бесплатный тариф с кредитом $5 в месяц; платные планы начинаются с $49 в месяц.

Лучше всего подходит для: разработчиков и технически подкованных аналитиков, которым нужен полный контроль и масштабируемость. Даже те, кто не пишет код, могут использовать готовые Actors для типовых задач ().

Таблица сравнения автоматизированных инструментов веб-скрейпинга

| Инструмент | Простота использования | AI-функции | Цена (от) | Целевая аудитория | Уникальные сильные стороны |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Естественный язык, AI Suggest Fields, скрейпинг подстраниц | $9/мес | Нетехнические бизнес-пользователи | Настройка за 2 клика, без кода, мгновенный экспорт, бесплатный пробный период |

| Clay | ★★★★☆ | AI-обогащение, GPT-4 | $99/мес | Growth / sales ops | Таблица для автоматизации, обогащение, outreach |

| Bardeen | ★★★★☆ | AI Command Builder | $99/мес | Power users, GTM-команды | Browser RPA, 500+ playbooks, глубокие интеграции |

| Bright Data | ★★☆☆☆ | Ротация прокси, AI для обхода антиботов | $499/мес | Enterprise, разработчики | Масштаб, надёжность, глобальные прокси |

| Octoparse | ★★★★☆ | Визуальное AI-определение | $119/мес | Аналитики, no-code пользователи | Drag-and-drop, шаблоны, облачный скрейпинг |

| Import.io | ★★★☆☆ | Интерактивные экстракторы | $199/мес | Enterprise, data-команды | Параллельная обработка, планирование, API, поддержка |

| Parsehub | ★★★★☆ | Визуальные рабочие процессы | $149/мес | Исследователи, SMB | Десктопное приложение, работа с динамическими сайтами |

| Common Crawl | ★☆☆☆☆ | Н/Д (только датасет) | Бесплатно | Data scientist’ы, инженеры | Огромный открытый датасет, веб-архивы масштаба интернета |

| Crawly | ★★☆☆☆ | Извлечение с помощью AI | По запросу / Enterprise | Стартапы, технические команды | На базе AI, без правил парсинга, доступ к API |

| Apify | ★★★★☆ | Маркетплейс Actors | $49/мес | Разработчики, технические аналитики | Создание и маркетплейс, облачная автоматизация, гибкость |

Как выбрать подходящий инструмент для веб-скрейпинга под ваши задачи

Выбор лучшего автоматизированного инструмента для веб-скрейпинга зависит от размера команды, технических навыков и бизнес-целей. Вот мой краткий гид:

- Для нетехнических пользователей (продажи, маркетинг, операции): выбирайте . Он создан именно для вас — без кода, без настройки, только результат. Идеален для лидогенерации, мониторинга цен и быстрых проектов с данными.

- Для команд, одержимых автоматизацией: Clay и Bardeen особенно хороши, если вам нужно сочетать скрейпинг с обогащением, outreach или автоматизацией рабочих процессов.

- Для enterprise и разработчиков: Bright Data, и Apify — лучшие варианты для крупных, глубоко настраиваемых проектов.

- Для исследователей и аналитиков: Octoparse и Parsehub предлагают визуальные интерфейсы и мощные функции без необходимости писать код.

- Для AI- и data science-проектов: Common Crawl и Crawly предоставляют огромные датасеты и извлечение на базе AI для тех, кто хочет строить или обучать модели.

Спросите себя: вы хотите начать за минуты или вам нужно строить индивидуальное enterprise-решение? Если не уверены, начните с бесплатного пробного периода — он есть почти у всех инструментов.

Уникальная ценность Thunderbit: AI-ассистент для бизнес-данных

Среди всех этих инструментов Thunderbit выделяется как единственный, который по-настоящему работает как «AI-ассистент» для веб-скрейпинга и преобразования данных. Речь не просто о том, чтобы забрать данные, — а о том, чтобы превращать хаотичные сайты в чистые, структурированные инсайты без технических барьеров.

- Интерфейс на естественном языке: опишите задачу простыми словами, и Thunderbit сделает остальное.

- Полная автоматизация workflow: от извлечения до очистки, перевода и экспорта — Thunderbit покрывает весь процесс.

- Идеален для быстрых экспериментов: нужно проверить новый рынок, собрать список лидов или отслеживать конкурентов? Thunderbit — самый быстрый и недорогой старт.

Это как иметь встроенного в браузер аналитика данных — того, кто никогда не просит повышения и не уходит в отпуск.

Итог: начните умнее с правильным автоматизированным инструментом веб-скрейпинга

Ландшафт скрейпинга в 2026 году уже не узнать по сравнению с тем, что было два года назад. Самовосстанавливающиеся AI-скрейперы, LLM-native пайплайны и действительно удобные no-code инструменты изменили правила игры. Независимо от того, кто вы — соло-фаундер, небольшая команда продаж или enterprise data scientist, в этом списке найдётся инструмент под ваши задачи. Главное — сопоставить свой workflow и навыки с правильной платформой, чтобы перестать бороться с кодом и начать извлекать инсайты.

Если вы готовы отказаться от ручного копипаста и начать работать умнее, и посмотрите, насколько простым может быть веб-скрейпинг. Или изучите другие варианты выше — в зависимости от ваших целей. В любом случае будущее data-driven бизнеса принадлежит тем, кто автоматизирует.

Хотите узнать больше? Загляните в за подробными разборками, туториалами и советами, как выжать максимум из веб-данных. Удачного скрейпинга — и пусть ваши данные всегда будут чистыми, а скрейперы никогда не ломаются (а если сломаются, пусть AI всё исправит).

Часто задаваемые вопросы

1. Почему автоматизированные инструменты для веб-скрейпинга важны для бизнес-пользователей в 2026 году?

Автоматизированные инструменты для веб-скрейпинга упрощают сбор данных, экономят время и сокращают ручную работу. Они повышают точность данных, помогают принимать решения в реальном времени и позволяют нетехническим командам извлекать и использовать веб-данные без написания кода. Сегодня эти инструменты критически важны для продаж, маркетинга и операций.

2. Чем Thunderbit отличается от других инструментов для веб-скрейпинга?

Thunderbit использует AI, чтобы пользователь мог просто описать, какие данные ему нужны, обычным языком. Инструмент автоматически определяет поля данных, работает с подстраницами и пагинацией и мгновенно экспортирует результаты в такие платформы, как Excel и Airtable. Он создан для нетехнических пользователей и предлагает мощные функции вроде очистки данных и планового скрейпинга по доступной цене.

3. Какой инструмент лучше всего подходит для крупных enterprise-проектов по скрейпингу?

Bright Data и — идеальные варианты для enterprise-сценариев. Они предлагают ротацию прокси, меры против ботов, высокую параллельность и доступ к API, что делает их подходящими для организаций, которым нужно надёжно и в больших объёмах обрабатывать тысячи веб-страниц.

4. Есть ли инструменты, которые объединяют скрейпинг с автоматизацией и outreach?

Да, такие инструменты, как Clay и Bardeen, не только собирают веб-данные, но и встраивают их в рабочие процессы. Clay обогащает лиды и автоматизирует outreach, а Bardeen позволяет автоматизировать браузерные задачи и workflow с помощью AI-playbooks.

5. Какой вариант лучше всего подходит для пользователей без технического бэкграунда?

Для нетехнических пользователей особенно выделяется Thunderbit благодаря интерфейсу на естественном языке, AI-настройке и простоте использования. Он не требует ни кода, ни сложной настройки и идеально подходит бизнес-пользователям, которым нужны быстрые и надёжные данные без технической сложности.