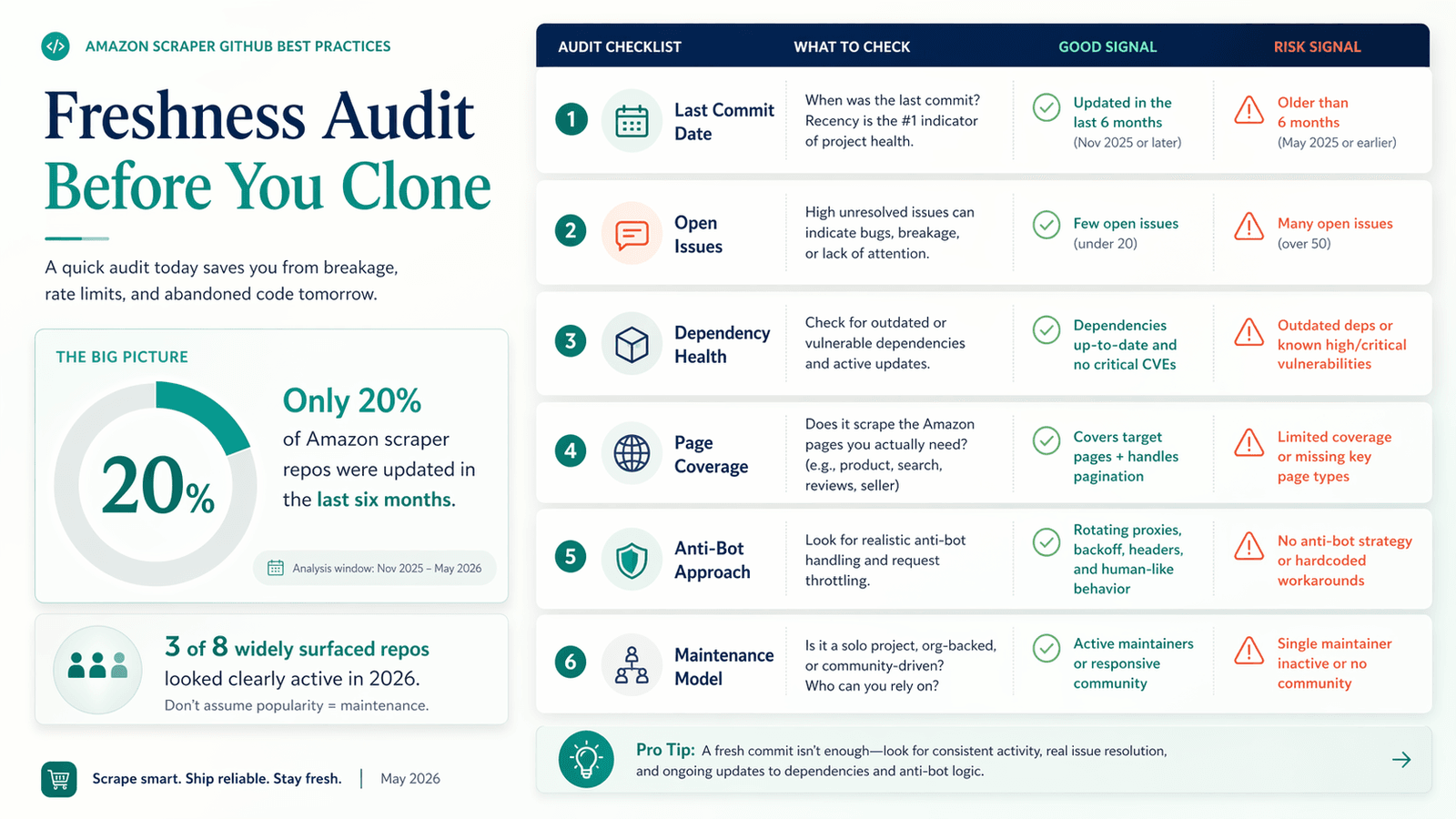

Поиск на GitHub по запросу "amazon scraper" возвращает примерно . Если сузить выборку до репозиториев, в которые пушили за последние шесть месяцев, останется около — то есть едва 20%. Остальные? Заброшенные туториалы, устаревшие обёртки и скрипты, которые перестали работать в тот же момент, когда Amazon ужесточил защиту.

Я потратил много времени, изучая репозитории Amazon scraper, читая GitHub Issues и следя за обсуждениями в Reddit и Stack Overflow. Картина везде одна и та же: кто-то находит популярный репозиторий, тратит час на настройку, запускает его один раз и упирается в стену CAPTCHA или ошибок 503. В 2026 году антибот-защита Amazon уже совсем не та, что даже два года назад: TLS-фингерпринтинг, поведенческий анализ и агрессивное использование CAPTCHA практически убили старую тактику «поменяй user-agent и надейся на лучшее». Это руководство разбирает практики, которые действительно важны, если вы хотите получать надёжные данные Amazon из GitHub-репозитория, и объясняет, что делать, когда скрейпер сломается — не если, а когда.

Что такое Amazon Scraper на GitHub (и почему так многие ломаются)?

Репозиторий Amazon scraper на GitHub — это обычно open-source-скрипт, чаще всего на Python, Node.js или на базе Scrapy, который извлекает структурированные данные со страниц Amazon. Цели извлечения знакомы всем: название товара, цена, ASIN, рейтинг, количество отзывов, наличие, информация о продавце, карточки результатов поиска и текст отзывов.

Обычно архитектура довольно простая:

- HTTP-клиент или headless-браузер загружает страницу.

- HTML- или JSON-парсер извлекает поля.

- Данные сохраняются в CSV, JSON или базу данных.

Репозитории обычно делятся на четыре категории:

- Лёгкие Python-библиотеки (например, )

- Scrapy-пауки (например, )

- Автоматизаторы браузера на Selenium или Playwright

- Проекты-обёртки над API, которые по сути являются фронтендом для коммерческого сервиса скрейпинга (например, )

Паттерн отказов предсказуем. Большинство репозиториев ломаются потому что:

- Amazon меняет макет страницы или HTML-фрагменты

- Amazon вместо реального контента отдаёт 503 или CAPTCHA

- TLS- и HTTP-фингерпринт скрипта больше не похож на браузерный

- Несовпадение локали, языка или заголовков вызывает подозрения

- Мейнтейнер уходит после решения своей исходной узкой задачи

Высокая популярность и реальная пригодность — это очень разные вещи. В аудите, который я провёл для этой статьи, только около трёх из восьми широко видимых репозиториев выглядели по-настоящему активными в 2026 году.

Проведите аудит свежести 2026 года, прежде чем клонировать любой Amazon Scraper GitHub-репозиторий

Для Amazon этот шаг важнее, чем для большинства других целей. Защитная политика Amazon меняется быстрее, чем у типичного e-commerce-сайта, поэтому репозиторий, который отлично работает на сайте-визитке, через пару недель может стать бесполезным на Amazon. И всё же большинство списков формата "best amazon scraper github" рекомендуют репозитории, не проверяя, работают ли они до сих пор. В итоге пользователи тратят часы на настройку сломанных инструментов.

Как проверить, жив ли GitHub-репозиторий

Прежде чем выполнять git clone, пройдитесь по этим пунктам:

- Дата последнего коммита: всё, что старше 6 месяцев, — серьёзный тревожный сигнал для Amazon.

- Открытые issues и скорость ответов: найдите в Issues слова "captcha", "503", "blocked" и "not working". Если жалобы копятся, а мейнтейнер не отвечает, лучше уйти.

- Состояние зависимостей: откройте

requirements.txtилиpackage.json. Устаревшие библиотеки (например, старыйrequestsбез современной TLS-обработки) — красный флаг. - Покрытие типов страниц Amazon: умеет ли репозиторий работать со страницами товаров, результатами поиска И ОТЗЫВАМИ? Или только с чем-то одним?

- Подход к антибот-защите: жёстко прописанные заголовки без поддержки прокси — это подход уровня 2023 года, который не переживёт 2026-й.

Чеклист свежести Amazon Scraper на GitHub

| Сигнал свежести | Что проверить | Красный флаг 🚩 |

|---|---|---|

| Дата последнего коммита | Лента коммитов или дата пуша в репозиторий | Старше 6 месяцев |

| Открытые issues | Вкладка Issues — фильтр по "captcha", "503", "blocked" | Повторяющиеся поломки без ответов мейнтейнера |

| Состояние зависимостей | requirements.txt / package.json | Устаревшие библиотеки, нет современной TLS-стратегии |

| Покрытие страниц Amazon | README + примеры кода | Работает только с одним типом страниц (например, страницы товаров, но не поиск и не отзывы) |

| Подход к антибот-защите | Исходный код, конфигурация прокси | Только жёстко заданные заголовки и строки UA |

| Модель поддержки | Это настоящий скрейпер, туториал или обёртка над коммерческим API? | Репозиторий на самом деле — всего лишь фронтенд платного сервиса |

Что показал аудит на самом деле

Я проверил восемь широко видимых репозиториев Amazon scraper по этим критериям. Результаты отрезвляют:

| Репозиторий / инструмент | Звёзды | Сигнал по последнему коммиту | Область применения | Статус в 2026 | Примечания |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2 872 | 2026-04-02 | Обёртка над управляемым API для скрейпинга | Жив, но не DIY | Свежий, но это по сути фронтенд к managed service |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | Управляемый API для поиска, карточек товаров и отзывов | Жив, но не DIY | Хорошее покрытие, но это API-продукт, а не сырой скрейпер |

| theonlyanil/amzpy | ~110 | 2026-02-26 | Лёгкая Python-библиотека | Жив | Самый очевидный прямой GitHub-скрейпер на базе curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | Только отзывы | Узкий, но рабочий | Старый и очень ориентирован только на отзывы |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | Последний коммит 2023; репозиторий пушили 2024-08-20 | Scrapy-пауки + proxy middleware | Уровень туториала, устаревает | Полезно для обучения, но не как готовый стек на 2026 год |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | Node CLI для поиска, карточек и отзывов | Высокий риск | Широкое покрытие, но поддержка слишком старая |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | От поиска до CSV | Мёртв для 2026 | Раньше был популярен, но явно устарел |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | Туториал по поиску / товарам | Мёртв для 2026 | По сути архивный проект |

Публичные issues рассказывают ту же историю. У есть issue с заголовком "All requests receive captcha response." У — "Doesn't seem to be working." У скрейпера — "Bypass Amazon protection." Это не редкие крайние случаи — это первое, с чем сталкиваются пользователи.

Антибан-плейбук: как не получить блокировку при работе с Amazon scraper из GitHub

Блокировка — главная боль для всех, кто использует проект amazon scraper github. Общие советы вроде «используйте прокси и меняйте user-agent» уже недостаточны. В 2025–2026 годах антибот-стек Amazon включает TLS-фингерпринтинг, поведенческий анализ и агрессивное внедрение CAPTCHA. Нужен многоуровневый подход.

Совпадение TLS-фингерпринта: почему обычный requests быстро приводит к бану

Это один из самых недооценённых антибан-методов. TLS-фингерпринтинг работает так: когда ваш скрипт открывает защищённое соединение с Amazon, сервер может многое понять о клиенте по тому, как тот «рукопожимается» — какие наборы шифров предлагает, в каком порядке идут расширения, какие настройки HTTP/2 использует. Браузеры применяют относительно фиксированные параметры TLS и HTTP/2, и эти комбинации можно идентифицировать по таким методам, как .

Обычный requests и стандартный httpx могут копировать заголовки, но не копируют TLS- и HTTP/2-поведение Chrome. Amazon видит разницу.

решает эту проблему напрямую. Он поддерживает имитацию браузера — среди целевых профилей есть chrome136, safari184 и firefox133, — так что TLS-фингерпринт вашего HTTP-клиента совпадает с реальным браузером. В документации прямо предупреждают: не стоит генерировать случайные строки JA3. Браузерные фингерпринты почти фиксированы для каждой версии, а случайная бессмыслица легче обнаруживается, чем копия реального отпечатка.

Данные сообщества это подтверждают. В подтверждается, что аргумент impersonate полезен: он переключает браузерные профили и сохраняет согласованность заголовков. Другой отмечает, что Amazon начинает блокировать клиентов по TLS-фингерпринту примерно «через месяц-два». В прямо спрашивают, фингерпринтит ли Amazon python-requests (спойлер: да).

Если вы всё ещё используете обычный requests как основной клиент для Amazon, сначала пересмотрите именно это предположение, а уже потом всё остальное.

Правильная ротация прокси, а не просто «используйте прокси»

Смысл прокси не в том, чтобы ротировать их как можно чаще. Смысл — сделать сессии правдоподобными.

Residential против datacenter: datacenter-прокси дешевле, но их проще обнаружить. Residential-прокси дороже, зато Amazonу их куда сложнее пометить. начинаются с $4.00/GB по модели pay-as-you-go и снижаются до $3.50/GB на более крупных планах. стартует с $6/GB. Amazon относится к категории «сложная цель», где premium на residential-прокси оправдан.

Ротация на каждый запрос или на сессию: здесь многие туториалы ошибаются. Ротация прокси на каждый запрос при постоянных cookie и заголовках может выглядеть менее по-человечески, а не более. Более безопасный паттерн такой:

- по возможности проходите путь поиск → товар → отзывы в рамках одной sticky-сессии

- меняйте сессию при начале нового поискового сценария, а не на каждом запросе

- ротируйте между сессиями, а не случайно внутри одной сессии браузинга

Один отметил, что обычные ISP-IP работают на популярных e-commerce-сайтах заметно хуже, чем mobile IP. Другой сообщил о блокировках даже при ротации user-agent и использовании residential-прокси — хорошее напоминание о том, что одних прокси недостаточно.

Темп запросов, backoff и ограничение скорости

Страницы 503 на Amazon — это не случайная неудача. Это сигнал.

о скрейпинге более 500 ASIN сообщил, что 503 стабильно возникал в одной и той же точке — примерно на ASIN 101 — даже с паузами. Паттерн старый, но вывод актуален: большой объём запросов с одного IP или одного фингерпринта рано или поздно срабатывает на защиту.

Лучшие практики темпа запросов для DIY GitHub-скрейперов:

- Случайные задержки между запросами, а не фиксированные интервалы, которые можно распознать

- 2–5 секунд между публичными запросами к товарам для простых HTTP-клиентов

- Экспоненциальный backoff после 503 или CAPTCHA — увеличивайте паузу, а не пытайтесь сразу повторять

- Меньшая параллельность, чем вам кажется необходимой

- Fail-open logging вместо жёстких бесконечных циклов повторов

У большинства Amazon scraper github-репозиториев встроенного ограничения скорости нет. Его придётся добавить самому.

Оркестрация заголовков: это не только строки User-Agent

Amazon проверяет весь набор заголовков, а не только User-Agent.

Реалистичный набор браузерных заголовков должен включать:

User-AgentAcceptAccept-LanguageAccept-Encoding- подсказки

Sec-CH-*там, где это уместно - поведение соединения, соответствующее выбранному браузерному профилю

Заголовки должны соответствовать локали маркетплейса. Один , заметил, что одна и та же бот-настройка детектируется только в некоторых локалях, а другой комментатор указал на региональные заголовки вроде Accept-Language.

Правило простое: заголовки, TLS/браузерный профиль и география прокси не должны противоречить друг другу. Не отправляйте заголовки Chrome с UA Firefox. Не используйте US-прокси вместе с Accept-Language: de-DE.

Работа с CAPTCHA: когда решать, а когда отступать

Появление CAPTCHA означает, что Amazon уже насторожился. Само по себе её решение не обнуляет уровень подозрительности.

Для единичных, редких CAPTCHA-событий:

- пакет в PyPI — это pure-Python-решатель текстовых CAPTCHA Amazon, хотя последняя версия вышла в мае 2023 года; воспринимайте его как тактический инструмент, а не долговременную стратегию

- указывает цену Amazon Captcha на уровне $0.45 за 1 000 решений

Для повторяющихся CAPTCHA-циклов:

- прекращайте решать и начинайте отступать

- повторные CAPTCHA означают, что сессия выгорела — решение не восстанавливает доверие к фингерпринту, истории сессии или репутации IP

- если CAPTCHA идут кластером по подсети прокси, проблема в сетевом слое, а не в парсере

Когда действительно нужен headless-браузер, а когда это избыточно

Неправильная интуиция — запускать Playwright вообще везде.

Хорошие сценарии для браузера:

- результаты поиска, зависящие от JavaScript-рендеринга или состояния локали

- сценарии с отзывами, которые перенаправляют на страницы входа или авторизации

- процессы, где cookies и браузерный контекст важнее сырой скорости

Плохие сценарии для браузера:

- обычные публичные страницы товаров

- извлечение статичных карточек товара, когда достаточно HTTP-клиента, похожего на браузер

- массовый сбор большого объёма, где важна вычислительная эффективность

Начинайте с самого лёгкого клиента, который работает. В одном о масштабном скрейпинге описан логичный путь: сначала requests, затем curl_cffi, и только потом полноценный браузер, если более лёгкие варианты не справляются. Headless-браузеры ощутимо медленнее и требуют больше ресурсов, чем HTTP-клиенты, если речь идёт о скрейпинге страниц товаров Amazon.

Матрица решений по антибану для Amazon Scraper GitHub-проектов

| Сценарий | Рекомендуемый подход | Почему |

|---|---|---|

| Публичные страницы товаров (малый масштаб) | curl_cffi + sticky residential-сессия | Самый дешёвый путь, который всё ещё выглядит браузероподобно |

| Страницы результатов поиска | Сначала curl_cffi, Playwright только если рендеринг или состояние ломают HTTP | Поиск более stateful и чувствителен к локали |

| Отзывы (нужен вход в аккаунт) | Режим браузера с реальными cookies / сессией | Вход и динамические потоки отзывов сложнее имитировать одним HTTP |

| Большой масштаб (5k+ в день) | Управляемый scraping API, unlocker или no-code-платформа | Один только DIY GitHub-код превращается в инфраструктурную проблему |

Когда ваш Amazon Scraper GitHub-проект ломается: нужен no-code запасной план

У каждого опытного скрейпера есть план B.

Обновления Amazon рано или поздно ломают любой GitHub-репозиторий — и обычно в самый неудобный момент. Для e-commerce-команд сломанный скрейпер означает упущенные изменения цен, устаревшие данные о конкурентах и дыры в дашбордах.

Многие, кто ищет "amazon scraper github", на самом деле бизнес-пользователи — e-commerce-операторы, маркетологи, исследователи FBA, — которые пробовали кодовые решения, потому что не нашли лучшего варианта. Данные форумов показывают и реальное недовольство официальным Amazon: жёсткий доступ, ограниченные данные и , которые многие продавцы не могут выполнить.

Почему Amazon-скрейперам на GitHub нужна постоянная поддержка

Приведённый выше аудит делает это очевидным:

- устаревшие репозитории копят отчёты о поломках без исправлений

- в README у "рабочих" репозиториев теперь прямо пишут об антибот-мерах

- обсуждения в сообществе всё чаще крутятся вокруг TLS-фингерпринтов, CAPTCHA-циклов и качества прокси — а не CSS-селекторов

Для бизнес-пользователей именно эта нагрузка на поддержку и есть настоящая скрытая стоимость. Репозиторий бесплатный. Ваше время, потраченное на отладку в 2 часа ночи, — нет.

Thunderbit как практичная альтернатива Amazon scraper

предлагает , который извлекает название, цену, ASIN, рейтинг, бренд, наличие, источник доставки и исходный URL — без написания кода.

Как это выглядит на практике:

- Скрейпинг в 2 клика вместо настройки Python-окружения, зависимостей и прокси-конфигов

- Мгновенный шаблон для Amazon — без AI-накладных расходов, просто извлечение в 1 клик

- Режим browser scraping для страниц, где требуется вход в аккаунт (например, страницы отзывов, которые мучают пользователей GitHub-скрейперов)

- Cloud scraping для публичных страниц товаров на скорости (по 50 страниц за раз)

- Бесплатный экспорт в Google Sheets, Airtable, Notion, Excel — не только в CSV/JSON

- Scheduled scraper для постоянного мониторинга цен

- AI адаптируется к изменениям макета — без нагрузки на вас по поддержке

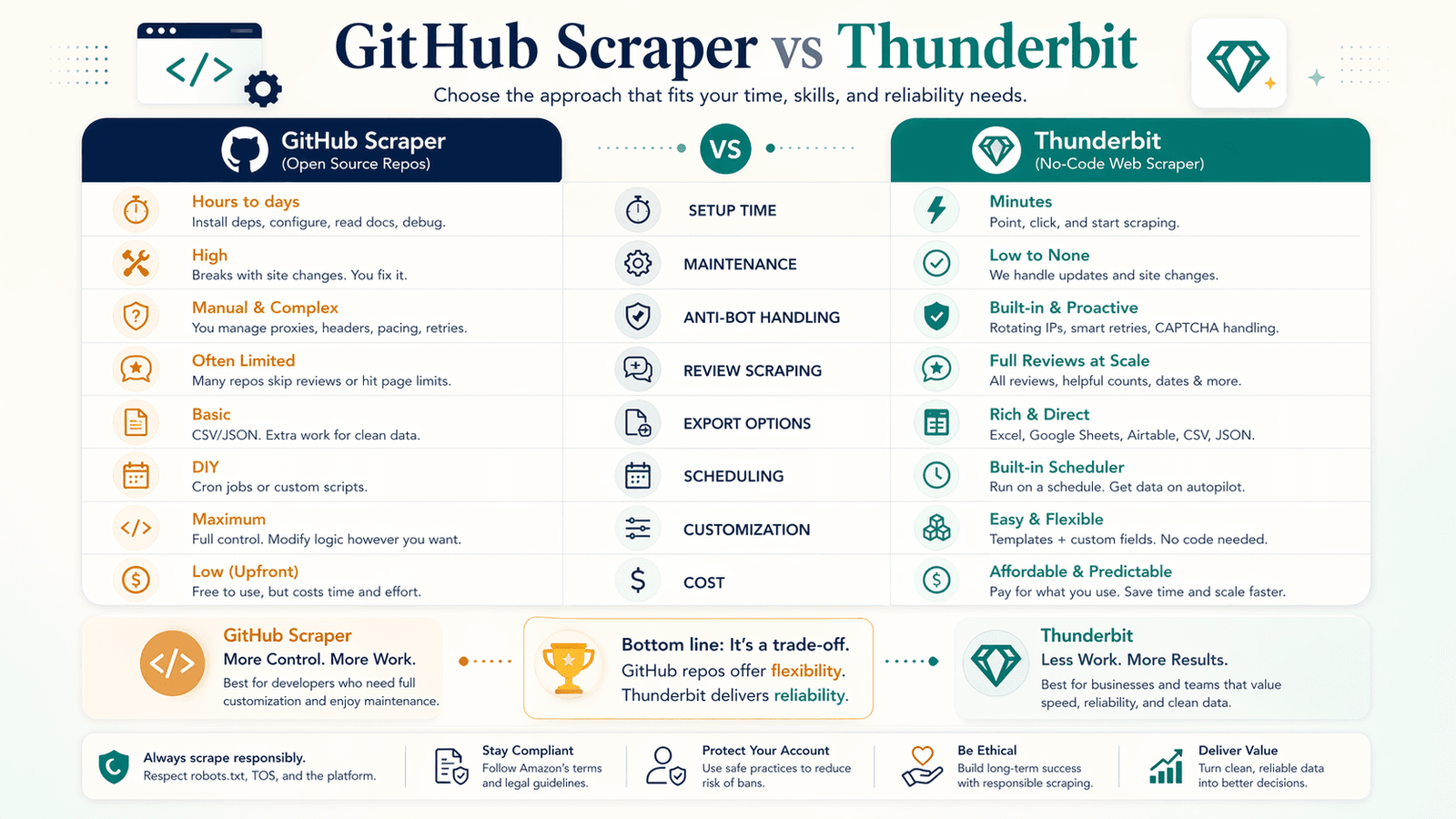

GitHub Amazon Scraper против Thunderbit: честное сравнение

| Фактор | GitHub-скрейпер (например, AmzPy) | Thunderbit |

|---|---|---|

| Время настройки | 15–60 мин (Python, зависимости, прокси) | ~2 мин (установить расширение Chrome) |

| Поддержка | Вы исправляете поломки | AI адаптируется к изменениям макета |

| Работа с антиботом | Самостоятельно (прокси, заголовки, TLS) | Встроено (cloud + browser режимы) |

| Скрейпинг отзывов (с входом) | Сложное управление сессиями | Режим browser scraping |

| Экспорт данных | Только CSV/JSON | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Расписание | Самостоятельно (cron, Airflow и т. д.) | Встроенный scheduled scraper |

| Кастомизация | Выше | Ниже |

| Стоимость | Бесплатно (плюс расходы на прокси) | Есть бесплатный тариф; кредитная модель |

Честный компромисс такой: GitHub-репозитории дают больше гибкости, а Thunderbit — больше надёжности. Если вашей команде важнее uptime, чем гибкость, no-code-путь обычно рациональнее.

Лучшие практики для планового и повторяющегося скрейпинга Amazon

Большинство amazon scraper github-проектов рассчитаны на разовый запуск, но реальные бизнес-сценарии — мониторинг цен, отслеживание запасов, анализ конкурентов — требуют повторяющихся скрейпов. Встроенного планировщика в GitHub-репозиториях почти никогда нет, поэтому пользователям приходится собирать всё через cron, Airflow или n8n.

Самостоятельное планирование для GitHub Amazon scraper

Минимально жизнеспособная схема повторного запуска:

- Cron job на Linux или macOS для запуска скрипта по расписанию

- Логи только на добавление (append-only), чтобы можно было разбирать сбои постфактум

- Дедупликация по ASIN + timestamp, чтобы не хранить дубли

- Оповещения об ошибках — даже простое письмо при ненулевом коде выхода — чтобы вы знали, когда запуск сломался в 3 часа ночи

Для более сложных команд:

- n8n для лёгкой автоматизации workflows (его часто упоминают в обсуждениях сообщества)

- Airflow для более тяжёлых плановых пайплайнов

- Состояние в базе данных, если нужны различия и история изменений

Ключевая best practice — не сам планировщик, а управление состоянием. Отслеживайте последний успешный запуск, последний набор ASIN, изменившиеся цены и неудачные URL.

Планирование становится проще с Thunderbit

в Thunderbit позволяет описать интервал обычным языком, вставить URL и нажать «Запланировать». AI переводит естественный язык в cron-расписание — без технической настройки. Для команд e-commerce без инженерного профиля, которые мониторят цены или запуск новых товаров у конкурентов, это существенно снижает операционные издержки.

Лучшие практики для повторяющихся скрейпов Amazon

Эти правила важны независимо от инструмента:

- Дедупликация по ASIN + временному окну timestamp — не сохраняйте один и тот же товар дважды за запуск

- Храните цены как числа, а не как сырые строки — это экономит очистку данных дальше по пайплайну

- Добавляйте timestamp скрейпа в каждую строку — он понадобится для анализа трендов

- Отслеживайте дельты, а не только текущее состояние — «цена упала на 12% с прошлой недели» полезнее, чем «цена $24.99»

- Оповещайте о значимых изменениях — падение цены конкурента на 15% заслуживает уведомления; колебание в 0.5% — шум

- Подумайте о хранении данных — плоские файлы годятся для небольших запусков; для 5k+ ASIN в день лучше база данных или облачная таблица

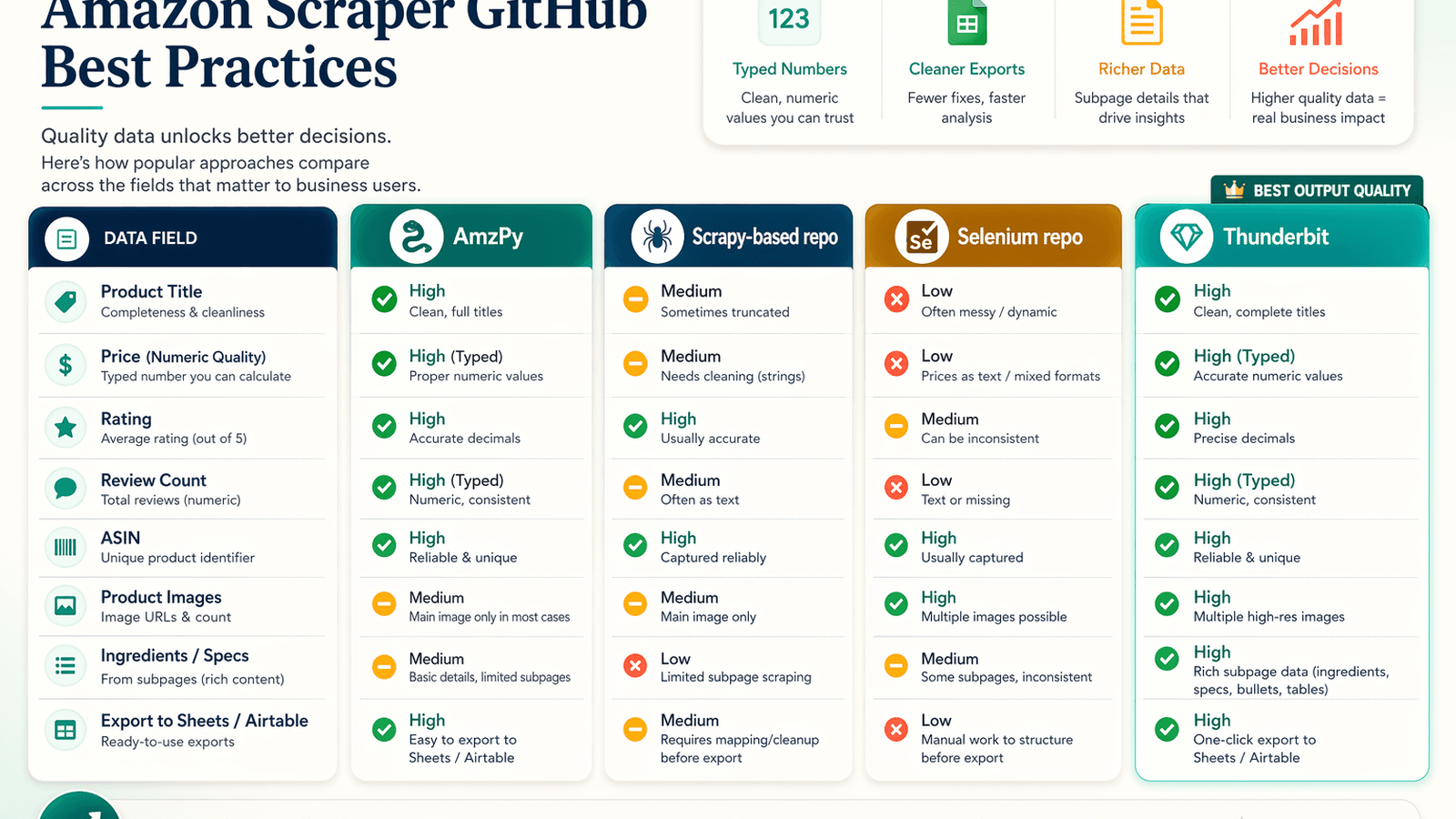

Качество вывода в сравнении: что на самом деле возвращает каждый подход Amazon Scraper GitHub

Никто не сравнивает качество реального вывода между Amazon scraper github-репозиториями. Пользователям очень важен data quality — «какой инструмент даёт самые чистые и полные данные» — но им приходится клонировать и тестировать каждый репозиторий самостоятельно. Этот раздел закрывает этот пробел.

Что популярные GitHub-репозитории реально извлекают, а что упускают

На основе примеров из README, публичных примеров и описанных форматов вывода:

| Подход | Что он явно извлекает | Типичные пробелы / компромиссы |

|---|---|---|

| amzpy | Название, цену, валюту, URL изображения, рейтинг, отзывы, варианты, ASIN | Ориентирован на страницы товаров; менее богатые данные по полным отзывам и спецификациям |

| tducret/amazon-scraper-python | CSV с названием, рейтингом, количеством отзывов, URL товара, URL изображения, ASIN | Устарел, сфокусирован на листингах, слабая антибот-история |

| python-scrapy-playbook scraper | Результаты поиска, страницы товаров, отзывы, пайплайны CSV/JSON | Уровень туториала; зависит от внешнего proxy middleware; вероятна дополнительная очистка |

| omkarcloud/amazon-scraper | Поиск, категории, карточки, топ-отзывы, много изображений / видео / спецификаций | Это не сырой скрейпер, а управляемый API-сервис |

| шаблон Thunderbit для Amazon | Название, цена, ASIN, бренд, рейтинг, отзывы, наличие, источник доставки, обогащение подстраниц | Меньше контроля на уровне кода, чем в кастомных скриптах |

Таблица сравнения качества вывода

| Поле данных | AmzPy | Репозиторий на Scrapy | Репозиторий на Selenium | Thunderbit |

|---|---|---|---|---|

| Название товара | ✅ | ✅ | ✅ | ✅ |

| Цена (числовой тип) | ⚠️ строка | ✅ | ⚠️ строка | ✅ (числовой тип) |

| Рейтинг | ✅ | ✅ | ✅ | ✅ |

| Количество отзывов | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Изображения товара | ❌ | ⚠️ только миниатюры | ✅ | ✅ (полное разрешение, можно экспортировать) |

| Ингредиенты / характеристики | ❌ | ❌ | ❌ | ✅ (через скрейпинг подстраниц + AI) |

| Экспорт в Sheets / Airtable | ❌ | ❌ | ❌ | ✅ бесплатно |

Почему форматирование данных важно для бизнес-пользователей

Грязные данные создают скрытую работу. Даже успешный скрейпер может стать операционной проблемой, если:

- цены хранятся как строки с символами валюты вместо чистых чисел

- пропуски представлены непоследовательно (пустая строка, null, "N/A")

- изображения — только низкокачественные миниатюры

- поля отзывов или характеристик нужно дополнительно обрабатывать перед анализом

Для команд e-commerce чистые данные напрямую влияют на скорость анализа и качество решений. AI в Thunderbit форматирует данные по типам — числа как числа, даты как даты, URL как URL — поэтому их можно использовать сразу. GitHub-репозитории сильно различаются в этом отношении, и время на очистку очень быстро накапливается.

Быстрый чеклист: лучшие практики Amazon Scraper GitHub

- Проверяйте дату последнего коммита перед клонированием. Старше шести месяцев — серьёзный тревожный сигнал для Amazon.

- Ищите issues по словам "captcha", "503", "blocked" и "not working" до настройки.

- Предпочитайте

curl_cffiили другой HTTP-клиент с имитацией браузера вместо обычногоrequests. - Держите заголовки, TLS-профиль, язык и географию прокси согласованными — никаких противоречий.

- Используйте sticky-сессии для навигационных сценариев; не ротируйте каждый запрос вслепую.

- Добавляйте случайный темп и exponential backoff.

- Считайте повторяющиеся CAPTCHA признаком сгоревшей сессии, а не головоломкой для перебора.

- Используйте headless-браузеры только тогда, когда HTTP-клиенты не могут надёжно воспроизвести страницу.

- Сохраняйте контрольные точки и состояние, чтобы неудачные запуски можно было безопасно продолжить.

- Имейте запасной план — будь то managed API или no-code-инструмент вроде .

Юридические и этические аспекты скрейпинга Amazon в 2026 году

Коротко о самом важном.

Подход Amazon остаётся жёстким и становится только жёстче. Самые сильные сигналы:

- На собственных справочных страницах Amazon теперь появляется с текстом: «To discuss automated access to Amazon data please contact api-services-support@amazon.com.»

- у Amazon запрещает широкий набор динамических путей, а также пути отзывов, профилей, списков желаний и offer-listing.

- прямо возражает против скрытого или маскируемого доступа агентов, обхода мер безопасности и выдачи агента за Google Chrome. Amazon также по этому инциденту.

- В конце 2025 года Amazon против crawlers OpenAI.

Практический риск явно выше, когда вы переходите от публичных страниц товаров к аутентифицированным потокам, замаскированной автоматизации или коммерческому извлечению больших объёмов. Это не юридическая консультация — по вашему конкретному случаю обращайтесь к своей legal-команде.

Главные выводы: как получать надёжные данные Amazon и не получать бан

По важности:

- Сначала аудит, потом clone. Считайте, что большинство результатов на GitHub устарели, являются туториалами или обёртками над коммерческими API.

- Сначала обновите сетевой слой. TLS-фингерпринтинг и согласованность сессии важнее, чем HTML-селекторы.

- Используйте sticky residential-сессии, а не хаотичную ротацию прокси. Ротируйте между сессиями, а не внутри них.

- Подавайте запросы как пользователь, а не как стресс-тест. Случайные задержки и exponential backoff обязательны.

- Решайте единичные CAPTCHA; выносите повторно атакуемые сессии из оборота. Не пытайтесь перебить уже сгоревший фингерпринт.

- Имейте запасной вариант. Amazon что-то поменяет в середине недели, и ваш GitHub-скрейпер сломается. Поддерживаемый no-code-инструмент вроде или managed API поможет сохранить пайплайн данных, пока вы отлаживаете.

- Ставьте качество вывода в приоритет. Чистые, типизированные данные экономят больше времени дальше по цепочке, чем быстрый, но грязный скрейпер.

Если вам важнее надёжность, чем кастомизация, Thunderbit предлагает поддерживаемую альтернативу — посмотрите или посмотрите обучающие материалы на . Разработчики, которым нужен полный контроль, вполне могут использовать GitHub-репозитории — но только с учётом антибан-практик и требований к поддержке, описанных в этом руководстве.

FAQ

Законно ли скрейпить данные товаров Amazon с помощью GitHub-скрейпера?

Условия использования Amazon ограничивают автоматизированный сбор данных, и Amazon активно применяет это на практике — через письма о прекращении и воздержании и технические меры противодействия, особенно в 2025–2026 годах. Скрейпинг публично доступных данных о товарах находится в серой зоне; скрейпинг за логином или маскировка бота под реальный браузер несёт более высокий риск. Это не юридическая консультация — обсудите ваш конкретный кейс с юристами.

Как часто ломаются GitHub-репозитории Amazon scraper?

Часто. Amazon регулярно меняет макеты страниц, добавляет новые уровни антибот-защиты и выводит endpoints из строя. В аудите для этой статьи только около 3 из 8 широко видимых репозиториев были явно рабочими в 2026 году. Даже у «рабочих» репозиториев нередко есть открытые issues про CAPTCHA и ошибки 503. Готовьтесь к отладке или обновлению настроек каждые несколько недель или месяцев.

Какой Amazon scraper на GitHub лучший в 2026 году?

Единого победителя нет — всё зависит от задачи и вашего технического уровня. Если нужен лёгкий прямой Python-скрейпер, — один из самых актуальных вариантов. Для более широкого покрытия через managed API подойдёт , но это не совсем DIY. Используйте чеклист свежести из этой статьи, чтобы самостоятельно оценить любой репозиторий до внедрения.

Может ли Thunderbit скрейпить Amazon без кода?

Да. в Thunderbit извлекает название товара, цену, ASIN, рейтинг, бренд, наличие и многое другое одним кликом. Он поддерживает режим browser scraping для страниц, где нужен вход, cloud scraping для быстрых публичных страниц, scheduled scraping для повторяющихся задач и бесплатный экспорт в Google Sheets, Airtable, Notion и Excel. Начать можно с установки .

Как избежать блокировки IP при скрейпинге Amazon?

Используйте многоуровневый подход: (1) замените обычный requests на клиент с TLS-имитацией, например curl_cffi, (2) используйте residential-прокси со sticky-сессиями вместо случайной ротации datacenter-прокси, (3) добавьте случайный темп и exponential backoff, (4) держите весь набор заголовков согласованным с браузерным профилем и локалью маркетплейса, и (5) рассматривайте повторные CAPTCHA как сигнал вывести сессию из оборота, а не как задачу для бесконечного решения. Подробнее см. матрицу решений по антибану выше в статье.